多元(重)线性回归分析

多元线性回归分析范例

多元线性回归分析范例多元线性回归是一种用于预测因变量和多个自变量之间关系的统计分析方法。

它假设因变量与自变量之间存在线性关系,并通过拟合一个多元线性模型来估计因变量的值。

在本文中,我们将使用一个实际的数据集来进行多元线性回归分析的范例。

数据集介绍:我们选取的数据集是一份汽车销售数据,包括了汽车的价格(因变量)和多个与汽车相关的特征(自变量),如车龄、行驶里程、汽车品牌等。

我们的目标是通过这些特征来预测汽车的价格。

数据集包括了100个样本。

数据集的构成如下:车龄(年),行驶里程(万公里),品牌,价格(万元)----------------------------------------5,10,A,153,5,B,207,12,C,10...,...,...,...建立多元线性回归模型:我们首先需要将数据集划分为自变量矩阵X和因变量向量y。

其中,自变量矩阵X包括了车龄、行驶里程和品牌等特征,因变量向量y包括了价格。

在Python中,我们可以使用NumPy和Pandas库来处理和分析数据。

我们可以使用Pandas的DataFrame来存储数据集,并使用NumPy的polyfit函数来拟合多元线性模型。

首先,我们导入所需的库并读取数据集:```pythonimport pandas as pdimport numpy as np#读取数据集data = pd.read_csv('car_sales.csv')```然后,我们将数据集划分为自变量矩阵X和因变量向量y:```python#划分自变量矩阵X和因变量向量yX = data[['车龄', '行驶里程', '品牌']]y = data['价格']```接下来,我们使用polyfit函数来拟合多元线性模型。

我们将自变量矩阵X和因变量向量y作为输入,并指定多项式的次数(线性模型的次数为1):```python#拟合多元线性模型coefficients = np.polyfit(X, y, deg=1)```最后,我们可以使用拟合得到的模型参数来预测新的样本。

多元线性回归分析

简介多元线性回归分析是一种统计技术,用于评估两个或多个自变量与因变量之间的关系。

它被用来解释基于自变量变化的因变量的变化。

这种技术被广泛用于许多领域,包括经济学、金融学、市场营销和社会科学。

在这篇文章中,我们将详细讨论多元线性回归分析。

我们将研究多元线性回归分析的假设,它是如何工作的,以及如何用它来进行预测。

最后,我们将讨论多元线性回归分析的一些限制,以及如何解决这些限制。

多元线性回归分析的假设在进行多元线性回归分析之前,有一些假设必须得到满足,才能使结果有效。

这些假设包括。

1)线性。

自变量和因变量之间的关系必须是线性的。

2)无多重共线性。

自变量之间不应高度相关。

3)无自相关性。

数据集内的连续观测值之间不应该有任何相关性。

4)同质性。

残差的方差应该在自变量的所有数值中保持不变。

5)正态性。

残差应遵循正态分布。

6)误差的独立性。

残差不应相互关联,也不应与数据集中的任何其他变量关联。

7)没有异常值。

数据集中不应有任何可能影响分析结果的异常值。

多重线性回归分析如何工作?多元线性回归分析是基于一个简单的数学方程,描述一个或多个自变量的变化如何影响因变量(Y)的变化。

这个方程被称为"回归方程",可以写成以下形式。

Y = β0 + β1X1 + β2X2 + ... + βnXn + ε 其中Y是因变量;X1到Xn是自变量;β0到βn是系数;ε是代表没有被任何自变量解释的随机变化的误差项(也被称为"噪音")。

系数(β0到βn)表示当所有其他因素保持不变时(即当所有其他自变量保持其平均值时),每个自变量对Y的变化有多大贡献。

例如,如果X1的系数为0.5,那么这意味着当所有其他因素保持不变时(即当所有其他独立变量保持其平均值时),X1每增加一单位,Y就会增加0.5单位。

同样,如果X2的系数为-0.3,那么这意味着当所有其他因素保持不变时(即所有其他独立变量保持其平均值时),X2每增加一个单位,Y就会减少0.3个单位。

多元线性回归分析

S /(n k 1) 或 t ˆi / cii

S /(n k 1)

c 式中 ii 是矩阵 (X ' X )1对角线上的第 i 个元素,S 表示残

差平方和 。 当检验统计量的值大于给定显著性下的临界值时,拒绝 原假设,认为回归系数是显著的

(六)利用已通过检验的回归方程进行预测。

市场调查

多元线性回归分析

多元线性回归是在简单线性回归基础上推广而来。是 用来分析多个自变量对多个因变量如何产生影响的,最常见 的是分析多个自变量对一个因变量的影响方向和影响程度。

一、多元线性回归分析在市场调查中的应用

(一)确定市场调查中因变量与自变量之间的关系 是否存在,若存在,还要分析自变量对因变量的影 响程度是多大,影响方向如何。

Yt

因变量

X it (i 1,2,, k)

自变量

i (i 1,2,, k)

总体回归系数

ut

随机误差项

作为总体回归方程的估计,样本回归方程如下:

Yˆt ˆ1 ˆ2 X 2t ˆ3 X3t ˆk X kt et

ˆi (i 1,2,, k)

总体回归系数的估计

t 1,2,, n

样本数

et 是 Yt与其估计 Yˆt之间的离差,即残差

(二)确定因变量和自变量之间的联系形式,关 键是要找出回归系数。

(三)利用已确定的因变量和自变量之间的方程 形式,在已知自变量的情况下,对因变量的取值 进行预测。

(四)在众多影响因变量的因素中,通过评价其 对因变量的贡献,来确定哪些自变量是重要的或 者说是比较重要的,为市场决策行为提供理论依 据。

(五)回归的显著性检验

包括对回归方程的显著性检验和对回归系数的显著性检验。

统计学中的回归分析方法

统计学中的回归分析方法回归分析是统计学中经常被使用的一种方法,它用于研究两个或多个变量之间的关系。

通过回归分析,我们可以预测一个变量如何随着其他变量的变化而变化,或者确定变量之间的因果关系。

在本文中,我将介绍几种常见的回归分析方法,帮助读者更好地理解和应用这一统计学方法。

一、简单线性回归分析简单线性回归分析是回归分析的最基本形式。

它适用于只涉及两个变量的场景,并且假设变量之间的关系可以用一条直线来描述。

在进行简单线性回归分析时,我们需要收集一组观测数据,并使用最小二乘法来拟合直线模型,从而得到最优的回归方程。

通过该方程,我们可以根据自变量的取值预测因变量的值,或者评估自变量对因变量的影响程度。

二、多元线性回归分析多元线性回归分析扩展了简单线性回归模型,允许多个自变量同时对因变量进行解释和预测。

当我们要考察一个因变量与多个自变量之间的复杂关系时,多元线性回归分析是一种有力的工具。

在进行多元线性回归分析时,我们需收集多组观测数据,并建立一个包含多个自变量的回归模型。

通过拟合最优的回归方程,我们可以分析每个自变量对因变量的影响,进一步理解变量之间的关系。

三、逻辑回归分析逻辑回归分析是回归分析的一种特殊形式,用于处理因变量为二元变量(如真与假)时的回归问题。

逻辑回归分析的目标是根据自变量的取值,对因变量的分类进行概率预测。

逻辑回归模型是通过将线性回归模型的输出映射到一个概率区间(通常为0到1)来实现的。

逻辑回归在实际应用中非常广泛,如市场预测、医学诊断等领域。

四、岭回归分析岭回归是一种用于解决多重共线性问题的回归分析方法。

多重共线性指多个自变量之间存在高度相关性的情况,这会导致回归分析结果不稳定。

岭回归通过在最小二乘法的基础上加入一个惩罚项,使得回归系数的估计更加稳定。

岭回归分析的目标是获得一个优化的回归方程,从而在存在多重共线性的情况下提高预测准确度。

五、非线性回归分析在某些情况下,变量之间的关系不是线性的,而是呈现出曲线或其他非线性形态。

回归分析方法总结全面

回归分析方法总结全面回归分析是一种常用的统计分析方法,用于建立一个或多个自变量与因变量之间的关系模型,并进行预测和解释。

在许多研究领域和实际应用中,回归分析被广泛使用。

下面是对回归分析方法的全面总结。

1.简单线性回归分析:简单线性回归分析是最基本的回归分析方法之一,用于建立一个自变量和一个因变量之间的线性关系模型。

它的方程为Y=a+bX,其中Y是因变量,X是自变量,a是截距,b是斜率。

通过最小二乘法估计参数a和b,可以用于预测因变量的值。

2. 多元线性回归分析:多元线性回归分析是在简单线性回归的基础上扩展的方法,用于建立多个自变量和一个因变量之间的线性关系模型。

它的方程为Y = a + b1X1 + b2X2 + ... + bnXn,其中n是自变量的个数。

通过最小二乘法估计参数a和bi,可以用于预测因变量的值。

3.对数线性回归分析:对数线性回归分析是在简单线性回归或多元线性回归的基础上,将自变量或因变量取对数后建立的模型。

这种方法适用于因变量和自变量之间呈现指数关系的情况。

对数线性回归分析可以通过最小二乘法进行参数估计,并用于预测因变量的对数。

4.多项式回归分析:多项式回归分析是在多元线性回归的基础上,将自变量进行多项式变换后建立的模型。

它可以用于捕捉自变量和因变量之间的非线性关系。

多项式回归分析可以通过最小二乘法估计参数,并进行预测。

5.非线性回归分析:非线性回归分析是一种更一般的回归分析方法,用于建立自变量和因变量之间的非线性关系模型。

这种方法可以适用于任意形式的非线性关系。

非线性回归分析可以通过最小二乘法或其他拟合方法进行参数估计,用于预测因变量的值。

6.逐步回归分析:逐步回归分析是一种变量选择方法,用于确定最重要的自变量对因变量的解释程度。

它可以帮助选择最佳的自变量组合,建立最合适的回归模型。

逐步回归分析可以根据其中一种准则(如逐步回归F检验、最大似然比等)逐步添加或删除自变量,直到最佳模型被找到为止。

《医学统计学》之多元(重)线性回归

多元(重)线性回归模型的假设

1 线性关系

假设自变量与因变量之间存在线性关系,即因变量可以用自变量的线性组合来表示。

2 独立性

假设误差项之间相互独立,即每个观测值的误差项不受其他观测值的影响。

3 常数方差

假设误差项具有常数方差,即各个观测值的误差方差相同。

多元(重)线性回归模型的估计方法

最小二乘法

多元(重)线性回归模型的模型选择方法

前向选择法

从不包含自变量的空模型开 始,逐步添加自变量,选择 最佳的组合。

后向消除法

从包含所有自变量的全模型 开始,逐步删除自变量,选 择最简单且最有效的模型。

逐步回归法

结合前向选择法和后向消除 法,逐步调整自变量,找到 最优的模型。

多元(重)线性回归模型的实际应用

医学研究

用于分析多个影响因素对疾病发生、病程进展和治 疗效果的影响。

市场分析

用于预测市场需求和销售量,并确定最佳的市场推 广策略。

财务预测

社会科学

用于预测企业的财务状况,并制定相应的经营决策。

用于研究社会现象和群体行为,解释和预测社会现 象的变化。

通过方差膨胀因子等指标,判断自变量之间是否存在高度相关性,以避免估计结果的不 准确性。

多元(重)线性回归模型的模型检验

1

残差分析

通过观察残差的分布和模式,检验回归模型是否符合基本假设。

2

拟合优度检验

通过比较拟合优度指标(如决定系数R²)和假设分布,评估回归模型的拟合程度。

3

异常值检验

通过检测异常值对回归分析结果的影响,判断数据中是否存在异常观测值。

《医学统计学》之多元 (重)线性回归

在医学统计学中,多元(重)线性回归是一种强大的数据分析方法,可用于探索 和建立多个自变量与因变量之间的关系。

《医学统计学》之多元(重)线性回归

在本课程中,我们将深入研究医学统计学中的多元(重)线性回归分析。掌握回 归模型的基础知识,并学习如何评估模型、诊断回归方程以及拟合策略。

模块一:回归分析基础知识

了解回归分析的基本原理和应用场景,掌握回归方程的建立和参数估计的方 法。

模块二:多元线性回归模型

学习多元线性回归模型的概念、假设条件和模型参数的估计方法。

模块七:应用案例与实战经验

通过真实的医学案例和实战经验,加深对多元(重)线性回归的理解,并了解统计概念,包括方差膨胀因子、共线性检验和异常值检测。

模块四:模型评估与解释

学习如何评估回归模型的拟合优度和预测精度,并解释模型中的系数含义。

模块五:回归诊断

掌握回归诊断的基本方法,包括残差分析、离群值检测和共线性诊断。

模块六:回归模型拟合策略

学习选择合适的自变量、建立最佳模型和验证模型的方法,以及防止过拟合和欠拟合。

SPSS—回归—多元线性回归结果分析(二)

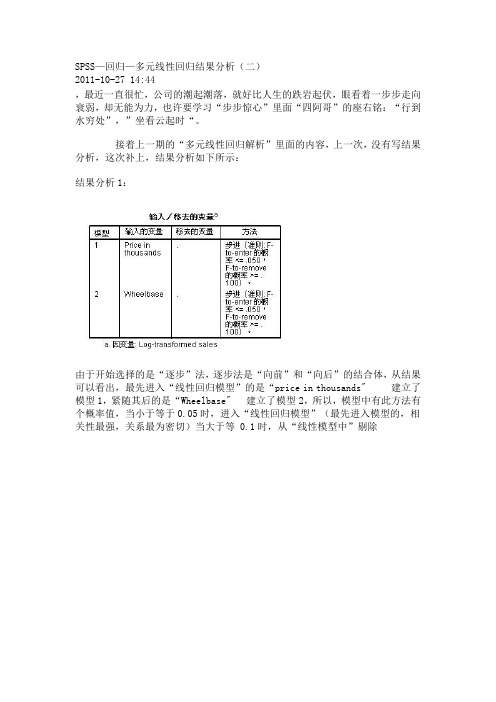

SPSS—回归—多元线性回归结果分析(二)2011-10-27 14:44,最近一直很忙,公司的潮起潮落,就好比人生的跌岩起伏,眼看着一步步走向衰弱,却无能为力,也许要学习“步步惊心”里面“四阿哥”的座右铭:“行到水穷处”,”坐看云起时“。

接着上一期的“多元线性回归解析”里面的内容,上一次,没有写结果分析,这次补上,结果分析如下所示:结果分析1:由于开始选择的是“逐步”法,逐步法是“向前”和“向后”的结合体,从结果可以看出,最先进入“线性回归模型”的是“price in thousands"建立了模型1,紧随其后的是“Wheelbase"建立了模型2,所以,模型中有此方法有个概率值,当小于等于0.05时,进入“线性回归模型”(最先进入模型的,相关性最强,关系最为密切)当大于等 0.1时,从“线性模型中”剔除结果分析:1:从“模型汇总”中可以看出,有两个模型,(模型1和模型2)从R2 拟合优度来看,模型2的拟合优度明显比模型1要好一些(0.422>0.300)2:从“Anova"表中,可以看出“模型2”中的“回归平方和”为115.311,“残差平方和”为153.072,由于总平方和= 回归平方和+残差平方和,由于残差平方和(即指随即误差,不可解释的误差)由于“回归平方和”跟“残差平方和”几乎接近,所有,此线性回归模型只解释了总平方和的一半,3:根据后面的“F统计量”的概率值为0.00,由于0.00<0.01,随着“自变量”的引入,其显著性概率值均远小于 0.01,所以可以显著地拒绝总体回归系数为0的原假设,通过ANOVA方差分析表可以看出“销售量”与“价格”和“轴距”之间存在着线性关系,至于线性关系的强弱,需要进一步进行分析。

结果分析:1:从“已排除的变量”表中,可以看出:“模型2”中各变量的T检的概率值都大于“0.05”所以,不能够引入“线性回归模型”必须剔除。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

两自变量与应变量的散点图

两自变量与应变量的拟合面

bj 为 xj方向

的斜率

(二)多元线性回归分析的一般步骤

同济医学院卫生统计

二、采用 最小二乘法 建立多元线性回归方程

同济医学院卫生统计

表

15-1 32 例

40 岁 以 上 男 性 的

Quetelet 体 重 指 数

、

年 龄

、

吸 烟 与 收 缩 压 实 测 值

第三节 模型的变量筛选

根据一些准则(criterion)建立 “最优”回归模型

校正决定系数(考虑了自变量的个数) Cp准则(C即criterion,p为所选模型中变 量的个数;Cp接近(p+1)模型为最优) AIC(Akaike’s Information Criterion)准则; AIC越小越好

第十五章 多元(重)线性回归分析 Multiple linear regression

《医学统计学》 宇围 血压值与年龄、性别、劳动强度、饮食 习惯、吸烟状况、家族史 糖尿病人的血糖与胰岛素、糖化血红蛋 白、血清总胆固醇、甘油三脂 射频治疗仪定向治疗脑肿瘤过程中,脑 皮质的毁损半径与辐射的温度、与照射的 时间

同济医学院卫生统计

二、各回归系数的t检验

Parameter Variable DF Estimate 变量 自由度 回归系数 Standard Error t Value 标准误 t值 Standardized Pr > |t| Estimate P值 标准化回归系数

Intercept 28 x1 28 x2 28 x3 28

同济医学院卫生统计

表15-1 32例40岁以上男性的年龄、吸烟、 体重指数与收缩压

同济医学院卫生统计

多元回归分析数据格式

同济医学院卫生统计

第一节 多元线性回归模型

一、回归模型简介

同济医学院卫生统计

(一)多元线性回归模型的一般形式

ˆ Y b0 b1 X 1 bm X m

同济医学院卫生统计

3.962 4.01

第二节 回归方程的假设检验与评价

一、回归方程的假设检验 二、偏回归系数的假设检验 三、有关评价指标

同济医学院卫生统计

一、回归方程的方差分析

(H0:所有总体回归系数bj为0)

Analysis of Variance Sum of Mean Source DF Squares Square F Value Pr > F Model 3 5052.61828 1684.20609 36.58 <.0001 Error 28 1289.25672 46.04488 Corrected Total 31 6341.87500

说明所有自变量能解释Y变异的百分比。 取值(0,1),越接近1模型拟合越好

同济医学院卫生统计

3. 复相关系数 ( multiple correlation coefficient)

R R 0.7967 0.8926

2

说明所有自变量与Y间的线性相关程度。 ˆ 即 Y 与Y间的相关程度。

(SS回-SS回-j) /1 F SS 残 /(32 3 1)

同济医学院卫生统计

一、 全局择优法 二、 逐步回归法

第四节 自变量的选择

同济医学院卫生统计

一、全局择优法

根据一些准则(criterion)建立 “最优”回归模型

校正决定系数(考虑了自变量的个数) Cp准则(C即criterion,p为所选模型中变 量的个数;Cp接近(p+1)模型为最优) AIC(Akaike’s Information Criterion)准则; AIC越小越好

R 2|1,2,..., j 1, j 1,..., p为X j 与其余自变量间的决定系数 j

同济医学院卫生统计

标准化回归系数 (可说明各自变量相对贡献大小)

变量

常数项 X1 X2 X3 Y

回归系数

bj

42.78878 1.43184 9.49043 5.83908

标准化 回归系数b’j

0.00000 0.68980 0.33641 0.20293

Variable Intercept x1 x2 x3

DF 1 1 1 1

28

分别为参数估计值b0、b1、b2、b3

SAS软件输出结果

data a; input no y x1-x3; cards; 1 135 45 0 2 122 41 0 。。。 31 152 62 0 32 164 65 0 ; proc reg; model y=x1-x3/stb; run; 2.876 3.251

Root MSE R-Square Adj R-Sq Dependent (剩余标准差) 6.7856 (决定系数) 0.7967 (校正决定系数) 0.7749 Mean 应变量Y 的均值=144.43750

同济医学院卫生统计

1. 剩余标准差( Root MSE ) ˆ )2 /(n p 1) S (Y Y

同济医学院卫生统计

有关计算公式

同济医学院卫生统计

有关计算公式

SSTotal (Yi Y )

i1 N N

Y

2

SS model (Yi Y )2 SSerror (Yi Yi )2

i1 i1 N

X1

X2

Total SS Model SS Residual SS

x x

1

2

32

同济医学院卫生统计

表15-1有三个自变量 ˆ 使Q (Y Y )2 [Y (b0 b1 x1 b2 x2 b3 x3 )]2 最小

也可采用矩阵计算偏回归系数向量 B X ' X X 'Y

1

同济医学院卫生统计

SAS软件输出结果

Parameter Estimates Parameter Estimate 42.78878 1.43184 9.49043 5.83908 Standard Error t Value 9.88159 0.31057 2.42174 4.28754 4.33 4.61 3.92 1.36 Standardized Pr > |t| Estimate 0.0002 <.0001 0.0005 0.1841 0 0.68980 0.33641 0.20293

1 1 0 0 1 0 0 0 1 1 0 1 0 1 0 0

3.360 3.024 3.171 3.401 3.628 3.751 3.296 3.210 3.301 3.017 2.789 2.956 3.800 4.132 3.962 4.010

同济医学院卫生统计

同济医学院卫生统计

表15-1有三个自变量 ˆ 使Q (Y Y )2 [Y (b0 b1 x1 b2 x2 b3 x3 )]2 最小

Y |12... p

SS残 (n p 1 MS残 ) 46.04488 6.78564

反映了回归方程的精度,其值越小说明回归 效果越好

同济医学院卫生统计

2.决定系数 ( determination coefficient)

SS残 SS回 R 1 SS总 SS总

2

5052.61828 1289.25672 =1 0.7967 6341.87500 6341.87500

Fj

SS回 SS回( j ) SS残 (n p 1)

; 1 1; 2 n p 1

Fj

SS回 SS回( j ) SS残 (n p 1)

; 1 1; 2 n p 1

Reduced Model Full Model

实例计算

用表 15-1 数据计算偏回归平方和,并进行 F 检验

平方和 方程的自变量 X1,X2,X3 X2,X3 X1,X3 X1,X2 方程 SS 回 5052.618 4073.880 4345.492 4967.219 SS 回-SS 回-j 978.738 707.126 85.399 SS 残 1289.257 21.256 15.357 1.855 4.61 3.92 1.36 0.0001 0.0005 0.1841 F值 t值 P值

l11b1 l12b2 l13b3 l1Y l21b1 l22b2 l23b3 l2Y l b l b l b l 31 1 32 2 33 3 3Y b0 Y (b1 x1 b2 x2 b3 x3 ) l12 l21 ( x1 x1 )( x2 x2 ) x1 x2

ljj

标准差

S

6.890561 0.507007 0.497078 14.30303

1471.875 7.969 7.660 6341.875

bj b j

l jj lYY

bj

l jj /(n 1) lYY /(n 1)

bj

Sj SY

同济医学院卫生统计

三、有关评价指标

(软件有关结果)

42.78878 1.43184 9.49043 5.83908

9.88159 0.31057 2.42174 4.28754

4.33 4.61 3.92 1.36

0.0002 <.0001 0.0005 0.1841

0 0.68980 0.33641 0.20293

t j b j Sb j b j ( SY |12... p C j ), n p 1; Cj 1 l jj (1 R 2|1,2,..., j 1, j 1,..., p ) j

如果只有一个自变量,此时 R | r |

同济医学院卫生统计