离散信源题与答案

信息论习题——精选推荐

选择题1、离散有记忆信源],[21x x X =,12()()0.5P x P x ==,其极限熵H ∞ 。

A 、1bit >B 、1bit <C 、1bit =D 、不能确定2、任意离散随机变量X 、Y 、Z , 必定成立A 、)|()|(XZ Y H YZ X H =B 、)()()()(Z H Y H X H XYZ H ++=C 、)|()|(Y X H YZ X H ≤D 、0)|;(=Z Y X I3、|Y X P 给定时,(;)I X Y 是X P 的 函数。

A 、上凸B 、下凸C 、上升D 、下降4、使(;)I X Y 达到最大的 称为最佳分布。

A 、联合分布B 、后验分布C 、输出分布D 、输入分布5、离散平稳无记忆信源],[21x x X =,且bit X H 1)(=,则=)(1x P 。

A 、41B 、2C 、1D 、216、=);(Y X I 。

A 、)|()(X Y H X H -B 、)|()(Y X H Y H +C 、)|()(X Y H Y H -D 、)()(X H XY H -7、通常所说的“连续信源”是指 信源。

A 、时间连续且取值连续的B 、取值连续C 、时间离散且取值连续的D 、时间连续8、已知信道,意味着已知 。

A 、 先验分布B 、转移概率分布C 、 输入输出联合概率分布D 、输出概率分布9、已知X Y P |,可求出A 、)(XY HB 、 )|(X Y HC 、);(Y X ID 、)|(i j x y I10、连续信源的输出可用 来描述A 、常量B 、变量C 、离散随机变量D 、连续随机变量11、101)(=i x P ,则=)(i x I 。

A 、bit 10lnB 、dit 10lnC 、dit 1D 、dit 10log12、信道容量表征信道的 。

A 、最大通过能力B 、最大尺寸C 、最小通过能力D 、最小尺寸13、DMS 的信息含量效率等于信源的实际熵 信源的最大熵。

2024年国家电网招聘之通信类真题精选附答案

2024年国家电网招聘之通信类真题精选附答案单选题(共45题)1、离散信源输出5个不同符号,若各符号概率分别为1/2,1/4,1/8,1/16,1/16,则该信源的熵为()。

A.1.5bit/signB.1.875bit/signC.2bit/signD.1bit/sign【答案】 B2、()是在接收端逐个统计不相关的分集支路,经过相位校正,并按适当的可变增益加权再相加后送入检测器进行相干检测。

此方法合并效果最好,但实现较复杂。

A.收发合并B.最大比合并C.等增益合并D.选择性合并【答案】 B3、IPPON的上层是(),这种方式可更加充分地利用网络资源,容易实现系统带宽的动态分配,简化中间层的复杂设备。

A.数据链路层B.物理层C.IP层D.网络层【答案】 C4、某省游泳队进行了为期一个月的高原集训,集训最后一日所有队员进行了一次队内测试,几位教练預测了一下队员的成绩:张教练说:这次集训时间短,没人会达标。

孙教练说:有队员会达标。

王教练说:省运会冠军或国家队队员可达标。

测试结束后,只有一位教练的预测是正确的。

由此可以推出( )A.没有人达标B.全队都达标了C.省运会冠军达标D.国家队队员未达标【答案】 D5、用于连接数字程控交换系统和数字用户终端设备之间的接口电路是()接口。

A.模拟用户B.数字用户C.模拟中继D.数字中继【答案】 B6、下列描述中,不属于 IP 层实现的功能是()A.尽力而为的不可靠传输服务B.数据报的分段与重组C.确定主机进程间的接口D.报文交换、TAM 交换【答案】 D7、连续信道的信道容量将受到“三要素”的限制,其“三要素”是()。

A.带宽、信号功率、信息量B.带宽、信号功率、噪声功率谱密度C.带宽、信号功率、噪声功率D.信息量、带宽、噪声功率谱密度【答案】 B8、当电磁波和障碍物符合()条件时,比较容易发生绕射现象。

A.障碍物为金属表面B.障碍物尺寸与波长相似或者更小C.障碍物尺寸远远大于波长D.障碍物表面粗糙【答案】 B9、根据《建设项目环境影响评价资质管理办法》,评价机构每年须填写“建设项目环境影响评价机构年度业绩报告表”,于()前报国家环境保护总局。

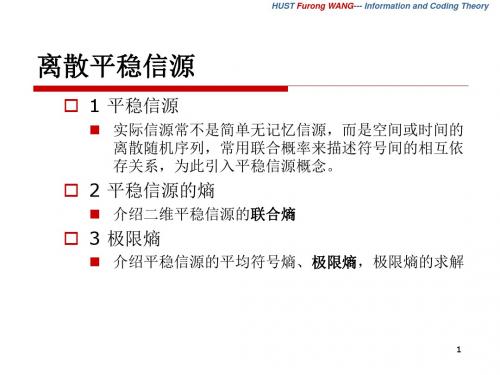

2223离散平稳信源

3 极限熵

介绍平稳信源的平均符号熵、极限熵,极限熵的求解

1

HUST Furong WANG--- Information and Coding Theory

平稳信源

1、所有X i , i 1, 2,...都取值于有限的信源符号集A x1 , x2 ,..., xn 2、随机序列是平稳的,即对所有非负整数i1 , i2 ,..., iN , h 有 P X i1 , X i2 ,..., X iN P X i1 h , X i2 h ,..., X iN h 则称此信源为离散平稳信源。 定义:若信源产生的随机序列X i , i 1, 2,...满足

13

HUST Furong WANG--- Information and Coding Theory

二维平稳信源的熵-例题

例:设二维离散信源X X 1 X 2的原始信源X 的 x1 x2 x3 X 信源模型为 1 4 11 P( X ) 4 9 36 X X 1 X 2中前后两个符号的条件概率如下表。

由于条件熵小于无条件熵,所以 H(X1X2)= H(X1)+ H(X2/X1) H(X1X2)≤H(X1)+ H(X2)

说明二维离散平稳有记忆信源的熵小于等于 二维离散平稳无记忆信源的熵

对于二维离散平稳无记忆信源X2=X1X2来说, X1对X2不产生任何影响。 对于二维离散平稳有记忆信源,由于X1和X2有 统计依赖关系, X1的发生会提供X2的部分相关 信息。

一维平稳信源无论在什么时刻均以 p( x1 ), p( x2 ), ...,p( xn )分布发出符号。

3

HUST Furong WANG--- Information and Coding Theory

信息论试题8

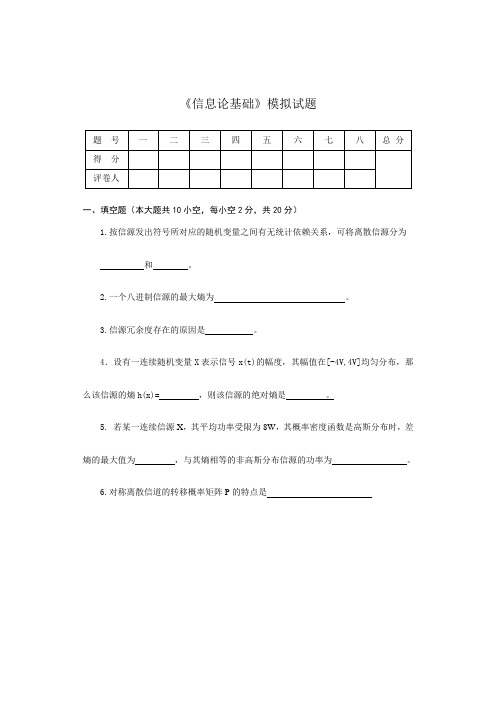

《信息论基础》模拟试题一、填空题(本大题共10小空,每小空2分,共20分)1.按信源发出符号所对应的随机变量之间有无统计依赖关系,可将离散信源分为和。

2.一个八进制信源的最大熵为。

3.信源冗余度存在的原因是。

4.设有一连续随机变量X表示信号x(t)的幅度,其幅值在[-4V,4V]均匀分布,那么该信源的熵h(x)= ,则该信源的绝对熵是。

5.若某一连续信源X,其平均功率受限为8W,其概率密度函数是高斯分布时,差熵的最大值为,与其熵相等的非高斯分布信源的功率为。

6.对称离散信道的转移概率矩阵P的特点是二、掷两粒骰子,各面出现的概率都是1/6,计算信息量:1.两骰子面朝上点数之和为2,该消息包含的信息量是多少?(3分)2.两骰子面朝上点数之和为8时,该消息包含的信息量是多少?(3分)3.两骰子面朝上点数是3和4,该消息包含的信息量是多少?(3分)三、设X,Y是二个相互统计独立的二元随机变量,其取-1或1的概率相等。

定义另一个二元随机变量Z,取Z=X+Y。

试计算:1.H(Y)、H(Z); (6分)2.H(XY); (3分)3.I(X;Y),I(Y;Z). (8分)四、一阶马尔可夫链信源有3个符号{a,b,c},转移概率为:P(a/a)=1/2,p(b/a)=1/4,p(c/a)=1/4,p(a/b)=1/2,p(b/b)=0,p(c/b)=1/2,p(a/c)=1/2, p(b/c)=1/2,p(c/c)=0。

1.画出状态图;写出转移概率矩阵;(6分)2.求出各符号稳态概率;(6分)3.计算其极限滴;(4分)五、在干扰离散对称信道上传输符号1和0,已知p(0)=1/4,p(1)=3/4,试求:1 该信道的转移概率矩阵P(3分)2 该信道的信道容量及其输入概率分布(7分)六、某信道的转移矩阵0.50.30.200.30.500.2 p⎡⎤=⎢⎥⎣⎦试求:该信道的信道容量及最佳输入概率分布。

(6分)七、设在平均功率受限高斯可加波形信道中,信道宽带为5KHZ,又设信噪比为20db1 试计算该信道的信道容量;(3分)2 若功率信噪比降为10db,要达到相同的最大信息传输率,信道带宽应是多少?(3分)八、信源符号X有6种字母,概率为0.25,0.2,0.16,0.15,0.1,0.07,0.04,0.03. 用霍夫曼编码法编成二进制变长码,写出编程过程并计算:(共16分)1.编码前信源X的信源剩余度,2.平均码长3.编码效率。

信息论与编码实验一离散信源信息量的计算

信息论与编码实验一离散信源信息量的计算【实用版】目录一、信息论与编码实验一概述二、离散信源的定义与分类三、离散信源信息量的计算方法四、实验过程及结果分析五、总结正文一、信息论与编码实验一概述信息论与编码实验一是一门关于信息论的基本概念和方法的实验课程。

信息论是研究信息传输、存储、处理和控制的科学,其目的是为了提高通信系统的效率和可靠性。

实验一的主要目的是让学生了解离散信源的定义、性质和计算方法,并掌握如何使用 Matlab 软件进行离散信源信息量的计算。

二、离散信源的定义与分类离散信源是指其输出信号为离散信号的信源,常见的离散信源有伯努利信源、马尔可夫信源等。

根据信源的性质和特点,离散信源可以分为离散无记忆信源和离散有记忆信源。

离散无记忆信源是指信源的输出信号只与当前输入信号有关,而与过去的输入信号无关;离散有记忆信源是指信源的输出信号与过去的输入信号有关。

三、离散信源信息量的计算方法离散信源的信息量是指信源输出的符号所包含的信息量,通常用比特(bit)来表示。

离散信源的信息量的计算方法主要有两种:一种是基于概率的计算方法,另一种是基于熵的计算方法。

基于概率的计算方法是通过计算信源输出符号的概率来计算信息量;基于熵的计算方法是通过计算信源的熵来计算信息量。

熵是信息论中用于度量信息量的一个重要概念,它表示信息的不确定性。

四、实验过程及结果分析在实验过程中,学生需要首先了解离散信源的定义和性质,然后通过Matlab 软件计算离散信源的熵,并根据熵的计算结果分析信源的信息量。

在实验中,学生需要编写 Matlab 程序,计算离散信源的熵,并绘制熵的图像。

通过实验,学生可以加深对离散信源的理解和掌握离散信源信息量的计算方法。

五、总结信息论与编码实验一是一门关于信息论的基本概念和方法的实验课程。

通过实验,学生可以了解离散信源的定义和性质,掌握离散信源信息量的计算方法,并熟练使用 Matlab 软件进行离散信源信息量的计算。

第3章 离散信源

时间长度为bi,则该信源的时间熵定义为:Ht(X)=H(X)/b. 其中b为信源符号的

平均时间长度。

M

b p( xi ) bi

i 1

s / 符号

离散信源的时间熵(续)

K重符号序列离散无记忆信源的时间熵:

K K Ht (X ) H(X ) / B

bit / s 其中B Kb

为K重符号序列消息的平均时间长度。由于信源无记忆,上式也可以写成:

bit / s

由于信源有记忆,所以有:

K ( H t X ) KH ( X ) (Kb) KH ( X ) /(Kb) H ( X ) / b

bit / s

有记忆信源与无记忆信源相比,对外提供信息量的速度下降了。

离散信源的时间熵(续)

马尔可夫信源的时间熵: 若信源从状态Si转移到状态Sj,发出的符号是xij,它的时间长度设为bij,则 信源从状态Si发生转移并发出一个符号时,符号的平均长度为:

信源分类

若离散信源输出符号彼此间相互独立,而且所有符号服从同一种概率分布,则称之 为简单无记忆信源;

若输出符号间彼此相关,且每个符号只与它前面的一个符号相关,而这种相关性可 以用符号间的转移概率来描述,则称之为马尔可夫信源。

离散信源的熵

单符号离散无记忆信源熵: 若信源X含有M个符号,而且每个符号相互独立,则当信源每次发送一个 符号代表一条消息时,其信源熵可以表示为:

H(X ) 100% H ( X )max

信源符号的相关性越大,信源效率越低,要提高信源效率,要设法降 低符号之间的相关性。

信源的效率与冗余度(续)

(2)信源冗余度:

H ( X )max H ( X ) H(X ) R 1 1 100% H ( X )max H ( X )max

信息论与编码习题参考答案(全)

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ (4)信源空间: bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率bitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知 bitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

《信息论、编码与密码学》课后习题答案资料

《信息论、编码与密码学》课后习题答案第1章 信源编码1.1考虑一个信源概率为{0.30,0.25,0.20,0.15,0.10}的DMS 。

求信源熵H (X )。

解: 信源熵 ∑=-=512)(log )(k k k p p X HH(X)=-[0.30*(-1.737)+0.25*(-2)+0.2*(-2.322)+0.15*(-2.737)+0.1*(-3.322)]=[0.521+0.5+0.464+0.411+0.332] =2.228(bit)故得其信源熵H(X)为2.228bit1.2 证明一个离散信源在它的输出符号等概率的情况下其熵达到最大值。

解: 若二元离散信源的统计特性为P+Q=1 H(X)=-[P*log(P)+(1-P)*log(1-P)] 对H(X)求导求极值,由dH(X)/d(P)=0可得211101log ==-=-p ppp p可知当概率P=Q=1/2时,有信源熵)(1)(max bit X H =对于三元离散信源,当概率3/1321===P P P 时,信源熵)(585.1)(m ax bit X H =,此结论可以推广到N 元的离散信源。

1.3 证明不等式ln 1x x ≤-。

画出曲线1ln y x =和21y x =-的平面图以表明上述不等式的正确性。

证明:max ()ln 1(0)1()()01001()0()0ln 11ln 1ln 1f x x x x f x xf x x x x f x f x f x x x x x x x =-+>'=''==>∴<≤>≤=≤-≥≤-≤-令,又有时此时也即当时同理可得此时综上可得证毕绘制图形说明如下 可以很明确说明上述 不等式的正确性。

1.4 证明(;)0I X Y ≥。

在什么条件下等号成立?1111(,)(,)(,)(,)log()()n mi j i j i j n mi j i j i j i j I P x y I x y P x y P x y P x P y =====∑∑∑∑(X ;Y )=当和相互独立时等号成立。

第三章离散信源

p(xi )

? 熵函数的自变量是X,表示信源整体,实质上是无

记忆信源平均不确定度的度量。试验后平均信息

量为熵

不确定性=携载的信息

? 单位:以2为底,比特/符号

? 为什么要用熵这个词与热熵的区别?

例3.2.1二元熵函数是对0-1分布的随机变量所求的熵:

X

0

1

=

P(x)

p

1-p

则: H(X) = -plogp-(1-p)log(1-p)=H(p)

? ?X

??P( X

? )??

?

? x1,

? ?

p(

x1

),

x2,? , p(x2 ),?

xi ,? , , p(xi

),?

,

p(

xn ? xn )??

,

n i?1

p(xi )

?

1

则信源X的N次扩展信源用 X N来表示,该新信源有 nN个元素(消息序列)

取值于同一集合

,且分量之间

统计{ 独x1 ,立x 2,, ? 则, x由n }随机矢量 X 组成的新信源称为

离散无记忆信源 X的N次扩展信源。

离散无记忆信源 X的N次扩展信源 (或称序列信 源)的熵就是离散信源 X的熵的N倍。

H ( X N ) ? NH ( X )

理解

若单符号离散信源的数 学模型为 :

qN

qN q

? P(? i ) ? ?? P(aik ) ? 1

i?1

i? 1 ik ? 1

有记忆信源:输出的随机序列 X中各随机变量 之间有依赖关系,但记忆长度有限。 m阶马尔可夫信源:信源每次发出的符号只与 前m个符号有关,与更前面的符号无关。

P(xi |? xi?2xi?1xi?1xi?2xi?3 ? xi?m ? xi?1)

信息论与编码试卷及答案

一、(11')填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是0 。

(3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的N倍.(4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。

(5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为3 。

(6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码。

(7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。

(9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关三、(5')居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1。

6米以上的,而女孩中身高1。

6米以上的占总数的一半。

假如我们得知“身高1。

6米以上的某女孩是大学生”的消息,问获得多少信息量?解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则P(A)=0。

25 p(B)=0.5 p(B|A)=0。

75 (2分)故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0.75*0。

25/0。

5=0。

375 (2分)I(A|B)=—log0.375=1。

42bit (1分)四、(5')证明:平均互信息量同信息熵之间满足I(X;Y)=H(X)+H(Y)—H(XY)证明:(2分)同理(1分)则因为(1分)故即(1分)五、(18')。

黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

离散信源题与答案 Last revision date: 13 December 2020.

3.1 设有一离散无记忆信源,其概率空间为 该信源发出的信息序列为(202 120 130 213 001 203 210 110 321 010 021 032 011 223 210)。

求:

(1) 此消息的自信息量是多少?

(2) 此消息中平均每符号携带的信息量是多少?

解:

(1)

此消息总共有14个0、13个1、12个2、6个3,因此消息发出的概率是:

此消息的信息量是:bit p I 811.87log =-=

(2)

此消息中平均每符号携带的信息量是:bit n I 951.145/811.87/==

3.2 某一无记忆信源的符号集为{0, 1},已知信源的概率空间为

(1) 求信息符号的平均熵;

(2) 由100个符号构成的序列,求某一特定序列(例如有m 个“0”和(100 - m )个“1”)的自信息量的表达式;

(3) 计算(2)中序列的熵。

解:

(1)

(2)

(3)

3.5 某信源的消息符号集的概率分布和二进制代码如题表3.2所列。

(1) (2) 求每个消息符号所需要的平均二进制码的个数或平均代码长度。

进而用这一结果求码序列中的一个二进制码的熵; (3) 当消息是由符号序列组成时,各符号之间若相互独立,求其对应的二进制码序列中出现0和1的无条件概率0p 和1p ,求相邻码间的条件概率1/0p 、0/1p 、1/1p 、0/0p 。

解: (1)

(2)

(3)

设消息序列长为N ,则0u 、1u 、2u 、3u 的个数分别为8/ ,8/ ,4/ ,2/N N N N 个。

则0的个数为

8

708181412N N N N N =⨯+⨯+⨯+⨯ 而1的个数为8738281402N N N N N =⨯+⨯+⨯+⨯

因而5.010==p p

3.7 设有一个信源,它产生0,1序列的信息。

该信源在任意时间而且不论以前发生过什么消息符号,均按P(0) = 0.4,P(1) = 0.6的概率发出符号。

(1) 试问这个信源是否是平稳的;

(2) 试计算H(X 2), H(X 3/X 1X 2)及H ∞;

(3) 试计算H(X 4)并写出X 4信源中可能有的所有符号。

解:

(1)

这个信源是平稳无记忆信源。

因为有这些词语:“它在任意时间....而且不论以前发生过什么符..........号.

……” (2)

(3)

3.11 有一马尔可夫信源,已知转移概率为3/2)/(11=S S p ,3/1)/(12=S S p ,1)/(21=S S p ,0)/(22=S S p 。

试画出状态转移图,并求出信源熵。

解:

3.21黑白传真机的信息元只有黑色和白色两种X ={黑,白},一般气象图上黑色出现的概率为P(黑) = 0.3,白色出现的概率为P(白) = 0.7,黑白消息前后没有关联,其转移概率为P(白/白) = 0.9,P(黑/白) = 0.1,P(白/黑) = 0.2,P(黑/黑) = 0.8。

求该一阶马尔可夫信源的不确定性H(X/X),并画出该信源的状态转移图。

解:

3.23 设信源产生A, B, C 三种符号2/1)/(=B B p ,4/1)/()/(==B C p B A p ,

8/5)/(=A A p ,4/1)/(=A B p ,8/1)/(=A C p ,8/5)/(=C C p ,4/1)/(=C B p ,8/1)/(=C A p 。

试计算冗余度。

解:

3.26 一阶马尔可夫信源的状态图如下图所示。

信源X 的符号集为{0, 1, 2}。

(1) 求平稳后信源的概率分布;

(2) 求信源的熵H ∞。

解:

(1)

(2)。