聚类分析原理及步骤.doc

聚类分析

聚类分析(一)聚类分析基本概念(1)有若干个变量(或指标),例3-1的2个变量是样本均值和样本标准差;例3-2的变量是对式样、图案、颜色、材料的态度;例3-3的变量是销售增长、销售利润和新客户销售额;例3-4的变量是出生率、死亡率和婴儿死亡率;…。

这些变量称为自变量或聚类变量。

(2)有若干次观测,每次观测值由若干个数值组成,每次观测值称为1个个体或1个样品:例3-1其观测次数共有4次(甲、乙、丙、丁),其观测值都是2个值组成:第1次观测(第1个样品)是向量,第2次观测(第2个样品)是,……。

例3-2有5次观测(5位顾客),每人4项指标;例3-3、3-4、3-5,的变量各有50、97、39次观测值;而例3-6将许多次原始观测整理为协方差阵,并未提供原始观测数据。

(3)要求分类(或分组):例3-3、3-4要求把观测值分为3类,而例3-1和例3-2则不限定观测值分为几类;例3-1、3-2、3-3、3-4要求按观测值分类,而例3-5,3-6要求按变量分类。

因为是把大量的样品变为少量的类,通常这种分类称为聚类。

(二)聚类原理1)聚类原则选定观测值(点)间距离,类间距离,按照距离最近两类合并在一起的原则合并。

(也有用相似远离)。

常用聚类方法分为:(1)系统聚类MINITAB译为观测值聚类(得到谱系图或树状图)(2)动态聚类MINITAB译为K均值聚类。

可由统计>多变量>观测值聚类,统计>多变量>K均值聚类分别进入。

2)常用点间距离(距离度量)有时先把数据标准化再聚类以免单位影响,例如x1观测值3,2,1,0,-1;x2取值30,20,10,0,-10。

X1均值1,样本标准差;将x1观测值减去平均值1,除以,得到,,,,;,,,,是3,2,1,0,-1的标准化。

X2标准化后也得到,,,,。

标准化后的数与单位无关。

系统聚类从“统计>多变量>观测值聚类”进入观测值聚类框;点间距离,类间距离根据情况选取。

完整版数据挖掘中的聚类分析方法

完整版数据挖掘中的聚类分析方法聚类分析方法是数据挖掘领域中常用的一种数据分析方法,它通过将数据样本分组成具有相似特征的子集,并将相似的样本归为一类,从而揭示数据中隐藏的模式和结构信息。

下面将从聚类分析的基本原理、常用算法以及应用领域等方面进行详细介绍。

聚类分析的基本原理聚类分析的基本原理是将数据样本分为多个类别或群组,使得同一类别内的样本具有相似的特征,而不同类别之间的样本具有较大的差异性。

基本原理可以总结为以下三个步骤:1.相似性度量:通过定义距离度量或相似性度量来计算数据样本之间的距离或相似度。

2.类别划分:根据相似性度量,将样本分组成不同的类别,使得同一类别内的样本之间的距离较小,不同类别之间的距离较大。

3.聚类评估:评估聚类结果的好坏,常用的评估指标包括紧密度、分离度和一致性等。

常用的聚类算法聚类算法有很多种,下面将介绍常用的几种聚类算法:1. K-means算法:是一种基于划分的聚类算法,首先通过用户指定的k值确定聚类的类别数,然后随机选择k个样本作为初始聚类中心,通过迭代计算样本到各个聚类中心的距离,然后将样本划分到距离最近的聚类中心对应的类别中,最后更新聚类中心,直至达到收敛条件。

2.层次聚类算法:是一种基于树状结构的聚类算法,将样本逐步合并到一个大的类别中,直至所有样本都属于同一个类别。

层次聚类算法可分为凝聚式(自底向上)和分裂式(自顶向下)两种。

凝聚式算法首先将每个样本作为一个初始的类别,然后通过计算样本之间的距离来逐步合并最近的两个类别,直至达到停止准则。

分裂式算法则是从一个包含所有样本的初始类别开始,然后逐步将类别分裂成更小的子类别,直至达到停止准则。

3. 密度聚类算法:是一种基于样本密度的聚类算法,通过在数据空间中寻找具有足够高密度的区域,并将其作为一个聚类。

DBSCAN (Density-Based Spatial Clustering of Applications with Noise)算法是密度聚类算法的代表,它通过定义距离和邻域半径来确定样本的核心点、边界点和噪声点,并通过将核心点连接起来形成聚类。

聚类分析实验报告

聚类分析实验报告一、实验目的:通过聚类分析方法,对给定的数据进行聚类,并分析聚类结果,探索数据之间的关系和规律。

二、实验原理:聚类分析是一种无监督学习方法,将具有相似特征的数据样本归为同一类别。

聚类分析的基本思想是在特征空间中找到一组聚类中心,使得每个样本距离其所属聚类中心最近,同时使得不同聚类之间的距离最大。

聚类分析的主要步骤有:数据预处理、选择聚类算法、确定聚类数目、聚类过程和聚类结果评价等。

三、实验步骤:1.数据预处理:将原始数据进行去噪、异常值处理、缺失值处理等,确保数据的准确性和一致性。

2.选择聚类算法:根据实际情况选择合适的聚类算法,常用的聚类算法有K均值算法、层次聚类算法、DBSCAN算法等。

3.确定聚类数目:根据数据的特征和实际需求,确定合适的聚类数目。

4.聚类过程:根据选定的聚类算法和聚类数目进行聚类过程,得到最终的聚类结果。

5. 聚类结果评价:通过评价指标(如轮廓系数、Davies-Bouldin指数等),对聚类结果进行评价,判断聚类效果的好坏。

四、实验结果:根据给定的数据集,我们选用K均值算法进行聚类分析。

首先,根据数据特点和需求,我们确定聚类数目为3、然后,进行数据预处理,包括去噪、异常值处理和缺失值处理。

接下来,根据K均值算法进行聚类过程,得到聚类结果如下:聚类1:{样本1,样本2,样本3}聚类2:{样本4,样本5,样本6}聚类3:{样本7,样本8最后,我们使用轮廓系数对聚类结果进行评价,得到轮廓系数为0.8,说明聚类效果较好。

五、实验分析和总结:通过本次实验,我们利用聚类分析方法对给定的数据进行了聚类,并进行了聚类结果的评价。

实验结果显示,选用K均值算法进行聚类分析,得到了较好的聚类效果。

实验中还发现,数据预处理对聚类分析结果具有重要影响,必要的数据清洗和处理工作是确保聚类结果准确性的关键。

此外,聚类数目的选择也是影响聚类结果的重要因素,过多或过少的聚类数目都会造成聚类效果的下降。

聚类分析法

聚类分析法聚类分析法(ClusterAnalysis)是一种基于模式识别及统计学理论的数据挖掘技术,它通过让数据集中的项以有联系的方式归入不同的簇(Cluster)来呈现其特征,以此发掘出隐藏在数据背后的所谓的“模式”和知识。

聚类分析法主要应用于定性分析(Qualitative Analysis)、模式识别、决策分析(Decision Analysis)、图象处理(Image Processing)、系统自动推理(System Inference)等领域,其主要性质属于非监督式学习。

基本流程聚类分析法的基本流程包括:数据准备(Data Preparation)、预处理(Pre-processing)、聚类(Clustering)、结果评估(Result Evaluation)等步骤。

在数据准备阶段,需要完成原始数据的清洗、转换、结构化以及标准化等操作。

而预处理步骤同样很重要,在此步骤中,可以得到样本的特征数据,并用于聚类模型的建立。

接下来,便是聚类的核心步骤了,完成聚类需要确定聚类的具体方法,例如层次聚类(Hierarchical Clustering)、基于密度的聚类(Density-Based Clustering)、均值聚类(K-means Clustering)等。

最后便是评估结果,在这一步中,会根据聚类的执行情况以及聚类的结果,采用相应的评估指标,对聚类结果做出评价,确定聚类模型的合理性。

工作原理聚类分析法的工作原理,主要是利用距离函数(Distance Function)来度量数据项之间的距离,从而将数据项归入不同的簇。

常用的距离函数有欧氏距离(Euclidean Distance)、曼哈顿距离(Manhattan Distance)、闵可夫斯基距离(Minkowski Distance)、切比雪夫距离(Chebyshev Distance)等。

其中欧氏距离被广泛应用,由于它比较容易实现,可以很好地表现出数据项之间的相似性。

聚类分析原理

聚类分析原理

聚类分析是一种无监督学习算法,它将数据集中的对象分

成相似的组或簇。

其原理基于以下几个关键步骤:

1. 选择合适的相似性度量:聚类算法需要定义一个衡量对

象之间相似性的度量方式。

常用的度量方法包括欧氏距离、曼哈顿距离、余弦相似度等。

2. 初始化聚类中心:聚类算法通常需要提前指定簇的数量K。

然后可以随机选取K个样本作为初始的聚类中心,或者通过某种启发式方法选择初始聚类中心。

3. 分配样本到簇:将每个样本分配到最接近的聚类中心所

属的簇。

这个过程可以通过计算每个样本与每个聚类中心

之间的距离,并选择距离最小的聚类中心来完成。

4. 更新聚类中心:根据当前簇中的样本重新计算聚类中心

的位置,通常是取簇内所有样本的均值作为新的聚类中心。

5. 重复步骤3和步骤4,直到簇的分配结果不再变化或达

到预定的停止条件。

6. 输出最终的聚类结果。

聚类分析的目标是在不知道样本的真实标签的情况下,将

样本聚类成相似的组。

它可以帮助发现数据的内在结构,

识别相似的样本和异常值,以及进行数据压缩和预处理等

任务。

系统聚类法的原理和具体步骤

系统聚类法(Hierarchical Clustering)是一种常用的聚类分析方法,用于将样本或对象根据相似性或距离进行层次化的分组。

其原理和具体步骤如下:

原理:

系统聚类法通过计算样本或对象之间的相似性或距离,将它们逐步合并为不同的聚类组。

该方法基于一个假设,即相似的样本或对象更有可能属于同一个聚类。

具体步骤:

距离矩阵计算:根据选定的相似性度量(如欧氏距离、曼哈顿距离等),计算样本或对象之间的距离,并生成距离矩阵。

初始化聚类:将每个样本或对象视为一个初始聚类。

聚类合并:根据距离矩阵中的最小距离,将距离最近的两个聚类合并为一个新的聚类。

更新距离矩阵:根据合并后的聚类,更新距离矩阵,以反映新的聚类之间的距离。

重复步骤3和4,直到所有的样本或对象都合并为一个聚类或达到指定的聚类数目。

结果展示:将合并过程可视化为一棵聚类树状图(树状图或树状图),以显示不同聚类之间的关系和层次结构。

需要注意的是,系统聚类法有两种主要的实现方式:凝聚层次聚类和分裂层次聚类。

凝聚层次聚类从单个样本开始,逐步合并为更大的聚类;分裂层次聚类从一个整体聚类开始,逐步分裂为更小的聚类。

以上步骤适用于凝聚层次聚类。

系统聚类法在数据分析、模式识别、生物学分类等领域广泛应用。

通过系统聚类法,可以将样本或对象进行有序的分组,帮助发现数据中的模式和结构,并为进一步的分析和解释提供基础。

第一节系统聚类分析

第一节系统聚类分析第五章聚类分析(一)教学目的通过本章的学习,对聚类分析从总体上有一个清晰地认识,理解聚类分析的基本思想和基本原理,掌握用聚类分析解决实际问题的能力。

(二)基本要求了解聚类分析的定义,种类及其应用范围,理解聚类分析的基本思想,掌握各类分析方法的主要步骤。

(三)教学要点1、聚类分析概述;2、系统聚类分析基本思想,主要步骤;3、动态聚类法基本思想,基本原理,主要步骤;4、模糊聚类分析基本思想,基本原理,主要步骤;5、图论聚类分析基本思想,基本原理。

(四)教学时数6课时五)教学内容 (1、聚类分析概述2、系统聚类分析3、动态聚类法4、模糊聚类分析5、图论聚类分析统计分组或分类可以深化人们的认识。

实际应用中,有些情况下进行统计分组比较容易,分组标志确定了,分组也就得到了,但是,有些情况下进行统计分组却比较困难,特别是当客观事物性质变化没有明显标志时,用于确定分组的标志和组别就很难确定。

聚类分析实际上给我们提供了一种对于复杂问题如何分组的统计方法。

第一节聚类分析概述一、聚类分析的定义聚类分析是将样品或变量按照它们在性质上的亲疏程度进行分类的多元统计分析方法。

聚类分析时,用来描述样品或变量的亲疏程度通常有两个途径,一是把每个样品或变量看成是多维空间上的一个点,在多维坐标中,定义点与点,类和类之间的距离,用点与点间距离来描述样品或变量之间的亲疏程度;另一个是计算样品或变量的相似系数,用相似系数来描述样品或变量之间的亲疏程度。

二、聚类分析的种类(一)聚类分析按照分组理论依据的不同,可分为系统聚类法,动态聚类法,模糊聚类、图论聚类、聚类预报等多种聚类方法。

1、系统聚类分析法。

是在样品距离的基础上定义类与类的距离,首先将个样品自成n一类,然后每次将具有最小距离的两个类合并,合并后再重新计算类与类之间的距离,再并类,这个过程一直持续到所有的样品都归为一类为止。

这种聚类方法称为系统聚类法。

根据并类过程所做的样品并类过程图称为聚类谱系图。

系统聚类分析方法

系统聚类分析方法聚类分析是研究多要素事物分类问题的数量方法。

基本原理是根据样本自身的属性,用数学方法按照某种相似性或差异性指标,定量地确定样本之间的亲疏关系,并按这种亲疏关系程度对样本进行聚类。

常见的聚类分析方法有系统聚类法、动态聚类法和模糊聚类法等。

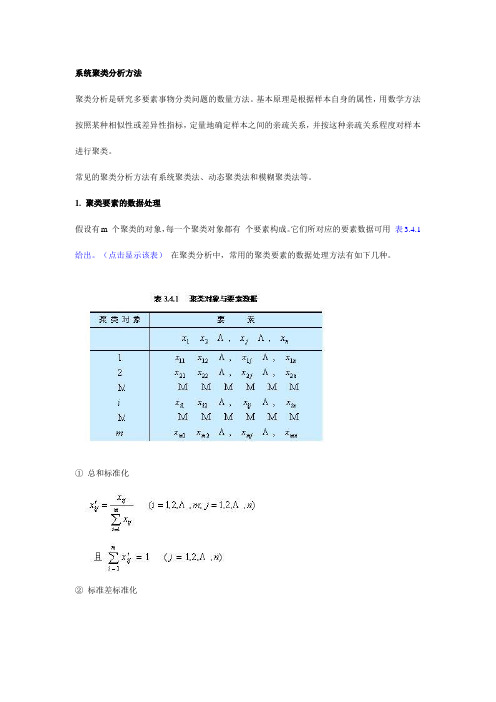

1. 聚类要素的数据处理假设有m 个聚类的对象,每一个聚类对象都有个要素构成。

它们所对应的要素数据可用表3.4.1给出。

(点击显示该表)在聚类分析中,常用的聚类要素的数据处理方法有如下几种。

①总和标准化②标准差标准化③极大值标准化经过这种标准化所得的新数据,各要素的极大值为1,其余各数值小于1。

④极差的标准化经过这种标准化所得的新数据,各要素的极大值为1,极小值为0,其余的数值均在0与1之间。

2. 距离的计算距离是事物之间差异性的测度,差异性越大,则相似性越小,所以距离是系统聚类分析的依据和基础。

①绝对值距离选择不同的距离,聚类结果会有所差异。

在地理分区和分类研究中,往往采用几种距离进行计算、对比,选择一种较为合适的距离进行聚类。

例:表3.4.2给出了某地区九个农业区的七项指标,它们经过极差标准化处理后,如表3.4.3所示。

对于表3.4.3中的数据,用绝对值距离公式计算可得九个农业区之间的绝对值距离矩阵:3. 直接聚类法直接聚类法是根据距离矩阵的结构一次并类得到结果。

▲ 基本步骤:①把各个分类对象单独视为一类;②根据距离最小的原则,依次选出一对分类对象,并成新类;③如果其中一个分类对象已归于一类,则把另一个也归入该类;如果一对分类对象正好属于已归的两类,则把这两类并为一类;每一次归并,都划去该对象所在的列与列序相同的行;④那么,经过m-1次就可以把全部分类对象归为一类,这样就可以根据归并的先后顺序作出聚类谱系图。

★直接聚类法虽然简便,但在归并过程中是划去行和列的,因而难免有信息损失。

因此,直接聚类法并不是最好的系统聚类方法。

[举例说明](点击打开新窗口,显示该内容)例:已知九个农业区之间的绝对值距离矩阵,使用直接聚类法做聚类分析。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

聚类分析原理及步骤——将未知数据按相似程度分类到不同的类或簇的过程

1》传统的统计聚类分析方法包括系统聚类法、分解法、加入法、动态聚类法、有序样品聚类、有重叠聚类和模糊聚类等。

采用k-均值、k-中心点等算法的聚类分析工具已被加入到许多著名的统计分析软件包中,如SPSS、SAS等。

典型应用

1》动植物分类和对基因进行分类

2》在网上进行文档归类来修复信息

3》帮助电子商务的用户了解自己的客户,向客户提供更合适的服务

主要步骤

1》数据预处理——选择数量,类型和特征的标度((依据特征选择和抽取)特征选择选择重要的特征,特征抽取把输入的特征转化

为一个新的显著特征,它们经常被用来获取一个合适的特征集来为避免“维数

灾”进行聚类)和将孤立点移出数据(孤立点是不依附于一般数

据行为或模型的数据)

2》为衡量数据点间的相似度定义一个距离函数——既然相类似性是定义一个类的基础,那么不同数据之间在同一个特

征空间相似度的衡量对于聚类步骤是很重要的,由于特征类型和特

征标度的多样性,距离度量必须谨慎,它经常依赖于应用,例如,

通常通过定义在特征空间的距离度量来评估不同对象的相异性,很

多距离度都应用在一些不同的领域一个简单的距离度量,如

Euclidean距离,经常被用作反映不同数据间的相异性,一些有关相

似性的度量,例如PMC和SMC,能够被用来特征化不同数据的概

念相似性,在图像聚类上,子图图像的误差更正能够被用来衡量两

个图形的相似性

3》聚类或分组——将数据对象分到不同的类中【划分方法

(划分方法一般从初始划分和最优化一个聚类标准开始,Cris p

Clustering和Fuzzy Clusterin是划分方法的两个主要技术,Crisp

Clustering,它的每一个数据都属于单独的类;Fuzzy Clustering,它的

每个数据可能在任何一个类中)和层次方法(基于某个标准产生一

个嵌套的划分系列,它可以度量不同类之间的相似性或一个类的可分

离性用来合并和分裂类)是聚类分析的两个主要方法,另外还有基于

密度的聚类,基于模型的聚类,基于网格的聚类】

4》评估输出——评估聚类结果的质量(它是通过一个类有效索引来

评价,,一般来说,几何性质,包括类间的分离和类内部的耦合,一般

都用来评价聚类结果的质量,类有效索引在决定类的数目时经常扮演

了一个重要角色,类有效索引的最佳值被期望从真实的类数目中获取,

一个通常的决定类数目的方法是选择一个特定的类有效索引的最佳

值,这个索引能否真实的得出类的数目是判断该索引是否有效的标准,

很多已经存在的标准对于相互分离的类数据集合都能得出很好的结

果,但是对于复杂的数据集,却通常行不通,例如,对于交叠类的集

合。

)

聚类分析的主要计算方法原理及步骤划分法

1》将数据集分割成K个组(每个组至少包

含一个数据且每一个数据纪录属于且

仅属于一个分组),每个组成为一类2》通过反复迭代的方法改变分组,使得每

一次改进之后的分组方案都较前一次

好(标准就是:同一分组中的记录越近

越好,而不同分组中的纪录越远越好,

使用这个基本思想的算法有:

K-MEANS算法、K-MEDOIDS算法、

CLARANS算法)

层次法

1》“自底向上”方案——将每个数据单独作为一

组,通过反复迭代的方法,把那些相互邻近的

组合并成一个组,直到所有的记录组成一个分

组或者某个条件满足为止,代表算法有:BIRCH

算法、CURE算法、CHAMELEON算法等

2》“自顶向下”方案

主要算法原理及步骤

K-MEANS算法

k-means 算法接受输入量k ;然后将n个数据对象划分为k个聚类以便使得所获得的聚类满足:同一聚类中的对象相似度较高;而不同聚类中的对象相似度较小。

聚类相似度是利用各聚类中对象的均值所获得一个“中心对象”(引力中心)来进行计算的。

k-means 算法的工作过程说明如下:1》从n个数据对象任意选择k 个对象作为初始聚类中心;而对于所剩下其它对象,则根据它们与这些聚类中心的相似度(距离),分别将它们分配给与其最相似的(聚类中心所代表的)聚类;

2》计算每个所获新聚类的聚类中心(该聚类中所有对象的均值);不断重复这一过程直到标准测度函数开始

收敛为止。

一般都采用均方差作为标准测度函数.

k个聚类具有以下特点:各聚类本身尽可能的紧凑,而各聚类之间尽可能的分开。

K-MEDOIDS算法

K-MEANS有其缺点:产生类的大小相差不会很大,

对于脏数据很敏感。

改进的算法:

k—medoids 方法:

选取一个对象叫做mediod来代替上面的中心的作用,这样的一个medoid就标识了这个类。

步骤:

(1)、任意选取K个对象作为medoids(O1,O2,…

Oi…Ok)。

以下是循环的:

(2)、将余下的对象分到各个类中去(根据与

medoid最相近的原则);(3)、对于每个类(Oi)

中,顺序选取一个Or,计算用Or代替Oi后的消

耗—E(Or)。

选择E最小的那个Or来代替Oi。

这

样K个medoids就改变了,

下面就再转到2。

(4)、这样循环直到K个medoids固定下来。

这

种算法对于脏数据和异常数据不敏感,但计算量显

然要比K均值要大,一般只适合小数据量

Clara算法

K-medoids算法不适合于大数据量的计算,Clara算法的思想就是用实际数据的抽样来代替整个数据,然后再在这些抽样的数据上利用K-medoids算法得到最佳的medoids。

Clara 算法从实际数据中抽取多个采样,在每个采样上都用K-medoids算法得到相应的(O1,O2…Oi…Ok),然后在这当中选取E最小的一个作为最终的结果。

Clarans算法

Clara算法的效率取决于采样的大小,一般不太可能得到最佳的结果

在Clara算法的基础上,又提出了Clarans的算法,与Clara算法不同的是:

在Clara算法寻找最佳的medoids的过程中,采样都是不变的。

而Clarans算法在每一次循环的过程中所采用的采样都是不一样的。

与上次课所讲的寻找最佳medoids的过程不同的是,必须人为地来限定循环的次数。