第5章聚类分析.复习过程

第五章--数据处理和可视化表达-学业水平考试总复习

C.数据规模大

D.数据处理速度快

2某超市曾经研究销售数据,发现购买方便面的顾客购买火腿肠、卤蛋等商品的概率

很大,进而调整商品摆放位置。这种数据分析方法是( C )

A.聚类分析

B.分类分析

C.关联分析

D.回归分析

【典型例题】

3.小智通过网络问卷收集同学们课外阅读时间的百分比分布情况,下列可以用于分

析调查数据的是( A )

D. XML

【典型例题】

6.利用Python采集网络数据时,导入扩展库的关键字是import。( A )

7.从互联网产生大数据的角度来看,大数据具有的特征是“4V”特征:大量、多样、

高价值密度、低速。( B )

8.网络数据采集法主要通过网络爬虫或网站公开API的方式获取网络爬虫,从网页的

URL开始获取。( A )

Seaborn:关注统计模型的可视化,高度依赖Matplotlib Bokeh:实现交互式可视化,可通过浏览器呈现

【知识梳理】

一、认识大数据

(一)大数据的概念

大数据:无法在可承受的时间范围内用常规软件工具进行高效捕捉、管理和处理的数据集合,是需要 新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。

A.饼图

B.折线图 C .动态热力图

D.词云图

4.下列关于大数据的特征,说法正确的是( D )。

A.数据价值密度高

B.数据类型少

C.数据基本无变化

D.数据体量巨大

5.网络数据采集法,主要通过网络爬虫或网站公开API的方式获取,网络爬虫从网页

的( A )开始获取。

A. URL

B. WWW C. HTML

(二)数据可视化表达的工具

应用多元统计分析习题解答聚类分析

第五章聚类剖析5.1鉴别剖析和聚类剖析有何差别?答:即依据必定的鉴别准则,判断一个样本归属于哪一类。

详细而言,设有n 个样本,对每个样本测得p 项指标(变量)的数据,已知每个样本属于k 个类型(或整体)中的某一类,经过找出一个最优的区分,使得不一样类其余样本尽可能地域别开,并鉴别该样本属于哪个整体。

聚类剖析是剖析怎样对样品(或变量)进行量化分类的问题。

在聚类以前,我们其实不知道整体,而是经过一次次的聚类,使邻近的样品(或变量)聚合形成整体。

平常来讲,鉴别剖析是在已知有多少类及是什么类的状况下进行分类,而聚类剖析是在不知道类的状况下进行分类。

5.2试述系统聚类的基本思想。

答:系统聚类的基本思想是:距离邻近的样品(或变量)先聚成类,距离相远的后聚成类,过程向来进行下去,每个样品(或变量)总能聚到适合的类中。

5.3对样品和变量进行聚类剖析时,所结构的统计量分别是什么?简要说明为何这样结构?答:对样品进行聚类剖析时,用距离来测定样品之间的相像程度。

由于我们把n 个样本看作 p 维空间的 n 个点。

点之间的距离即可代表样品间的相像度。

常用的距离为pq)1/ q(一)闵可夫斯基距离: d ij (q) ( X ik X jkk 1q取不一样值,分为( 1)绝对距离(( 2)欧氏距离(q 1)q 2 )( 3)切比雪夫距离( q) (二)马氏距离(三)兰氏距离对变量的相像性, 我们更多地要认识变量的变化趋向或变化方向, 所以用有关性进行权衡。

将变量看作 p 维空间的向量,一般用(一)夹角余弦(二)有关系数5.4 在进行系统聚类时,不一样类间距离计算方法有何差别?选择距离公式应按照哪些原则?答: 设 d ij 表示样品 X i 与 X j 之间距离,用 D ij 表示类 G i 与 G j 之间的距离。

( 1) . 最短距离法( 2)最长距离法( 3)中间距离法D kr 21D kp21D kq 2D pq 22 2此中(4)重心法(5)类均匀法(6)可变类均匀法D kr2 (1 )( np D kp2nq D kq2 )D pq2 n r? <1n r此中 ?是可变的且( 7)可变法D kr21(D kp2 D kq2 )D pq2 此中 ?是可变的且 ? <12(8)离差平方和法往常选择距离公式应注意按照以下的基根源则:(1)要考虑所选择的距离公式在实质应用中有明确的意义。

第五讲聚类分析

第五讲聚类分析聚类分析是一种无监督学习方法,旨在将样本数据划分为具有相似特征的若干个簇。

它通过测量样本之间的相似性和距离来确定簇的划分,并试图让同一簇内的样本点相似度较高,而不同簇之间的样本点相似度较低。

聚类分析在数据挖掘、模式识别、生物信息学等领域有着广泛的应用,它可以帮助我们发现隐藏在数据中的模式和规律。

在实际应用中,聚类分析主要包含以下几个步骤:1.选择合适的距离度量方法:距离度量方法是聚类分析的关键,它决定了如何计算样本之间的相似性或距离。

常用的距离度量方法包括欧氏距离、曼哈顿距离、切比雪夫距离等。

2.选择合适的聚类算法:聚类算法的选择要根据具体的问题和数据特点来确定。

常见的聚类算法有K-means算法、层次聚类算法、DBSCAN算法等。

3.初始化聚类中心:对于K-means算法等需要指定聚类中心的方法,需要初始化聚类中心。

初始化可以随机选择样本作为聚类中心,也可以根据领域知识或算法特点选择合适的样本。

4.计算样本之间的相似度或距离:根据选择的距离度量方法,计算样本之间的相似度或距离。

相似度越高或距离越小的样本越有可能属于同一个簇。

5.按照相似度或距离将样本划分为不同的簇:根据计算得到的相似度或距离,将样本划分为不同的簇。

常用的划分方法有硬聚类和软聚类两种。

硬聚类将样本严格地分到不同的簇中,而软聚类允许样本同时属于不同的簇,并给出属于每个簇的概率。

6.更新聚类中心:在K-means等迭代聚类算法中,需要不断迭代更新聚类中心,以找到最优划分。

更新聚类中心的方法有多种,常用的方法是将每个簇内的样本的均值作为新的聚类中心。

7.评估聚类结果:通过评估聚类结果的好坏,可以判断聚类算法的性能。

常用的评估指标有轮廓系数、Dunn指数、DB指数等。

聚类分析的目标是让同一簇内的样本点尽量相似,而不同簇之间的样本点尽量不相似。

因此,聚类分析常常可以帮助我们发现数据中的分组结构,挖掘出数据的内在规律。

聚类分析在市场细分、社交网络分析、基因表达数据分析等领域都有广泛的应用。

多元统计分析 第5章 聚类分析

余弦相似性 Cosine Similarity

A document can be represented by thousands of attributes,

p (such as each recording the frequency of a particular word keywords) or phrase in the document. xi yi

feature mapping, ... Cosine measure: If d1 and d2 are two vectors (e.g., termfrequency vectors), then cos(d1, d2) = (d1 d2) /||d1|| ||d2|| ,

where indicates vector dot product, ||d||: the length of vector d

d1 = (5, 0, 3, 0, 2, 0, 0, 2, 0, 0) d2 = (3, 0, 2, 0, 1, 1, 0, 1, 0, 1) d1 d2 = 5*3+0*0+3*2+0*0+2*1+0*1+0*1+2*1+0*0+0*1 = 25 ||d1||= (5*5+0*0+3*3+0*0+2*2+0*0+0*0+2*2+0*0+0*0)0.5=(42)0.5 = 6.481 ||d2||= (3*3+0*0+2*2+0*0+1*1+1*1+0*0+1*1+0*0+1*1)0.5=(17)0.5 = 4.12 cos(d1, d2 ) = 0.94

第5章 聚类分析6

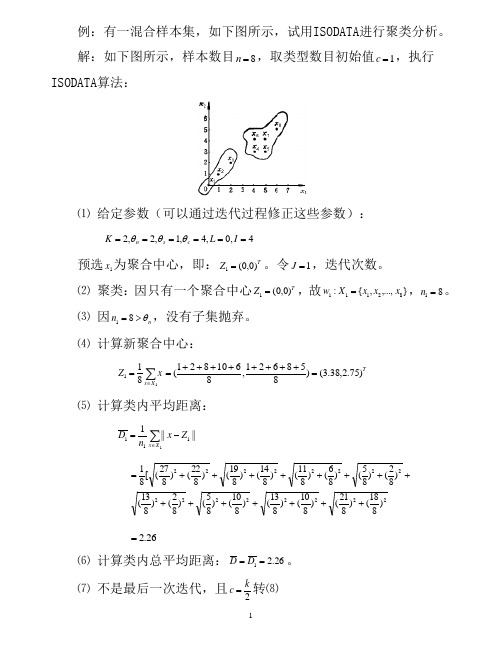

例:有一混合样本集,如下图所示,试用ISODATA 进行聚类分析。

解:如下图所示,样本数目8=n ,取类型数目初始值1=c ,执行ISODATA 算法:⑴ 给定参数(可以通过迭代过程修正这些参数):4,0,4,1,2,2======I L K c s n θθθ预选1x 为聚合中心,即:TZ )0,0(1=。

令1=J ,迭代次数。

⑵ 聚类:因只有一个聚合中心TZ )0,0(1=,故},..,,{:82111x x x X w =,81=n 。

⑶ 因n n θ>=81,没有子集抛弃。

⑷ 计算新聚合中心:∑∈=1811X x x Z T )75.2,38.3()858621,8610821(=++++++++=⑸ 计算类内平均距离:∑∈-=1||||1111X x Z x n D ++++++++=22222222)82()85()86()811()814()819()822()827([8122222222)818()821()810()813()810()85()82()813(+++++++26.2=⑹ 计算类内总平均距离:26.21==D D 。

⑺ 不是最后一次迭代,且2kc =转⑻⑻ 计算聚合1X 中的标准偏差1σ:T ),(12111σσσ=∑∈-=j X x ji J Z x 2111))((81σ])8276()8275()8274()8275()8274()8272()8271()8270[(8122222222-+-+-+-+-+-+-+-=56.1])818()810()810()822()82()86()814()822[(812222222212=+++++++=σ T )56.1,99.1(1=σ⑼ 1σ中的最大偏差分量为99.111=σ,即99.1max 1=σ。

⑽ 因为s θσ>max 1,且2K c =。

所以把聚合分裂成两个子集,5.0=K ,则:T r )0,1(1=,故新的聚合中心分别为:T Z )75.2,38.4(1=+,T Z )75.2,38.2(1=-为方便起见,+1Z 和-1Z 改写为1Z 和2Z ,令1+=c c ,21=+=J J ,返回到⑵。

多元统计分析期末复习试题

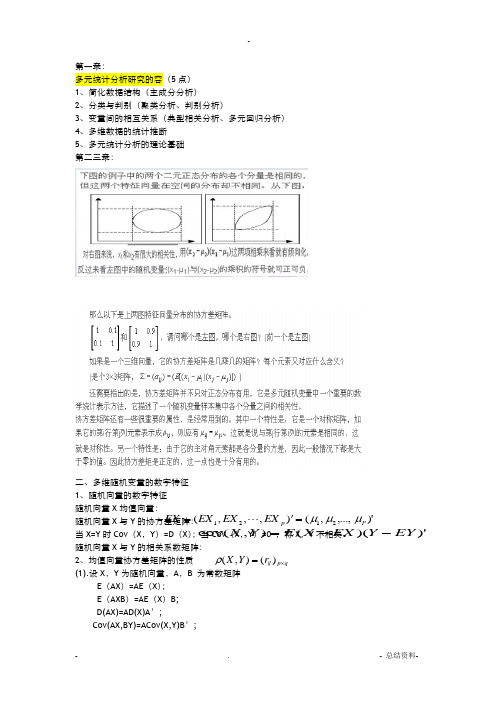

第一章:多元统计分析研究的容(5点)1、简化数据结构(主成分分析)2、分类与判别(聚类分析、判别分析)3、变量间的相互关系(典型相关分析、多元回归分析)4、多维数据的统计推断5、多元统计分析的理论基础第二三章:二、多维随机变量的数字特征1、随机向量的数字特征随机向量X 均值向量:随机向量X 与Y 的协方差矩阵: 当X=Y 时Cov (X ,Y )=D (X );当Cov (X ,Y )=0 ,称X ,Y 不相关。

随机向量X 与Y 的相关系数矩阵:2、均值向量协方差矩阵的性质(1).设X ,Y 为随机向量,A ,B 为常数矩阵E (AX )=AE (X );E (AXB )=AE (X )B;D(AX)=AD(X)A ’;Cov(AX,BY)=ACov(X,Y)B ’;)',...,,(),,,(2121P p EX EX EX EX μμμ='= )')((),cov(EY Y EX X E Y X --=q p ij r Y X ⨯=)(),(ρ(2).若X ,Y 独立,则Cov(X,Y)=0,反之不成立.(3).X 的协方差阵D(X)是对称非负定矩阵。

例2.见黑板三、多元正态分布的参数估计2、多元正态分布的性质(1).若 ,则E(X)= ,D(X)= .特别地,当 为对角阵时, 相互独立。

(2).若 ,A为sxp 阶常数矩阵,d 为s 阶向量,AX+d ~ . 即正态分布的线性函数仍是正态分布. (3).多元正态分布的边缘分布是正态分布,反之不成立.(4).多元正态分布的不相关与独立等价.例3.见黑板.三、多元正态分布的参数估计(1)“ 为来自p 元总体X 的(简单)样本”的理解---独立同截面. (2)多元分布样本的数字特征---常见多元统计量样本均值向量 =样本离差阵S= 样本协方差阵V= S ;样本相关阵R(3) ,V分别是 和 的最大似然估计; (4)估计的性质 是 的无偏估计; ,V分别是 和 的有效和一致估计; ; S~ , 与S相互独立; 第五章 聚类分析:一、什么是聚类分析 :聚类分析是根据“物以类聚”的道理,对样品或指标进行分类的一种多元统计分析方法。

多元统计分析课件第五章_聚类分析

止。如果某一步距离最小的元素不止一个,则对应ቤተ መጻሕፍቲ ባይዱ些

最小元素的类可以同时合并。

【例5.1】设有六个样品,每个只测量一个指标,分别是1, 2,5,7,9,10,试用最短距离法将它们分类。

(1)样品采用绝对值距离,计算样品间的距离阵D(0) ,见 表5.1

一、系统聚类的基本思想

系统聚类的基本思想是:距离相近的样品(或变量)先聚成 类,距离相远的后聚成类,过程一直进行下去,每个样品 (或变量)总能聚到合适的类中。系统聚类过程是:假设总 共有n个样品(或变量),第一步将每个样品(或变量)独 自聚成一类,共有n类;第二步根据所确定的样品(或变量) “距离”公式,把距离较近的两个样品(或变量)聚合为一 类,其它的样品(或变量)仍各自聚为一类,共聚成n 1类; 第三步将“距离”最近的两个类进一步聚成一类,共聚成n 2类;……,以上步骤一直进行下去,最后将所有的样品 (或变量)全聚成一类。为了直观地反映以上的系统聚类过 程,可以把整个分类系统画成一张谱系图。所以有时系统聚 类也称为谱系分析。除系统聚类法外,还有有序聚类法、动 态聚类法、图论聚类法、模糊聚类法等,限于篇幅,我们只 介绍系统聚类方法。

在生物、经济、社会、人口等领域的研究中,存在着大量量 化分类研究。例如:在生物学中,为了研究生物的演变,生 物学家需要根据各种生物不同的特征对生物进行分类。在经 济研究中,为了研究不同地区城镇居民生活中的收入和消费 情况,往往需要划分不同的类型去研究。在地质学中,为了 研究矿物勘探,需要根据各种矿石的化学和物理性质和所含 化学成分把它们归于不同的矿石类。在人口学研究中,需要 构造人口生育分类模式、人口死亡分类状况,以此来研究人 口的生育和死亡规律。

数据挖掘原理、 算法及应用第5章 聚类方法

第5章 聚类方法

5.1 概述 5.2 划分聚类方法 5.3 层次聚类方法 5.4 密度聚类方法 5.5 基于网格聚类方法 5.6 神经网络聚类方法:SOM 5.7 异常检测

第5章 聚类方法

5.1 概 述

聚类分析源于许多研究领域,包括数据挖掘、统计学、 机器学习、模式识别等。它是数据挖掘中的一个功能,但也 能作为一个独立的工具来获得数据分布的情况,概括出每个 簇的特点,或者集中注意力对特定的某些簇作进一步的分析。 此外,聚类分析也可以作为其他分析算法 (如关联规则、分 类等)的预处理步骤,这些算法在生成的簇上进行处理。

凝聚的方法也称为自底向上的方法,一开始就将每个对 象作为单独的一个簇,然后相继地合并相近的对象或簇,直 到所有的簇合并为一个,或者达到终止条件。如AGNES算法 属于此类。

第5章 聚类方法

(3) 基于密度的算法(Density based Methods)。 基于密度的算法与其他方法的一个根本区别是: 它不是 用各式各样的距离作为分类统计量,而是看数据对象是否属 于相连的密度域,属于相连密度域的数据对象归为一类。如 DBSCAN (4) 基于网格的算法(Grid based Methods)。 基于网格的算法首先将数据空间划分成为有限个单元 (Cell)的网格结构,所有的处理都是以单个单元为对象的。这 样处理的一个突出优点是处理速度快,通常与目标数据库中 记录的个数无关,只与划分数据空间的单元数有关。但此算 法处理方法较粗放,往往影响聚类质量。代表算法有STING、 CLIQUE、WaveCluster、DBCLASD、OptiGrid算法。

(3) 许多数据挖掘算法试图使孤立点影响最小化,或者排除 它们。然而孤立点本身可能是非常有用的,如在欺诈探测中, 孤立点可能预示着欺诈行为的存在。

聚类分析法

8 个棉花品种的观测性状值

铃重 (g) 5.6 3.3 6.1 3.1 6.1 2.3 5.5 2.5 衣分 (%) 33.2 29.0 33.0 26.5 34.0 31.8 34.9 31.2 籽指 (g) 12.4 12.9 11.3 12.7 12.7 12.0 11.5 13.7 2.5% 跨长 (mm) 29.9 31.9 28.0 32.9 30.3 33.3 30.3 29.6 比强度 (cN/tex) 19.6 26.6 17.4 26.4 19.0 35.1 16.8 31.5 种仁 脂肪 (mg) 35.7 34.8 38.6 34.2 33.7 37.2 33.5 37.8 种仁 蛋白 (mg) 39.3 38.9 39.2 38.3 37.0 36.7 39.7 35.3

-3-

第七章

聚类分析

埃棉 3 号和吉扎 80 号)的 10 个表型性状,数据列于表 7-3,试计算 8 个棉花品种间的欧氏距离。

表 7-3

编号 品种 果枝 节位 (个) 8.6 5.7 5.4 3.5 7.5 4.0 7.4 6.4 果枝数 (个) 12.0 16.3 14.4 18.4 13.3 20.0 13.3 15.0

2 DM (Y(i ) Y( j ) )S 1 (Y(i ) Y( j ) )T ij

如品种 2 和 5 间的马列氏距离 DM 3.74 。 这里需要说明两点:①在使用欧氏距离方法计算遗传距离之前, 一定要对表型数据作标准化处理,否则,相同的测量结果会因所采用 的量纲不同(例如厘米)而导致样品间的距离发生变化;但是,若采 用马氏距离则无需标准化, 因为在马氏距离的计算中包含了标准差标 准化过程。 ②马氏距离较欧氏距离的优点在于可以排除变量之间相关 性的干扰,实际应用时,变量之间若存在着很强相关性,可以采用马 氏距离。 三、基于分子标记数据的遗传距离 在分子标记实验中,只统计样品间具有多态性的条带信息:有带 记为 “1” , 无带记为 “0 ” 。 那么就得到一个观测值为 0 和 1 的数据表。 用分子标记数据可计算样品间遗传距离。 基于分子标记数据的遗传距离计算方法有多种如 Sneath and Sokal 法、 Russell and Rao 法等, 但最常用的是 Nei and Li 法和 Jaccard 法,其计算公式如下: 1. Nei and Li 距离法:

第5章 聚类分析5

2.ISODATA聚类算法ISODATA算法:Iterative Self-Organizing Data Analysis Technigues Algorithm,迭代自组织的数据分析算法。

ISODATA算法特点:可以通过类的自动合并(两类合一)与分裂(一类分为二),得到较合理的类型数目c。

具体算法步骤:⑴给定控制参数K:预期的聚类中心数目。

nθ:每一聚类中最少的样本数目,如果少于此数就不能作为一个独立的聚类。

sθ:一个聚类域中样本距离分布的标准差(阈值)。

cθ:两个聚类中心之间的最小距离,如果小于此数,两个聚类合并。

L:每次迭代允许合并的最大聚类对数目。

I:允许的最多迭代次数。

给定n个混合样本,令1=J(迭代次数),预选c个起始聚合中心,) (J Zj ,cj,...,2,1=。

⑵计算每个样本与聚合中心距离:))(,(JZxDjk。

若:},...,2,1)),(,({min))(,(,...,2,1nkJZxDJZxDjkcjjk===,则:ikwx∈。

把全部样本划分到c个聚合中去,且jn表示各子集j X中的样本数目。

⑶判断:若njnθ<,cj,...,2,1=则舍去子集j X,1-=cc,返回②。

⑷计算修改聚合中心:∑==jnkjkjjxnJZ1)(1)(,cj,...,2,1=。

⑸计算类内距离平均值jD:∑==jn k j j k jj J Z x D n D 1)())(,(1,c j ,...,2,1= ⑹ 计算类内总平均距离(全部样本对其相应聚类中心的总平均距离):∑=⋅=cj j j D n n D 11 ⑺ 判别分裂、合并及迭代运算等步骤。

(a )如迭代运算次数已达I 次,即最后一次迭代,置0=c θ,跳到⑾,运算结束。

(b )如2K c ≤,即聚类中心的数目等于或不到规定值的一半,则转⑻,将已有的聚类分裂。

(c )如迭代运算的次数是偶数,或K c 2≥,则不进行分裂,跳到⑾,若不符合上述两个条件,则进入⑻,进行分裂处理。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

5.3 基于试探的聚类搜索算法

2.3.2 最大最小距离算法 • [算法(实例)]

5.4 系统聚类法

• 基本思想 将模式样本按距离准则逐步分类,类 别由多到少,直到获得合适的分类要 求为止。

• [算法]

系统聚类也称为Hierarchical Clustering

• Many times, clusters are not disjoint, but a cluster may have subclusters, in turn having subsubclusters, etc.

量纲对分类的影响(图例)

5.2 模式相似性的测度和 聚类准则

5.2.2 聚类准则 有了模式的相似性测度,还需要一种基 于数值的聚类准则,能将相似的模式样 本分在同一类,相异的模式样本分在不 同的类。

• 试探方法 • 聚类准则函数法

5.2 模式相似性的测度和 聚类准则

5.2.2 聚类准则

• 试探方法

– 名义尺度:指定性的指标,即特征度量时没有数量 关系,也没有明显的次序关系,如黑色和白色的关 系,男性和女性的关系等,都可将它们分别用“0” 和“1”来表示。

5.2 模式相似性的测度和 聚类准则

5.2.1 相似性测度

• 目的:为了能将模式集划分成不同的类别,必须定义 一种相似性的测度,来度量同一类样本间的类似性和 不属于同一类样本间的差异性。

5.2 模式相似性的测度和 聚类准则

5.2.2 聚类准则 • 聚类准则函数法

– [一种聚类准则函数J的定义]

• J代表了属于c个聚类类别的全部模式样本与其 相应类别模式均值之间的误差平方和。

• 对于不同的聚类形式,J值是不同的。 • 目的:求取使J值达到最小的聚类形式。

5.3 基于试探的聚类搜索算法

• 第一个聚类中心的位置 • 待分类模式样本的排列次序 • 距离阈值T的大小 • 样本分布的几何性质

5.3 基于试探的聚类搜索算法

2.3.1 按最近邻规则的简单试探法 • 讨论(续)

– 距离阈值T对聚类结果的影响

5.3 基于试探的聚类搜索算法

5.3.2 最大最小距离算法

• 基本思想:以试探类间欧氏距离为最大 作为预选出聚类中心的条件。

– 依据:由于聚类是将样本进行分类以使类别间可 分离性为最大,因此聚类准则应是反映类别间相 似性或分离性的函数;

– 由于类别是由一个个样本组成的,因此一般来说 类别的可分离性和样本的可分离性是直接相关的;

– 可以定义聚类准则函数为模式样本集{x}和模式类 别寻{找S准j, j则=1函,2,数…极,c}值的的函最数优,化从问而题使。聚类分析转化为

5.1 聚类分析的相关概念

• 特征选择的维数

在特征选择中往往会选择一些多余的特征,它增加了 维数,从而增加了聚类分析的复杂度,但对模式分类 却没有提供多少有用的信息。在这种情况下,需要去 掉相关程度过高的特征(进行降维处理)。

• [降维方法]

– 结论:若rij→1,则表明第i维特征与第j维特征所反 映的特征规律接近,因此可以略去其中的一个特 征,或将它们合并为一个特征,从而使维数降低 一维。

聚类分析是按不同对象之间的差异,根据距 离函数的规律(大小)进行模式分类的。

5.1 聚类分析的相关概念

• 聚类分析的有效性

聚类分析方法是否有效,与模式特征向量的 分布形式有很大关系。

– 若向量点的分布是一群一群的,同一群样本密集 (距离很近),不同群样本距离很远,则很容易 聚类;

– 若样本集的向量分布聚成一团,不同群的样本混 在一起,则很难分类;

第5章聚类分析.

5.1 聚类分析的相关概念

• 定义

对一批没有标出类别的模式样本集,按 照样本之间的相似程度分类,相似的归 为一类,不相似的归为另一类,这种分 类称为聚类分析,也称为无监督分类。

5.1 聚类分析的相关概念

• 模式相似/分类的依据

把整个模式样本集的特征向量看成是分布在 特征空间中的一些点,点与点之间的距离即 可作为模式相似性的测量依据。

– [欧氏距离]

• 量纲对分类的影响(下页图例)

– [马氏距离]

• 特点:排除了模式样本之间的相关性 • 问题:协方差矩阵在实际应用中难以计算

– [一般化的明氏距离] – [角度相似性函数]

• 特点:反映了几何上相似形的特征,对于坐标系的旋转、 放大和缩小等变化是不变的。

• [当特征的取值仅为(0,1)两个值时的特例]

– 对具体对象做聚类分析的关键是选取合适的特征。 特征选取得好,向量分布容易区分,选取得不好, 向量分布很难分开。

5.1 聚类分析的相关概念

• 两类模式分类的实例:一摊黑白围棋子

– 选颜色作为特征进行分类,用“1”代表白, “0”代表黑,则很容易分类;

– 选大小作为特征进行分类,则白子和黑子 的特征相同,不能分类(把白子和黑子分 开)。

• Consider a sequence of partitions of the n samples into c clusters

凭直观感觉,针对实际问题定义一种相 似性测度的阈值,然后按最近邻规则指 定某些模式样本属于某一个聚类类别。

– 例如对欧氏距离,它反映了样本间的近邻 性,但将一个样本分到不同类别中的哪一 个时,还必须规定一个距离测度的阈值作 为聚类的判别准则。

5.2 模式相似性的测度和 聚类准则

5.2.2 聚类准则 • 聚类准则函数法

5.1 聚类分析的相关概念

• 模式对象特征测量的数字化 计算机只能处理离散的数值,因此根据识别 对象的不同,要进行不同的数据化处理。

– 连续量的量化:用连续量来度量的特性,如长度、 重量、面积等等,仅需取其量化值;

– 量级的数量化:度量时不需要详尽的数值,而是相 应地划分成一些有次序的量化等级的值。

5.3.1 按最近邻规则的简单试探法 • [算法]

• 讨论

– 这种方法的优点:计算简单,若模式样本 的集合分布的先验知识已知,则可获得较 好的聚类结果。

5.3 基于试探的聚类搜索算法

5.3.1 按最近邻规则的简单试探法 • 讨论(续)

– 在实际中,对于高维模式样本很难获得准确的先 验知识,因于以下因素: