基于最小二乘算法的RBF

一种RBF神经网络的混合学习算法在CPI中的应用

CI 8s Num b TP】 3 a er 8

1 引言

研 究 表 明 , 约 R F神 经 网 络 发 展 及 应 用 的 瓶 颈 主 要 制 B 有 : 何 确 定 满 足 精 度 要 求 的最 小 网络 拓 扑 结 构 ; 网络 拓 如 当

பைடு நூலகம்

明显 无 法 满 足 要 求 或 效 果 不 好 , 生 成 的 网 络 非 常 大 , 或 或数 字 的病 态 产 生 线 性 的 结 果 , 造 成 有 些 中心 值 很 接 近 。 正 或 交 最 小 二 乘 法 OL Or o oa L atS u rs , 正 交 性 S( t g n l es q ae) 其 h 可 以有 效 地 解 决 上 述 问题 ] S算 法 采 用 正 交 化 方 法 独 , OL 立 计 算 回归 算 子 对 输 出 的 贡 献 , 使 中心 的 选 择 步 骤 简 单 故 有 效 , 从 大 量 的 候 选 值 中 选 择 合 适 的 回归 中心 子 集 , 以 其 可

RBF神经网络

6. 调用 void RBFNet::lms(),采用梯度训练算法,由 u[1],计算权值 w,并保存在 w[2]数组 之中,同时计算出输出的结果,保存在 u[2]之中; 7. 调用 double RBFNet::getwucha(),计算 u[2]与样本输出之间的误差大小(选择不同的聚 类中心数,分别计算误差,选出误差最小时的聚类中心数目); 8. 调用 void RBFNet::saveW(double *newW),将计算出的权值,以文件的形式保存下来,以 方便下次调用; 9. 调用 void RBFNet::saveGaosi(double *newG),同上,保存高斯因子,将训练好的网络保 存下来;

RBF 神经网络: RBF 神经网络又称为径向基函数神经网络是一类常用的 3 层前馈网络, 也可用于函数逼近及 分类,常用的 RBF 网络为 n-h-m 结构,即网络具有 n 个输入,h 个隐节点,m 个输出。 RBF 的常用算法用:聚类方法,梯度训练方法,正交最小二乘算法等等,在本次算法实现过 程中,主要用到了聚类方法和梯度训练方法。 常用的 RBF 算法实现流程是: 1. 算法初始化:选择 h 个不同的初始聚类中心,并令 k=1。初始聚类中心的方法很多,比 如,从样本输入中随机选取,或者选择前 h 个样本输入,但这 h 个初始数据中心必须取 不同值。距离||X j –c i(k)||,i=1,2,· · ·,h,j=1,2,· · ·,N。 3. 对样本输入 X j 按最小距离原则对其进行分类: 即当 i(X j)=min||X j –c ( k ) || , i=1,2, · · · ,h i 时,X j 即被归化为第 i 类,将 n 个输入分为 h 类。 4. 重新计算各类的新的聚类中心: C i(k+1)=Ni

三种RBF神经网络比较分析

三种RBF神经网络比较分析摘要:径向基函数(RBF)神经网络广泛应用于模式识别、非线性函数逼近等领域。

通过对聚类、梯度、正交最小二乘三种RBF神经网络进行正弦函数逼近的仿真实验,从中比较分析这三种RBF神经网络。

得到的对比分析结果表明:正交最小二乘的方式所需的训练时间最短,网络收敛速度最快,并且不需要预先定义隐层节点数。

关键词:神经网络;径向基函数;Matlab0引言人工神经网络是一种模仿生物神经网络的结构和功能的数学模型或计算模型。

现代神经网络是一种非线性统计性数据建模工具,常用来对输入和输出间复杂的关系进行建模,或用来探索数据的模式。

RBF神经网络即径向基函数神经网络(Radical Basis Function),是由J. Moody和C. Darken于上世纪80年代末提出的一种神经网络模型。

径向基函数神经网络是一种高效的前馈式神经网络,它具有其他前向网络所不具有的最佳逼近性能和全局最优特性,并且结构简单,训练速度快。

同时,它也是一种可以广泛应用于模式识别、非线性函数逼近等领域的神经网络模型。

1RBF神经网络原理由输入层、一个隐含层(径向基层)和一个线性输出层组成的前向RBF神经网络结构如图1。

隐含层神经元是将该层权值向量w与输入向量c之间的矢量距离与偏差b相乘后作为该神经元激活函数的输入,即:Ini=(‖w-c‖·bi)2=∑n[]j=1(wji-cj)2·bi(1)若取径向基函数为高斯函数,则神经元的输出为:Outi=e-In2i=e-(‖w-c‖·bi)2=e-(∑n[]j=1(wji-cj)2·bi)2(2)由式(1)可以看出,随着和之间距离的减少,径向基函数输出值增加,且在其输入为0时,即w和c之间的距离为0时,输出为最大值1。

1.1基于聚类的RBF神经网络原理基于聚类的RBF神经网络方法最早由Broomhead and Lowe提出。

最简单形式是有固定的中心,映射属性的参数有两组:输出层权值w,和径向基函数中心c。

最小二乘算法在RBF神经网络中的应用

此 ,B R F网络 以其简单的结构 、 快速 的训练过 程和 良好 的推 广能力 等诸 多优点 已在许多应用领域取得 了巨大 的成功 , 特 别是在模式分类 和函数逼近方面 。

R F网络 中心选 取正交最 小二乘 0 s算法 , B L 解决 了径

R F网络 中所用的非线性 函数的形式对 网络性能的影 B 响并不是至关重要 的, 关键 因素是 基 函数 中心的选取 , 中心

2 R F中心选取 的正 交最d -乘算 法 B x

正交最 d - 乘 ( r ooa L atS ur-O S 法来 源 x O t gnl es q ae- L ) h

于线性 回归模型。令网络的训练样本对为 { , ” } ”= d( ) , 12 …, , , N。其 中 , 为训练样本 数 ; ∈R N 为网络 的输入 数据矢量 ; ( ) d ” ∈R’ 网络的期望输 出响应 。根据线性 回 为

选取不 当构造 出来 的 R F网络 的性 能一般 不能令人 满意。 B

例如 , 如果某 些中心靠 的太近 , 产生近似线形相关 , 会 从而带 来数值上 的病变条件。由于 R F网络中心选取是该 网络能 B

否成功用于实际的关键 , 因此下面我们主要研究径 向高斯 函 数中心 的选取算法 。

关键词 : 径向基 函数 ; 神经 网络 ; 最小二乘算法 ; 函数逼近

中 图分 类 号 : P 8 T 1 文 献标 识 码 : A

0 引言

近年来 , 随着智能技 术 的发 展 , 神经 网络理论 已得 到 了

广泛的应用 , 中前馈 网络和反馈 网络是两 种典 型的 网络模 其

y: i

图 1 R F网络 结构 B

u j= e xp

基于改进RBF神经网络的动态测量误差预测方法

算法 ( O S 来 改进 传 统 的 R F神 经 网络 存 在 的不 R L) B 足 , 而有效地提 高了动态测量误 差的预测精度 。 从

1 I F神 经 网络 结 构 m

R F神 经 网 络 可 以 看 成 是 一 从 输 入 到输 出 的 B 高度 非线 性 映射 , , 一 即 X)=Y 。对 于 样 本 集合 : 输入 (∈ 和 输 出 Y(∈R ) 可 以认 为存 R) , 在某 一映 射 g 使 g )=Y, 要 求 出一 映 射 , , ( 现 使 得在某 种 意 义 下 , g的最 佳 逼 近 。神 经 网络 通 . 厂是 过 对 简单 的非线 性 函数 进 行数 次 复合 , 可近 似 为 复

杂 函数 。

术 的发展 , 时误差 修 正 己变得 越来 越 重 要 , 进 行 实 在

实时误差修正过 程时 , 不可避免地 要对 动态测 量误差

进行建模预测 , 动态测量误差的建模预测是误差修正 的基础 , 在误差修 正技 术 中具有 非常重要 的地位 。

动态 测量误差模 型的精 度很 大程 度 上决 定 了对

t n( B )n ua ntok ti p p r usf w r ea oi m o v l eai dcmpti erig i R F e rl e r , s ae t o adt l rh f a pn l e o e t el nn o w h p r h g t i r z iv a ( P L n eus eotoo a l s su r( O S n k sas d f y a cm aue e t r R C )adrc r v r gn l e t q ae R L )a dmae t yo nmi esrm n e- i h a u d

rbf神经网络原理

rbf神经网络原理RBF(RadialBasisFunction)神经网络是一种广泛应用的人工神经网络,它以其准确性和高精度被广泛应用于多种领域,其中有建模预测、模式识别和控制系统等。

本文首先介绍了RBF神经网络的基本原理,然后介绍了其优势及模式识别应用,最后重点介绍了其在控制系统研究中的应用。

RBF神经网络的原理是在一个给定的期望输出集合中,通过学习总结出一组带有可调整参数的基函数分布,以此来进行近似。

它的本质是一个二次形式的最小二乘函数:E(w)=∑i{p[i]-yd[i]^2}+∑jε{wj*hj(x)}其中p[i]是第i个观测点的期望输出,hj(x)是第j个基函数,wj是它的参数,yd[i]是第i个点的实际输出值。

基函数通常用高斯函数形式,其参数会在学习过程中不断调整,使得建模能够准确拟合实际数据。

RBF神经网络的优势在于其具有可解释性、快速学习速度、无局部极小点和可扩展性等特点,即其可以有效解决复杂的系统建模和控制问题。

在模式识别方面,由于RBF神经网络具有很高的识别精度,它被广泛用于语音识别、图像分类等复杂任务。

例如,一些研究者使用RBF神经网络来识别人脸图像,以及基于光学字符识别的文本翻译系统,其准确率高达99%。

另外,RBF神经网络也被广泛用于控制系统领域,其中包括机器人控制、动力系统控制及非线性系统的鲁棒控制和稳定控制等。

例如,研究者使用RBF神经网络设计了一种可用于机器人末端重力补偿的非线性控制器,提高了机器人对负载变化的响应效果。

总而言之,RBF神经网络具有可解释性、快速学习速度、无局部极小点和可扩展性等优势,广泛应用于各种领域,如模式识别、控制系统设计等。

通过RBF神经网络可以更好地解决复杂的实际问题,具有极大的应用价值。

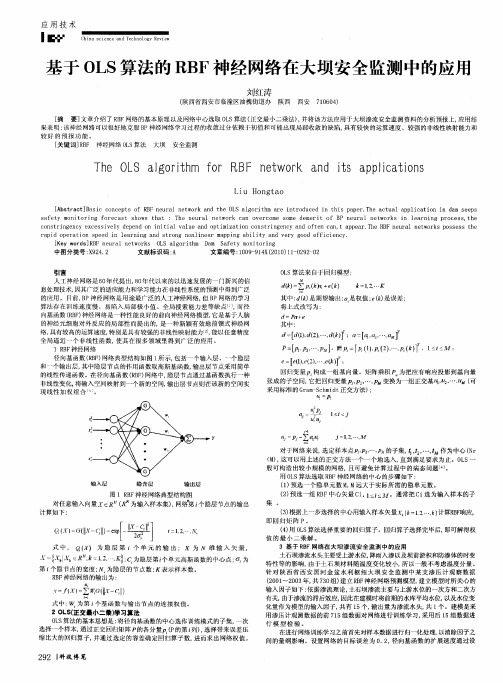

基于OLS算法的RBF神经网络在大坝安全监测中的应用

文 章编号 :09 94 (0 0 1 09 —2 10 — 1X 2 1)卜 2 20 0S L 算法 来 自于回 归模型 :

引言 人工神 经 网络 是 6 年 代提 出, O 0 8 年代 以来 的 以迅 速发 展 的一 门新 兴的信 息处 理技术, 因其 ,泛 的适 应能力 和学 习能力在 非线性系 统的预测 中得到广 泛

【e o d R F n u a n t o k 0 S l o i h D m S f t o t r n K y w r sJ B e r 1 e w r s L a g r t m a a e y m ni o i g

中图 分类号 :9 42 X 2 .

文献标 识码 : A

其 中: () d k是期 望输 出 : a是权值 :() ek 是误 差 : 将 上式 改写 为 : d =Pa+ Fra bibliotek其中:

d [( ( ) ( “ [ ・ r】 =d ) (. d ); =q 一 1, 2 一 ,

P 【 2 , =n【 毂f , () , l ; =nP … P 】而 『 1 2 … 鼽 l l j )

应用 技 术

I ■

基于 O S算法的 R F神 经网络在大坝安全 监测中的应用 L B

刘红涛

( 陕西省 西安 市临潼 区油槐 街道 办 陕西 西安 7 0 0) 164 [ 摘 要] 文章 介绍 了 R F网络 的基本 原理 以及 网络 中心 选取 O S 法 ( 交最 小二乘 法) 并将 该方 法应用 于大 坝渗 流安全 监测 资料 的分析 预报 上, B L算 正 , 应用 结 果表 明 : 该神经 网路可 以很好 地 克服 B P神经 网络 学习过 程 的收敛过 分依赖 于初 值和可 能 出现局 部收 敛的缺 陷, 有较快 的运 算速度 、较 强的非 线性 映射能 力和 具 较 好 的预 报 功 能 。 [ 关键 词] B 神经 网络 O S 法 大坝 安全 监测 RF L算

径向基神经网络学习算法(RBF)

Mezer chen 2018.5.9

RBF简介

1989年,Moody和Darken提出了一种由两个阶段组成的混 合学习过程的思路。

①无监督的自组织学习阶段 ②有监督学习阶段

其任务是用自组织聚类方法为隐 层节点的径向基函数确定合适的 数据中心,并根据各中心之间的 距离确定隐节点的扩展常数。 一般采用Duda和Hart1973年提 出的k-means聚类算法。

其任务是用有监督 学习算法训练输出 层权值,一般采用 梯度法进行训练。

RBF网络的工作原理

RBF网络特点

只有一个隐含层,且隐层神经元与输出层神经元的模型不同。 隐层节点激活函数为径向基函数,输出层节点激活函数为线 性函数。 隐层节点激活函数的净输入是输入向量与节点中心的距离 (范数)而非向量内积,且节点中心不可调。 隐层节点参数确定后,输出权值可通过解线性方程组得到。 隐层节点的非线性变换把线性不可分问题转化为线性可分问 题。 局部逼近网络(MLP是全局逼近网络),这意味着逼近一个输 入输出映射时,在相同逼近精度要求下,RBF所需的时间要 比MLP少。 具有唯一最佳逼近的特性,无局部极小。 合适的隐层节点数、节点中心和宽度不易确定。

RBF神经网络中心选取

① 从样本输入中选取中心

一般来说,样本密集的地方中心点可以适当多些,样本 稀疏的地方中心点可以少些;若数据本身是均匀分布的,

中心点也可以均匀分布。总之,选出的数据中心应具有代

表性。径向基函数的扩展常数是根据数据中心的散布而确 定的,为了避免每个径向基函数太尖或太平,一种选择方 法是将所有径向基函数的扩展常数设为

d max 2I

② 自组织选取中心法

常采用各种动态聚类算法对数据中心进行自组织选择,在

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

基于正交最小二乘算法的RBF神经网络

一、实验环境

硬件平台Win10 64位操作系统,1.5GHZ,4G内存,软件版本MA TLAB2015b

二、实验数据

训练数据集:

T

F W M Y Q

1000.00130010000

20.00740.03350.00150.00320.010610000

30.00430.022300.00470.005310000

40.5520.30170.25810.30940.231601000

50.54520.27930.26110.29880.203601000

60.55020.24580.27170.31150.234701000

70.24620.15080.09470.09640.099900100

80.25350.10610.09680.09710.08100100

90.26650.08940.09370.09940.090800100

100.66150.52510.51950.471100010

110.67380.44130.52250.47320.966700010

120.66650.47490.52550.47690.975800010

13110.981210.820600001

140.97970.977710.9960.775900001

150.98460.97270.98470.98570.7600001

测试数据集:

T

F W M Y Q

10.00310.02350.00050.0030.004510000

20.54930.26260.26590.30880.222101000

30.25720.10060.09580.09810.08900100

40.67040.49720.52350.47410.979100010

50.9920.98990.99790.99370.797900001

三、算法介绍

RBF函数网络从结构上看是一个3层前馈网络,包括一个输入层、一个输出层和一个隐含层。

输入层节点的作用是将输入数据传递到隐含层节点。

隐含层节点称为RBF节点,其激活函数为辐射状函数的神经元构成,通常采用高斯型函数:Array

图1 RBF结构

RBF网络中所用的非线性函数的形式对网络性能的影响并不是至关重要的,关键因素是基函数中心的选取,中心选取不当构造出来的RBF网络的性能一般不能令人满意。

例如,如果某些中心靠的太近,会产生近似线形相关,从而带来数值上的病变条件。

基本的RBF 神经网络采用随机抽取固定中心的方法,在输入样本数据的分布具有某种特性的情况下,采用这种方法解决给定问题就显得简单可行了。

而针对其缺陷,已经有许多改进的方法,其中

之一就是利用最小二乘法选取中心,训练网络权重。

四、程序设计

1.RBF基本算法

程序分为数据准备,网络训练,网络测试,图形绘制四部分。

数据准备部分将EXCEL表格中的训练集测试集数

据导入MATLAB工作空间,作为实验的数据源。

然后

对程序参数进行初始化设置在训练集中随机抽取数据

作为RBF中心。

网络训练部分进行样本迭代训练,每

一次迭代结束计算误差是否达到精度要求,若未达到精

度要求则调整权值进行下一次迭代。

精度达到要求或达

到最大步数则结束训练,进入测试阶段。

最后绘制训练

误差图形,输出测试结果。

图2 基本RBF程序流程图2.基于正交最小二乘法的改进设计

正交最小二乘法是神经网络中的很重要的一种学习方法。

线性回归模型是算法的来源。

不失一般性,考虑网络中只有一个单元的输出层。

令网络训练样本对为

其中、N代表训练样本数。

Xn是网络输入数据矢量。

d(n)表示网络期望输出响应。

网络的期望输出响应根据选型回归模型可以表达为

式中M是隐含层的单元数M<N。

p(i)是回归算子,它其实也是在某种参数下,隐含层产生的响应,可以用下式表达

Wi为模型参数,同样也可以表示输出层连接隐含层的权;e(n)是残差。

将4-40写成矩阵方程形式,可表示为

式中,P为回归矩阵。

选择回归算子矢量pi是求解回归方程式的关键。

P确定以后,就可以用线性方程组来求解模型参数矢量。

通常的RBF中心,是从输入的样本数据的矢量集合中做选择。

每当选定一组ti,就能得到一个对应于输入样本的回归矩阵。

值得注意的是,

回归算子的个数M的选择和它的变化都直接影响回归模型中的残差。

我们要选择那些对降低残差贡献显著回归的算子,剔除对降低残差贡献差的回归算子。

为了得到满足二次性能指标的网络输出,OLS法需要的工作是通过学习选择出合适的回归算子矢量,以及它的个数M,OLS法的基本思想是正交化pi,分析判断pi对降低残差的贡献,选择贡献显著的回归算子并确定其个数。

将P进行正交三角形分解,P=UA,U是各列正交的N*M阵,A为上三角矩阵。

经运算得到最小二乘解

定义误差压缩比,据此可以选择重要的回归算子。

总结OLS算法的具体过程是:

(1)进行隐含层单元数的预选工作。

(2)选择一组RBF中心矢量ti,1≤i≤M

(3)选择输入样本矢量计算P

(4)正交化P矩阵

(5)分别计算

(6)计算上三角矩阵A,根据AW=G求连接权重。

(7)检查是否满足以下公式

如果得到满足,则停止计算。

否则,重新开始第2步。

五、调试过程及结果

1.RBF基本算法

网络结构及参数:选择5个输入神经元,5个输出神经元,隐层神经元个数20个,目标精度0.001。

训练过程误差变化如图3所示,经过两次迭代就达到精度要求。

图3 基本RBF训练过程

此时输出结果如下表所示,由结果可知经过训练后的网络很好的实现了分类目的,且精度较高。

此时网络权值如下表所示,M为隐层神经元,Y为输出神经元

RBF中心取值分别为

改变隐藏神经元个数为5个训练及测试结果:

通过测试数据可以看到并未达到分类要求,因此隐层神经元太少会影响分类精度,而且在调试过程中由于初始权值以及网络中心都是随机选择,同一参数下测试效果也不相同。

2.基于正交最小二乘法的改进设计

基于正交最小二乘算法的RBF改进算法并没有成功实现。

在程序设计调试过程中,开始并不了解RBF的工作原理,于是参考了《智能控制》(),《MATLAB神经网络:::》以及网络上一篇名为《RBF神经网络的matlab简单实现》的博客文章,了解了RBF的基本结构及其实现方法。

在基本算法完成的情况下,考虑正交最小二乘算法与RBF神经网络的结合问题。

对于最小二乘法,可以理解为是一种数学优化技术。

它通过最小化误差的平方和寻找数据的最佳函数匹配。

利用最小二乘法可以简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。

在知网期刊论文文库搜索了大量相关的文献资料,通过阅读文献发现最小二乘法常用来进行隐层神经元中心的选择以及权值的修正,上一部分研究已经发现RBF隐层神经元函数中心的选择直接影响了网络训练结果的好坏,基于正交最小二乘算法的RBF改进算法就是利用最小二乘法进行网络中心的选择以及权值调整。

接下来在一篇硕士论文《基于RBF神经网络的浮船坞浮态检验系统辨识》中找到基于最小二乘算法改进RBF神经网络的较为详细的总体步骤。

(如第四部分所述),据此设计程序。

首先进行数据准备工作,将训练数据测试数据导入MATLAB工作空间,然后初始化所需参数,计算回归矩阵P,p(i)为第i个隐层的输出向量,对P进行正交化处理,程序中采用QR分解的方法,得到正交矩阵U以及上三角矩阵A,之后再求取g和误差压缩比时针对多维输出情况遇到困难,至此,问题的关键集中于如何求取误差压缩比并选择最佳的中心点向量,通过每次迭代增加隐层中心数目更新权值矩阵直至误差达到精度要求。

接下来的工作应该建立在充分理解最小二乘算法的基础上解决多维输出情况下最优中心点选择的问题。

对于测试部分、结果处理绘图程序同前述基本RBF算法。

六、讨论与小结

由实验可知,RBF神经网络在分类问题中具有优越性能。

通过动手编制RBF底层学习算法程序可以促使我们深入了解算法原理,在其缺陷基础上提出改进措施。

由于时间有限,实验改进算法虽未顺利完成,但也在其中学到了更多程序改进的思路。

未完成的部分还需要继续研究。

参考文献

[1]焦玉莹. 基于RBF神经网络的浮船坞浮态检验系统辨识[D]. 大连海事大学,2011.

[2]何加宝.多段径向基函数网络的正交最小二乘法和正则最小二乘法[D]. 安徽工业大学: 安徽工业大学,2013.

[3]刘金玲,. 基于OLS算法的RBF网设计方法与实现[J]. 计算机时代,2010,(7)

[4]陈涛,蒋林,屈梁生. 基于正交最小二乘学习算法的径向基函数网络设计[J]. 中国机械工程,1997,(6).

[5]曹屹立,葛超,张景春,孙丽英,朱艺,. 最小二乘算法在RBF神经网络中的应用[J]. 山西电子技术,2008,(1).

[6]韦巍,何衍.智能控制基础[M].清华大学出版社,2008.

[7]陈明.MATLAB神经网络原理与实例精解[M].清华大学出版社.2013.。