模式识别报告 bayes分类

模式识别第二章

p(x)~N(μ,Σ)

第二章 贝叶斯决策理论

37

等概率密度轨迹为超椭球面

正态分布 Bayes决策

p ( x ) c ( x μ ) T 1 ( x μ ) 2

i

第二章 贝叶斯决策理论

9

分类器设计

判别 函数

分类器是某种由硬件或软件组成的“机器”:

➢计算c个判别函数gi(x)

➢最大值选择

x1

g1

x2

g2

ARGMAX

a(x)

.

.

.

.

.

.

xn

gc

多类识别问题的Bayes最大后验概率决策:gi(x) = P (ωi |x)

第二章 贝叶斯决策理论

10

2.3 Bayes最小错误率决策

根据已有知识和经验,两类的先验概率为:

➢正常(ω1): P(ω1)=0.9 ➢异常(ω2): P(ω2)=0.1 ➢对某一样本观察值x,通过计算或查表得到:

p(x|ω1)=0.2, p(x|ω2)=0.4

如何对细胞x进行分类?

第二章 贝叶斯决策理论

15

Bayes最小错误率决策例解(2)

最小错误 率决策

利用贝叶斯公式计算两类的后验概率:

P ( 1|x ) 2 P P ( ( 1)jp )( p x (x | | 1 )j)0 .9 0 0 ..9 2 0 0 ..2 1 0 .40 .8 1 8

j 1

P ( 2|x ) 2 P P ( ( 2)jp )( p x (x | | 2)j)0 .2 0 0 ..9 4 0 0 ..1 4 0 .1 0 .1 8 2

模式识别(3-1)

§3.2 最大似然估计

最大似然估计量: -使似然函数达到最大值的参数向量。 -最符合已有的观测样本集的那一个参数向量。 ∵学习样本从总体样本集中独立抽取的

N ) p( X | ) p( X k | i ) k 1 N个学习样本出现概率的乘积

i

i

∴

p( X | i . i

i

§3.2 Bayes学习

假定: ①待估参数θ是随机的未知量 ②按类别把样本分成M类X1,X2,X3,… XM 其中第i类的样本共N个 Xi = {X1,X2,… XN} 并且是从总体中独立抽取的 ③ 类条件概率密度具有某种确定的函数形式,但其 参数向量未知。 ④ Xi 中的样本不包含待估计参数θj(i≠j)的信息,不 同类别的参数在函数上是独立的,所以可以对每一 类样本独立进行处理。

有时上式是多解的, 上图有5个解,只有一个解最大即 (对所有的可能解进行检查或计算二阶导数)

§3.2 最大似然估计

例:假设随机变量x服从均匀分布,但参数1, 2未知, 1 1 x 2 p ( x | ) 2 1 , 0 其他 求1, 2的最大似然估计量。 解:设从总体中独立抽取N个样本x1 , x2 , , xN , 则其似然函数为: 1 p ( x1 , x2 , , xN | 1, 2 ) ( 2 1 ) N l ( ) p ( X | ) 0

§3.2 Bayes学习

p ~ N 0 , 0

2

其中 0和 0 是已知的

2

已知的信息还包括一组抽取出来的样本X i x1 , x2 ,, xN ,从而 可以得到关于 的后验概率密度:

模式识别上机实验报告

实验一、二维随机数的产生1、实验目的(1) 学习采用Matlab 程序产生正态分布的二维随机数 (2) 掌握估计类均值向量和协方差矩阵的方法(3) 掌握类间离散度矩阵、类内离散度矩阵的计算方法(4) 熟悉matlab 中运用mvnrnd 函数产生二维随机数等matlab 语言2、实验原理多元正态分布概率密度函数:11()()2/21/21()(2)||T X X d p X eμμπ---∑-=∑其中:μ是d 维均值向量:Td E X μμμμ=={}[,,...,]12Σ是d ×d 维协方差矩阵:TE X X μμ∑=--[()()](1)估计类均值向量和协方差矩阵的估计 各类均值向量1ii X im X N ω∈=∑ 各类协方差矩阵1()()iTi iiX iX X N ωμμ∈∑=--∑(2)类间离散度矩阵、类内离散度矩阵的计算类内离散度矩阵:()()iTi iiX S X m X m ω∈=--∑, i=1,2总的类内离散度矩阵:12W S S S =+类间离散度矩阵:1212()()Tb S m m m m =--3、实验内容及要求产生两类均值向量、协方差矩阵如下的样本数据,每类样本各50个。

1[2,2]μ=--,11001⎡⎤∑=⎢⎥⎣⎦,2[2,2]μ=,21004⎡⎤∑=⎢⎥⎣⎦ (1)画出样本的分布图;(2) 编写程序,估计类均值向量和协方差矩阵;(3) 编写程序,计算类间离散度矩阵、类内离散度矩阵; (4)每类样本数增加到500个,重复(1)-(3)4、实验结果(1)、样本的分布图(2)、类均值向量、类协方差矩阵根据matlab 程序得出的类均值向量为:N=50 : m1=[-1.7160 -2.0374] m2=[2.1485 1.7678] N=500: m1=[-2.0379 -2.0352] m2=[2.0428 2.1270] 根据matlab 程序得出的类协方差矩阵为:N=50: ]0628.11354.01354.06428.1[1=∑ ∑--2]5687.40624.00624.08800.0[N=500:∑--1]0344.10162.00162.09187.0[∑2]9038.30211.00211.09939.0[(3)、类间离散度矩阵、类内离散度矩阵根据matlab 程序得出的类间离散度矩阵为:N=50: ]4828.147068.147068.149343.14[=bS N=500: ]3233.179843.169843.166519.16[b =S根据matlab 程序得出的类内离散度矩阵为:N=50:]0703.533088.73088.71052.78[1=S ]7397.2253966.13966.18975.42[2--=S ]8100.2789123.59123.50026.121[=W SN=500: ]5964.5167490.87490.86203.458[1--=S ]8.19438420.78420.70178.496[2=S ]4.24609071.09071.06381.954[--=W S5、结论由mvnrnd 函数产生的结果是一个N*D 的一个矩阵,在本实验中D 是2,N 是50和500.根据实验数据可以看出,当样本容量变多的时候,两个变量的总体误差变小,观测变量各个取值之间的差异程度减小。

[数学]模式识别方法总结

![[数学]模式识别方法总结](https://img.taocdn.com/s3/m/9bfe35a6a0116c175f0e484a.png)

假定有m个类别ω1, ω2, …, ωm的模式识别问题,

每类有Ni(i=1, 2, …, m)个样本, 规定类ωi的判别函数

为

gi (x) min x xik

i

k 1, 2,

, Ni

其中, xki表示第i类的第k个元素。 判决准则: gi (x) ,则x∈ω 若 g j (x) i min j 1,2, , m

定义Fisher线性判决函数为

( 1 2 )2 J F (w ) S1 S2

分子反映了映射后两类中心的距离平方,

该值越大, 类间可

分性越好;

分母反映了两类的类内离散度,

从总体上来讲,

其值越小越好;

JF(w)的值越大越好。 使JF(w)达到最大值的w即为最

在这种可分性评价标准下,

如果P(ω1|x)<P(ω2|x), 则判决x属于ω2;

如果P(ω1|x)=P(ω2|x), 则判决x属于ω1或属于ω2。

这种决策称为最大后验概率判决准则, 也称为贝叶斯 (Bayes)判决准则。 假设已知P(ωi)和p(x|ωi)(i=1, 2, …, m), 最大后验概率判 决准则就是把样本x归入后验概率最大的类别中, 也就是,

0

Sigmoid (a) 取值在(0, 1)内; (b) 取值在(-1, 1)内

神经网络结构 神经网络是由大量的人工神经元广泛互连而成 的网络。 根据网络的拓扑结构不同, 神经网络可分

R( j | x) ( j , i ) P(i | x)

i 1 m

最小风险贝叶斯判决准则: 如果

R( k | x) min R( j | x)

j 1, 2 ,, m

《模式识别》实验报告-贝叶斯分类

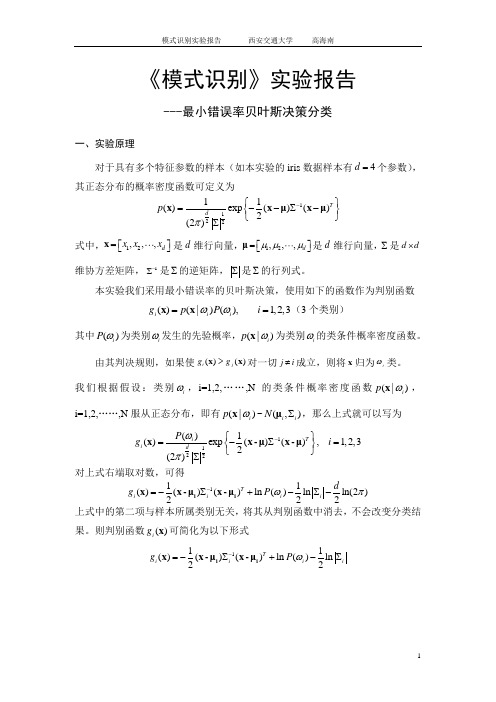

《模式识别》实验报告---最小错误率贝叶斯决策分类一、实验原理对于具有多个特征参数的样本(如本实验的iris 数据样本有4d =个参数),其正态分布的概率密度函数可定义为112211()exp ()()2(2)T d p π-⎧⎫=--∑-⎨⎬⎩⎭∑x x μx μ 式中,12,,,d x x x ⎡⎤⎣⎦=x 是d 维行向量,12,,,d μμμ⎡⎤⎣⎦=μ是d 维行向量,∑是d d ⨯维协方差矩阵,1-∑是∑的逆矩阵,∑是∑的行列式。

本实验我们采用最小错误率的贝叶斯决策,使用如下的函数作为判别函数()(|)(),1,2,3i i i g p P i ωω==x x (3个类别)其中()i P ω为类别i ω发生的先验概率,(|)i p ωx 为类别i ω的类条件概率密度函数。

由其判决规则,如果使()()i j g g >x x 对一切j i ≠成立,则将x 归为i ω类。

我们根据假设:类别i ω,i=1,2,……,N 的类条件概率密度函数(|)i p ωx ,i=1,2,……,N 服从正态分布,即有(|)i p ωx ~(,)i i N ∑μ,那么上式就可以写为1122()1()exp ()(),1,2,32(2)T i i dP g i ωπ-⎧⎫=-∑=⎨⎬⎩⎭∑x x -μx -μ对上式右端取对数,可得111()()()ln ()ln ln(2)222T i i i i dg P ωπ-=-∑+-∑-i i x x -μx -μ上式中的第二项与样本所属类别无关,将其从判别函数中消去,不会改变分类结果。

则判别函数()i g x 可简化为以下形式111()()()ln ()ln 22T i i i i g P ω-=-∑+-∑i i x x -μx -μ二、实验步骤(1)从Iris.txt 文件中读取估计参数用的样本,每一类样本抽出前40个,分别求其均值,公式如下11,2,3ii iii N ωωω∈==∑x μxclear% 原始数据导入iris = load('C:\MATLAB7\work\模式识别\iris.txt'); N=40;%每组取N=40个样本%求第一类样本均值 for i = 1:N for j = 1:4w1(i,j) = iris(i,j+1); end endsumx1 = sum(w1,1); for i=1:4meanx1(1,i)=sumx1(1,i)/N; end%求第二类样本均值 for i = 1:N for j = 1:4 w2(i,j) = iris(i+50,j+1);end endsumx2 = sum(w2,1); for i=1:4meanx2(1,i)=sumx2(1,i)/N; end%求第三类样本均值 for i = 1:N for j = 1:4w3(i,j) = iris(i+100,j+1); end endsumx3 = sum(w3,1); for i=1:4meanx3(1,i)=sumx3(1,i)/N; end(2)求每一类样本的协方差矩阵、逆矩阵1i -∑以及协方差矩阵的行列式i ∑, 协方差矩阵计算公式如下11()(),1,2,3,41i ii N i jklj j lk k l i x x j k N ωωσμμ==--=-∑其中lj x 代表i ω类的第l 个样本,第j 个特征值;ij ωμ代表i ω类的i N 个样品第j 个特征的平均值lk x 代表i ω类的第l 个样品,第k 个特征值;iw k μ代表i ω类的i N 个样品第k 个特征的平均值。

Bayes分类器算法

⇒ x ∈ωi

2、具体步骤如下 A).算出各类别特征值的均值 B).求出特征值的协方差矩阵 C).将第二步所得矩阵代入判别函数 g1(x)、g2(x) D).将待测试样本集数据依次代入 g1(x)- g2(x),若 g1(x)- g2(x)>0,则判断其为第一类,反

之为第二类。 3、流程图

确定特征及先验概率

体重: clear all; load FEMALE.txt; load MALE.txt; fid=fopen('test2.txt','r'); test1=fscanf(fid,'%f %f %c',[3,inf]); test=test1';

fclose(fid); Fmean = mean(FEMALE); Mmean = mean(MALE); Fvar = std(FEMALE); Mvar = std(MALE); preM = 0.9; preF = 0.1; error=0; Nerror=0; figure; for i=1:300

Nerror = Nerror +1; end; else plot(test(i,1),test(i,2),'k*'); if (test(i,3)=='F')

Nerror = Nerror +1; end end hold on; end; title('身高体重不相关最小风险的 Bayes 决策'); ylabel('身高(cm)'),zlabel('体重(kg)'); error = Nerror/300*100; sprintf('%s %d %s %0.2f%s','分类错误个数:',Nerror,'分类错误率为:',error,'%')

贝叶斯决策理论

g(x)

判别计算

阈值单元

决策

贝叶斯决策理论

2.3 正态分布时的统计决策

重点分析正态分布情况下统计决策的原因是: ①正态分布在物理上是合理的、广泛的 ②正态分布 数学表达上简捷,如一维情况下只

有均值和方差两个参数,因而易于分析

贝叶斯决策理论

贝叶斯决策理论

目标:所采取的一系列决策行动应该使期 望风险达到最小

手段:如果在采取每一个决策时,都使其 条件风险最小,则对所有的 x 作决策时, 其期望风险也必然达到最小

决策:最小风险Bayes决策

贝叶斯决策理论

最小风险Bayes决策规则:

其中

采取决策

贝叶斯决策理论

最小风险Bayes决策的步骤

2.2.6 分类器设计

要点: • 判别函数 • 决策面(分类面) • 分类器设计

贝叶斯决策理论

决策面(分类面)

对于 c 类分类问题,按照决策规则可以把 d 维特 征空间分成 c 个决策域,我们将划分决策域的 边界面称为决策面(分类面)

贝叶斯决策理论

判别函数

用于表达决策规则的某些函数,则称为判别 函数

E{ xi xj } = E{ xi } E{ xj }

贝叶斯决策理论

相互独立

成立

成立?? 多元正态分布的任

不相关

意两个分量成立!

贝叶斯决策理论

说明:正态分布中不相关意味着协方差矩阵

是对角矩阵

并且有

贝叶斯决策理论

④边缘分布(对变量进行积分)和条件分布(固定变 量)的正态性

⑤线性变换的正态性

y=Ax A为线性变换的非奇异矩阵。若 x 为正态分布,

第3章 Bayes决策理论

第3章 Bayes决策理论

“概率论”有关概念复习

Bayes公式:设实验E的样本空间为S,A为E的事件,

第3章 Bayes决策理论

B1,B2,…,Bn为S的一个划分,且P(A)>0,P(Bi)>0,

(i=1,2,…,n),则:

P( Bi | A) P( A | Bi ) P( Bi )

n

P( A | B

返回本章首页

第3章 Bayes决策理论

平均错误概率

P(e)

P (e x ) p ( x ) d x

从式可知,如果对每次观察到的特征值 x , P(e x) 是 尽可能小的话,则上式的积分必定是尽可能小的。这就 证实了最小错误率的Bayes决策法则。下面从理论上给 予证明。以两类模式为例。

解法1:

利用Bayes公式

第3章 Bayes决策理论

p ( x 10 | 1 ) P(1 ) P(1 | x 10) p ( x 10) p ( x 10 | 1 ) P(1 ) p ( x 10 | 1 ) P(1 ) p( x 10 | 2 ) P(2 ) 0.05 1/ 3 0.048 0.05 1/ 3 0.50 2 / 3

解法2:

写成似然比形式

第3章 Bayes决策理论

p ( x 10 | 1 ) 0.05 l12 (x 10) 0.1 p ( x 10 | 2 ) 0.50 P (2 ) 2 / 3 判决阀值12 2 P (1 ) 1/ 3 l12 (x 10) 12 , x 2 , 即是鲑鱼。

若 P(i x) P( j x) , j i ,则判

若 P(i x) 若 若

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

西安交通大学《模式识别》实验一——IRIS正态分布假设下的贝叶斯分类吴娟梅硕20813112313030对于具有多个特征参数的样本(如本实验的iris 数据样本有4d =个参数),其正态分布的概率密度函数可定义为112211()exp ()()2(2)T dp π-⎧⎫=--∑-⎨⎬⎩⎭∑x x μx μ式中,12,,,d x x x ⎡⎤⎣⎦=x 是d 维行向量,12,,,d μμμ⎡⎤⎣⎦=μ 是d 维行向量,∑是d d ⨯维协方差矩阵,1-∑是∑的逆矩阵,∑是∑的行列式。

本实验我们采用最小错误率的贝叶斯决策,使用如下的函数作为判别函数()(|)(),1,2,3i i i g p P i ωω==x x (3个类别)其中()i P ω为类别i ω发生的先验概率,(|)i p ωx 为类别i ω的类条件概率密度函数。

由其判决规则,如果使()()i j g g >x x 对一切j i ≠成立,则将x 归为i ω类。

我们根据假设:类别i ω,i=1,2,……,N 的类条件概率密度函数(|)i p ωx ,i=1,2,……,N 服从正态分布,即有(|)i p ωx ~(,)i i N ∑μ,那么上式就可以写为1122()1()exp ()(),1,2,32(2)T i i dP g i ωπ-⎧⎫=-∑=⎨⎬⎩⎭∑x x -μx -μ对上式右端取对数,可得111()()()ln ()ln ln(2)222T i i i i dg P ωπ-=-∑+-∑-i i x x -μx -μ上式中的第二项与样本所属类别无关,将其从判别函数中消去,不会改变分类结果。

则判别函数()i g x 可简化为以下形式111()()()ln ()ln 22T i i i i g P ω-=-∑+-∑i i x x -μx -μ1.用部分数据来估计均值、协方差首先读入数据clear allclc% 原始数据导入,原数据以文本的形式存储,iris是一个L*12的矩阵,L为数据长度iris = load('C:\Documents andSettings\Administrator\IRIS_Data.txt');%求出数据长度Ldisplay('数据长度为') L=length(iris)%iris是一个L*12的矩阵,12列共分为三类数据,每类占4列%将数据分类存储于三个数组w1=iris(1:L,1:4);w2=iris(1:L,5:8);w3=iris(1:L,9:12);然后选取训练样本估计均值、协方差。

训练样本的选取有很多种方法,我们采用两种较为常见的方法进行选取。

方法一是顺序选取。

分别试取[1:10]、 [11:50]两组数据进行训练,用于对比训练数据多寡对于分类效果的影响。

%顺序选取,参数可调,待输入选取的训练样本的起始点和截止点display('请输入每类训练样本在顺序选取时的');N0 = input('数据起始点(大于0小于L的整数)N0=');Nj = input('数据截止点(大于N0小于L的整数)Nj=');display('则训练样本长度为')N=Nj-N0+1 %提取样本的统计特征值,均值和协方差display('用上述部分数据估计的三类样本均值、协方差依次为');mean1=mean(w1(N0:Nj,:))mean2=mean(w2(N0:Nj,:))mean3=mean(w3(N0:Nj,:))cov1=cov(w1(N0:Nj,:))cov2=cov(w2(N0:Nj,:))cov3=cov(w3(N0:Nj,:))方法二是随机选取N个数据。

试随机取N=10、N=40两组数据进行训练。

同样也是用于比对训练数据的多寡对分类器的性能有何影响。

clear allclc% 原始数据导入,原数据以文本的形式存储,iris是一个L*12的矩阵,L为数据长度iris = load('C:\Documents andSettings\Administrator\IRIS_Data.txt');%求出数据长度Ldisplay('数据长度为')L=length(iris)%iris是一个L*12的矩阵,12列共分为三类数据,每类占4列%将数据分类存储于三个数组w1=iris(1:L,1:4);w2=iris(1:L,5:8);w3=iris(1:L,9:12);%随机选取,参数可调,待输入选取的训练样本的个数NN=input('请输入每类训练样本在随机选取时的样本长度为N=');%随机选取N个训练样本,即产生N个不大于数据长度L的不重复的整数作为其样本序号Numberranddata=randperm(L);Number1=randdata(1:N);Number=sort(Number1);%提取样本的统计特征值,均值和协方差display('用上述部分数据估计的三类样本均值、协方差依次为'); mean1=mean(w1(Number,:)) mean2=mean(w2(Number,:)) mean3=mean(w3(Number,:)) cov1=cov(w1(Number,:)) cov2=cov(w2(Number,:)) cov3=cov(w3(Number,:))2.用后验概率去判断数据的类型首先选取测试分类数据。

令先验概率可变,即选取不同的测试数据组数进行实验。

试取测试数据组数为10、10、10,正常取值,来考查前述训练样本数对分类结果的影响。

再试取数据组数为试取数据组数为4、40、50;45、4、3进行分类。

研究当先验概率很小时对分类效果的影响。

%选取w1[N10:N1j],w2[N20:N2j],w3[N30:N3j]用作每类测试的分类样本,可变先验概率%顺序选取,参数可调,待输入选取的测试分类样本的起始点和截止点%1类测试分类数据display('请输入1类测试分类样本在顺序选取时的');N10 = input('数据起始点(大于0小于L的整数)N10=');N1j = input('数据截止点(大于N0小于L的整数)N1j=');display('则1类测试分类样本长度为')N1=N1j-N10+1test1=w1(N10:N1j,:);%2类测试分类数据display('请输入第2类测试分类样本在顺序选取时的');N20 = input('数据起始点(大于0小于L的整数)N20=');N2j = input('数据截止点(大于N0小于L的整数)N2j=');display('则第2类测试分类样本长度为')N2=N2j-N20+1test2=w1(N20:N2j,:);%3类测试分类数据display('请输入第3类测试分类样本在顺序选取时的');N30 = input('数据起始点(大于0小于L的整数)N30=');N3j = input('数据截止点(大于N0小于L的整数)N3j=');display('则第3类测试分类样本长度为')N3=N3j-N30+1test3=w1(N30:N3j,:);%选取的测试分类数据存入一个数组test test=[test1;test2;test3];然后分别两两分组,第1&2类、第2&3类、第1&3类,计算判别函数,判别分类正确率。

%计算协方差阵的行列式和逆cov1_det=det(cov1);cov2_det=det(cov2); cov3_det=det(cov3); cov1_inv=inv(cov1); cov2_inv=inv(cov2);cov3_inv=inv(cov3);%进行第1次实验,即第1&2分组实验display('对一二分组时第一、二类测试数据的先验概率(%)依次为');pw11=N1/(N1+N2)pw12=1-pw11rate11=0.0;rate12=0.0;fori = 1:(N1+N2)g11=(-0.5)*(test(i,:)-mean1)*cov1_inv*(test(i,: )'-mean1')-0.5*log(abs(cov1_det))+log(pw11);g12=(-0.5)*(test(i,:)-mean2)*cov2_inv*(test(i,: )'-mean2')-0.5*log(abs(cov2_det))+log(pw12);if g11>g12ifi<(N1+1)rate11=rate11+1;endelseifi>N1rate12=rate12+1;endendenddisplay('对一二分组时第一、二类测试数据的分类正确率(%)依次为为');rate11=rate11/N1*100rate12=rate12/N2*100%进行第2次实验,即第2&3分组实验display('对二三分组时第二、三类测试数据的先验概率(%)依次为');pw22=N2/(N2+N3)pw23=1-pw22rate22=0.0;rate23=0.0;fori = (N1+1):(N1+N2+N3)g22=(-0.5)*(test(i,:)-mean2)*cov2_inv*(test(i,: )'-mean2')-0.5*log(abs(cov2_det))+log(pw22);g23=(-0.5)*(test(i,:)-mean3)*cov3_inv*(test(i,:)'-mean3')-0.5*log(abs(cov3_det))+log(pw23);if g22>g23ifi<(N1+N2+1)rate22=rate22+1;endelseifi>(N1+N2)rate23=rate23+1;endendenddisplay('对二三分组时第二、三类测试数据的分类正确率(%)依次为');rate22=rate22/N2*100rate23=rate23/N3*100%进行第3次实验,即第1&3分组实验display('对一三分组时第一、三类测试数据的先验概率(%)依次为');pw31=N1/(N1+N3)pw33=1-pw31rate31=0.0;rate33=0.0;fori = [1:N1,N1+N2+1:N1+N2+N3]g31=(-0.5)*(test(i,:)-mean1)*cov1_inv*(test(i,: )'-mean1')-0.5*log(abs(cov1_det))+log(pw31);g33=(-0.5)*(test(i,:)-mean3)*cov3_inv*(test(i,: )'-mean3')-0.5*log(abs(cov3_det))+log(pw33);if g31>g33ifi<(N1+1)rate31=rate31+1;endelseifi>(N1+N2)rate33=rate33+1;endendenddisplay('对一三分组时第一、三类测试数据的分类正确率(%)依次为');rate31=rate31/N1*100 rate33=rate33/N3*100结果分析与结论结果分析一:试取测试数据组数为10、10、10,正常取值,来考查前述训练样本数对分类结果的影响。