粒子群优化算法及其参数设置

matlab 粒子群优化算法

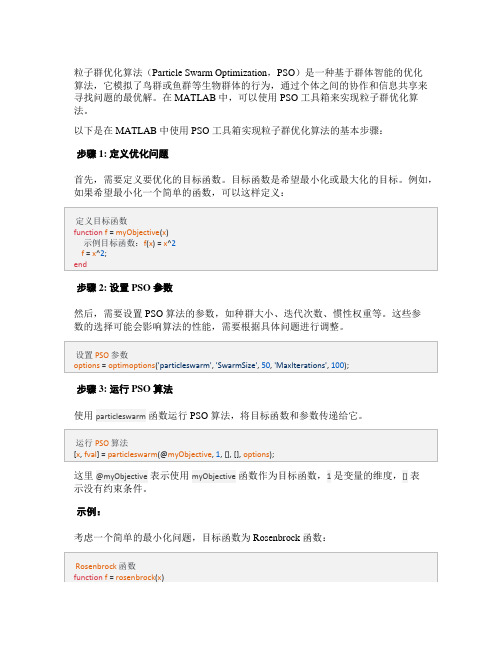

粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化

算法,它模拟了鸟群或鱼群等生物群体的行为,通过个体之间的协作和信息共享来寻找问题的最优解。

在 MATLAB 中,可以使用 PSO 工具箱来实现粒子群优化算法。

以下是在 MATLAB 中使用 PSO 工具箱实现粒子群优化算法的基本步骤:

步骤1: 定义优化问题

首先,需要定义要优化的目标函数。

目标函数是希望最小化或最大化的目标。

例如,如果希望最小化一个简单的函数,可以这样定义:

步骤2: 设置 PSO 参数

然后,需要设置 PSO 算法的参数,如种群大小、迭代次数、惯性权重等。

这些参

数的选择可能会影响算法的性能,需要根据具体问题进行调整。

步骤3: 运行 PSO 算法

使用particleswarm函数运行 PSO 算法,将目标函数和参数传递给它。

这里@myObjective表示使用myObjective函数作为目标函数,1是变量的维度,[]表

示没有约束条件。

示例:

考虑一个简单的最小化问题,目标函数为 Rosenbrock 函数:

设置 PSO 参数:

运行 PSO 算法:

在这个示例中,rosenbrock函数是一个二维的 Rosenbrock 函数,PSO 算法将寻找使得该函数最小化的变量值。

请注意,实际应用中,需要根据具体问题调整目标函数、约束条件和 PSO 参数。

MATLAB 的文档和示例代码提供了更多关于 PSO 工具箱的详细信息。

第6章粒子群优化算法

第6章粒子群优化算法PSO算法的基本原理是通过模拟粒子在空间中的移动,从而找到最优解。

每个粒子代表一个可能的解,并根据自身的经验和群体的经验进行。

粒子的速度和位置的更新使用以下公式:v(t+1) = w * v(t) + c1 * rand( * (pbest - x(t)) + c2 *rand( * (gbest - x(t))x(t+1)=x(t)+v(t+1)其中,v(t)代表粒子的当前速度,x(t)代表粒子的当前位置,w是惯性权重,c1和c2是学习因子,rand(是一个0到1之间的随机数,pbest 是粒子自身的最佳位置,gbest是整个群体的最佳位置。

PSO算法的过程如下:1.初始化粒子的位置和速度。

2.计算每个粒子的适应度值。

3. 更新每个粒子的pbest和gbest。

4.根据公式更新每个粒子的速度和位置。

5.重复步骤2到4,直到达到终止条件。

PSO算法有几个重要的参数需要设置:-群体大小:确定PSO算法中粒子的数量。

较大的群体大小可以增加整个空间的探索能力,但也增加了计算复杂度。

-惯性权重:控制粒子速度变化的因素。

较大的惯性权重可以增加粒子的飞行距离,但可能导致过程陷入局部最优解。

-学习因子:用于调节个体经验和群体经验的权重。

c1用于调节个体经验的权重,c2用于调节群体经验的权重。

较大的学习因子可以增加粒子的探索能力,但也可能增加时间。

PSO算法的优点是简单、易实现,收敛速度较快,对于多维、非线性、离散等问题具有良好的适应性。

然而,PSO算法也存在一些缺点,如易陷入局部最优解、对参数的敏感性等。

总之,粒子群优化算法是一种基于群体智能的优化算法,在求解复杂问题方面具有出色的性能。

它的基本原理是通过模拟粒子的移动来最优解,利用个体经验和群体经验进行自适应。

PSO算法在多个领域都有成功的应用,可以帮助解决实际问题。

matlab粒子群算法默认种群规模

【主题】matlab粒子裙算法默认种裙规模【内容】一、介绍matlab粒子裙算法matlab粒子裙算法(Particle Swarm Optimization,简称PSO)是一种启发式优化算法,源自于鸟裙觅食的行为。

PSO算法通过迭代搜索空间中的潜在解,寻找最优解。

其基本思想是模拟鸟裙觅食的行为,在搜索空间中不断调整潜在解的位置,直至找到最优解。

二、 PSO算法的种裙规模在matlab中,PSO算法的种裙规模即为裙体中粒子的数量,它决定了搜索空间的范围和算法的性能。

PSO算法的默认种裙规模为50。

种裙规模的设定直接影响算法的搜索速度和全局最优解的找寻能力。

三、种裙规模的设置原则1. 确定问题的复杂度:种裙规模应根据待解决问题的复杂度来设定。

对于复杂、高维度的问题,适当增加种裙规模有助于提高搜索效率。

2. 计算资源的限制:种裙规模的增加会带来更高的计算开销,因此在资源有限的情况下,需要平衡种裙规模和计算性能。

3. 经验设定:在实际应用中,也可根据经验和实验结果来调整种裙规模,找到最适合问题的设置。

四、调整种裙规模的方法1. 网格搜索法:通过在一定范围内以一定步长遍历种裙规模,评估不同规模下算法的性能和收敛速度,找到最佳的种裙规模。

2. 实验验证法:在实际问题中,通过对不同种裙规模下算法的性能进行实验验证,找到最适合问题的种裙规模。

3. 算法迭代法:根据算法的迭代次数和搜索效果来动态调整种裙规模,逐步优化算法的性能。

五、结语种裙规模是PSO算法中一个重要的参数,它直接关系到算法的搜索效率和性能。

在使用matlab的PSO算法时,合理设置种裙规模对于解决实际问题非常重要。

需要根据问题本身的特点、计算资源的限制以及实际应用情况来进行合理的选择和调整。

希望本文对于matlab粒子裙算法默认种裙规模的设置能够提供一些参考和帮助。

六、种裙规模与算法性能的关系种裙规模是PSO算法中最为关键的参数之一,其大小直接影响算法的搜索效率和全局最优解的寻找能力。

粒子群优化算法ppt

联合优化

粒子群优化算法可以用于联合优化神经网络的参数和结构,进一步提高神经网络的性能。

粒子群优化算法在神经网络训练中的应用

粒子群优化算法可以用于优化控制系统的控制器参数,以提高控制系统的性能和稳定性。

控制器参数优化

鲁棒性优化

联合优化

粒子群优化算法可以用于提高控制系统的鲁棒性,以应对系统中的不确定性和干扰。

粒子群优化算法可以用于联合优化控制系统的参数和结构,进一步提高控制系统的性能和稳定性。

03

粒子群优化算法在控制系统中的应用

02

01

06

总结与展望

粒子群优化算法是一种高效的全局优化算法,具有速度快、简单易行、易于并行化等优点。它利用群体智慧,通过粒子间的协作与信息共享,可以快速找到全局最优解。

优点

PSO算法的特点包括:简单易懂、易实现、能够处理高维问题、对初始值不敏感、能够处理非线性问题等。

定义与特点

粒子群优化算法的起源与发展

PSO算法的起源可以追溯到1995年,由 Kennedy 和 Eberhart博士提出,受到鸟群觅食行为的启发。

最初的PSO算法主要应用于函数优化问题,后来逐渐发展应用到神经网络训练、模式识别、图像处理、控制等领域。

边界条件的处理

通过对粒子速度进行限制,可以避免粒子在搜索空间中过度震荡,从而更好地逼近最优解。

粒子速度的限制

实例一

针对函数优化问题,通过对粒子速度和位置进行更新时加入随机扰动,可以增加粒子的探索能力,从而寻找到更好的最优解。

实例二

针对多峰函数优化问题,将粒子的个体最佳位置更新策略改为基于聚类的方法,可以使得粒子更好地逼近问题的全局最优解。

粒子的适应度函数用于评估其位置的好坏。

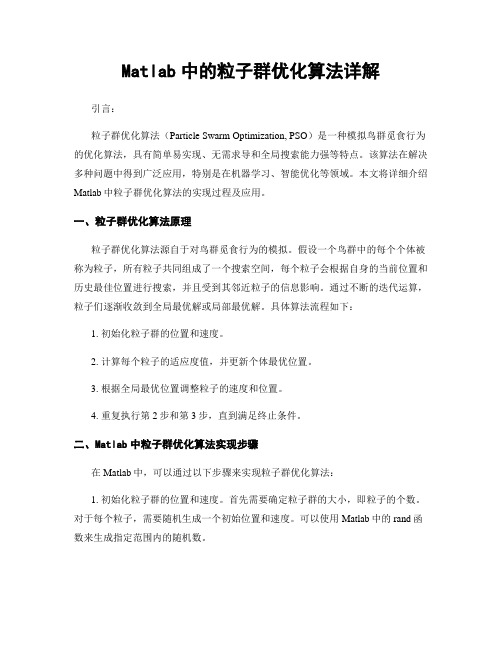

Matlab中的粒子群优化算法详解

Matlab中的粒子群优化算法详解引言:粒子群优化算法(Particle Swarm Optimization, PSO)是一种模拟鸟群觅食行为的优化算法,具有简单易实现、无需求导和全局搜索能力强等特点。

该算法在解决多种问题中得到广泛应用,特别是在机器学习、智能优化等领域。

本文将详细介绍Matlab中粒子群优化算法的实现过程及应用。

一、粒子群优化算法原理粒子群优化算法源自于对鸟群觅食行为的模拟。

假设一个鸟群中的每个个体被称为粒子,所有粒子共同组成了一个搜索空间,每个粒子会根据自身的当前位置和历史最佳位置进行搜索,并且受到其邻近粒子的信息影响。

通过不断的迭代运算,粒子们逐渐收敛到全局最优解或局部最优解。

具体算法流程如下:1. 初始化粒子群的位置和速度。

2. 计算每个粒子的适应度值,并更新个体最优位置。

3. 根据全局最优位置调整粒子的速度和位置。

4. 重复执行第2步和第3步,直到满足终止条件。

二、Matlab中粒子群优化算法实现步骤在Matlab中,可以通过以下步骤来实现粒子群优化算法:1. 初始化粒子群的位置和速度。

首先需要确定粒子群的大小,即粒子的个数。

对于每个粒子,需要随机生成一个初始位置和速度。

可以使用Matlab中的rand函数来生成指定范围内的随机数。

问题优劣的指标,因此需要根据具体问题来确定。

对于更新个体最优位置,可以通过比较当前适应度值和历史最佳适应度值的大小,选择适应度更优的位置进行更新。

3. 根据全局最优位置调整粒子的速度和位置。

粒子的速度和位置的更新是通过以下公式实现的:V(i,j) = w * V(i,j) + c1 * rand() * (P(i,j) - X(i,j)) + c2 * rand() * (G(j) - X(i,j))X(i,j) = X(i,j) + V(i,j)其中,V(i,j)表示第i个粒子在第j个维度上的速度,X(i,j)表示第i个粒子在第j个维度上的位置,P(i,j)表示第i个粒子的历史最佳位置,G(j)表示全局最佳位置,w、c1和c2分别表示惯性权重、个体学习因子和社会学习因子。

mopso算法参数

mopso算法参数MOPSO算法参数MOPSO(Multi-Objective Particle Swarm Optimization)算法是一种多目标粒子群优化算法,通过模拟鸟群觅食行为来解决多目标优化问题。

在使用MOPSO算法时,需要设置一些参数来指导算法的运行过程,以达到更好的优化效果。

1. 粒子数量(Particle Number):粒子数量是指算法中参与搜索的粒子个数。

粒子数量的选择应根据问题的复杂度和计算资源进行合理的设定。

粒子数量过少可能导致搜索空间未被充分探索,粒子数量过多则可能增加计算负担。

2. 迭代次数(Iteration Number):迭代次数是指算法运行的代数。

迭代次数越多,算法搜索的空间范围越大,但也会增加计算时间。

迭代次数的选择应综合考虑问题的复杂度和计算资源。

3. 粒子速度(Particle Velocity):粒子速度决定了粒子在搜索空间中的移动步长和方向。

通过调整粒子速度的范围和变化规律,可以控制搜索过程的探索和局部优化能力。

4. 惯性权重(Inertia Weight):惯性权重用于调节粒子速度的更新,影响粒子的全局搜索和局部搜索能力。

惯性权重越大,粒子在搜索空间中的移动越迅速,全局搜索能力增强;惯性权重越小,粒子在局部区域的搜索能力增强。

5. 个体学习因子(Cognitive Learning Factor)和社会学习因子(Social Learning Factor):个体学习因子和社会学习因子用于计算粒子的速度更新值。

个体学习因子决定了粒子根据自身经验调整速度的程度,而社会学习因子决定了粒子根据邻域中优秀粒子的经验调整速度的程度。

6. 邻域大小(Neighborhood Size):邻域大小定义了每个粒子周围的邻域,用于计算粒子的社会学习因子。

较大的邻域大小能够增加粒子之间的信息交流,促进全局搜索;较小的邻域大小则更侧重于局部搜索。

7. 外部存档容量(Archive Size):外部存档容量用于存储搜索过程中的非支配解集合。

粒子群优化算法python

粒子群优化算法python粒子群优化算法(Particle Swarm Optimization,简称PSO)是一种基于群体智能的优化算法,它模拟了鸟群觅食行为,通过不断更新粒子的位置和速度,来寻找最优解。

在本文中,我们将介绍粒子群优化算法的原理及其在Python中的实现。

一、粒子群优化算法原理粒子群优化算法的核心思想是通过模拟鸟群觅食行为来进行优化。

算法中的每个粒子都代表了搜索空间中的一个解,而粒子的位置和速度则代表了解的状态和搜索方向。

在算法开始时,每个粒子都会被随机初始化,并赋予一个随机的速度。

接着,粒子会根据自身当前位置和速度,以及全局最优解和个体最优解的信息,来更新自己的速度和位置。

粒子群优化算法中的速度更新公式如下所示:v(t+1) = w * v(t) + c1 * r1 * (pbest - x(t)) + c2 * r2 * (gbest - x(t))其中,v(t+1)表示粒子在下一时刻的速度,w是惯性权重,c1和c2分别是加速因子,r1和r2是[0,1]之间的随机数,pbest表示粒子的个体最优解,gbest表示全局最优解,x(t)表示粒子的当前位置。

粒子的位置更新公式如下所示:x(t+1) = x(t) + v(t+1)其中,x(t+1)表示粒子在下一时刻的位置,x(t)表示粒子的当前位置,v(t+1)表示粒子在下一时刻的速度。

通过不断迭代更新粒子的位置和速度,粒子群优化算法能够逐渐收敛到全局最优解。

二、粒子群优化算法的Python实现在Python中,我们可以使用numpy库来进行粒子群优化算法的实现。

下面是一个简单的示例代码:```pythonimport numpy as npdef objective_function(x):# 定义目标函数,这里以Rosenbrock函数为例return (1 - x[0])**2 + 100 * (x[1] - x[0]**2)**2def PSO(objective_function, num_particles, num_dimensions, max_iter):# 初始化粒子群particles = np.random.uniform(low=-5, high=5, size=(num_particles, num_dimensions))velocities = np.zeros((num_particles, num_dimensions))pbest = particles.copy()gbest = particles[np.argmin([objective_function(p) for p in particles])]# 设置参数w = 0.5c1 = 1c2 = 1# 迭代更新粒子位置和速度for _ in range(max_iter):for i in range(num_particles):r1 = np.random.uniform()r2 = np.random.uniform()velocities[i] = w * velocities[i] + c1 * r1 * (pbest[i] - particles[i]) + c2 * r2 * (gbest - particles[i])particles[i] = particles[i] + velocities[i]if objective_function(particles[i]) < objective_function(pbest[i]):pbest[i] = particles[i]if objective_function(pbest[i]) < objective_function(gbest):gbest = pbest[i]return gbest# 使用粒子群优化算法求解目标函数的最小值gbest = PSO(objective_function, num_particles=30, num_dimensions=2, max_iter=100)print("最优解:", gbest)print("最优解对应的目标函数值:", objective_function(gbest))```在上述代码中,我们首先定义了一个目标函数`objective_function`,这里以Rosenbrock函数为例。

粒子群优化算法课件

实验结果对比分析

准确率

01

在多个数据集上,粒子群优化算法的准确率均高于对比算法,

表明其具有较强的全局搜索能力。

收敛速度

02

粒子群优化算法在多数数据集上的收敛速度较快,能够更快地

找到最优解。

鲁棒性

03

在不同参数设置和噪声干扰下,粒子群优化算法的性能表现稳

定,显示出良好的鲁棒性。

结果讨论与改进建议

讨论

其中,V(t+1)表示第t+1次迭代 时粒子的速度,V(t)表示第t次迭 代时粒子的速度,Pbest表示粒 子自身的最优解,Gbest表示全 局最优解,X(t)表示第t次迭代时

粒子的位置,w、c1、c2、 rand()为参数。

算法优缺点分析

优点

简单易实现、参数少、收敛速度快、 能够处理多峰问题等。

03

强化算法的可视化和解释性

发展可视化工具和解释性方法,帮助用户更好地理解粒子群优化算法的

工作原理和结果。

THANKS

感谢观看

粒子群优化算法的改进与扩展

动态调整惯性权重

惯性权重是粒子群优化算法中的一个 重要参数,它决定了粒子的飞行速度 。通过动态调整惯性权重,可以在不 同的搜索阶段采用不同的权重值,从 而更好地平衡全局搜索和局部搜索。

VS

一种常见的动态调整惯性权重的方法 是根据算法的迭代次数或适应度值的 变化来调整权重值。例如,在算法的 初期,为了更好地进行全局搜索,可 以将惯性权重设置得较大;而在算法 的后期,为了更好地进行局部搜索, 可以将惯性权重设置得较小。

并行粒子群优化算法

并行计算技术可以提高粒子群优化算法的计算效率和收敛 速度。通过将粒子群分成多个子群,并在不同的处理器上 同时运行这些子群,可以加快算法的收敛速度。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

附录程序1当22111==c c ,5.12212==c c ,2.1=w 。

a)%主函数源程序(main.m )%------基本粒子群算法 (particle swarm optimization ) %------名称: 基本粒子群算法%------初始格式化clear all ; %清除所有变量clc; %清屏format long ; %将数据显示为长整形科学计数 %------给定初始条条件------------------N=40; %³初始化群体个数D=10; %初始化群体维数T=100; %初始化群体最迭代次数 c11=2; %学习因子1c21=2; %学习因子2c12=1.5;c22=1.5;w=1.2; %惯性权重eps=10^(-6); %设置精度(在已知最小值的时候用) %------初始化种群个体(限定位置和速度)------------ x=zeros(N,D);v=zeros(N,D); for i=1:Nfor j=1:Dx(i,j)=randn; %随机初始化位置v(i,j)=randn; %随机初始化速度endend%------显示群位置----------------------figure(1)for j=1:Dif(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始位置')tInfo=strcat('第',char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维');endtitle(tInfo)end%------显示种群速度figure(2)for j=1:Dif(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始速度')tInfo=strcat('第,char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维);endtitle(tInfo)endfigure(3)%第一个图subplot(1,2,1)%------初始化种群个体(在此限定速度和位置)------------x1=x;v1=v;%------初始化个体最优位置和最优值---p1=x1;pbest1=ones(N,1);for i=1:Npbest1(i)=fitness(x1(i,:),D);end%------初始化全局最优位置和最优值---------------g1=1000*ones(1,D);gbest1=1000;for i=1:Nif(pbest1(i)<gbest1)g1=p1(i,:);gbest1=pbest1(i);endendgb1=ones(1,T);%-----浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x1(j,:),D)<pbest1(j))p1(j,:)=x1(j,:);pbest1(j)=fitness(x1(j,:),D);endif(pbest1(j)<gbest1)g1=p1(j,:);gbest1=pbest1(j);endv1(j,:)=w*v1(j,:)+c11*rand*(p1(j,:)-x1(j,:))+c21*rand*(g1-x1(j,:));x1(j,:)=x1(j,:)+v1(j,:);endgb1(i)=gbest1;endplot(gb1)TempStr=sprintf('c1= %g ,c2=%g',c11,c21);title(TempStr);xlabel('迭代次数');ylabel('适应度值');%第二个图subplot(1,2,2)%-----初始化种群个体(在此限定速度和位置)------------x2=x;v2=v;%-----初始化种群个体最有位置和最优解-----------p2=x2;pbest2=ones(N,1);for i=1:Npbest2(i)=fitness(x2(i,:),D);end%-----初始化种全局最有位置和最优解------g2=1000*ones(1,D);gbest2=1000;for i=1:Nif(pbest2(i)<gbest2)g2=p2(i,:);gbest2=pbest2(i);endendgb2=ones(1,T);%------浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x2(j,:),D)<pbest2(j))p2(j,:)=x2(j,:);pbest2(j)=fitness(x2(j,:),D);endif (pbest2(j)<gbest2)g2=p2(j,:);gbest2=pbest2(j);endv2(j,:)=w*v2(j,:)+c12*rand*(p2(j,:)-x2(j,:))+c22*rand*(g2-x2(j,:)); x2(j,:)=x2(j,:)+v2(j,:);endgb2(i)=gbest2;endplot(gb2)TempStr=sprintf('c1= %g ,c2=%g',c12,c22);title(TempStr);xlabel('迭代次数');ylabel('适应度值');b )适应度函数%适应度函数(fitness.m )function result=fitness(x,D)sum=0;for i=1:Dsum=sum+x(i)^2;endresult=sum;程序2当22111==c c 于2.1,2,02212===w c c 对比a)%主函数源程序(main.m )%------基本粒子群算法 (particle swarm optimization )%------名称: 基本粒子群算法%------初始格式化clear all ; %清除所有变量clc; %清屏format long ; %将数据显示为长整形科学计数%------给定初始条条件------------------N=40; %³初始化群体个数D=10; %初始化群体维数T=100; %初始化群体最迭代次数c11=2; %学习因子1c21=2; %学习因子2c12=0;c22=2;w=1.2; %惯性权重eps=10^(-6); %设置精度(在已知最小值的时候用)%------初始化种群个体(限定位置和速度)------------x=zeros(N,D);v=zeros(N,D);for i=1:Nfor j=1:Dx(i,j)=randn; %随机初始化位置v(i,j)=randn; %随机初始化速度endend%------显示群位置----------------------figure(1)for j=1:Dif(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始位置')tInfo=strcat('第',char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维');endtitle(tInfo)end%------显示种群速度figure(2)for j=1:Dif(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始速度')tInfo=strcat('第,char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维);endtitle(tInfo)endfigure(3)%第一个图subplot(1,2,1)%------初始化种群个体(在此限定速度和位置)------------x1=x;v1=v;%------初始化个体最优位置和最优值---p1=x1;pbest1=ones(N,1);for i=1:Npbest1(i)=fitness(x1(i,:),D);end%------初始化全局最优位置和最优值---------------g1=1000*ones(1,D);gbest1=1000;for i=1:Nif(pbest1(i)<gbest1)g1=p1(i,:);gbest1=pbest1(i);endendgb1=ones(1,T);%-----浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x1(j,:),D)<pbest1(j))p1(j,:)=x1(j,:);pbest1(j)=fitness(x1(j,:),D);endif(pbest1(j)<gbest1)g1=p1(j,:);gbest1=pbest1(j);endv1(j,:)=w*v1(j,:)+c11*rand*(p1(j,:)-x1(j,:))+c21*rand*(g1-x1(j,:));x1(j,:)=x1(j,:)+v1(j,:);endgb1(i)=gbest1;endplot(gb1)TempStr=sprintf('c1= %g ,c2=%g',c11,c21);title(TempStr);xlabel('迭代次数');ylabel('适应度值');%第二个图subplot(1,2,2)%-----初始化种群个体(在此限定速度和位置)------------x2=x;v2=v;%-----初始化种群个体最有位置和最优解-----------p2=x2;pbest2=ones(N,1);for i=1:Npbest2(i)=fitness(x2(i,:),D);end%-----初始化种全局最有位置和最优解------g2=1000*ones(1,D);gbest2=1000;for i=1:Nif(pbest2(i)<gbest2)g2=p2(i,:);gbest2=pbest2(i);endendgb2=ones(1,T);%------浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x2(j,:),D)<pbest2(j))p2(j,:)=x2(j,:);pbest2(j)=fitness(x2(j,:),D);endif(pbest2(j)<gbest2)g2=p2(j,:);gbest2=pbest2(j);endv2(j,:)=w*v2(j,:)+c12*rand*(p2(j,:)-x2(j,:))+c22*rand*(g2-x2(j,:));x2(j,:)=x2(j,:)+v2(j,:);endgb2(i)=gbest2;endplot(gb2)TempStr=sprintf('c1= %g ,c2=%g',c12,c22);title(TempStr);xlabel('迭代次数');ylabel('适应度值');b)适应度函数%适应度函数(fitness.m)function result=fitness(x,D)sum=0;for i=1:Dsum=sum+x(i)^2;endresult=sum;程序3当2.1,22111===w c c 于2.1,0,22212===w c c 对比a)%主函数源程序(main.m )%------基本粒子群算法 (particle swarm optimization ) %------名称: 基本粒子群算法%------初始格式化clear all ; %清除所有变量clc; %清屏format long ; %将数据显示为长整形科学计数 %------给定初始条条件------------------N=40; %³初始化群体个数D=10; %初始化群体维数T=100; %初始化群体最迭代次数c11=2; %学习因子1c21=2; %学习因子2c12=2;c22=0;w=1.2; %惯性权重eps=10^(-6); %设置精度(在已知最小值的时候用) %------初始化种群个体(限定位置和速度)------------x=zeros(N,D);v=zeros(N,D);for i=1:Nfor j=1:Dx(i,j)=randn; %随机初始化位置v(i,j)=randn; %随机初始化速度endend%------显示群位置----------------------figure(1)if(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始位置')tInfo=strcat('第',char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维');endtitle(tInfo)end%------显示种群速度figure(2)for j=1:Dif(rem(D,2)>0)subplot((D+1)/2,2,j)elsesubplot(D/2,2,j)endplot(x(:,j),'b*');grid onxlabel('粒子')ylabel('初始速度')tInfo=strcat('第,char(j+48),'维');if(j>9)tInfo=strcat('第',char(floor(j/10)+48), char(rem(j,10)+48),'维);endtitle(tInfo)endfigure(3)subplot(1,2,1)%------初始化种群个体(在此限定速度和位置)------------x1=x;v1=v;%------初始化个体最优位置和最优值---p1=x1;pbest1=ones(N,1);for i=1:Npbest1(i)=fitness(x1(i,:),D);end%------初始化全局最优位置和最优值---------------g1=1000*ones(1,D);gbest1=1000;for i=1:Nif(pbest1(i)<gbest1)g1=p1(i,:);gbest1=pbest1(i);endendgb1=ones(1,T);%-----浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x1(j,:),D)<pbest1(j))p1(j,:)=x1(j,:);pbest1(j)=fitness(x1(j,:),D);endif(pbest1(j)<gbest1)g1=p1(j,:);gbest1=pbest1(j);endv1(j,:)=w*v1(j,:)+c11*rand*(p1(j,:)-x1(j,:))+c21*rand*(g1-x1(j,:));x1(j,:)=x1(j,:)+v1(j,:);endgb1(i)=gbest1;endplot(gb1)TempStr=sprintf('c1= %g ,c2=%g',c11,c21);title(TempStr);xlabel('迭代次数');ylabel('适应度值');%第二个图subplot(1,2,2)%-----初始化种群个体(在此限定速度和位置)------------x2=x;v2=v;%-----初始化种群个体最有位置和最优解-----------p2=x2;pbest2=ones(N,1);for i=1:Npbest2(i)=fitness(x2(i,:),D);end%-----初始化种全局最有位置和最优解------g2=1000*ones(1,D);gbest2=1000;for i=1:Nif(pbest2(i)<gbest2)g2=p2(i,:);gbest2=pbest2(i);endendgb2=ones(1,T);%------浸入主循环,按照公式依次迭代直到满足精度或者迭代次数---for i=1:Tfor j=1:Nif (fitness(x2(j,:),D)<pbest2(j))p2(j,:)=x2(j,:);pbest2(j)=fitness(x2(j,:),D);endif (pbest2(j)<gbest2)g2=p2(j,:);gbest2=pbest2(j);endv2(j,:)=w*v2(j,:)+c12*rand*(p2(j,:)-x2(j,:))+c22*rand*(g2-x2(j,:)); x2(j,:)=x2(j,:)+v2(j,:);endgb2(i)=gbest2;endplot(gb2)TempStr=sprintf('c1= %g ,c2=%g',c12,c22);title(TempStr);xlabel('迭代次数');ylabel('适应度值');b )适应度函数%适应度函数(fitness.m )function result=fitness(x,D)sum=0;for i=1:Dsum=sum+x(i)^2;endresult=sum;程序4对21c c ≠,21w w ≠分别对其取值1.11=c ,22=c ,2.11=w ,5.12=w 测试函数。