常用概率分布函数

常见的几种分布函数

常见的几种分布函数概率论中,分布函数(distribution function)是描述随机变量取值的概率分布的函数。

常见的几种分布函数包括离散型分布函数、连续型分布函数以及混合分布函数。

1. 离散型分布函数离散型分布函数是指随机变量在有限或可数个点上取值的分布函数。

离散型分布函数的特点是其概率质量函数只在有限或可数个点上取值,或者说离散型分布函数所描述的随机变量的取值是离散的。

比较常见的离散型分布函数有:- 二项分布函数:二项分布函数是描述n个独立的、相同概率的随机试验中成功的次数的分布函数。

- 泊松分布函数:泊松分布函数是描述一定时间间隔内一个随机事件发生次数的分布函数。

- 几何分布函数:几何分布函数是描述进行一系列独立的、相同概率的实验,成功的次数需要进行多次才能得到的情况的分布函数。

2. 连续型分布函数连续型分布函数是指随机变量的取值范围为连续区间的分布函数。

连续型分布函数所描述的随机变量的取值是连续的。

比较常见的连续型分布函数有:- 正态分布函数:正态分布函数又称高斯分布函数,是一种描述随机变量分布最为常用的分布函数之一。

- 均匀分布函数:均匀分布函数是描述随机变量在一定区间内取值时等概率分布的分布函数。

- 指数分布函数:指数分布函数是描述随机变量取值时间间隔的分布函数。

3. 混合分布函数混合分布函数是指一个随机变量可以同时满足两种或两种以上的分布函数时的情况。

比较常见的混合分布函数有:- 混合正态分布函数:混合正态分布函数是指由多个正态分布函数混合而成的分布函数。

- 混合伯努利分布函数:混合伯努利分布函数是指由多个伯努利分布函数混合而成的分布函数。

总之,分布函数是描述随机变量的 one-stop-shop,而离散型、连续型和混合型都是这一目的下的不同实现方式。

不同的分布函数有不同的特点和应用场景,选择合适的分布函数是进行概率论研究和应用的前提。

16种常见概率分布概率密度函数、意义及其应用

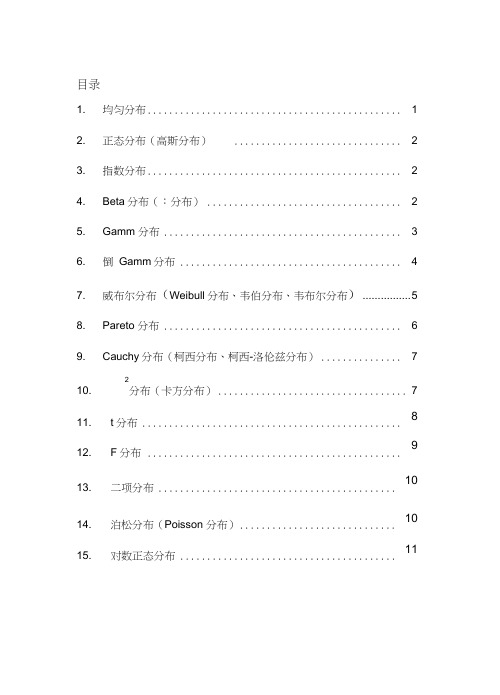

目录1. 均匀分布 (1)2. 正态分布(高斯分布) (2)3. 指数分布 (2)4. Beta分布(:分布) (2)5. Gamm 分布 (3)6. 倒Gamm分布 (4)7. 威布尔分布(Weibull分布、韦伯分布、韦布尔分布) (5)8. Pareto 分布 (6)9. Cauchy分布(柯西分布、柯西-洛伦兹分布) (7)210. 分布(卡方分布) (7)8 11. t分布................................................9 12. F分布 ...............................................10 13. 二项分布............................................10 14. 泊松分布(Poisson 分布).............................11 15. 对数正态分布........................................1. 均匀分布均匀分布X ~U(a,b)是无信息的,可作为无信息变量的先验分布。

2. 正态分布(高斯分布)当影响一个变量的因素众多,且影响微弱、都不占据主导地位时,这个变量 很可能服从正态分布,记作X~N (」f 2)。

正态分布为方差已知的正态分布N (*2)的参数」的共轭先验分布。

1 空f (x ): —— e 2-J2 兀 o'E(X), Var(X) _ c 23. 指数分布指数分布X ~Exp ( )是指要等到一个随机事件发生,需要经历多久时间。

其 中,.0为尺度参数。

指数分布的无记忆性:Plx s t|X = P{X t}。

f (X )二 y oiE(X) 一4. Beta 分布(一:分布)f (X )二 E(X)Var(X)=(b-a)2 12Var(X)二1~2Beta 分布记为X 〜Be(a,b),其中Beta(1,1)等于均匀分布,其概率密度函数 可凸也可凹。

常用的分布函数公式

常用的分布函数公式

常用的分布函数公式分布函数是概率论和统计学中重要的概念,用于描述随机变量的概率分布。

在实际应用中,我们经常需要使用一些常用的分布函数公式来计算概率或进行统计推断。

以下是一些常见的分布函数公式:1. 正态分布函数:正态分布是自然界中许多现象的模型,其分布函数可以用以下公式表示:

F(x) = 1/2 [1 + erf((x-μ)/(σ√2))] 其中,μ是正态分布的均值,σ是标准差,erf是误差函数。

2. 二项分布函数:二项分布是一种离散概率分布,用于描述在n次独立重复试验中成功次数的概率。

其分布函数可以用以下公式表示:

F(x) = Σ(i=0 to x) [C(n, i) * p^i * (1-p)^(n-i)] 其中,C(n, i)是组合数,p是每次试验成功的概率。

3. 泊松分布函数:泊松分布是一种离散概率分布,用于描述单位时间或空间内随机事件发生的次数。

其分布函数可以用以下公式表示:

F(x) = Σ(i=0 to x) [e^(-λ) * λ^i / i!] 其中,λ是单位时间或空间内随机事件的平均发生率。

4. t分布函数:t分布是用于小样本情况下进行统计推断的概率分布。

其分布函数可以用以

下公式表示:

F(x) = 1/2 + 1/2 * I(x/√(n-1), (n-1)/2, 1/2) 其中,n是样本容量,I是不完全贝塞尔函数。

以上是一些常用的分布函数公式,它们在概率论和统计学中具有广泛的应用。

通过了解和掌握这些公式,我们可以更好地理解和分析随机变量的概率分布,从而进行相应的统计推断和决策。

理解概率分布函数常见分布公式详解

理解概率分布函数常见分布公式详解概率分布函数(Probability Distribution Function,简称PDF)是描述随机变量取值概率分布的函数,常用于统计学和概率论中。

在统计学中,常见的概率分布函数有众多的公式。

本文将详细解释几种常见的概率分布函数公式,包括均匀分布、正态分布、指数分布和泊松分布。

一、均匀分布均匀分布是最简单的概率分布函数之一,它在一个有限区间内的取值是均匀分布的。

均匀分布的概率密度函数公式为:f(x) = 1 / (b - a),a ≤ x ≤ b其中,a和b分别是区间的上下界。

均匀分布的期望值(均值)为(a + b)/ 2,方差为(b - a)^2 / 12。

二、正态分布正态分布是自然界和社会现象中常见的概率分布函数。

它在统计学中有着重要的地位。

正态分布的概率密度函数(Probability Density Function,简称PDF)公式为:f(x) = (1 / (σ * √(2π))) * exp(-((x - μ)^2/(2σ^2)))其中,μ是期望值(均值),σ是标准差。

正态分布的期望值和方差分别为μ和σ^2。

三、指数分布指数分布是描述事件发生的时间间隔的概率分布函数,常用于可靠性工程和排队论中。

指数分布的概率密度函数公式为:f(x) = λ * exp(-λx),x ≥ 0其中,λ是事件发生率。

指数分布的期望值为1 / λ,方差为1 / λ^2。

四、泊松分布泊松分布是描述单位时间或空间内事件发生次数的概率分布函数,常用于描述稀有事件的发生情况。

泊松分布的概率质量函数(Probability Mass Function,简称PMF)公式为:P(X = k) = (λ^k * exp(-λ)) / k!其中,λ是单位时间或空间内事件的平均发生率。

泊松分布的期望值和方差均为λ。

以上是几种常见的概率分布函数公式的详细解释。

这些概率分布函数在不同领域的应用非常广泛,能够描述和解释各种随机现象的概率分布情况。

16种常见概率分布概率密度函数意义及其应用

16种常见概率分布概率密度函数意义及其应用概率分布是统计学中一个重要的概念,用于描述随机变量在各个取值上的概率分布情况。

常见的概率分布有16种,它们分别是均匀分布、伯努利分布、二项分布、几何分布、泊松分布、正态分布、指数分布、负二项分布、超几何分布、Gumbel分布、Weibull分布、伽马分布、Beta分布、对数正态分布、卡方分布和三角分布。

以下将逐一介绍这些概率分布的概率密度函数、意义及其应用。

1. 均匀分布(Uniform Distribution):概率密度函数为f(x)=1/(b-a),意义是在一个区间内所有的取值具有相同的概率,应用有随机数生成、模拟实验等。

2. 伯努利分布(Bernoulli Distribution):概率密度函数为P(x)=p^x*(1-p)^(1-x),意义是在两种可能结果中,成功或失败的概率分布,应用有二分类问题的建模。

3. 二项分布(Binomial Distribution):概率密度函数为P(x)=C(n,x)*p^x*(1-p)^(n-x),意义是在n次独立重复试验中,成功次数为x的概率分布,应用有二分类问题中的n次重复试验。

4. 几何分布(Geometric Distribution):概率密度函数为P(x)=p*(1-p)^(x-1),意义是独立重复试验中,第x次成功所需的试验次数的概率分布,应用有描述一连串同样试验中第一次获得成功之前所需的试验次数。

5. 泊松分布(Poisson Distribution):概率密度函数为P(x)=(e^(-λ)*λ^x)/x!,意义是在给定时间或空间内事件发生的次数的概率分布,应用有描述单位时间或单位空间内的事件计数问题。

6. 正态分布(Normal Distribution):概率密度函数为P(x) = (1 / sqrt(2πσ^2)) * e^(-(x-μ)^2 / (2σ^2)),意义是描述连续变量的概率分布,应用广泛,例如测量误差、人口身高等。

常用概率分布-医学统计学

标准正态分布的µ=0,σ=1,则 µ±σ相当于区间(-1,1), µ±1.96σ相当于区间(-1.96,1.96), µ±2.58σ的区间相当于区间(-2.58,2.58)。

区间(-1,1)的面积:1-2Φ(-1)=1-2×0.1587=0.6826=68.26% 区间(-1.96,1.96)的面积:1-2Φ(-1.96)=1-2×0.0250=0.9500=95% 区间(-2.58,2.58)的面积:1-2Φ(-2.58)=1-2×0.0049=0.9902=99.02%

在单位空间中某种昆虫或野生动物数的分布,粉尘在

观察容积内的分布,放射性物质在单位时间内放射出

质点数的分布等。Poisson分布一般记作

。

Poisson分布作为二项分布的一种极限情况

Poisson分布可以看作是发生的概率π 很小,而观

察例数很大时的二项分布。除要符合二项分布的三个

基本条件外,Poisson分布还要求π或1-π接近于0和1。 有些情况π和n都难以确定,只能以观察单位(时间、

例 3 某年某市调查了 200例正常成人血铅含量 (μg/100g)如下,试估计该市成人血铅含量的95%医 学参考值范围。

分析:血铅的分布为偏态分布,且血铅含量只以 过高为异常,要用百分位数法制定单侧上限。

二、质量控制 为了控制实验中的检测误差,常用 ±2S作上

下但的警影随响机戒某因线一素,指很以标多, ±3S作为上下控制线。这里的2S和 3如S可果该视指为标1的.96随S 和2.58S的约数。其依据是正常情况下 检机误测波差动,误属则差于往是随往服机符从正态分布的。

概率 密度

正态分布的密度函数,即正态曲线的方程为 -∞<X<+∞

均数为0,标准差为1的正态分布,这种正态分布 称为标准正态分布。

概率论分布函数

概率论分布函数概率论分布函数是概率论中的重要概念,它描述了一个随机变量取值的概率分布情况。

在统计学和概率论中,有许多常见的概率分布函数,如正态分布、均匀分布、泊松分布等。

本文将针对这些常见的概率分布函数进行介绍和解释。

一、正态分布(Normal Distribution)正态分布是自然界中最常见的分布之一。

它以钟形曲线形式展现,其分布函数描述了随机变量在不同取值上的概率密度。

正态分布的特点是对称且呈现出标准差的影响,标准差越大,曲线越平缓。

正态分布广泛应用于自然科学、社会科学等领域,用于描述各种现象的分布情况。

二、均匀分布(Uniform Distribution)均匀分布是最简单的概率分布之一,它描述了随机变量在一定范围内各个取值出现的概率是相等的。

均匀分布的分布函数是一个常数函数,其特点是在一定范围内的取值概率是相等的。

均匀分布常用于模拟随机事件或生成随机数,广泛应用于数值计算和概率统计等领域。

三、泊松分布(Poisson Distribution)泊松分布是用于描述单位时间(或空间)内随机事件发生次数的概率分布。

泊松分布的分布函数可以表示在一段时间或空间内发生某种事件的次数的概率。

泊松分布的特点是具有独立性和稀有性,适用于描述稀有事件的发生情况,如电话交换机接听电话的次数、汽车在某路段通过的次数等。

四、指数分布(Exponential Distribution)指数分布是一种连续概率分布函数,描述了随机事件发生的时间间隔的概率分布。

指数分布的分布函数具有单峰性,随着时间的推移,事件发生的概率逐渐减小。

指数分布常用于描述随机事件的间隔时间,如人们等待公交车的时间、网络传输数据包到达的时间等。

五、二项分布(Binomial Distribution)二项分布是描述在一次试验中成功次数的概率分布函数。

二项分布的分布函数描述了在一定次数的独立重复试验中成功次数的概率分布情况。

二项分布的特点是具有两个参数,成功概率和试验次数,常用于描述二元随机事件的发生情况,如硬币正反面的次数、投篮命中的次数等。

概率分布函数各种类型

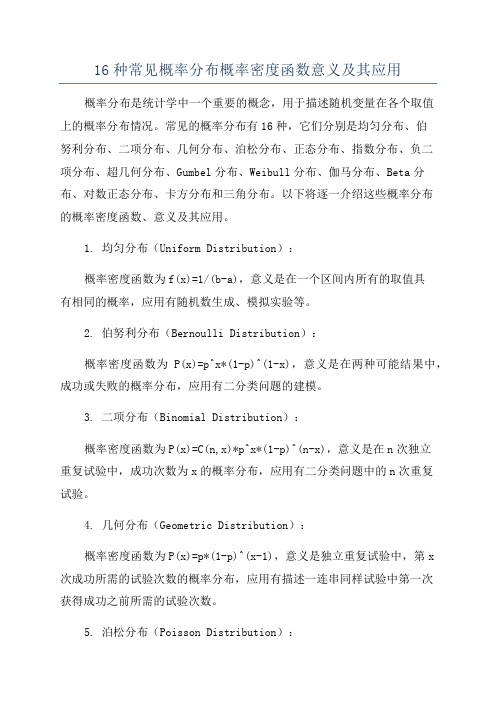

Diagram of distribution relationships Probability distributions have a surprising number inter-connections. A dashed line in the chart below indicates an approximate (limit) relationship between two distribution families. A solid line indicates an exact relationship: special case, sum, or transformation.Click on a distribution for the parameterization of that distribution. Click on an arrow for details on the relationship represented by the arrow. Other diagrams on this site:The chart above is adapted from the chart originally published by Lawrence Leemis in 1986 (Relationships Among Common Univariate Distributions, American Statistician 40:143-146.) Leemis published a larger chart in 2008 which is available online.The precise relationships between distributions depend on parameterization. The relationships detailed below depend on the following parameterizations for the PDFs.Let C(n, k) denote the binomial coefficient(n, k) and B(a, b) = Γ(a) Γ(b) / Γ(a + b).Geometric: f(x) = p (1-p)x for non-negative integers x.Discrete uniform: f(x) = 1/n for x = 1, 2, ..., n.Negative binomial: f(x) = C(r + x - 1, x) p r(1-p)x for non-negative integers x. See notes on the negative binomial distribution.Beta binomial: f(x) = C(n, x) B(α + x, n + β - x) / B(α, β) for x = 0, 1, ..., n. Hypergeometric: f(x) = C(M, x) C(N-M, K - x) / C(N, K) for x = 0, 1, ..., N. Poisson: f(x) = exp(-λ) λx/ x! for non-negative integers x. The parameter λ is both the mean and the variance.Binomial: f(x) = C(n, x) p x(1 - p)n-x for x = 0, 1, ..., n.Bernoulli: f(x) = p x(1 - p)1-x where x = 0 or 1.Lognormal: f(x) = (2πσ2)-1/2 exp( -(log(x) - μ)2/ 2σ2) / x for positive x. Note that μ and σ2are not the mean and variance of the distribution.Normal : f(x) = (2π σ2)-1/2 exp( - ½((x - μ)/σ)2 ) for all x.Beta: f(x) = Γ(α + β) xα-1(1 - x)β-1/ (Γ(α) Γ(β)) for 0 ≤ x ≤ 1.Standard normal: f(x) = (2π)-1/2 exp( -x2/2) for all x.Chi-squared: f(x) = x-ν/2-1 exp(-x/2) / Γ(ν/2) 2ν/2for positive x. The parameter ν is called the degrees of freedom.Gamma: f(x) = β-α xα-1 exp(-x/β) / Γ(α) for positive x. The parameter α is called the shape and β is the scal e.Uniform: f(x) = 1 for 0 ≤ x ≤ 1.Cauchy: f(x) = σ/(π( (x - μ)2+ σ2) ) for all x. Note that μ and σ are location and scale parameters. The Cauchy distribution has no mean or variance. Snedecor F: f(x) is proportional to x(ν1 - 2)/2/ (1 + (ν1/ν2) x)(ν1 + ν2)/2 for positive x. Exponential: f(x) = exp(-x/μ)/μ for positive x. The parameter μ is the mean.Student t: f(x) is proportional to (1 + (x2/ν))-(ν + 1)/2 for positive x. The parameter ν is called the degrees of freedom.Weibull: f(x) = (γ/β) xγ-1 exp(- xγ/β) for positive x. The parameter γ is the shape and β is the scale.Double exponential : f(x) = exp(-|x-μ|/σ) / 2σ for all x. The parameter μ is the location and mean; σ is the scale.For comparison, see distribution parameterizations in R/S-PLUS and Mathematica.In all statements about two random variables, the random variables are implicitly independent.Geometric / negative binomial: If each X i is geometric random variable with probability of success p then the sum of n X i's is a negative binomial random variable with parameters n and p.Negative binomial / geometric: A negative binomial distribution with r = 1 is a geometric distribution.Negative binomial / Poisson: If X has a negative binomial random variable with r large, p near 1, and r(1-p) = λ, then F X≈ F Y where Y is a Poisson random variable with mean λ.Beta-binomial / discrete uniform: A beta-binomial (n, 1, 1) random variable is a discrete uniform random variable over the values 0 ... n.Beta-binomial / binomial: Let X be a beta-binomial random variable with parameters (n, α, β). Let p = α/(α + β) and suppose α + β is large. If Y is a binomial(n, p) random variable then F X≈ F Y.Hypergeometric / binomial: The difference between a hypergeometric distribution and a binomial distribution is the difference between sampling without replacement and sampling with replacement. As the population size increases relative to the sample size, the difference becomes negligible. Geometric / geometric: If X1 and X2 are geometric random variables with probability of success p1 and p2 respectively, then min(X1, X2) is a geometric random variable with probability of success p = p1 + p2 - p1 p2. The relationship is simpler in terms of failure probabilities: q = q1 q2.Poisson / Poisson: If X1 and X2are Poisson random variables with means μ1 and μ2respectively, then X1 + X2is a Poisson random variable with mean μ1 + μ2.Binomial / Poisson: If X is a binomial(n, p) random variable and Y is a Poisson(np) distribution then P(X = n) ≈ P(Y = n) if n is large and np is small. For more information, see Poisson approximation to binomial.Binomial / Bernoulli: If X is a binomial(n, p) random variable with n = 1, X is a Bernoulli(p) random variable.Bernoulli / Binomial: The sum of n Bernoulli(p) random variables is a binomial(n, p) random variable.Poisson / normal: If X is a Poisson random variable with large mean and Y is a normal distribution with the same mean and variance as X, then for integers j and k, P(j ≤ X ≤ k) ≈ P(j - 1/2 ≤ Y ≤ k + 1/2). For more information, see normal approximation to Poisson.Binomial / normal: If X is a binomial(n, p) random variable and Y is a normal random variable with the same mean and variance as X, i.e. np and np(1-p), then for integers j and k, P(j ≤ X ≤ k) ≈ P(j - 1/2 ≤ Y ≤ k + 1/2). Theapproximation is better when p ≈ 0.5 and when n is large. For more information, see normal approximation to binomial.Lognormal / lognormal: If X1 and X2 are lognormal random variables with parameters (μ1, σ12) and (μ2, σ22) respectively, then X1 X2 is a lognormal random variable with parameters (μ1+ μ2, σ12+ σ22).Normal / lognormal: If X is a normal (μ, σ2) random variable then e X is a lognormal (μ, σ2) random variable. Conversely, if X is a lognormal (μ, σ2) random variable then log X is a normal (μ, σ2) random variable.Beta / normal: If X is a beta random varia ble with parameters α and β equal and large, F X≈ F Y where Y is a normal random variable with the same mean and variance as X, i.e. mean α/(α + β) and variance αβ/((α+β)2(α + β + 1)). For more information, see normal approximation to beta.Normal / standard normal: If X is a normal(μ, σ2) random variable then (X - μ)/σ is a standard normal random variable. Conversely, If X is a normal(0,1) random variable then σ X + μ is a normal (μ, σ2) random variable.Normal / normal: If X1is a normal (μ1, σ12) random variable and X2 is a normal (μ2, σ22) random variable, then X1 + X2is a normal (μ1+ μ2, σ12+ σ22) random variable.Gamma / normal: If X is a gamma(α, β) random variable and Y is a normal random variable with the same mean and variance as X, then F X≈ F Y if the shape parameter α is large relative to the scale parameter β. For more information, see normal approximation to gamma.Gamma / beta: If X1 is gamma(α1, 1) random variable and X2is a gamma (α2, 1) random variable then X1/(X1 + X2) is a beta(α1, α2) random variable. More generally, if X1is gamma(α1, β1) random variable and X2is gamma(α2, β2) random variable then β2 X1/(β2 X1+ β1 X2) is a beta(α1, α2) random variable. Beta / uniform: A beta random variable with parameters α = β = 1 is a uniform random variable.Chi-squared / chi-squared: If X1 and X2 are chi-squared random variables with ν1and ν2 degrees of freedom respectively, then X1 + X2 is a chi-squared random variable with ν1+ ν2 degrees of freedom.Standard normal / chi-squared: The square of a standard normal random variable has a chi-squared distribution with one degree of freedom. The sum of the squares of n standard normal random variables is has a chi-squared distribution with n degrees of freedom.Gamma / chi-squared: If X is a gamma (α, β) random variable with α = ν/2 and β = 2, then X is a chi-squared random variable with ν degrees of freedom. Cauchy / standard normal: If X and Y are standard normal random variables, X/Y is a Cauchy(0,1) random variable.Student t / standard normal: If X is a t random variable with a large number of degrees of freedom ν then F X≈ F Y where Y is a standard normal random variable. For more information, see normal approximation to t.Snedecor F / chi-squared: If X is an F(ν, ω) random variable with ω large, then ν X is approximately distributed as a chi-squared random variable with ν degrees of freedom.Chi-squared / Snedecor F: If X1 and X2 are chi-squared random variables with ν1and ν2 degrees of freedom respectively, then (X1/ν1)/(X2/ν2) is an F(ν1, ν2) random variable.Chi-squared / exponential: A chi-squared distribution with 2 degrees of freedom is an exponential distribution with mean 2.Exponential / chi-squared: An exponential random variable with mean 2 is a chi-squared random variable with two degrees of freedom.Gamma / exponential: The sum of n exponential(β) random variables is a gamma(n, β) rand om variable.Exponential / gamma: A gamma distribution with shape parameter α = 1 and scale parameter β is an exponential(β) distribution.Exponential / uniform: If X is an exponential random variable with mean λ, then exp(-X/λ) is a uniform random variabl e. More generally, sticking any random variable into its CDF yields a uniform random variable.Uniform / exponential: If X is a uniform random variable, -λ log X is an exponential random variable with mean λ. More generally, applying the inverse CDF of any random variable X to a uniform random variable creates a variable with the same distribution as X.Cauchy reciprocal: If X is a Cauchy (μ, σ) random variable, then 1/X is a Cauchy (μ/c, σ/c) random variable where c = μ2+ σ2.Cauchy sum: If X1 is a Cauchy (μ1, σ1) random variable and X2 is a Cauchy (μ2, σ2), then X1 + X2is a Cauchy (μ1+ μ2, σ1+ σ2) random variable. Student t / Cauchy: A random variable with a t distribution with one degree of freedom is a Cauchy(0,1) random variable.Student t / Snedecor F: If X is a t random variable with ν degree of freedom, then X2is an F(1,ν) random variable.Snedecor F / Snedecor F: If X is an F(ν1, ν2) random variable then 1/X is an F(ν2, ν1) random variable.Exponential / Exponential: If X1 and X2 are exponential random variables with mean μ1and μ2 respectively, then min(X1, X2) is an exponential random variable with mean μ1μ2/(μ1+ μ2).Exponential / Weibull: If X is an exponential random variable with mean β, then X1/γis a Weibull(γ, β) random variable.Weibull / Exponential: If X is a Weibull(1, β) random variable, X is an exponential random variable with mean β.Exponential / Double exponential: If X and Y are exponential random variables with mean μ, then X-Y is a double exponential random variable with mean 0 and scale μDouble exponential / exponential: If X is a double exponential random variable with mean 0 and scale λ, then |X| is an exponential random variable with mean λ.。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

– 则f(x)为X的概率密度函数(PDF)

– f(x)满足:

(1) f (x) 0

(2) f (x)dx 1

常用概率分布函数

• 连续型随机变量

– F(x)为连续型随机变量的累积分布函数(CDF)

F(x) P(X x) x f (x)dx

– 连续型随机变量X均值和方差分别为:

E(X ) xf (x)dx

常用概率分布函数

二项分布 泊松分布 均匀分布 正态分布 指数分布 伽马分布

常用概率分布函数

• 离散型随机变量

– 若随机变量的取值为有限个或可以逐一列举的无穷多个 数值,则称此类随机变量为离散型随机变量。

– 设离散随机变量X有:P( X xi ) p( xi )

– 将P={p1,p2,…pn…}称为X的概率密度函数 (Probability Density Function,PDF)

– 泊松分布是二项分布的特殊情况(n趋近无穷大,令 np->λ),当一个固定时间间隔内有大量事件以恒定的 速率发生,且事件之间相互独立时,可以用泊松分布描 述,并称这样的随机事件为泊松流。

– 泊松分布的概率密度函数: P(x k) k e k {0,1, 2..., n}

k!

– 累积分布函数:

– x=0:0.001:5;

0.4

– n=10;

0.35

– p=0.1;

0.3

– y=binopdf(x,n,p); 0.25

– plot(x,y);

0.2

0.15

0.1

0.05

0 0 0.5 1 1.5 2 2.5 3 3.5 4 4.5 5

常用概率分布函数

• 泊松分布( Poisson Distribution )

D(X ) E(X 2 ) [E(X )]2

常用概率分布函数

• 二项分布(Binomial Distribution)

– 二项分布用来描述当每次试验的成功概率为p时,n次 独立贝努力试验成功的总次数为k的概率。

–

二项分布的概率密度函数:

P(x k)

n k

pk (1

p)nk

– 累积分布函数:

– x=0:0.001:50;

– a=10;

0.14

– b=1; 0.12

– y=gampdf(x,a,b); 0.1

– plot(x,y);

0.08

0.06

0.04

0.02

0

0

5 10 15 20 25 30 35 40 45 50

E( X ) xi pi i 1

D(X ) E[X E(X )]2 E(X 2) [E(X )]2

常用概率分布函数

• 连续型随机变量

– 若随机变量X可以在某个数值区间内连续取任一数值, 则称之为连续型随机变量。

– 若存在非负函数f(x),使得X在区间(a, b)内取值的概率

为:

b

P(a,b) a f (x)dx

f (x)

x

1e

x

x 0

( )

0为比例参数,表示时间发生的平均间隔;

0为形状参数,表示产生一次失效的事件数;

( )为函数,( )= t e 1 tdt 0

–

累积分布函数:

F ( x)

1-e x

1 (x

j0

)j

j!

x

0

0

其它

常用概率分布函数

• γ分布(γ Distribution)

– 正态分布的概率密度函数:

– 累积分布函数:

f (x)

1

(x )2

e 2 2

2

x

F(x) f (x)dx

1

( x )2

x

e

2 2

dx

2

常用概率分布函数

• 正态分布( Normal Distribution )

– 均值为0,标准差为1的标准正态分布与一般正态分布的比较:

– x=-5:0.01:5;

ex , 0 x;

f (x) 0, x 0.

1 ex , 0 x; F(x)

0, x 0.

常用概率分布函数

• 指数分布(Exponential Distribution)

– 排队系统中平均间隔时间为1的客户到达概率密度分布:

– x=0:0.01:10; 1

– lamuda=1;

– a=0;

1

0.9

– b=1;

0.8

– y=unifpdf(x,0,1); 0.7

– plot(x,y);

0.6

0.5

0.4

0.3

0.2

0.1

0

-1

-0.5

0

0.5

1

1.5

2

常用概率分布函数

• 正态分布( Normal Distribution )

– 正态分布用于描述众多独立偶然因素共同作用下的变量。

– plot(x,y0,x,y1,x,y2); 0.1

0

-5 -4 -3 -2 -1

0

1

2

3

4

5

常用概率分布函数

• 指数分布(Exponential Distr互独立的时间间隔,如 顾客到达的时间间隔、服务时间等。

– 概率密度函数: – 累积分布函数:

其中

n k

=

k

n! !(n

k

)!

称为二项系数

0 (x 0)

F ( x)

P( X

x)

x

i1

n

i

pi (1

p)ni (0

x

n)

1 (n x)

常用概率分布函数

• 二项分布(Binomial Distribution)

– 每次概率p为0.1,n为10次试验中,成功次数为x的概 率

F (x) P( X x) x i e i0 i!

常用概率分布函数

• 泊松分布( Poisson Distribution )

– 大量生产时零件不合格品出现次数的概率,比如生产 100000个零件,每个零件的次品率为0.0001,则出现 不同数量次品的概率

0.14

– x=0:0.001:30; 0.12

– 概率密度函数满足:

(1) p( xi ) 0

(2) p( xi ) 1.

i 1

i 1, 2

常用概率分布函数

• 离散型随机变量

– F(x)为离散型随机变量的累积分布函数(Cumulative Distribution Function,CDF)

F(x) p(xi ) xi x

– 离散型随机变量X均值和方差分别为:

0.9

– y=exppdf(x, lamuda); 0.8

– plot(x,y);

0.7

0.6

0.5

0.4

0.3

0.2

0.1

0

0

1

2

3

4

5

6

7

8

9 10

常用概率分布函数

• γ分布(γ Distribution)

–γ分布用于描述完成某些任务所需要的时间,如排队系

统中顾客的等待时间等。

– 概率密度函数:

– lamuda=10;

0.1

– y=poisspdf(x,lamuda);

0.08

– plot(x,y);

0.06

0.04

0.02

0

0

5

10

15

20

25

30

常用概率分布函数

• 均匀分布( Uniform Distribution )

– 均匀分布是取值在最大值b和最小值a之间随机、连续 的抽取。在仿真中具有重要意义,(0,1)均匀分布的随机 数是生成其他类型随机数的基础。

– u0=0;

– sigma0=1;

0.8

– u1=1;

0.7

– sigma1=0.5;

0.6

– u2=0; 0.5

– sigma2=2; – y0=normpdf(x,u0,sigma0); 0.4

– y1=normpdf(x,u1,sigma1); 0.3

– y2=normpdf(x,u2,sigma2); 0.2

– 均匀分布的概率密度函数:

f

(x)

b

1

a

a

x

b

– 累积分布函数:

0 其它

0 x a

F

(

x)

x b

a a

a

x

b

1 x b

常用概率分布函数

• 均匀分布( Uniform Distribution )

– (0, 1)区间的标准均匀分布:

– x=-1:0.01:2;