聚类分析层次聚类

实验4:聚类分析

实验四:聚类分析1、实验内容:层次聚类和K-Means聚类的主要步骤,SPSS的聚类分析操作,聚类分析结果的分析2、实验目的:能够运用SPSS软件进行聚类分析,能够分析聚类分析结果3、实验难点:聚类分析结果的分析一、层次聚类1、层次聚类(Hierarchical Cluster):聚类过程是按照一定的层次逐步进行的,也称为系统聚类。

层次聚类是聚类分析方法中使用最多的,它有两种类型:(1)Q型聚类:对样品(Case,也称为个案)进行聚类,使具有相似特征的样品聚集在一起,使差异性较大的样品分离开来,也称为样品聚类。

Q型聚类应用较多。

(2)R型聚类:对变量进行聚类,使具有相似特征的变量聚集在一起,使差异性较大的变量分离开来,也称为变量聚类。

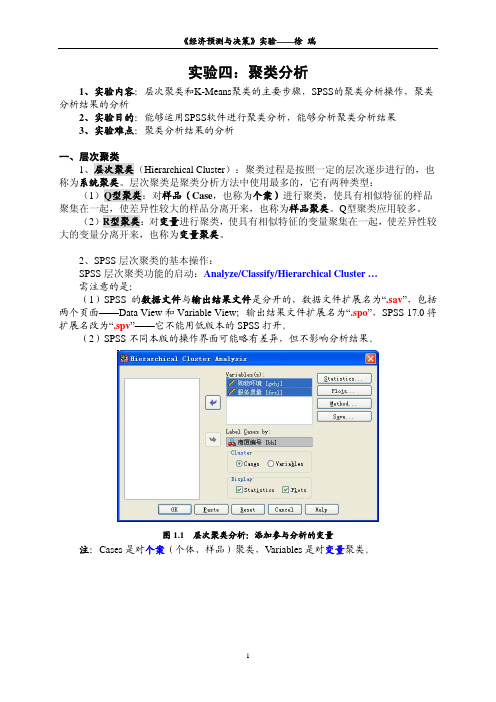

2、SPSS层次聚类的基本操作:SPSS层次聚类功能的启动:Analyze/Classify/Hierarchical Cluster …需注意的是:(1)SPSS的数据文件与输出结果文件是分开的,数据文件扩展名为“.sav”,包括两个页面——Data View和Variable View;输出结果文件扩展名为“.spo”,SPSS 17.0将扩展名改为“.spv”——它不能用低版本的SPSS打开。

(2)SPSS不同本版的操作界面可能略有差异,但不影响分析结果。

图1.1 层次聚类分析:添加参与分析的变量注:Cases是对个案(个体、样品)聚类,Variables是对变量聚类。

图1.2 层次聚类分析的Statistics窗口注:Cluster Membership选项中的None表示不输出个案所属的类,Single Solution 表示输出当分成n类(n需输入)时的各个案所属的类,Range of Solution表示输出当分成m至n类(m、n均需输入)时的各个案所属的类。

输入完毕点Continue。

图1.3 层次聚类分析的Plots窗口注:Dendrogram表示输出聚类分析树状图。

聚类分析的类型与选择

聚类分析的类型与选择聚类分析是一种常用的数据挖掘技术,可以将数据按照某种相似性进行分组。

通过聚类分析,我们可以发现数据中的潜在规律和结构,帮助我们更好地理解数据,并做出相应的决策。

本文将介绍聚类分析的常见类型,并讨论如何选择适合的聚类方法。

1.聚类分析的类型聚类分析有多种类型,常见的包括层次聚类分析和k均值聚类分析。

下面将分别介绍这两种聚类方法。

1.1层次聚类分析层次聚类分析是一种自下而上的聚类方法,它通过计算数据之间的相似度或距离,将相似的数据逐步合并成簇。

这种方法对数据的层次结构有较好的表示,能够发现不同层次的聚类结构。

层次聚类分析的优点之一是不需要预先指定聚类的个数,但计算复杂度较高,对大规模数据处理存在困难。

另外,它对异常值敏感,若存在异常值可能影响聚类结果。

1.2k均值聚类分析k均值聚类分析是一种基于划分的聚类方法,它将数据划分成k个互不重叠的簇,使得簇内的数据相似度较高,簇间的数据相似度较低。

该方法通过迭代计算簇的中心和重新分配数据来实现聚类。

k均值聚类分析的优点在于计算简单、效果较好,适用于大规模数据集。

但该方法对初始簇中心的选择较为敏感,容易收敛于局部最优解。

2.选择合适的聚类方法在选择聚类方法时,应根据数据的特点和目标进行判断。

下面列举几个常见的选择因素,供参考:2.1数据特点需要考虑数据的特点,如数据的维度、规模、密度等。

对于高维度数据,层次聚类分析可能更适用;而对于大规模数据,k均值聚类分析常常更为合适。

2.2聚类目标需要考虑聚类的目标。

如果希望发现层次结构、发现数据的内在关联性,层次聚类分析是一个不错的选择。

而如果目标是将数据划分成互不重叠的簇,并且希望聚类结果能较好地解释数据的差异性,k均值聚类分析更为合适。

2.3数据质量数据质量也是选择聚类方法的重要因素。

层次聚类分析对异常值比较敏感,如果数据中存在异常值,使用k均值聚类分析可能更好。

选择合适的聚类方法需要综合考虑数据特点、聚类目标和数据质量等因素。

层次聚类分析

层次聚类分析层次聚类分析在层次聚类中,起初每⼀个实例或观测值属于⼀类。

聚类就是每⼀次把两类聚成新的⼀类,直到所有的类聚成单个类为⽌,算法如下:(1) 定义每个观测值(⾏或单元)为⼀类;(2) 计算每类和其他各类的距离;(3) 把距离最短的两类合并成⼀类,这样类的个数就减少⼀个;(4) 重复步骤(2)和步骤(3),直到包含所有观测值的类合并成单个的类为⽌。

层次聚类⽅法单联动聚类⽅法倾向于发现细长的、雪茄型的类。

它也通常展⽰⼀种链式的现象,即不相似的观测值分到⼀类中,因为它们和它们的中间值很相像。

全联动聚类倾向于发现⼤致相等的直径紧凑类。

它对异常值很敏感。

平均联动提供了以上两种⽅法的折中。

相对来说,它不像链式,⽽且对异常值没有那么敏感。

它倾向于把⽅差⼩的类聚合。

Ward法倾向于把有少量观测值的类聚合到⼀起,并且倾向于产⽣与观测值个数⼤致相等的类。

它对异常值也是敏感的。

质⼼法是⼀种很受欢迎的⽅法,因为其中类距离的定义⽐较简单、易于理解。

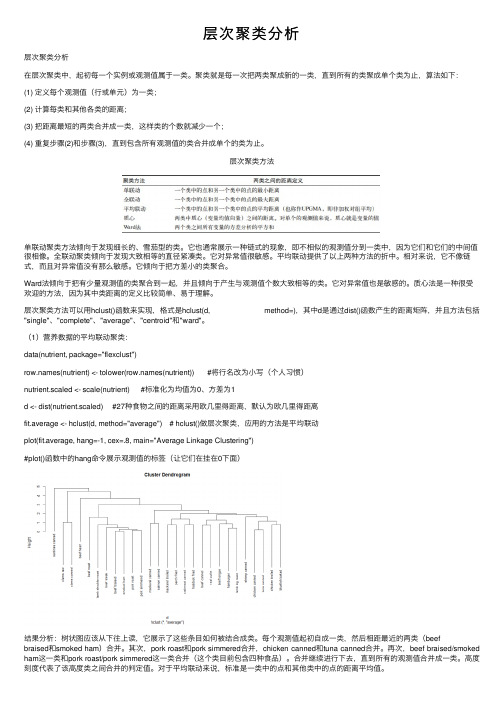

层次聚类⽅法可以⽤hclust()函数来实现,格式是hclust(d, method=),其中d是通过dist()函数产⽣的距离矩阵,并且⽅法包括"single"、"complete"、"average"、"centroid"和"ward"。

(1)营养数据的平均联动聚类:data(nutrient, package="flexclust")s(nutrient) <- tolower(s(nutrient)) #将⾏名改为⼩写(个⼈习惯)nutrient.scaled <- scale(nutrient) #标准化为均值为0、⽅差为1d <- dist(nutrient.scaled) #27种⾷物之间的距离采⽤欧⼏⾥得距离,默认为欧⼏⾥得距离fit.average <- hclust(d, method="average") # hclust()做层次聚类,应⽤的⽅法是平均联动plot(fit.average, hang=-1, cex=.8, main="Average Linkage Clustering")#plot()函数中的hang命令展⽰观测值的标签(让它们在挂在0下⾯)结果分析:树状图应该从下往上读,它展⽰了这些条⽬如何被结合成类。

聚类分析—层次聚类

10

9

8

7

6

5

4

3 2

1

0 0

123Fra bibliotek45

6

7

8

9

10

2020/6/19

10

9

8

7 6

5

4

3

2

1

0 0

1

2

3

4

5

6

7

8

9

10

10

9

8

7

6

5

4

3 2

1

0 0

1

2

3

4

5

6

7

8

9

10

层次方法(续)

四个广泛采用的簇间距离度量方法

最小距离:dmin(Ci,Cj) = min p∈Ci, p’∈Cj |p-p’| 最大距离:dmax(Ci,Cj) = max p∈Ci, p’∈Cj |p-p’| 平均值的距离:dmean(Ci,Cj) = | mi - mj | 平均距离(簇的直径D ):davg(Ci,Cj) =∑ p∈Ci ∑p’∈Cj |p-p’|

/ninj

其中, |p-p’|是两个对象p和p’之间的距离 mi是簇Ci 的平均值,ni是簇Ci中对象的数目

2020/6/19

层次方法(续)

层次聚类的主要缺点

不具有很好的可伸缩性: 时间复杂性至少是 O(n2), 其中 n 对象总数 合并或分裂的决定需要检查和估算大量的对象或簇 不能撤消已做的处理, 聚类之间不能交换对象. 如果某一步没有很好地

2020/6/19

聚类特征

假定簇C1中有两个点(1,2,3),(3,2,1),簇C2 有三个点(1,1,2),(2,2,1),(2,1,2),簇 3由C1和C2构成,则:

层次聚类分析

D(0)

表1

D(0) G1={X1}G2={X2}G3={X3}G4={X4}G5={X5} G1={X1} 0

G2={X2} 1

G3={X3} 2.5

0

1.5 0

G4={X4} 6

G5={X5} 8

5

7

3.5

5.5

0

2 0

D(1)

表2

D(1) G6={G1, G2} G3={X3} G4={X4} G5={X5} G6 0 1.5 5 7 0 3.5 5.5 0 2 0 G3 G4 G5

层次聚类分析

hierarchical clustering method

聚类分析也是一种分类技术。是研究“ 物以类聚”的一种方法。与多元分析的 其他方法相比,该方法理论上还不完善 ,但由于它能解决许多实际问题,很受 人们的重视,应用方面取得了很大成功 。

举 例

对10位应聘者做智能检验。3项指标X,Y 和Z分别表示数学推理能力,空间想象能 力和语言理解能力。其得分如下,选择合 适的统计方法对应聘者进行分类。

D2(1) G6={X1, X2} G3={X3}

G6 0 4

G3

G4

G5

0

G4={X4}

G5={X5}

30.25

56.25

12.25

30.25

0

4 0

D2(2)

G7

G7

0

G4

G5

G4

G5

20.25

42.25

0

4 0

D2(3)

G7={X1, X2,X3} G8={X4,X5 }

ห้องสมุดไป่ตู้G7

0 30.25

• x11• •

聚类分析及其应用实例ppt课件

Outlines

聚类的思想 常用的聚类方法 实例分析:层次聚类

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

3. 实例分析:层次聚类算法

定义:对给定的数据进行层次的分解

第4 步

➢

凝聚的方法(自底向上)『常用』

思想:一开始将每个对象作为单独的

第3 步

一组,然后根据同类相近,异类相异 第2步 的原则,合并对象,直到所有的组合

并成一个,或达到一个终止条件。 第1步

a, b, c, d, e c, d, e d, e

X3 Human(人) X4 Gorilla(大猩猩) X5 Chimpanzee(黑猩猩) X2 Symphalangus(合趾猿) X1 Gibbon(长臂猿)

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

离差平方和法( ward method ):

各元素到类中心的欧式距离之和。

Gp

Cluster P

Cluster M

Cluster Q

D2 WM Wp Wq

G q

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

凝聚的层次聚类法举例

Gp G q

Dpq max{ dij | i Gp , j Gq}

在整堂课的教学中,刘教师总是让学 生带着 问题来 学习, 而问题 的设置 具有一 定的梯 度,由 浅入深 ,所提 出的问 题也很 明确

聚类分析

步骤:

• • • • • • • 1、对数据进行变换处理,消除量纲 2、构造n个类,每个类只包含一个样本计算 3、n个样本两两间的距离{dij} 4、合并距离最近的两类为一新类 5、计算新类与当前各类的距离,重复(4) 6、画聚类图 7、决定类的个数和类

12

类与类间距离的确定

一、最短距离法 二、最长距离法 三、中间距离法 四、重心距离法 五、类平均法 六、离差平方和

聚类分析

(Cluster Analysis)

1

聚类分析(Cluster Analysis)

• 一、聚类分析基本原理 • 二、层次聚类法(Hierarchical Cluster) • 三、K-均值聚类法(K-means cluster)

2

一、聚类分析(Cluster analysis)基本原理 • 聚类分析又称群分析或点群分析,它是研

G8={G1,G2}

17

d78=min{d71,d72}=12.80 7 D4= 7 8 河南3 甘肃4 青海5 辽宁1 浙江2 0 12.8 0 8

18

最长距离法(furthest neighbor)

• 用两类之间最远点 的距离代表两类之 间的距离。

例2:对例1的数据以最长距离法聚类。

19

d13=13.80 d14=13.12 d15=12.80 d23=24.63 d24=24.06 d25=23.54 d34=2.2 d35=3.51 d45=2.21 1 D1= 1 2 3 4 5 0 11.67 0 13.80 24.63 0 13.12 24.06 2.20 0 0 12.80 23.54 3.51 2.21 2 3 4 5 河南与甘肃的距离最近, 先将二者(3和4)合 为一类G6={G3,G4}

层次分析法和聚类分析法

层次分析法和聚类分析法层次分析法(Analytic Hierarchy Process,AHP)是由美国运筹学家托马斯·萨亨于20世纪70年代提出的一种多属性决策方法,用于处理和解决具有多个因素和多个层次的决策问题。

层次分析法基于对决策问题的分解和层次化处理,通过对不同因素的权重进行评估和比较,最终得到最优的决策方案。

层次分析法的主要步骤包括:建立层次结构、构造判断矩阵、计算权重向量、一致性检验和综合权重。

首先,建立层次结构,将问题分解为不同的层次和因素,形成一个树状结构。

然后,通过构造判断矩阵,对不同层次和因素进行两两比较,得到判断矩阵。

接着,计算权重向量,通过对判断矩阵进行归一化和求和,得到每个因素的权重。

进行一致性检验,判断判断矩阵是否具有一致性。

最后,综合权重,将各个层次和因素的权重进行综合,得到最终的决策方案。

层次分析法的特点是简单、直观、易于理解和操作。

它可以将复杂的决策问题分解为易于处理的因素,通过权重比较将主观感受量化为数值,从而获得可操作的决策方案。

同时,层次分析法还可以根据不同的需求和偏好进行灵活调整,具有较强的适应性。

聚类分析法(Cluster Analysis)是一种基于样本相似性的数据分析方法,用于将相似的对象或观测分组成为簇。

聚类分析通过计算样本之间的相似性或距离,并基于相似性将样本进行分组,从而实现对数据的分类和整理。

聚类分析的主要步骤包括:选择合适的距离或相似性度量方法、选择合适的聚类算法、确定聚类数目、计算样本之间的相似性或距离、进行聚类分析和评价聚类结果。

首先,选择合适的距离或相似性度量方法,用于衡量样本之间的相似性或距离。

然后,选择合适的聚类算法,如K-means、层次聚类等,用于将样本分组成簇。

确定聚类数目,根据具体问题确定簇的个数。

接着,计算样本之间的相似性或距离,根据所选的度量方法计算样本之间的距离或相似性。

进行聚类分析,将样本分组成簇,并通过可视化和统计等方法对结果进行解释和评价。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

10

9

8

7

6

5

4

3 2

1

0 0

1

2

3

4

5

6

7

8

9

10

6/6/2020

10

9

8

7 6

5

4

3

2

1

0 0

1

2

3

4

5

6

7

8

9

10

10

9

8

7

6

5

4

3 2

1

0 0

1

2

3

4

5

6

7

8

9

10

层次方法(续)

四个广泛采用的簇间距离度量方法

最小距离:dmin(Ci,Cj) = min p∈Ci, p’∈Cj |p-p’| 最大距离:dmax(Ci,Cj) = max p∈Ci, p’∈Cj |p-p’| 平均值的距离:dmean(Ci,Cj) = | mi - mj | 平均距离(簇的直径D ):davg(Ci,Cj) =∑ p∈Ci ∑p’∈Cj |p-p’|

智能数据挖掘

Topic3--聚类分析

层次聚类方法(Hierarchical Methods)

层次方法

层次的聚类方法将数据对象组成一棵聚类的树 根据层次分解是自底向上, 还是自顶向下形成, 层次的聚类方

法可以进一步分为凝聚的(agglomerative)和分裂的(divisive) 层次聚类 纯粹的层次聚类方法的聚类质量受限于如下特点:一旦一个 合并或分裂被执行,就不能修正 最近的研究集中于凝聚层次聚类和迭代重定位方法的集成 使用距离矩阵作为聚类标准. 该方法不需要输入聚类数目 k, 但需要终止条件

在阶段三和四采用任何聚类算法,例如典型的划分方法 BIRCH的性能

支持增量聚类:因为它对每一个数据点的聚类的决策都是基于当前 已经处理过的数据点,而不是基于全局的数据点。

线性可伸缩性: 计算复杂性O(n), 单遍扫描, 附加的扫描可以改善聚类 质量

较好的聚类质量

缺点

只能处理数值数据 对数据的输入次序敏感 CF树结点不总是对应于[用户考虑的]自然簇(参数B和T) 簇非球形时效果不好(使用半径/直径控制簇边界)

Ø 阶段四:通过上阶段得出聚类质心,将其作为 种子节点,将其他对象分配给质心,构成新的聚 类。

6/6/2020

BIRCH算法流程如下图所示:

BIRCH算法流程如下图所示:

6/6/2020

BIRCH (续)

重建过程从旧树的叶子节点建造一个新树。这样,重建树的过程不需要重 读所有的对象 ----建树只需读一次数据

Leaf node

prev CF1 CF2

CF6 next

CF5

child5

prev CF1 CF2

Leaf node CF4 next

6/6/2020

CF树构造过程

(1)从根节点开始,自上而下选择最近的孩子节点

(2)到达叶子节点后,检查最近的元组CFi能否吸收此数 据点

是,更新CF值

否,是否可以添加一个新的元组

分支因子B: 定义非树叶节点的孩子的最大个数 阈值T: 给出了存储在树的叶子节点中的子类的最大直径

6/6/2020

CF tree的结构类似于一棵B-树,它有3个参数: 内部节点平衡因子B,叶节点平衡因子L,簇直径 阈值T。树中每个Nlonleaf节点最多包含B个孩子 节点,Leaf最多只能有L个MinCluster(初始划分 子簇),而一个MinCluster的直径不能超过T。

是,添加一个新的元组

否则,分裂最远的一对元组,作为种子,按最近

距离重新分配其它元组

(3)更新每个非叶节点的CF信息,如果分裂节点,在父 节点中插入新的元组,检查分裂,直到root

6/6/2020

构造CF树

算法起初,我们扫描数据库,拿到第一个data point instance--(1,2,3),我们创建一个空的Leaf 和MinCluster,把点(1,2,3)的id值放入 Mincluster,更新MinCluster的CF值为(1, (1,2,3),(1,4,9)),把MinCluster作为Leaf 的一个孩子,更新Leaf的CF值为(1,(1,2,3), (1,4,9))。实际上只要往树中放入一个CF (这里我们用CF作为Nonleaf、Leaf、 MinCluster的统称),就要更新从Root到该叶子 节点的路径上所有节点的CF值。

因此得到CF3为: CF3=(2+3,(4+5,4+4,4+5),(10+9,8+6,10+9))=(5,

(9,8,9),(19,14,19))

6/6/2020

簇的质心和簇的半径。

假如一个簇中包含n个数据点:{Xi},i=1,2,3...n., 则质心C和半径R计算公式如下:

C=(X1+X2+...+Xn)/n,(这里X1+X2+...+Xn是向 量加)

6/6/2020

Birch算法的阶段:

Ø 阶段一:扫描数据库,构造一颗CF树,并定 义相关阈值,把稠密数据分成簇。

Ø 阶段二:对CF树进行压缩,通过改变T值,将 部分簇进行压缩合并,建立一个更小的CF树。

Ø 阶段三:采用其他的聚类算法对其叶节点进行 聚类,将稀疏的簇当作离群值进行删除,补救由 于输入顺序和页面大小带来的分裂。

记录了计算聚类和有效利用存储的关键度量, 并有效地利用了存储,因 为它汇总了关于子类的信息,而不是存储所有的对象

CF 树是高度平衡的树,它存储了层次聚类的聚类特征

树中的非叶节点有后代或“孩子” 非叶节点存储了其孩子的CF的总和,即汇总了关于其孩子的聚类信

息

CF树有两个参数 ----影响CF树的大小

6/6/2020

有意思的是簇中心、簇半径、簇直径以及两簇之 间的距离D0到D3都可以由CF来计算,比如

簇直径 簇间距离 这里的N,LS和SS是指两簇合并后大簇的N,LS

和SS。所谓两簇合并只需要两个对应的CF相加 那可

6/6/2020

BIRCH的CF树

聚类特征

从统计学的观点来看,聚类特征是对给定子类统计汇总: 子聚类的0 阶, 1阶和 2阶矩( moments )

两个重要概念

聚类特征(Clustering Feature, CF) 聚类特征树(Clustering Feature Tree, CF树)

聚类特征

聚类特征(CF)是一个三元组,给出对象子类的信息的汇总描述

设某个子类中有N个d维的点或对象{oI},则该子类的CF定义如下

6/6/2020

C F (N ,L S

假定簇C1中有两个点(1,2,3),(3,2,1),簇C2 有三个点(1,1,2),(2,2,1),(2,1,2),簇 3由C1和C2构成,则:

CF1=(2,(1+3,2+2,3+1),( ))=(2,(4,4,4), (10,8,10))

CF2=(3,(1+2+2,1+2+1,2+1+2),( ))=(3,(5,4, 5),(9,6,9))

聚类特征

Clustering Feature:CF = (N, LS, SS)

N: 数据点数目

LS: Ni=1 Xi SS: Ni=1Xi2

CF = (5, (16,30),(54,190))

10

9

8

7

6

5

4

3 2

1

0 0

1

2

3

4

5

6

7

8

9

10

(3,4) (2,6) (4,5) (4,7) (3,8)

/ninj

其中, |p-p’|是两个对象p和p’之间的距离 mi是簇Ci 的平均值,ni是簇Ci中对象的数目

6/6/2020

层次方法(续)

层次聚类的主要缺点

不具有很好的可伸缩性: 时间复杂性至少是 O(n2), 其中 n 对象总数 合并或分裂的决定需要检查和估算大量的对象或簇 不能撤消已做的处理, 聚类之间不能交换对象. 如果某一步没有很好地

个指定的收缩因子向着聚类中心对它们进行收缩

6/6/2020

BIRCH (1996)

Birch (Balanced Iterative Reducing and Clustering using Hierarchies): 利用层次方法的平衡迭代归约和聚类由Zhang, Ramakrishnan和Livny 提出(SIGMOD’96), 该算法的特点是能利用有限的内存资源完成对大数 据集的高质量的聚类,同时通过单遍扫描数据集能最小化I/O代价。

选择合并或分裂的决定, 可能会导致低质量的聚类结果

6/6/2020

层次方法(续)

改进层次方法的聚类质量的方法: 将层次聚类和其他的聚类 技术进行集成, 形成多阶段聚类

BIRCH (1996): 使用 CF-tree对对象进行层次划分, 然后采用其他的聚 类算法对聚类结果进行求精

ROCK1999:基于簇间的互联性进行合并 CHAMELEON (1999): 使用动态模型进行层次聚类 CURE (1998):采用固定数目的代表对象来表示每个簇,然后依据一

例如,一棵高度为3,B为6,L为5的一棵CF树的 例子如图所示:

6/6/2020

CF树的样子

6/6/2020

CF Tree

Root

B=5 L=6

CF1 CF2 CF3

child1 child2 child3

CF6

child6

Non-leaf node CF1 CF2 CF3