6-聚类分析

聚类分析的基本概念与方法

聚类分析的基本概念与方法聚类分析(Cluster Analysis)是一种将数据分组或分类的统计学方法,通过将相似的对象归为同一组,使得组内的对象之间更加相似,而不同组之间的对象则差异较大。

它是数据挖掘和机器学习领域中常用的技术之一,被广泛应用于市场分析、生物信息学、图像处理等领域。

一、聚类分析的基本概念聚类分析基于相似性的概念,即认为具有相似特征的对象更有可能属于同一类别。

在聚类分析中,每个对象都被视为一个数据点,而聚类则是将这些数据点分组。

基本概念包括以下几点:1. 数据点:数据集中的每个样本或对象都被看作是一个数据点,它具有多个特征或属性。

2. 相似性度量:聚类分析的关键是如何计算数据点之间的相似性或距离。

常用的相似性度量包括欧氏距离、曼哈顿距离、闵可夫斯基距离等。

3. 簇/类别:将相似的数据点归为一组,这个组被称为簇或类别。

簇内的数据点相似度较高,而不同簇之间的数据点相似度较低。

4. 聚类算法:聚类分析依赖于具体的算法来实现数据点的分组。

常见的聚类算法有K均值聚类、层次聚类、密度聚类等。

二、聚类分析的方法1. K均值聚类(K-means Clustering):K均值聚类是一种迭代的聚类方法,它将数据点分成K个簇,每个簇代表一个样本集。

算法的基本思想是通过最小化簇内数据点与簇中心之间的平方误差来确定最优的簇中心位置。

2. 层次聚类(Hierarchical Clustering):层次聚类是一种基于树状结构的聚类算法,它根据数据点之间的相似性逐步合并或分割簇。

层次聚类分为凝聚型和分裂型两种方法,其中凝聚型方法从单个数据点开始,逐步合并最相似的簇;分裂型方法从所有数据点开始,逐步分割最不相似的簇。

3. 密度聚类(Density-Based Clustering):密度聚类基于密度可达的概念,将具有足够高密度的数据点归为一簇。

核心思想是在数据空间中通过密度连通性来确定簇的边界,相对于K均值聚类和层次聚类,密度聚类能够有效处理不规则形状和噪声数据。

第5章 聚类分析6

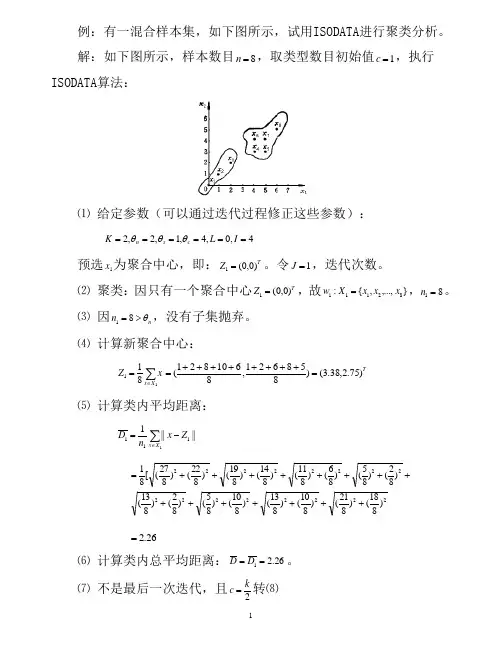

例:有一混合样本集,如下图所示,试用ISODATA 进行聚类分析。

解:如下图所示,样本数目8=n ,取类型数目初始值1=c ,执行ISODATA 算法:⑴ 给定参数(可以通过迭代过程修正这些参数):4,0,4,1,2,2======I L K c s n θθθ预选1x 为聚合中心,即:TZ )0,0(1=。

令1=J ,迭代次数。

⑵ 聚类:因只有一个聚合中心TZ )0,0(1=,故},..,,{:82111x x x X w =,81=n 。

⑶ 因n n θ>=81,没有子集抛弃。

⑷ 计算新聚合中心:∑∈=1811X x x Z T )75.2,38.3()858621,8610821(=++++++++=⑸ 计算类内平均距离:∑∈-=1||||1111X x Z x n D ++++++++=22222222)82()85()86()811()814()819()822()827([8122222222)818()821()810()813()810()85()82()813(+++++++26.2=⑹ 计算类内总平均距离:26.21==D D 。

⑺ 不是最后一次迭代,且2kc =转⑻⑻ 计算聚合1X 中的标准偏差1σ:T ),(12111σσσ=∑∈-=j X x ji J Z x 2111))((81σ])8276()8275()8274()8275()8274()8272()8271()8270[(8122222222-+-+-+-+-+-+-+-=56.1])818()810()810()822()82()86()814()822[(812222222212=+++++++=σ T )56.1,99.1(1=σ⑼ 1σ中的最大偏差分量为99.111=σ,即99.1max 1=σ。

⑽ 因为s θσ>max 1,且2K c =。

所以把聚合分裂成两个子集,5.0=K ,则:T r )0,1(1=,故新的聚合中心分别为:T Z )75.2,38.4(1=+,T Z )75.2,38.2(1=-为方便起见,+1Z 和-1Z 改写为1Z 和2Z ,令1+=c c ,21=+=J J ,返回到⑵。

聚类分析方法

聚类分析方法

聚类分析是一种常用的数据挖掘方法,它可以将相似的数据点分组在一起。

在聚类分析中,数据被分为多个类别,每个类别都包含具有类似特征的数据点。

聚类分析方法有很多种,其中一种是K均值聚类。

K均值聚

类的目标是将数据点分为K个簇,使得每个数据点都属于与

其最近的质心所代表的簇。

首先,在聚类分析中,需要先选择一个初始的簇质心,然后迭代地将每个数据点分配到与其最近的质心所代表的簇中,然后更新簇质心的位置,直到达到收敛。

另一种常见的聚类分析方法是层次聚类。

层次聚类将数据点逐渐合并成一个个的簇,直到所有数据点都属于同一个簇。

层次聚类可以根据不同的相似性度量来合并簇,例如单链接、完全链接或平均链接等。

另外,谱聚类是一种基于图论的聚类方法,它利用数据点之间的相似性构建一个相似度矩阵,并将其转化为一个图。

然后,通过计算图的特征向量来对数据进行聚类分析。

聚类分析方法还有很多其他的变体和扩展,例如密度聚类、模糊聚类和网格聚类等。

这些方法可以根据具体的问题和数据类型来选择和应用。

总的来说,聚类分析方法是一种无监督学习的方法,可以用于发现数据中的内在结构和模式。

它在很多领域都有广泛的应用,

如市场分析、社交网络分析和生物信息学等。

通过应用聚类分析方法,可以帮助我们更好地理解和分析数据。

《应用多元统计分析》第五版PPT(第六章)-简化版(JMP13.1)

一、最短距离法

❖ 定义类与类之间的距离为两类最近样品间的距离, 即

DKL

min

iGK , jGL

dij

图6.3.1 最短距离法:DKL=d23

24

最短距离法的聚类步骤

❖ (1)规定样品之间的距离,计算n个样品的距离矩阵 D(0),它是一个对称矩阵。

❖ (2)选择D(0)中的最小元素,设为DKL,则将GK和GL合 并成一个新类,记为GM,即GM= GK∪GL。

❖ 聚集系统法的基本思想是:开始时将n个样品各自作 为一类,并规定样品之间的距离和类与类之间的距 离,然后将距离最近的两类合并成一个新类,计算 新类与其他类的距离;重复进行两个最近类的合并 ,每次减少一类,直至所有的样品合并为一类。

20

一开始每个样品各自作为一类

21

❖ 分割系统法的聚类步骤与聚集系统法正相反。由n个 样品组成一类开始,按某种最优准则将它分割成两 个尽可能远离的子类,再用同样准则将每一子类进 一步地分割成两类,从中选一个分割最优的子类, 这样类数将由两类增加到三类。如此下去,直至所 有n个样品各自为一类或采用某种停止规则。

12

➢ 一般地,若记 m1:配合的变量数 m2:不配合的变量数

则它们之间的距离可定义为

d x, y m2

m1 m2 ➢ 故按此定义,本例中x 与y 之间的距离为2/3。

13

二、相似系数

❖ 变量之间的相似性度量,在一些应用中要看相似系 数的大小,而在另一些应用中要看相似系数绝对值 的大小。

❖ 相似系数(或其绝对值)越大,认为变量之间的相 似性程度就越高;反之,则越低。

❖ 类与类之间的距离定义为两类最远样品间的距离, 即

DKL

max

聚类分析大数据课件

5

Techniques

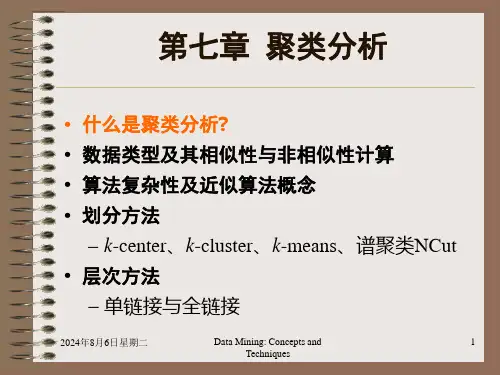

第七章 聚类分析

• 什么是聚类分析? • 数据类型及其相似性与非相似性计算 • 算法复杂性及近似算法概念 • 划分方法

– k-center、k-cluster、k-means、谱聚类NCut • 层次方法

– 单链接与全链接

2024年8月6日星期二

Data Mining: Concepts and

Data Mining: Concepts and

26

Techniques

天河一号有关数据

• 天河一号由140个机柜组成,占地约70 0平方米,总重量约160吨。

• 6144个通用处理器, 5120个加速处理器,内 存总容量98TB,存储容量为2PB 。

• 峰值运算速度为每秒4700万亿次、持续运算 速度2507万亿次每秒浮点运算。

解决方案:启发式方法与近似算法!

2024年8月6日星期二

Data Mining: Concepts and

28

Techniques

一些定义

• P = {C1, C2, …, Ck}:n个对象的一个划分,满足条件

Ci (i = 1, 2, …, k), V = iCi, 及Ci Cj = (i j)。

• k-Center:最大半径最小化

min r(P)

PPnk

k 3: NP-Hard问题!

• k-Cluster:最大直径最小化:

min d (P)

PPnk

k 3: NP-Hard问题!

2024年8月6日星期二

Data Mining: Concepts and

30

Techniques

一些常见的优化准则

d(i, j) q (| xi1 x j1 |q | xi2 x j2 |q ...| xip x jp |q)

聚类分析的意义和作用

聚类分析的意义和作用

聚类分析是一种用于将相似对象分组的数据分析方法。

它的主要作用是在给定数据集中,识别出具有相似特征的数据对象并将它们划分为不同的群组。

聚类分析主要的意义和作用如下:

1. 发现隐藏模式:聚类分析可以揭示潜在的群组结构和隐藏的模式,使得我们能够更好地理解数据集中的关系和趋势。

通过聚类分析,我们可以识别出数据集中的不同群组,并研究它们之间的相似性和差异性。

2. 数据预处理:聚类分析可以用于数据预处理,对大规模数据集进行降维和筛选。

通过将数据对象划分为不同聚类,我们可以减少数据的维度,提取出最具代表性的数据子集。

这有助于减少数据处理的复杂性,并简化后续分析任务。

3. 目标客户/市场细分:聚类分析可以用于市场细分和目标客户分析。

通过对消费者行为和偏好进行聚类,可以将消费者划分为不同的群组,并根据群组特征来定制市场营销策略。

这有助于提高营销精准度和效果,并实现个性化推荐。

4. 异常检测:聚类分析可以用于检测异常数据或异常行为。

通过将正常数据对象划分为一个聚类群组,我们可以将与这个群组相异较大的数据对象视为异常数据。

这对于识别数据集中的异常情况、欺诈行为、系统故障等具有重要意义。

5. 知识发现和决策支持:聚类分析是一种知识发现的工具,可以揭示数据中的规律和趋势。

通过对聚类结果的分析和解释,

我们可以获得有关数据集的深入洞察,并基于这些洞察做出更好的决策。

总之,聚类分析具有广泛的应用领域和意义。

它可以用于数据挖掘、市场研究、生物信息学、图像处理等多个领域,帮助我们更好地理解和利用大规模数据。

聚类分析详解ppt课件

以上我们对例6.3.1采用了多种系统聚类法进行聚类,其结果 都是相同的,原因是该例只有很少几个样品,此时聚类的过 程不易有什么变化。一般来说,只要聚类的样品数目不是太 少,各种聚类方法所产生的聚类结果一般是不同的,甚至会 有大的差异。从下面例子中可以看到这一点。

动态聚类法(快速聚类)

(4) 对D1 重复上述对D0 的两步得 D2,如此下去 直至所有元素合并成一类为止。

如果某一步Dm中最小的元素不止一个,则称此现 象为结(tie),对应这些最小元素的类可以任选一对 合并或同时合并。

27

二、最长距离法

类与类之间的距离定义为两类最远样品间的距离, 即

DKL

max

iGK , jGL

聚类分析应注意的问题

(1)所选择的变量应符合聚类的要求

如果希望依照学校的科研情况对高校进行分类,那么可以 选择参加科研的人数、年投入经费、立项课题数、支出经 费、科研成果数、获奖数等变量,而不应选择诸如在校学 生人数、校园面积、年用水量等变量。因为它们不符合聚 类的要求,分类的结果也就无法真实地反映科研分类的情 况。

主要内容

引言 聚类分析原理 聚类分析的种类 聚类分析应注意的问题 聚类分析应用 聚类分析工具及案例分析

聚类分析的种类

(1)系统聚类法(也叫分层聚类或层次聚类) (2)动态聚类法(也叫快速聚类) (3)模糊聚类法 (4)图论聚类法

系统聚类法

对比

常用的系统聚类方法

一、最短距离法 二、最长距离法 三、中间距离法 四、类平均法 五、重心法 六、离差平方和法(Ward方法)

对比

k均值法的基本步骤

(1)选择k个样品作为初始凝聚点,或者将所有样品分成k 个初始类,然后将这k个类的重心(均值)作为初始凝聚点。

《SPSS数据分析与应用》第6章 聚类分析

• 当纵坐标为13时,15个样本被12个白色 间隙分隔为13类。

系统聚类的结果解读

冰柱图聚类进程(最后一步)

依次类推,直到将15个样本全部 聚为一类,在15个样本之间没有 白色间隙,表示系统聚类结束。

• 测度观测点之间“亲疏”程度的方法与K-means聚类相同。 • 观测点与小类、小类与小类之间“亲疏”程度的测度,常用的方法有以下几种:

(1)重心法 (2)最近邻元素法 (3)组间平均联接法 (4)组间平均联接法 (5)离差平方和法

系统聚类的基本操作

第一步:用SPSS打开数据文件“移动通信客户_样本15.sav”。 第二步:在菜单栏中选择【分析(A)】→【描述统计(E)】→【描述(D)】,在弹出的 “描述”对话框的左下 角勾选【将标准化值另存为变量(Z)】,将已有的 6 个连续性变量都选到【变量(V)】列表框中,单击【确定】 按钮。

第四步:在“K均值聚类分析”对话框中单击右上角的【迭代(I)】按钮,在弹出的“K-均值聚类分析:迭代” 对话框中将【最大迭代次数(M)】修改为“50”,【收敛准则(C)】暂时不做修改。单击【继续(C)】按钮, 回到“K 均值聚类分析” 对话框。

K-Means聚类的基本操作

第五步:在“K均值聚类分析”对话框中单击右上角的【保存 (S)】按钮,在弹出的“K-均值聚类:保存新 变量”对话框中勾选【聚类成员(C)】和【与聚类中心的距离(D)】。单击【继续(C)】按钮,回到“K均 值聚类分析”对话框。

第一,如何测度样本的“亲疏程度”; 第二,如何进行聚类

K-means聚类对“亲疏程度”的测度

统计专业实验-实验6-聚类分析

重庆工商大学数学与统计学院《统计专业实验》课程实验报告实验课程:统计专业实验指导教师: ____叶勇专业班级: 09级统计二班学生姓名: ___陈文慧学生学号: __2009101218实验报告实验运行程序、基本步骤及运行结果:1.根据信息基础设施的发展状况,已知20个国家和地区信息基础设施基本数据, 对世界20个国家和地区进行聚类分析,并对结果进行判断。

(1)将数据导入SPSS中,进行聚类分析,操作如下:Analyze->Classify->Hierarchical cluster,弹出一个对话框,将各项信息基础设施指标填入变量框中,选择对国家进行分类。

(2)设置输出方式:单击plots选取Dendrogram。

点击ok,得到结果如下:组间平均链锁法Agglomeration ScheduleStageCluster CombinedCoefficientsStage Cluster FirstAppearsNext Stage Cluster 1 Cluster 2 Cluster 1 Cluster 21 12 14 7972.485 0 0 22 12 17 17744.376 1 0 63 3 19 17957.647 0 0 134 5 7 28549.087 0 0 105 10 13 59431.102 0 0 96 11 12 111361.753 0 2 97 15 16 117089.616 0 0 148 4 6 307831.028 0 0 169 10 11 482865.981 5 6 1210 5 20 751994.250 4 0 1511 8 9 1247359.726 0 0 1712 10 18 1905933.370 9 0 1413 2 3 2014119.410 0 3 1514 10 15 3118684.117 12 7 1715 2 5 8031137.994 13 10 16162 4 21721099.70815 8 18178 10 23641731.32711 14 18182 8 133944481.48516 17 19191 2 392419717.6670 18 0。

市场研究——聚类分析法

市场研究——聚类分析法

聚类分析法在市场研究中有着广泛的应用。

通过对市场中消费者、产品、品牌等进行聚类分析,可以帮助市场研究人员更好地理解市场细分和

目标受众,并制定针对不同群体的市场营销策略。

下面将详细介绍聚类分

析法的原理、应用和步骤。

聚类分析的原理是将数据样本划分为不同的类别或群组,使得同类之

间的差异最小,而不同类之间的差异最大。

输入聚类分析的数据通常是多

维的,每个维度代表一个变量。

聚类分析的目标是找到一个最优的聚类方案,使得相同类别内的样本相似度最高,而不同类别的样本相似度最低。

聚类分析法的应用非常广泛。

在市场研究中,它可以用于客户细分、

产品定位、市场定位等方面。

通过对消费者进行聚类,可以发现隐藏在市

场中的不同消费者群体,并确定他们的特征、需求和偏好。

对产品和品牌

进行聚类分析,则可以帮助确定产品和品牌的差异化定位和市场竞争策略。

需要注意的是,聚类分析法只是一种分析工具,通过聚类分析得到的

结果并不一定代表真实的市场现象,仅供市场研究人员参考和决策。

在市场研究中,聚类分析法的应用是非常重要的。

它能够帮助市场研

究人员更好地理解市场细分和目标受众,并制定针对不同群体的市场营销

策略。

随着数据量的不断增加和分析技术的不断发展,聚类分析法在市场

研究中的应用前景将更加广阔。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

相似性统计指标

怎样衡量样品或者变量之间的相似性大小?假 定有N个样品,每个样品有P变量来描述,可测的 一个数组,以矩阵X表示:

比较N个样品间相似性的Q型聚类分析,实际上 是矩阵X的N列数据之间相似性对比;同理,p个变 量之间的相似性的R型分析,是矩阵X的p行之间的 比较。

矩阵X 矩阵X中任意两个样品或两个变量之间 的相似性,表现在以下三个基本方面: ①描述两个样品或变量的两列或两行对应元 素接近的程度 ②两列或两行对应元素成比例的程度 ③两列或两行对应元素消长关系的密切程度 因此,用于表示相似性的统计指标通常 有距离系数、相似系数及相关系数三种。

聚类分析的主要思想是:根据事物本身的特性研 究个体的分类,原则是同一类中的个体有较大的相似 性,不同类中的个体差异很大。 聚类分析的实质是建立一种分类方法,它能将一 批样本数据按照他们在性质上的亲密程度在没有先验 知识的情况下自动进行分类,这里的类就是一个具有 相似性的个体的集合,不同类之间具有明显的区别。 聚类分析是一种探索性的分析,在分类过程中, 人们不必事先给出一个分类的标准,聚类分析能够从 样本数据出发,自动进行分类,因此聚类分析不需要 建模。 在具体进行聚类分析时,出于不同的目的和要求, 可能选择不同的统计量和聚类方法,因此可出现不同 的聚类结果。

层次聚类法

层次聚类法或系统聚类法(hierarchical 层次聚类法或系统聚类法(hierarchical cluster)基本思想是:先将要归类的n cluster)基本思想是:先将要归类的n个样品 (或者变量)各自看成一类,共有n (或者变量)各自看成一类,共有n类;然后按照 事先规定好的方法计算分类统计量,即某种距离 或某种相似系数,将关系最密切的两类并为一类, 其余不变,即得n 其余不变,即得n-1类;又按前面使用的计算新类 与其它类的距离或者相似系数,又将关系最密切 的两类并成一类,其余不变,即得n 的两类并成一类,其余不变,即得n-2类;如此进 行下去,每次重复都减少一类,直到最后所有样 品(或者变量)归为一类为止。显然,越是后来 合并的类,距离就越远。最后再利用一些相应的 指标来确定聚为几类的结果是最为合适的。

在地质研究领域,由于地质对象的 复杂性,单靠定性标志或少量定量标 志进行分类,常常不能揭示客观事物 内在的本质差别和联系。很多分类常 具有很大的主观性和任意性,分类常 常不能反映客观实际,分类方案又经 常因人而异,因此,多元统计分析中 对客观事物进行分类的聚类方法已在 地质研究中取得日益广泛的应用。

距离系数(dik) 距离系数(

常用于Q 常用于Q型聚类分析 每个样品视为p维空间中的一点,d 相当于p 每个样品视为p维空间中的一点,dik相当于p维空间中两点 之间的距离,既两样品点接近的程度。聚类时聚类相近的 样本属于一个类,聚类远的样本属于不同的类。 常用的方法有: 欧氏距离(Euclidean) 欧氏距离(Euclidean): (Euclidean 欧氏距离平方(Squared 欧氏距离平方(Squared Euclidean):

在应用上述所有相似性统计指标计 算时,由于测定样品的各种特征所用 的量纲及各种标志值的变化幅度可能 不同。为了避免过分突出那些绝对值 较大的变量在分类中的作用,在进行 聚类分析之前,需要对原始数据进行 处理,应对数据进行标准化或 处理,应对数据进行标准化或正规化 变化。

聚类方法的选择

有了上面的点间距离和类间距离的概念,就可 以介绍聚类的方法了。这里介绍两个简单的方法。 传统的聚类方法大致可以分为两大类, 一类是层次聚类法(Hierarchical), 一类是层次聚类法(Hierarchical), 另一类是重新定位聚类法(Relocation),也称非 另一类是重新定位聚类法(Relocation),也称非 层次聚类法。

聚类分析

聚类分析( analysis) 聚类分析(Cluster analysis)

俗语说,物以类聚、人以群分。分类学是人 类认识世界的基础科学。人类认识世界的一个重 要方法就是对所认识的对象进行分类。人们在认 识世界的过程中,需要把某些方面相似的东西归 成类,以便从中发现规律性,寻找其中共同与不 同的特征。早先分类主要是凭借经验和本学科专 业知识,做些定性分类,很少利用数据进行定量 分类的研究。随着现代科学的迅猛发展,对分类 的要求越来越高,利用数据本身的特性进行定量 分类的数值分类应运而生。尤其是电子计算机的 分类的数值分类应运而生。尤其是电子计算机的 应用,利用数学方法研究分类不仅非常必要,而 且成为可能。聚类分析是数值分类的重要方法, 被广泛地应用于自然科学、社会科学、工农业生 产的各个领域。

当有一个分类指标时,分类比较容易。 但是当有多个指标,要进行分类就不是很容 易了。 比如,要想把中国的县分成若干类,可以按 照自然条件来分:考虑降水、土地、日照、湿度 等各方面;也可以考虑收入、教育水准、医疗条 件、基础设施等指标; 对于多指标分类,由于不同的指标项对重要 程度或依赖关系是相互不同的,所以也不能用平 均的方法,因为这样会忽视相对重要程度的问题。 所以需要进行多元分类,即聚类分析。

显然,这一系列的聚类结果间存在着嵌套, 或者说层次的关系,因此这一类方法的名称 被称为层次聚类法。 由于这种结果上的层次关系,整个分析过程, 特别是每一步中完成的合并都可以用一张二 维空间的图形来表示,这种图被称为“ 维空间的图形来表示,这种图被称为“树状 图”,是层次聚类法结果解释的重要工具。 即可进行样品的聚类,也可进行变量的聚类。 SPSS为层次聚类法提供了很好的支持,具体 SPSS为层次聚类法提供了很好的支持,具体 的过程为菜单中的

如果想要对100个学生进行分类, 如果想要对100个学生进行分类,如果仅仅 知道他们的数学成绩, 知道他们的数学成绩 , 则只好按照数学成 绩来分类;这些成绩在直线上形成100个点。 绩来分类;这些成绩在直线上形成100个点。 这样就可以把接近的点放到一类。 这样就可以把接近的点放到一类。 如果还知道他们的物理成绩, 如果还知道他们的物理成绩 , 这样数学和 物理成绩就形成二维平面上的100个点, 物理成绩就形成二维平面上的100个点,也 可以按照距离远近来分类。 可以按照距离远近来分类。 三维或者更高维的情况也是类似;只不过 三维以上的图形无法直观地画出来而已。 三维以上的图形无法直观地画出来而已。

类Gp与类Gq之间的距离Dpq 与类G 之间的距离D 表示点x 之间的距离) (d(xi,xj)表示点xi∈ Gp和xj ∈ Gq之间的距离) 最短距离法: 最短距离法: 最长距离法: 最长距离法: 重心法: 重心法: 类平均法: 类平均法: 离差平方和法。 离差平方和法。

相似性系数

常用于Q型聚类分析,是把第i、k样品看成p维空间中的 两向量,两个样品之间的相似程度可由其向量间夹角的余 弦来表示,公式为

两个距离概念

按照远近程度来聚类需要明确两个概念:一个是点和点 按照远近程度来聚类需要明确两个概念:一个是点和点 之间的距离,一个是类和类之间的距离。 之间的距离,一个是类和类之间的距离。 点间距离有很多定义方式。最简单的是欧氏距离, 点间距离有很多定义方式。最简单的是欧氏距离,还有 其他的距离。 其他的距离。 当然还有一些和距离相反但起同样作用的概念, 当然还有一些和距离相反但起同样作用的概念,比如相 似性等,两点相似度越大,就相当于距离越短。 似性等,两点相似度越大,就相当于距离越短。 由一个点组成的类是最基本的类;如果是类间距离。但是如果某一 类包含不止一个点,那么就要确定类间距离, 类包含不止一个点,那么就要确定类间距离, 类间距离是基于点间距离定义的:比如两类之间最近点 类间距离是基于点间距离定义的:比如两类之间最近点 之间的距离可以作为这两类之间的距离,也可以用两类 之间的距离可以作为这两类之间的距离,也可以用两类 中最远点之间的距离作为这两类之间的距离;当然也可 中最远点之间的距离作为这两类之间的距离;当然也可 以用各类的中心之间的距离来作为类间距离。在计算时, 以用各类的中心之间的距离来作为类间距离。在计算时, 各种点间距离和类间距离的选择是通过统计软件的选项 实现的。不同的选择的结果会不同,但一般不会差太多。 实现的。不同的选择的结果会不同,但一般不会差太多。

式中:i、j=1,2,…,n(i≠k)为样品号,k= 1,2,…,p为变量号。

相关系数

多用于R 多用于R型聚类分析以表示研究对象之 间的相关性,其公式为:

式中:k 式中:k=1,2,…,p(t≠j)为变量 ,p(t≠j)为变量 号;i,j=1,2,…,n为样品号。r的取值范围是 ;i,j= 为样品号。r +1与-1之间,|r|值越大表示两变量之间关系 与-1之间,|r|值越大表示两变量之间关系 越密;|r|值越小表示关系越不密切 越密;|r|值越小表示关系越不密切

“Analyze→Classify→Hierarchical Cluster” Cluster”

非层次聚类法

非层次聚类法中以K 均值聚类法( 非层次聚类法中以K-均值聚类法(K-means Clustering)最为常用,该方法也被称为快速聚 Clustering)最为常用,该方法也被称为快速聚 类法,SPSS中提供的也正是这种方法,具体式菜 类法,SPSS中提供的也正是这种方法,具体式菜 单中的“Analyze→Classify→K单中的“Analyze→Classify→K-Means Cluster” Cluster” K-均值聚类法,类别个数需要在分析前就加 以确定,整个分析过程使用迭代的方式进行,首 先起步于一个初始的分类,然后通过不断的迭代 把数据在不同类别之间移动,直到最后达到一定 的标准为止,整个计算过程中不需要存储基本数 据或者距离矩阵,因此不会出现多个互相嵌套的 聚类结果,而计算速度也要快得多。

Chebychev: max|xi-yi| Block(绝对距离 绝对距离): Σ|xi-yi| 绝对距离 Minkowski: :

Customized距离(用户自定义距离) Customized距离(用户自定义距离): 距离