经典线性回归模型

第四章--经典线性回归模型(高级计量经济学-清华大学-潘文清)PPT课件

.

11

• 一些有用的等式

(1) (2) 因为 (3)

则

且 (4)

X’e=0

b-=(X’X)-1X’

b=(X’X)-1X’Y=(X’X)-1X’(X+)=+(X’X)-1X’

定义nn方阵:

P=X(X’X)-1X’ , M=In-P P=P’ , M=M’

P2=P, M2=M

PX=X, MX=On(k+1) e=MY=M

SSR(b)=e’e=Y’MY=’M

.

12

三、高斯-马尔科夫定理

Gauss-Markov Theorem

•Question: OLS估计量的统计性质如何?

(1)[Unbiaseness] E(b|X)=, E(b)=

E(b|X)=E[(+(X’X)-1X’)|X]=+(X’X)-1X’E(|X)=

注意:

(1) 假设4可写成

E(ij|X)=2ij,

其中, i= j时,ij=1; i≠j时,ij=0

矩阵形式: E(’)=2I

.

7

(2)由假设2,

Var(i|X)=E(i2|X)-E[(i|X)]2=E(i|X)=2

同理, Cov(i,j|X)=E(ij|X)=0

(3) 假设4意味着存在非条件同方差性:

(2) 由于可以有j≤i, 或j>i, 意味着i既不依赖过去的X, 也不依赖于未来的X。因此排除了动态模型。

例:对AR(1)模型: Yi=0+1Yi-1+i=Xi’+i

这里Xi=(1, Yi-1)’,显然E(Xii)=E(Xi)E(i)=0,但

E(Xi+1i)≠0。因此,E(i|X关于严格外生性有其他的定义。 如定义为i独立于X,或X是非随机的。这一定义排 除了条件异方差性。而我们这里的假设2是允许存在 条件异方差性的。

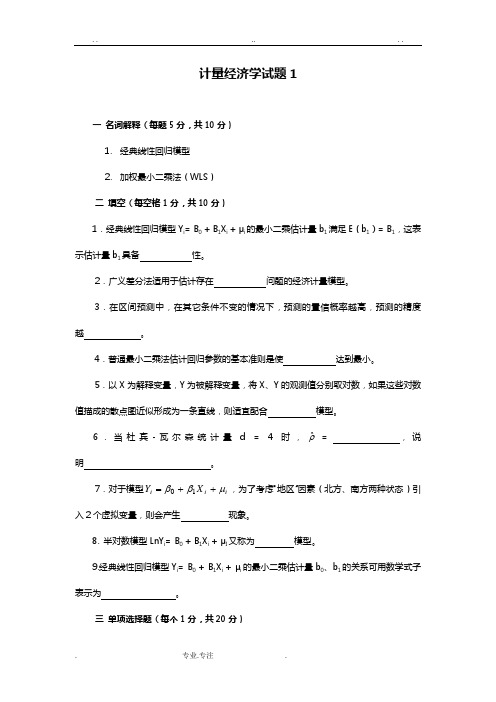

名校计量经济学试题与参考答案

计量经济学试题1一 名词解释(每题5分,共10分) 1. 经典线性回归模型 2. 加权最小二乘法(WLS ) 二 填空(每空格1分,共10分)1.经典线性回归模型Y i = B 0 + B 1X i + µi 的最小二乘估计量b 1满足E ( b 1 ) = B 1,这表示估计量b 1具备 性。

2.广义差分法适用于估计存在 问题的经济计量模型。

3.在区间预测中,在其它条件不变的情况下,预测的置信概率越高,预测的精度越 。

4.普通最小二乘法估计回归参数的基本准则是使 达到最小。

5.以X 为解释变量,Y 为被解释变量,将X 、Y 的观测值分别取对数,如果这些对数值描成的散点图近似形成为一条直线,则适宜配合 模型。

6.当杜宾-瓦尔森统计量 d = 4时,ρˆ= ,说明 。

7.对于模型i i i X Y μββ++=10,为了考虑“地区”因素(北方、南方两种状态)引入2个虚拟变量,则会产生 现象。

8. 半对数模型LnY i = B 0 + B 1X i + µI 又称为 模型。

9.经典线性回归模型Y i = B 0 + B 1X i + µi 的最小二乘估计量b 0、b 1的关系可用数学式子表示为 。

三 单项选择题(每个1分,共20分)1.截面数据是指--------------------------------------------------------------( )A .同一时点上不同统计单位相同统计指标组成的数据。

B .同一时点上相同统计单位相同统计指标组成的数据。

C .同一时点上相同统计单位不同统计指标组成的数据。

D .同一时点上不同统计单位不同统计指标组成的数据。

2.参数估计量βˆ具备有效性是指------------------------------------------( ) A .0)ˆ(=βar V B.)ˆ(βarV 为最小 C .0)ˆ(=-ββD.)ˆ(ββ-为最小 3.如果两个经济变量间的关系近似地表现为:当X 发生一个绝对量(X ∆)变动时,Y 以一个固定的相对量(Y Y /∆)变动,则适宜配合的回归模型是------------------------------------------------------------------------------------------- ( )A .i i i X Y μβα++= B.i i i X Y μβα++=ln C .i ii X Y μβα++=1D.i i i X Y μβα++=ln ln 4.在一元线性回归模型中,不可能用到的假设检验是----------( ) A .置信区间检验 B.t 检验 C.F 检验 D.游程检验5.如果戈里瑟检验表明 ,普通最小二乘估计的残差项有显著的如下性质:24.025.1i i X e +=,则用加权最小二乘法估计模型时,权数应选择-------( )A .i X 1 B. 21i X C.24.025.11iX + D.24.025.11i X +6.对于i i i i X X Y μβββ+++=22110,利用30组样本观察值估计后得56.827/)ˆ(2/)ˆ(2=-∑-∑=iiiY Y Y Y F ,而理论分布值F 0.05(2,27)=3.35,,则可以判断( )A . 01=β成立 B. 02=β成立 C. 021==ββ成立 D. 021==ββ不成立7.为描述单位固定成本(Y )依产量(X )变化的相关关系,适宜配合的回归模型是:A .i i i X Y μβα++= B.i i i X Y μβα++=ln C .i ii X Y μβα++=1D.i i i X Y μβα++=ln ln 8.根据一个n=30的样本估计ii i e X Y ++=10ˆˆββ后计算得d=1.4,已知在95%的置信度下,35.1=L d ,49.1=U d ,则认为原模型------------------------( )A .存在正的一阶线性自相关 B.存在负的一阶线性自相关 C .不存在一阶线性自相关 D.无法判断是否存在一阶线性自相关9.对于ii i e X Y ++=10ˆˆββ,判定系数为0.8是指--------------------( ) A .说明X 与Y 之间为正相关 B. 说明X 与Y 之间为负相关 C .Y 变异的80%能由回归直线作出解释 D .有80%的样本点落在回归直线上10. 线性模型i i i i X X Y μβββ+++=22110不满足下列哪一假定,称为异方差现象-------------------------------------------------------------------------------( )A .0)(=j i ov C μμ B.2)(σμ=i ar V (常数) C .0),(=i i ov X C μ D.0),(21=i i ov X X C11.设消费函数i i i X D Y μβαα+++=10,其中虚拟变量⎩⎨⎧=南方北方01D ,如果统计检验表明1α统计显著,则北方的消费函数与南方的消费函数是--( )A .相互平行的 B.相互垂直的 C.相互交叉的 D.相互重叠的12. 在建立虚拟变量模型时,如果一个质的变量有m 种特征或状态,则一般引入几个虚拟变量:----------------------------------------------------------------( )A .m B.m+1 C.m -1 D.前三项均可 13. 在模型i i iX Y μββ++=ln ln ln 10中,1β为---------------------( )A .X 关于Y 的弹性 B.X 变动一个绝对量时Y 变动的相对量 C .Y 关于X 的弹性 D.Y 变动一个绝对量时X 变动的相对量14.对于i i i e X Y ++=10ˆˆββ,以S 表示估计标准误差,iY ˆ表示回归值,则-------------------------------------------------------------------------------------------( )A .S=0时,0)ˆ(=-∑ti Y Y B.S=0时,∑==-ni i i Y Y 120)ˆ( C .S=0时,)ˆ(ii Y Y -∑为最小 D.S=0时,∑=-ni i i Y Y 12)ˆ(为最小 15.经济计量分析工作的基本工作步骤是-----------------------------( )A .设定理论模型→收集样本资料→估计模型参数→检验模型B .设定模型→估计参数→检验模型→应用模型C .理论分析→数据收集→计算模拟→修正模型D .确定模型导向→确定变量及方程式→应用模型16.产量(X ,台)与单位产品成本(Y ,元/台)之间的回归方程为:X Y5.1356ˆ-=,这说明-----------------------------------------------------------( )A .产量每增加一台,单位产品成本平均减少1.5个百分点B .产量每增加一台,单位产品成本减少1.5元C .产量每增加一台,单位产品成本减少1.5个百分点D .产量每增加一台,单位产品成本平均减少1.5元17.下列各回归方程中,哪一个必定是错误的------------------------( )A .8.02.030ˆ=+=XY i i r X Y B. 91.05.175ˆ=+-=XY i i r X Y C .78.01.25ˆ=-=XY ii r X Y D. 96.05.312ˆ-=--=XY ii r X Y18.用一组有28个观测值的样本估计模型i i i X Y μββ++=10后,在0.05的显著性水平下对1β的显著性作t 检验,则1β显著地不等于0的条件是统计量t 大于-------------------------------------------------------------------------------------( )A .t 0.025(28) B. t 0.05(28) C. t 0.025(26) D. t 0.05(26)19.下列哪种形式的序列相关可用DW 统计量来检验(V t 为具有零均值、常数方差,且不存在序列相关的随机变量)---------------------------------( )A .t t t V +=-1ρμμ B.t t t t V +⋅⋅⋅++=--121μρρμμ C. t t V ρμ= D. ⋅⋅⋅++=-12t t t V V ρρμ20.对于原模型t t t X Y μββ++=10,一阶差分模型是指------------( )A .)()()(1)(1t tt t t t t X f X f X X f X f Y μββ++=B .t t t X Y μβ∆+∆=∆1C .t t t X Y μββ∆+∆+=∆10D .)()()1(11101----+-+-=-t t t t t t X X Y Y ρμμρβρβρ四 多项选择题(每个2分,共10分)1.以Y 表示实际值,Y ˆ表示回归值,ie 表示残差项,最小二乘直线满足------------------------------------------------------------------------------------------( )A .通用样本均值点(Y X ,) B.ii Y Y ˆ∑=∑ C .0),ˆ(=i i ov e Y C D.0)ˆ(2=-∑i i Y Y E .0)ˆ(=-∑Y Y i2.剩余变差(RSS )是指--------------------------------------------------( )A .随机因素影响所引起的被解释变量的变差B .解释变量变动所引起的被解释变量的变差C .被解释变量的变差中,回归方程不能作出解释的部分D .被解释变量的总变差与解释变量之差E .被解释变量的实际值与回归值的离差平方和3. 对于经典线性回归模型,0LS 估计量具备------------------------( ) A .无偏性 B.线性特性 C.正确性 D.有效性 E.可知性4. 异方差的检验方法有---------------------------------------------------( ) A .残差的图形检验 B.游程检验 C.White 检验D.帕克检验E.方差膨胀因子检验5. 多重共线性的补救有---------------------------------------------------( ) A .从模型中删掉不重要的解释变量 B.获取额外的数据或者新的样本 C.重新考虑模型 D.利用先验信息 E. 广义差分法五 简答计算题(4题,共50分)1. 简述F 检验的意图及其与t 检验的关系。

2 经典线性回归模型I

第二章经典线性回归模型:估计、统计性质与统计检验•经典线性回归模型:假设与OLS估计•OLS估计的小样本性质与统计检验•OLS估计的大样本性质与统计检验§1.1 经典线性回归模型:假设与OLS估计一、经典线性回归模型二、经典线性回归模型的OLS估计E(Y|X)回归分析的基本逻辑:寻找样本回归线,并用样本回归线近似代表总体回归线问题:能否代表?需要通过检验来回答!(1) 对残差平方和SSR(b )= Σe t 2=e ’e =(Y -Xb )’(Y -Xb ) 1阶偏导: ∂SSR/∂b = -2X ’(Y-Xb )2阶偏导: ∂2SSR/∂b ∂b ’= 2X ’X由于X ’X 为正定矩阵(Why?), 从而b =(X ’X )-1(X ’Y )是最小值 由1阶极值条件可以得到所谓正规方程(normal equations ): X ’(Y-Y-XbXb )=X ’e =0 ⇔ Σt X tj e t =0 (j=1,2,…,k )当模型含有值恒为1的常数项时, Σe t =0正规方程是OLS 所特有的,而不论是否有E(εt |X )=02、OLS 估计的数值性质(4)一些有用的等式a. X’e=0b. b −β=(X’X)-1X’ε因为b=(X’X)-1X’Y=(X’X)-1X’(Xβ+ε)=β+(X’X)-1X’ε c. 定义n×n方阵:P P X=X(X’X)-1X’(投影矩阵),M X=I n−P X(消灭矩阵)则P=P X’, M M X=M X’XP X2=P X, M M X2=M XX=X, M X X=O n×(k+1)且PXd. e=M X Y=M XεSSR(b)=e’e=Y’M X Y=ε’M Xε二元回归的示例图赤池信息准则(Akaike information criterion, AIC, 1973) AIC=ln[e’e/n]+2(k+1)/n=goodness of fit + model complexityAIC= -2ln L/n +2(k+1)/n贝叶斯信息准则(Baysian information criterion, BIC)施瓦茨准则(Schwarz criterion,SC, 1978)BIC=ln[e’e/n]+(k+1)ln(n)/nBIC/SC= -2ln L/n+(k+1)ln(n)/n贝叶斯信息准则对多引入多余的解释变量给出了更重的惩罚。

计量经济学第3章 线性回归模型

计量经济学-第3章 线性回归模型

4

(3)等方差性:Var (i ) 2,i 1,2,, n ,因而

Var ( yi ) 2 , i 1,2,, n

(4)正态性:i ~ N (0, 2 ), i 1,2,, n ,因而

yi ~ N ( xi , 2 ), i 1,2,, n

上述四个条件可简化为: ij

1 lxx

n

xi

i 1

x E( yi )

1 n

lxx i1

xi x

(

xi

)

1 lxx

n i 1

xi x xi

1 lxx

lxx

E(ˆ)

2021/5/8

计量经济学-第3章 线性回归模型

14

E(ˆ ) E(Y ˆx )

1 n

n

E(

i 1

Yi )

E(ˆ ) x

1 n

n

i 1

i 1

i 1

2021/5/8

计量经济学-第3章 线性回归模型

21

n i 1

( yi

y)2

2 lxy lxx

lxy

(

lxy lxx

)2

lxx

n i 1

( yi

y)2

l

2 xy

lxx

n i 1

yi2

ny 2

l

2 xy

lxx

n i 1

yi2

n( 1 n

n i 1

yi )2

n

(

i 1

( xi

x)(yi lxx

y))2

n i 1

yi2 (

1 n

n i 1

yi )2

n

各种线性回归模型原理

各种线性回归模型原理线性回归是一种广泛应用于统计学和机器学习领域的方法,用于建立自变量和因变量之间线性关系的模型。

在这里,我将介绍一些常见的线性回归模型及其原理。

1. 简单线性回归模型(Simple Linear Regression)简单线性回归模型是最简单的线性回归模型,用来描述一个自变量和一个因变量之间的线性关系。

模型方程为:Y=α+βX+ε其中,Y是因变量,X是自变量,α是截距,β是斜率,ε是误差。

模型的目标是找到最优的α和β,使得模型的残差平方和最小。

这可以通过最小二乘法来实现,即求解最小化残差平方和的估计值。

2. 多元线性回归模型(Multiple Linear Regression)多元线性回归模型是简单线性回归模型的扩展,用来描述多个自变量和一个因变量之间的线性关系。

模型方程为:Y=α+β1X1+β2X2+...+βnXn+ε其中,Y是因变量,X1,X2,...,Xn是自变量,α是截距,β1,β2,...,βn是自变量的系数,ε是误差。

多元线性回归模型的参数估计同样可以通过最小二乘法来实现,找到使残差平方和最小的系数估计值。

3. 岭回归(Ridge Regression)岭回归是一种用于处理多重共线性问题的线性回归方法。

在多元线性回归中,如果自变量之间存在高度相关性,会导致参数估计不稳定性。

岭回归加入一个正则化项,通过调节正则化参数λ来调整模型的复杂度,从而降低模型的过拟合风险。

模型方程为:Y=α+β1X1+β2X2+...+βnXn+ε+λ∑βi^2其中,λ是正则化参数,∑βi^2是所有参数的平方和。

岭回归通过最小化残差平方和和正则化项之和来估计参数。

当λ=0时,岭回归变为多元线性回归,当λ→∞时,参数估计值将趋近于0。

4. Lasso回归(Lasso Regression)Lasso回归是另一种用于处理多重共线性问题的线性回归方法,与岭回归不同的是,Lasso回归使用L1正则化,可以使得一些参数估计为0,从而实现特征选择。

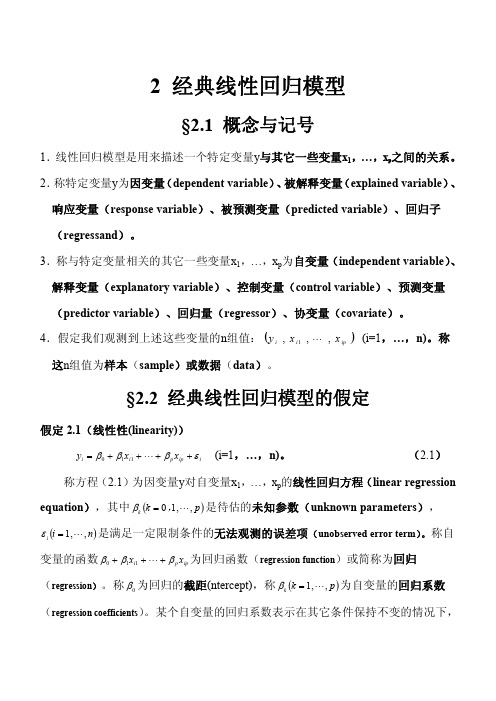

经典线性回归模型

·β的OLS估计量:在假定2.3成立时

( ) å å b =

XTX

-1 X T Y

= çæ 1 èn

n i=1

xi xiT

Hale Waihona Puke -1ö æ1 ÷ç ø èn

n i=1

xi yi

÷ö ø

( ) ·估计量的抽样误差(sampling error): b - b = X T X -1 X Te

·第i次观测的拟合值(fitted value): yˆi = xiTb

且自变量的回归系数和 y 与 x 的样本相关系数之间的关系为

b1 == corr(Y , X )

å( 1 n

n - 1 i=1

yi

- y)2

º r sy

å( ) 1 n

n - 1 i=1

xi - x 2

sx

·修正决定系数(adjusted coefficient of determination, adjusted R square)

4.假定我们观测到上述这些变量的n组值: (y i , x i1 , L , ) x ip (i=1,…,n)。称

这n组值为样本(sample)或数据(data)。

§2.2 经典线性回归模型的假定

假定 2.1(线性性(linearity))

yi = b0 + b1xi1 + L + b p xip + e i (i=1,…,n)。

( ) ( ) E ~x jei

çæ E x j1e i =ç M

÷ö ÷=0

(i=1,…,n ; j=1,…,n )。

( ) ç

è

E

x jp e i

÷ ø

·不相关条件(zerocorrelation conditions)

回归分析线性回归Logistic回归对数线性模型

逻辑回归的模型为 (P(Y=1) = frac{1}{1+e^{-z}}),其中 (z = beta_0 + beta_1X_1 + beta_2X_2 + ... + beta_nX_n)。

逻辑斯蒂函数

பைடு நூலகம்

定义

逻辑斯蒂函数是逻辑回归模型中用来描述自变量与因变量之 间关系的函数,其形式为 (f(x) = frac{1}{1+e^{-x}})。

。

在样本量较小的情况下, logistic回归的预测精度可能高 于线性回归。

线性回归的系数解释较为直观 ,而logistic回归的系数解释相 对较为复杂。

对数线性模型与其他模型的比较

对数线性模型假设因变量和自变量之间存在对 数关系,而其他模型的假设条件各不相同。

对数线性模型的解释性较强,可以用于探索自变量之 间的交互作用和效应大小。

THANKS

感谢您的观看

预测市场细分中的消费者行为等。

对数线性模型还可以用于探索性数据分析,以发现数 据中的模式和关联。

Part

04

比较与选择

线性回归与logistic回归的比较

线性回归适用于因变量和自变 量之间存在线性关系的场景, 而logistic回归适用于因变量为

二分类或多分类的场景。

线性回归的假设条件较为严格 ,要求因变量和自变量之间存 在严格的线性关系,而logistic 回归的假设条件相对较为宽松

最小二乘法

最小二乘法是一种数学优化技术,用于最小化预测值与实际观测值之间的平方误差总和。

通过最小二乘法,可以估计回归系数,使得预测值与实际观测值之间的差距最小化。

最小二乘法的数学公式为:最小化 Σ(Yi - (β0 + β1X1i + β2X2i + ...))^2,其中Yi是实际观 测值,X1i, X2i, ...是自变量的观测值。

各种线性回归模型原理

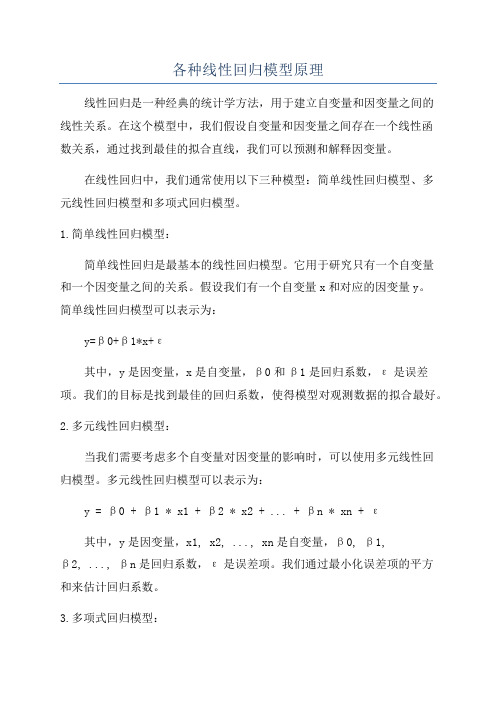

各种线性回归模型原理线性回归是一种经典的统计学方法,用于建立自变量和因变量之间的线性关系。

在这个模型中,我们假设自变量和因变量之间存在一个线性函数关系,通过找到最佳的拟合直线,我们可以预测和解释因变量。

在线性回归中,我们通常使用以下三种模型:简单线性回归模型、多元线性回归模型和多项式回归模型。

1.简单线性回归模型:简单线性回归是最基本的线性回归模型。

它用于研究只有一个自变量和一个因变量之间的关系。

假设我们有一个自变量x和对应的因变量y。

简单线性回归模型可以表示为:y=β0+β1*x+ε其中,y是因变量,x是自变量,β0和β1是回归系数,ε是误差项。

我们的目标是找到最佳的回归系数,使得模型对观测数据的拟合最好。

2.多元线性回归模型:当我们需要考虑多个自变量对因变量的影响时,可以使用多元线性回归模型。

多元线性回归模型可以表示为:y = β0 + β1 * x1 + β2 * x2 + ... + βn * xn + ε其中,y是因变量,x1, x2, ..., xn是自变量,β0, β1,β2, ..., βn是回归系数,ε是误差项。

我们通过最小化误差项的平方和来估计回归系数。

3.多项式回归模型:多项式回归模型是在线性回归模型的基础上引入了多项式项的扩展。

在一些情况下,自变量和因变量之间的关系可能不是简单的线性关系,而是复杂的曲线关系。

多项式回归模型可以通过引入自变量的高次幂来建立非线性关系。

例如,二阶多项式回归模型可以表示为:y=β0+β1*x+β2*x^2+ε我们可以使用最小二乘法来估计回归系数,从而找到最佳的拟合曲线。

在以上三种线性回归模型中,我们以最小二乘法作为求解回归系数的方法。

最小二乘法通过最小化观测值与模型拟合值之间的残差平方和来选择最佳的回归系数。

通过最小二乘法,我们可以得到回归系数的闭式解,即可以明确得到回归系数的数值。

除了最小二乘法,还有其他求解回归系数的方法,例如梯度下降法和正规方程法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

上述假设条件可用矩阵表示为以下四个条件:

16

A1. E(u)=0 A2. E (uu) 2 I n

由于

u1 u2 uu u1 u2 ... u n

2

u12 u1u2 ...... u1un 2 u2u1 u2 ...... u2un ... un ................................. 2 unu1 unu2 ...... un

第二章 经典线性 回归模型

(Classical Linear Regression Model)

第一节 线性回归模型的概念

第二节 线性回归模型的估计

第三节

拟合优度

第四节 非线性关系的处理 第五节 假设检验

第六节 预测

第七节 虚拟变量

第一节 线性回归模型的概念

一、 双变量线性回归模型 我们在上一章给出的需求函数的例子 Q =α+βP + u (2.1) 是一个双变量线性回归模型,模型中只有两个变量, 一个因变量,一个解释变量,由解释变量的变动来解 释因变量的变动,或者说用因变量对解释变量进行线 性回归,因而称为双变量线性回归模型,亦称简单线 性回归模型。

收入不变的情况下,价格指数每上升一个点, 食品消费支出减少7.39亿元(0.739个billion)

10

回到一般模型

Yt β 0 β 1 X 1t β 2 X 2t ... β k X kt u t

t=1,2,… ,n 即对于n组观测值,有

Y1 β 0 β 1 X 11 β 2 X 21 β 3 X 31 ... β K X K 1 u1 Y2 β 0 β 1 X 12 β 2 X 22 β 3 X 32 ... β K X K 2 u2 ...... Yn β 0 β 1 X 1n β 2 X 2 n β 3 X 3n ... β K X Kn un

27

最小二乘法就是选择一条直线,使其残差平方和 ˆ 达到最小值的方法。即选择 α和 ,使得

ˆ S et (Yt Yt ) 2

2

ˆ ˆ (Yt X t ) 2

达到最小值。

28

运用微积分知识,使上式达到最小值的必要条件为:

S S 0 ˆ ˆ

14

(3)E(ut2)=σ2, t=1,2,…,n 即各期扰动项的方差是一常数,也就是假定各 扰动项具有同方差性。 这是因为: Var(ut)=E{[ut-E(ut)]2}= E(ut2) ——根据假设(1)

15

(4)Xjt是非随机量, j=1,2, … k

t=1,2, … n

(5)(K+1)< n; 即观测值的数目要大于待估计的参数的个数 (要有足够数量的数据来拟合回归线)。

t=1,2,…,n 在这个模型中,Y由X1、X2、X3、… XK所解释, 有K+1个未知参数β 0、β 1、β 2、…β K 。

这里,“斜率”β j 的含义是 其它变量不变的情况 下,Xj改变一个单位对因变量所产生的影响,也称为 偏回归系数。 8

Yt β 0 β 1 X 1t β 2 X 2t ... β k X k身高与子辈身高之间关系的研 究 1889年F.Gallton和他的学生、现代统计学的奠基者 之一K.Pearson(1856-1911)收集了1078个家庭的身

高、臂长和腿长的记录。企图寻找出儿子身高与父亲身高 之间关系的具体表现形式。在观看散点图时,发现近乎于 一条直线。计算出的回归直线方程为:

23

(二)最小二乘原理 1. 一元线性回归模型的最小二乘估计 我们的任务是, 在给定X和Y的一组观测值 (X1, Y1), (X2, Y2) , ..., (Xn, Yn) 的情况下, 如何 求出

Yt = + Xt + ut 中 和 的估计值,使得拟 合的直线为最佳。 直观上看,也就是要求在X和Y的散点图上穿过 各观测点画出一条“最佳”直线,如下图所示。

即

S ˆ ˆ 2(1)(Yt X t ) 0 ˆ S ˆ ˆ 2( X t )(Yt X t ) 0 ˆ

模型的良好性质只有在大样本下才能 得到理论上的证明

19

二、最小二乘估计

(一)关于最小二乘法的历史回顾 最小二乘法最早称为回归分析法。由著名的英国 生物学家、统计学家道尔顿(F.Gallton,1822-1911) 。早年,道尔顿致力于化学和遗传学领域的研究。道 尔顿研究英国男子中父亲们的身高与儿子们的身高之 间的关系时,创立了回归分析法。

(6) 两 条

满足条件(A1)—(A4)的线性回归模型称为经 典线性回归模型或古典线性回归模型(CLR模型)。 当然,为了后面区间估计和假设检验的需要,还 要加上一条:

A5.各期扰动项服从正态分布。

u t ~ N (0, 2 )

,t=1,2,…n

18

满足基本要求的样本容量

从统计检验的角度: n30 时,Z检验才能应用; n-k8时, t分布较为稳定 一般经验认为: 当n30或者至少n3(k+1)时,才能说满足 模型估计的基本要求。

11

其矩阵形式为: Y X u

其中

Y1 Y2 Y ... Y n

1 X 11 1 X 12 X ... ... 1 X 1n

... X K 1 ... X K 2 ... ... ... X Kn

显然, E (uu) I n 仅当 E(ui uj)=0 , i≠j E(ut2) = σ2, t=1,2,…,n 这两个条件成立时才成立,因此, 此条件相当前面条件 (2), (3)两条,即各期扰动项互不相关,并具有常数方差。 17

A3. X 是一个非随机元素矩阵。

A4. Rank(X) = (K+1) < n. ------相当于前面 (5) 即矩阵X的秩 =(K+1)< n

0 u1 1 , u u2 2 ... ... u n K

12

第二节 线性回归模型的估计

一、经典线性回归模型的统计假设

(1)E(ut)=0,

t=1,2,…,n 即各期扰动项的均值(期望值)均为0。均值为 0的假设反映了这样一个事实:扰动项被假定为对 因变量的那些不能列为模型主要部分的微小影响。 没有理由相信这样一些影响会以一种系统的方式使 因变量增加或减小。因此扰动项均值为0的假设是 合理的。

让我们再看一个例子。 C =α+βD + u (2.2) 这是凯恩斯消费函数,其中C为消费支出,D为 个人可支配收入,u为扰动项(或误差项)。 此模型中,方程左端的消费支出(C)为因变 量(或被解释变量),方程右端的个人可支配收入 (D)为解释变量(或自变量)。α和β是未知参数, 由于双变量线性回归模型的图形是一条直线,因而 α和β习惯上又分别称为截距和斜率。

4

这里斜率β的含义是解释变量增加一个单位所引起 的因变量的变动。例如在(2.2)式中,β的含义是个人可 支配收入增加一个单位所引起的消费的增加量,经济 学中称之为边际消费倾向(MPC)。截距α的含义是 解释变量为0时α的值。截距α有时有经济含义,但大 多数情况下没有,因此,在计量经济分析中,通常不 大关注α的取值如何。

13

(2)E(ui uj)=0, i≠j 即各期扰动项互不相关。也就是假定它们之间无 自相关或无序列相关。 实际上该假设等同于: cov( ui, uj) = 0, i≠j 这是因为: cov(ui, uj) = E{[ui - E(ui)][uj - E(uj)]} = E(uiuj) ——根据假设(1)

例2.2

食品需求方程

Y β 0 β 1 X β 2 P u

其中,Y=在食品上的总支出 X=个人可支配收入 P=食品价格指数 用美国1959-1983年的数据,得到如下回归结果(括号中数 字为标准误差):

ˆ Y 116.7 0.112 X 0.739 P (9.6) (0.003) (0.114)

它表明,对于n个时期t =1,2,…,n,该模型成立。

6

更一般的形式为:

Yi xi ui

i 1,2,...,n

(2.4)

即模型对X和Y的n对观测值(i=1,2,…,n)成立。 (2.3)式一般用于观测值为时间序列的情形,在横 截面数据的情形,通常采用(2.4) 式。

7

二、 多元线性回归模型 在许多实际问题中,我们所研究的因变量的变动 可能不仅与一个解释变量有关。因此,有必要考虑 线性模型的更一般形式,即多元线性回归模型:

5

在教学中,我们习惯上采用Y表示因变量,X表示 解释变量,双变量线性回归模型的一般形式为: Y =α+βX + u 在实践中,此模型被应用于因变量和解释变量的一组 具体观测值 Yt 和 x t(t=1,2,…,n),因而模型表示为 :

Yt xt ut

t 1,2,...,n

(2.3)

22

这个例子生动地说明了生物学中“种”的概念 的稳定性。正是为了描述这种有趣的现象, Galton引进了“回归”这个名词来描述父辈身高x 与子代身高y的关系。 尽管“回归”这个名称的由来具有特定的含义 ,人们在研究大量的问题中变量x与y之间的关系 并不具有这种“回归”的含义,但借用这个名词 把研究变量x与y之间统计关系的数学方法称为“ 回归”分析。

第二部分,et 代表观测点对于回归线的误差,称 为拟合或预测的残差 (residuals):

ˆ et Yt Yt

即

t=1,2,……,n t=1,2,……,n