第四章 约束非线性优化的理论与方法

非线性约束最优化

⾮线性约束最优化CanChen ggchen@讲完了⼆次线性规划,这节课主要是讲了⼀般的⾮线性约束最优化怎么解。

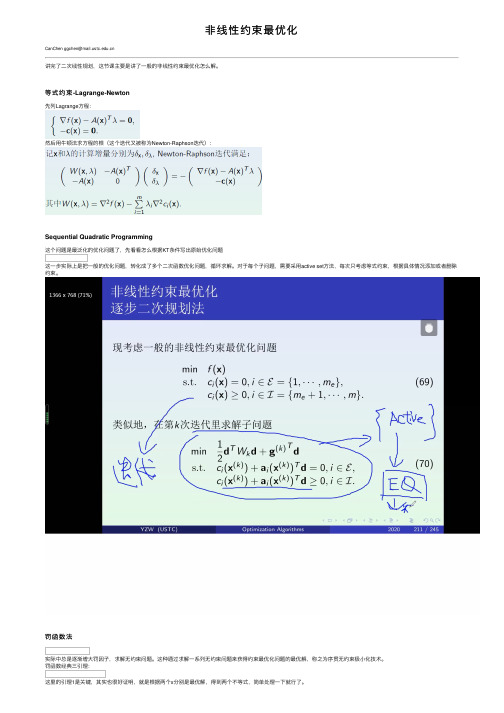

等式约束-Lagrange-Newton先列Lagrange⽅程:然后⽤⽜顿法求⽅程的根(这个迭代⼜被称为Newton-Raphson迭代):Sequential Quadratic Programming这个问题是最泛化的优化问题了,先看看怎么根据KT条件写出原始优化问题这⼀步实际上是把⼀般的优化问题,转化成了多个⼆次函数优化问题,循环求解。

对于每个⼦问题,需要采⽤active set⽅法,每次只考虑等式约束,根据具体情况添加或者删除约束。

罚函数法实际中总是逐渐增⼤罚因⼦,求解⽆约束问题。

这种通过求解⼀系列⽆约束问题来获得约束最优化问题的最优解,称之为序贯⽆约束极⼩化技术。

罚函数经典三引理:这⾥的引理1是关键,其实也很好证明,就是根据两个x分别是最优解,得到两个不等式,简单处理⼀下就⾏了。

三个引理刻画了罚函数法动态变化的过程。

其中,第三个引理就是说,我迭代到⼀步,不想迭代了,这个时候实际上得到的解是把定义域扩⼤了之后的解。

乘⼦罚函数这⾥实际上就是⽬标函数,加朗格朗⽇项,加罚项。

使⽤罚函数,必须要求罚因⼦趋于⽆穷⼤,然⽽这在实际中很难办到。

这⾥引⼊朗格朗⽇项,让罚因⼦不⽤趋于⽆穷,就能得到结果。

本质是就是将乘⼦罚函数在迭代中寻找和拉格朗⽇函数的关系,从⽽将带约束问题转化为⽆约束问题。

这⾥给出了带约束问题的⼆阶充分条件,⾮常⽜逼,之前只是必要条件。

障碍函数法这个实际上通过⽆限限制边界,将有约束问题转化为⽆约束问题。

内点法这个实际上是改变互补松弛条件,sz=u>0, 所以s>0,所以⼀定是内点。

本质上还是在求解KT系统,把不等式改造成等式,还在内部,这个⽐较野蛮。

后⾯凸优化就是⼲这个。

障碍函数法和内点法本质是⼀样的。

第四章约束问题的最优化方法

当limr(k) 0 k

则(x, r(k) ) f (x) , xk * x *

例: 用内点法求

min

f

(x)

x2 1

x2 2

s.t. g( x) 1 x1 0 的约束最优解。

解:

首先构造内点惩罚函数: (

x,

r)

x2 1

x2 2

rk

ln(x1

1)

用解析法求函数的极小值,运用极值条件:

二. 直接解法:

基本思想:合理选择初始点,确定搜索方向,以迭代公式 x(k+1)= x(k)+α(k)S(k)在可行域中寻优,经过若干次迭代,收敛至最优点。 适用范围:只能求解不等式约束优化问题的最优解。

基本要点:选取初始点、确定搜索方向及适当步长。

搜索原则:每次产生的迭代点必须满足可行性与适用性两个条件。 可行性:迭代点必须在约束条件所限制的可行域内,即满足

1

u1 gu (x)

② .(x, r(k) )

m

f (x) r(k)

1

u1 gu (x)

③ .(x, r (k) )

f (x)

m

r (k) u u 1

1 gu (x)

其中:gu (x) 0,u 1,2,...m

其中:gu (x) 0,u 1,2,...m

gu(x)0, u=1,2,…,p

适用性:当前迭代点的目标函数值较前一点是下降的,即满足 F(xk+1)<F(xk)

收敛条件:

• 边界点的收敛条件应该符合 K-T 条件;

• 内点的收敛条件为: xk1 xk 1

和

第四章 约束非线性优化的理论与方法讲解

1) 下降方向的选择 如果方向P在点x0处是下降方向,则P应与-f (x0)同侧, 即: T f ( x ) P 0

0

T F { P f ( x0 ) P 0} 为点x0处的下降方向集。 记 0

2) 可行方向的选择 在x0处的可行方向应满足:

gi ( x0 P ) 0, i 1,2,, m hj ( x0 P ) 0, j 1,2,, p

注1 注2

g1 ( x0 ),, gm ( x0 ) 是x0处法空间的一组基。

方程组

的一组线 g i ( x0 , h) 0, i 1,2, , m 性无关的解构成曲面S上x0处切空间的一组基。 min f (x,y) S.t. g (x,y)=0 0,则f (x0,y0)与g (x0,y0)

j

g i ( x 0 ) h j 0, i 1,2, , m x j g m ( x 0 ) x1 g1 ( x 0 ), g m ( x 0 ) g m ( x 0 ) x n

系数矩阵

满秩,则称x0为曲面S上的一个正规点。

m in f ( x ) S x g ( x ) 0, h ( x ) 0, i 1, , m; j 1, , p i j

n f ( x ) x1 x2 S x x1 x 2 1 0,1 x1 0,1 x 2 0

2,具等式约束问题的极值必要条件 考虑二维问题:

结论1:若在极小点(x0,y0)处,g (x0,y0)

线性相关,即f (x0,y0) + g (x0,y0)=0。

结论2:(Lagrange乘子规则)设(x0,y0)是局部极小点,且g (x0,y0)

非线性规划理论和算法

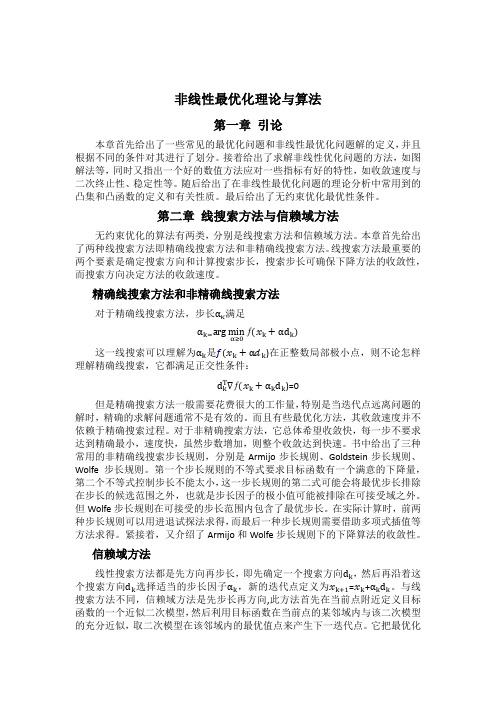

非线性最优化理论与算法第一章引论本章首先给出了一些常见的最优化问题和非线性最优化问题解的定义,并且根据不同的条件对其进行了划分。

接着给出了求解非线性优化问题的方法,如图解法等,同时又指出一个好的数值方法应对一些指标有好的特性,如收敛速度与二次终止性、稳定性等。

随后给出了在非线性最优化问题的理论分析中常用到的凸集和凸函数的定义和有关性质。

最后给出了无约束优化最优性条件。

第二章线搜索方法与信赖域方法无约束优化的算法有两类,分别是线搜索方法和信赖域方法。

本章首先给出了两种线搜索方法即精确线搜索方法和非精确线搜索方法。

线搜索方法最重要的两个要素是确定搜索方向和计算搜索步长,搜索步长可确保下降方法的收敛性,而搜索方向决定方法的收敛速度。

精确线搜索方法和非精确线搜索方法对于精确线搜索方法,步长ακ满足αk=arg minƒx k+αd kα≥0这一线搜索可以理解为αk是f(x k+αd k)在正整数局部极小点,则不论怎样理解精确线搜索,它都满足正交性条件:d k T∇ƒ(x k+αk d k)=0但是精确搜索方法一般需要花费很大的工作量,特别是当迭代点远离问题的解时,精确的求解问题通常不是有效的。

而且有些最优化方法,其收敛速度并不依赖于精确搜索过程。

对于非精确搜索方法,它总体希望收敛快,每一步不要求达到精确最小,速度快,虽然步数增加,则整个收敛达到快速。

书中给出了三种常用的非精确线搜索步长规则,分别是Armijo步长规则、Goldstein步长规则、Wolfe步长规则。

第一个步长规则的不等式要求目标函数有一个满意的下降量,第二个不等式控制步长不能太小,这一步长规则的第二式可能会将最优步长排除在步长的候选范围之外,也就是步长因子的极小值可能被排除在可接受域之外。

但Wolfe步长规则在可接受的步长范围内包含了最优步长。

在实际计算时,前两种步长规则可以用进退试探法求得,而最后一种步长规则需要借助多项式插值等方法求得。

非线性优化与约束优化问题的求解方法

非线性优化与约束优化问题的求解方法非线性优化问题是在目标函数和约束条件中包含非线性项的优化问题。

约束优化问题是在目标函数中加入了一些约束条件的优化问题。

解决这些问题在实际应用中具有重要意义,因此研究非线性优化和约束优化问题的求解方法具有重要的理论和实际意义。

一、非线性优化问题的求解方法非线性优化问题的求解方法有很多,下面介绍几种常见的方法:1. 黄金分割法:黄金分割法是一种简单但有效的搜索方法,它通过不断缩小搜索范围来逼近最优解。

该方法适用于目标函数单峰且连续的情况。

2. 牛顿法:牛顿法利用目标函数的一阶和二阶导数信息来逼近最优解。

该方法收敛速度较快,但在计算高阶导数或者初始点选取不当时可能产生不稳定的结果。

3. 拟牛顿法:拟牛顿法是对牛顿法的改进,它通过逼近目标函数的Hessian矩阵来加快收敛速度。

拟牛顿法可以通过不同的更新策略来选择Broyden-Fletcher-Goldfarb-Shanno(BFGS)方法或者DFP方法。

4. 全局优化方法:全局优化方法适用于非凸优化问题,它通过遍历搜索空间来寻找全局最优解。

全局优化方法包括遗传算法、粒子群优化等。

二、约束优化问题的求解方法约束优化问题的求解方法也有很多,下面介绍几种常见的方法:1. 等式约束问题的拉格朗日乘子法:等式约束问题可以通过引入拉格朗日乘子来转化为无约束优化问题。

通过求解无约束优化问题的驻点,求得原始约束优化问题的解。

2. 不等式约束问题的罚函数法:不等式约束问题可以通过引入罚函数来转化为无约束优化问题。

罚函数法通过将违反约束条件的点处添加罚项,将约束优化问题转化为无约束问题。

3. 逐次二次规划法:逐次二次规划法是一种常用的求解约束优化问题的方法。

该方法通过依次处理逐个约束来逼近最优解,每次处理都会得到一个更小的问题,直至满足所有约束条件。

4. 内点法:内点法是一种有效的求解约束优化问题的方法。

该方法通过向可行域内部逼近,在整个迭代过程中都保持在可行域内部,从而避免了外点法需要不断向可行域逼近的过程。

第四章 约束非线性优化

m * 0 f ( x * ) i*ci ( x * ) 0, i 1 *c ( x * ) 0, * 0, i 1, 2, ..., m; * 0. i 0 i i

f ( x* d ) f ( x* ) 且 ci ( x * d ) 0

对于0 = 都成立,这与已知x*为局部极小矛盾.

最优化方法之约束非线性规划 怀化学院数学系

最优性条件

定理4.1( Fritz John一阶必要条件)

设x*为(1)的局部极小点且f ( x ), ci ( x )(1 i m )在点x*可微,

i 1 m

最优化方法之约束非线性规划

怀化学院数学系

最优性条件

Gordan引理的几何意义为:

不存在向量d 使aiT d 0( i 1, ..., m ),是指向量a1 , a2 , ..., am不同时

处于过原点的任何超平面的同一侧.

这时,总可以适当放大或缩小各向量的长度,使变化后 各向量的组合为零向量. 引理4.3(几何最优性条件) 在问题(1)中,假定x*为(1)的局部

% % 不等式约束ci ( x ) 0为x的有效约束;反之,若有ci ( x ) 0, % % 则称不等式约束ci ( x ) 0为x的非有效约束.称所有在x处的 有效约束的下标组成的集合

% % I ( x ) {i | ci ( x ) 0} {1, 2, ..., m}

% % 为x处的有效约束指标集, 简称x处的有效集. 在讨论两个重要引理前先给出凸锥的定义. 定义4.2 设非空集合C Rn , 某一点x C .对d Rn和t 0, 当x d C时,必有x td C , 则称C为以x为顶点的锥.当C

非线性优化理论及算法

非线性优化理论及算法随着人工智能、大数据、云计算等技术的快速发展,非线性优化理论及算法逐渐成为研究的热点。

非线性优化是指在满足一定限制条件的情况下,将目标函数最优化的问题,通常具有多个局部最优解,需要通过算法求解全局最优解。

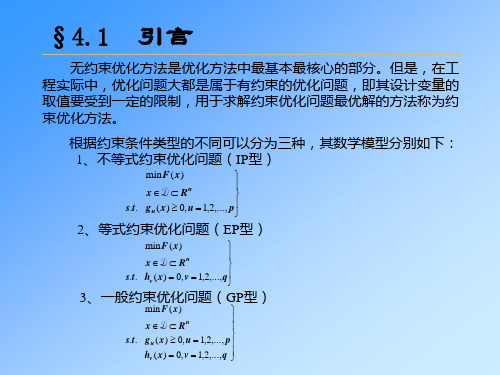

一、非线性优化理论1.1 优化问题的数学形式非线性优化问题的数学形式可以表示为:$$\min_{\boldsymbol{x} \in \mathcal{S}} f(\boldsymbol{x})$$其中,$\boldsymbol{x}$ 是决策变量向量,$\mathcal{S}$ 是定义域,$f(\boldsymbol{x})$ 是目标函数。

1.2 优化问题的分类根据优化问题的约束条件,可以将其分类为以下几种:1)无约束优化问题:没有约束条件,即 $\mathcal{S} =\mathbb{R}^n$;2)等式约束优化问题:存在等式约束条件,即 $\mathcal{S} = \{\boldsymbol{x} \in \mathbb{R}^n \, | \, g_i(\boldsymbol{x}) = 0, \, i = 1, \ldots, l\}$;3)不等式约束优化问题:存在不等式约束条件,即$\mathcal{S} = \{\boldsymbol{x} \in \mathbb{R}^n \, | \,h_i(\boldsymbol{x}) \leq 0, \, i = 1, \ldots, m\}$。

1.3 最优解的性质对于一般的非线性优化问题,其最优解可能具有以下几种性质:1)局部最优解:在解空间中,存在一个局部范围内的最优解,但不一定是全局最优解;2)全局最优解:在解空间中,存在一个全局最优解,但不一定是唯一的;3)不可行解:在优化问题的约束条件下,不存在满足条件的解。

1.4 梯度和海森矩阵梯度和海森矩阵是非线性优化中常用的两个概念。

梯度是目标函数的导数,表示了函数在某个点处增长最快的方向,可用于确定优化问题的搜索方向。

非线性多目标优化问题求解

非线性多目标优化问题求解【导言】非线性多目标优化问题是指在实际应用中,存在多个决策目标且它们之间相互制约、相互影响,不是简单的线性关系。

如何快速有效地求解非线性多目标优化问题是近些年来研究的热点之一。

本文将重点介绍非线性多目标优化问题的求解方法。

【第一章】非线性多目标优化问题的概念和分类非线性多目标优化问题是指一类具有多个目标函数、多个自变量以及多个约束条件的优化问题,目标函数与约束条件都含有非线性关系。

可转化为多个标量优化问题求解,或直接求解多目标优化问题。

根据约束条件是否存在,可将非线性多目标优化问题分类为无约束的和有约束的。

而根据解的情况,可将非线性多目标优化问题分类为全局最优解、局部最优解和帕累托最优解。

【第二章】传统方法求解非线性多目标优化问题在传统方法中,常用的包括遗传算法、模拟退火算法、蚁群算法、粒子群算法和差分进化算法等。

遗传算法是一种基于生物学进化思想的优化算法,其核心思想是利用自然选择、交叉和变异等基本遗传操作来搜索最优解。

模拟退火算法则是一种模拟物理系统的退火过程的优化算法,其主要思想是在搜索过程中,通过引入随机扰动,逐步降低温度以实现全局搜索。

蚁群算法模仿蚂蚁搜索食物的行为,在寻找最优解的过程中,蚂蚁在解空间内设置路径,寻找最优路径索引物质。

粒子群算法也是一种基于个体群体适应度的智能优化算法,其主要思想是通过模拟群体中个体行动、合作及竞争等过程,来找寻最优解。

差分进化算法利用向量差分更新种群中的个体,不断调整自适应常数,迭代解空间,淘汰低适应度的个体,以实现全局搜索。

不同的算法在不同的问题中表现效果也不尽相同,通过不断实验和改进来适应不同的应用场景。

【第三章】多目标进化算法求解非线性多目标优化问题随着优化算法的不断发展和应用,多目标进化算法(MOEA)已经成为非线性多目标优化问题求解的一个主流方法。

多目标进化算法最早起源于1994年,伴随着重要性采样、拥挤距离、局部搜索等部分技术的出现,使得多目标进化算法在解决约束和非线性非凸优化问题方面具有了更为广泛的适用场景。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

h( x) x1 x2 6 0.

f

解:

(

x

)

(2

x1,1)T ,g1(

2x1 1

x) (1,0)T

21 x2 1

, g2 0,

(

x

)

(

2

x1

,2

x2

)T

,

h1

(

x

)

(1,1)

;

K T条件为

1 22 x2 1 0,

x* (1,0)T 是 最 优 点 , 起 作 用 约 束I ( x*) {1,3},f ( x*) (1,0)T

g1( x*) (0,1)T , g3 ( x*) (0,1)T , 显 然 找 不 到1 , 3 0, 使 f ( x*) 1g1( x*) 5g3 ( x*)成 立 。

F(x0)= f (x0) + g (x0)=0.

若 F ( x0 , h) hT 2F ( x0 )h 0, h 0

gi ( x0; h) 0, i 1,2,, m

则x0是局部极小点。 二,具不等式约束的问题

1,下降方向和可行方向

考虑一般非线性约束优化问题:

满足:

f

(

x

)

m

i 1

1 ,m T ;

p

i gi ( x ) jhj ( x

j1

1 )

,,

0

ቤተ መጻሕፍቲ ባይዱ

p

T

i gi ( x ) 0, i 0, i 1,, m

称上式为K-T条件,满足上式的点称K-T点。

40

5

3), x~* (3 13,2)T , ~* 0, ~* 13 , ~*g( x~* ) 0, I( x~* ) .

26

例2:

g1

(

x

)

x1

min f 1 0,

(x) g2( x)

x12 x2 , x12

x

2 2

26

0,

L( x, , ) f ( x) T g( x) T h( x) 的鞍点。

定理5 :若 ( x, , ) 是鞍点,则 x 是原问题的整体最优解,

但逆一般不成立。

例

考虑非线性规划问题:min

f (x)

x12

x

2 2

h( x) x2 0.

3 x2 ,

结论2:(Lagrange乘子规则)设(x0,y0)是局部极小点,且g (x0,y0)

0,则存在常数 ,对函数F (x0,y0)= f (x0,y0)+ g (x0,y0),满足 F(x0,y0)= f (x0,y0) + g (x0,y0)=0.

结论3(充分条件):设点x0满足必要条件:

相应的广义Lagrange函数为:

m

p

L( x,, ) f ( x) i gi ( x) jhj ( x)

i 1

j 1

例1:验证以下问题在最优解处K-T条件成立。

min f ( x) x1 g( x) 16 ( x1 4)2 x22 0

极小点为x*=(2,2)T,极小值为8,令

L( x1 x2 , )

x12

x

2 2

( x1

x2

4)

( ) min{x12 x22 ( x1 x2 4), x1 , x2 0}

min{ x1 0

x12

x1 }

m x2

in{

0

x

2 2

x2 }

4

因此

( )

2 4 ,当

2

4 ,当 0.

0,

对偶问题:max { 0

2

2

4 }

最优点*= 4,最大值 (*)=8。

1)对偶定理

定理1(弱对偶定理)若x 是原问题(1)的可行解, 而(,)是对偶问题(2)的可行解,则

第四章 约束非线性优化的理论与方法

一,等式约束问题

1,切向量与正规性

定义1 设x0 是由方程组gi(x)=0, i=1,2, …,m,确定的曲面 S上的一点,若在S上存在曲线x(t),x(0)= x0,x’(0)=h,

则称向量是曲面S上点x0处的切向量。 定义2:如果关于h 的线性方程组:

系数矩阵

gi ( x0 , h)

h( x) ( x1 3)2 ( x2 2)2 13 0

解: 1),

x*

(0,0)T

, *

1

,*

0, * g( x* )

0,

I ( x* )

1;

8

2), x* (6.4,3.2)T , * 3 , * 1 , *g( x* ) 0, I( x* ) 1;

j

gi ( x0 x j

) h

j

0, i

1,2,, m

g1 ( x0 ) gm ( x0 )

x1

x1

g1 ( x0 ),gm ( x0 )

g1 ( x0 )

xn

gm ( x0 )

xn

满秩,则称x0为曲面S上的一个正规点。 注1 g1 ( x0 ),, gm ( x0 ) 是x0处法空间的一组基。 注2 方程组 gi ( x0 , h) 0, i 1,2,, m 的一组线

min f ( x)

S x gi ( x) 0, hj ( x) 0, i 1,, m; j 1,, p

例:求解 S

min f ( x) x12 x22 x x1 x2 1 0,1 x1 0,1 x2 0

1) 下降方向的选择

1( x1 1) 0, 2 (26 x12 x22 ) 0,

12

2.2 0.1或

1 0 2 3 8

1 0 1 11 4

x* (1,5)T f ( x*) 4

1 0, 2 0.

定理3 设x*是一个可行点,若存在使K-T条件成立,并且对应

(1)

min f (x) x h(x) 0, g(x) 0

题对偶问(2)

(

,

)

max (, ) min L( x,,

x

),

0

例 考虑问题

min

f ( x)

x12

x

2 2

,

h( x ) x1 x2 4 0, x1 , x2 0.

0

结论1:若 x0 S 所有方向P都是可行的。

结论2:若 x0 S 当 PTgi (x0) 0,i I(x0) {i gi (x0) 0} 时

则P为可行方向。

记 G0 {P T gi ( x0 ) P 0, i I ( x0 )} 为可行方

向集。

注:对等式约束而言,所有约束都是起作用约束。

i 1

( k 1) max{0, ( k ) L( x ( k ) , ( k ) )}

其中为某个取定的步长,迭代过程中逐步缩小,每次迭代需

计算两迭代点之间的距离,如距离减小 被接受,否则缩小,

最后当两点距离充分小时,迭代终止。

4,对偶问题

原问题:x S

i 1

的一个可行点,并且前t个约束为起作用约束,则x*为最

优解的一个必要条件是下式成立:

t

f ( x*)

iai , i 0

i 1

例:考虑问题

g1

(

x

)

min f (1

(x) x1)3

x1 , x2

0,

g2( x) x1 0, g3 ( x) x2 0

注 可验证x*=(0,0)T是问题的极小点(在x*是处,取* =-3,则

K-T条件成立)。

下证其Lagrange函数 L( x, , ) x12 x22 3 x2 x2

没有鞍点。

反证法 ,假设鞍点 ( x, ) 存在,由定理5知, x 必为问题的

最优解,故 x x* (0,0)T , 由鞍点定义,对所有的x与, 有

定理4: 凸规划问题的可行K-T点必为最优解。

3,Lagrange函数的鞍点

定义1:如果对 x Rn , ( 0) Rm , R p

有 L( x, , ) L( x, , ) L( x, , )

则称点 ( x, , ) 是Lagrange函数:

从上例看出,满足定理1还需增加一些约束规范,如梯度向量

线性无关等,上例有 g1 ( x*) g3 ( x*)

更一般的有:

定理2(Kuhn-Tucker)最优性必要条件:

在最优点x*处,设 gi ( x ),i I( x );hj ( x ), j 1,, p

线性无关,则存在

2,最优性条件

定义1:若对xC和0,有 xC ,则称C为锥,如果C是

凸的,则称其为凸锥。

定义2:设是约束集,称 D {P P 0, x0 P S, 0,