视听觉信息的认知计算

《十天学会智能车》第一讲:什么是智能车

第一讲:什么是智能车一、概述各位读者朋友们大家好,我是宇智波科技的JSIR(一个奇怪的来自好友的称呼),在接下来的几部教程里,将由我来为各位小伙伴们带来智能车的各种入门必备的干货知识。

我本人于2017年硕士毕业于中国海洋大学,无论是在校还是工作后,还依然从事着当初学习的嵌入式行业,于2012年、2013年、2014年参与恩智浦杯全国智能车大赛。

之后,由于一些机缘巧合,我有幸参与了多个高校的智能车培训活动。

在与学弟学妹们的交流中,我感慨良多,尤其是和他人分享和交流自己的知识,帮助嵌入式爱好者提升技术水平的过程中,让我感受到作为一名分享者的快乐。

于是,我在2018年创立了宇智波电子科技有限公司,专门致力于科技创新教育,希望让我们的付出,能够为嵌入式爱好者们带来帮助,传播快乐和创新、创意的灵感。

我们这一代的许多人,学习嵌入式的过程中都拜读过郭天祥老师的51单片机课程,对我们入门单片机和嵌入式设计有着巨大的帮助(在此对郭老师表达诚挚的谢意)。

有那么一天,我的一位在大学任教的好友问我说,何不做一个系列教程,为学习智能车的孩子理清思路,指明方向呢?我听过后觉得这个主意很好啊,说干就干,于是就有了今天的系列教程,今后我们会在文字版教程的基础上,结合车友们的痛点,陆续推出视频系列教程,敬请期待。

也许有的小伙伴会对我们的公司名称感到了兴趣,又看到logo,突然觉得仿佛发现了什么,如果是这样,当你登陆我们的淘宝企业网店时,也许会对漂浮着的祥云颇有感触哦,我们的领域会涉及到高校各种竞赛(智能车、电赛、水下航行器等),以一种更有趣的方式传播知识。

在成文的过程中,如有错误之处,还请大家批评指正,我的联系方式是:Jsir@。

二、智能车的发展例程在这一章节中,我们很荣幸的请到了母校的綦声波老师(参见卓老师公众号“十年磨一剑”的相关文章),为大家讲解智能车的发展例程(资历最老的智能车带队老师之一)。

大家好,我是中国海洋大学的綦声波。

视听觉信息处理与认知研究

视听觉信息处理与认知研究第一章引言视听觉信息处理与认知研究是一门专业性强的学科,它主要关注人类的感知机制和认知过程以及它们与视听觉信息的交互关系。

本文将从不同角度对这一领域进行探讨,包括信息处理的基本原理、感知过程的神经机制、大脑认知与视听觉信息的关系以及应用领域的发展趋势。

第二章信息处理的基本原理视听觉信息处理是指将视听信号转化为有意义的认知信息的过程。

信息处理的基本原理包括感知、编码、存储和检索。

感知是感受外界刺激并将其转化为神经信号的过程,包括视觉感知和听觉感知。

编码是将感知到的信息转化为神经活动模式的过程,包括编码规则和编码模型。

存储是将信息储存到记忆系统中的过程,包括短时记忆和长时记忆。

检索是从记忆系统中提取信息的过程,包括记忆检索和注意力控制。

第三章感知过程的神经机制感知过程的神经机制是视听觉信息处理与认知研究的核心内容之一。

视觉感知神经机制主要包括感光细胞对光信号的感知、视网膜与脑内视觉核团的信息传递、大脑皮层对视觉信息的处理等。

听觉感知神经机制主要包括耳蜗对声音的感知、听觉神经传递声音信号、大脑皮层对听觉信息的处理等。

神经机制的研究有助于深入了解感知过程的生理学基础,从而进一步探索视听觉信息的认知过程。

第四章大脑认知与视听觉信息的关系大脑是人类视听觉信息处理与认知的中心,同时也是感知和认知之间的桥梁。

研究表明,感知和认知是相互依存的。

大脑皮层在视听觉信息的感知过程中起到重要作用,包括大脑皮层的特异性区域与视听觉感知功能的联系、大脑皮层的联合处理以及大脑皮层与其他脑区的功能连接等。

此外,大脑结构与认知能力之间也存在着一定的联系。

通过研究大脑认知与视听觉信息的关系,可以更好地理解人类的感知认知过程。

第五章应用领域的发展趋势视听觉信息处理与认知研究在科学研究和应用领域具有广阔的前景。

在科学研究方面,对视听觉信息处理与认知的深入研究可以为神经科学、认知心理学、人工智能等领域的发展提供理论支持和实际应用。

车辆工程系列讲座有感

车辆工程系列讲座有感本学期学院为了开阔我们的视野,再次为我们即将毕业的学生开设了车辆工程专业系列讲座的课程。

一共由7位老师为我们带来了五大方面的启发课程。

其中有些知识是我从未了解过的,有些是已经了解过的,但是听了老师们的讲解后,还是有很深的启发。

下面我将主要从这五大方面简单谈谈我的收获。

在用车尾气排放检测:简易工况法——由刘昭度老师为我们讲解了我国在用车辆是如何进行尾气排放检测的,原来从未深入了解尾气排放检测的方法,听了刘老师的讲解还是对这方面的知识有了一定的了解。

我国汽车保有总量的大幅增长导致其排放污染物总量不断增加, 已成为破坏城市空气质量的主要因素。

因此我国必须有效地控制车辆排放,防止环境被严重污染。

有效控制机动车污染不仅要从新车开始控制好污染物的排放,满足新车排放法规要求,更重要的是要对在用车实行严格的排放检测制度,保证车辆排放长期处于正常状态。

简易工况法中,我国主要推行汽油车稳态加载加速模拟ASM法和柴油车加载减速Lugdown法。

该方法只有稳定的匀速过程, 加载保持固定值, 有两个等速工况段: 一是ASM5025 工况, 二是ASM2540 工况。

污染物分析仪器采用下列原理: CO、HC 和CO2采用不分光红外法( NDIR) , NO 和O2采用电化学法。

检测结果以浓度表示。

柴油车加载减速Lugd ow n 法对发现高排放的黑烟车很有效。

香港环保署首先于2000 年6 月颁布了修订后的柴油车加载减速L ugdow n法排放限值及测量方法, 先后控制了20000多辆黑烟车,十分有效地减少了道路上的柴油车颗粒物排放。

越野汽车悬架技术——陈思忠老师让我们了解到了越野车上所装备的各种先进的悬架技术。

2023年中考阅读理解-人类自动驾驶的百年情结

天气舒服的朋友圈句子

1. 今天的天气真是太舒服了,心情也随之变得愉快起来。

2. 晨光洒在身上,微风轻拂脸庞,这样的天气让人心旷神怡。

3. 天空湛蓝,阳光明媚,感受着温暖的微风,我觉得整个世界都变得美丽起来。

4. 不用担心雷雨,不用忍受酷暑,只有舒适的天气才能真正让人感到愉悦。

5. 忍受了漫长的冬天,总算迎来了温暖的春天,感受到阳光的温暖,心情也跟着放松了。

6. 花开的时节,天空的蓝也更加深邃,这样的天气真是让人心生欢喜。

7. 凉爽的午后,阳光透过窗户洒进来,温暖又舒适,难以言喻的惬意感油然而生。

8. 这样的天气,简直就是大自然的恩赐,让人不由自主地想要和朋友们一起出去享受。

9. 天气舒爽,空气中弥漫着淡淡的花香,仿佛大自然也在诉说着它的故事。

10. 夕阳的余晖洒在地面上,让一切都变得慵懒起来,这样的天气真是让人心醉神迷。

11. 美丽的夜晚,星星闪烁,微风吹过,感受到夏季的凉意,真是太舒服了。

12. 无论是散步还是跑步,都能感受到微风的陪伴,这样的天气对身心健康都有好处。

13. 在这样的天气里,不用担心被雨淋湿,不用担心被太阳晒伤,真是太适合户外活动了。

国内外智能车研究现状

军事交通学院(第三届亚军、第四届冠军)2012年11月24日,军事交通学院猛狮3号(JJUV-3)从北京台湖收费站出发,沿着京津高速一路飞奔,85分钟后安全到达天津东丽收费站。

根据国家自然科学基金委和北京理工大学有关专家现场宣布的测试结果,该无人驾驶智能车全程行驶114公里,最高时速105千米,共完成12次自主超车,36次换道操作,30次刹车操作。

“军交猛狮Ⅲ号”无人驾驶车到目前为止已经完成了一万多公里测试,最高时速曾达到120公里。

军事交通学院JJUV-3军事交通学院三代智能车国防科技大学(第三届冠军)我国从20世纪80年代开始进行无人驾驶汽车的研究,国防科技大学在1992年成功研制出我国第一辆真正意义上的无人驾驶汽车。

我国自主研制的无人车——由国防科技大学自主研制的红旗HQ3无人车,2011年7月14日首次完成了从长沙到武汉286公里的高速全程无人驾驶实验,创造了我国自主研制的无人车在复杂交通状况下自主驾驶的新纪录,标志着我国无人车在复杂环境识别、智能行为决策和控制等方面实现了新的技术突破,达到世界先进水平。

红旗HQ3无人车由国防科技大学自主研制,它从京珠高速公路长沙杨梓冲收费站出发,历时3小时22分钟到达武汉,总距离286公里。

实验中,无人车自主超车67次,途遇复杂天气,部分路段有雾,在咸宁还遭逢降雨。

红旗HQ3全程由计算机系统控制车辆行驶速度和方向,系统设定的最高时速为110公里。

在实验过程中,实测的全程自主驾驶平均时速为87公里。

国防科技大学方面透露,该车在特殊情况下进行人工干预的距离仅为2.24公里,仅占自主驾驶总里程的0.78%。

从20世纪80年代末开始,在贺汉根教授带领下,2001年研制成功时速达76公里的无人车,2003年研制成功我国首台高速无人驾驶轿车,最高时速可达170公里;2006年研制的新一代无人驾驶红旗HQ3,则在可靠性和小型化方面取得突破。

此次红旗HQ3无人车实验成功创造了我国自主研制的无人车在复杂交通状况下自主驾驶的新纪录,这标志着我国在该领域已经达到世界先进水平。

无人驾驶汽车国内外研究概况

无人驾驶汽车国内外研究概况无人驾驶车辆,又称为无人车、自主车、智能车辆、室外轮式移动机器人等,涉及认知科学、涉及认知科学、人工智能、人工智能、人工智能、机器人技术与车辆工程等交叉学科,机器人技术与车辆工程等交叉学科,机器人技术与车辆工程等交叉学科,是各种新兴技术是各种新兴技术的综合试验床与理想载体,也是当今前沿科技的重要发展方向。

它既包括理论方法与关键技术的突破,也涉及到大量的工程与试验问题,其重大研究意义不仅体现在所包含的核心科学问题上,同时又反映在其重大应用前景与战略价值上,社会关注度极高。

从二十世纪的50年代起,美英德等西方国家已经开始了无人驾驶汽车的研究工作,并且在无人车的控制和商用化方面取得了一定的进展。

在汽车工业非常发达的德国,各大汽车公司都资助或联合了高等院校以开发可在普通道路上行驶的无人车。

目前,欧盟已经开启了一个名为CyberCars 的无人车项目,以推动无人车的研究和各国间的信息共享。

在二十世纪的80年代,我国部分大学开始了无人驾驶汽车的研究工作,但是虽然起步较晚且投入不足,但也取到了一定的成果。

目前从事这方面研究工作的主要是国防科技大学、军事交通学院以及清华大学等科研院所。

1 国外无人驾驶车辆研究现状1.1 美国美国于上世纪50年代开始对无人驾驶车辆进行研究,在1980年左右其技术得到高速发展。

上世纪八十年代,美国陆军开始与国防高级研究计划局(DARPA )进行合作,开展了自主地面车辆开展了自主地面车辆((A VL )项目。

1995年由卡耐基梅隆大学研制的Navlab-V 智能车,完成了横穿美国东西部的无人驾驶试验。

美国国防部门在上世纪九十年代末开始进行DEMO 系列无人驾驶车辆的研制,总共研制出了十代DEMO 无人车。

从2004年开始到2007年,美国国防高级研究计划局(DARPA )举办了3次无人驾驶车辆比赛,主要为了考察在复杂环境下无人驾驶车辆的自主行驶能力。

2004年3月在美国西部的莫哈维沙漠月在美国西部的莫哈维沙漠((Mojave Desert )举办了首届DARPA 挑战赛——崎岖地形大挑战。

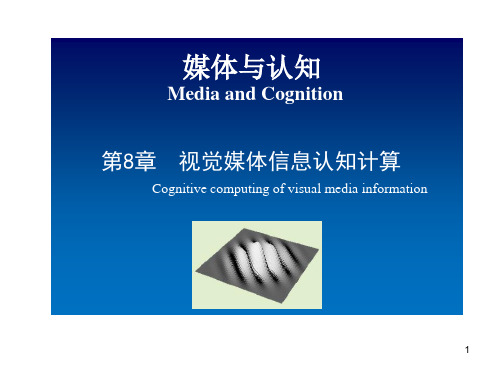

媒体与认知:第8章-视觉媒体信息认知计算

Tsinghua

(2)视觉感知系统的神经信息处理机制 是视觉感知的核心,也是视觉认知计算的基础

可以从2个方面分析:

① 物理行为层次 可通过感官系统或脑的物理行为来描述,例如

显示器光线进入眼后,引发电信号,通过视神经传入大脑

② 抽象行为层次

除了物理行为,还可分析行为的编码信息,即在信息层 次分析神经信息处理机制。

Hubel(1981年诺贝尔生理学和医学奖)最早发现视 网膜的A型神经节细胞呈同心圆交替形。即刺激在感 受野中心与外围,对细胞响应的影响正好相反,常见 的类型有

on-中心型,off-中心型两种

- ++ -

++ --

+

+ -- +

+

-

+

视网膜神经节细 胞感受野

26

Tsinghua

on-中心型由中心的兴奋区和周边的抑制区组成 off-中心型正好相反

媒体与认知

Media and Cognition

第8章 视觉媒体信息认知计算

Cognitive computing of visual media information

1

Chapter 8 Cognitive computing of visual media information

Tsinghua

Lindeberg证明了 归一化的高斯-拉普拉斯算子 Laplacian-of-Gaussian(LoG)图像满足尺度不变性。

Mikolajczyk通过实验发现归一化LoG图像的局 部极值点,是比较稳定的图像特征。

为节省运算量,Lowe提出采用difference-ofGaussian(DoG)图像来近似LoG图像。

大数据认知_李德毅院士

在半个世纪的自然语言理解的研究中,我们对 此关注了多少?

人类如何理解自然语言的?

研表究明,汉字的序顺并不定 一能影响阅读,比如当你看完这 句话后,才发这现里的字全是都 乱的!再回头仔看细看,真这是 样的。

在半个世纪的自然语言理解的研究中,我们对 此关注了多少?

区分计算机和人的全自动公共图灵测 试(CAPTCHA)还能维持多久?

自然语言可以计算吗?

脑科学认为: 自然语言是不 可以计算的!

计算语言学认为: 在特定语境和语用场 合,自然语言理解是 可以被形式化表达并 进行计算的!

如果一个问题不能够全部形式化,那 么,其中的局部问题可不可以形式化? 如何让这个局部问题尽可能地普遍一 些?

自然语言可以在什么程度上被形式化, 取决于能否把不确定性形式化。

第二句

X4 X5

第三句

X6 X7

第四句

X8

1羞玉 2流泪 3窈窕 4雪满 5月色 6愁空 7浮云 8伤别 9哀苦 0回首

1未曾看 2斩楼兰 3寄燕然 4水生烟 5凤楼酣 6暗无边 7绕林间 8竟不还 9贵乡还 0泪遥传

1燕然 2芙蓉 3鸳鸯 4梅花 5江南 6春风 7佳人 8斜阳 9西湖 0微霜

1水月牵 2寻岳仙 3哀苦寒 4觉夜寒 5嬉笑牵 6独去闲 7上酒船 8流泪泉 9不可攀 0走百川

机器人能听会说正在改变我们的生活!

在线服务机器人 智能耳机?

通讯平台 数字媒体

网络应用

语言翻译服务云支撑各式各样智能语音

方言服务中心 中英文翻译 服务中心 政治语言翻译中心

语音指纹 计算用语翻译中心 服务中心

位置服务中心

Let data speak! listen & answering carefully.

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

附件2:重大研究计划“视听觉信息的认知计算”2008年度项目指南与人类视听觉感知密切相关的图像、语音和文本(语言)信息在社会、经济和国家安全等领域中扮演着重要角色,并在今后一段时间内仍将迅猛增长。

这类信息可被人类直接感知和理解,也可用计算机进行处理,但计算机的处理能力远逊于人类且处理效率远不能满足当今社会的发展需求。

如何借鉴人类的认知机理和相关数学的最新研究成果,建立新的计算模型和方法,从而大幅度提高计算机对这类信息的理解能力与处理效率,不仅可有力推动信息科学的快速发展,也将为国民经济和社会发展做出重大贡献。

一、科学目标本重大研究计划的总体科学目标是:围绕国家重大需求,充分发挥信息科学、生命科学和数理科学的交叉优势,从人类的视听觉认知机理出发,研究并构建新的计算模型与计算方法,提高计算机对非结构化视听觉感知信息的理解能力和海量异构信息的处理效率,克服图像、语音和文本(语言)信息处理所面临的瓶颈困难,为确保国家安全与公共安全、推动信息服务及相关产业发展以及提高国民生活和健康水平做出重要贡献。

具体表现为:在视听觉信息处理的基础理论研究方面取得重要进展;在视听觉信息协同计算、自然语言(汉语)理解以及与视听觉认知相关的脑―机接口等三项关键技术方面取得重大突破;集成上述相关研究成果,研制具有自然环境感知与智能行为决策能力的无人驾驶车辆验证平台,主要性能指标达到世界先进水平,从而提升我国在视听觉信息处理领域的整体研究实力,培养具有国际影响力的优秀人才与团队,为国家安全和社会发展提供相关研究环境与技术支撑。

二、核心科学问题本重大研究计划将围绕“感知特征提取、表达与整合”、“感知数据的机器学习与理解”和“多模态信息协同计算”等核心科学问题,组织并实施如下四个主要方面的研究工作。

(一)图像与视觉信息计算。

主要研究图像与视觉信息计算的认知机理,视觉基本特征的提取与选择,物体识别与图像内容理解,复杂场景下运动目标的行为分析等。

提出若干图像与视觉信息的高效计算模型,取得国际公认的原创性研究成果(在Nature, Science, IEEE Trans. PAMI等刊物上发表高水平论文),培养具有国际影响力的优秀人才与研究团队。

(二)语音与听觉信息计算。

主要研究听感知机理与音频场景分析,自然环境下的语音识别与合成,口语对话分析与理解等。

取得国际上有影响的原创性研究成果,提出若干语音与听觉信息的有效计算模型,在本领域国际权威刊物上发表高水平论文,培养具有国际影响力的优秀人才与研究团队。

(三)自然语言(汉语)理解。

主要研究语言加工的认知机理,语言知识建模和语义计算模型,基于语义理解的机器翻译方法,面向网络的汉语适度理解模型和系列分析工具,支持自然环境下口语对话分析、识别与理解的关键技术等。

在国内已有相关成果的基础上,统筹构建大规模高标准汉语语义知识库。

将上述研究成果应用到语言(汉语)信息处理典型系统中,显著提高对自然语言(句子、段落、篇章)的理解能力,并在网络信息检索、过滤和知识获取方面得到验证。

(四)多模态信息的协同计算与脑—机接口。

主要研究多模态感知信息协同的认知机理与计算模型,基于视听觉信息融合的模式识别与环境交互方法,跨模态视频信息检索与网络敏感信息过滤技术等。

大幅度提高跨模态视频信息检索的查准率,显著提升本领域整体研究实力。

研究与视听觉认知相关的脑信号提取、脑区定位与脑功能网络分析方法和技术,脑—机交互中的信号传输、处理与控制技术,与视听觉认知相关的脑—机接口典型应用。

在改善残疾人生活质量和功能康复等方面得到验证或应用,为延伸和提高人类行为控制能力提供新技术。

三、关键技术与集成验证平台在上述研究工作的基础上,本重大研究计划进一步开展与视听觉信息处理相关的关键技术和集成验证平台研究。

(一)视听觉信息协同计算的关键技术。

研究机器视听觉信息的协同计算模型及系统实现技术,基于视听觉信息融合的模式识别技术与验证系统,跨模态视频信息检索与网络敏感信息过滤技术及应用。

基于多模态协同计算模型的网络视频信息搜索的查准率比同期国外最好水平高5%—10%,并在网络信息安全与服务等领域得到验证。

(二)自然语言(汉语)理解关键技术。

研究汉语通用词汇的规范化语义知识库及其构建技术,面向网络的汉语适度理解模型及系列分析工具的实现技术,支持自然环境下口语对话分析、识别与理解的关键技术。

在国内现有相关成果的基础上,统筹构建汉语语义知识库,汉语通用词汇规模不小于5万词,带有语义标注的汉语平衡语料库规模不小于1千万字。

将研究成果应用到网络环境下的汉语处理系统中,信息检索与知识获取的准确率比现有最好技术提高20%以上。

(三)与视听觉认知相关的脑―机接口关键技术。

研究与视听觉认知相关的脑信号提取、脑区定位与脑功能网络分析技术,脑—机交互中的信号传输、处理、控制技术及系统实现,与视听觉认知相关的脑—机接口典型应用。

所提无创脑―机接口信息提取与分析等技术处于同期国际领先水平,在改善残疾人生活质量和功能康复等方面得到验证或应用。

(四)无人驾驶车辆集成验证平台。

集成上述基础理论与关键技术的相关研究成果,将传统视觉计算模型与新的视觉认知模型相结合,实现环境感知与建模方法新突破;实现多传感器跨模态跨尺度信息融合,生成高质量三维场景认知地图,构建高性能智能车辆无人驾驶验证平台;提供新的基于人—车—路状态综合分析的智能辅助安全驾驶关键技术;在国防、智能辅助安全驾驶等相关领域得到验证或应用并产生重要影响。

四、2008年度拟资助的研究项目本重大研究计划主要以“培育项目”、“重点支持项目”和“集成项目”的形式予以资助,三类项目在资助强度和实现目标上有所不同。

对有较好的创新学术思路和研究价值,但尚需进一步探索研究的申请项目,将以“培育项目”方式予以资助。

对有很好的创新学术思想和研究价值,有良好的研究基础和成果积累,且对研究计划总体目标有较大贡献的申请项目,将以“重点支持项目”的方式予以资助。

对实现研究计划总体目标有决定作用的研究方向,将以更大支持强度的“集成项目”方式予以资助。

根据项目执行的年度进展情况或考察结果,本重大研究计划将适度调整获准项目的资助经费(中止课题或追加经费)。

2008年度拟资助如下领域的“重点支持项目”及与其相关的“培育项目”。

(一)多模态信息协同计算方面。

1.“重点支持项目”的研究方向:面向互联网的跨媒体挖掘与搜索引擎融合自然语言理解、图像与视频分析及跨媒体数据挖掘等多领域交叉的新方法,研究有效的网络文本、图像与视频内容挖掘方法和有效的网页分析技术,构建精度高、速度快和鲁棒性强的垂直搜索算法,研发面向特定用户的互联网跨媒体搜索引擎。

考核目标:特定领域文本内容的查准、查全率均在90%以上;特定领域图像与视频内容的查准、查全率均在70%以上;可实现准实时的互联网跨媒体内容挖掘与搜索。

2.“培育项目”的研究方向:(1)文本、图像和语音感知信息交互的选择性注意机理、语义特征提取;(2)“情境(Ambient)智能”的多模态信息协同计算。

(二)自然语言(汉语)理解方面。

1.“重点支持项目”的研究方向一:网络文本的语义计算与理解建立高标准、规模化、易扩展的语义知识库(包括词条、句子和篇章级的核心语义标注);建立面向大规模汉语文本的语义计算框架和计算模型;研究基于内容的网络文本信息检索、事件检测和内容文摘等的关键技术,实现特定语义目标的网络内容理解。

考核目标:研究所得的语义计算与理解方法明显优于非语义方法,特定网络文本信息检索的准确率较现有技术至少提高20%。

2.“重点支持项目”的研究方向二:多模态口语对话内容的分析与理解以口语为主,综合语音、视觉、行为、情感等跨模态信息,研究建立人类口语对话模型,支撑口语对话的理解和人机语音交互。

考核目标:面向汽车语音导航和语音通讯等领域,研制多模态口语人机自然对话原型系统,特定对话主题的理解准确率大于90%,人机对话的正确响应率大于80%,任务完成率大于90%。

3.“培育项目”的研究方向:(1)汉语认知机理的语言心理学研究;(2)适于句子和篇章的汉语语义计算模型;(3)听觉感知机理与音频场景分析;(4)语义计算与理解的资源共享与测评。

(三)脑—机接口方面。

1.“重点支持项目”的研究方向:与视听觉认知相关的人机交互关键技术研究与视听觉认知相关的脑信号提取与脑区定位技术;脑—机交互中的信息传输、处理与控制技术;与视听觉相关的脑—机接口应用技术。

考核目标:提出并实现脑—机交互的在线自动模式学习策略,提高脑―机接口系统的鲁棒性和自适应性;在脑电信息的提取、分析和应用方面处于同期国际领先水平;在与视听觉相关的残疾人功能康复方面得到验证或应用。

2.“培育项目”的研究方向:(1)基于脑―机接口的车辆导航与控制技术;(2)脑电信号的无创采集、传输和处理;(3)脑―机交互范式的新概念与新方法。

(四)驾驶行为的认知机理方面。

1.“重点支持项目”的研究方向:驾驶行为的认知机理和神经表达—选择性注意及与动作的相互关系选择性注意是人类驾驶行为的一个不可缺少的认知功能。

对选择性注意的研究以及对驾驶行为注意研究的一个根本问题是:“注意选择的究竟是什么?”。

本项目要求在这个认知科学的重大问题上取得实质性突破,特别是,提出和发展基于“物体”的选择性注意原创性系统理论,并应用于无人驾驶的环境感知计算模型。

一方面建立物体表达概念的科学定义,以及物体表达和驾驶行动交互作用的认知机理的准确描述;另一方面利用脑功能成像的各种方法,发现基于物体注意和驾驶行动的大脑皮层的神经表达。

从而为建立具有主动视觉功能和“注视转移”机理的驾驶行为新模型提供认知科学基础。

2.“培育项目”的研究方向:(1)驾驶行为的知觉学习;(2)眼动和注意调节的认知机理与主动视觉;(3)驾驶员的行为心理学与认知结构模型。

(五)无人驾驶车辆集成验证平台方面。

1.“重点支持项目”的研究方向:无人驾驶车辆的关键技术与系统平台考核目标:在遵守交通法规的前提下,实现以下三种路况自主驾驶。

(1)城市道路:要求车辆能够安全并入及驶出多车道交通场景,具有保持车道、换道和超车的能力,行驶里程约5公里;在部分路段中能够通过一连串平行停放的车辆和路障,且能行驶到位于其它停放车辆中间的指定停车点。

测试环境:人与车辆较为密集,测试道路有多个十字路口,测试车辆能对障碍物进行识别,并能掉头重新选择行驶路径。

(2)高速公路:行驶里程约2000公里,人工干预里程小于3%;能安全有效地超车并汇入车流;能准确识别高速公路上的常见交通标志,并做出正确安全的驾驶动作。

测试环境:测试道路上有多个高架桥路口。

(3)乡村道路:在各种路表(土路、砂石路、水泥或沥青等)条件下,行驶里程约200公里,人工干预里程小于4%;能保持车道、安全跟随和超越前方车辆,能停车、重新启动和绕行;能识别障碍物,并能避免与行人、自行车和路边树木、电线杆等物体碰撞。