信息论无失真信源编码

信息论:第5章 无失真信源编码定理

(7)码的N次扩展码

假定某码C,它把信源 S {s1 , s2 ,, sq }中的符号

s i 一一变换成码C中的码字 Wi ,则码C的N次扩展 码是所有N个码字组成的码字序列的集合。

24

例如:若码 C {W1 ,W2 ,,Wq } 满足:si Wi ( xi1 , xi 2 ,, xil ), si S , xil X 则码C的N次扩展码集合 B {B1 , B2 , , Bq } ,其中:

为了解决这两个问题,就要引入信源编码和信 道编码。

2

一般来说,抗干扰能力与信息传输率二者相互矛盾。 然而编码定理已从理论上证明,至少存在某种最佳 的编码能够解决上述矛盾,做到既可靠又有效地传 输信息。 信源虽然多种多样,但无论是哪种类型的信源, 信源符号之间总存在相关性和分布的不均匀性,使 得信源存在冗余度。

q r

N

l

(5.2)

36

25

(8)惟一可译码

若任意一串有限长的码符号序列只能被惟一地 译成所对应的信源符号序列,则此码称为惟一可译 码(或称单义可译码)。否则就称为非惟一可译码 或非单义可译码。

若要使某一码为惟一可译码,则对于任意给定 的有限长的码符号序列,只能被惟一地分割成一个 个的码字。

26

例如:对于二元码 C1 {1, 01, 00},当任意给定一串 码字序列,例如“10001101”,只可唯一地划分为 1,00,01,1,01,因此是惟一可译码; 而对另一个二元码 C 2 {0,10, 01},当码字序列 为“01001”时,可划分为0,10,01或01,0,01,所以是 非惟一可译的。

i

N

Bi {Wi1 ,Wi2 ,,WiN }; i1 ,, i N 1,, q; i 1,, q N

信息论常用无失真信源编码设计(含MATLAB程序)

《信息论基础》题目:常用无失真信源编码程序设计目录1. 引言 (2)2. 香农编码 (2)2.1 编码步骤 (3)2.2 程序设计 (3)2.3 运行结果 (3)3. 费诺编码 (4)3.1 编码步骤 (5)3.2 程序设计 (5)3.3 运行结果 (5)4. 哈夫曼编码 (6)4.1 编码步骤 (7)4.2 程序设计 (7)4.3 运行结果 (8)5. 结论 (9)6. 参考文献 (10)7. 附录 (11)7.1 香农编码Matlab程序 (11)7.2 费诺编码Matlab程序 (12)7.3 哈夫曼编码Matlab程序 (14)1. 引言信息论(Information Theory)是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。

信息系统就是广义的通信系统,泛指某种信息从一处传送到另一处所需的全部设备所构成的系统。

信息论是关于信息的理论,应有自己明确的研究对象和适用范围[1]。

信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。

信息传输和信息压缩是信息论研究中的两大领域。

这两个方面又由信息传输定理、信源-信道隔离定理相互联系。

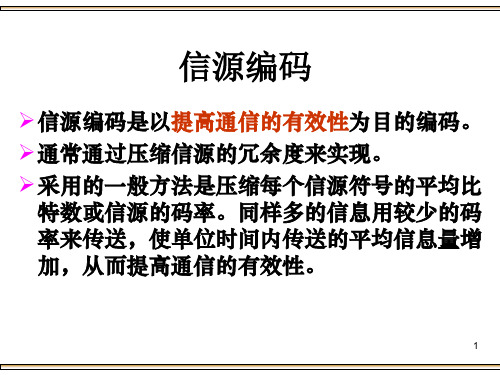

信源编码是一种以提高通信有效性为目的而对信源符号进行的变换,或者说为了减少或消除信源冗余度而进行的信源符号变换。

具体说,就是针对信源输出符号序列的统计特性来寻找某种方法,把信源输出符号序列变换为最短的码字序列,使后者的各码元所载荷的平均信息量最大,同时又能保证无失真地恢复原来的符号序列[2]。

在通信中,传送信源信息只需要具有信源极限熵大小的信息率,但在实际的通信系统中用来传送信息的信息率远大于信源极限熵。

为了能够得到或接近信源熵的最小信息率,必须解决编码的问题,而编码分为信源编码和信道编码,其中的信源编码又分为无失真信源编码和限失真信源编码。

由于无失真信源编码只适用于离散信源,所以本次作业讨论无失真离散信源的三种简单编码,即香农(Shannon)编码、费诺(Fano) 编码和哈夫曼(Huffman) 编码[3]。

无失真的信源编码

[例]有一单符号离散无记忆信源

对该信源编二进制香农码。其编码过程如表所示。 二进制香农编码

xi x1 x2 x3 x4 x5 x6 p(xi) 0.25 0.25 0.20 0.15 0.10 0.05 pa(xj) 0.000 0.250 0.500 0.700 0.85 0.95 ki 2 2 3 3 4 5 码字 00 01 100 101 1101 11110 0.000 =(0.000)2 0.250 =(0.010)2 0.500 =(0.100)2 0.700 =(0.101)2 0.85 =(0.1101)2 0.95 =(0.11110)2

7/13/2013 4/31

信源编码概述

信源的原始信号绝大多数是模拟信号,因此,信源编码的 第一个任务是模拟和数字的变换,即:A/D,D/A。 抽样率取决于原始信号的带宽:fc = 2 w,w为信号带宽。 抽样点的比特数取决于经编译码后的信号质量要求: SNR = 6 L(dB),L为量化位数 但是,由于传输信道带宽的限制,又由于原始信源的信号 具有很强的相关性,则信源编码不是简单的A/D,D/A, 而是要进行压缩。为通信传输而进行信源编码,主要就是 压缩编码。 信源编码要考虑的因素:

只含(n-2)个符号的缩减信源S2。

重复上述步骤,直至缩减信源只剩两个符号为止,此时所剩两个符 号的概率之和必为1。然后从最后一级缩减信源开始,依编码路径向

前返回,就得到各信源符号所对应的码字。

7/13/2013 16/31

[例] 设单符号离散无记忆信源如下,要求对信源编二进制哈夫曼码。

7/13/2013

7/13/2013

2/31

信源编码:提高通信有效性。通常通过压缩信源的

信息论基础与应用-李梅-第五章 无失真信源编码解析

二次扩展码码字 w j ( j 1, 2,...,16)

w1 w1w1 00 w 2 w1w2 001 w3 w1w3 0001 w16 w4 w4 111111

第五章:无失真信源编码

一、信源编码的相关概念

4. 关于编码的一些术语

编码器输出的码符号序列 wi称为码字;长度 li 称为码 字长度,简称码长;全体码字的集合C称为码。 若码符号集合为X={0,1},则所得的码字都是二元序 列,称为二元码。

将信源符号集中的每个信源符号

si 固定的映射成某

一个码字 wi ,这样的码称为分组码。

码字与信源符号一一对应

2) 不同的信源符号序列对应不同的码字序列

第五章:无失真信源编码

一、信源编码的相关概念

6. 唯一可译性(续2)

例1:

1) 奇异码

s1 s2 s3 s4

0 11 00 Байду номын сангаас1

译码 11

s2 s4

奇异码一定不是唯一可译码

第五章:无失真信源编码

一、信源编码的相关概念

6. 唯一可译性(续3)

译码 0 0 0 1 1 0 1 1

s1s2 s3 s4

第五章:无失真信源编码

一、信源编码的相关概念

6. 唯一可译性(续5)

4)

唯一可译码 1 1 0 1 0 0 1 0 0 0 0

s1 s2

1 10

1 0

1

s2 / s3 ?

s3 100 s4 1000

为非即时码

第五章:无失真信源编码

一、信源编码的相关概念

信息论与编码第2

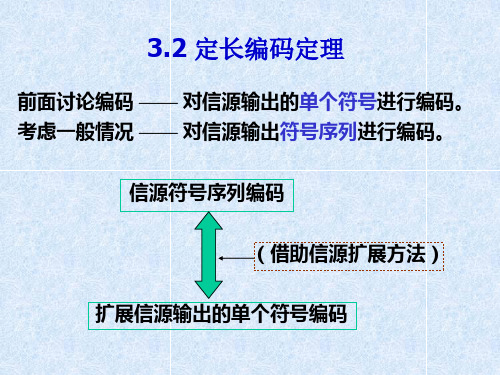

第2章 无失真信源编码原理

某些简单的离散平稳信源先后发出的一个个符号是统计 独立的。也就是说,在信源输出的随机序列X=X1X2…XN中, 各随机变量Xi(i=1,2,…,N)之间是无依赖的、统计独立的,这 样的信源称为离散无记忆信源。该信源在不同时刻发出的各 符号之间也是无依赖的、统计独立的。离散无记忆信源输出 的随机变量X所描述的信源称为离散无记忆信源的N次扩展 信源。可见,N次扩展信源是由离散无记忆信源输出N长的 随机序列构成的信源。一般情况下,信源在不同时刻发出的 各符号之间是相互依赖的,也就是在信源输出的平稳随机序 列X=X1X2…XN中,各随机变量Xi之间是相互依赖的。

第2章 无失真信源编码原理

若信源只输出一个消息(符号),则用一维随机变量来描 述。然而,很多实际信源输出的消息往往是由一系列符号序 列所组成的。例如,将中文自然语言文字作为信源,这时中 文信源的样本空间是所有汉字与标点符号的集合。由这些汉 字和标点符号组成的序列即构成中文句子和文章。因此,从 时间上看,中文信源输出的消息是时间上离散的符号序列, 其中每个符号的出现是不确定的、随机的,由此构成了不同 的中文消息。又例如,对离散化的平面灰度图像信源来说, 从XY平面空间上来看每幅画面是一系列空间离散的灰度值 符号,而空间每一点的符号(灰度值)又都是随机的,由此 形成了不同的图像消息。

第2章 无失真信源编码原理

2.1.2 信源的数学模型 根据信源输出信息所对应的不同的随机过程可以导出不

同的信源模型。例如,根据随机过程具有的随机变量前后独 立与否可分为独立随机信源(或称无记忆信源)和不独立随机 信源(或称有记忆信源);根据随机过程平稳与否可分为平稳 (稳恒)信源和非平稳(非稳恒)信源。与特殊的随机过程相对 应又有特殊的信源模型,例如,与高斯过程相对应的高斯信 源,与马尔可夫过程相对应的马尔可夫信源等,其中,马尔 可夫信源是有记忆信源中最简单且最具代表性的一种。信源 的类型不同其对应的模型也不同,限于篇幅,这里只介绍基 本离散信源的数学模型及其无记忆扩展信源的数学模型。

信息论与编码第5章(2)

2.48

3

011

a4

0.17

0.57

2.56

3

100

a5

0.15

0.74

2.743101 Nhomakorabeaa6

0.10

0.89

3.34

4

1110

a7

0.01

0.99

6.66

7

1111110

10

香农编码

• 由上表可以看出,一共有5个三位的代码组,各代 码组之间至少有一位数字不相同,故是唯一可译码。 还可以判断出,这7个代码组都属于即时码。

相等。如编二进制码就分成两组,编m进制码就分成 m组。 给每一组分配一位码元。 将每一分组再按同样原则划分,重复步骤2和3,直至概 率不再可分为止。

13

费诺编码

xi

符号概 率

x1

0.32

0

编码 0

码字 00

码长 2

x2

0.22

1

01

2

x3

0.18

0

10

2

x4

0.16

1

0

110

3

x5

0.08

1

0

的码字总是0、00、000、0…0的式样; ✓ 码字集合是唯一的,且为即时码; ✓ 先有码长再有码字; ✓ 对于一些信源,编码效率不高,冗余度稍大,因此

其实用性受到较大限制。

12

费诺编码

费诺编码属于概率匹配编码 。

编码步骤如下: 将概率按从大到小的顺序排列,令

p(x1)≥ p(x2)≥…≥ p(xn) 按编码进制数将概率分组,使每组概率尽可能接近或

15

哈夫曼编码

哈夫曼编码也是用码树来分配各符号的码字。 哈夫曼(Huffman)编码是一种效率比较高的变长无失

第三章-无失真信源编码(2)

序列 x1x1 x1x2 x2x1 x2x2

序列概率 9/16 3/16 3/16 1/16

即时码 0 10 110 111

这个码的码字平均长度

lN

9 1

3 2

3 3

1 3 27

码元/ 信源序列

16 16 16 16 16

单个符号的平均码长

l

l

N

lN

27

码元 / 符号

N 2 32

编码效率

c

H(X)

例1:设有一简单DMS信源:

U

p

u1 1 2

u2 1 22

u3 1 23

u4 u5 u6 u7

111

1

24 25 26 26

用码元表X={0,1}对U的单个符号进行编码(N=1),即对U

的单个符号进行2进制编码。

解:用X的两个码元对U的7个符号进行编码,单 个对应的定长码长:

l lN log q log 7 2.8 码元 / 符号 N log r log 2

j 1

log r

1 qN

r l j

ln 2

P(a j ) ln

j 1

P(aj )

1 qN

r l j

ln 2 j1 P(a j )( P(a j ) 1)

(ln z z 1)

qN

qN

rlj P(a j )

j 1

j 1

ln 2

11 0 (Kraft不等式和概率完备性质) ln 2

(2)根据信源的自信息量来选取与之对应的码长:

【说明】

霍夫曼编码是真正意义上的最佳编码,对给定的信源,平 均码长达到最小,编码效率最高,费诺编码次之,香农编码 效率最低。

信息论与编码第4章无失真信源编码

0

2

1

w1 0 1 2 0 1 2

01

2w2

w3 w4

0

1

2

w5

w6 w7 w8

w9 w10 w11

0级节点 1级节点 2级节点

3级节点

25

4.3 变长编码

码树编码方法

(1)树根编码的起点; (2)每一个中间节点树枝的个数编码的进制数; (3)树的节点编码或编码的一部分; (4)树的终止节点(端点、树叶)码; (5)树的节数码长; (6)码位于多级节点变长码; (7)码位于同一级节点码等长码;

设离散无记忆信源X的熵为H(X), 若对长为N的信源符号序 列进行等长编码,码长为L , 码元符号个数为m. 则对任意的

>0, >0, 只要

L log m H ( 率小于。

反之,当

L log m H ( X ) 2

N

时, 则译码差错概率一定是有限值(不可能实现无失真编 码), 而当N足够大时, 译码错误概率近似等于1。

概率分布 0.5 0.25 0.125 0.125

码1:C1 码2:C2 码3:C3

00

0

0

码4:C4 1

码5:C5 1

01

11

10

10

01

10

00

00

100

001

11

11

01

1000

0001

等长码 非唯一 非 唯 唯一可译 及时码 可译 一可译

11

4.1 无失真信源编码的概念

关系 即时码一定是唯一可译码 唯一可译码一定是非奇异码 定长的非奇异码一定是唯一可译码 非定长的非奇异码不一定是唯一可译码

一般地,平均码长: L 3.322 (N ) N

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

信息,例如霍夫曼编码。

它相对简单,是 本章的重点。

信息有一定的差别,例如JPEG 、MPEG

■无失真信源编码:解码之后可以得到原始 jlll ■有失真信源编码:解码之后的信息与原始 jlll

■其中X 称为码符号集,X 中的元素“称为码元或者 码符号。

输岀符号叱•称为码字,植字的集合C 称 为代码组或者码。

码字比•的长度厶称为码字长度, 简称码长。

■要实现无失真编码,编码器的映射必须是一一对 应、可逆的。

码的分类

5.1编码器

编码器

C=(W1,W2,…,W 几

■信源编码器表示为: X=(QK2,…对

■例如:

S=(ACD) r A B C D C=(OOJOJl)r

00,01,10,11

r X=(o ,l)

S=(A ,CQ) AB C D C=(0,001,lip

* 0,01,001,111

X=(0J)

■根据码长

□固定长度码(定长码):所有码字的长度相同。

□可变长度码(变长码):码字长短不一。

■码字是否相同

□非奇异码:所有码字都不相同。

□奇异码:存在相同的码字。

5.2分组码

■象稱蛊轟凋11映射

■通常在接收端收到的码字之间并没有明显的间隔, 表现为皿叫…巴的形式,把这种形式称为g阶扩展码。

例如前面的两个例子,ACD编码成另 001011/0001111的形式,均为3阶扩展码。

■码字之间缺少间隔,给译码造成了一定的困难□定长码:不存在困难,001011必定译码成为ACD □变长码:存在困难,0001111可以译码成为ACD(0 001 111),也可以译码成为AABD(0 0 01 lll)o

唯一可译性

■定义524 —个分组码若对于任意有限的整 数N,其N 阶扩展码均为非奇异的,则称之 为唯一可译码。

■含义:无论码由多少个码字组成,总是能 够正确译码,不存在二义性。

10110 010 ^BACB 10110 0 Ol^ABAD

■无需知道下一个码字的码符号,即可译码, 这样的唯一可译码成为即时码。

■命题521 —个唯一可译码成为即时码的充 要条件是其中任何一个码字都不是其他码 字的前缀。

即时码

5.3定长码

■编码速率: ~1T,其中/是码字长度,厂是码符号的个数,N代表N次扩展信源。

■编码效率:rj=H(S)R其中H(S)是扩展之前信源的爛。

■例如:S={ABC},等概率出现,N=2,SN={AA,・・・,CC},对SN进行二元编码,则心2,编码方式如下,则上4。

■那么,S"的编码速率为R=(41og2)/2=2, S"的编码效率为

7=H(S)//?=log3/2=0.7925

5.4变长码

■匹配编码:根据概率进行编码,概率大的所给的代码短,概率小的所给的代码长。

例如哈夫曼编码。

■变换编码:将信号从一个空间变换到另一个空间,在新的空间里对信号进行编码。

例如JPEG

■识别编码:主要用于印刷或奢打字机等有标准形状的符号的编码。

0 2 4 6 8 10 12 14 16 18 20

5.4.2两个不等式

■定理5.4.1即时码爭在的充要条件是茁a

Z = 1

克拉夫特(Kraft)不等式。

■定理5.4.2唯一可译码存在的充要条件是

q

y

麦克米伦(McMillanS不等式。

5.4.3唯一可译码判别准则

■命题541 —种码是唯一可译码的充要条件是S], S”…中没有一个含有So中的码字。

5.4.4码平均长度 /八一…]…么 ....................

0 g 。

对唯一可译桐,则这个码的平 q 厶二£卩(训

i=l

■定义5.4.2对应一给定的信源和一给定的码符号

集,若有一种唯一可译码,其平均长度小于所有 其他

[;]

■定义5.4.1设信源

编码后的码字分别为W]W?…巴,各码字相应的码 长分别为仏••丿 均长度为

的唯一可译码,则称这种码为紧致码,或最佳码。

精品课件

V

1 •

•r

精品课件

V

1 •

•r

5.4.5变长码的编码方法:霍夫曼编码

■ {^5.4.4

$1$3$5

10 11 01 001 000

L = 2 x 0.4 + 2x 0.2 + 2x 0.2 + 3x0.1+3x0.! =

2.2

■定理5.4.6霍夫曼码是紧致码。