机器学习实验2-贝叶斯分类器设计

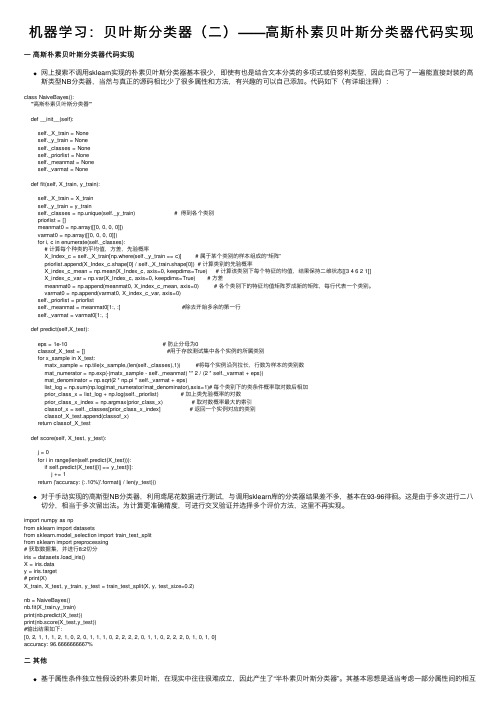

机器学习:贝叶斯分类器(二)——高斯朴素贝叶斯分类器代码实现

机器学习:贝叶斯分类器(⼆)——⾼斯朴素贝叶斯分类器代码实现⼀⾼斯朴素贝叶斯分类器代码实现⽹上搜索不调⽤sklearn实现的朴素贝叶斯分类器基本很少,即使有也是结合⽂本分类的多项式或伯努利类型,因此⾃⼰写了⼀遍能直接封装的⾼斯类型NB分类器,当然与真正的源码相⽐少了很多属性和⽅法,有兴趣的可以⾃⼰添加。

代码如下(有详细注释):class NaiveBayes():'''⾼斯朴素贝叶斯分类器'''def __init__(self):self._X_train = Noneself._y_train = Noneself._classes = Noneself._priorlist = Noneself._meanmat = Noneself._varmat = Nonedef fit(self, X_train, y_train):self._X_train = X_trainself._y_train = y_trainself._classes = np.unique(self._y_train) # 得到各个类别priorlist = []meanmat0 = np.array([[0, 0, 0, 0]])varmat0 = np.array([[0, 0, 0, 0]])for i, c in enumerate(self._classes):# 计算每个种类的平均值,⽅差,先验概率X_Index_c = self._X_train[np.where(self._y_train == c)] # 属于某个类别的样本组成的“矩阵”priorlist.append(X_Index_c.shape[0] / self._X_train.shape[0]) # 计算类别的先验概率X_index_c_mean = np.mean(X_Index_c, axis=0, keepdims=True) # 计算该类别下每个特征的均值,结果保持⼆维状态[[3 4 6 2 1]]X_index_c_var = np.var(X_Index_c, axis=0, keepdims=True) # ⽅差meanmat0 = np.append(meanmat0, X_index_c_mean, axis=0) # 各个类别下的特征均值矩阵罗成新的矩阵,每⾏代表⼀个类别。

bayes 分类器设置实验总结

bayes 分类器设置实验总结Bayes 分类器设置实验总结在机器学习领域中,分类算法是一个常见的任务之一。

Bayes 分类器是一种基于概率统计的分类算法,它基于贝叶斯定理对样本进行分类。

在本次实验中,我们将对Bayes 分类器的设置进行实验,并总结实验结果。

一、实验目的Bayes 分类器是一种简单但有效的分类算法,通过实验设置我们的目的是验证Bayes 分类器在不同参数下的分类效果,并探索如何对其进行优化。

我们希望通过实验的设计和分析,能够决定最佳的参数设置,并对Bayes 分类器的性能有更深入的了解。

二、数据集选择在进行实验之前,我们需要选择一个合适的数据集作为实验对象。

数据集应具备以下特点:1. 包含有标签的样本数据:由于Bayes 分类器是一种监督学习算法,我们需要有样本的标签信息来进行分类。

2. 具备多类别分类的情况:我们希望能够测试Bayes 分类器在多类别分类问题上的表现,以便更全面地评估其性能。

三、实验设置1. 数据预处理:根据所选数据集的特点,我们需要对数据进行适当的预处理。

可能的预处理步骤包括特征选择、特征缩放、处理缺失值等。

2. 分类器参数设置:Bayes 分类器的性能会受到不同参数的影响,我们希望通过实验找到最佳的参数设置。

例如,在朴素贝叶斯分类器中,我们可以选择不同的先验概率分布,或者使用不同的平滑技术来处理零概率问题。

3. 评价指标选择:为了评估分类器的性能,我们需要选择合适的评价指标。

常见的评价指标包括准确率、召回率、精确率和F1 分数等。

四、实验结果在实验完成后,我们将根据所选的评价指标对实验结果进行分析和总结。

我们可以比较不同参数设置下的分类器性能,并选择最佳的参数设置。

此外,我们还可以考虑其他因素对分类器性能的影响,如数据预处理方法和样本量等。

五、实验总结在本次实验中,我们通过对Bayes 分类器的设置进行实验,得到了一些有价值的结果和经验。

根据实验结果,我们可以总结以下几点:1. 参数设置的重要性:Bayes 分类器的性能受到参数设置的影响。

贝叶斯分类器的实现与应用

贝叶斯分类器的实现与应用近年来,机器学习技术在各个领域都有着广泛的应用。

其中,贝叶斯分类器是一种常用且有效的分类方法。

本文将介绍贝叶斯分类器的原理、实现方法以及应用。

一、贝叶斯分类器原理贝叶斯分类器是一种概率分类器,它基于贝叶斯定理和条件概率理论,通过统计样本之间的相似度,确定样本所属分类的概率大小,从而进行分类的过程。

贝叶斯定理的公式为:P(A|B) = P(B|A) × P(A) / P(B)其中,P(A|B) 表示在已知 B 的条件下,事件 A 发生的概率;P(B|A) 表示在已知 A 的条件下,事件 B 发生的概率;P(A) 和 P(B) 分别表示事件 A 和事件 B 的概率。

在分类问题中,假设有 m 个不同的分类,每个分类对应一个先验概率 P(Yi),表示在未知样本类别的情况下,已知样本属于第 i 个分类的概率。

对于一个新的样本 x,通过求解以下公式,可以得出它属于每个分类的后验概率 P(Yi|X):P(Yi|X) = P(X|Yi) × P(Yi) / P(X)其中,P(X|Yi) 表示样本 X 在已知分类 Yi 的条件下出现的概率。

在贝叶斯分类器中,我们假设所有特征之间是独立的,即条件概率 P(X|Yi) 可以表示为各个特征条件概率的乘积,即:P(X|Yi) = P(X1|Yi) × P(X2|Yi) × ... × P(Xn|Yi)其中,X1、X2、...、Xn 分别表示样本 X 的 n 个特征。

最终,将所有分类对应的后验概率进行比较,找出概率最大的那个分类作为样本的分类结果。

二、贝叶斯分类器实现贝叶斯分类器的实现包括两个部分:模型参数计算和分类器实现。

1. 模型参数计算模型参数计算是贝叶斯分类器的关键步骤,它决定了分类器的分类性能。

在参数计算阶段,需要对每个分类的先验概率以及每个特征在每个分类下的条件概率进行估计。

先验概率可以通过样本集中每个分类的样本数量计算得到。

贝叶斯分类器在机器学习中的研究

贝叶斯分类器在机器学习中的研究作者:王贤举来源:《科技探索》2014年第03期摘要:贝叶斯分类器作为机器学习中的一种分类算法,在有些方面有着其优越的一面,在机器学习中有着广泛的应用,本文通过对机器学习中贝叶斯分类器的解析,指出了贝叶斯分类器在机器学习中的适用方面和不足之处。

使其能更加清楚认识了解贝叶斯算法,并能在适合的方面使用贝叶斯算法。

关键词:机器学习贝叶斯算法适用1. 引言机器学习是计算机问世以来,兴起的一门新兴学科。

所谓机器学习是指研究如何使用计算机来模拟人类学习活动的一门学科,研究计算机获得新知识和新技能,识别现有知识,不断改善性能,实现自我完善的方法,从而使计算机能更大性能的为人类服务。

机器学习所适用的范围广阔,在医疗、军事、教育等各个领域都有着广泛的应用,并发挥了积极的作用。

而分类是机器学习中的基本问题之一,目前针对不同的分类技术,分类方法有很多,如决策树分类、支持向量机分类、神经网络分类等。

贝叶斯分类器作为机器学习分类中的一种,近年来在许多领域也受到了很大的关注,本文对贝叶斯分类器进行总结分析和比较,提出一些针对不同应用对象挑选贝叶斯分类器的方法。

2. 贝叶斯公式与贝叶斯分类器:2.1贝叶斯公式:在概率论方面的贝叶斯公式是在乘法公式和全概率公式的基础上推导出来的,它是指设■是样本空间Ω的一个分割,即■互不相容,且,如果■,■,■,则,■这就是贝叶斯公式,■称为后验概率,■为先验概率,一般是已知先验概率来求后验概率,贝叶斯定理提供了“预测”的实用模型,即已知某事实,预测另一个事实发生的可能性大小。

2.2 机器学习中的贝叶斯法则:在机器学习中,在给定训练数据D时,确定假设空间H中的最佳假设,我们用■来代表在没训练数据前假设■拥有的初始概率。

■为■的先验概率,用■代表将要观察训练数据D的先验概率,以■代表假设■成立的情况下观察到数据D的概率,以■为给定训练数据D时■成立的概率,■称为■的后验概率,机器学习中的贝叶斯公式为:学习器考虑候选假设集合H并在其中寻找给定数据D时可能性最大的假设,称为MAP假设,记为■,则■2.3 贝叶斯分类器贝叶斯分类器是用于分类的贝叶斯网络。

二分类朴素贝叶斯例题

二分类朴素贝叶斯例题《二分类朴素贝叶斯例题》在机器学习领域中,分类是一个重要的任务,它可以将数据集划分为不同的类别。

朴素贝叶斯分类器是一种基于概率的分类方法,它采用了贝叶斯定理,并假设特征之间是相互独立的。

本文将介绍一个关于二分类朴素贝叶斯的例题。

假设我们有一个邮件分类的数据集,它包含了许多已被标记为垃圾邮件和非垃圾邮件的样本。

每个样本都有多个特征,比如邮件的主题、发送者、内容等。

我们的目标是根据这些特征来对新的邮件进行分类。

首先,我们需要准备数据集并进行预处理。

预处理包括去除噪声、标准化数据等步骤。

在这个例题中,我们假设已经完成了预处理,并得到了一个包含特征和标签的训练集。

特征被表示为一个向量,而标签则用0表示非垃圾邮件,用1表示垃圾邮件。

接下来,我们可以使用朴素贝叶斯分类器对训练集进行训练。

朴素贝叶斯分类器的基本思想是通过计算给定特征的概率来预测新样本的类别。

这里的朴素贝叶斯假设指的是假设每个特征的出现概率是相互独立的。

训练步骤涉及计算每个类别的先验概率和每个特征在给定类别下的条件概率。

先验概率表示的是某个样本属于某个类别的概率,而条件概率则表示的是在已知类别的情况下,某个特征出现的概率。

这些概率可以通过统计训练集中的样本来进行估计。

在训练完成后,我们可以使用分类器对新的样本进行预测。

预测步骤包括计算新样本属于每个类别的概率,并选择具有最高概率的类别作为预测结果。

在实际应用中,我们可以使用不同的评价指标来评估分类器的性能,比如准确率、精确率、召回率等。

此外,可以通过调整分类器的参数或选择其他特征来改进分类器的性能。

通过这个例题,我们可以了解到朴素贝叶斯分类器的基本原理和应用方法。

它是一种简单而有效的分类算法,在文本分类、垃圾邮件过滤等领域中有广泛应用。

通过适当地调整参数和特征选择,我们可以提高分类器的性能,并对新的样本进行准确的分类预测。

机器学习实验报告-朴素贝叶斯学习和分类文本

机器学习实验报告朴素贝叶斯学习和分类文本(2015年度秋季学期)一、实验内容问题:通过朴素贝叶斯学习和分类文本目标:可以通过训练好的贝叶斯分类器对文本正确分类二、实验设计实验原理与设计:在分类(classification)问题中,常常需要把一个事物分到某个类别。

一个事物具有很多属性,把它的众多属性看做一个向量,即x=(x1,x2,x3,…,xn),用x这个向量来代表这个事物。

类别也是有很多种,用集合Y=y1,y2,…ym表示。

如果x属于y1类别,就可以给x打上y1标签,意思是说x属于y1类别。

这就是所谓的分类(Classification)。

x的集合记为X,称为属性集。

一般X和Y的关系是不确定的,你只能在某种程度上说x有多大可能性属于类y1,比如说x有80%的可能性属于类y1,这时可以把X和Y看做是随机变量,P(Y|X)称为Y的后验概率(posterior probability),与之相对的,P(Y)称为Y的先验概率(prior probability)1。

在训练阶段,我们要根据从训练数据中收集的信息,对X和Y的每一种组合学习后验概率P(Y|X)。

分类时,来了一个实例x,在刚才训练得到的一堆后验概率中找出所有的P(Y|x),其中最大的那个y,即为x所属分类。

根据贝叶斯公式,后验概率为在比较不同Y值的后验概率时,分母P(X)总是常数,因此可以忽略。

先验概率P(Y)可以通过计算训练集中属于每一个类的训练样本所占的比例容易地估计。

在文本分类中,假设我们有一个文档d∈X,X是文档向量空间(document space),和一个固定的类集合C={c1,c2,…,cj},类别又称为标签。

显然,文档向量空间是一个高维度空间。

我们把一堆打了标签的文档集合<d,c>作为训练样本,<d,c>∈X×C。

例如:<d,c>={Beijing joins the World Trade Organization, China}对于这个只有一句话的文档,我们把它归类到China,即打上china标签。

贝叶斯实验报告

贝叶斯实验报告Document serial number【UU89WT-UU98YT-UU8CB-UUUT-UUT108】HUNAN UNIVERSITY人工智能实验报告题目实验三:分类算法实验学生姓名匿名学生学号 02xx专业班级智能科学与技术1302班指导老师袁进一.实验目的1.了解朴素贝叶斯算法的基本原理;2.能够使用朴素贝叶斯算法对数据进行分类3.了解最小错误概率贝叶斯分类器和最小风险概率贝叶斯分类器4.学会对于分类器的性能评估方法二、实验的硬件、软件平台硬件:计算机软件:操作系统:WINDOWS10应用软件:C,Java或者Matlab相关知识点:贝叶斯定理:表示事件B已经发生的前提下,事件A发生的概率,叫做事件B发生下事件A 的条件概率,其基本求解公式为:贝叶斯定理打通了从P(A|B)获得P(B|A)的道路。

直接给出贝叶斯定理:朴素贝叶斯分类是一种十分简单的分类算法,叫它朴素贝叶斯分类是因为这种方法的思想真的很朴素,朴素贝叶斯的思想基础是这样的:对于给出的待分类项,求解在此项出现的条件下各个类别出现的概率,哪个最大,就认为此待分类项属于哪个类别。

朴素贝叶斯分类的正式定义如下:1、设为一个待分类项,而每个a为x的一个特征属性。

2、有类别集合。

3、计算。

4、如果,则。

那么现在的关键就是如何计算第3步中的各个条件概率。

我们可以这么做:1、找到一个已知分类的待分类项集合,这个集合叫做训练样本集。

2、统计得到在各类别下各个特征属性的条件概率估计。

即3、如果各个特征属性是条件独立的,则根据贝叶斯定理有如下推导:因为分母对于所有类别为常数,因为我们只要将分子最大化皆可。

又因为各特征属性是条件独立的,所以有:整个朴素贝叶斯分类分为三个阶段:第一阶段: 准备工作阶段,这个阶段的任务是为朴素贝叶斯分类做必要的准备,主要工作是根据具体情况确定特征属性,并对每个特征属性进行适当划分,然后由人工对一部分待分类项进行分类,形成训练样本集合。

knime贝叶斯实验报告总结

knime贝叶斯实验报告总结一、引言Knime是一款开源的数据分析平台,可以方便地进行数据处理、建模和可视化等操作。

贝叶斯分类器是其中一种常用的机器学习算法,可以用于分类问题。

本报告旨在介绍使用Knime进行贝叶斯分类器实验的过程和结果。

二、实验目的本次实验旨在探究使用Knime进行贝叶斯分类器的效果,并通过对比不同参数设置下的预测结果,寻找最优参数组合。

三、实验步骤1. 数据准备:选择适合贝叶斯分类器的数据集,并将其导入Knime中。

2. 数据预处理:对数据进行缺失值填充、特征选择、归一化等处理。

3. 模型训练:将处理后的数据集分为训练集和测试集,使用Naive Bayes Learner节点建立贝叶斯分类器模型,并通过Cross Validation节点进行交叉验证。

4. 模型评估:使用Scorer节点对模型进行评估,并根据评估结果调整参数。

5. 结果分析:通过比较不同参数组合下的预测准确率和其他指标,确定最优参数组合。

四、实验结果1. 数据集选择:本次实验选择了UCI Machine Learning Repository中的Iris数据集,该数据集包含150个样本,每个样本有4个特征和一个类别标签。

数据集中的三种不同花卉的类别标签分别为Iris Setosa、Iris Versicolour和Iris Virginica。

2. 数据预处理:对于缺失值填充,使用Missing Value节点将缺失值替换为平均值;对于特征选择,使用Correlation Filter节点选取相关性较弱的特征;对于归一化,使用Normalize节点将特征值缩放到0-1之间。

3. 模型训练:将处理后的数据集分为训练集(70%)和测试集(30%),使用Naive Bayes Learner节点建立贝叶斯分类器模型,并通过Cross Validation节点进行交叉验证。

交叉验证结果显示,在默认参数下,模型在测试集上的准确率为95%。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一、实验意义及目的

1、掌握贝叶斯判别定理

2、能利用matlab编程实现贝叶斯分类器设计

3、熟悉基于matlab的算法处理函数,并能够利用算法解决简单问题

二、算法原理

贝叶斯定理是关于随机事件A和B的条件概率(或边缘概率)的一则定理。

其中P(A|B)是在B发生的情况下A发生的可能性

公式为:

贝叶斯法则:当分析样本大到接近总体数时,样本中事件发生的概率将接近于总体中事件发生的概率。

内容:

(1)两类w服从正态分布,设计基于最小错误率的贝叶斯分类器,对数据进行分

类。

(2)使用matlab进行Bayes判别的相关函数,实现上述要求。

(3)针对(1)中的数据,自由给出损失表,并对数据实现基于最小风险的贝叶斯分类。

三、实验内容

(1)尝两类w服从正态分布,设计基于最小错误率的贝叶斯分类器,对数据进行分类。

代码清单:

clc;

clear all;

meas=[0 0;2 0;2 2;0 2;4 4;6 4;6 6;4 6];%8x2矩阵这里一行一行2个特征

[N n]=size(meas);

species={'one';'one';'one';'one';'two';'two';'two';'two'};%这里也对应一行一行的

sta=tabulate(species)

[c k]=size(sta);

priorp=zeros(c,1);

for i=1:c

priorp(i)=cell2mat(sta(i,k))/100;%计算概率

end

%cell2mat(sta(:,2:3)) 提取数组中的数据本来sta数组中数据为矩阵不能直接用

%估算类条件概率参数

cpmean=zeros(c,n);

cpcov=zeros(n,n,c);

for i=1:c

cpmean(i,:)=mean(meas(strmatch(char(sta(i,1)),species,'exact'),:));%exact精确查找cpmean放的每一类的均值点几类就几行

cpcov(:,:,i)=cov(meas(strmatch(char(sta(i,1)),species,'exact'),:))*(N*priorp(i)-

1)/(N*priorp(i));

end

%求(3 1)的后验概率

x=[3 1];

postp=zeros(c,1);

for i=1:c

postp(i)=priorp(i)*exp(-(x-cpmean(i,:))*inv(cpcov(:,:,i))*(x-

cpmean(i,:))'/2)/((2*pi)^(n/2)*det(cpcov(:,:,i)));

end

if postp(1)>postp(2)

disp('第一类');

else

disp('第二类');

end

运行结果:

(2)使用matlab进行Bayes判别的相关函数,实现上述要求。

(3)针对(1)中的数据,自由给出损失表,并对数据实现基于最小错误率的贝叶斯分类:

给出损失表

在(1)的基础上增加代码:

r11=0;

r12=2 ;

r21=4 ;

r22=0 ;

%风险决策表

R1_x=zeros(1); %存放把样本X判为one所造成的整体损失

R2_x=zeros(1); %存放把样本X判为two所造成的整体损失

%计算两类风险值

pw1=priorp(1);

pw2=priorp(2);

R1_x=postp(2)*r12

R2_x=postp(1)*r21

if R1_x>R2_x

disp('two');

else

disp('one');

end

运行结果:

四、实验感想

通过这次实验,我学会了朴素贝叶斯分类器相关的分类方法,对数据分类有了进一步的认识,尽管在过程中有不少概率论相关知识忘记了,通过查阅概率论书籍或者询问同学,我最终完成了实验,为今后继续深入学习打下良好基础。