机器学习 —— 概率图模型(推理:消息传递算法)

概率图模型的推理方法详解(Ⅰ)

概率图模型的推理方法详解概率图模型是一种用图来表示随机变量之间依赖关系的数学模型。

它通过图的节点表示随机变量,边表示随机变量之间的依赖关系,可以用来描述各种复杂的现实世界问题。

概率图模型包括了贝叶斯网络和马尔可夫网络两种主要类型,它们都可以用来进行推理,即根据已知的信息来推断未知的变量。

在本文中,将详细介绍概率图模型的推理方法,包括贝叶斯网络和马尔可夫网络的推理算法。

一、概率图模型概率图模型是一种用图来表示随机变量之间依赖关系的数学模型。

它通过图的节点表示随机变量,边表示随机变量之间的依赖关系,可以用来描述各种复杂的现实世界问题。

概率图模型包括了贝叶斯网络和马尔可夫网络两种主要类型。

贝叶斯网络是一种有向图模型,用来表示变量之间的因果关系;马尔可夫网络是一种无向图模型,用来表示变量之间的相关关系。

概率图模型可以用来进行概率推理,即根据已知的信息来推断未知的变量。

二、贝叶斯网络的推理方法在贝叶斯网络中,每个节点表示一个随机变量,每条有向边表示一个因果关系。

贝叶斯网络的推理方法主要分为两种:精确推理和近似推理。

1. 精确推理精确推理是指通过精确的计算来得到准确的推理结果。

常用的精确推理算法包括变量消去算法和团树传播算法。

变量消去算法通过逐步消去变量来计算联合概率分布,但是对于大型网络来说计算复杂度很高。

团树传播算法通过将网络转化为一个树状结构来简化计算,提高了计算效率。

2. 近似推理近似推理是指通过近似的方法来得到推理结果。

常用的近似推理算法包括马尔科夫链蒙特卡洛算法和变分推断算法。

马尔科夫链蒙特卡洛算法通过构建马尔科夫链来进行抽样计算,得到近似的概率分布。

变分推断算法通过将概率分布近似为一个简化的分布来简化计算,得到近似的推理结果。

三、马尔可夫网络的推理方法在马尔可夫网络中,每个节点表示一个随机变量,每条无向边表示两个变量之间的相关关系。

马尔可夫网络的推理方法主要分为两种:精确推理和近似推理。

1. 精确推理精确推理是指通过精确的计算来得到准确的推理结果。

概率图模型的推理方法详解(六)

概率图模型的推理方法详解概率图模型是一种用于描述随机变量之间关系的工具,它能够有效地表示变量之间的依赖关系,并且可以用于进行推理和预测。

在实际应用中,概率图模型广泛应用于机器学习、人工智能、自然语言处理等领域。

本文将详细介绍概率图模型的推理方法,包括贝叶斯网络和马尔科夫随机场两种主要类型的概率图模型,以及它们的推理算法。

1. 贝叶斯网络贝叶斯网络是一种用有向无环图表示的概率图模型,它描述了变量之间的因果关系。

在贝叶斯网络中,每个节点表示一个随机变量,节点之间的有向边表示了变量之间的依赖关系。

贝叶斯网络中的概率分布可以由条件概率表来表示,每个节点的条件概率表描述了该节点在给定其父节点的取值情况下的概率分布。

在进行推理时,我们常常需要计算给定一些证据的情况下,某些变量的后验概率分布。

这可以通过贝叶斯网络的条件概率分布和贝叶斯定理来实现。

具体来说,给定一些证据变量的取值,我们可以通过贝叶斯网络的条件概率表计算出其他变量的后验概率分布。

除了基本的推理方法外,贝叶斯网络还可以通过变量消除、置信传播等方法进行推理。

其中,变量消除是一种常用的推理算法,它通过对变量进行消除来计算目标变量的概率分布。

置信传播算法则是一种用于处理概率传播的通用算法,可以有效地进行推理和预测。

2. 马尔科夫随机场马尔科夫随机场是一种用无向图表示的概率图模型,它描述了变量之间的联合概率分布。

在马尔科夫随机场中,每个节点表示一个随机变量,边表示了变量之间的依赖关系。

不同于贝叶斯网络的有向图结构,马尔科夫随机场的无向图结构表示了变量之间的无向关系。

在进行推理时,我们常常需要计算给定一些证据的情况下,某些变量的后验概率分布。

这可以通过马尔科夫随机场的联合概率分布和条件随机场来实现。

具体来说,给定一些证据变量的取值,我们可以通过条件随机场计算出其他变量的后验概率分布。

除了基本的推理方法外,马尔科夫随机场还可以通过信念传播算法进行推理。

信念传播算法是一种用于计算概率分布的通用算法,可以有效地进行推理和预测。

机器学习 —— 概率图模型(推理:连续时间模型)

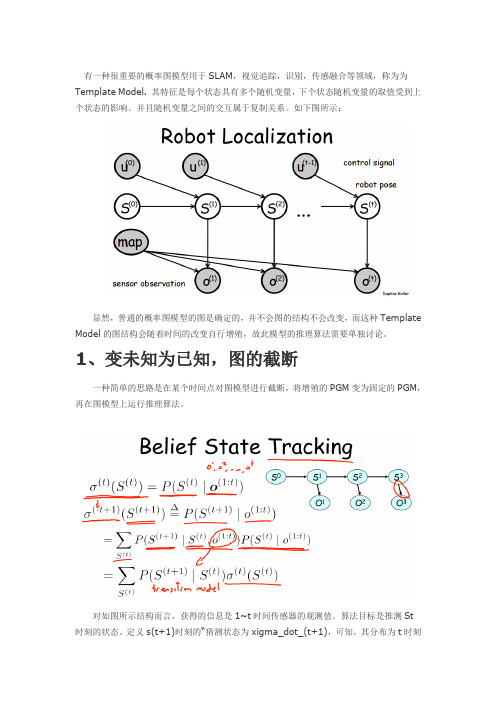

有一种很重要的概率图模型用于SLAM,视觉追踪,识别,传感融合等领域,称为为Template Model. 其特征是每个状态具有多个随机变量,下个状态随机变量的取值受到上个状态的影响。

并且随机变量之间的交互属于复制关系。

如下图所示:

显然,普通的概率图模型的图是确定的,并不会图的结构不会改变,而这种Template Model的图结构会随着时间的改变自行增殖,故此模型的推理算法需要单独讨论。

1、变未知为已知,图的截断

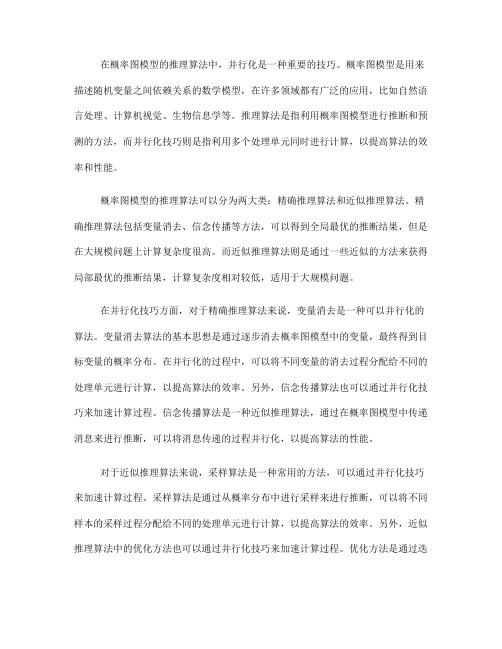

一种简单的思路是在某个时间点对图模型进行截断,将增殖的PGM变为固定的PGM,再在图模型上运行推理算法。

对如图所示结构而言,获得的信息是1~t时间传感器的观测值。

算法目标是推测St

时刻的状态。

定义s(t+1)时刻的“猜测状态为xigma_dot_(t+1),可知,其分布为t时刻

状态的和。

也就是t时刻取值的线性组合。

在给定t+1时刻的观测时,s(t+1)可表达为下式:

s(t+1)真正的值实际上和t+1时刻的观测,对t+1时刻的猜测,以及分母——对t+1时刻观测量的猜测有关。

分母实际上是一个跟状态无关的常数,最后求不同状态S取值比例的时候分母是可以忽略的。

所以重要的是分子。

分子和两个量有关,第一个是观测模型,第二个是t+1时刻状态猜测量。

而状态猜测量是线性组合,每次计算都可以直接带入上次结果。

所以,这种结构的Template Model算起来并不会非常困难。

概率图模型及其在机器学习中的应用

概率图模型及其在机器学习中的应用机器学习是人工智能领域中的重要分支,它主要研究如何通过大量数据和学习算法构建模型,以实现自动化决策和预测。

在机器学习中,概率图模型是一种重要的工具,它可以帮助我们更好地建模和解决许多实际应用问题,包括推荐系统、自然语言处理、计算机视觉等。

一、什么是概率图模型概率图模型(Probabilistic Graphical Models,PGM)是一种用图形表示变量之间概率依赖关系的数学工具。

它的核心思想是通过变量节点和边来表示随机变量之间的联合概率分布,从而实现“图形化建模”。

概率图模型有两类:有向图模型(Directed Graphical Model,DGM)和无向图模型(Undirected Graphical Model,UGM)。

有向图模型又称贝叶斯网络(Bayesian Network,BN),它是一类有向无环图(DAG),其中结点表示随机变量,边表示变量之间的依赖关系。

无向图模型又称马尔科夫随机场(Markov Random Field,MRF),它是一个无向图,其中结点表示变量,边表示变量之间的关系。

概率图模型的优点在于可以通过图形的方式自然地表示变量之间的依赖关系,更容易理解和解释模型的含义。

而且,概率图模型能够有效地减少模型参数量,提高模型估计的准确性和效率。

二、概率图模型在机器学习中的应用概率图模型在机器学习中的应用非常广泛,下面介绍其中几个应用场景。

1.概率图模型在推荐系统中的应用推荐系统是机器学习中的一个重要研究方向,概率图模型可以帮助我们建立更精确和智能的推荐模型。

以贝叶斯网络为例,它可以用来表示用户-物品之间的依赖关系。

在一个面向物品的模型中,图中的结点表示物品,边表示商品之间的关系。

通过学习用户的历史行为数据,我们可以基于贝叶斯网络进行商品推荐,从而提高推荐准确率。

2.概率图模型在自然语言处理中的应用自然语言处理是人工智能领域中的重要研究方向,它旨在让计算机能够理解和处理人类语言。

概率图模型的推理算法并行化技巧分享(Ⅰ)

在概率图模型的推理算法中,并行化是一种重要的技巧。

概率图模型是用来描述随机变量之间依赖关系的数学模型,在许多领域都有广泛的应用,比如自然语言处理、计算机视觉、生物信息学等。

推理算法是指利用概率图模型进行推断和预测的方法,而并行化技巧则是指利用多个处理单元同时进行计算,以提高算法的效率和性能。

概率图模型的推理算法可以分为两大类:精确推理算法和近似推理算法。

精确推理算法包括变量消去、信念传播等方法,可以得到全局最优的推断结果,但是在大规模问题上计算复杂度很高。

而近似推理算法则是通过一些近似的方法来获得局部最优的推断结果,计算复杂度相对较低,适用于大规模问题。

在并行化技巧方面,对于精确推理算法来说,变量消去是一种可以并行化的算法。

变量消去算法的基本思想是通过逐步消去概率图模型中的变量,最终得到目标变量的概率分布。

在并行化的过程中,可以将不同变量的消去过程分配给不同的处理单元进行计算,以提高算法的效率。

另外,信念传播算法也可以通过并行化技巧来加速计算过程。

信念传播算法是一种近似推理算法,通过在概率图模型中传递消息来进行推断,可以将消息传递的过程并行化,以提高算法的性能。

对于近似推理算法来说,采样算法是一种常用的方法,可以通过并行化技巧来加速计算过程。

采样算法是通过从概率分布中进行采样来进行推断,可以将不同样本的采样过程分配给不同的处理单元进行计算,以提高算法的效率。

另外,近似推理算法中的优化方法也可以通过并行化技巧来加速计算过程。

优化方法是通过迭代的方式来求解概率图模型中的参数,可以将不同迭代步骤的计算过程分配给不同的处理单元进行计算,以提高算法的性能。

总的来说,并行化技巧在概率图模型的推理算法中有着重要的作用。

通过并行化技巧,可以充分利用多个处理单元的计算能力,提高算法的效率和性能。

未来随着计算机硬件的发展和并行计算技术的进步,相信并行化技巧会在概率图模型的推理算法中发挥越来越重要的作用,为解决实际问题提供更加高效的方法。

机器学习 —— 概率图模型(推理:团树算法)

在之前的消息传递算法中,谈到了聚类图模型的一些性质。

其中就有消息不能形成闭环,否则会导致“假消息传到最后我自己都信了”。

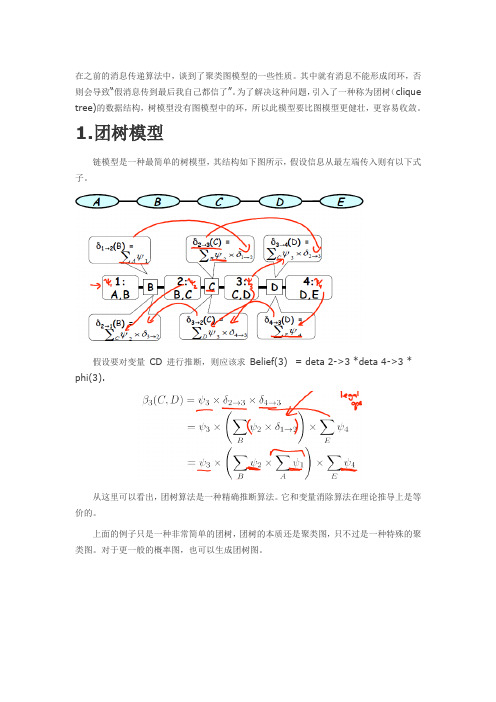

为了解决这种问题,引入了一种称为团树(clique tree)的数据结构,树模型没有图模型中的环,所以此模型要比图模型更健壮,更容易收敛。

1.团树模型链模型是一种最简单的树模型,其结构如下图所示,假设信息从最左端传入则有以下式子。

假设要对变量CD 进行推断,则应该求Belief(3) = deta 2->3 *deta 4->3 * phi(3).从这里可以看出,团树算法是一种精确推断算法。

它和变量消除算法在理论推导上是等价的。

上面的例子只是一种非常简单的团树,团树的本质还是聚类图,只不过是一种特殊的聚类图。

对于更一般的概率图,也可以生成团树图。

其中,每个cluster都是变量消除诱导图中的一个最小map。

2.团树模型的计算从上面分析可知,团树模型本质上和变量消除算法还有说不清道不明的关系(团树模型也是精确推理模型)。

但是这个算法的优势在于,它可以利用消息传递机制达到收敛。

之前提过,聚类图模型中的收敛指的是消息不变。

除此之外,聚类图的本质是一种数据结构,它可以储存很多中间计算结果。

如果我们有很多变量ABCDEF,那么我们想知道P(A),则需要执行一次变量消除。

如果要计算P(B)又要执行一次变量消除。

如果中途得到了某个变量的观测,又会对算法全局产生影响。

但是使用团树模型可以巧妙的避免这些问题。

首先,一旦模型迭代收敛之后。

所有的消息都是不变的,每个消息都是可以被读取的。

每个团的belief,实际上就是未归一划的联合概率,要算单个变量的概率,只需要把其他的变量边际掉就行。

这样一来,只需要一次迭代收敛,每个变量的概率都是可算的。

并且算起来方便。

其次,如果对模型引入先验知识比如A = a 时,我们需要对D 的概率进行估计。

按照变量消除的思路又要从头来一次。

但是如果使用团树结构则不用,因为A的取值只影响deta1->2以及左向传递的消息,对右向传递的消息则毫无影响,可以保留原先对右向传递消息的计算值,只重新计算左向传递结果即可。

概率图模型的推理方法详解(十)

概率图模型的推理方法详解概率图模型是一种用于描述随机变量之间关系的数学工具,它通过图的形式表示变量之间的依赖关系,并利用概率分布来描述这些变量之间的关联。

在概率图模型中,常用的两种图结构是贝叶斯网络和马尔可夫随机场。

而推理方法则是通过已知的观测数据来计算未知变量的后验概率分布,从而进行推断和预测。

一、贝叶斯网络的推理方法贝叶斯网络是一种有向无环图,它由节点和有向边组成,每个节点表示一个随机变量,有向边表示变量之间的依赖关系。

在贝叶斯网络中,推理问题通常包括给定证据条件下计算目标变量的后验概率分布,以及对未观测变量进行预测。

常用的推理方法包括变量消去法、固定证据法和采样法。

变量消去法是一种精确推理方法,它通过对贝叶斯网络进行变量消去来计算目标变量的后验概率分布。

这种方法的优点是计算结果准确,但当网络结构复杂时,计算复杂度会很高。

固定证据法是一种近似推理方法,它通过将已知的证据变量固定,然后对目标变量进行推理。

这种方法的优点是计算速度快,但结果可能不够准确。

采样法是一种随机化推理方法,它通过蒙特卡洛采样来计算目标变量的后验概率分布。

这种方法的优点是可以处理复杂的网络结构,但计算效率较低。

二、马尔可夫随机场的推理方法马尔可夫随机场是一种无向图,它由节点和边组成,每个节点表示一个随机变量,边表示变量之间的依赖关系。

在马尔可夫随机场中,推理问题通常包括给定证据条件下计算目标变量的后验概率分布,以及对未观测变量进行预测。

常用的推理方法包括置信传播法、投影求解法和拉普拉斯近似法。

置信传播法是一种精确推理方法,它通过消息传递算法来计算目标变量的后验概率分布。

这种方法的优点是计算结果准确,但当网络结构复杂时,计算复杂度会很高。

投影求解法是一种近似推理方法,它通过对目标变量进行投影求解来计算后验概率分布。

这种方法的优点是计算速度快,但结果可能不够准确。

拉普拉斯近似法是一种随机化推理方法,它通过拉普拉斯近似来计算目标变量的后验概率分布。

概率图模型的推理算法并行化技巧分享(十)

概率图模型(Probabilistic Graphical Models, PGM)是一种描述随机变量之间关系的数学模型,它在机器学习、人工智能等领域有着广泛的应用。

在构建概率图模型时,一个重要的问题是如何进行推理,即通过已知的变量值来推断未知变量的概率分布。

由于概率图模型通常包含大量的变量和复杂的依赖关系,因此需要高效的推理算法来处理。

在实际应用中,处理大规模概率图模型的推理问题是非常具有挑战性的。

传统的推理算法往往面临着计算复杂度高、运行时间长的问题。

为了解决这一难题,研究者们提出了各种并行化技巧,以提高推理算法的效率。

本文将介绍一些常见的概率图模型推理算法并行化技巧,希望能为相关领域的研究者和从业者提供一些启发。

### 一、并行化技巧概述在进行概率图模型的推理时,常用的算法包括变量消去、信念传播、马尔可夫链蒙特卡洛等。

这些算法往往需要进行大量的概率计算和变量更新,因此可以通过并行化技巧来提高运行效率。

常见的并行化技巧包括并行化算法设计、多核并行计算、分布式计算等。

### 二、并行化算法设计在设计概率图模型的推理算法时,可以从算法本身入手,通过并行化技巧来提高算法的效率。

例如,在变量消去算法中,可以将不依赖于彼此的变量分组,并行进行计算和更新,从而加快算法的运行速度。

此外,还可以利用GPU等硬件加速技术,将部分计算任务转移到GPU上进行并行计算,以提高运行效率。

### 三、多核并行计算多核并行计算是一种常见的并行化技巧,通过利用多核处理器的并行计算能力,将计算任务分配给多个核心同时进行处理。

在概率图模型的推理算法中,可以利用多核并行计算来加速概率计算和变量更新过程。

通过合理设计并行任务的划分和调度策略,可以充分利用多核处理器的计算能力,提高算法的运行效率。

### 四、分布式计算随着大数据技术的发展,分布式计算已经成为处理大规模数据的重要技术手段。

在概率图模型的推理中,可以将概率计算和变量更新任务分布到多台计算机上进行并行处理,以提高算法的运行效率。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

机器学习——概率图模型(推理:消息传递算法)

概率图模型G(V,E)由节点V和边E构成。

在之前马尔科夫模型相关的博客中,我谈到马尔科夫模型的本质是当两个人交流后,其意见(两个随机变量)同意0与不同意1的概率组合。

而势函数表达的是两个意见相同或者相左的程度。

我们搞的那么麻烦,最后想要得到的不就是每个意见正确与否(随机变量取不同值的概率)吗?与其采用解析的方法去算,去把所有其他的变量边际掉,那干脆采用模拟的方法,让这个消息传递跑起来,把系统迭代N次以后的结果拿出来分析。

这种朴素(Naive)的想法,就是Message Passing 算法。

1. 聚类图

在执行消息传递之前,我们需要指定两件事情:1.掌握消息的人有哪些,手里都有哪些消息。

2.他把这个消息告诉了谁。

为了解答这两个问题,需要从我们手里仅有的材料去构造。

P(ABCD) = P(AB)*P(BC)*P(CD)*P(DA) ------- 这里的P是未归一化的概率。

通过这个联合概率计算式,我们获得一种叫做聚类图的全新图模型。

从概率图到聚类图如下所示。

其中,聚类图中存在Cluster 和Edge. Cluster 就是掌握消息的人,Cluster 里的内容就是人所掌握的消息。

Edge 连接了两个交互消息的人,Edge上是两个人交换的消息。

当然,聚类图不仅仅是这么简单的结构。

还有更复杂的聚类图如下.

势函数表达的是两个人意见相同或者相左的程度,两个势函数相乘则会表达多个消息相同或相左的程度。

多个势函数相乘可以成为某个人的消息函数。

对于聚类图,有以下性质:

1.C(Clusters)由节点组成。

2. 边上传递的消息,是两个C的交集(必须要两个人同时知道的消息才能交流)。

3.消息函数是势函数的乘积。

总结一下:消息是随机变量,并且都是相关的。

人掌握消息之间的关系。

人和人之间可以传递消息。

我们假设消息A:明天下雨B:明天下雪C:地上有水那么人们一般都会认为

A1B1C1的可能性肯定大于A1B1C0。

而E有可能是明天有洒水车。

总之,不同的人掌握着不同的消息。

消息与消息之间会相互影响。

2.消息传递

有了消息之后,两个都知道同一件事情的人就会交流和这件事有关的内容,比如 2 会告诉1 关于C(地上有没有水)的事情,这会改变1对消息C的看法(概率)。

我们把消息传递写成以下形式。

i->j 表示消息从i 传递到j。

Sij表示被传递的消息。

通式的物理意义有以下三点:

1.消息从i 传递到j,i 会综合所有人给他说的信息(把所有的δ 相乘)

2.加上自己对消息组合的认知(把δ 相乘的结果乘以消息之间的关系)

3.去除掉不需要传递的部分(把其他变量边际掉)

以上循环一定次数后,达到某种稳定状态。

最终计算某个人对所有消息的看法Belief (所有稳态输入消息δ 乘以消息关系)

这种算法会和精确解法存在一定偏差,故此仅为一种近似算法。

3.聚类图的性质

不是随便一幅图都可以作为聚类图。

聚类图有3个基本要素:

1.每个势函数都被使用,且被使用一次。

2.聚类图中消息传递不能形成环。

3.每个消息如果存在两个知道的人,这两个人必须要有交流途径

关于第一点,势函数描述了消息之间的关系,如果漏了,则失去了消息之间的某个信息,如果重复使用,则某种关系被多余的加强了。

第二点则比较有意思,其实际上描述的是一个正反馈的情况。

假设有个人,编了一个谎话:明天会下雨。

并且把这个谎话告诉了A,然后A又告诉B,B->C,C-D。

如果恰好编这个谎话的人正好和D认识,又正好交流了明天是否会下雨的情况。

那么就“谎话到最后自己都信了”。

这就对“明天下雨”这个随机变量的概率产生较大的估计偏差。

简而言之就是,消息不能成环。

第三点要表达的是,如果甲乙两个人都知道一件事情A,那么他们一定要有交流途径,无论直接交流还是通过其他人转达,总之消息A一定要有在甲乙两人之间联通的路径。

值得注意的一点是,明天下雨A和地上有水C之间可能存在较强的相关性,就算A没有形成环,却通过C形成了环,最终也会对结果产生较大影响。

比如图中,xy强相关时,消息传递算法的表现并不好。

有一种一定能够满足上诉性质的聚类图成为Bethe Clusters Graph。

在使用消息传递算法时,优先考虑构造此聚类图。

该聚类图中有两种不同的人,一种掌握多个消息,一种掌握单种消息。

这样的聚类图一定不会存在环。

其形式如下所示:

4. 传播算法的性质

一群人交换意见,如果大家最后意见都相同了。

比如甲乙都认为明天下雨的概率是0.6,乙丙都认为明天地上有水的概率是0.7.........这种情况称为聚类图校准了。

公式表示,边际掉无关量,两个人对交流消息的看法是一致的。

意见相同还有一个说法,就是交流过程稳定,也就是说,在经过无数次迭代后,消息收敛了。

——————消息传递公式

————————δj-i 与求和无关,因为不在求和域内,故可以乘出去。

发现i,j是对称轮换的

——————————最终得出

收敛和校准是等价的

———————

———一种新的符号

————此式证明了,消息传递算法无论如何运行,初始设定都没有引入新的信息

5.总结

消息传递算法是一种朴素的模拟推断算法,用于求解随机变量的给定依赖条件下的概率。

这种算法的计算结果是有偏的,但该算法却可以大幅降低推断所需要的计算量。