偏最小二乘回归

偏最小二乘回归

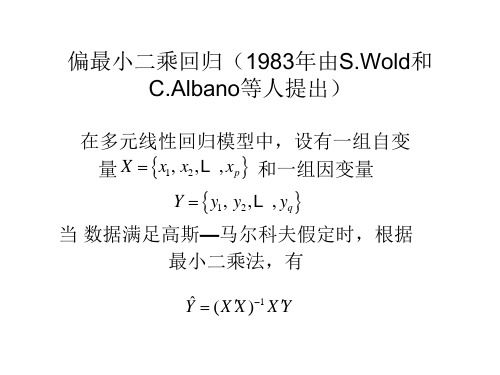

在多元线性回归模型中,设有一组自变 量 X x1 , x2 , , x p 和一组因变量

Y y1 , y2 , , yq

当 数据满足高斯—马尔科夫假定时,根据 最小二乘法,有

ˆ (X Y X )1 X Y

怎样确定所应提取的成分个数

在偏最小二乘回归建模中,可通过考察增加一个 新的成分后,能否对预测功能有明显的改进来考 虑。把所有的n个样本点分成两部分:第一部分是 除去某个样本点i 的所有样本点的集合(共含n 1个 样本点),用这部分样本点并使用h个成分拟合一 ˆ hj 个回归方程,得到y j 在样本点i, n, 重复上述测试,则可定义 y j的预测误差平方和为:

2 ˆ hj PRESShj ( yij y ) (-i ) i 1 n

定义Y的预测误差平方和为: PRESSh PRESShj

j 1 p

如果回归方程的稳健性不好,误差很大,它对样本 点的变动就会十分敏感,这种扰动误差的作用,就 会加大PRESSh值。

比较PRESS h 和SS h -1. SSh -1是用样本点拟合的具有h-1个成分的拟合 误差;PRESS h 增加了一个成分th ,但却含有样 本点的扰动误差。如果h个成分的回归方程的 含扰动误差能在一定程度上小于h-1个成分回 归方程的拟合误差,则认为增加一个成分th, 会使预测的精度明显提高。因此我们希望 PRESS h与SS h -1的比值能越小越好. 若 PRESS h / SS h -1 0.952 就认为增加成分是 有益的,反之,则认为新增加的成分对减少 方程的预测误差无明显的改善作用。

4. 变量 x j 与 xk的相关系数 rjk r(x j , xk ) s jk s j sk

偏相关与偏最小二乘

偏相关与偏最小二乘

偏相关分析和偏最小二乘回归是两种常用的多元统计分析方法,用于处理多个预测变量和一个响应变量的关系。

偏相关分析是一种确定多个变量之间相关性的方法,它控制其他变量的影响,只考虑特定两个变量之间的相关性。

这种方法用于探索变量之间的依赖关系,并通过控制其他变量的影响来理解变量之间的纯粹关系。

偏相关分析可以揭示变量之间的真实关系,即使它们受到其他变量的影响。

偏最小二乘回归是一种回归分析技术,用于建立因变量和自变量之间的关系模型。

它通过迭代过程同时估计回归系数和提取对因变量有最大影响的自变量特征。

在每一步迭代中,它使用最小二乘法估计回归系数,并提取新的特征,直到达到收敛或达到预设的迭代次数。

总之,偏相关分析用于探索和理解变量之间的相关性,而偏最小二乘回归则用于建立预测模型和预测因变量的值。

这两种方法在多元统计分析中都是非常重要的工具,可以根据具体的数据和分析目标选择使用其中一种或结合使用。

偏最小二乘回归方法(PLS)

偏最小二乘回归方法1 偏最小二乘回归方法(PLS)背景介绍在经济管理、教育学、农业、社会科学、工程技术、医学和生物学中,多元线性回归分析是一种普遍应用的统计分析与预测技术。

多元线性回归中,一般采用最小二乘方法(Ordinary Least Squares :OLS)估计回归系数,以使残差平方和达到最小,但当自变量之间存在多重相关性时,最小二乘估计方法往往失效。

而这种变量之间多重相关性问题在多元线性回归分析中危害非常严重,但又普遍存在。

为消除这种影响,常采用主成分分析(principal Components Analysis :PCA)的方法,但采用主成分分析提取的主成分,虽然能较好地概括自变量系统中的信息,却带进了许多无用的噪声,从而对因变量缺乏解释能力。

最小偏二乘回归方法(Partial Least Squares Regression:PLS)就是应这种实际需要而产生和发展的一种有广泛适用性的多元统计分析方法。

它于1983年由S.Wold和C.Albano等人首次提出并成功地应用在化学领域。

近十年来,偏最小二乘回归方法在理论、方法和应用方面都得到了迅速的发展,己经广泛地应用在许多领域,如生物信息学、机器学习和文本分类等领域。

偏最小二乘回归方法主要的研究焦点是多因变量对多自变量的回归建模,它与普通多元回归方法在思路上的主要区别是它在回归建模过程中采用了信息综合与筛选技术。

它不再是直接考虑因变量集合与自变量集合的回归建模,而是在变量系统中提取若干对系统具有最佳解释能力的新综合变量(又称成分),然后对它们进行回归建模。

偏最小二乘回归可以将建模类型的预测分析方法与非模型式的数据内涵分析方法有机地结合起来,可以同时实现回归建模、数据结构简化(主成分分析)以及两组变量间的相关性分析(典型性关分析),即集多元线性回归分析、典型相关分析和主成分分析的基本功能为一体。

下面将简单地叙述偏最小二乘回归的基本原理。

第章偏最小二乘回归分析

第章偏最小二乘回归分析偏最小二乘回归(PLS Regression)是一种多元统计回归分析方法,用于处理多个自变量与一个或多个因变量之间的关系。

与传统的最小二乘回归相比,PLS回归可以在数据存在多重共线性或高维情况下获得更为稳定和准确的结果。

本章将详细介绍PLS回归的原理、应用以及其在实际问题中的使用。

1.PLS回归的原理PLS回归通过建立自变量和因变量之间的线性关系模型,将数据投影到一个新的空间中,以降低维度并消除多重共线性的影响。

PLS回归的主要思想是将原始数据进行分解,得到一系列相互相关的隐藏变量,然后使用这些隐藏变量来进行回归分析。

2.PLS回归的步骤PLS回归的步骤包括数据预处理、建立模型、模型评估和解释。

首先,需要对原始数据进行预处理,包括中心化和标准化,以保证数据的平均值为零且方差为一、然后,通过逐步回归的方法构建模型,选择与响应变量高度相关的隐藏变量。

模型的选择可以通过交叉验证的方法进行。

最后,通过解释模型的系数和残差来评估模型的质量和可解释性。

3.PLS回归的应用PLS回归在实际问题中有广泛的应用,特别是在化学、生物、医学和食品科学等领域。

例如,PLS回归可以用于药物分析,通过测量药物的光谱数据来预测其浓度。

另外,PLS回归还可以用于食品安全和质量检测,通过分析食品的化学成分和感官属性来预测食品的品质。

4.PLS回归的优势和局限性相比于传统的最小二乘回归,PLS回归具有以下优势:能够处理高维数据和多重共线性问题,对异常值和缺失数据有较强的鲁棒性,对小样本数据有较好的稳定性。

然而,PLS回归也存在一些局限性,例如对数据的敏感性较高,模型的解释性较差,难以挑选合适的隐藏变量数量。

5.PLS回归的使用在使用PLS回归时,需要注意选择合适的模型评估方法和隐藏变量数量。

常用的评估方法包括交叉验证和留一法。

此外,还需要注意数据预处理的方法,如中心化、标准化和异常值处理等。

对于隐藏变量数量的选择,可以通过观察坐标平方和贡献率图来确定。

偏最小二乘回归分析

x y xy 101.8389 b 2 2 , x x a y b x -28.6883

y

2 [ y ( a bx )] i i

n2

0.931912

利用肖维涅舍弃判据来剔除测量值中带有粗差的数 据,列表如下(n=16时,Cu=2.15):

递推关系:

P0(x)=1, P1(x)=x,

2 P2 ( x) 1 ( 3 x 1) 2

则: a 28.7 0.4 b 101.8 0.1

即回归方程为:

y 28.7 101.8 x

附:临界相关系数 R表

N-2 a

0.05 0.01

1

2

3

4

5

6

7

8

9

10

0.997 0.950 0.878 0.811 0.754 0.707 0.666 0.632 0.602 0.576 1.000 0.990 0.959 0.917 0.874 0.834 0.798 0.765 0.735 0.707

1.3 相关关系

相关关系的描述 相关关系最直观的描述方式——坐标图(散点图)

非线性相关

零相关

正相关

负相关

相关系数 — 相关程度的度量

X和Y的总体 相关系数: •

Cov( X , Y ) Var ( X )Var (Y )

其中: Var(X)-----X 的方差 Var(Y)-----Y的方差 Cov(X,Y)-----X和Y的协方差

解: 1.列表

n x

y x2 y2 xy

1 2 3 4 5 6 7 8 9

1.11

82.5 1.2321 6806.25 91.575

偏最小二乘回归方法

偏最小二乘回归方法偏最小二乘回归(PLSR)方法是一种用于建立两个或多个变量之间的线性关系模型的统计技术。

这种方法是回归分析的变种,特别适用于处理高维数据集或变量之间具有高度相关性的情况。

PLSR方法的目标是找到一个最佳的投影空间,以将自变量和因变量之间的关系最大化。

PLSR方法首先将自变量和因变量进行线性组合,然后通过最小二乘法来拟合这些组合和实际观测值之间的关系。

通过迭代过程,PLSR方法会削减每个变量的权重,并选择最相关的变量组合来构建模型。

PLSR方法使用最小二乘回归来估计模型参数,并通过交叉验证来确定模型的最佳复杂度。

一般而言,PLSR方法需要满足以下几个步骤:1.数据预处理:包括数据中心化和标准化操作。

中心化是指将数据的平均值平移到原点,标准化是指将数据缩放到相同的尺度,以便比较它们的重要性。

2.建立模型:PLSR方法通过迭代过程来选择最相关的变量组合。

在每次迭代中,PLSR方法计算每个变量对自变量和因变量之间关系的贡献程度。

然后,根据这些贡献程度重新计算变量的权重,并选择最重要的变量组合。

3.确定复杂度:PLSR方法通常通过交叉验证来确定模型的最佳复杂度。

交叉验证可以将数据集划分为训练集和测试集,在训练集上建立模型,并在测试集上评估模型的性能。

根据测试集上的性能表现,选择最佳的复杂度参数。

PLSR方法的优点在于可以处理高维数据集,并能够处理变量之间的高度相关性。

它可以找到自变量与因变量之间的最佳组合,从而提高建模的准确性。

此外,PLSR方法还可以用于特征选择,帮助研究人员找到对结果变量具有重要影响的变量。

然而,PLSR方法也存在一些限制。

首先,PLSR方法假设自变量和因变量之间的关系是线性的,因此无法处理非线性模型。

其次,PLSR方法对异常值非常敏感,可能会导致模型的失真。

此外,PLSR方法也对样本大小敏感,需要足够的样本数量才能获得可靠的结果。

总的来说,偏最小二乘回归方法是一种用于建立变量之间线性关系模型的统计技术。

专题6偏最小二乘回归ppt课件

3

一、偏最小二乘回归概述——偏最小二乘回归方法的产生背景(续)

在国内,最早对此进行系统研究的学者 是北京航空航天大学的王惠文教授。

4

一、偏最小二乘回归概述

偏最小二乘回归的基本思想

2 T

。一般地,若有ˆT2

ˆ

2 B

,

则回归方程会有更好的预测效果;若

ˆT2

ˆ

2 B

,

则回归方程不宜用于预测。

22

二、偏最小二乘回归的建模步骤

在PLS建模中,究竟该选取多少个成分为宜,这 可通过考察增加一个新的成分后,能否对模型的预 测功能有明显改进来考虑。

采用类似于抽样测试法的工作方式,把所有n 个样本点分成2部分:第1部分除去某个样本点i的 所有样本点集合(共含n-1个样本点),用这部分样本 点并使用h个成分拟合一个回归方程;第二部分是 把刚才被排除的样本点i代入前面拟合的回归方程, 得到 y j 在样本点i上的拟合值 yˆ hj(i)。

显提高。

26

三、偏最小二乘回归的辅助分析技术

与典型相关分析对应的研究内容 与主成分分析对应的研究内容

27

三、偏最小二乘回归的辅助分析技术

与典型相关分析对应的研究内容

1.精度分析

(1)th对某自变量xj的解释能力为

Rd (xj ;th ) r2 (xj ,th )

(2)th对X的解释能力为

1 p

m

Rd (xj ;t1,t2, ,tm ) Rd (xj ;th ) h1

(5)th对某因变量yk的解释能力为 Rd ( yk ;th ) r2 ( yk ;th )

偏最小二乘回归方法(PLS)

偏最小二乘回归方法1 偏最小二乘回归方法(PLS)背景介绍在经济管理、教育学、农业、社会科学、工程技术、医学和生物学中,多元线性回归分析是一种普遍应用的统计分析与预测技术。

多元线性回归中,一般采用最小二乘方法(Ordinary Least Squares :OLS)估计回归系数,以使残差平方和达到最小,但当自变量之间存在多重相关性时,最小二乘估计方法往往失效。

而这种变量之间多重相关性问题在多元线性回归分析中危害非常严重,但又普遍存在。

为消除这种影响,常采用主成分分析(principal Components Analysis :PCA)的方法,但采用主成分分析提取的主成分,虽然能较好地概括自变量系统中的信息,却带进了许多无用的噪声,从而对因变量缺乏解释能力。

最小偏二乘回归方法(Partial Least Squares Regression:PLS)就是应这种实际需要而产生和发展的一种有广泛适用性的多元统计分析方法。

它于1983年由S.Wold和C.Albano等人首次提出并成功地应用在化学领域。

近十年来,偏最小二乘回归方法在理论、方法和应用方面都得到了迅速的发展,己经广泛地应用在许多领域,如生物信息学、机器学习和文本分类等领域。

偏最小二乘回归方法主要的研究焦点是多因变量对多自变量的回归建模,它与普通多元回归方法在思路上的主要区别是它在回归建模过程中采用了信息综合与筛选技术。

它不再是直接考虑因变量集合与自变量集合的回归建模,而是在变量系统中提取若干对系统具有最佳解释能力的新综合变量(又称成分),然后对它们进行回归建模。

偏最小二乘回归可以将建模类型的预测分析方法与非模型式的数据内涵分析方法有机地结合起来,可以同时实现回归建模、数据结构简化(主成分分析)以及两组变量间的相关性分析(典型性关分析),即集多元线性回归分析、典型相关分析和主成分分析的基本功能为一体。

下面将简单地叙述偏最小二乘回归的基本原理。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

偏最小二乘回归

偏最小二乘回归(Partial Least Squares Regression,简称PLSR)是

一种主成分回归方法,旨在解决多元线性回归中自变量数目较多,且

存在共线性或多重共线性的问题。

本文将介绍偏最小二乘回归的原理、应用案例以及优缺点。

1. 偏最小二乘回归原理

偏最小二乘回归是基于多元线性回归的一种方法,通过压缩自变量

的空间,将高维的自变量转化为低维的潜在变量,从而避免了多重共

线性的问题。

在偏最小二乘回归中,我们定义两个主成分,其中第一

个主成分能最大化自变量与因变量之间的协方差,而第二个主成分垂

直于第一个主成分,以此类推。

2. 偏最小二乘回归应用案例

偏最小二乘回归在众多领域都有广泛的应用。

以下是一些常见的应

用案例:

2.1 化学分析

在化学领域中,我们常常需要使用红外光谱仪等仪器进行样本的分析。

然而,由于样本中存在大量的杂质,导致光谱数据存在共线性等

问题。

通过偏最小二乘回归可以降低样本数据的维度,提取出有用的

信息,从而准确地进行化学成分的分析。

2.2 生物医学

在生物医学领域中,研究人员常常需要通过大量的生理指标预测某

种疾病的发生风险。

然而,由于生理指标之间存在相互关联,使用传

统的线性回归模型时,很容易出现共线性的问题。

通过偏最小二乘回归,可以降低指标的维度,减少共线性对预测结果的影响,提高疾病

预测的准确性。

2.3 金融领域

在金融领域中,偏最小二乘回归也有广泛的应用。

例如,在股票市

场的分析中,研究人员常常需要通过一系列宏观经济指标预测股票的

涨跌趋势。

然而,这些指标之间往往存在较强的相关性,导致传统的

回归模型难以提取出有效的信息。

通过偏最小二乘回归,可以从多个

指标中提取出潜在的主成分,预测股票的涨跌趋势。

3. 偏最小二乘回归的优缺点

3.1 优点

(1)解决了多重共线性问题:偏最小二乘回归通过降低自变量的

维度,有效地解决了多重共线性问题,提高了模型的稳定性和准确性。

(2)提取了潜在的主成分:通过偏最小二乘回归,我们可以从高

维的自变量中提取出潜在的主成分,这些主成分更具有解释性,有助

于理解自变量与因变量之间的关系。

3.2 缺点

(1)依赖于主成分的选择:偏最小二乘回归在提取主成分时,需

要选择恰当的主成分数目,如果选择不当,可能会损失部分有用信息,导致模型的预测性能下降。

(2)易受异常值的干扰:偏最小二乘回归对异常值敏感,当样本

中存在极端值时,模型的效果可能会受到较大的影响。

4. 总结

偏最小二乘回归是一种强大的回归分析方法,通过降低自变量的维度,解决了多重共线性等问题。

在化学分析、生物医学、金融等领域

中都有广泛的应用。

然而,偏最小二乘回归也有一些局限性,包括主

成分选择和异常值的干扰。

在实际应用中,我们需要综合考虑这些因素,确保模型的有效性和稳定性。

参考文献:

[1] Wold S, Ruhe A, Wold H, et al. The collinearity problem in linear regression. The partial least squares (PLS) approach to generalized

inverses[J]. SIAM Journal on Scientific and Statistical Computing, 1984,

5(3): 735-743.

[2] Efron B, Hastie T, Johnstone I, et al. Least angle regression[J]. The Annals of Statistics, 2004, 32(2): 407-499.。