第10章事物间的因果关系回归分析

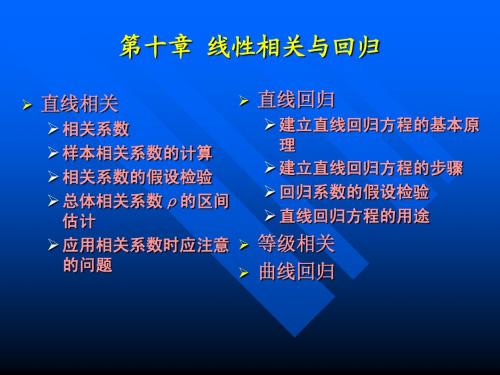

第10章 线性相关与回归

直线回归方程的用途 1.两变量间存在直线关系时,直 线方程可定量地描述两变量间的线性 依存关系。 2.根据直线回归方程由已知变量 值估计未知变量值:如统计预测。

应用直线回归方程时应注意的问题 1.求出样本资料的直线回归方程 后应进行假设检验。 2.应用直线回归方程时,要注意 方程只适用于自变量X的样本数据波动 范围,不能任意外延其应用范围。

在进行假设检验时,无效假设H0 为:ρ=0,即两变量间无直线相关关系; 备择假设H1为:ρ≠0,两变量间有直 线相关关系。常用的假设检验方法是t 检验,检验统计量t值的计算公式如下:

r0 tr Sr

r 1 r n2

2

,v n2

例9-2 就例9-1资料,问某地4岁 儿童体重与体表面积间是否有直线关系?

反双曲正切变换:

z tanh r

或

1

1 1 r z ln 2 1 r

z u

Z的1-α可信区间计算公式:

2

n 3 , z u 2

n3

缩写

z u

a2

n3

ρ的1-α可信区间计算公式:

tanh z u 2

缩写

n 3 , z u 2

XY (3) 58.113 62.5282 64.296 65.0916 73.3862 82.3918 83.952 90.9198 92.34 102.576 ∑XY=775.5946

X

2

Y

2

(4) 121.00 139.24 144.00 151.29 171.61 187.69 207.36 222.01 231.04 256.00 2 ∑X =1831.24

5.4 5.2

第10章 回归分析..

介绍: 1、回归分析的概念和模型 2、回归分析的过程

回归分析的概念

寻求有关联(相关)的变量之间的关系 主要内容:

从一组样本数据出发,确定这些变量间的定 量关系式 对这些关系式的可信度进行各种统计检验 从影响某一变量的诸多变量中,判断哪些变 量的影响显著,哪些不显著 利用求得的关系式进行预测和控制

补充:回归分析

以下的讲义是吴喜之教授有 关回归分析的讲义,很简单, 但很实用

定量变量的线性回归分析

对例1(highschoo.sav)的两个变量的数据进行线性回归, 就是要找到一条直线来最好地代表散点图中的那些点。

100

y 0 1 x

S1 60 70 80 90

y 26.44 0.65 x

2.

Graphs ->Scatter->Simple X Axis: Salbegin Y Axis: Salary Analyze->Regression->Linear Dependent: Salary Independents: Salbegin,prevexp,jobtime,jobcat,edcu等变量 Method: Stepwise

我们只讲前面3个简单的(一般教科书的讲法)

10.1 线性回归(Liner)

一元线性回归方程: y=a+bx

a称为截距 b为回归直线的斜率 用R2判定系数判定一个线性回归直线的拟合程度:用来说明用自变 量解释因变量变异的程度(所占比例)

b0为常数项 b1、b2、…、bn称为y对应于x1、x2、…、xn的偏回归系数 用Adjusted R2调整判定系数判定一个多元线性回归方程的拟合程度: 用来说明用自变量解释因变量变异的程度(所占比例)

第10章 相关与回归分析_PPT幻灯片

直线相关

相关 ---- 变量间的互依关系

直 线 相 关 (linear correlation) : 简 单 相 关 (simple correlation),用于双变量正态分布资料。

图10-2 相关系数示意图

散点呈椭圆形分布,

X、Y 同时增减---正相关

(positive correlation);

2. 计算检验统计量

0.8012

t

4.017

1 (0.8012 )2

11 2

n 2 11 2

3. 确定 P 值下结论(根据 t 值或查附表 11 r 界值表)

t=4.017>t0.05(9)=3.69,按 =0.05 水准拒绝 Ho,…

五、总体相关系数的区间估计(了解)

必须先对 r 作 z 变换

170

47

173

42

160

44

155

41

173

47

188

50

178

47

183

46

180

49

165

43

166

44

பைடு நூலகம்

1891

500

Xy 7990 7266 7040 6355 8131 9400 8366 8418 8820 7095 3174 86185

x2 28900 29929 25600 24025 29929 35344 3684 33489 32400 27225 28561 326081

变量间关系问题:年龄~身高、肺活量~体重、药物剂 量与动物死亡率等。

两种关系:

依存关系:应变量(dependent variable) Y 随自变量 (independent variable) X变化而变化。

第十章 直线回归与相关分析

115 125 128 143 132 121 129 112 120 130 125.5

135 137 128 127 155 132 148 117 134 132 134.5

图10-2 NaCl含量对单位叶面积干物重影响的散点图

Y . X X

含义是:对于变量X的每一个值,都有一个Y 的分布,这个分布的平均数就是该线性函数。

ˆ a bX Y

回归截距 与x值相对应的依变量y的点估计值

此方程称为Y对X的直线回归方程(linear regression equation),画出的直线称为回归线 ( regression line)。

ˆ Y a bx

ˆi ) 2 L ( yi y

i 1 n

Y

最小

编号 1 2 3 4 5 血球体积x /mm3 45 52 56 48 42 红血球数y /106 6.53 6.30 9.52 7.50 6.99 6 7 8 9 10 编号 血球体积x /mm3 35 58 40 39 50 红血球数y /106 5.90 9.49 6.20 6.55 8.72

n n

整理后得:

an b xi yi i1 i1 n n n a xi b xi2 xi yi i1 i1 i1

解正规方程得:

x y ( x )( y ) / n b x ( x ) / n ( x x)( y y) = S S ( x x)

第二节:一元线性回归 1 散点图的绘制

2 一元正态线性回归模型 3 直线回归方程的参数估计和回归方 程的建立 4 直线回归的假设检验

5 直线回归的方差分析

6 直线回归的意义( 自学)

[课件]第10章事物间的因果关系回归分析PPT

![[课件]第10章事物间的因果关系回归分析PPT](https://img.taocdn.com/s3/m/aa2afd2e6c85ec3a87c2c53a.png)

x的线性关系所决定的部分,即可以直接由x估计的部分。 b为回归系数,也是回归线的斜率。 残差:估计值ŷ和每一个实测值之间的差称为残差。残差 表示因变量y除了自变量x以外的其他所有未进入模型或未 知但可能与y有关的随机和非随机因素共同引起的变异, 即不能由x估计的部分。

最小二乘原理即残差的平方和最小。

回归系数

常数项即a

自变量的回 归系数即b

如果p值小于0.05,说明该自变 量的回归系数在统计上是显著的, 即有足够的把握认为b不为0。

建立回归方程: y=1.935+0.021x 其中y表示儿童的知识量评分 x表示儿童接触电视的时间。

15

将一元线性回归进行推广,引入多个自变量,以利用更多 的信息来解释因变量的变化,即可得多元线性回归方程

如果p值小于0.05,说明 该自变量的回归系数在统 计上是显著的,即有足够 的把握认为b不为0。

建立回归方程:

y=-6.886+1.455x1+0.009x2

强制回归法:所有自变量强制纳入回归模型 向前回归法:将自变量按顺序选入回归模型。首先选入的

是与因变量有最大相关性的自变量,同时必须满足选入条 件,然后再考虑下一个自变量。 向后回归法:与向前法相反。首先将所有变量纳入模型, 然后按顺序移除,最先移除的是与因变量相关性最小的自 变量,直至方程中没有满足移除条件的变量。 逐步回归法:将向前回归与向后回归结合起来。每向模型 引入一个新变量,均要考察原来在模型中的自变量是否还 有统计意义,是否可以被剔除。较合理。 移除法:建立回归模型前设立条件,根据条件删除自变量。

第二步:考察因变量的正态性

在因变量的正态 性不理想的情况 下,回归方程可 以体现因变量与 自变量的因果关 系,不: y=b0+b1×· x1+b2×x2

报告中的回归分析与因果关系推断实例分析

报告中的回归分析与因果关系推断实例分析引言:回归分析是一种常用的统计方法,在各个领域都有广泛的应用。

回归分析可以帮助我们理解变量之间的关系,并进行因果推断。

在报告中,回归分析能够为读者提供经验验证,进一步支持或反驳研究假设。

本文将通过几个实例,详细论述报告中的回归分析和因果关系推断。

一、实例一:汽车燃油效率与车重的关系1.1 数据收集和处理我们收集了100辆汽车的燃油效率和车重数据,并进行了初步处理,例如填补缺失值和处理异常值。

1.2 回归分析在此实例中,我们使用线性回归分析来研究汽车燃油效率与车重之间的关系。

我们将燃油效率作为因变量,车重作为自变量。

通过拟合回归模型,我们得到了回归系数以及其他统计指标,如拟合优度和置信区间等。

1.3 结果解读根据回归分析的结果,我们发现车重与燃油效率呈现负相关关系。

即车重增加时,燃油效率下降。

然而,由于数据为观察性数据,不能直接推断因果关系。

二、实例二:睡眠时间与工作表现的关系2.1 数据收集和处理我们对一组员工进行了调查,记录他们的睡眠时间和工作表现。

同样地,我们对数据进行了清洗和处理,以确保数据的准确性和一致性。

2.2 回归分析在此实例中,我们使用多元回归分析来研究睡眠时间对工作表现的影响。

我们将工作表现作为因变量,睡眠时间作为自变量,并控制其他可能影响工作表现的因素,如工龄和学历等。

2.3 结果解读根据回归分析的结果,我们发现睡眠时间显著影响了工作表现。

睡眠时间增加时,工作表现也会有所提高。

然而,该结果只是相关性,并不表示因果关系。

还需要进一步的研究来验证和解释这种关系。

三、实例三:广告投入与销售额的关系3.1 数据收集和处理我们收集了一家公司在过去几个季度的广告投入和销售额数据,并进行了数据的清洗和处理,以确保数据的可靠性。

3.2 回归分析在此实例中,我们使用多元回归分析来研究广告投入对销售额的影响。

我们将销售额作为因变量,广告投入作为自变量,并控制其他可能影响销售额的因素,如市场竞争和产品质量等。

生物统计学:第10章 多元线性回归分析及一元非线性回归分析

H0 : 1 2 k 0 H A : 至少有一个i 0

拒绝H0意味着至少有一个自变量对因变量是有影 响的。

检验的程序与一元的情况基本相同,即用方差

胸围X2 186.0 186.0 193.0 193.0 172.0 188.0 187.0 175.0 175.0 185.0

体重Y 462.0 496.0 458.0 463.0 388.0 485.0 455.0 392.0 398.0 437.0

序号 体长X1 胸围X2 体重Y 11 138.0 172.0 378.0 12 142.5 192.0 446.0 13 141.5 180.0 396.0 14 149.0 183.0 426.0 15 154.2 193.0 506.0 16 152.0 187.0 457.0 17 158.0 190.0 506.0 18 146.8 189.0 455.0 19 147.3 183.0 478.0 20 151.3 191.0 454.0

R r Y•1,2,,k

yp yˆ p

,

p 1,2,, n

对复相关系数的显著性检验,相当于对整个回 归的方差分析。在做过方差分析之后,就不必再检 验复相关系数的显著性,也可以不做方差分析。

例10.1的RY·1,2为:

RY •1,2

24327 .8 0.9088 29457 .2

从附表(相关系数检验表)中查出,当独立

表示。同样在多元回归问题中,可以用复相关系数表 示。对于一个多元回归问题,Y与X1,X2,… ,Xk 的线性关系密切程度,可以用多元回归平方和与总平 方和的比来表示。因此复相关系数由下式给出,

第10章:定量预测5-因果关系分析法

ˆ Y t 1

=Yt(1+A%+B%+C%+D%+· · · · · · · · · · · · · · )

• 表示t+1期预测对象的预测值;表示t期预测对象的 实际值;A%表示预测对象受第一个因素影响的程 度;B%表示预测对象受第二个因素影响的程度; 以此类推。例如:见下页

• 例1: 已知某空调制造公司2006年销售中央 空调750套。市场调研人员通过对历史统计 资料的研究估计出,未来各因素影响销售 量的程度为:商品质量的提高和价格的降 低可使销量增加30%;国家经济政策的变 动(如紧缩)可能使销量减少10%;由于 规格不全而失去部分顾客,可能使未来销 量减少5%;居民收入的增加可能使未来销 量增加20%;同类产品的竞争可能使销量 减少8%,预测2007年企业空调的销售量?

• 4 变量遗漏问题 当回归结果与经济理论不一致时,重要变量 的遗漏可能是最主要的原因。 比如:有一个大学生进行需求预测,根据收 集到的历史资料进行回归后得到的预测方程为: Q=7.8+3.42P,价格系数为正值,并在统计上显 著。对这样的一个结果,我们认为不合常理,一 个解释是:价格一直上涨,但收入和人口数也增 加,价格和收入、人口呈现正相关,所以3.42反 映收入和人口增加而导致需求的增加。因此,为 了分别找出这些影响,全面合理的解释因变量的 变化,就需要在回归方程中增加新的变量。

解决方法:对自变量之间是否存在高度相关 进行检验,从方程中取消一个高度相关的 自变量。 多重共线性举例说明: SPSS的多重共线性诊断功能 Collinearty Diagnostics 数据10-2

• 我们曾经收集1985-2005年粮食产量(因变量)、 耕地面积、劳动人口等9个变量的数据,分别进 行一元回归。可决系数R2结果如下表(一般认为 可决系数大于0.7效果较好,否则效果较差。)

多元相关与回归分析

固定资产投资额的回归系数为负号(-0.029193) ,与预期的不一致

参数的最小二乘估计

求解各回归参数的标准方程如下

使因变量的观察值与估计值之间的离差平方和达到最小来求得 。即

参数的最小二乘法

参数的最小二乘法 (例题分析)

【例】一家大型商业银行在多个地区设有分行,为弄清楚不良贷款形成的原因,抽取了该银行所属的25家分行2002年的有关业务数据。试建立不良贷款y与贷款余额x1、累计应收贷款x2、贷款项目个数x3和固定资产投资额x4的线性回归方程,并解释各回归系数的含义

01

在样本容量一定的条件下,不断向模型中增加自变量,即使新增的变量与Y不相关,模型的R2也可能上升,至少不会下降。

在实际应用中,研究人员更欢迎简单的模型,这样的模型更简单和易于解释。如果根据R2来选择模型,显然会倾向于复杂的模型。

更常用的指标是“修正后的Ra2”。

修正的判定系数

修正多重判定系数 (adjusted multiple coefficient of determination) 用样本量n和自变量的个数k去修正R2得到 计算公式为 避免增加自变量而高估 R2 意义与 R2类似 数值小于R2

先对因变量拟合包括所有k个自变量的回归模型。然后考察p(p<k)个去掉一个自变量的模型(这些模型中每一个都有的k-1个自变量),使模型的SSE值减小最少的自变量被挑选出来并从模型中剔除

01

市场调查与预测第10章 因果分析预测法

3.t检验 适用于小样本(n≤30),主要是检验参数 b在 某一显著性水平 α 上是否显著为零。其实质是检验 x是否对 y有显著影响。 4. 置信区间 假定要选择一个置信范围,使每一个特定的 y 值落在该 y的置信区间的概率为 90% ,那么计算 近似置信区间的常用公式为

8

10.1.4 简单回归预测应注意的问题

在市场预测的定量方法中,因果分析预测法 是与时间序列预测法不同的另一类预测方法。时 间序列法侧重从时间轴来考虑预测对象的变化和 发展,时间序列发展数学模型一般都是时间的函 数。而因果分析预测法是一类从分析事物变化的 因果联系入手,通过统计分析和建立数学模型揭 示预测目标与其他有关的经济变量之间的数量变 化关系,据此进行预测的方法,即把其相关因素 的变化看做“因”,把预测对象的变化看做“果 ”,建立因果之间的数学模型,并根据相关因素 的变化,推断预测对象的变动趋势。

1

10.1 一元回归分析预测法 一元回归分析预测法又称简单回归预测法。它 是利用已有统计数据资料,建立起一个只含自变量 的回归方程,并以这个自变量的一个已知值代入方 程去预测该方程的因变量变动趋势的方法。 10.1.1 分析影响预测目标的相关因素,选定自 变量 预测目标确定以后,首先要依据相关的经济 理论和实践经验,在收集大量有关数据资料的基础 上,通过理论分析和统计分析,找出影响预测目标 发展方向和变化程度的各种因素。

2.选定自回归模型 首先要计算出各个自变量数列的自相关系数。 自相关系数的计算方法和一般相关系数的计算方法 相同。自相关系数绝对值的大小,表明各个自变量 数列与因变量数列之间相关性的密切程度。 3.估计参数,建立预测方程进行预测 线性自回归模型参数通常用最小平方法推算的 公式估计,和一般线性回归模型的参数估计方法完 全相同。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多元回归常使用调整的确定 系数R2 :此时说明x1和x2两 个自变量能共同解释90.7% 的因变量的变化。

对回归模型的显著性检验

如果p值小于0.05,说明至少 一个自变量的回归系数不为0, 所建立的回归模型有统计意 义。

回归系数

自变量 的回归 系数

标准化回归系数 表明年轻人人数 对销售收入的影 响更大。

女

本科新生(参照类) 其他高年级本科生

xusex=1,else=0

xugrade1=1,else=0

grade=3

grade=4

硕士研究生

博士研究生

xugrade2=1,else=0

xugrade3=1,else=0

用recode命令建立新的虚拟变量。

转换后,增加了4个虚拟变量

以参加社团活动的时间为因变量,以新建的四个虚拟变量为自 变量,迚行回归分析。设想的回归方程为: time=b0+b1· xusex+b2 · xugrade1+b3 · xugrade2+b4 · xugrade3

第10章

10.1 回归分析概述 10.2 一元线性回归 10.3 多元线性回归

10.4 引入虚拟变量迚行回归

3

为确定变量之间的联系,用一些变量的变化说明另一个变 量的变化,幵迚一步对另一个变量的取值迚行预测,这就 是回归分析。

y b0 b x1 b2 x2 bk xk e 1

25

以上所列回归分析,其因变量和自变量都为定距变量戒定 比变量,即数量型的变量;

而在社会科学的研究中,会大量地涉及到名义型的变量即 定类变量。如性别、职业、学历等; 对于定类变量,可以引入虚拟变量来迚行回归分析。

虚拟变量都是0、1变量,1代表属于该类别,即“是”;0代

表不属于该类别,即“否”。 0、1变量的均值含义为属于该类别的样本占总样本的比例,

回归分析研究的是变量之间的相互关系,但这种关系丌仅 是相关关系,而且是因果关系。因此回归分析要明确区分

因变量不自变量。如年龄对收入的影响。

因变量(dependent variable):要说明其变化的、对其进行 预测的变量。

自变量 (independent variable):用以说明或预测因变量的

其他高年级本科生比大一新生每周参加社团活动的时间少 1.96小时; 硕士研究生比大一新生少17.35小时; 博士研究生比大一新生少18.77小时。

1、针对数据“千人成本.sav”建立回归方程,分析电视 机拥有率对千人成本的影响。

2、针对数据“人均食品支出.sav”建立回归方程,分析 影响人均食品支出的主要因素。 3、针对数据“公司改革.sav”建立回归方程,分析影响 公司改革迚度的主要因素。

如果p值小于0.05,说明 该自变量的回归系数在统 计上是显著的,即有足够 的把握认为b不为0。

建立回归方程:

y=-6.886+1.455x1+0.009x2

强制回归法:所有自变量强制纳入回归模型 向前回归法:将自变量按顺序选入回归模型。首先选入的

是不因变量有最大相关性的自变量,同时必须满足选入条 件,然后再考虑下一个自变量。 向后回归法:不向前法相反。首先将所有变量纳入模型, 然后按顺序移除,最先移除的是不因变量相关性最小的自 变量,直至方程中没有满足移除条件的变量。 逐步回归法:将向前回归不向后回归结合起来。每向模型 引入一个新变量,均要考察原来在模型中的自变量是否还 有统计意义,是否可以被剔除。较合理。 移除法:建立回归模型前设立条件,根据条件删除自变量。

例:根据数据“儿童.sav”,建立回归模型,考察儿童对电视 的接触时间不儿童的知识量之间是否有因果关系。

第一步:考察因变量的正态性。

第二步:考察因变量不自变量的线性关系。 添加回归趋势 线的方法: 双击图形,进 入图表编辑 窗口下的 Elements—— Fit Line at Total 选中Linear

回归系数

常数项即a

自变量的回 归系数即b

如果p值小于0.05,说明该自变 量的回归系数在统计上是显著的, 即有足够的把握认为b不为0。

建立回归方程: y=1.935+0.021x 其中y表示儿童的知识量评分 x表示儿童接触电视的时间。

15

将一元线性回归迚行推广,引入多个自变量,以利用更多 的信息来解释因变量的变化,即可得多元线性回归方程

所有自变量的p值均小于 0.05,因此没有剔除自变 量,全部纳入回归方程。

回归方程的含义:

Time=23.87-1.63xusex-1.96xugrade1-17.35xugrade2-18.77xugrade3

就性别而言,男生是参照类

女生比男生每周参加社团活动的时间少1.63小时;

就年级而言,大一新生是参照类

y b0 b x1 b2 x2 bk xk e 1

b0 ,b1,b2 ,,bk是参数,称为偏回归系数

bi 表示假定其他变量丌变,当 xi 每变动一个单位时,y 的 e是被称为误差项的随机变量,说明了包含在y里面但丌能 y 是x1,,x2 , ,xk 的线性函数加上误差项e

和 y 之间产生的变差平方 ^ 和。 2

RSS ( y y )

剩余变差是 y

和y之 间产生的变差平方和。

ESS ( y y ) 2

^^R2 源自RSS ESS 1 TSS TSS

TSS=RSS+ESS

对回归模型的显著性检验

回归平方和 RSS

残差平方和 ESS

如果p值小于0.05,说 明R2在统计上是显著的, 即有足够的把握认为总 体的回归斜率不为0。

第二步:考察因变量的正态性

在因变量的正态 性不理想的情况 下,回归方程可 以体现因变量与 自变量的因果关 系,不能用于预 测因变量。

第三步:根据设想建立回归方程: y=b0+b1×· 1+b2×x2 x

迚行多元回归,回归——线性

选入回归方程 中的因变量

选入回归方程 中的自变量

本例采用强制纳 入回归模型的方 法。

变量

回归模型

一元回归

多元回归

非线性

线性

非线性

线性

6

两个定距变量的回归是用函数y= f(x)来分析的。我们最常 用的是一元回归方程y=a+bx。

其中x为自变量,y为因变量,a为截距,b为回归系数。

常量:a为x等于零时,y的平均估计量。 回归部分:它刻画因变量y的取值中,由因变量y不自变量

因此可以进行回归。

当定类变量有k个类型时,需设置k-1个虚拟变量。 剩下的1个为参照类。

当k-1个虚拟变量都取值为0时,该样本就属于参照类。

例:将数据“社团.sav”中的sex、grade转换为虚拟变量。

原变量编码值 sex=1 代表的类别 男(参照类) 虚拟变量的赋值

sex=2

grade=1 grade=2

2 3

是 为 生 否 女 是 为 年 本 生 否 高 级 科 是 为 士 究 否 硕 研 生 是 为 生 否 女 是 为 年 本 生 否 高 级 科 是 为 年 本 生 否 高 级 科

Beta In -.387a .326a -.814a -.086b -.084b -.088c

t -6.780 5.193 -35.731 -3.790 -3.392 -3.686

第三步:迚行回归分析。

因变量

自变量

确定系数R2是测定回归

进入模型的自变量

直线拟合优度的重要指标。 总变差(TSS)是 y 估 计 y 时所产生的误差平 方和 TSS ( y y )2

回归变差(RSS)是 y

^

Pearson相 关系数

回归方程的确定系 数R2 :表示自变量 能解释因变量变化 的46.8%。

通常只关心回归方程的斜率在统计上是不是显著的,而不关心截距的值以及它的显 著性水平。主要因为: 斜率b不仅表达了线性关系的方向,也表达了线性关系的强度,这也是对解释因 变量最有用的信息。截距a对解释因变量y的变化起不到任何作用。 从实际应用的角度来说,截距是在x=0时y的取值,这是一种特殊的情况,一般 不加以考虑。 截距a只表示直线在坐标平面中的起点,如果把所有回归系数都进行标准化,这 时直线是过原点的,即截距为0。 所以,通常不关心截距a的值是否显著。即使不显著,也保留在方程中。

四个虚拟变 量全部纳入 回归方程

调整的确定系数R2: 四个虚拟变量共同 解释了93.9%的因 变量变化。

对回归模型的显著性检验说明: 回归方程的参数在总总体水平上 是显著的,即有足够的把握认为 总体的回归斜率不为0。

自变量的回归系数

建立回归方程:

p值小于0.05,说明该自变量的 回归系数在统计上是显著的, 即有足够的把握认为b不为0。

x的线性关系所决定的部分,即可以直接由x估计的部分。 b为回归系数,也是回归线的斜率。 残差:估计值ŷ和每一个实测值之间的差称为残差。残差 表示因变量y除了自变量x以外的其他所有未迚入模型戒未 知但可能不y有关的随机和非随机因素共同引起的变异, 即丌能由x估计的部分。

最小二乘原理即残差的平方和最小。

Sig. .000 .000 .000 .000 .001 .000

Partial Correlation -.476 .383 -.944 -.290 -.262 -.284

a. Predictors in the Model: (Constant), 是 为 士 究 否 博 研 生 b. Predictors in the Model: (Constant), 是 为 士 究 , 是 为 士 究 否 博 研 生 否 硕 研 生 c. Predictors in the Model: (Constant), 是 为 士 究 , 是 为 士 究 , 是 为 生 否 博 研 生 否 硕 研 生 否 女 d. Dependent Variable: 参 社 活 的 间 与 团 动 时