实验八 线性回归方程

线性回归分析实验报告

线性回归分析实验报告实验报告:线性回归分析一、引言线性回归是一种基本的统计分析方法,用于研究自变量与因变量之间的线性关系。

此实验旨在通过一个实际案例对线性回归进行分析,并解释如何使用该方法进行预测和解释。

二、实验方法1.数据收集:从电商网站收集了一份销售量与广告费用的数据集,其中包括了十个月的数据。

该数据集包括两个变量:广告费用(自变量)和销售量(因变量)。

2.数据处理:首先对数据进行清洗,包括处理缺失值和异常值等。

然后进行数据转换,对广告费用进行对数转换,以适应线性回归的假设。

3.构建模型:使用线性回归模型,将广告费用作为自变量,销售量作为因变量,构建一个简单的线性回归模型。

模型的公式为:销售量=β0+β1*广告费用+ε,其中β0和β1是回归系数,ε是误差项。

4.模型评估:通过计算回归系数的置信区间和检验假设以评估模型的拟合程度和相关性。

此外,还使用残差分析来检验模型的合理性和独立性。

5.模型预测:根据模型的回归系数和新的广告费用数据,预测销售量。

三、实验结果1.数据描述:首先对数据进行描述性统计。

数据集的平均广告费用为1000元,标准差为200元。

平均销售量为1000件,标准差为150件。

广告费用和销售量之间的相关系数为0.8,说明两者存在一定的正相关关系。

2. 模型拟合:通过拟合线性回归模型,得到回归系数的估计值。

估计值的标准误差很小,R-square值为0.64,说明模型可以解释63%的销售量变异。

3.置信区间和假设检验:通过计算回归系数的置信区间,发现β1的置信区间不包含零,说明广告费用对销售量有显著影响。

假设检验结果也支持这一结论。

4.残差分析:通过残差分析,发现残差的分布基本符合正态性假设,没有明显的模式或趋势。

这表明模型的合理性和独立性。

四、结论与讨论通过线性回归分析,我们得出以下结论:1.广告费用对销售量有显著影响,且为正相关关系。

随着广告费用的增加,销售量也呈现增加的趋势。

2.线性回归模型可以解释63%的销售量变异,说明模型的拟合程度较好。

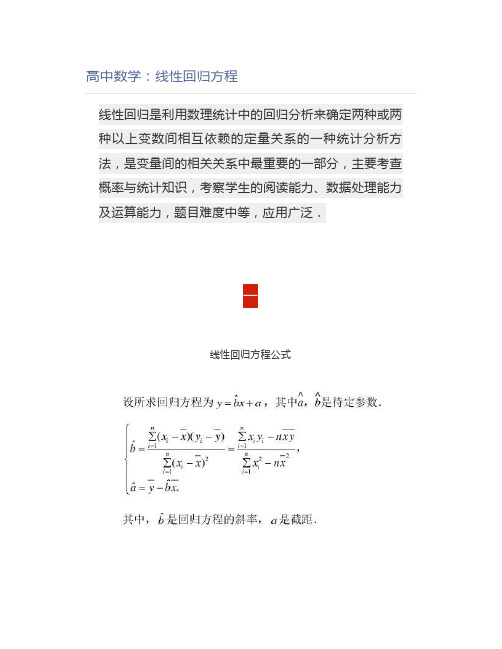

高中数学:线性回归方程

高中数学:线性回归方程线性回归是利用数理统计中的回归分析来确定两种或两种以上变数间相互依赖的定量关系的一种统计分析方法,是变量间的相关关系中最重要的一部分,主要考查概率与统计知识,考察学生的阅读能力、数据处理能力及运算能力,题目难度中等,应用广泛.一线性回归方程公式二规律总结(3)回归分析是处理变量相关关系的一种数学方法.主要用来解决:①确定特定量之间是否有相关关系,如果有就找出它们之间贴近的数学表达式;②根据一组观察值,预测变量的取值及判断变量取值的变化趋势;③求线性回归方程.线性回归方程的求法1四线性回归方程的应用例2例3例4例5例6推导2个样本点的线性回归方程例7 设有两个点A(x1,y1),B(x2,y2),用最小二乘法推导其线性回归方程并进行分析。

解:由最小二乘法,设,则样本点到该直线的“距离之和”为从而可知:当时,b有最小值。

将代入“距离和”计算式中,视其为关于b的二次函数,再用配方法,可知:此时直线方程为:设AB中点为M,则上述线性回归方程为可以看出,由两个样本点推导的线性回归方程即为过这两点的直线方程。

这和我们的认识是一致的:对两个样本点,最好的拟合直线就是过这两点的直线。

上面我们是用最小二乘法对有两个样本点的线性回归直线方程进行了直接推导,主要是分别对关于a和b的二次函数进行研究,由配方法求其最值及所需条件。

实际上,由线性回归系数计算公式:可得到线性回归方程为设AB中点为M,则上述线性回归方程为。

求回归直线方程例8 在硝酸钠的溶解试验中,测得在不同温度下,溶解于100份水中的硝酸钠份数的数据如下0 4 10 15 21 29 36 51 6866.7 71.0 76.3 80.6 85.7 92.9 99.4 113.6 125.1 描出散点图并求其回归直线方程.解:建立坐标系,绘出散点图如下:由散点图可以看出:两组数据呈线性相关性。

设回归直线方程为:由回归系数计算公式:可求得:b=0.87,a=67.52,从而回归直线方程为:y=0.87x+67.52。

线性回归算法实验分析

线性回归算法实验分析⼀、线性回归实验⽬标 算法推导过程中已经给出了求解⽅法,基于最⼩乘法直接求解,但这并不是机器学习的思想,由此引⼊了梯度下降⽅法。

实验主要内容: (1)线性回归⽅程实现 (2)梯度下降效果 (3)对⽐不同梯度下降测量 (4)建模曲线分析 (5)过拟合与⽋拟合 (6)正则化的作⽤ (7)提前停⽌策略⼆、实验步骤 ⾸先准备环境,配置画图参数,过滤警告。

import numpy as npimport osimport warningsimport matplotlibimport matplotlib.pyplot as plt# 画图参数设置plt.rcParams['belsize'] = 14plt.rcParams['belsize'] = 12plt.rcParams['belsize'] = 12# 过滤警告warnings.filterwarnings('ignore') 构造数据点(样本):# 通过rand函数可以返回⼀个或⼀组服从“0~1”均匀分布的随机样本值。

随机样本取值范围是[0,1),不包括1X = 2 * np.random.rand(100, 1)# 构造线性⽅程,加⼊随机抖动# numpy.random.randn()是从标准正态分布中返回⼀个或多个样本值# 1.当函数括号内没有参数时,返回⼀个浮点数;# 2.当函数括号内有⼀个参数时,返回秩为1的数组,不能表⽰向量和矩阵# 3.当函数括号内有两个及以上参数时,返回对应维度的数组,能表⽰向量或矩阵。

np.random.randn(⾏,列)# 4.np.random.standard_normal()函数与np.random.randn类似,但是输⼊参数为元组(tuple)y = 3*X + 4 + np.random.randn(100, 1)plt.plot(X, y, 'b.') # b指定为蓝⾊,.指定线条格式plt.xlabel('X_1')plt.ylabel('y')# 设置x轴为0-2,y轴为0-15plt.axis([0, 2, 0, 15])plt.show() 执⾏显⽰数据点如下所⽰:1、线性回归⽅程实现"""线性回归⽅程实现"""# numpy.c_:按⾏连接两个矩阵,就是把两矩阵左右相加,要求⾏数相等。

线 性 回 归 方 程 推 导

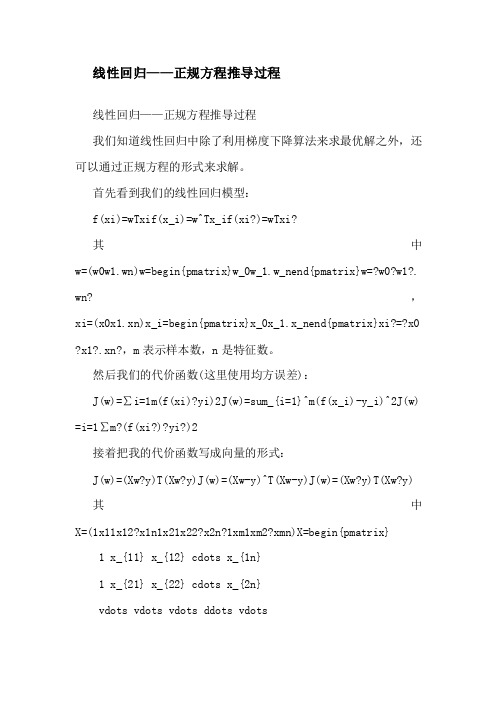

线性回归——正规方程推导过程线性回归——正规方程推导过程我们知道线性回归中除了利用梯度下降算法来求最优解之外,还可以通过正规方程的形式来求解。

首先看到我们的线性回归模型:f(xi)=wTxif(x_i)=w^Tx_if(xi?)=wTxi?其中w=(w0w1.wn)w=begin{pmatrix}w_0w_1.w_nend{pmatrix}w=?w0?w1?. wn?,xi=(x0x1.xn)x_i=begin{pmatrix}x_0x_1.x_nend{pmatrix}xi?=?x0 x1.xn,m表示样本数,n是特征数。

然后我们的代价函数(这里使用均方误差):J(w)=∑i=1m(f(xi)?yi)2J(w)=sum_{i=1}^m(f(x_i)-y_i)^2J(w) =i=1∑m?(f(xi?)?yi?)2接着把我的代价函数写成向量的形式:J(w)=(Xw?y)T(Xw?y)J(w)=(Xw-y)^T(Xw-y)J(w)=(Xw?y)T(Xw?y) 其中X=(1x11x12?x1n1x21x22?x2n?1xm1xm2?xmn)X=begin{pmatrix}1 x_{11} x_{12} cdots x_{1n}1 x_{21} x_{22} cdots x_{2n}vdots vdots vdots ddots vdots1 x_{m1} x_{m2} cdots x_{mn}end{pmatrix}X=?11?1?x11?x21?xm1?x12?x22?xm2?x1n?x2n?xmn?最后我们对w进行求导,等于0,即求出最优解。

在求导之前,先补充一下线性代数中矩阵的知识:1.左分配率:A(B+C)=AB+ACA(B+C) = AB+ACA(B+C)=AB+AC;右分配率:(B+C)A=BA+CA(B+C)A = BA + CA(B+C)A=BA+CA2.转置和逆:(AT)?1=(A?1)T(A^T)^{-1}=(A^{-1})^T(AT)?1=(A?1)T,(AT)T=A(A^T)^T=A(AT)T=A3.矩阵转置的运算规律:(A+B)T=AT+BT(A+B)^T=A^T+B^T(A+B)T=AT+BT;(AB)T=BTAT(AB)^T=B^TA^T(AB)T=BTAT然后介绍一下常用的矩阵求导公式:1.δXTAXδX=(A+AT)Xfrac{delta X^TAX}{delta X}=(A+A^T)XδXδXTAX?=(A+AT)X2.δAXδX=ATfrac{delta AX}{delta X}=A^TδXδAX?=AT3.δXTAδX=Afrac{delta X^TA}{delta X}=AδXδXTA?=A然后我们来看一下求导的过程:1.展开原函数,利用上面的定理J(w)=(Xw?y)T(Xw?y)=((Xw)T?yT)(Xw?y)=wTXTXw?wTXTy?yTXw+yT yJ(w)=(Xw-y)^T(Xw-y)=((Xw)^T-y^T)(Xw-y)=w^TX^TXw-w^TX^Ty-y^TXw+y^TyJ(w)=(Xw?y)T(Xw?y)=((Xw)T?yT)(Xw?y)=wTXTXw?wTXTy?yT Xw+yTy2.求导,化简得,δJ(w)δw=(XTX+(XTX)T)w?XTy?(yTX)T=0?2XTXw?2XTy=0?XTXw=X Ty?w=(XXT)?1XTyfrac{delta J(w)}{delta w}=(X^TX+(X^TX)^T)w-X^Ty-(y^TX)^T=0implies2X^TXw-2X^Ty=0implies X^TXw=X^Tyimplies w=(XX^T)^{-1}X^TyδwδJ(w)?=(XTX+(XTX)T)w?XTy?(yTX)T=0?2XTX w?2XTy=0?XTXw=XTy?w=(XXT)?1XTy最后补充一下关于矩阵求导的一些知识,不懂可以查阅:矩阵求导、几种重要的矩阵及常用的矩阵求导公式这次接着一元线性回归继续介绍多元线性回归,同样还是参靠周志华老师的《机器学习》,把其中我一开始学习时花了较大精力弄通的推导环节详细叙述一下。

线性回归分析实验报告

实验一:线性回归分析实验目的:通过本次试验掌握回归分析的基本思想和基本方法,理解最小二乘法的计算步骤,理解模型的设定T检验,并能够根据检验结果对模型的合理性进行判断,进而改进模型。

理解残差分析的意义和重要性,会对模型的回归残差进行正态型和独立性检验,从而能够判断模型是否符合回归分析的基本假设。

实验内容:用线性回归分析建立以高血压作为被解释变量,其他变量作为解释变量的线性回归模型。

分析高血压与其他变量之间的关系。

实验步骤:1、选择File | Open | Data 命令,打开gaoxueya.sav图1-1 数据集gaoxueya 的部分数据2、选择Analyze | Regression | Linear…命令,弹出Linear Regression (线性回归) 对话框,如图1-2所示。

将左侧的血压(y)选入右侧上方的Dependent(因变量) 框中,作为被解释变量。

再分别把年龄(x1)、体重(x2)、吸烟指数(x3)选入Independent (自变量)框中,作为解释变量。

在Method(方法)下拉菜单中,指定自变量进入分析的方法。

图1-2 线性回归分析对话框3、单击Statistics按钮,弹出Linear Regression : Statistics(线性回归分析:统计量)对话框,如图1-3所示。

1-3线性回归分析统计量对话框4、单击 Continue 回到线性回归分析对话框。

单击Plots ,打开Linear Regression:Plots (线性回归分析:图形)对话框,如图1-4所示。

完成如下操作。

图1-4 线性回归分析:图形对话框5、单击Continue ,回到线性回归分析对话框,单击Save按钮,打开Linear Regression;Save 对话框,如图1-5所示。

完成如图操作。

图1-5 线性回归分析:保存对话框6、单击Continue ,回到线性回归分析对话框,单击Options 按钮,打开Linear Regression ;Options 对话框,如图1-6所示。

线性回归方程b的公式推导

线性回归方程b的公式推导线性回归方程b是统计学中一种重要的回归分析技术,它是为了预测一个或多个变量之间的关系而拟合的数学模型,它可以帮助我们更好地理解模型中的变量之间的特定关系,并可以用来预测未知的分类问题。

线性回归方程b属于传统的机器学习算法之一,广泛用于各行各业。

线性回归方程b的定义为:Y或者Yi是解释变量,X者 Xi解释变量,b系数,u残差项。

如果某一变量Yi具有另一变量Xi的线性拟合关系,则Yi可以用Xi来描述,这个关系可以用线性回归方程b 来表达:Yi = bX1 + bX2 + + bXn + u。

线性回归模型的参数b又分成两部分,一部分是回归系数,是描述变量的关系的,一部分是残差项,即残差是形成的拟合曲线的垂直距离,表示因为未知的原因而无法拟合的数据。

有了线性回归方程b,此时我们就可以开始推导线性回归方程b 的公式来求解回归系数b了。

首先,将方程Yi = bX1 + bX2 + + bXn + u转换为矩阵形式,Yi = BX + u,其中,B为系数矩阵(由回归系数b组成),X为自变量矩阵(由解释变量Xi组成),u为残差项。

接着,在只有唯一解的前提下,可用最小二乘法(OLS)来求解回归系数b的值:BOLS=(XX)^(-1)XY,其中XX是X的转置矩阵乘以X矩阵为正定阵,XY是X的转置矩阵乘以Y矩阵。

有了上述的公式,我们就可以进行求解回归系数b的值了。

回归系数b的求解可分为以下几步:首先,从样本中抽取多个解释变量和一个被解释变量;然后,计算XX和XY;接下来,计算BOLS,即(XX)^(-1)XY;最后,根据BOLS确定其中的回归系数b。

以上就是线性回归方程b的推导过程。

线性回归方程b不仅可以用于求解拟合程度,而且可以用来预测未知的数据。

此外,它也不仅仅可以用于线性回归,还可以用于其他类型的回归分析,比如多项式回归、局部加权回归、非线性回归等。

以上就是关于线性回归方程b推导公式的相关内容,线性回归方程b是统计学中一种重要的回归分析技术,它可以用来推导回归系数b的计算,并可以用来预测未知的分类问题。

1.1线性回归方程的求法

9. 利用线性回归模型解决一类 非线性回归问题

10. 正确理解分析方法与结果

什么是回归分析:

“回归”一词是由英国生物学家F.Galton在研究人体身高的遗传问题时首先提出的。

根据遗传学的观点,子辈的身高受父辈影响,以X记父辈身高,Y记子辈身高。 虽然子辈身高一般受父辈影响,但同样身高的父亲,其子身高并不一致,因此, X和Y之间存在一种相关关系。

a. 比《数学3》中“回归”增加的内

数学3——统计

容选修1-2——统计案例

5. 引入线性回归模型

1. 画散点图

2. 了解最小二乘法 的思想

y=bx+a+e

6. 了解模型中随机误差项e产 生的原因

3. 求回归直线方程

y=bx+a

4. 用回归直线方程 解决应用问题

7. 了解相关指数 R2 和模型拟 合的效果之间的关系

探索:水稻产量y与施肥量x之间大致有何 规律?

施化肥量x 15 20 25 30 35 40 45

水稻产量y 330 345 365 405 445 450 455

y

500 水稻产量

450

· ··

400

·

350 · · ·

300

散点图 施化肥量

10 20 30 40 50

x

探索2:在这些点附近可画直线不止一条,

哪条直线最能代表x与y之间的关系呢?

发现:图中各点,大致分布在某条直线附近。

y 水稻产量

500

· · 450

(xi ,yi )

· · 400 |yi - yi |

··· 350

(xi ,yi )

300

10 20 30 40

高中数学-线性回归方程

【变式1】 下列两个变量中具有相关关系的是________(填 写相应的序号).

①正方体的棱长和体积;②角的弧度数和它的正弦值;③ 单产为常数时,土地面积和总产量;④日照时间与水稻的亩产 量.

解析 正方体的棱长x和体积V存在着函数关系V=x3;角的 弧度数α和它的正弦值y存在着函数关系y=sin α;单产为常数a公 斤/亩土地面积x(亩)和总产量y(公斤)之间也存在着函数关系y= ax.日照时间长,则水稻的亩产量高,这只是相关关系,应选④.

性回归方程;

(3) 已 知 该 厂 技 改 前 100 吨 甲 产 品 的 生 产 能 耗 为 90 吨 标 准

i=1

i=1

∴b=1129.03--55××442×5=1.23, a=5-1.23×4=0.08. ∴所求线性回归方程为y^=1.23x+0.08.

课前探究学习

课堂讲练互动

活页规范训练

【变式2】 某商店统计了近6个月某商品的进价x与售价y(单 位:元),对应数据如下:

x 3 5 2 8 9 12 y 4 6 3 9 12 14 求y对x的回归直线方程.

是一种理想关系模型 是更为一般的情况

课前探究学习

课堂讲练互动

活页规范训练

2.回归直线方程 (1)回归直线方程的思想方法 ①回归直线:观察散点图的特征,发现各点大致分布在一

条直线的附近,就称这两个变量之间具有线性相关的关系,这

条直线叫做回归直线.

可见,根据不同的标准可画出不同的直线来近似表示这种

线性关系.比如,可以连接最左侧点和最右侧点得到一条直

课前探究学习

课堂讲练互动

活页规范训练

自学导引 1.与函数关系不同,相关关系是一种有关系,但不是

线 性 回 归 方 程 推 导

线性回归方程推导理论推导机器学习所针对的问题有两种:一种是回归,一种是分类。

回归是解决连续数据的预测问题,而分类是解决离散数据的预测问题。

线性回归是一个典型的回归问题。

其实我们在中学时期就接触过,叫最小二乘法。

线性回归试图学得一个线性模型以尽可能准确地预测输出结果。

?先从简单的模型看起:?首先,我们只考虑单组变量的情况,有:?使得?假设有m个数据,我们希望通过x预测的结果f(x)来估计y。

其中w和b都是线性回归模型的参数。

?为了能更好地预测出结果,我们希望自己预测的结果f(x)与y 的差值尽可能地小,所以我们可以写出代价函数(cost function)如下:?接着代入f(x)的公式可以得到:?不难看出,这里的代价函数表示的是预测值f(x)与实际值y之间的误差的平方。

它对应了常用的欧几里得距离简称“欧氏距离”。

基于均方误差最小化来求解模型的方法我们叫做“最小二乘法”。

在线性回归中,最小二乘法实质上就是找到一条直线,使所有样本数据到该直线的欧式距离之和最小,即误差最小。

?我们希望这个代价函数能有最小值,那么就分别对其求w和b的偏导,使其等于0,求解方程。

?先求偏导,得到下面两个式子:?很明显,公式中的参数m,b,w都与i无关,简化时可以直接提出来。

?另这两个偏导等于0:?求解方程组,解得:?这样根据数据集中给出的x和y,我们可以求出w和b来构建简单的线性模型来预测结果。

接下来,推广到更一般的情况:?我们假设数据集中共有m个样本,每个样本有n个特征,用X矩阵表示样本和特征,是一个m×n的矩阵:?用Y矩阵表示标签,是一个m×1的矩阵:?为了构建线性模型,我们还需要假设一些参数:?(有时还要加一个偏差(bias)也就是,为了推导方便没加,实际上结果是一样的)好了,我们可以表示出线性模型了:?h(x)表示假设,即hypothesis。

通过矩阵乘法,我们知道结果是一个n×1的矩阵。

线性回归方程的残差分析课件

残差的同方差性检验

目的

检验残差是否具有同方差性,即方差是否随预测值的增加而增加。

方法

可以通过绘制残差的散点图、计算残差的方差齐性检验等手段进行检验。

CHAPTER 03

残差图分析

残差图绘制

残差图是一种用于分析回归模型预测 准确性的工具,通过将实际观测值与 预测值进行比较,可以直观地展示模 型的预测误差。

案例三:某股票价格预测的线性回归分析

总结词

利用线性回归分析方法预测某股票未来价格走势,并通过残差分析评估模型的预测能力 和可靠性。

详细描述

收集某股票的历史价格数据和其他相关因素数据,如公司财务指标、市场走势等。利用 线性回归分析方法建立股票价格预测模型。通过残差分析评估模型的预测能力和可靠性 ,如计算残差均值、残差标准差、残差图等。根据分析结果提出投资策略和建议,如选

单击此处添加正文,文字是您思想的提一一二三四五 六七八九一二三四五六七八九一二三四五六七八九文 ,单击此处添加正文,文字是您思想的提炼,为了最 终呈现发布的良好效果单击此4*25}

残差分析还可以用于评估模型的预测能力和泛化能力 。通过将模型应用于新数据集,观察新数据集的残差 分布和拟合效果,可以评估模型的预测精度和泛化能 力,为实际应用提供依据。

03

04

β0和β1

回归系数,表示X对Y的效应 大小。

ε

随机误差项,表示Y的变异中 不能由X解释的部分。

线性回归方程的建立

收集数据

收集因变量Y和自变量X的相关数据。

散点图

最小二乘法

使用最小二乘法估计β0和β1的值,使 实际观测值与预测值之间的残差平方 和最小化。

绘制Y与X的散点图,观察是否存在线 性关系。

线性回归方程的评估

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

- 1 - 实验八 线性回归方程 一、 数据来源 Employee data.sav

二、 基本结果 基本操作设置: 1、 Analyze——Regression——Linear 2、Dependent: 当前薪金 Independent(s): 起始工资、雇佣类别、经验(以月计)、雇佣时间(以月计)、教育水平(年) 3、 Method: Stepwise 4、 Statistics选项:保留原始设置 5、Plot选项:Y:*ZRESID X: *ZPRED 6、Save选项:保留原始设置 7、Options选项:保留原始设置 8、输出结果

(1)确定自变量、因变量 - 2 -

因变量(Y):当前薪金 自变量(Xi):起始工资(X1)、雇佣类别(X2)、经验(以月计)(X3)、雇佣时间(以月计)(X4)、教育水平(年)(X5) (2)做出因变量与自变量的散点图(Graphs--Legacy Dialogs—Scattor—Matrix Scatter)

从散点图中可发现因变量与各自变量之间存在某种线性关系。 (3)从样本数据出发确定变量间的数学关系,用多重回归分析实现。以下将对多重回归分析结果进行分析: 1)进行回归方程的拟和优度检验

分析:由于该方程中有多个解释变量,因此应参考调整的判定系数。R2体现了回归方程所能解释的因变量变差的比例,R2越接近于1,则说明回归平方和占了因变量总变差平方和的绝大部分比例,因变量的变差主要由自变量的不同

Model Summaryf Model R R Square Adjusted R Square Std. Error of the Estimate 1 .880a .775 .774 $8,115.356 2 .898b .806 .805 $7,540.433 3 .909c .827 .826 $7,127.040 4 .914d .836 .835 $6,940.232 5 .917e .840 .839 $6,856.795 a. Predictors: (Constant), 起始薪金 b. Predictors: (Constant), 起始薪金, 雇佣类别 c. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计) d. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计), 雇佣时间(以月计) e. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计), 雇佣时间(以月计), 教育水平(年) f. Dependent Variable: 当前薪金 - 3 -

取值造成,回归方程对样本数据点拟合得好。在模型5中的R2最大,达到0.840,且调整的R2也达到0.839,认为方程5拟合优度较高,被解释变量可以被模型解释的部分较多,不能被解释的部分较少。

2)进行回归方程的显著性检验:F检验 目的:检验自变量与因变量之间的线性关系是否显著,是否可用线性模型来表示。

ANOVAf Model Sum of Squares df Mean Square F Sig. 1 Regression 1.068E11 1 1.068E11 1622.118 .000a Residual 3.109E10 472 6.586E7 Total 1.379E11 473 2 Regression 1.111E11 2 5.557E10 977.312 .000b Residual 2.678E10 471 5.686E7 Total 1.379E11 473 3 Regression 1.140E11 3 3.801E10 748.392 .000c Residual 2.387E10 470 5.079E7 Total 1.379E11 473 4 Regression 1.153E11 4 2.883E10 598.577 .000d Residual 2.259E10 469 4.817E7 Total 1.379E11 473 5 Regression 1.159E11 5 2.318E10 493.084 .000e Residual 2.200E10 468 4.702E7 Total 1.379E11 473 a. Predictors: (Constant), 起始薪金 b. Predictors: (Constant), 起始薪金, 雇佣类别 c. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计) d. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计), 雇佣时间(以月计) e. Predictors: (Constant), 起始薪金, 雇佣类别, 经验(以月计), 雇佣时间(以月计), 教育水平(年) f. Dependent Variable: 当前薪金 分析:在方差分析表中,模型5的F值为493.084,概率P-为0.000,小于显著

性水平0.05,应拒绝回归方程显著性检验的原假设,认为各回归系数不同时为0,因变量与自变量全体的线性关系是显著的,即:自变量造成的因变量的线性变动远大于随机因素对因变量的影响,可建立线性模型。 3)进行回归系数的显著性检验:t检验 - 4 -

目的:检验自变量对因变量的线性影响是否显著。 Coefficientsa

Model Unstandardized Coefficients Standardized Coefficients t Sig. B Std. Error Beta 1 (Constant) 1928.206 888.680 2.170 .031 起始薪金 1.909 .047 .880 40.276 .000

2 (Constant) 1036.931 832.051 1.246 .213 起始薪金 1.469 .067 .677 21.873 .000

雇佣类别 5947.000 683.430 .269 8.702 .000

3 (Constant) 3039.205 829.783 3.663 .000 起始薪金 1.467 .063 .676 23.117 .000

雇佣类别 6160.294 646.577 .279 9.528 .000

经验(以月计) -23.749 3.139 -.145 -7.565 .000

4 (Constant) -10300.675 2707.813 -3.804 .000 起始薪金 1.479 .062 .682 23.911 .000

雇佣类别 6060.446 629.927 .274 9.621 .000

经验(以月计) -23.789 3.057 -.146 -7.781 .000

雇佣时间(以月计) 163.826 31.739 .097 5.162 .000

5 (Constant) -15038.574 2992.525 -5.025 .000 起始薪金 1.365 .069 .629 19.796 .000

雇佣类别 5859.585 624.945 .265 9.376 .000

经验(以月计) -19.553 3.250 -.120 -6.017 .000

雇佣时间(以月计) 154.698 31.464 .091 4.917 .000

教育水平(年) 539.642 152.735 .091 3.533 .000

a. Dependent Variable: 当前薪金 分析:t检验结果表格中,常数和各自变量的概率P-值均为0.000,小于显著

性水平0.05。t值越大,表明该自变量x解释因变量线性变化的能力较强。在模型5中,可总结出各自变量对因变量线性变化的解释能力大小排序为:起始薪金>雇佣类别>雇佣时间>教育水平>经验。 4)写出回归方程。 根据3)中Coefficientsa表,由于各自变量及常数项的t检验概率P-值均小于0.05,达到显著水平,因此可把系数代入线性回归方程得: Y=-15038.574+1.365 X1+5859.585X2+(-19.553)X3+154.698X4+539.642X5

各自变量系数 - 5 -

三、结论 通过对多重线性回归分析输出结果的分析,可以推断当前薪金受起始薪金、雇佣类别、经验、雇佣时间、教育水平等5个因素的影响,它们建立起的线性回归方程: Y=-15038.574+1.365 X1+5859.585X2+(-19.553)X3+154.698X4+539.642X5 回归方程拟合程度较好,达到83.9%(即R2调整值),各自变量对因变量的影响程度排序为:起始薪金>雇佣类别>雇佣时间>教育水平>经验。 四、建议与对策 从上述分析结果中看出对当前薪金影响最大的是起始薪金,其次是雇佣类别、雇佣时间、教育水平,最后是经验。经验对当前薪金的影响是负的,因此在择业时仅仅靠工作经验是不能有较高当前薪金的,取得一个较高的雇佣类别,在一家单位稳定工作,取得较长的雇佣时间,同时提高个人的受教育水平,都有利于取得较高的当前薪金。 从结论也可以得出在择业时的一些注意点:例如不要频繁更换工作单位;不能仅依靠经验,因为在某些情况下,经验对当前薪金起到的是一个负作用;选择一个起始薪金高的工作岗位对以后的收入是有很大影响的。