Hadoop集群安装配置教程_Hadoop2.6.0_Ubuntu_CentOS

hadoop2.6.0安装

hadoop2.6.0安装搭建hadoop2.6.0开发环境前言:因为没有物理机器要测试,所以学习如何构建Hadoop环境并在本地笔记本中创建三个Linux虚拟机是一个不错的选择。

安装VMware并准备三台相同的Linux虚拟机Linux虚拟机ISO:虚拟机平台服务器版本:PS:关于软件,软件描述如下:本地笔记本:t420,8g内存,64位操作系统,配置如下:1.安装虚拟机1.1安装vmware-workstation,一路下一步即可,导入centos,使用iso方式搭建linux虚拟机2.安装Linux虚拟机2.1安装vmware-workstation完成后,选择新建虚拟机,导入centos,使用iso方式搭建linux虚拟机选择路径选择多核选择2G内存选择桥连接的方式选择磁盘I/O模式创建全新的虚拟机选择磁盘类型虚拟机文件存储方式设置虚拟机文件的存储路径完成打开,报错如下:无法准备安装说明:\\software\\wmware\\centos-6.5-x86 64-bin-dvd1。

iso。

确保您正在使用有效的Linux安装光盘。

如果出现错误,您可能需要安装VMWareWorkstation。

原因是笔记本没有开启虚拟机功能选项,重启电脑,然后按住f1键,进入bios设置,找到virtual选项,设置成enable,然后保存退出。

打开时出现错误消息:EDD:Error8000ReadingSector 2073976原因是:vmwareworkstation9,版本太老,升级到10版本,就ok了。

设置虚拟机网络连接(固定IP),并将连接模式设置为NAT模式看下是否能上外网,左键点击笔记本右下角无线图标,再点击打开网络与共享中心,关闭vmnet01,只保留vmnet08,然后使用默认的ipv4的ip地址192.168.52.1像两颗豌豆一样克隆另一颗。

在虚拟机name02上右键弹出菜单里点击”管理(m)”,然后点击右边下拉菜单”克隆(c)”,如下所示:继续下一步选择创建完成克隆(f)设置名称和位置,然后单击finish开始复制,时间较长,耐心等待,如下单击“关闭”按钮以完成克隆。

基于Ubuntu的hadoop集群安装与配置

Ubuntu 系统安装在这里补充一下Ubuntu ubuntu-14.04.3-server-amd64 所遇到的问题牵扯到挂载问题当时我们早期安装的时候总是会出现安装失败的现象,后来我们把ubuntu-14.04.3-server-amd64 -iso镜像文件直接挂栽在/cdrom 文件夹下面Mount /dev/sdc /mnt/Mount -t iso9600 -o loop /mnt/ubuntu-14.04.3-server-amd64 -iso /cdromMou nt基于Ubuntu的Hadoop集群安装与配置一、实验目的1、掌握Hadoop原理机制,熟悉Hadoop集群体系结构、核心技术。

2、安装和配置Hadoop集群。

二、实验原理Hadoop分布式计算平台是由Apache软件基金会开发的一个开源分布式计算平台。

以Hadoop分布式文件系统(HDFS)和MapReduce(Google MapReduce的开源实现)为核心的Hadoop为用户提供了系统底层细节透明的分布式基础架构。

Hadoop 中的分布式文件系统 HDFS 由一个管理结点 ( NameNode )和N个数据结点( DataNode )组成,每个结点均是一台普通的计算机。

在使用上同我们熟悉的单机上的文件系统非常类似,一样可以建目录,创建,复制,删除文件,查看文件内容等。

但其底层实现上是把文件切割成 Block,然后这些 Block 分散地存储于不同的 DataNode 上,每个 Block 还可以复制数份存储于不同的 DataNode 上,达到容错容灾之目的。

NameNode 则是整个HDFS 的核心,它通过维护一些数据结构,记录了每一个文件被切割成了多少个 Block,这些 Block 可以从哪些 DataNode 中获得,各个 DataNode 的状态等重要信息。

MapReduce 是 Google 公司的核心计算模型,它将复杂的运行于大规模集群上的并行计算过程高度的抽象到了两个函数,Map 和 Reduce, 这是一个令人惊讶的简单却又威力巨大的模型。

centos下hadoop2.6.0配置

Hadoop-2.6.0配置前面的部分跟配置Hadoop-1.2.1的一样就可以,什么都不用变,完全参考文档1即可。

下面的部分就按照下面的做就可以了。

hadoop-2.6.0的版本用张老师的。

下面的配置Hadoop hadoop-2.6.0的部分1.修改hadoop-2.6.0/etc/hadoop/hadoop-env.sh,添加JDK支持:export JAVA_HOME=/usr/java/jdk1.6.0_45如果不知道你的JDK目录,使用命令echo $JAVA_HOME查看。

2.修改hadoop-2.6.0/etc/hadoop/core-site.xml注意:必须加在<configuration></configuration>节点内<configuration><property><name>hadoop.tmp.dir</name><value>/home/hadoop/hadoop-2.6.0/tmp</value><description>Abase for other temporary directories.</description></property><property><name></name><value>hdfs://master:9000</value></property></configuration>3.修改hadoop-2.6.0/etc/hadoop/hdfs-site.xml<property><name>.dir</name><value>/home/hadoop/hadoop-2.6.0/dfs/name</value><description>Path on the local filesystem where the NameNode stores the namespace and transactions logs persistently.</description></property><property><name>dfs.data.dir</name><value>/home/hadoop/hadoop-2.6.0/dfs/data</value><description>Comma separated list of paths on the local filesystem of a DataNode where it should store its blocks.</description></property><property><name>dfs.replication</name><value>1</value></property>4.修改hadoop-2.6.0/etc/hadoop/mapred-site.xml<property><name>mapred.job.tracker</name><value>master:9001</value><description>Host or IP and port of JobTracker.</description></property>5. 修改hadoop-2.6.0/etc/hadoop/masters列出所有的master节点:master6.修改hadoop-2.6.0/etc/hadoop/slaves这个是所有datanode的机器,例如:slave1slave2slave3slave47.将master结点上配置好的hadoop文件夹拷贝到所有的slave结点上以slave1为例:命令如下:scp -r ~/hadoop-2.6.0slave1:~/安装完成后,我们要格式化HDFS然后启动集群所有节点。

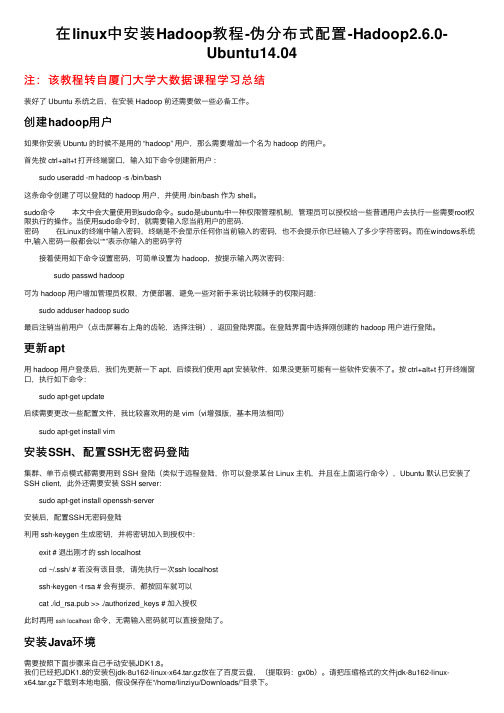

在linux中安装Hadoop教程-伪分布式配置-Hadoop2.6.0-Ubuntu14.04

在linux中安装Hadoop教程-伪分布式配置-Hadoop2.6.0-Ubuntu14.04注:该教程转⾃厦门⼤学⼤数据课程学习总结装好了 Ubuntu 系统之后,在安装 Hadoop 前还需要做⼀些必备⼯作。

创建hadoop⽤户如果你安装 Ubuntu 的时候不是⽤的 “hadoop” ⽤户,那么需要增加⼀个名为 hadoop 的⽤户。

⾸先按 ctrl+alt+t 打开终端窗⼝,输⼊如下命令创建新⽤户 : sudo useradd -m hadoop -s /bin/bash这条命令创建了可以登陆的 hadoop ⽤户,并使⽤ /bin/bash 作为 shell。

sudo命令 本⽂中会⼤量使⽤到sudo命令。

sudo是ubuntu中⼀种权限管理机制,管理员可以授权给⼀些普通⽤户去执⾏⼀些需要root权限执⾏的操作。

当使⽤sudo命令时,就需要输⼊您当前⽤户的密码.密码 在Linux的终端中输⼊密码,终端是不会显⽰任何你当前输⼊的密码,也不会提⽰你已经输⼊了多少字符密码。

⽽在windows系统中,输⼊密码⼀般都会以“*”表⽰你输⼊的密码字符 接着使⽤如下命令设置密码,可简单设置为 hadoop,按提⽰输⼊两次密码: sudo passwd hadoop可为 hadoop ⽤户增加管理员权限,⽅便部署,避免⼀些对新⼿来说⽐较棘⼿的权限问题: sudo adduser hadoop sudo最后注销当前⽤户(点击屏幕右上⾓的齿轮,选择注销),返回登陆界⾯。

在登陆界⾯中选择刚创建的 hadoop ⽤户进⾏登陆。

更新apt⽤ hadoop ⽤户登录后,我们先更新⼀下 apt,后续我们使⽤ apt 安装软件,如果没更新可能有⼀些软件安装不了。

按 ctrl+alt+t 打开终端窗⼝,执⾏如下命令: sudo apt-get update后续需要更改⼀些配置⽂件,我⽐较喜欢⽤的是 vim(vi增强版,基本⽤法相同) sudo apt-get install vim安装SSH、配置SSH⽆密码登陆集群、单节点模式都需要⽤到 SSH 登陆(类似于远程登陆,你可以登录某台 Linux 主机,并且在上⾯运⾏命令),Ubuntu 默认已安装了SSH client,此外还需要安装 SSH server: sudo apt-get install openssh-server安装后,配置SSH⽆密码登陆利⽤ ssh-keygen ⽣成密钥,并将密钥加⼊到授权中: exit # 退出刚才的 ssh localhost cd ~/.ssh/ # 若没有该⽬录,请先执⾏⼀次ssh localhost ssh-keygen -t rsa # 会有提⽰,都按回车就可以 cat ./id_rsa.pub >> ./authorized_keys # 加⼊授权此时再⽤ssh localhost命令,⽆需输⼊密码就可以直接登陆了。

Hadoop集群安装详细步骤亲测有效

Hadoop集群安装详细步骤亲测有效第一步:准备硬件环境- 64位操作系统,可以是Linux或者Windows-4核或更高的CPU-8GB或更高的内存-100GB或更大的硬盘空间第二步:准备软件环境- JDK安装:Hadoop运行需要Java环境,所以我们需要先安装JDK。

- SSH配置:在主节点和从节点之间建立SSH连接是Hadoop集群正常运行的前提条件,所以我们需要在主节点上生成SSH密钥,并将公钥分发到从节点上。

第四步:配置Hadoop- core-site.xml:配置Hadoop的核心参数,包括文件系统的默认URI和临时目录等。

例如,可以将`hadoop.tmp.dir`设置为`/tmp/hadoop`。

- hdfs-site.xml:配置Hadoop分布式文件系统的参数,包括副本数量和块大小等。

例如,可以将副本数量设置为`3`。

- yarn-site.xml:配置Hadoop的资源管理系统(YARN)的参数。

例如,可以设置YARN的内存资源分配方式为容器的最大和最小内存均为1GB。

- mapred-site.xml:配置Hadoop的MapReduce框架的参数。

例如,可以设置每个任务容器的内存限制为2GB。

第五步:格式化Hadoop分布式文件系统在主节点上执行以下命令,格式化HDFS文件系统:```hadoop namenode -format```第六步:启动Hadoop集群在主节点上执行以下命令来启动Hadoop集群:```start-all.sh```此命令将启动Hadoop的各个组件,包括NameNode、DataNode、ResourceManager和NodeManager。

第七步:测试Hadoop集群可以使用`jps`命令检查Hadoop的各个进程是否正常运行,例如`NameNode`、`DataNode`、`ResourceManager`和`NodeManager`等进程都应该在运行中。

Hadoop集群安装与配置及其示例程序运行说明文件

Hadoop集群安装与配置及其示例程序的运行(虚拟机下实现)系统:Ubuntu 12.04虚拟机软件:VMware WorkstationHadoop2.6.0【特别声明:安装的Ubuntu虚拟机操作系统的位数一定要和Hadoop的位数一致!!建议都装64位的。

】单机情况下安装:一、安装jdk 【我下载的jdk版本是:jdk-7u51-linux-i586.tar.gz。

安装后的版本号是:jdk1.7.0_75】去下载jdk-***.tar.gz文件,下载完得到压缩包,解压到要安装的目录下。

(例如解压到/etc下)命令:tar -zxvf jdk-***.tar.gz -C ~/etc 【将jdk压缩包解压到/etc目录下】设置坏境变量:修改用户目录下的.bashrc文件【命令是$ gedit ~/.bashrc】,在文件末尾加入:set JAVA_HOME=/home/becy/etc/jdk1.7.0_75export JAVA_HOMEset JRE_HOME=/home/becy/etc/jdk1.7.0_75/jreExport JRE_HOMEset PATH=$JAVA_HOME/bin:$PATHexport PATHset CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jarexport CLASSPATH保存文件后退出。

然后再命令行输入$ source ~/.bashrc使刚才设置的环境变量生效。

接着输入命令$ java -version会弹出以下窗口:然后按照提示,在命令行输入$ sudo apt-get install openjdk-7-jre-headles s完成jdk 的安装工作【安装过程约20分钟】。

接着测试是否安装成功输入命令:$ java –version以上显示则安装成功。

二、添加专用的Hadoop系统用户我们将利用专用用户来运行Hadoop,这不是必须的,但是建议这么做,主要考虑安全,权限等问题。

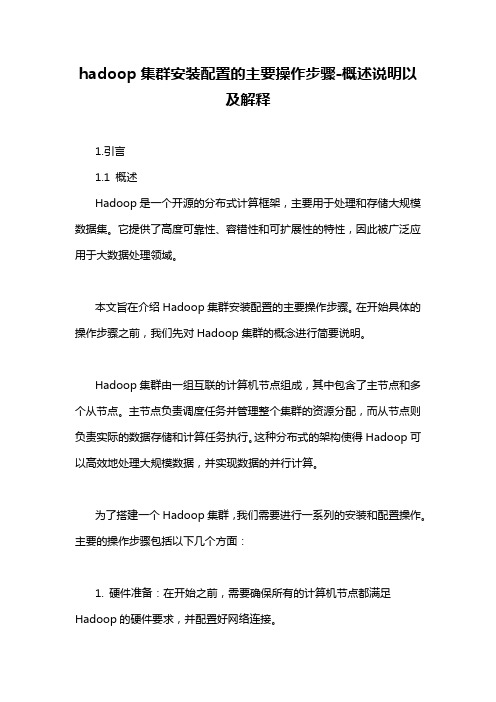

hadoop集群安装配置的主要操作步骤-概述说明以及解释

hadoop集群安装配置的主要操作步骤-概述说明以及解释1.引言1.1 概述Hadoop是一个开源的分布式计算框架,主要用于处理和存储大规模数据集。

它提供了高度可靠性、容错性和可扩展性的特性,因此被广泛应用于大数据处理领域。

本文旨在介绍Hadoop集群安装配置的主要操作步骤。

在开始具体的操作步骤之前,我们先对Hadoop集群的概念进行简要说明。

Hadoop集群由一组互联的计算机节点组成,其中包含了主节点和多个从节点。

主节点负责调度任务并管理整个集群的资源分配,而从节点则负责实际的数据存储和计算任务执行。

这种分布式的架构使得Hadoop可以高效地处理大规模数据,并实现数据的并行计算。

为了搭建一个Hadoop集群,我们需要进行一系列的安装和配置操作。

主要的操作步骤包括以下几个方面:1. 硬件准备:在开始之前,需要确保所有的计算机节点都满足Hadoop的硬件要求,并配置好网络连接。

2. 软件安装:首先,我们需要下载Hadoop的安装包,并解压到指定的目录。

然后,我们需要安装Java开发环境,因为Hadoop是基于Java 开发的。

3. 配置主节点:在主节点上,我们需要编辑Hadoop的配置文件,包括核心配置文件、HDFS配置文件和YARN配置文件等。

这些配置文件会影响到集群的整体运行方式和资源分配策略。

4. 配置从节点:与配置主节点类似,我们也需要在每个从节点上进行相应的配置。

从节点的配置主要包括核心配置和数据节点配置。

5. 启动集群:在所有节点的配置完成后,我们可以通过启动Hadoop 集群来进行测试和验证。

启动过程中,我们需要确保各个节点之间的通信正常,并且集群的各个组件都能够正常启动和工作。

通过完成以上这些操作步骤,我们就可以成功搭建一个Hadoop集群,并开始进行大数据的处理和分析工作了。

当然,在实际应用中,还会存在更多的细节和需要注意的地方,我们需要根据具体的场景和需求进行相应的调整和扩展。

Hadoop2.6.0安装----环境准备

Hadoop2.6.0安装----环境准备准备工作:1、笔记本4G内存,操作系统WIN7 (屌丝的配置)2、工具VMware Workstation3、虚拟机:CentOS6.4共四台虚拟机设置:每台机器:内存512M,硬盘40G,网络适配器:NAT模式选择高级,新生成虚机Mac地址(克隆虚拟机,Mac地址不会改变,每次最后手动重新生成)编辑虚拟机网络:点击NAT设置,查看虚机网关IP,并记住它,该IP在虚机的网络设置中非常重要。

NAT设置默认IP会自动生成,但是我们的集群中IP需要手动设置。

本机Win7 :VMnet8 网络设置注意:克隆的虚拟机网卡MAC地址已经改变,但是文件里面没有修改,我们启动网络服务会遇到下面错误:Bringing up interface eth0: Error: No suitable device found: no device found for cone解决办法:# vi /etc/udev/rules.d/70-persistent-net.rules(内容如下图)查看ifcfg-eth0 中的“HWADDR ”是否和第一个网卡启动信息中的ATTR{address}值相同,如果两个值相同则删除eth0中的所有内容在eth1中进行相关IP配置安装JDK72.1下载JDK安装包安装版本:jdk-7u60-linux-x64.gz查看最新:/technetwork/java/javase/downloads/ind ex.html2.2解压安装我们把JDK安装到这个路径:/usr/lib/jvm如果没有这个目录,我们就新建一个目录cd /usr/libsudomkdirjvm将jdk-7u60-linux-x64.tar.gz复制到linux桌面tarzxvf jdk-7u60-linux-x64.tar.gz -C /usr/lib/jvm2.3配置环境变量(1)只对当前用户生效vim ~/.bashrcexport JAVA_HOME=/usr/lib/jvm/jdk1.7.0_60export JRE_HOME=${JAVA_HOME}/jreexport CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/libexport PATH=${JAVA_HOME}/bin:$PATH保存退出,然后输入下面的命令来使之生效source ~/.bashrc(2)对所有用户生效(root用户登录)vim /etc/profileexport JAVA_HOME=/usr/lib/jvm/jdk1.7.0_60export JRE_HOME=${JAVA_HOME}/jreexport CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/libexport PATH=${JAVA_HOME}/bin:$PATH保存退出,然后输入下面的命令来使之生效source /etc/profile2.4配置默认JDK(一般情况下这一步都可以省略)由于一些Linux的发行版中已经存在默认的JDK,如OpenJDK等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Hadoop集群安装配置教程_Hadoop2.6.0_Ubuntu/CentOS本教程讲述如何配置Hadoop 集群,默认读者已经掌握了Hadoop 的单机伪分布式配置,否则请先查看Hadoop安装教程_单机/伪分布式配置或CentOS安装Hadoop_单机/伪分布式配置。

本教程由厦门大学数据库实验室出品,转载请注明。

本教程适合于原生Hadoop 2,包括Hadoop 2.6.0, Hadoop 2.7.1 等版本,主要参考了官方安装教程,步骤详细,辅以适当说明,保证按照步骤来,都能顺利安装并运行Hadoop。

另外有Hadoop安装配置简略版方便有基础的读者快速完成安装。

为了方便新手入门,我们准备了两篇不同系统的Hadoop 伪分布式配置教程。

但其他Hadoop 教程我们将不再区分,可同时适用于Ubuntu 和CentOS/RedHat 系统。

例如本教程以Ubuntu 系统为主要演示环境,但对Ubuntu/CentOS 的不同配置之处、CentOS 6.x 与CentOS 7 的操作区别等都会尽量给出注明。

环境本教程使用Ubuntu 14.04 64位作为系统环境,基于原生Hadoop 2,在Hadoop 2.6.0 (stable)版本下验证通过,可适合任何Hadoop 2.x.y 版本,例如Hadoop 2.7.1,Hadoop 2.4.1 等。

本教程简单的使用两个节点作为集群环境: 一个作为Master 节点,局域网IP 为192.168.1.121;另一个作为Slave 节点,局域网IP 为192.168.1.122。

准备工作Hadoop 集群的安装配置大致为如下流程:1.选定一台机器作为Master2.在Master 节点上配置hadoop 用户、安装SSH server、安装Java 环境3.在Master 节点上安装Hadoop,并完成配置4.在其他Slave 节点上配置hadoop 用户、安装SSH server、安装Java 环境5.将Master 节点上的/usr/local/hadoop 目录复制到其他Slave 节点上6.在Master 节点上开启Hadoop配置hadoop 用户、安装SSH server、安装Java 环境、安装Hadoop 等过程已经在Hadoop安装教程_单机/伪分布式配置或CentOS安装Hadoop_单机/伪分布式配置中有详细介绍,请前往查看,不再重复叙述。

继续下一步配置前,请先完成上述流程的前 4 个步骤。

网络配置假设集群所用的节点都位于同一个局域网。

如果使用的是虚拟机安装的系统,那么需要更改网络连接方式为桥接(Bridge)模式,才能实现多个节点互连,例如在VirturalBox 中的设置如下图。

此外,如果节点的系统是在虚拟机中直接复制的,要确保各个节点的Mac 地址不同(可以点右边的按钮随机生成MAC 地址,否则IP 会冲突):VirturalBox中节点的网络设置Linux 中查看节点IP 地址的命令为ifconfig,即下图所示的inet 地址(注意虚拟机安装的CentoS 不会自动联网,需要点右上角连上网络才能看到IP 地址):Linux查看IP命令首先在Master 节点上完成准备工作,并关闭Hadoop (/usr/local/hadoop/sbin/stop-dfs.sh),再进行后续集群配置。

为了便于区分,可以修改各个节点的主机名(在终端标题、命令行中可以看到主机名,以便区分)。

在Ubuntu/CentOS 7 中,我们在Master 节点上执行如下命令修改主机名(即改为Master,注意是区分大小写的):如果是用CentOS 6.x 系统,则是修改/etc/sysconfig/network 文件,改为HOSTNAME=Master,如下图所示:CentOS中hostname设置然后执行如下命令修改自己所用节点的IP映射:例如本教程使用两个节点的名称与对应的IP 关系如下:我们在/etc/hosts 中将该映射关系填写上去即可,如下图所示(一般该文件中只有一个127.0.0.1,其对应名为localhost,如果有多余的应删除,特别是不能有“127.0.0.1 Master” 这样的记录):Hadoop中的hosts设置CentOS 中的/etc/hosts 配置则如下图所示:CentOS中的hosts设置修改完成后需要重启一下,重启后在终端中才会看到机器名的变化。

接下来的教程中请注意区分Master 节点与Slave 节点的操作。

需要在所有节点上完成网络配置。

如上面讲的是Master 节点的配置,而在其他的Slave 节点上,也要对/etc/hostname(修改为Slave1、Slave2 等)和/etc/hosts(跟Master 的配置一样)这两个文件进行修改!配置好后需要在各个节点上执行如下命令,测试是否相互ping 得通,如果ping 不通,后面就无法顺利配置成功:例如我在Master 节点上ping Slave1,ping 通的话会显示time,显示的结果如下图所示:检查是否ping得通继续下一步配置前,请先完成所有节点的网络配置,修改过主机名的话需重启才能生效。

SSH无密码登陆节点这个操作是要让Master 节点可以无密码SSH 登陆到各个Slave 节点上。

首先生成Master 节点的公匙,在Master 节点的终端中执行(因为改过主机名,所以还需要删掉原有的再重新生成一次):让Master 节点需能无密码SSH 本机,在Master 节点上执行:完成后可执行ssh Master验证一下(可能需要输入yes,成功后执行exit返回原来的终端)。

接着在Master 节点将上公匙传输到Slave1 节点:scp 是secure copy 的简写,用于在Linux 下进行远程拷贝文件,类似于cp 命令,不过cp 只能在本机中拷贝。

执行scp 时会要求输入Slave1 上hadoop 用户的密码(hadoop),输入完成后会提示传输完毕,如下图所示:通过scp向远程主机拷贝文件接着在Slave1 节点上,将ssh 公匙加入授权:如果有其他Slave 节点,也要执行将Master 公匙传输到Slave 节点、在Slave 节点上加入授权这两步。

这样,在Master 节点上就可以无密码SSH 到各个Slave 节点了,可在Master 节点上执行如下命令进行检验,如下图所示:在Master节点中ssh到Slave节点配置PATH变量(CentOS 单机配置Hadoop 的教程中有配置这一项了,这一步可以跳过)在单机伪分布式配置教程的最后,说到可以将Hadoop 安装目录加入PATH 变量中,这样就可以在任意目录中直接使用hadoo、hdfs 等命令了,如果还没有配置的,需要在Master 节点上进行配置。

首先执行vim ~/.bashrc,加入一行:如下图所示:配置PATH变量保存后执行source ~/.bashrc使配置生效。

配置集群/分布式环境集群/分布式模式需要修改/usr/local/hadoop/etc/hadoop 中的5个配置文件,更多设置项可点击查看官方说明,这里仅设置了正常启动所必须的设置项:slaves、core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml。

1, 文件slaves,将作为DataNode 的主机名写入该文件,每行一个,默认为localhost,所以在伪分布式配置时,节点即作为NameNode 也作为DataNode。

分布式配置可以保留localhost,也可以删掉,让Master 节点仅作为NameNode 使用。

本教程让Master 节点仅作为NameNode 使用,因此将文件中原来的localhost 删除,只添加一行内容:Slave1。

2, 文件core-site.xml改为下面的配置:3, 文件hdfs-site.xml,dfs.replication 一般设为3,但我们只有一个Slave 节点,所以dfs.replication 的值还是设为1:4, 文件mapred-site.xml(可能需要先重命名,默认文件名为mapred-site.xml.template),然后配置修改如下:5, 文件yarn-site.xml:配置好后,将Master 上的/usr/local/Hadoop 文件夹复制到各个节点上。

因为之前有跑过伪分布式模式,建议在切换到集群模式前先删除之前的临时文件。

在Master 节点上执行:在Slave1 节点上执行:同样,如果有其他Slave 节点,也要执行将hadoop.master.tar.gz 传输到Slave 节点、在Slave 节点解压文件的操作。

首次启动需要先在Master 节点执行NameNode 的格式化:CentOS系统需要关闭防火墙CentOS系统默认开启了防火墙,在开启Hadoop 集群之前,需要关闭集群中每个节点的防火墙。

有防火墙会导致ping 得通但telnet 端口不通,从而导致DataNode 启动了,但Live datanodes 为0 的情况。

在CentOS 6.x 中,可以通过如下命令关闭防火墙:若用是CentOS 7,需通过如下命令关闭(防火墙服务改成了firewall):如下图,是在CentOS 6.x 中关闭防火墙:CentOS6.x系统关闭防火墙接着可以启动hadoop 了,启动需要在Master 节点上进行:通过命令jps可以查看各个节点所启动的进程。

正确的话,在Master 节点上可以看到NameNode、ResourceManager、SecondrryNameNode、JobHistoryServer 进程,如下图所示:通过jps查看Master的Hadoop进程在Slave 节点可以看到DataNode 和NodeManager 进程,如下图所示:通过jps查看Slave的Hadoop进程缺少任一进程都表示出错。

另外还需要在Master 节点上通过命令hdfs dfsadmin -report查看DataNode 是否正常启动,如果Live datanodes 不为0 ,则说明集群启动成功。

例如我这边一共有1 个Datanodes:通过dfsadmin查看DataNode的状态也可以通过Web 页面看到查看DataNode 和NameNode 的状态:http://master:50070/。

如果不成功,可以通过启动日志排查原因。

伪分布式、分布式配置切换时的注意事项1, 从分布式切换到伪分布式时,不要忘记修改slaves 配置文件;2, 在两者之间切换时,若遇到无法正常启动的情况,可以删除所涉及节点的临时文件夹,这样虽然之前的数据会被删掉,但能保证集群正确启动。