前馈神经网络

前馈神经网络的常见使用注意事项(四)

前馈神经网络是目前深度学习中最常用的一种神经网络结构,它具有许多优点,能够处理大规模的数据,并且在图像识别、自然语言处理、语音识别等领域取得了巨大的成功。

然而,使用前馈神经网络也需要注意一些常见的问题和注意事项,下面将从数据准备、网络结构选择、训练技巧等方面进行探讨。

数据准备是使用前馈神经网络时需要特别注意的一个环节。

首先,要保证数据的质量,包括数据的准确性、完整性和一致性。

其次,要进行数据预处理,包括数据清洗、特征提取、数据归一化等。

此外,在选择训练集、验证集和测试集时,要保证数据的平衡性和代表性,避免训练集和测试集之间的数据分布差异过大,导致模型泛化能力不足。

在选择网络结构时,要考虑到自己的问题类型和数据特点。

对于不同的任务,比如分类、回归、序列预测等,可以选择不同的网络结构,比如全连接网络、卷积神经网络、循环神经网络等。

此外,要根据数据的维度和特征数量来选择网络的层数和节点数量,避免网络结构过于复杂或简单,导致模型的欠拟合或过拟合问题。

在模型训练过程中,要注意避免梯度消失和梯度爆炸的问题,可以采用批标准化、梯度裁剪等技术来缓解。

另外,要选择合适的损失函数和优化器,比如交叉熵损失、均方误差损失等,以及Adam、SGD等优化器。

在训练过程中,还要注意学习率的调整,可以采用学习率衰减的方法,使得模型能够更快地收敛。

除了以上几点,还有一些其他注意事项。

首先,要注意对模型进行评估和调优,可以采用交叉验证、超参数搜索等技术来找到最佳的模型。

其次,要注意模型的解释性和泛化能力,避免过度拟合训练数据,导致模型在新数据上表现不佳。

最后,要注意模型的部署和维护,包括模型的存储、调用和更新等。

综上所述,使用前馈神经网络时需要注意数据准备、网络结构选择、训练技巧等方面的问题。

只有在细心准备和合理选择的情况下,才能训练出高质量的模型,取得令人满意的效果。

希望这些注意事项对广大的深度学习爱好者有所帮助。

前馈神经网络的基本结构与工作原理

前馈神经网络的基本结构与工作原理前馈神经网络是一种常用的人工神经网络模型,广泛应用于机器学习和模式识别等领域。

在本文中,我们将介绍前馈神经网络的基本结构和工作原理。

一、基本结构前馈神经网络由多个神经元按层次连接而成,分为输入层、隐藏层和输出层。

每个神经元都与下一层的神经元连接,前向传播信息,不同层之间没有反馈连接,因此称为“前馈”。

1. 输入层输入层是前馈神经网络的第一层,接收外部输入的数据。

每个输入神经元对应输入数据的一个特征。

输入层通常不进行计算,只将输入数据传递给下一层的神经元。

2. 隐藏层隐藏层是位于输入层和输出层之间的一层或多层神经元。

隐藏层对输入数据进行加权和偏移运算,并通过激活函数进行非线性变换。

隐藏层的神经元数量和层数可以根据问题的复杂性和数据的特征进行设置。

3. 输出层输出层是前馈神经网络的最后一层,输出网络对问题进行预测或分类。

输出层的神经元数量取决于问题的种类,例如二分类问题需要一个神经元,多分类问题需要多个神经元。

二、工作原理前馈神经网络的工作原理可以分为两个阶段:前向传播和反向传播。

1. 前向传播前馈神经网络通过前向传播将输入数据从输入层传递到输出层,实现对输入数据的处理和预测。

首先,输入层接收外部输入的数据,并将其传递给隐藏层。

隐藏层对输入数据进行加权和偏移运算,计算得到隐藏层的输出值,并通过激活函数进行非线性变换。

隐藏层的输出值被传递到下一层,依次经过每一层的计算,最后传递到输出层。

输出层接收隐藏层传递过来的数据,并进行加权和偏移运算,计算得到输出层的输出值。

输出层的输出值可以表示分类结果、预测值等问题的输出。

2. 反向传播前馈神经网络通过反向传播来更新神经网络的参数,以调整网络的权重和偏置,使网络的输出尽可能地接近真实值,从而提高预测的准确性。

反向传播的过程可以分为以下几个步骤:(1)计算输出误差:将网络的输出值与真实值进行比较,计算输出误差。

(2)传播误差:根据输出误差,沿着网络的反向传播路径,依次更新隐藏层和输入层的误差。

如何使用前馈神经网络进行时间序列预测(六)

前馈神经网络(Feedforward Neural Network,FNN)是一种常用的人工神经网络模型,它可以用来进行时间序列预测。

时间序列预测是指根据已知的一系列时间点上的数据,来预测未来某个时间点上的数值。

在金融领域、气象预测、销售预测等方面,时间序列预测都有着广泛的应用。

而前馈神经网络作为一种强大的模型,可以帮助我们更准确地进行时间序列预测。

一、前馈神经网络的基本结构前馈神经网络由输入层、隐藏层和输出层组成。

输入层接收外部数据输入,隐藏层进行信息处理,输出层输出最终的预测结果。

隐藏层可以有多层,每一层都可以包含多个神经元。

在前馈神经网络中,信息是单向传播的,即从输入层到输出层,没有反馈。

二、数据预处理在使用前馈神经网络进行时间序列预测之前,首先需要对数据进行预处理。

通常包括数据清洗、归一化处理等步骤。

数据清洗是指去除异常值或缺失值,以保证数据的完整性和准确性。

而归一化处理则是将数据缩放到一个较小的范围内,以便神经网络更好地学习和收敛。

三、选择合适的神经网络结构选择合适的神经网络结构是进行时间序列预测的关键。

通常可以根据实际问题的复杂程度来确定网络的层数和每一层神经元的个数。

过于简单的网络结构可能无法捕捉时间序列数据的复杂关系,而过于复杂的网络结构又容易造成过拟合。

因此,需要根据实际情况进行合理的选择。

四、选择合适的激活函数激活函数在神经网络中起着至关重要的作用,它决定了神经元的输出。

常用的激活函数包括Sigmoid函数、Tanh函数和ReLU函数等。

在选择激活函数时,需要考虑到函数的性质以及数据的特点,以确保神经网络能够更好地拟合时间序列数据。

五、训练神经网络在选择好神经网络结构和激活函数之后,就可以开始训练神经网络了。

通常采用梯度下降算法来更新神经网络的参数,以使网络的预测结果与实际值之间的误差最小化。

在训练过程中,需要根据损失函数的值来调整网络的参数,直到网络收敛。

六、验证和评估在训练好神经网络之后,需要对模型进行验证和评估。

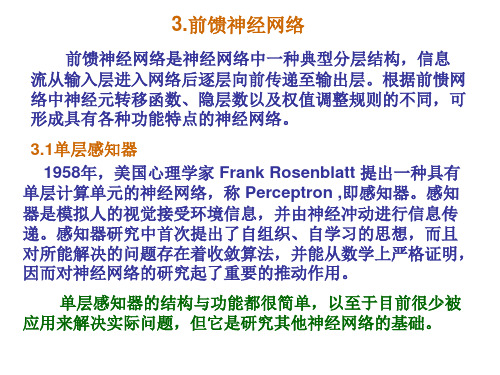

3前馈神经网络

1 yj 1

w1 j x1 w2 j x 2 j 0 w1 j x1 w2 j x 2 j 0

则方程 w1 j x1 w2 j x2 j 0 成为二维输入样本空间上的一条分界线。

*

*

x1

*

w1 j x1 w2 j x2 j 0

节点j的输出为:

1 yj 1

w1 j x1 w2 j x 2 w3 j x3 j 0 w1 j x1 w2 j x 2 w3 j x3 j 0

方程 w1 j x1 w2 j x2 w3 j x3 j 0 确定的平面成为三维输入样本空间的 一个分界面。把输入样本*和△正确分两类(对应yj=1和-1)

X3=[-1 -1 1 0.5]T d3=1. 设初始权向量 W(0)=[0.5 1 -1 0]T η=0.1 注意:输入向量中第一个分量x0恒等于-1,权向量中第一个分量为阈值,试训 练该感知器网络. 解:第一步,输入X1 WT(0)X1= [0.5 1 -1 0][-1 1 -2 0]T=2.5 Y1(0)=sgn(2.5)=1 W(1)=W(0)+ η[d1-y1]X1= [0.5 1 -1 0]T +0.1(-1-1) [-1 1 -2 0]T

0.5x1+0.5x2-0.75=0 x 1 将输出为1的样本点作*、

输出为0的样本点作△表示。 按真值表作图,得: (0,1) △ (1,1) *

(0

该分类线不唯一,取决于具体的权值训练 逻辑”或”功能: X1 0 真值表: 0 1 1 x2 0 1 0 1 y 0 1 1 1 4个样本,两种输出 1

3.1.4感知器的学习算法

感知器采用感知器学习规则进行训练,用t表示学习步的序号,权值看作t的函

前馈的名词解释是什么

前馈的名词解释是什么前馈是一种信息传递和处理的过程,它在不同领域中都具有重要的应用。

无论是在计算机科学、神经生物学还是物理学中,前馈都是一种常见的概念。

在本文中,我们将从不同的角度解释前馈的含义和作用。

在计算机科学领域,前馈神经网络是一种广泛应用的人工智能模型。

它由多个神经元层组成,每个神经元通过连接权重与上一层的神经元相连。

信息从输入层传递到最终输出层的过程中,不涉及反馈路径。

这种结构使得前馈神经网络能够识别和分类复杂的模式,例如图像和语音识别。

前馈神经网络的训练过程基于反向传播算法,通过调整连接权重来提高预测的准确性。

因此,前馈神经网络在人工智能领域中具有重要的应用前景。

在神经生物学中,前馈是指信息从感觉器官逐级传递到大脑的过程。

当我们感受到外界的刺激时,神经元会通过神经递质的释放来传递信号。

这些信号沿着神经元之间的突触传导,最终到达大脑。

在这个过程中,信息的传递是单向的,不会出现反馈回路。

神经递质的释放、突触传导和大脑的处理相互协同作用,使我们能够感知和理解外部世界。

例如,当我们触摸热的物体时,神经信号的前馈过程会引起对热的感知。

在物理学中,前馈是指物理系统中信息传递的过程。

例如,传感器可以感知环境中的物理量,并将其转化为电信号。

这些电信号通过导线传输到处理单元,经过处理后再转化为有用的输出信号。

这个过程中,信息的流动是单向的,不会产生反馈。

前馈在物理系统中具有重要的应用,如自动控制系统和反应堆控制。

通过前馈控制,系统能够实时监测和调整状态,以达到预期的稳定性和性能。

总结起来,前馈是一种信息传递和处理的过程,不涉及反馈回路。

在计算机科学中,前馈神经网络通过连接权重实现模式识别和分类。

在神经生物学中,前馈是指信息从感觉器官传递到大脑的单向过程。

在物理学中,前馈用于物理系统中信息的单向传递和控制。

这些不同领域中的前馈概念和应用,共同构成了我们对前馈的全面理解。

通过深入研究和应用前馈的原理,我们可以更好地理解和利用信息的传递和处理过程,推动科学技术的不断发展。

如何使用前馈神经网络进行自然语言处理(Ⅱ)

在当今信息爆炸的时代,自然语言处理(Natural Language Processing,NLP)技术的重要性越来越凸显。

NLP是人工智能领域的一个重要分支,它涉及到计算机对人类语言的理解和处理。

前馈神经网络(Feedforward Neural Network)作为一种重要的深度学习模型,在NLP领域发挥着重要作用。

本文将结合前馈神经网络和自然语言处理,探讨如何使用前馈神经网络进行自然语言处理。

一、前馈神经网络简介前馈神经网络是一种最基本的深度学习模型,也是一种最常用的人工神经网络。

它由输入层、隐藏层和输出层组成,信息在网络中只向前传播,没有反馈。

这种结构使得前馈神经网络适用于许多机器学习任务,包括自然语言处理。

在自然语言处理中,前馈神经网络可以用来进行文本分类、情感分析、命名实体识别等任务。

通过输入文本数据,前馈神经网络可以学习其中的语义和语法信息,从而实现对文本的理解和处理。

二、文本表示与词嵌入在自然语言处理中,文本数据通常需要经过表示和编码,以便于计算机进行处理。

词嵌入(Word Embedding)是一种常用的文本表示方法,它可以将单词映射到高维空间中的向量,从而捕捉单词之间的语义和语法信息。

前馈神经网络可以利用词嵌入来处理文本数据。

通过将文本中的单词转换为对应的词向量,前馈神经网络可以更好地理解文本的含义和结构。

在训练过程中,前馈神经网络可以不断调整词嵌入的参数,从而使得网络能够更好地适应语言数据的特点。

三、文本分类与情感分析文本分类和情感分析是NLP中常见的任务,它们涉及对文本的分类和情感倾向进行预测。

前馈神经网络可以用来实现这些任务,通过学习文本数据的特征和模式,从而对文本进行分类和情感分析。

在文本分类任务中,前馈神经网络可以接受文本数据作为输入,然后通过隐藏层和输出层的计算,对文本进行分类。

例如,可以将新闻文本分为不同的类别,如体育、娱乐、科技等。

通过不断调整网络参数,前馈神经网络可以学习到不同类别文本的特征,从而实现准确的分类。

人工神经网络模型及应用领域分析

人工神经网络模型及应用领域分析人工神经网络(Artificial Neural Network)是一种模拟生物神经网络的智能系统。

它由一系列处理单元,即神经元所组成,能够学习、适应和模拟复杂的非线性关系,具有很强的特征提取与分类能力。

其主要应用于机器学习、人工智能等领域,并在图像识别、预测控制、金融风险分析、医学诊断等方面得到广泛应用。

本文将从人工神经网络模型的原理、种类和应用领域三个方面进行探讨。

一、人工神经网络模型的原理人工神经网络模型由模拟人类神经元构成,其基本结构包括输入层、隐藏层和输出层。

其中输入层接受外部输入信息,隐层是神经网络的核心,通过将输入信息转换为内部状态进行处理,并将处理结果传递给输出层。

输出层将最终结果输出给用户。

举个例子,我们可以将输入层视为人类的五官,隐藏层类比于大脑,而输出层则类比人体的手脚。

人工神经网络各层间的信息传递包括两个过程,即正向传递和反向传递。

正向传递过程是指输入信息从输入层流向输出层的过程,即信息的传递方向是输入层-隐藏层-输出层。

反向传递过程是指通过反向误差传递算法计算并更新神经网络中每个权重的值,从而优化神经网络的过程。

二、人工神经网络的种类人工神经网络主要分为三类,分别是前馈神经网络、递归神经网络和自适应神经网络。

一、前馈神经网络(FNN)前馈神经网络是人工神经网络中最为常见的一类,也是最简单的神经网络类型之一。

其功能类似于单向传导信息的系统,例如生物的视网膜和传感器等。

前馈神经网络只有正向传递过程,而没有反向传递过程。

前馈神经网络常用于分类、识别和预测等领域。

二、递归神经网络(RNN)递归神经网络包括输入层、隐藏层和输出层,但隐藏层的神经元可以连接到之前的神经元,使信息得以传递。

与前馈神经网络不同,递归神经网络可以处理时序性数据、自然语言等。

递归神经网络的应用领域主要是非线性有限时序预测、文本分类、语音识别、图像处理、自然语言处理等。

三、自适应神经网络(ANN)自适应神经网络是一种可以自动调整结构和参数的神经网络,包括自组织神经网络和归纳神经网络。

五大神经网络模型解析

五大神经网络模型解析近年来,人工智能的快速发展使得深度学习成为了热门话题。

而深度学习的核心就在于神经网络,它是一种能够模拟人脑神经系统的计算模型。

今天,我们就来一起解析五大神经网络模型。

1.前馈神经网络(Feedforward Neural Network)前馈神经网络是最基本的神经网络模型之一。

在前馈神经网络中,信息是单向传输的,即神经元的输出只会被后续神经元接收,不会造成回流。

前馈神经网络能够拟合线性和非线性函数,因此在分类、预测等问题的解决中被广泛应用。

前馈神经网络的一大优势在于简单易用,但同时也存在一些缺点。

例如,神经网络的训练难度大、泛化能力差等问题,需要不断探索解决之道。

2.循环神经网络(Recurrent Neural Network)与前馈神经网络不同,循环神经网络的信息是可以进行回流的。

这意味着神经元的输出不仅会传向后续神经元,还会传回到之前的神经元中。

循环神经网络在时间序列数据的处理中更为常见,如自然语言处理、语音识别等。

循环神经网络的优点在于增强了神经网络处理序列数据的能力,但是它也存在着梯度消失、梯度爆炸等问题。

为了解决这些问题,一些变种的循环神经网络模型应运而生,如长短期记忆网络(LSTM)、门控循环单元(GRU)等。

3.卷积神经网络(Convolutional Neural Network)卷积神经网络是一种类似于图像处理中的卷积操作的神经网络模型。

卷积神经网络通过卷积神经层和池化层的堆叠来对输入数据进行分层提取特征,从而进一步提高分类性能。

卷积神经网络在图像、视频、语音等领域的应用非常广泛。

卷积神经网络的优点在于对于图像等数据具有先天的特征提取能力,可以自动识别边缘、角点等特征。

但是,卷积神经网络也存在着过拟合、泛化能力欠佳等问题。

4.生成对抗网络(Generative Adversarial Network)生成对抗网络可以说是最近几年最热门的神经网络模型之一。

它基于博弈论中的对抗训练模型,由两个神经网络构成:生成器和判别器。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

+0.6安 1.0安 电流

电流

§3.2 前馈网络( BP )的隐含层设计

3.2.1.2 对输出层

根据网络处理的功能和处理的规模来确定输出节点数目。 比如,用作分类器的网络,要进行m类别分类,则要求 ①m个输出节点; ②每个类别有足够的训练样本; ③当输入样本为第i类时,其输出应为

0 0 y 1 第i个1 0 0

注意:(l-1)层第j个神经元的输出即为l层神经元的输入, k为迭代次数。

l Ek Ek net jk l l l wij net jk wij

可以令

Ek l 1 O jk net ljk Ek ljk 局部剃度 l net jk

§3.1 BP网络模型及原理

注意:输入/输出层节点数目设计不宜过多,否则整个系统训 练和处理复杂。

§3.2 前馈网络( BP )的隐含层设计

3.2.2 隐含层的设计

隐含层的规模是利用前馈网络解决实际问题时最重 要的问题之一,隐含层的设计都是依据网络的用途来决 定的,但并不是唯一的,目前主要还是以经验来确定。 3.2.2.1隐含层数的选择

§3.1 BP网络模型及原理

比如剃度学习算法

( n 1) (n) wij (t ) wij (t )

E (t ) wij (t )

神经网络对信息处理过程一般都要经过执行阶段和学习阶段的反复迭代过程。 学习过程是为了取得对信息的适应特性,执行过程是对信息的检索或者分类, 这是神经网络中两个不可分割的阶段。 通过学习阶段,将神经网络训练成对某类信息模式特别敏感,或者具有某 种特征的动力学系统。 通过执行阶段,使得网络能够识别有关的信息模式或者特征。

l l l 1 net jk wij O jk l l O f ( net jk jk ) 可以按照 从(l+1)层(或者输出层) 一步步往回推求。有

总结:

Ek l l 1 O jk jk wljk

l ( y y ) f ( net 神经元j为输出单元时 k k jk ) l 其中 jk ( l 1wl 1 ) f (net l ) 神经元j为隐含单元时 mk mk jk m

3.1.3.1 BP算法原理

k层

k +1层

输入层

隐含层

输出层_连接权修正源自连接权修正误差信号Ä

网络学习结构

期望信号

对隐含层虽然与I/O层外界单元不发生直接联系,但隐含层 连接权的修正可以改变整个多层网络的性能。

§3.1 BP网络模型及原理

对第k+1层,第i个神经元I/O的关系:

x( k 1),i f ( wij xkj ) y( k 1),i f ( wij xkj )

3.1.2.2 BP神经网络的几个基本概念

①学习速率参数 ②振荡

§3.1 BP网络模型及原理

3.1.3 BP网络算法的原理

BP网络算法是为解决多层前馈网络连接权优化才提出的, 是一种无反馈的多层前馈网络。 以Rumelhart和McClelland为首的并行分布处理(PDP)的 研究小组1986年提出,BP算法是应用最广泛的学习算法之一。

人工神经网络及其应用

第三讲 前馈网络 主讲人:方涛

第三 讲前馈网络

主讲内容

◆ ◆ ◆ ◆ ◆ §3.1 §3.2 §3.3 §3.4 §3.5 BP网络模型及原理 前馈网络的隐含层设计 初始连接权的设置及影响 Questions Homework

§3.1 BP网络模型及原理

3.1.1 3.1.2 3.1.3 3.1.4 3.1.5 神经网络信息处理的数学过程 BP网络算法概述 BP网络算法的原理 BP网络算法中常用的激励函数 BP网络算法的若干改进

感知器的学习算法是一种单层网络的学习算法,不能用于多 层网络的学习算法。 BP算法解决了多层网络的学习问题,并不象Minsky等人预 料的那样弱的学习能力,相反它可以完成许多学习任务,解决 许多实际问题,也因此推动了前馈式神经网络的研究。 BP算法目前已成为迄今为止应用最普遍的神经网络学习算 法。

§3.1 BP网络模型及原理

即等效地改变了原来恒定的学习速率 是 确定比较麻烦。

,可以加快收敛速度,但

§3.1 BP网络模型及原理

⊙学习速率渐小法 学习速率在迭代开始时大,有利于加快学习训练速度,但是到了 极值点时,减少学习速率可有利于收敛:

h ( n) = h (0) h (1 + ) g g 为常数

⊙学习速率的经验公式

§3.1 BP网络模型及原理

3.1.2 BP网络算法概述

3.1.2.1 BP算法概述

最初由Werbos开发的反向传播训练算法,是一种 迭代梯度算法,用于求解前馈网络的实际输出与期望 输出间的最小均方差值。 BP网是一种反向传递并能修正误差的多层映射网 络。 当参数适当时,此网络能够收敛到较小的均方差。 BP网的短处是训练时间较长,且易陷于局部极小。

实线:工作信号,是输入信号逐层向前传送产生输出; 虚线:误差信号,是网络实际输出与期望输出之差,并由输出

端逐层向后传播。

BP反向传播算法分为正向传播与反向传播。

§3.1 BP网络模型及原理

①正向传播与工作信号 输入样本从输入层经过隐含单元一层层进行处理, 传向输出层,这种逐层处理的过程,每层神经元的状 态只对下一层神经元的状态产生影响。 在输出层将当前的输出与期望的输出进行比较, 如果当前的输出不等于期望输出,则进行反向传播。 ②反向传播与误差信号 将误差信号按正向传播的通路反向传回,对隐含 层的各个神经元的连接权进行修正,以使误差信号最 小。

§3.1 BP网络模型及原理

3.1.3.3 BP算法的执行步骤

对连接权 wij进行递归计算。 每层有n个神经元,即i=1,2,„,n;j=1,2,„,n。 wi1 , wi 2 ,, w 对第k层的第i个神经元,则有n个连接权 。 in T 输入样本 X = ( x1, x2 ,, xn ) ,并设共有m层。 以s型函数为例, f ( x) = 1 - x ,有 f ( x) f ( x) (1 f ( x))

1+e

步骤:

①对权系数 wij 置初始值; ②输入样本X,以及期望输出 Y = ( y1, y2 ,, yn )T ③计算各层的输出(正向过程计算) k 对第k层第i个神经元的输出 xi

1 netik wij x k j k k x f ( net i ) i

§3.1 BP网络模型及原理

⑤连接权修正

k-1 wij (t +1) = wij (t ) - hd k x j j

⑥求出各层的各个连接权后,如满足要求,则结束迭代,否则, 返回③继续。 如果网络层数较多,计算量大,收敛速度很慢。

§3.1 BP网络模型及原理

3.1.4 BP网络计算中常用的激励函数

①S型及双曲正切函数

f ( x) = 1 1 + e- x

⊙渐进自适应学习速率 采用进化策略来调节学习速率。

§3.1 BP网络模型及原理

②局部学习速率的自适应 实质为:对每个连接权采用不同的学习速率进行局部自适应调整, 比如 ⊙基于符号变换的学习速率自适应 对每个连接权选其初始值 ij (0) ; 修正学习速率

ij (n) ij (n 1) (n) (n 1) d ij ij E E ( n) ( n 1) 0 wij wij

Ek l f ( net jk ) Oljk 要从(l 1 )层往回算

对于(l 1)层第m个单元 Ek l 1 l 1 mk wmj l O jk m

ljk

l 1 l 1 ( mk wmk ) f (net ljk ) m

§3.1 BP网络模型及原理

§3.1 BP网络模型及原理

3.1.3.2 BP算法的数学表达

常用激励函数Sigmoid型函数

f ( x) =

1 1 + e- x

BP算法采用非线性规划中的最速下降方法,按照误 差函数的负剃度方向修正连接权。BP算法的实质就是使误差最 小化的求解问题: 平方型误差函数:

E 1 ( y jk y jk ) 2 2

否则

连接权更新

w(n) ij (

E wij ( n 1)) wij 动量项

§3.2 前馈网络( BP )的隐含层设计

3.2.1 I/O层设计 3.2.2 隐含层的设计 3.2.3 几个重要的前馈网络定理

§3.2 前馈网络( BP )的隐含层设计

3.2.1 I/O层设计

①当节点j为输出单元时

Oljk y jk Ek y jk l jk y net l jk jk ( yk yk ) f (net ljk )

②当节点j不为输出单元(隐含单元)时 l O E jk ljk lk O jk net ljk

k l ④求各层的学习误差 di = d jk(反向过程)

输出层,k m, 有 其它层,

dik xik (1 xik ) wli dik 1

l

dim xim (1 xim )( xim yi )

误差函数的求取是从输出层开始到输入层反向传播的,这种误 差的递归求法,使误差逐渐减小,以修正连接权。