Android使用opencv总结

OpenCV图像处理技术介绍

OpenCV图像处理技术介绍一、概述OpenCV(Open Source Computer Vision Library)是一款用于计算机视觉和机器视觉的开源跨平台库。

它被广泛应用于计算机视觉、图像处理、机器学习、人工智能等领域,是一种非常强大、开放的框架。

本文将重点介绍 OpenCV 图像处理技术,以帮助读者了解它的具体应用和实现过程。

二、图像的读取和展示要使用 OpenCV 进行图像处理,需要先加载图像。

OpenCV 支持多种图像格式,如 BMP、JPEG、PNG、GIF 等。

用OpenCV 加载图像的方法有两种:一种是cv::imread() 函数,另一种是 cv::VideoCapture 类。

cv::imread() 函数可以通过指定图像路径或网络 URL 加载本地或远程图像,读取后返回一个 cv::Mat 对象,然后可以使用cv::imshow() 函数将图像展示在屏幕上。

三、灰度化和二值化灰度化将一个彩色图像转换为黑白图像,使得图像的像素值只有一个亮度值,而没有颜色信息。

在 OpenCV 中,可以通过cv::cvtColor() 函数将一张彩色图像转换为灰度图像。

二值化是将灰度图像中的像素值转换为 0 或 255,即黑色或白色。

它主要用于将图像转换为二进制图像,方便进一步处理。

在OpenCV 中,可以使用 cv::threshold() 函数实现图像的二值化,可以设置操作的阈值、最大值和操作类型等参数。

四、图像滤波图像滤波是指对图像进行平滑或增强的处理方法。

在 OpenCV 中,可以使用 cv::GaussianBlur() 函数实现图像的高斯滤波,可以设置卷积核的大小和标准差等参数,以及边缘处理的方法。

此外,还可以使用 cv::medianBlur() 函数进行中值滤波,cv::bilateralFilter() 函数进行双边滤波,以及 cv::blur() 函数进行均值滤波等。

opencv absdiff用法

opencv absdiff用法摘要:1.OpenCV 简介2.absDiff 算法原理3.OpenCV absDiff 用法4.示例代码5.结论正文:1.OpenCV 简介OpenCV(Open Source Computer Vision Library,开源计算机视觉库)是一个开源的计算机视觉和机器学习软件库。

它包含了大量的图像处理、视频分析和计算机视觉方面的功能。

OpenCV 的目的是为人工智能、机器视觉、图像处理等领域的研究人员和开发者提供一个通用且高效的平台。

2.absDiff 算法原理absDiff(绝对差异)算法是一种用于检测图像变化的方法,它是基于图像之间的差异进行计算的。

具体来说,absDiff 算法会计算两个图像之间的像素值差异的绝对值,然后将这些差异值进行累加,得到一个表示图像变化的总差异值。

这个总差异值可以用来衡量图像之间的相似度,从而实现对图像变化的检测。

3.OpenCV absDiff 用法在OpenCV 中,absDiff 算法是通过`absdiff`函数实现的。

使用这个函数,我们可以方便地对两个图像进行绝对差异计算。

下面是一个简单的示例:```pythonimport cv2# 读取两个图像image1 = cv2.imread("image1.jpg")image2 = cv2.imread("image2.jpg")# 计算绝对差异diff = cv2.absdiff(image1, image2)# 显示结果cv2.imshow("Result", diff)cv2.waitKey(0)cv2.destroyAllWindows()```4.示例代码为了更好地理解如何使用OpenCV absDiff 功能,我们可以看一个具体的例子。

假设我们有两个图像,分别是“image1.jpg”和“image2.jpg”,我们想要找到它们之间的差异。

opencv 点到线距离算子

OpenCV 点到线距离算子1. 简介OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉库,提供了丰富的图像处理和计算机视觉算法。

其中,点到线距离算子是 OpenCV 中的一个重要功能,用于计算点到直线的最短距离。

本文将详细介绍 OpenCV 中的点到线距离算子,包括基本原理、使用方法以及示例代码。

2. 基本原理点到线距离是计算机视觉中常用的测量指标之一。

在二维空间中,给定一条直线 L 和一个点 P,点到线的最短距离可以通过以下公式计算得出:distance_formuladistance_formula其中 (x0, y0) 是点 P 的坐标,A、B 和 C 是直线 L 的参数。

对于一般形式的直线方程 Ax + By + C = 0,可以通过两个已知点 (x1, y1) 和 (x2, y2) 计算出 A、B 和 C 的值。

3. 使用方法OpenCV 提供了函数cv::pointPolygonTest()来计算点到线的最短距离。

该函数接受三个参数:点的坐标、直线上两个点的坐标以及一个布尔值参数用于指定是否计算有符号距离。

以下是函数的基本语法:double cv::pointPolygonTest(const cv::Mat& contour, cv::Point2f pt, bool measu reDist)•contour:表示直线的两个点组成的矩阵,可以通过cv::Mat类型表示。

•pt:点 P 的坐标,类型为cv::Point2f。

•measureDist:一个布尔值参数,用于指定是否计算有符号距离。

如果设置为 true,则在点在线段左侧时返回负值,在右侧时返回正值;如果设置为false,则返回无符号距离。

4. 示例代码下面我们将通过一个示例代码来演示如何使用 OpenCV 中的点到线距离算子。

首先,我们需要引入相应的头文件和命名空间:#include <opencv2/opencv.hpp>using namespace cv;然后,我们定义一条直线和一个点,并计算它们之间的最短距离:int main(){// 定义直线上两个点Point2f linePt1(10, 10);Point2f linePt2(100, 100);// 定义待计算距离的点Point2f pt(50, 70);// 计算点到线的最短距离double distance = pointPolygonTest(Mat(Point2f(linePt1.x, linePt1.y)), pt, true);// 输出结果std::cout << "Distance from point to line: " << distance << std::endl;return 0;}运行上述代码,将得到输出结果:Distance from point to line: -21.21325. 总结本文介绍了 OpenCV 中的点到线距离算子的基本原理、使用方法和示例代码。

个人整理的opencv最基本入门资料

---- By Moco Sun 2010.12.19

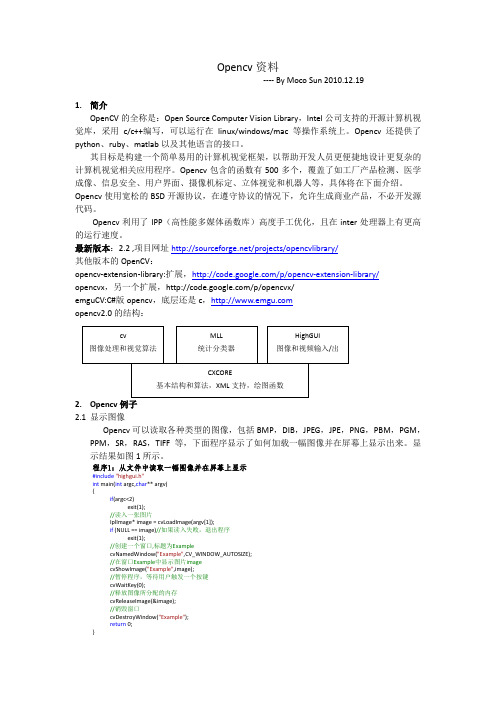

1. 简介 OpenCV 的全称是:Open Source Computer Vision Library,Intel 公司支持的开源计算机视

觉库,采用 c/c++编写,可以运行在 linux/windows/mac 等操作系统上。Opencv 还提供了 python、ruby、matlab 以及其他语言的接口。

//读取图像宽度 //读取图像高度 //读取图像通道数 //读取图像一行像素所占的字节数

{ pchar = (uchar*)image->imageData + i*widthStep; for (j=0; j<width; j++) { uchar* temp = pchar + j*channel; temp[0] += 10;//通道B temp[1] += 10;//通道G temp[2] += 10;//通道R }

其目标是构建一个简单易用的计算机视觉框架,以帮助开发人员更便捷地设计更复杂的 计算机视觉相关应用程序。Opencv 包含的函数有 500 多个,覆盖了如工厂产品检测、医学 成像、信息安全、用户界面、摄像机标定、立体视觉和机器人等,具体将在下面介绍。 Opencv 使用宽松的 BSD 开源协议,在遵守协议的情况下,允许生成商业产品,不必开发源 代码。

CvSize表示图像的大小,为含两个int的结构体,定义如下

typedef struct CvSize { int width; int height; }

CvSize; 小贴士

Cv与cv的区别:以Cv开头的一般是函数,以cv开头的通常是内联数据元素。 CvPoint结构体不支持默认构造函数,但是可以通过inline的cvPoint(注意首字母小写)函数来创 建一个无名的CvPoint,这在传递一些函数参数经常使用,同理,CvScalar与cvScalar,CvSize与 cvSize等也有这样的用法。

opencv, 大纲

opencv, 大纲OpenCV (Open Source Computer Vision Library) 是一个开源的计算机视觉和机器学习库,它包含一系列用于图像处理和计算机视觉的算法。

以下是 OpenCV 的主要大纲:1. 基础操作:图像读取、保存、显示和变换颜色空间转换(例如 RGB 到灰度、HSV 等)图像滤波(模糊、锐化等)2. 特征检测与描述符:特征点检测(如 SIFT, SURF, ORB 等)特征点匹配3. 图像分割与轮廓检测:阈值分割边缘检测(如 Canny, Sobel, Laplacian 等)轮廓检测与拟合4. 模板匹配:使用 OpenCV 的模板匹配方法来查找图像中的模板5. 相机校正与标定:使用 OpenCV 的相机标定和校正功能来获取相机参数6. 运动分析:光流法(如 Lucas-Kanade, Horn-Schunck 等)背景减除(例如 MOG2, GMM 等)7. 3D重建:使用立体视觉或深度相机进行点云重建8. 视频分析:视频流处理(帧差分、背景减除等)9. 机器学习与目标检测:使用 OpenCV 的机器学习模块进行目标检测(例如 Haar Cascades, HOG, DNN 等)10. 其他:OpenCV 还提供了许多其他功能,如图像金字塔、透视变换、光栅化等。

11. 扩展模块:OpenCV 还有许多扩展模块,如用于视频编辑和特效的 `cvx`,用于面部识别的 `face`,用于光学字符识别的 `text` 等。

12. 交互式 API:Python, C++, Java 和其他语言的 API。

OpenCV 支持多种编程语言,包括 Python、C++、Java 和其他语言。

这意味着你可以使用你最喜欢的编程语言来开发计算机视觉应用程序。

13. 优化与性能:OpenCV 经过优化,可以在各种硬件上运行,包括CPU、GPU 和 FPGA。

此外,OpenCV 还支持多线程和并行计算,以提高性能。

opencv——感兴趣区域(ROI)的分析和选取[详细总结]

![opencv——感兴趣区域(ROI)的分析和选取[详细总结]](https://img.taocdn.com/s3/m/81389d14fe00bed5b9f3f90f76c66137ee064fa3.png)

opencv——感兴趣区域(ROI)的分析和选取[详细总结]引⾔在利⽤OpenCV对图像进⾏处理时,通常会遇到⼀个情况,就是只需要对部分感兴趣区域进⾏处理。

因此,如何选取感兴趣区域呢?(其实就是“抠图”)。

在学习opencv的掩码运算后,尝试实现⼀个类似halcon的reduce_domain功能,对于实现抠图的过程中,需要掌握的要点就是位运算符和copyTo函数 位运算符的相关API:void bitwise_and(InputArray src1, InputArray src2, OutputArray dst); //dst = src1 & src2 “与”操作void bitwise_or(InputArray src1, InputArray src2, OutputArray dst); //dst = src1 | src2 “或”操作void bitwise_xor(InputArray src1, InputArray src2, OutputArray dst); //dst = src1 ^ src2 “异或”操作void bitwise_not(InputArray src, OutputArray dst); //dst = ~src “⾮”操作copyTo函数它的定义OpenCV中image.copyTo()有两种形式:1、image.copyTo(imageROI),作⽤是把image的内容复制到imageROI;2、image.copyTo(imageROI,mask),作⽤是把原图(image)和掩膜(mask)与运算后得到ROI区域(imageROI)。

mask就是位图,如果mask像素的值是⾮0的,我就拷贝它,否则不拷贝。

(⾮零的位置就是原图中的那些需要拷贝的部分)正⽂部分对于感兴趣区域(Region of Interest, ROI)的选取,⼀般有两种情形:1)已知ROI在图像中的位置;2)ROI在图像中的位置未知。

opencv 标定参数使用

opencv 标定参数使用OpenCV是一个开源的计算机视觉库,广泛应用于图像处理和计算机视觉任务中。

在许多计算机视觉应用中,相机的标定是一个重要的步骤,用于确定相机内部和外部参数,以便准确地测量和分析图像中的物体。

本文将介绍使用OpenCV进行相机标定的参数设置。

相机标定是将相机的内参和外参参数进行估计的过程。

内参包括焦距、主点坐标和畸变参数等,而外参则包括相机的位置和朝向参数。

在进行相机标定之前,需要准备一组已知的三维空间点和对应的二维图像点对,这些点对即为标定板上的特征点。

在OpenCV中,相机标定的参数设置包括标定板的尺寸、标定板上特征点的尺寸、待标定相机的图像尺寸等。

首先,标定板的尺寸是指标定板上特征点的行列数,通过设置这些参数可以提供更准确的标定结果。

其次,标定板上特征点的尺寸也需要根据实际情况进行设置,通常选择较大的特征点尺寸可以提高标定的精度。

最后,待标定相机的图像尺寸也需要根据实际情况进行设置,以确保标定结果的准确性。

在进行相机标定之前,还需要设置一些与标定相关的参数,例如用于检测标定板的方法、标定板上特征点的检测阈值等。

OpenCV提供了多种方法用于检测标定板,例如使用棋盘格或圆点阵列等。

根据实际情况选择合适的检测方法可以提高标定的准确性。

此外,还可以设置标定板上特征点的检测阈值,通过调整这个参数可以提高标定的鲁棒性。

在进行相机标定时,还需要设置一些与优化相关的参数,例如优化算法的类型、最大迭代次数等。

OpenCV提供了多种优化算法,例如Levenberg-Marquardt算法、高斯牛顿算法等。

根据实际情况选择合适的优化算法可以提高标定的精度。

此外,还可以设置最大迭代次数,通过增加迭代次数可以提高标定的收敛性。

在进行相机标定时,还需要设置一些与畸变矫正相关的参数,例如是否进行畸变矫正、畸变矫正的类型等。

OpenCV提供了多种畸变矫正方法,例如简单的多项式模型和更复杂的鱼眼模型等。

opencv kcf算法使用

摘要: 本文旨在探讨OpenCV中的KCF算法的使用。

首先介绍KCF算法的原理及其在目标跟踪中的应用,然后详细讲解KCF算法在OpenCV中的使用方法,并提供一些实际案例和代码示例。

通过本文的阐述,读者可以更好地理解KCF算法的工作原理,并在实际应用中灵活运用该算法。

一、概述KCF(Kernelized Correlation Filters)算法是一种用于目标跟踪的算法,基于相关滤波器和核技巧。

它在目标跟踪领域有着广泛的应用,并且在速度和准确性上都有较好的表现。

OpenCV作为一个开源的计算机视觉库,提供了丰富的图像处理和分析功能,同时也集成了KCF 算法。

本文将重点介绍KCF算法在OpenCV中的使用方法,并给出一些实际案例和代码示例。

二、KCF算法原理KCF算法是基于相关滤波器的目标跟踪算法,其核心思想是通过学习训练样本的特征来构建模板,并使用该模板来寻找目标在下一帧图像中的位置。

KCF算法在不同尺度和位置上对目标特征进行了有效的提取和描述,同时使用了核技巧来提高算法的运算速度和准确性。

KCF算法的主要步骤如下:1. 初始化:选择目标区域,并提取其特征作为训练样本。

2. 训练:使用训练样本构建相关滤波器模型。

3. 目标定位:在下一帧图像中利用相关滤波器模型进行目标定位。

4. 更新:根据新的目标位置和特征来更新相关滤波器模型。

KCF算法通过有效的特征提取和学习训练样本来实现目标跟踪,其核技巧和滤波器设计使得算法具有较快的运行速度和较高的准确性。

三、KCF算法在OpenCV中的使用在OpenCV中,KCF算法的使用非常简便。

下面将介绍KCF算法在OpenCV中的具体实现步骤。

1. 导入相关的模块首先需要导入相关的模块,包括OpenCV模块和numpy模块。

```pythonimport cv2import numpy as np```2. 读取视瓶文件使用OpenCV的VideoCapture()函数来读取视瓶文件,并获取第一帧图像。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Android使用OpenCv总结

1:Android使用OpenCv有二种方式:、

1) 使用静态的OpenCV库的方式

2) 使用动态的OpenCV库的方式

这三种方式均无需安装OpenCVManager,区别在于mk文件不同

2:两种方式的使用说明

1) Android JNI调用OpenCv的第一种配置方法:

Application.mk文件里的内容如下:

APP_STL:=gnustl_static

APP_CPPFLAGS:=-frtti -fexceptions

APP_ABI:= armeabi-v7a

这三种方式的Application.mk都一样,所以往后不说了。在Application.mk

里还可以配置APP_PLATFORM=17类似这种,当然不配置完全可以。

Android.mk内容如下:

LOCAL_PATH := $(call my-dir)

include $(CLEAR_VARS)

OpenCV_INSTALL_MODULES:=on

OPENCV_CAMERA_MODULES:=off

OPENCV_LIB_TYPE:=STATIC

ifeq ("$(wildcard $(OPENCV_MK_PATH))","")

include D:\ProgramFile\OpenCV-2.4.9-android-sdk\sdk\native\jni\OpenCV.mk

else

include $(OPENCV_MK_PATH)

endif

LOCAL_MODULE := ProcessImg

LOCAL_SRC_FILES := DetectFace_JNI.cpp \

src/copyToAssets.cpp \

src/detectFace.cpp

LOCAL_LDLIBS += -lm -llog

include $(BUILD_SHARED_LIBRARY)

逐一解释下,OpenCV_INSTALL_MODULES:=on的意思是自动将依赖的

OpenCV的so库拷贝到libs目录下,但很遗憾的是,这个命令只对

OPENCV_CAMERA_MODULES有效。只有当

OPENCV_CAMERA_MODULES:=on时,可以看到他会自动将里面的带

camera的so拷贝至工程下的libs文件夹下。include

D:\ProgramFile\OpenCV-2.4.9-android-sdk\sdk\native\jni\OpenCV.mk这句话

比较关键,这是我安装OpenCV-2.4.9-android-sdk的地方,我将其安装到

了D盘。而我的工作空间在E盘也是ok的。而不用像OpenCV2.3.1使用

时,限制这个解压缩包的位置了。LOCAL_MODULE 是要生成的库的名

字,LOCAL_SRC_FILES 是jni文件夹下的cpp文件,其中的src说明我的jni

下还有个子文件夹名字是“src”,这块替换成自己的源码文件就ok了。

2) Android以JNI调OpenCV的第二种配置方法

Application.mk文件同上,Android.mk文件如下

LOCAL_PATH := $(call my-dir)

include $(CLEAR_VARS)

OpenCV_INSTALL_MODULES:=on

OPENCV_CAMERA_MODULES:=off

OPENCV_LIB_TYPE:=SHARE

ifeq ("$(wildcard $(OPENCV_MK_PATH))","")

include D:\ProgramFile\OpenCV-2.4.9-android-sdk\sdk\native\jni\OpenCV.mk

else

include $(OPENCV_MK_PATH)

endif

LOCAL_MODULE := ProcessImg

LOCAL_SRC_FILES := DetectFace_JNI.cpp \

src/copyToAssets.cpp \

src/detectFace.cpp

LOCAL_LDLIBS := -lm -llog

include $(BUILD_SHARED_LIBRARY)

唯一的变化时将OPENCV_LIB_TYPE:=STATIC 变成了SHARE.即通过动态链

接的方式连接OpenCV的so