最优化问题的计算机求解

最优化理论与算法

最优化理论与算法

优化理论与算法研究的目标是解决最优化问题,即给定一定的约束条

件下,求得目标函数的最佳值,优化理论与算法是计算机科学、数学、运

筹学及其它相关学科的重要组成部分,是一个多学科交叉学科。

优化理论

与算法是指对复杂环境、条件、限制等进行模型建立,并以此模型为基础,运用计算机对各种优化问题进行求解,得到最优解的方法。

它在产业中的

应用非常广泛,包括交通系统、排课模式、物流系统、科研计划等,它的

应用领域也不断扩大。

优化理论与算法包括几何优化、数值优化、组合优化、动态规划等,

其中几何优化是指把优化问题转换成几何问题,按照优化准则进行空间,

以求取最优解的方法。

数值优化是指根据给定的模型,使用计算机求解目

标函数的最优解的方法。

组合优化是指求解那些变量数量特别多,而每个

变量又只能取有限的取值,使其能达到最优解的一种技术。

动态规划是指

通过构建有限步骤,每步骤之间相互关联的一个优化过程,以求得最优解

的方法。

优化理论与算法综合利用了统计学、数理统计、概率论、凸分析、数

值分析和计算机程序的优势和特点,能有效地处理实际中复杂的优化问题。

最优化问题的建模与解法

最优化问题的建模与解法最优化问题(optimization problem)是指在一组可能的解中寻找最优解的问题。

最优化问题在实际生活中有广泛的应用,例如在工程、经济学、物流等领域中,我们经常需要通过数学模型来描述问题,并利用优化算法来求解最优解。

本文将介绍最优化问题的建模和解法,并通过几个实例来说明具体的应用。

一、最优化问题的数学建模最优化问题的数学建模包括目标函数的定义、约束条件的确定以及变量范围的设定。

1. 目标函数的定义目标函数是一个表达式,用来衡量问题的解的优劣。

例如,对于一个最大化问题,我们可以定义目标函数为:max f(x)其中,f(x)是一个关于变量x的函数,表示问题的解与x的关系。

类似地,对于最小化问题,我们可以定义目标函数为:min f(x)2. 约束条件的确定约束条件是对变量x的一组限制条件,用来定义问题的可行解集合。

约束条件可以是等式或不等式,通常表示为:g(x) ≤ 0h(x) = 0其中,g(x)和h(x)分别表示不等式约束和等式约束。

最优化问题的解必须满足所有的约束条件,即:g(x) ≤ 0, h(x) = 03. 变量范围的设定对于某些变量,可能需要限定其取值的范围。

例如,对于一个实数变量x,可能需要设定其上下界限。

变量范围的设定可以通过添加额外的不等式约束来实现。

二、最优化问题的解法最优化问题的解法包括数学方法和计算方法两种,常见的数学方法有最优性条件、拉格朗日乘子法等,而计算方法主要是通过计算机来求解。

1. 数学方法数学方法是通过数学分析来求解最优化问题。

其中,常见的数学方法包括:(1)最优性条件:例如,对于一些特殊的最优化问题,可以通过最优性条件来判断最优解的存在性和性质。

最优性条件包括可导条件、凸性条件等。

(2)拉格朗日乘子法:对于带有约束条件的最优化问题,可以通过拉格朗日乘子法将原问题转化为无约束最优化问题,从而求解最优解。

2. 计算方法计算方法是通过计算机来求解最优化问题。

第6章 代数方程与最优化问题的计算机求解

例6-12

求非线性方程组全部根

感兴趣区间 图解法

10/30/2016星期六, 2008-9- 6, 13:09:29

高等应用数学问题的MATLAB求解 东北大学信息学院 29/195

设定求解区间 [-2*pi,2*pi] 求解

用图解法显示出找到的全部根

10/30/2016星期六, 2008-9- 6, 13:09:29

10/30/2016星期六, 2008-9- 6, 13:09:29 高等应用数学问题的MATLAB求解 东北大学信息学院 21/195

6.1.4 求解多解方程的全部解

Riccati 方程(第4章)

更多的非线性矩阵方程,例如,

广义Riccati方程

类Riccati方程

还有很多很多的矩阵方程

10/30/2016星期六, 2008-9- 6, 13:09:29 高等应用数学问题的MATLAB求解 东北大学信息学院 22/195

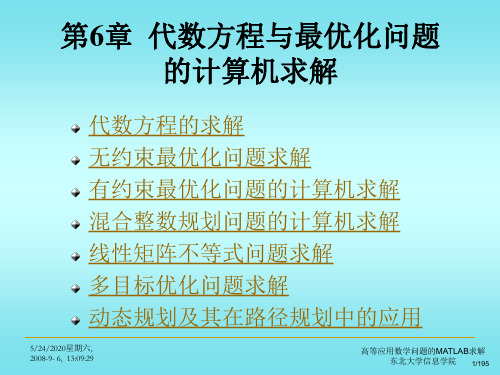

第6章 代数方程与最优化问题 的计算机求解

代数方程的求解 无约束最优化问题求解 有约束最优化问题的计算机求解 混合整数规划问题的计算机求解 线性矩阵不等式问题求解 多目标优化问题求解 动态规划及其在路径规划中的应用

10/30/2016星期六, 2008-9- 6, 13:09:29 高等应用数学问题的MATLAB求解 东北大学信息学院 1/195

高等应用数学问题的MATLAB求解 东北大学信息学院 41/195

6.2.3 全局最优解与局部最优解

最小值存在的必要条件是

使用搜索方法,从初始值出发,可能找到 一个这样的点,它是局部最小值 局部极小值中目标函数最小的为全局最小 整个目标函数可能存在多个局部最小值 搜索算法不一定能求出全局最小值

数学中的最优化理论

数学中的最优化理论最优化理论作为数学中一个重要的分支,其目的是寻找在给定条件下能够使某一函数取得最优值的变量取值。

最优化问题广泛应用于工程、经济、计算机科学等领域,对于提高效率、降低成本具有重要意义。

本文将对最优化理论的基本概念、常见方法和应用进行介绍。

一、最优化理论的基本概念最优化问题可以归结为如下形式:$$\min_{x \in D} f(x)$$其中,$D$是定义域,$f(x)$是目标函数。

最优化问题分为约束优化和无约束优化两类。

在约束优化问题中,目标函数的取值需要满足一定的条件。

无约束优化问题则没有这样的限制条件。

在求解最优化问题时,我们需要找到一个使目标函数值最小的变量取值。

这个变量取值被称为最优解,对应的目标函数值被称为最优值。

最优解的存在性和唯一性是最优化问题的重要性质,而最优化理论研究的就是如何找到最优解。

二、最优化问题的常见求解方法1. 数学分析方法数学分析方法主要通过对目标函数进行求导以及对约束条件进行分析,来得到最优解。

这种方法通常适用于目标函数和约束条件具有良好的可导性质的情况。

通过求解一阶导数为零的方程组,可以得到最优解的可能取值。

然后通过二阶导数的符号来判断这些取值是最大值还是最小值。

2. 梯度下降法梯度下降法是一种常用的优化方法,特别适用于目标函数为凸函数的情况。

其基本思想是通过不断朝着函数梯度的负方向迭代,直到找到最小值或达到预设的停止条件。

梯度下降法的优势在于可以处理大规模问题,并且不需要求解函数的导数。

然而,梯度下降法可能陷入局部最优解,因此在实际应用中需要谨慎选择初始点和调整学习率。

3. 线性规划法线性规划是一种特殊的最优化问题,其目标函数和约束条件均为线性函数。

线性规划问题具有良好的可解性,并且有高效的算法可以求解。

最著名的线性规划方法是单纯形法,它通过不断沿着可行解空间中的边界移动,寻找最优解。

此外,整数规划、二次规划等也是常见的最优化问题,各自有不同的求解方法。

数学中的最优化问题

数学中的最优化问题数学中的最优化问题是一类重要的数学问题,其目标是寻找某个函数的最优解,即使得函数取得最大值或最小值的输入变量的取值。

最优化问题在数学、经济学、物理学等领域有广泛的应用,对于解决实际问题具有重要意义。

一、最优化问题的基本概念在介绍最优化问题之前,需要先了解几个基本的概念。

1. 目标函数:最优化问题中,我们定义一个目标函数,该函数是一个关于变量的函数,表示我们要优化的目标。

2. 约束条件:最优化问题中,往往存在一些限制条件,这些条件限制了变量的取值范围。

这些限制条件可以是等式约束或者不等式约束。

3. 最优解:最优解是指满足约束条件下使得目标函数取得最优值的变量取值。

最优解可能是唯一的,也可能存在多个。

二、最优化问题的求解方法在数学中,有多种方法可以求解最优化问题。

以下是几种常见的方法:1. 解析法:对于一些特殊的最优化问题,我们可以通过解析的方法求解。

这种方法通常需要对目标函数进行求导,并解方程得到极值点。

2. 迭代法:对于一些复杂的最优化问题,解析法并不适用,这时可以采用迭代法求解。

迭代法通过不断地逼近最优解,逐步优化目标函数的值。

3. 线性规划:线性规划是一种常见的最优化问题,它的约束条件和目标函数都是线性的。

线性规划可以利用线性代数的方法进行求解,有着广泛的应用。

4. 非线性规划:非线性规划是一类更一般的最优化问题,约束条件和目标函数都可以是非线性的。

非线性规划的求解比线性规划更为困难,需要采用一些数值方法进行逼近求解。

三、最优化问题的应用最优化问题在各个领域都有广泛的应用,下面以几个具体的例子来说明:1. 经济学中的最优化问题:经济学中的生产优化、消费优化等问题都可以抽象为最优化问题。

通过求解最优化问题,可以找到最有效的生产组合或最佳的消费策略。

2. 物理学中的最优化问题:在物理学中,最优化问题常常涉及到动力学、优化控制等方面。

例如,在机械设计中,可以通过最优化问题确定各部件的尺寸和形状,使得机械系统具有最佳的性能。

牛顿迭代法的最优化方法和应用

牛顿迭代法的最优化方法和应用牛顿迭代法是一种优化算法,它基于牛顿法和迭代法的思想,广泛应用于最优化问题的求解中。

在计算机科学、数学和工程等领域,牛顿迭代法被广泛应用于解决各种实际问题,如机器学习、数值分析和物理模拟等。

一、基本原理牛顿迭代法的基本思想是在当前点的邻域内用二次函数近似目标函数,然后在近似函数的极小点处求解最小化问题。

具体而言,假设我们要最小化一个凸函数$f(x)$,我们可以在当前点$x_k$处利用泰勒级数将其近似为:$$f(x_k+p)\approx f(x_k)+\nabla f(x_k)^Tp+\frac12p^T\nabla^2f(x_k)p$$其中,$p$是一个向量,$\nabla f(x_k)$和$\nabla ^2f(x_k)$分别是$f(x_k)$的一阶和二阶导数,也称为梯度和黑塞矩阵。

我们可以令近似函数的一阶导数等于零,即$\nabla f(x_k)+\nabla^2f(x_k)p=0$,然后解出$p$,得到$p=-\nabla ^{-1}f(x_k)\nablaf(x_k)$。

于是我们可以将当前点更新为$x_{k+1}=x_k+p$。

我们可以重复这个过程,直到目标函数收敛到我们所需的精度。

二、应用实例1. 机器学习:牛顿迭代法可以用于训练神经网络和逻辑回归等机器学习模型。

在神经网络中,牛顿迭代法可以帮助我们优化网络的权重和偏置,以提高网络的准确性和鲁棒性。

在逻辑回归中,牛顿迭代法可以帮助我们学习双分类问题的参数和概率分布。

2. 数值分析:牛顿迭代法可以用于求解非线性方程和方程组的根。

例如,我们可以使用牛顿迭代法来解决$sin(x)=0$和$x^2-2=0$这样的方程。

当然,为了保证迭代收敛,我们需要选择一个合适的初始点,并且要确保目标函数是连续和可微的。

3. 物理模拟:牛顿迭代法可以用于求解物理方程组的数值解。

它可以帮助我们模拟地球的运动轨迹、热力学系统的稳态和弹性材料的应力分布等。

贪心算法在最优化问题中的应用研究

贪心算法在最优化问题中的应用研究第一章:引言贪心算法是在最优化问题中被广泛应用的一种算法。

在计算机科学领域中,贪心算法是一种启发式算法,通过在每个步骤中选择最优解决方案来达到整体最优解决方案。

贪心算法的特点是该算法快速简单且易于理解。

在不同的最优化问题中,贪心算法具有不同的应用方法和实现方式。

本文将介绍贪心算法的基本原理和应用方法,并从实际问题出发,分析贪心算法在最优化问题中的应用实例。

第二章:贪心算法基本原理贪心算法是一种求解最优解的启发式算法。

贪心算法在每个步骤中选择当前状态下的最优解,使得整体解决方案达到最优化。

贪心算法与动态规划、分支界限等算法相比较,贪心算法具有简单快速的特点。

贪心算法的过程如下:1、定义最优解。

2、根据问题定义选择一个最优解策略。

3、根据最优策略,在当前状态下选择最优的解。

4、对于已选择的最优解,在下一个状态下重复步骤3,直到达到最优解。

贪心算法的正确性需要证明,即要证明每一步选择的最优解可以达到整体最优解。

第三章:贪心算法应用方法针对不同的最优化问题,贪心算法具有不同的应用方法。

本节将从两个方面来介绍贪心算法应用的两种方法。

1、构造法贪心算法通过构造法实现。

通常情况下,构造法通过从剩余选项中选择当前状态下的最优解。

举例说明,对于背包问题,贪心算法以价值单位最高为准则优先选取物品装入背包中。

在霍夫曼编码问题中,贪心算法选择以最小的频率为基准选择编码,这样可以使总编码长度最小。

2、优化法贪心算法通过优化法实现。

通常情况下,优化法通过贪心算法的思路对问题进行重构。

这样,在选择最优状态时,将避免一些不必要的无效状态。

举例说明,对于旅行推销员问题,贪心算法可以通过选择离当前节点距离最近的邻居节点,避免重复和无效的状态。

第四章:应用实例贪心算法在不同的实际问题中得到了充分的应用。

在本章中,将通过两个实际问题来展示贪心算法的具体应用。

1、硬币找零贪心算法在硬币找零问题中得到了应用。

最优化基础理论与方法

最优化基础理论与⽅法⽬录1.最优化的概念与分类 (2)2. 最优化问题的求解⽅法 (3)2.1线性规划求解 (3)2.1.1线性规划模型 (3)2.1.2线性规划求解⽅法 (3)2.1.3 线性规划算法未来研究⽅向 (3)2.2⾮线性规划求解 (4)2.2.1⼀维搜索 (4)2.2.2⽆约束法 (4)2.2.3约束法 (4)2.2.4凸规划 (5)2.2.5⼆次规划 (5)2.2.6⾮线性规划算法未来研究⽅向 (5)2.3组合规划求解⽅法 (5)2.3.1 整数规划 (5)2.3.2 ⽹络流规划 (7)2.4多⽬标规划求解⽅法 (7)2.4.1 基于⼀个单⽬标问题的⽅法 (7)2.4.2 基于多个单⽬标问题的⽅法 (8)2.4.3多⽬标规划未来的研究⽅向 (8)2.5动态规划算法 (8)2.5.1 逆推解法 (8)2.5.2 顺推解法 (9)2.5.3 动态规划算法的优点及研究⽅向 (9)2.6 全局优化算法 (9)2.6.1 外逼近与割平⾯算法 (9)2.6.2 凹性割⽅法 (9)2.6.3 分⽀定界法 (9)2.6.4 全局优化的研究⽅向 (9)2.7随机规划 (9)2.7.1 期望值算法 (10)2.7.2 机会约束算法 (10)2.7.3 相关机会规划算法 (10)2.7.4 智能优化 (10)2.8 最优化软件介绍 (11)3 最优化算法在电⼒系统中的应⽤及发展趋势 (12)3.1 电⼒系统的安全经济调度问题 (12)3.1.1电⼒系统的安全经济调度问题的介绍 (12)3.1.2电⼒系统的安全经济调度问题优化算法的发展趋势 (12)2. 最优化问题的求解⽅法最优化⽅法是近⼏⼗年形成的,它主要运⽤数学⽅法研究各种优化问题的优化途径及⽅案,为决策者提供科学决策的依据。

最优化⽅法的主要研究对象是各种有组织系统的管理问题及其⽣产经营活动。

最优化⽅法的⽬的在于针对所研究的系统,求得⼀个合理运⽤⼈⼒、物⼒和财⼒的最佳⽅案,发挥和提⾼系统的效能及效益,最终达到系统的最优⽬标。

基于遗传算法的最优化问题求解方法

基于遗传算法的最优化问题求解方法随着人工智能技术的不断发展和普及,最优化问题在工程、经济、管理等领域中得到了广泛应用。

最优化问题是指在一定的限制条件下,寻找最佳的决策方案,从而能够获得最优的效果。

为了解决最优化问题,人们在不断探索新的算法和方法。

其中,基于遗传算法的最优化问题求解方法备受关注。

遗传算法是一种基于生物进化思想的计算机算法,具有全局优化、可适应性强、鲁棒性好等特点,因此在最优化问题的求解中扮演着重要的角色。

一、遗传算法的概念和基本原理遗传算法是模拟生物进化过程的计算机算法。

它是从自然界中生物进化的过程中发掘出来的一种求解最优化问题的方法。

遗传算法的基本原理是模拟生物进化过程的三个操作:选择、交叉和变异。

1.选择操作选择操作是指根据个体适应度大小,按照一定的概率选择优秀个体,淘汰劣质个体。

具体实现方法是在种群中随机选择两个个体比较它们的适应度,然后根据某种方法保留优秀个体并淘汰劣质个体,以此来生成新的种群。

选择操作是遗传算法中最重要的操作之一,它直接影响到算法的性能。

2.交叉操作交叉操作是指将已选择的优秀个体进行交叉从而生成新的个体。

具体实现方法是在两个被选择的个体之间随机选取交叉点,并交换两个个体之间的某些基因信息。

目的是为了保留经过选择操作后的优秀个体,并且在新的个体中引入多样性,增加种群的搜索范围,从而增强算法的全局搜索能力。

3.变异操作变异操作是指在某些条件下,对已经生成的新个体进行个别基因的改变。

具体实现方法是选取某个新个体的一个基因进行随机改变操作,例如随机增加、删除或修改某个基因的值。

变异操作是为了增加多样性,避免算法陷入局部最优解,从而提高算法的全局寻优能力。

二、遗传算法的优点和不足遗传算法具有一系列的优点,主要包括以下方面。

1.全局最优性遗传算法具有全局寻优能力,它能够搜索全部解空间,并找到全局最优解。

这是由于它采用了随机寻优方法,能够避免陷入局部最优解。

2.可适应性强遗传算法能够自适应地调整参数,以适应问题的复杂性和难度,在不同的环境下优化效果也不同。

sos 计算方法

sos 计算方法【实用版3篇】篇1 目录1.SOS 计算方法的概念和背景2.SOS 计算方法的原理3.SOS 计算方法的应用4.SOS 计算方法的优缺点5.总结篇1正文1.SOS 计算方法的概念和背景SOS(Sum of Squares,平方和)计算方法是一种求解最优化问题的数值方法,主要应用于求解非线性规划问题。

这种方法在处理具有特定结构的非线性问题时表现出卓越的性能,如求解二次规划问题、拟线性规划问题等。

2.SOS 计算方法的原理SOS 计算方法基于拉格朗日乘子法,通过将非线性规划问题转化为求解一个关于拉格朗日乘子的线性规划问题来实现。

在此过程中,SOS 方法通过构造一个关于决策变量的平方和函数,并引入拉格朗日乘子,将原问题转化为求解一个关于这些乘子的线性规划问题。

然后,利用线性规划算法求解该问题,得到最优解。

3.SOS 计算方法的应用SOS 计算方法广泛应用于各种实际问题中,如经济学、工程、计算机科学等领域。

具体来说,它可用于求解如下问题:- 二次规划问题:当目标函数和约束条件都是关于决策变量的二次函数时,SOS 方法可以简化为求解一个线性规划问题。

- 拟线性规划问题:当目标函数是关于决策变量的线性函数,而约束条件是关于决策变量的二次函数时,SOS 方法可以简化为求解一个线性规划问题。

- 其他具有特定结构的非线性规划问题:SOS 方法可以处理一些具有特定结构的非线性规划问题,如具有特殊形式的对数约束条件、指数约束条件等。

4.SOS 计算方法的优缺点优点:- SOS 方法在处理具有特定结构的非线性规划问题时,具有较高的计算效率和稳定性。

- SOS 方法求解出的解通常是全局最优解,因此在求解最优化问题时具有较高的可靠性。

缺点:- SOS 方法在处理一般性的非线性规划问题时,可能无法有效地提高计算效率。

- SOS 方法在求解过程中需要构造一个关于决策变量的平方和函数,这可能导致计算复杂度的增加。