区间数据下EV线性回归模型修正的广义最小二乘估计_何其祥

最小二乘估计定义

最小二乘估计定义【最小二乘估计定义】**开场白**嘿,朋友们!在我们的日常生活中,经常会遇到需要从一堆数据中找出规律或者做出预测的情况。

比如说,你想根据过去几个月的消费情况来估计下个月的开销,或者根据自己多次考试的成绩来预估下次能考多少分。

这时候,就有一种神奇的方法能帮助我们,那就是最小二乘估计。

今天,咱们就来好好聊聊这个有趣又实用的话题。

**什么是最小二乘估计?**其实,最小二乘估计就是一种通过数据找到“最佳拟合直线”或者“最佳拟合曲线”的方法。

打个比方,假设你记录了自己每周锻炼的时长和体重的变化,想要找到这两者之间的关系。

最小二乘估计就能帮你找到一条线,让这些数据点到这条线的距离的平方和最小。

这可不像我们随便画一条线那么简单,有些人可能会误解,觉得随便找一条差不多的线就行。

其实不是的,最小二乘估计是有严格的计算方法和标准的,它保证找到的是最能反映数据趋势的那条线。

**关键点解析**3.1 核心特征或要素首先,它的目标是让误差的平方和最小。

就像你投篮,要尽量让每个球离篮筐中心的距离的平方和最小,这样才能投得更准。

其次,需要有数据点。

这些数据点就像是一个个路标,指引着我们找到最佳的拟合线。

最后,它是基于数学原理进行计算的。

有一套严谨的公式和算法,可不是靠感觉来的。

3.2 容易混淆的概念最小二乘估计和简单线性回归有些相似,但也有区别。

简单线性回归也是找变量之间的关系,但它更侧重于对因果关系的探讨。

而最小二乘估计重点在于找到最优的拟合线,不一定要强调因果。

**起源与发展**最小二乘估计的历史可以追溯到 18 世纪。

当时的科学家们在研究天文观测数据时,发现需要一种方法来处理数据中的误差。

于是,最小二乘估计应运而生。

随着时代的发展,它在各个领域都发挥了重要作用。

在当下,大数据和人工智能盛行,最小二乘估计更是成为了数据分析和机器学习中不可或缺的工具。

未来,它可能会变得更加精准和高效,帮助我们从海量的数据中挖掘出更有价值的信息。

回归模型的参数估计与假设检验

回归模型的参数估计与假设检验回归模型的参数估计主要包括最小二乘估计和极大似然估计两种方法。

最小二乘估计是以最小化残差平方和为目标,通过对样本数据进行拟合,求得最优的回归系数。

极大似然估计则是基于对数据样本概率分布的假设,利用最大化似然函数来估计回归模型的参数。

最小二乘估计是最常用的参数估计方法之一、它的基本思想是通过最小化实际观测值与模型预测值之间的差异,来估计回归模型的参数。

具体而言,对于简单线性回归模型(y=β0+β1x+ε),最小二乘估计通过最小化残差平方和来求解β0和β1的估计值。

最小二乘估计方法具有许多优点,如解析解存在、估计结果具有线性无偏性、效率性好等。

在最小二乘估计的基础上,还可以进行各种统计检验,用于检验回归系数的显著性。

常见的假设检验方法包括t检验和F检验。

t检验用于测试回归系数是否与零有显著差异。

在回归模型中,t统计量的计算公式为:t=估计值/标准误差其中,估计值是通过最小二乘法得到的回归系数估计值,标准误差则是估计标准误差的估计值。

t统计量的值越大,说明回归系数与零的差异越显著。

F检验用于测试回归模型整体的显著性。

F统计量的计算公式为:F=(回归平方和/自由度)/(残差平方和/自由度)其中,回归平方和表示回归模型能够解释的样本数据方差之和,残差平方和表示回归模型无法解释的样本数据方差之和。

自由度则表示相关统计量中所用到的自由参数个数。

通过计算F统计量的值,可以得到一个关于回归模型整体显著性的p 值。

p值小于给定的显著性水平(通常为0.05或0.01),则拒绝“回归模型无效”的原假设,即认为回归模型整体显著。

回归模型的参数估计和假设检验是回归分析的核心步骤,可以帮助研究者理解因变量和自变量之间的关系,并通过假设检验来进行推断和判断。

这些方法不仅在社会科学和经济学领域有广泛应用,也在相关学科的研究中具有重要意义。

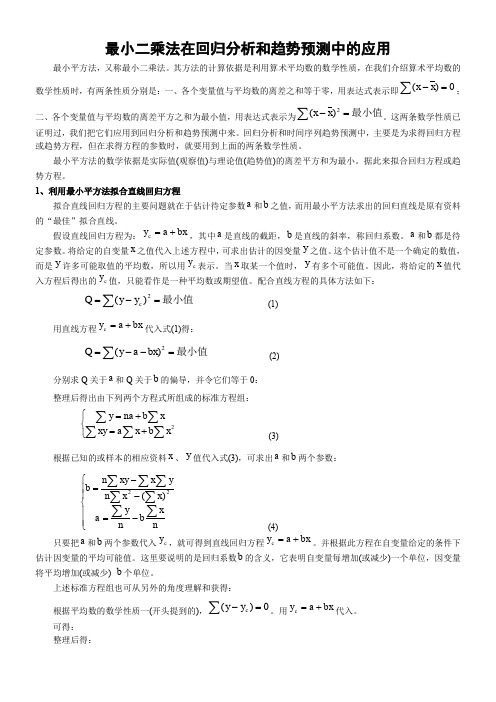

最小二乘法在回归分析和趋势预测中的应用

最小二乘法在回归分析和趋势预测中的应用最小平方法,又称最小二乘法。

其方法的计算依据是利用算术平均数的数学性质,在我们介绍算术平均数的数学性质时,有两条性质分别是:一、各个变量值与平均数的离差之和等于零,用表达式表示即0)(=-∑x x ;二、各个变量值与平均数的离差平方之和为最小值,用表达式表示为最小值=-∑2)(x x 。

这两条数学性质已证明过,我们把它们应用到回归分析和趋势预测中来。

回归分析和时间序列趋势预测中,主要是为求得回归方程或趋势方程,但在求得方程的参数时,就要用到上面的两条数学性质。

最小平方法的数学依据是实际值(观察值)与理论值(趋势值)的离差平方和为最小。

据此来拟合回归方程或趋势方程。

1、利用最小平方法拟合直线回归方程拟合直线回归方程的主要问题就在于估计待定参数a 和b 之值,而用最小平方法求出的回归直线是原有资料的“最佳”拟合直线。

假设直线回归方程为:bx a y c +=,其中a 是直线的截距,b 是直线的斜率,称回归系数。

a 和b 都是待定参数。

将给定的自变量x 之值代入上述方程中,可求出估计的因变量y 之值。

这个估计值不是一个确定的数值,而是y 许多可能取值的平均数,所以用c y 表示。

当x 取某一个值时,y 有多个可能值。

因此,将给定的x 值代入方程后得出的c y 值,只能看作是一种平均数或期望值。

配合直线方程的具体方法如下:∑=-=最小值2)(c y y Q (1) 用直线方程bx a y c +=代入式(1)得:最小值=--=∑2)(bx a y Q (2) 分别求Q 关于a 和Q 关于b 的偏导,并令它们等于0: 整理后得出由下列两个方程式所组成的标准方程组:⎩⎨⎧+=+=∑∑∑∑∑2x b x a xy x b na y (3)根据已知的或样本的相应资料x 、y 值代入式(3),可求出a 和b 两个参数:⎪⎪⎩⎪⎪⎨⎧-=--=∑∑∑∑∑∑∑n x b n y a x x n y x xy n b 22)( (4)只要把a 和b 两个参数代入c y ,就可得到直线回归方程bx a y c +=。

最小二乘估计原理

最小二乘估计原理最小二乘估计是一种常用的参数估计方法,它可以用来估计线性回归模型中的参数。

在实际应用中,最小二乘估计被广泛应用于数据拟合、信号处理、统计分析等领域。

本文将介绍最小二乘估计的原理及其应用。

最小二乘估计的原理是基于最小化观测值与模型预测值之间的误差平方和来进行参数估计。

在线性回归模型中,我们通常假设因变量Y与自变量X之间存在线性关系,即Y = β0 + β1X + ε,其中β0和β1是待估参数,ε是误差项。

最小二乘估计的目标是找到最优的β0和β1,使得观测值与模型预测值之间的误差平方和最小。

为了形式化地描述最小二乘估计的原理,我们可以定义损失函数为误差的平方和,即L(β0, β1) = Σ(Yi β0 β1Xi)²。

最小二乘估计的思想就是通过最小化损失函数来求解最优的参数估计值。

为了找到最小化损失函数的参数估计值,我们可以对损失函数分别对β0和β1求偏导数,并令偏导数等于0,从而得到最优的参数估计值。

在实际应用中,最小二乘估计可以通过求解正规方程来得到参数的闭式解,也可以通过梯度下降等迭代方法来进行数值优化。

无论采用何种方法,最小二乘估计都能够有效地估计出线性回归模型的参数,并且具有较好的数学性质和统计性质。

除了在线性回归模型中的应用,最小二乘估计还可以推广到非线性回归模型、广义线性模型等更加复杂的模型中。

在这些情况下,最小二乘估计仍然是一种有效的参数估计方法,并且可以通过一些变形来适应不同的模型结构和假设条件。

总之,最小二乘估计是一种重要的参数估计方法,它具有简单直观的原理和较好的数学性质,适用于各种统计模型的参数估计。

通过最小化观测值与模型预测值之间的误差平方和,最小二乘估计能够有效地估计出模型的参数,并且在实际应用中取得了广泛的成功。

希望本文对最小二乘估计的原理有所帮助,谢谢阅读!。

线性约束下的异方差回归模型参数的广义最小二乘估计_胡俊航

X* cY* -

K= 2[H( X* cX* )Hc]

C

- 1

{ H[ ( X* cX* )

- 1

X* cY* ] - c} ( 7)

把 ( 7) 代入 ( 6) 得

X 收稿日期: 2009- 02- 24 作者简介: 胡俊航, 男, 河南质量工程职业学院经贸与管理系讲师, 理学硕士。

# 36 #

# 37 #

2 diag( R2 1, R2 ,

这里 K 是待定的 q @ 1 向量。对 ( 3) 两边分别求关于 B, K的偏导数并 令其等于 0 得 9 L( B, K ) = - 2X* cY* + 2X* cX* B+ HcK = 0 9B 9 L( B, K ) = HB- c= 0 9B ( 4) ( 5)

X)

- 1

X c5

- 1

Y

根据 ( 11) , ( 9) 可以写成 B= B- ( X c5 - 1X) - 1Hc[ H( X c5 - 1X) H c] - 1( H B- c) ( 12) 由 ( 12) , 模型 ( 1) 残差平方和 RSS( Bc) = ( Y - XBc)c( Y- XBc) = ( Y- X B) c( Y- X B) + { (X c5 - 1X) - 1Hc[ H( X c5 - 1X)Hc] - 1 (H B- c) } .X cX{ ( X c5 - 1X) - 1Hc[ H( X c5 - 1X) Hc] - 1( H B- c) } = ( Y - X B)c( Y- X B) + ( B- B cc)cX cX( B- B c c) = RSS( B) + ( B- B cc) XX c( B- B cc) > RSS( B) ( 13) 由此可见 , 线性约束 的异方 差回归 模型参 数的 广义最 小二乘估计的残差平方和比无约束的异方差回归模型参数

最小二乘估计及其应用

最小二乘估计及其应用在许多实际问题中,我们需要从已知的数据集中预测一些未知的结果,这时候统计学中的回归分析就派上用场了。

回归分析旨在通过输入变量(预测因子)和输出变量(预测结果)之间的数学关系,来预测未知值。

其中最小二乘估计(Least Squares Estimation)是回归分析的一种基本方法,也广泛应用于其他实际问题中。

最小二乘估计是一种方法,通过最小化预测数据与实际数据之间的误差平方和来构建回归方程。

这个方法可以用于线性回归和非线性回归,因为这两种回归方法都需要预测数据与实际数据之间的误差平方和尽可能的小。

最小二乘估计的核心思想是,找到一条线/曲线(回归方程),使该线/曲线与每个实际数据点的距离之和最小。

这个距离也称为残差(Residual),表示预测值与真实值之间的差异,而误差平方和则是所有残差平方和的总和。

在线性回归中,最小二乘估计会找到一条直线(回归直线),使得直线上所有数据点到该直线的距离之和最小。

回归方程可以用以下公式表示:y = β0 + β1x其中y是输出变量,β0是y截距,β1是y与x之间的斜率,x是输入变量。

β0和β1的值是通过最小化残差平方和来估计。

非线性回归中,最小二乘估计会找到一条曲线(回归曲线),使得曲线上所有数据点到该曲线的距离之和最小。

在这种情况下,回归方程的形式不再是y=β0 + β1x,而是通过一些非线性函数(如指数、幂函数等)来表示。

这时候,估计β0和β1的完整算法由于模型的非线性而变得更加复杂,但最小二乘估计仍然是其中一个核心算法。

最小二乘估计可以应用于多种实际问题中。

在金融领域,最小二乘估计可用于计算资产回报和风险之间的关系。

在医学研究中,最小二乘估计可用于研究某种疾病与多个因素(如年龄、性别、生活方式)之间的关系。

在电子商务领域,最小二乘估计可用于分析客户购买行为,以制定更有效的市场营销战略。

总的来说,最小二乘估计可以应用于所有需要预测未知值的领域中。

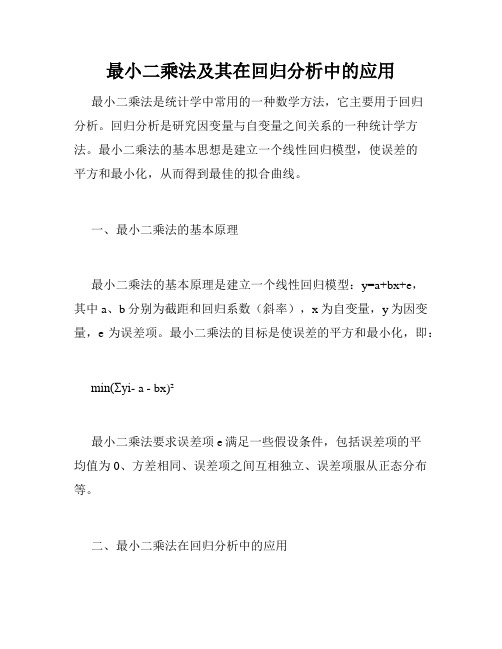

最小二乘法及其在回归分析中的应用

最小二乘法及其在回归分析中的应用最小二乘法是统计学中常用的一种数学方法,它主要用于回归分析。

回归分析是研究因变量与自变量之间关系的一种统计学方法。

最小二乘法的基本思想是建立一个线性回归模型,使误差的平方和最小化,从而得到最佳的拟合曲线。

一、最小二乘法的基本原理最小二乘法的基本原理是建立一个线性回归模型:y=a+bx+e,其中a、b分别为截距和回归系数(斜率),x为自变量,y为因变量,e为误差项。

最小二乘法的目标是使误差的平方和最小化,即:min(Σyi- a - bx)²最小二乘法要求误差项e满足一些假设条件,包括误差项的平均值为0、方差相同、误差项之间互相独立、误差项服从正态分布等。

二、最小二乘法在回归分析中的应用最小二乘法在回归分析中具有广泛的应用,例如:天气预测、股票市场预测、数据建模等。

以股票市场预测为例,当我们需要预测某只股票未来的价格变化时,可以通过最小二乘法建立线性回归模型来分析它与其他一些因素的关系,例如市场指数、公司业绩等。

通过最小化误差平方和,可以得到最佳的拟合曲线,然后预测未来股票价格的变化趋势。

三、最小二乘法的局限性虽然最小二乘法在回归分析中具有广泛的应用,但其也存在一些局限性。

例如,最小二乘法只能用于线性回归分析,而对于非线性的回归关系,就需要使用非线性回归分析方法;此外,最小二乘法容易受到异常值的影响,因此在应用过程中需要注意异常值的处理。

四、总结最小二乘法是回归分析中常用的数学方法,它可以用于解决许多实际问题,例如天气预测、股票市场预测等。

然而,最小二乘法也存在一些局限性,需要在应用中注意异常值的处理以及回归关系的线性性等问题。

最小二乘法是一种简单有效的统计学方法,可以被广泛应用于各种领域中,但是其认识并不容易,需要理解数学知识以及一定的数据分析能力,才能将其应用于实际工作中,更好地为决策与分析服务。

广义最小二乘模型的应用

广义最小二乘模型的应用广义最小二乘模型(Generalized Least Squares, GLS)是统计学中常用的数据分析方法,用于描述两个变量之间的关系。

它是基于最小二乘法的一种拓展,能够处理具有非常规误差分布的数据。

广义最小二乘模型的应用非常广泛,在许多领域都有重要的作用。

首先,广义最小二乘模型在经济学中有重要的应用。

经济学研究中经常需要分析两个或多个变量之间的关系,例如消费者收入与消费水平之间的关系。

广义最小二乘模型能够提供准确的参数估计和统计检验,为经济学研究者提供重要的参考。

其次,广义最小二乘模型在生物学和医学研究中也有重要的应用。

在生物学和医学研究中,研究者经常需要分析两个或多个生物标志物之间的关系,例如蛋白质水平与疾病状态之间的关系。

广义最小二乘模型能够提供准确的参数估计和统计检验,为生物学和医学研究者提供重要的参考。

此外,广义最小二乘模型在工程、气象、地理等领域中也有重要的应用。

广义最小二乘模型能够处理具有非常规误差分布的数据,因此在这些领域中都有重要的应用。

总之,广义最小二乘模型是一种常用的数据分析方法,其应用非常广泛。

它能够提供准确的参数估计和统计检验,为研究者提供重要的参考。

另外,广义最小二乘模型还可以用来解决非线性拟合问题。

通过使用非线性拟合函数,广义最小二乘模型可以对非线性数据进行拟合,更好地描述数据之间的关系。

此外,广义最小二乘模型还可以用来处理具有复杂误差结构的数据。

通过使用更复杂的误差模型,广义最小二乘模型可以更准确地描述数据之间的关系。

总之,广义最小二乘模型是一种强大的工具,其应用非常广泛。

除了上面提到的应用外,广义最小二乘模型还可以用于时间序列分析、遥感数据分析、空间数据分析等领域。

在实际应用中,广义最小二乘模型可以与其他统计学和机器学习方法相结合,以提高模型的精度和鲁棒性。

另外,广义最小二乘模型对于高维数据也是非常有效的,在进行高维数据分析时也可以使用这种方法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第20卷第4期 2011年7月系统管理学报Journal o f Systems &M anagementVol.20No.4 Jul.2011文章编号:1005-2542(2011)04-0480-05区间数据下EV 线性回归模型修正的广义最小二乘估计何其祥(上海财经大学应用数学系,上海200433)=摘要>研究了当响应变量为区间数据时的EV 线性回归模型,通过构造区间数据的无偏转换,并对广义最小二乘估计作适当修正,得到了回归参数的估计,在较一般的条件下证明了强相合性和渐近正态性。

最后作了若干模拟计算,从模拟的结果发现,利用本文提出的方法所获得的估计具有较高的精度。

关键词:区间数据;EV 线性模型;无偏转换;修正的广义最小二乘估计中图分类号:O 212.1 文献标识码:AThe Modified Generalized Leas-t Square Estimation for EV LinearRegression Model with Censored Interval DataH E Qi -x iang(Depar tm ent o f Applied M athematics,Shanghai U niversity of Finance and Econom ics,Shanghai 200433,China)=Abstract >In this paper,w e co nsider an EV linear regr ession m odel under censored interval respo nse.By constructing unbiased tr ansform ation of the censo red interval data,and mo dify ing the generalized least square estimation,w e obtain the estimators o f regr ession parameters and prov e te strong consistency and asym ptotic no rmality under g eneral conditions.T he simulation results indicate that o ur m ethod performs very w ell in term s of the accuracies of the estim ation.Key words:censored interval data;EV linear mo del;unbiased transfor matio n;m odified generalized least square estimation收稿日期:2009-11-26 修订日期:2010-07-05基金项目:国家自然科学资助基金项目(10971033)作者简介:何其祥(1963-),男,副教授。

研究方向为非参数统计及不完全数据分析。

E -mail:qxhe@m 众所周知,线性回归模型是统计学中最重要的模型之一,其参数的估计有许多良好的性质。

但在许多应用问题中,变量之间的关系无法用精确的线性模型加以刻画。

考虑如下的Erro r -in -Variable (EV)模型Y i =x TiB +E i X i =x i +u ii =1,2,,,n (1)式中:x i 为R p上不可观测的随机向量,且独立同分布;X i 为R p上可观测的随机向量;B 为p @1未知参数;E i 为独立同分布的模型误差,均值为0,其分布函数F 连续可导;u i 为p 维独立同分布的测量误差。

记e i =(E i ,u i ),假设e i 的均值为0,协方差矩阵为2ee ,并设x i 与e i 相互独立(i,j =1,2,,,n)。

对模型(1),最早的研究可以追溯到Tintner [1]和Geary[2];Gleser[3]在2ee =R 2I p +1的假定下,给出了B的极大似然估计的极限分布;Daham 等[4]讨论了B的广义最小二乘估计;崔恒建[5-6]考虑了B 的L 1-估计和M-估计,在较一般条件下,证明了它们的强相合性和渐近正态性;高玉福等[7]证明了2ee =R 2I p +1情形下,B 的广义最小二乘估计的强相合性和渐近正态性;李高荣等[8]讨论了带有协变量误差的部分线性EV 模型,得到了未知参数的极大经验似然估计以及估计的渐近正态性;崔恒建[9]定义了线性EV 模型的T -型估计,并给出了T -型估计的EM 算法,同时获得了估计的相合性;冯三营等[10]对非线性EV 模型作了研究,通过构造未知参数的经验对数似然比统计量,利用统计量的渐近分布,构造得到了未知参数的置信域。

刘强等[11]考虑了响应变量随机缺失的线性EV 模型,依然通过构造未知参数的经验对数似然比统计量,得到了未知参数的置信域。

在EV 模型的应用过程中,待处理的数据通常是不完整的,会遇到区间删失的情况。

如在问卷抽样调查中,被调查者每月收入的准确数值通常无法得知,而只知道落入某区间;又如在医药统计中,为了得到某种新药的最大安全剂量,通常采用的办法是让受试者不断加大剂量,观察其是否出现不良反应。

若第i 个受试者在服用剂量为U ij 时无不良反应,而剂量增至U i,j +1时出现不良反应,则最大安全剂量位于区间(U i,j ,U i,j +1)内,但无法确定其具体的数值。

对于响应变量被区间删失的EV 线性回归问题的研究,至今还未有文献上出现。

本文首次在响应变量区间删失情形下对模型(1)进行讨论,构造未知参数B 的估计,并讨论估计的大样本性质。

由于响应变量无法观察到具体的数值,得到的信息只是它们落入某一区间,因此,本文吸取了Zheng [12]和邓文丽[13]处理区间数据的无偏转换的思想,即构造区间数据变量的无偏转换,它们与原变量有相同的均值,将转换后的量用于广义最小二乘估计。

同时,为保证B 的估计具有良好的大样本性质,文中对B 的广义最小二乘估计作了修正。

1 模型与估计在模型(1)中,假定2ee =R 2I p+1。

响应变量Y i (i =1,2,,,n)被区间删失,观察到的数据为(U i ,V i ,D 1i ,D 2i ,X i )=(U i ,V i ,I Y i [U i,I U i <Y i [V i ,X i ), i =1,2,,,n (2)式中,(U i ,V i )(i =1,2,,,n)为观察点,它们是相互独立同分布的随机向量,且与E i ,u i (i =1,2,,,n)相互独立,(U i ,V i )(i =1,2,,,n)的密度函数g (u,v)已知且g(u,v)>0。

引进如下记号:X =(X 1,X 2,,,X n )T, Y =(Y 1,Y 2,,,Y n )Tx =(x 1,x 2,,,x n )T ,2=E(x 1,x T 1)A n =1nY T Y 1nY T X 1n X T Y 1nX T X , A =EY 21B T22B 2+R 2I p 当x i 无测量误差且Y i 未被区间删失时,B 的最小二乘估计为(x T x )-1x T Y(3) 当存在测量误差u i 、Y i 仍为完整数据时,由于Y i =X Ti B -u Ti B +E i , i =1,2,,,n (4)若取B 的估计为(X TX )-1X TY (5)显然,模型(4)不是同方差的,且式(3)不具有相合性。

因此,考虑如下的广义最小二乘估计,使得Q n (B )=Eni=1(Y i -X T i B )21+B TB= 1-B TA n1-B1-B T1-B(6)达到最小的解,记为B GL S 。

对于Y i 被区间删失的情形,类似于文献[7],以下就p =1和p >1分别讨论。

(1)p =1的情形。

通过直接计算,不难得到使得式(6)达到最小的广义最小二乘估计为BGLS =2X T Y (Y T Y -X T X )2+4(X T Y)2-(Y T Y -X T X )(7)由于Y i 无法直接观察到,自然的想法是:构造Y i 的无偏转换,它和Y i 有相同的均值,并直接代入式(7)。

为此,令Y *i =U 1(U i ,V i )D 1i +U 2(U i ,V i )D 2i +U 3(U i ,V i )(1-D 1i -D 2i )i =1,2,,,n其中,U 1、U 2和U 3为连续函数,与Y i 的分布函数独立,并且假设存在连续偏导数5U j 5u ,5U j 5v (j =1,2,3),同时满足Q +]v=0Q vu=0U 1(u,v)g (u,v)d u d v =0Q +]xU 2(x ,v)-U 1(x ,v)g(x ,v)d v +Q x 0U 3(u,x )-U 2(u,x )g(u,x )d u =1(8)则[12]EY i =E Y *i 。

但是,通过直接与仔细的计算,发现B *GLS =T *481第3期何其祥:区间数据下EV 线性回归模型修正的广义最小二乘估计不是B 的相合估计,式(9)中Y *=(Y *1,Y *2,,,Y *n )T 。

为此,对式(9)作如下修正。

沿用上述记号,令Y (r)i =U (r)1(U i ,V i )D 1i +U (r)2(U i ,V i )D 2i +U (r)3(U i ,V i )(1-D 1i -D 2i )i =1,2,,,n其中,U (r)1、U (r)2和U (r)3为连续函数,与Y i 的分布函数独立,存在连续偏导数5U (r)j5u ,5U (r)j5v(j =1,2,3),且满足Q +]v=0Qvu=0U (r)1(u,v)g(u,v)d u d v =0Q +]xU (r )2(x ,v)-U (r)1(x ,v)g(x ,v)d v +Q x 0U (r)3(u,x )-U (r)2(u,x )g(u,x )d u =rx r -1(10)则[13]E Y (r )i =EY r i(11)令B GL S =2X T Y (1)(Y (2)Y (2)-X T X)2+4(X T Y (1))2-(Y (2)T Y (2)-X T X )(12)对这样构造的 B GLS ,有以下结论。

定理1 设Ex 21<],则当n y ]时,有¹ B GL S a.s.;ºn( B GLS -B )LN (0,R 2G ),此处R 2G =B 2E(x 21-Ex 21)2+B 2R 2Ex 21+R 2Ex 21+R 4(Ex 21)2证明 由大数定律及式(11),有1nY (2)T Y (2) a.s.EY (2)1=EY 211n X T Y (1) a.s.E(Y 1x 1)=Ex 21B 1nX T X a.s.E (X 21)=Ex 21+R2(13)同时由于1n (Y (2)T Y (2)-X T X )2+4(X T Y (1))2-(Y(2)T Y(2)-X TX )a.s.Ex 21B 2+Ex 21-(Ex 21B 2-Ex 21)=2Ex 21(14)因此B GLSa.s.Bº由中心极限定理,1(T (1)E x 21Eni=1x i B u i +Eni=1x i Ei +Eni=1u i Ei LN (0,R21)其中,R 21=B 2E(x 21-Ex 21)2+B 2R 2Ex 21+R 2Ex 21+R 4从而n( B GLS -B )LN (0,R 2G )(2)p >1的情形。