加权OLS权数确定

权重的确定方法

权重的确定方法篇一:权重的确定方法权重的确定方法综合评价指标体系内部各元素间存在质和量的联系。

由指标体系的结构模型(如层次模型),我们已经确定了指标体系质的方面的联系,那么权重则反映各系统各元素之间量的方面联系纽带,它对于系统综合评价具有重要的意义。

无论是在模糊综合评价,还是层次分析、灰色系统评价无一例外的用到了评价指标的权重。

权重的概念韦氏大词典中对权重(weight)的解释为:“在所考虑的群体或系列中,赋予某一项目的相对值”;“在某一频率分布中,某一项目的频率”;“表示某一项目相对重要性所赋予的一个数”。

从中我们可以得出两点结论:(1)权重是表示因素重要性的相对数值。

(2)权重是通过概率统计得出的频率分布中的频率。

由此可以看出权重具有随机性与模糊性,它是一个模糊随机量。

在综合评价中权重可以定义为元素对于整体贡献的相对重要程度,即元素能够反映总体的程度。

权重的确定方法对实际问题选定被综合的指标后,确定各指标的权的值的方法有很多种。

有些方法是利用专家或个人的知识和经验,所以有时称为主观赋权法。

但这些专家的判断本身也是从长期实际中来的,不是随意设想的,应该说有客观的基础;有些方法是从指标的统计性质来考虑,它是由调查所得的数据决定,不需征求专家们的意见,所以有时称为客观赋权法。

在这些方法中,德尔菲(Delphi)方法是被经常被采用的,其它方法就相对来说用得不多,这里列举几个在下面,以供比较。

1.德尔菲法德尔菲法又称为专家法,其特点在于集中专家的知识和经验,确定各指标的权重,并在不断的反馈和修改中得到比较满意的结果。

基本步骤如下:(1)选择专家。

这是很重要的一步,选得好不好将直接影响到结果的准确性。

一般情况下,选本专业领域中既有实际工作经验又有较深理论修养的专家10~30人左右,并需征得专家本人的同意。

(2)将待定权重的p个指标和有关资料以及统一的确定权重的规则发给选定的各位专家,请他们独立的给出各指标的权数值。

加权最小二乘法(WLS)

加权最小二乘法(W L S) -CAL-FENGHAI-(2020YEAR-YICAI)_JINGBIAN加权最小二乘法(WLS)如果模型被检验证明存在异方差性,则需要发展新的方法估计模型,最常用的方法是加权最小二乘法。

加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采用普通最小二乘法估计其参数。

下面先看一个例子。

原模型:+++=i i i x x y 22110βββ,i ki k u x ++βn i ,,2,1 =如果在检验过程中已经知道: 2222)()()(u i i i i x f u E u D σσ=== ,n i ,,2,1 =即随机误差项的方差与解释变量2x 之间存在相关性,模型存在异方差。

那么可以用)(2x f 去除原模型,使之变成如下形式的新模型:+++=i i i i i i i x x f x x f x f y x f 222121202)(1)(1)(1)(1βββi i ki i k u x f x x f )(1)(122++βn i ,,2,1 =在该模型中,存在 222222)()(1))(1())(1(u i ii i i i u E x f u x f E u x f D σ=== (4.2.1)即同方差性。

于是可以用普通最小二乘法估计其参数,得到关于参数βββ01,,, k 的无偏的、有效的估计量。

这就是加权最小二乘法,在这里权就是)(12i x f 。

一般情况下,对于模型Y X =+B N (4.2.2) 若存在:W2)(),(0)(uE Cov E σ=N 'N =N N =NW =⎡⎣⎢⎢⎢⎢⎤⎦⎥⎥⎥⎥w w w n 12(4.2.3) 则原模型存在异方差性。

设T DD W =⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=n w w w D21, ⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=----112111n w w w D用D 1-左乘(4.2.2)两边,得到一个新的模型:D Y D X D ---=+111B N (4.2.4) 即Y X ***=+B N该模型具有同方差性。

线性回归分析权重计算公式

线性回归分析权重计算公式在统计学和机器学习中,线性回归是一种常用的建模方法,用于预测一个或多个自变量与因变量之间的关系。

在线性回归中,我们通常会使用权重来表示自变量对因变量的影响程度。

本文将介绍线性回归分析中权重的计算公式,以及如何利用这些权重进行预测和解释。

线性回归模型通常表示为:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε。

其中,Y是因变量,X1, X2, ..., Xn是自变量,β0是截距,β1, β2, ..., βn是自变量的权重,ε是误差项。

线性回归的目标是找到最佳的权重,使得模型的预测值与实际观测值之间的差异最小化。

为了计算权重,我们通常使用最小二乘法(OLS)来拟合线性回归模型。

最小二乘法的思想是通过最小化残差平方和来找到最佳的权重。

残差是指模型预测值与实际观测值之间的差异,残差平方和则是所有观测值的残差平方的总和。

最小二乘法的数学表达式如下:β = (X'X)^(-1)X'Y。

其中,β是权重向量,X是自变量矩阵,Y是因变量向量,X'是X的转置矩阵,(X'X)^(-1)是X'X的逆矩阵。

在实际应用中,我们通常会使用计算机软件来进行线性回归分析,例如Python中的NumPy和SciPy库,R语言中的lm函数,以及SPSS和SAS等统计软件。

这些软件可以帮助我们自动计算权重,并提供模型拟合的统计指标和图表。

一旦我们得到了权重,就可以利用它们来进行预测和解释。

预测的过程非常简单,只需要将自变量的取值代入线性回归模型中,然后根据权重计算出因变量的预测值。

例如,如果我们有一个包含身高和体重的线性回归模型,那么我们可以利用权重来预测一个人的体重,只需要将他的身高代入模型中即可。

除了预测,权重还可以帮助我们解释自变量对因变量的影响。

权重的绝对值表示自变量对因变量的影响程度,正负号表示影响的方向。

例如,如果一个自变量的权重为正,那么随着这个自变量的增加,因变量也会增加;如果一个自变量的权重为负,那么随着这个自变量的增加,因变量会减少。

ols回归模型公式

ols回归模型公式经典的OLS回归模型由英国经济学家SirRonaldAylmerFisher在1921年首次提出,它是所有回归模型分析技术中最基础、最全面的一种。

它可以用来预测一个变量(被解释变量)的变化量,也可以用来确定两个或更多变量之间的关系。

OLS回归模型的基本公式为:Y = bo + b1X1 + b2X2 + ... + bnXn其中,Y是被解释变量,X1、X2...Xn是影响Y变化的自变量,bo、b1、b2...bn是相应的回归系数,它们一般是通过统计分析来计算的。

OLS回归模型是一种最小二乘法,它旨在找出一组回归系数,使得样本观测值的残差的平方和最小。

当Y是连续变量时,它的残差主要表现为因变量与拟合值的差异,可以用以下形式来表示:Ei = Yi - (bo + b1X1i + b2X2i + ... + bnXni)其中,Ei是残差,Yi是实际观察到的值,(bo + b1X1i + b2X2i + ... + bnXni)是拟合出的值。

最小二乘法可以由以下公式表示:SSE = E1^2 + E2^2 + ... + En^2其中,SSE代表残差的平方和;E1、E2...En代表残差。

以上是OLS回归模型的基础公式,有了它,我们就能够更好地研究和分析因变量和自变量之间的关系,从而更好地对未来变量变化做出预测和分析。

OLS回归模型不仅用于经济学上的研究,在其他学科如心理学、社会学等也有广泛的应用。

举例来说,心理学家可以根据性格测验结果、健康状况、自尊心等自变量,来分析和预测一个人的生活满意度,作为因变量。

社会学家也可以应用OLS回归模型来研究社会问题。

比如,社会经济地位、学历水平和就业状况等变量可以用作自变量,来研究这些因素对婚姻破裂的影响,或者健康状况的影响等。

可以看出,OLS回归模型的公式是十分灵活的,可以用来提取数据中的有用信息,从而帮助我们更好地解决实际问题。

在日常生活中,也经常使用OLS回归模型来建立商业模型,比如金融风控模型、投资决策模型等。

确定权重系数的方法

确定权重系数的方法

确定权重系数的方法包括主观和客观两种。

主观方法是基于专家意见或个人经验来确定权重,通常使用问卷调查、专家访谈等方式。

客观方法则是基于数据分析和统计学方法来确定权重,包括层次分析法、熵权法、灰色关联度分析法等。

其中,层次分析法是一种常用的客观方法,它通过构建层次结构,将复杂的问题分解成若干个层次,再通过对比不同层级之间的相对重要性来确定权重系数。

熵权法则是一种基于信息熵原理的方法,它通过计算不同因素的信息熵,来确定不同因素对变量的影响程度。

灰色关联度分析法则是一种基于灰色系统理论的方法,它通过计算不同因素之间的灰色关联度来确定权重系数。

总之,确定权重系数的方法是一种重要的分析工具,可以帮助分析师们更准确地评估各项因素对于变量的影响,从而为决策提供更有力的支持。

- 1 -。

第一讲OLS估计和预测 重要

• 下面把数据输入。具体的方法有两种:

• (1)可以在已有的excel表格中数据复制到 里面。

• (2)可以直接在这个对话框里输入数据。 (比较麻烦 大家要有耐心)

第二步:作散点图

• 作散点图的目的,就是看这两个变量 之间是不是有显著的线性关系。

• 具体的步骤如下: • 在数据对话框的窗口中选:

• 一、基本操作 • 二、最小二乘估计法(OLS) • 三、预测

一、基 本 操 作

1、窗口介绍

2、工作文档(workfile)的建立:

• 需要强调的是不论进行什么估计,都要在这个建立 的工作文档中进行,打个比方,可以把这个文档比 喻成一张桌子,任何任务都是在这个桌子上进行的。 如果输入了数据,就存在了它里面,关闭整个程序 之前把这个Workfile保存了,也就把所有的数据都 保存了。

二、 一元线性回归模型的ols估计

• 例:OLS估计一元线性回归模型

【李子奈的《计量经济学》书中P34的例子】

具体步骤:

• 第一步:数据输入 : • 第二步:作散点图: • 第三步:OLS估计: • 第四步:参数分析: • 第五步:经济学意义分析:

第一步:数据输入 :

• 有了上节建立的“桌子”(工作文档),下面就 是准备要分析的材料――→数据。首先要把不同 数据的不同的名字输入,在上面的命令栏里输入: Data +要分析的数据变量名称(多个变量之间加

第三步:预测:

• 再次对其进行OLS估计,在估计出来的 对话框中,点击上面的forecast键。

● 出来的对话框中选择“ok”,会出现线形的估计图 表。这时workfile中会多出一个edf,打开它便会看 到对1998年ed的估计值为2264.243:

第四步:意义分析

权重确定方法归纳

权重确定方法归纳多指标综合评价是指人们根据不同的评价目的,选择相应的评价形式据此选择多个因素或指标,并通过一定的评价方法将多个评价因素或指标转化为能反映评价对象总体特征的信息,其中评价指标与权重系数确定将直接影响综合评价的结果。

按照权数产生方法的不同多指标综合评价方法可分为主观赋权评价法和客观赋权评价法两大类,其中主观赋权评价法采取定性的方法由专家根据经验进行主观判断而得到权数,然后再对指标进行综合评价,如层次分析法、综合评分法、模糊评价法、指数加权法和功效系数法等。

客观赋权评价法则根据指标之间的相关关系或各项指标的变异系数来确定权数进行综合评价,如熵值法、神经网络分析法、TOPSIS法、灰色关联分析法、主成分分析法、变异系数法等。

两种赋权方法特点不同,其中主观赋权评价法依据专家经验衡量各指标的相对重要性,有一定的主观随意性,受人为因素的干扰较大,在评价指标较多时难以得到准确的评价。

客观赋权评价法综合考虑各指标间的相互关系,根据各指标所提供的初始信息量来确定权数,能够达到评价结果的精确但是当指标较多时,计算量非常大。

下面就对当前应用较多的评价方法进行阐述。

一、变异系数法(一)变异系数法简介变异系数法是直接利用各项指标所包含的信息,通过计算得到指标的权重。

是一种客观赋权的方法。

此方法的基本做法是:在评价指标体系中,指标取值差异越大的指标,也就是越难以实现的指标,这样的指标更能反映被评价单位的差距。

例如,在评价各个国家的经济发展状况时,选择人均国民生产总值(人均GNP)作为评价的标准指标之一,是因为人均GNP不仅能反映各个国家的经济发展水平,还能反映一个国家的现代化程度。

如果各个国家的人均GNP没有多大的差别,则这个指标用来衡量现代化程度、经济发展水平就失去了意义。

由于评价指标体系中的各项指标的量纲不同,不宜直接比较其差别程度。

为了消除各项评价指标的量纲不同的影响,需要用各项指标的变异系数来衡量各项指标取值的差异程度。

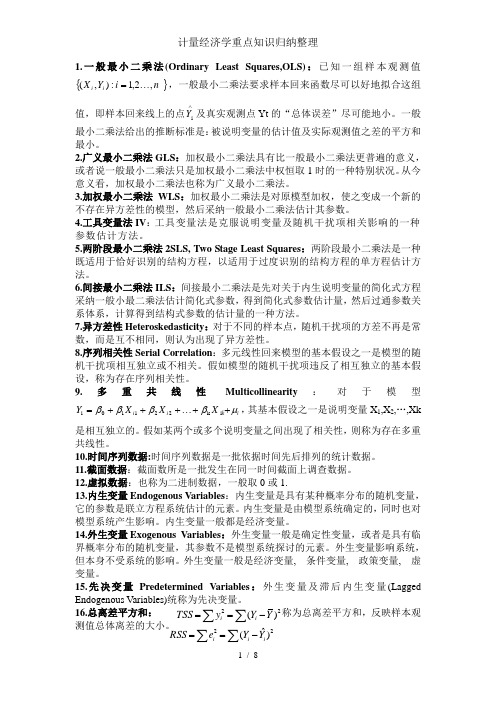

计量经济学重点知识归纳整理

1.一般最小二乘法(Ordinary Least Squares,OLS):已知一组样本观测值{}n i Y X i i ,2,1:),(⋯=,一般最小二乘法要求样本回来函数尽可以好地拟合这组值,即样本回来线上的点∧i Y 及真实观测点Yt 的“总体误差”尽可能地小。

一般最小二乘法给出的推断标准是:被说明变量的估计值及实际观测值之差的平方和最小。

2.广义最小二乘法GLS :加权最小二乘法具有比一般最小二乘法更普遍的意义,或者说一般最小二乘法只是加权最小二乘法中权恒取1时的一种特别状况。

从今意义看,加权最小二乘法也称为广义最小二乘法。

3.加权最小二乘法WLS :加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采纳一般最小二乘法估计其参数。

4.工具变量法IV :工具变量法是克服说明变量及随机干扰项相关影响的一种参数估计方法。

5.两阶段最小二乘法2SLS, Two Stage Least Squares :两阶段最小二乘法是一种既适用于恰好识别的结构方程,以适用于过度识别的结构方程的单方程估计方法。

6.间接最小二乘法ILS :间接最小二乘法是先对关于内生说明变量的简化式方程采纳一般小最二乘法估计简化式参数,得到简化式参数估计量,然后过通参数关系体系,计算得到结构式参数的估计量的一种方法。

7.异方差性Heteroskedasticity :对于不同的样本点,随机干扰项的方差不再是常数,而是互不相同,则认为出现了异方差性。

8.序列相关性Serial Correlation :多元线性回来模型的基本假设之一是模型的随机干扰项相互独立或不相关。

假如模型的随机干扰项违反了相互独立的基本假设,称为存在序列相关性。

9.多重共线性Multicollinearity :对于模型i k i i X X X Y μββββ++⋯+++=i k 22110i ,其基本假设之一是说明变量X 1,X 2,…,Xk 是相互独立的。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

浅谈加权最小二乘法及其残差图——兼答孙小素副教授何晓群 刘文卿ABSTRACTThe paper introduces some problems in relation to weighted least square regression ,and answers a question about weighted residual plots.关键词:异方差;加权最小二乘法;残差图;SPSS一、引言好几年没有翻《统计研究》了。

最近,有一同行朋友打电话告诉我《统计研究》2005年第11期上刊登了一篇有关我与刘文卿合作编著的《应用回归分析》(2001.6.中国人民大学出版社)教材的文章。

赶紧找到这期的《统计研究》,看到其中孙小素副教授的文章《加权最小二乘法残差图问题探讨——与何晓群教授商榷》一文,以下简称《孙文》。

认真拜读后感触良多。

首先衷心感谢孙小素副教授阅读了我们《应用回归分析》拙作的部分章节,同时感谢《统计研究》给我们提供这样一个好的机会,使我们能够借助贵刊对加权最小二乘法的有关问题谈谈更多的认识。

《孙文》谈到《应用回归分析》教材中有关加权最小二乘法残差图的问题。

摆出了与加权最小二乘法相关的三类残差图,指出第三类残差图的局限性。

直接的问题是三类残差图的作用,而更深层的原因应该是对加权最小二乘法统计思想的理解和认识上的差异。

二、对加权最小二乘法的认识1. 加权最小二乘估计方法拙作《应用回归分析》中对加权最小二乘法有详尽的讲述,这里仅做简要介绍。

多元线性回归方程普通最小二乘法的离差平方和为:∑=----=ni ip p i i p x x y Q 1211010)(),,,(ββββββ(1)普通最小二乘估计就是寻找参数p βββ,,,10 的估计值pβββˆ,,ˆ,ˆ10 使式(1)的离差平方和Q 达极小。

式(1)中每个平方项的权数相同,是普通最小二乘回归参数估计方法。

在误差项i ε等方差不相关的条件下,普通最小二乘估计是回归参数的最小方差线性无偏估计。

然而在异方差的条件下,平方和中的每一项的地位是不相同的,误差项i ε的方差2i σ大的项,在式(1)平方和中的取值就偏大,在平方和中的作用就大,因而普通最小二乘估计的回归线就被拉向方差大的项,方差大的项的拟合程度就好,而方差小的项的拟合程度就差。

由式(1)求出的pβββˆ,,ˆ,ˆ10 仍然是p βββ,,,10 的无偏估计,但不再是最小方差线性无偏估计。

加权最小二乘估计的方法是在平方和中加入一个适当的权数i w ,以调整各项在平方和中的作用,加权最小二乘的离差平方和为:∑=----=ni ip p i i i p w x x y w Q 1211010)( ),,,(ββββββ (2)加权最小二乘估计就是寻找参数p βββ,,,10 的估计值pww w βββˆ,,ˆ,ˆ10 使式(2)的离差平方和w Q 达极小。

所得加权最小二乘经验回归方程记做ppw w w w x x y βββˆˆˆˆ110+++= (3)理论上最优的权数i w 为误差项方差2i σ的倒数,即21ii w σ=(4)误差项方差大的项接受小的权数,以降低其在式(2)平方和中的作用; 误差项方差小的项接受大的权数,以提高其在平方和中的作用。

由(2)式求出的加权最小二乘估计pww w βββˆ,,ˆ,ˆ10 就是参数p βββ,,,10 的最小方差线性无偏估计。

一个需要解决的问题是误差项的方差2i σ是未知的,因此无法真正按照式(4)选取权数。

在实际问题中误差项方差2i σ通常与自变量的水平有关,可以利用这种关系确定权数。

例如2i σ与第j 个自变量取值的平方成比例时,即2i σ=k 2ijx 时,这时取权数为 21iji x w =(5) 更一般的情况是误差项方差2i σ与某个自变量j x 取值的幂函数m ij x 成比例,即2i σ=k mij x ,其中m 是待定的未知参数。

此时权数为m iji x w 1=(6) 这时确定权数i w 的问题转化为确定幂参数m 的问题,可以借助SPSS 软件解决。

《应用回归》书中和《孙文》中都讲了这个方法,本文不再重述。

需要注意的是,在实际问题中比例关系2i σ=k mij x 只是近似的,式(6)确定的权数i w 只是式(4)最优权数的近似值,因此所得的参数最小二乘估计也只是近似的最小方差线性无偏估计。

2. 变量变换的加权最小二乘法《孙文》中谈到:加权最小二乘法的实质是要对原始数据实施变换,获得新的解释变量和被解释变量,变换的方法是:2m jx y y -⋅='(y '表示变换后的被解释变量) (7)2mj h hx x x -⋅=',h =0,1,2,……,p (hx '是对应于原始变量h x 的新解释变量) (8)对变换后的变量(p x x x y '''',,,,10)重新进行普通最小二成估计(注意,此处的回归模型不包含常数项,增加了数据变换后派生出的一个新解释变量2mj x x -='),即可得到加权最小二乘法的经验回归方程:p pw w w w x x x y '++'+'='βββˆˆˆˆ1100 (9)以上是《孙文》中对加权最小二乘法的解释,其中公式(7)、(8)、(9)分别对应《孙文》中的公式(3)、(4)、(5)。

3. 两种方法的异同相同之处。

显然,式(3)与式(9)两个回归方程是等价的,把式(3)同时乘以2mjx w -=后就转化为式(9)。

不同之处。

首先,式(3)的回归方程ppw w w w x x y βββˆˆˆˆ110+++= 使用起来比较方便,因为利用该回归方程进行预测和控制时,无须按式(8)变换自变量的新值,直接将自变量的新值代入式(3)即可。

对这一点孙小素副教授也是认同的。

其实,所有方法的优劣评价根本就在于他是否方便于建模最终的应用。

其次,虽然两种加权回归方法所得的回归方程是等价的,但是对回归效果的拟合优度和检验是不同的,式(3)的加权最小二乘的总离差平方和、回归离差平方和、残差平方和的计算公式和关系为:∑∑∑===+-=-n i ni iw i w iw i ni w ii e w y yw y yw 112212)ˆ()( (10) 其中w y 是i y 用i w 加权的算术平均数。

由于式(9)的变换加权最小二乘回归方程不含常数项,所以不满足离差平方和分解式,而是对直接的平方和满足分解式,总平方和、回归平方和、残差平方和的计算公式和关系为:∑∑∑==='+'='n i ni iw iwn i ie yy 112212ˆ (11)等价于∑∑∑===+=ni ni iwi iwin i ii e w yw y w 112212ˆ (12) 对不含常数项的普通最小二乘回归,SPSS 软件就是用上述公式计算平方和并进而计算判定系数2R 和做F 检验的。

然而,这种做法的合理性是有欠缺的,因为总平方和∑='ni i y 12不能如实反映因变量的变差,仅是为了满足平方和分解式而这样做,有削足适履的嫌疑。

另外一种做法是以∑='-'ni y y 12)(作为总离差平方和,把∑∑=='-'-'n i ni iwie y y 1122)(作为回归离差平方和,而不使用∑='-'ni iwy y12)ˆ(作为回归离差平方和,Excel 软件不含常数项(即指定常数项为零)的普通最小二乘回归就是采用的这个方法。

对《孙文》所引用的《应用回归分析》例题,有关的计算结果见表1(a )—(d )。

从表中可以清楚看出用变换加权最小二乘法计算离差平方和存在明显的问题,判定系数2R 和检验统计量F 严重失真。

对同样的数据做变换加权最小二乘估计,市面上流行的不同软件的拟合优度检验却差别很大,SPSS 软件计算出的F =442.2,2R =0.968;Excel 软件计算出的F =74.26,2R =0.837。

对其他数值就不逐一对比了。

针对上述问题,变换加权最小二乘法实际上常用于式(5)成立的情况,即m =2,此时变换后的自变量j x '≡1,回归参数j β就相当于回归常数项了,对变换后的数据就可以用含有常数项的普通最小二乘估计方法,各种统计软件对变换加权最小二乘法回归的拟合优度检验的输出结果就都一致了。

遗憾的是,即使是在这种特殊情况下也仍然与直接用加权最小二乘估计方法不一致,这只需仔细比较两种情况的总离差平方和公式∑='-'ni iy y 12)(和∑=-ni w ii y yw 12)(的差异即可。

这种通过变换变量求解加权最小二乘估计方法的作用是什么呢?引用文献[1]第180页的一段文字给予解释:“许多回归软件包允许用户有选择地使用具体的权数进行加权最小二乘分析。

如果不能选择,通过对观察值的具体变换,使用不加权的最小二乘法,仍能得到加权最小二乘估计量。

”可见通过变换变量求解加权最小二乘估计的方法仅是作为参数估计的一种计算手段而存在的,如果你使用的软件仅具有普通最小二乘功能,就只能用变换变量的方法求解加权最小二乘的参数估计。

《应用回归分析》教材是结合SPSS 软件编写的,而SPSS 软件允许用户直接使用权数进行加权最小二乘分析,不必通过变换变量的方法求解加权最小二乘估计,因此我们在教材中没有给出这种通过变换变量求解加权最小二乘估计的方法。

纵上所述,在拥有像SPSS 这种能够直接计算加权最小二乘估计的软件时,就不必使用变换变量求解加权最小二乘估计的方法了。

即使使用的是变换变量求解加权最小二乘估计的方法,也应该把式(9)变换回式(3)的形式,用来直接表示出原始变量之间的关系。

因此《孙文》把式(9)称为加权最小二乘法的经验回归方程就显然不合适了。

我们也没有见到其他的文献用这个称法。

三、三类残差图的作用以残差为纵坐标轴以自变量(或回归值y ˆ)为横坐标轴画的散点图就是残差图。

《孙文》中的三类残差图如下:1. 普通残差图。

指用原始数据对线性回归模型做普通最小二乘估计所得的普通残差ie 所做的残差图,也就是《孙文》中所称的第一类残差图。

2. 加权普通残差图。

其残差是用原始数据做加权最小二乘估计所得的普通残差w e (在《孙文》中记做w e '),也就是《孙文》中所称的加权派生残差图,或第三类残差图。

3. 加权变换残差图。

其残差是用变换数据做加权最小二乘估计所得的普通残差w e '(在《孙文》中记做w e ),也就是《孙文》中所称的加权残差图,或第二类残差图。