一维搜索插值法

一维插值算法

一维插值算法

一维插值算法是一种数据插值方法,用于在已知的一组数据点的基础上估计或预测中间位置的数据点的值。

一维插值算法的目的是根据已有数据的变化趋势,在新的数据点位置上进行预测,以填补数据的缺失或不连续性。

常见的一维插值算法有线性插值、拉格朗日插值、牛顿插值等。

这些算法的基本原理都是利用已知数据点之间的关系,通过某种数学模型来计算未知数据点的值。

线性插值是最简单的一维插值算法,它假设数据点之间的变化是线性的,因此可以使用一条直线来连接相邻的数据点,从而计算未知数据点的值。

拉格朗日插值和牛顿插值则是更高阶的插值算法,它们利用多项式函数来拟合已知数据点,并通过插值公式来计算未知数据点的值。

一维插值算法可以用于很多领域的应用,比如地图绘制、数值分析、信号处理等。

在实际应用中,选择合适的插值算法和参数是非常重要的,因为不同的算法和参数可能会对插值结果产生不同的影响。

第三章 一维搜索法

0

x1 x2

x3

3-1 确定初始区间的进退法

探测初始空间的进退法步骤: 探测初始空间的进退法步骤 (1)给定初始点 x0 ,初始步长 h ,令 x1 = x0 ,记: f1 = f ( x1 ) 给定初始点 初始步长 令 记 (2)产生新的探测点 x2 = x1 + h ,记 f 2 = f ( x2 ) 产生新的探测点 (3)比较函数值 f1 和 f 2 的大小 确定向前或向后探测的策略 比较函数值 的大小,确定向前或向后探测的策略 则加大步长,令 若: f1 > f 2 则加大步长 令 h = 2h ,转(4)向前探测 转 向前探测 (4)产生新的探测点 x3 = x0 + h ,令 f 3 = f ( x3 ) 产生新的探测点 令 (5)比较函数值 f 2 和 f 3 的大小 比较函数值 则调转方向,令 若: f1 < f 2 则调转方向 令 h = − h ,转(4)向后探测 转 向后探测

3-1 确定初始区间的进退法

f (x ) f ( x1 )

f ( x2 )

f ( x1 ) > f ( x2 ) > f ( x3 )

极小点在右端点的

f (x3 ) (x

x

x3 右侧

0

x1

x2 x3

3-1 确定初始区间的进退法

f (x ) f ( x1 ) f ( x2 )

f ( x3 )

f ( x1 ) < f ( x2 ) < f ( x3 )

h=-h;x2=x0+h;f2=f(x2); ; ; ; End

3-2 黄金分割法

一维搜索试探方法的基本思想: 一维搜索试探方法的基本思想:在确定了搜索区间的 前提下,不断缩小搜索区间, 前提下,不断缩小搜索区间,同时保持搜索区间内函数值 “大-小-大”的走势,直到区间的宽度小于预定的精度。 小 大 的走势,直到区间的宽度小于预定的精度。 黄金分割法基本思想: 黄金分割法基本思想 : 在搜索区间内插入两个黄金分 割点,将区间分成三段。利用函数的单谷性质,通过函数值 割点,将区间分成三段。利用函数的单谷性质, 大小的比较,删去其中一段。 大小的比较,删去其中一段。在保留下来的区间上作同样的 处置,如此往复送代,使搜索区间缩小到精度范围内, 处置,如此往复送代,使搜索区间缩小到精度范围内,得到 极小点的近似解。 极小点的近似解。

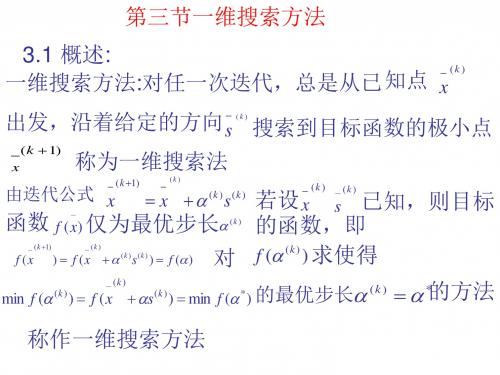

第三节一维搜索方法

a3 a2 , y3 y2 a2 ap , y2 yp

特点:程序结构简单容易理解可靠性好。但计算 效率偏低,使用于低维优化的一维搜索。

三、二次插值法(抛物线法)

(1)基本思想:在寻求目标函数 f (x ) 极小点的区间 内取三个点的函数值来构造一个二次插值多项式 p(x )用它的极小点近似地作为原目标函数的极小 点。若近似程度不满足精度要求时,可反复使用 此法随着区间的缩短,二次插值多项式的极小点 就逼近原目标函数的极小点一维函数 f (x ) 在搜索 区间[a b] 内为单峰函数,在区间内取三点 x1 x2 x3 且 x1 x2 x3 三点的函数值为 f1 f (x1) f2 f (x2 ) f3 (x3 ) 且 f1 f2 f3 即满足函数值是大—小—大变化。原目

1、基本原理: 通过不断缩短搜索区间的长度来寻求一维函数

f (x ) 的极小点原理。

a

x1 x2

b

a

x1 x2

b

它是一种等比例缩短区间的直接搜索方法。

设目标函数 f (x) 在搜索区间 [a,b] 内 为单峰函数,区间长设为 l

在区间内按如下规则对 称地取两点 x1和 x2

x1 a 0.382(b a) x2 a 0.618(b a)

x b 2a

x*p

1 2

(x22 x32 ) f1 (x32 x12 ) f2 (x12 x22 ) f3 (x2 x3 ) f1 (x3 x1 ) f2 (x1 x2 ) f3

c1

f3 x3

f1 x1

c2

(

f2

f1 ) (x2

x2 x3

一维搜索方法

否

y3 y2 ?

是

是

否

h 0?

a 1

a 3

b 3

b 1

确定搜索《区车间辆优的化外设计推理法论与的实程践》序教框学课图件如图

2.算法的MATLAB实现 在MATLAB中编程实现的进退法函数为:minJT。 功用:用进退法求解一维函数的极值区间。 调用格式:

[minx,maxx]=minJT(f,x0,f0,eps0) 其中,f: 目标函数; x0: 初始点; h0: 初始步长; eps0: 精度; minx: 目标函数包含极值的区间左端点; maxx: 目标函数包含极值的区间右端点。

《车辆优化设计理论与实践》教学课件

2.4 一维搜索的插值方法

假定我们的问题是在某一确定区间内寻求函 数的极小点位置,虽然没有函数表达式,但 能够给出若干试验点处的函数值。我们可以 根据这些点处的函数值,利用插值方法建立 函数的某种近似表达式,进而求出函数的极 小点,并用它作为原来函数极小点的近似值。 这种方法称作插值方法,又称作函数逼近法。

《车辆优化设计理论与实践》教学课件

2.3 黄金分割法

黄金分割法适用于[a,b] 区间上的任何单峰函数求 极小值问题。对函数除要求“单峰”外不作其他要 求,甚至可以不连续。因此,这种方法的适应面相 当广。

黄金分割法也是建立在区间消去法原理基础上的试 探方法,即在搜索区间[a,b]内适当插入两点,并 计算其函数值,将区间分成三段。应用函数的单谷 性质,通过函数值大小的比较,删去其中一段,是 搜索区间得以缩短。然后再在保留下来的区间上作 同样的处置,如此迭代下去,是搜索区间无限缩小, 从而得到极小点的数值近似解。

f

( )

( )

f

(0 )

一维理想插值计算公式

一维理想插值计算公式

一维理想插值通常指的是通过已知的一系列数据点来估算在这些点之间的未知值的过程。

插值方法有很多种,其中最简单和最常见的是线性插值。

但在这里,我将为你提供一个更一般的插值公式,即拉格朗日插值公式。

假设我们有一组已知的n+1个数据点(x0, y0), (x1, y1), ..., (xn, yn),我们希望找到一个n次多项式P(x) 使得P(xi) = yi 对于所有的i 都成立。

拉格朗日插值公式为:

\(P(x) = \sum_{i=0}^{n} y_i l_i(x)\)

其中,\(l_i(x)\) 是拉格朗日基函数,定义为:

\(l_i(x) = \prod_{\substack{j=0 \\ j \neq i}}^{n} \frac{x - x_j}{x_i - x_j}\)

这个公式的意义是:对于每一个数据点(xi, yi),我们构造一个函数\(l_i(x)\),它在xi处取值为1,而在其他数据点的x坐标处取值为0。

这样,当我们把这些函数乘以对应的y值并加起来,得到的多项式P(x)就会经过所有的数据点。

如果你只需要线性插值(即两个点之间的插值),那么公式会简化很多。

对于两个点(x0, y0) 和(x1, y1),线性插值公式为:\(y = y_0 + \frac{y_1 - y_0}{x_1 - x_0} (x - x_0)\)

这个公式表示的是通过两点确定的一条直线,可以用来估算这两

点之间任意x值对应的y值。

第二章一维搜素解析

不存在极值点

当x x0时,f x 0,当x x0时,f x 0,则x0为极小值

当x x0时,f x 0,当x x0时,f x 0,则x0为极大值

又 f x lim f x f x0

xx0 0

x x0

0,极小值

一维函数极值条件: f x0 0,且f x 0,极大值

0,非极值

(1) 如 果 f1

f

,

2

则

留

下

的

区

间

为[a,x2

]

(2) 如 果 f1

f

,

2

则

留

下

的

区

间

为[ x1,b]

(3) 如 果 f1

f

,

2

则

留

下

的

区

间

为[ x1,x2

]

a) f a1 f b1

b) f a1 f b1

迭代

迭代是重复反馈过程的活动,

其目的通常是为了逼近所需目标或结果。

每一次对过程的重复称为一次“迭代”,

B. 当 f1> f2 时,极小点必在[x1, b]中,则

x1 a, x2 x1, f2 f1, x2 a 0.618(b a), f2 f (x2 )

(4)判断是否满足精度要求。若新区间已缩短至预 定精度要求,即 b a ,则转第5)步;否则 转第3)步,进行下一次迭代计算。

迭代

• %求第十个斐波那契数

• a0=0

• a1=1

• for i=2:10

•

a2=a0+a1

•

a0=a1;a1=a2;

• end

•

• %求不大于100的最大斐波那契数

《现代机械优化设计》第3章 一维搜索

a xp, f (a) f (xp ), f (a) f (xp )

b xp, f (b) f (xp ), f (b) f (xp )

计算 f (x*p ), f (x*p )

否

f (x*p ) 0 是

否

f (x*p )

x xp , f f (xp )

是

结束

否

是

K>0

否

xp-xp0 ≤ε

是

x*=x2, f*=f2

是

x*=xp,f*=fp

xp

1 2

f1(x22 x32 ) f2 (x32 x12 ) f3(x12 x22 ) f1(x2 x3) f2 (x3 x1) f3(x1 x2 )

结束

由于区 间缩到很 小时因计 算机舍入 误差引起, 可取中间 点输出。

x3

ⅱ) (xP x1)(x3 xP ) 0

f1

x1

f2

f3

x2 x3

补充 §3-5 格点法

一)基本思路

先将搜索区间分成若干等分,计算出当中的n个等分 点的目标函数值. 再通过比较,找出其中的最小点,则该 点的两个邻近点围成缩短了的新区间。

f

a

xmx1 m xm1 b

x

二)每轮迭代区间的缩短率

ⅰ)A=0

f1(x2 x3 ) f2 (x3 x1) f3 (x1 x2 ) 0

f1[( x2 x1) (x3 x1)] f2 (x3 x1) f3(x1 x2 ) 0

f2 f1 f3 f1 这表明此时三个插值点共线。 x2 x1 x3 x1

f2

f3

f1

x1

x2

a=x3、b=x1

x3=x2+h、y3=f(x3)

常用一维搜索算法

常用一维搜索算法常用一维算法一维算法是解决一维问题的常用方法。

一维算法主要通过在一维数据集中查找目标元素来解决问题。

以下是一些常用的一维算法:1. 线性(Linear Search):线性算法是一种最简单的算法,也是最基本的一维算法。

它从头到尾依次检查数据集中的每个元素,直到找到目标元素或遍历完整个数据集。

线性算法的时间复杂度为O(n)。

2. 二分(Binary Search):二分算法是一种高效的算法,但它要求数据集必须是有序的。

算法通过将数据集分成两半,并与目标元素进行比较,从而确定目标元素在哪个半部分中。

然后,它将重复这个过程,直到找到目标元素或数据集被划分为一个元素。

二分算法的时间复杂度为O(log n)。

3. 插值(Interpolation Search):插值算法是改进的二分算法,它根据目标元素与数据集中元素的相对位置来确定的起始位置。

它使用目标元素与数据集首尾元素之间的比例来估计目标元素的位置。

插值算法在数据集分布均匀的情况下具有较好的性能。

4. 斐波那契(Fibonacci Search):斐波那契算法基于斐波那契数列来确定的起始位置。

它通过比较目标元素与斐波那契数列中的元素来确定的范围,并将数据集划分成两部分。

然后,它在适当的部分中重复这个过程,直到找到目标元素。

斐波那契算法的时间复杂度为O(log n)。

5. 插入(Interpolation Search):插入算法是一种改进的线性算法,它使用了数据集中元素的顺序信息来提高效率。

与线性算法一样,它从头到尾依次检查数据集中的每个元素,但是当元素不满足条件时,它会根据元素的顺序信息来确定的方向,从而减少的次数。

6. 哈希(Hash Search):哈希算法使用哈希函数将数据集中的元素映射到哈希表中的索引。

然后,它通过查找哈希表中的索引来确定目标元素的位置。

哈希算法通常具有很高的效率,但是它需要额外的内存空间来存储哈希表。

上述算法是一维问题的常用解决方法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

5)重新计算插入试点。 )重新计算插入试点。

α 2 = α 1 = 4.292

f 2 = f 1 = − 1 .6227

α 1 = b − 0.618 (b − a ) = 5.708 − 0.618 ´ (5.708 − 2) = 3.4165

数值解法求解一般步骤

f (α )极小点 α * 所在 运用进退法确定单变量函数 1、运用进退法确定单变量函数

该区间应是单谷区间。 的搜 索区间 [ a, b],该区间应是单谷区间。 单谷区间是指函数在区间内只有一个极小点。 单谷区间是指函数在区间内只有一个极小点。 是指函数在区间内只有一个极小点 在极小点左边的函数值应是严格下降,在极小 在极小点左边的函数值应是严格下降, 点右边的函数值应是严格上升, 点右边的函数值应是严格上升,即单谷区间内 的函数值具有的特征是: 的函数值具有的特征是:“高—低—高” 。 低 高

2.比较函数值 比较函数值, 比较函数值

f 2 < f1 ,向前试探 向前试探

α3 = α2 + h = 2

3. 比较函数值 比较函数值,

f 3 = f (α 3 ) = 0

f2 > f3

,步长加倍 向前试探 步长加倍,向前试探 步长加倍

h = 2 ×1 = 2 α1 = α 2 = 1

f 1 = f 2= 4

(1 ) (2 )

α 1 = b − 0.618(b − a ) α 2 = a + 0.618(b − a )

(1) (2)

α1 = a + 0.382(b − a ) α 2 = a + 0.618(b − a)

(1) (2)

黄金分割法的搜索过程

1. 给出搜索区间 给出搜索区间[a,b]及收敛精度 ,并置 λ =0.618。 及收敛精度e, 及收敛精度 。 2. 按照公式 按照公式(1)(2)计算插入点,并计算其函数值。 计算插入点,并计算其函数值。 计算插入点 3. 根据区间消去法原理,进行区间缩短。 根据区间消去法原理,进行区间缩短。 4. 检验区间是否缩短到足够短,如果不满足转步骤2。否则 检验区间是否缩短到足够短,如果不满足转步骤 。 转下步。 转下步。 5. 取区间两端点的平均值作为极小点的数值近似解。 取区间两端点的平均值作为极小点的数值近似解。

f (α ) = α − 7α + 10

2

1.取初始点为第一点 前进一步 得第二点 并计算函数值 取初始点为第一点,前进一步 得第二点,并计算函数值 取初始点为第一点 前进一步,得第二点 并计算函数值.

α1 = α 0 = 0 f 1 = f (α 1 ) = 10 α 2 = α 1 + h = 1 f 2 = f (α 2 ) = 4

第三章 一维搜索方法

第一节 概 述

k +1

x

=x +

k

αkd

k

(k = 1,2,...)

的极值时, 求多维目标函数 f ( X ) 的极值时,若迭代过程的出发 已确定, 出发, 点 X ( K ) 及搜索方向 d ( K ) 已确定,则从 X ( K ) 出发,沿方 向 d ( K ) 搜索新点的迭代格式为 X ( K +1) = X ( K ) + αd ( K ) 式中, 为步长因子。 式中, α 为步长因子。 α = α ( K ) ,使产生的新点 X ( K +1) 是方 选择一特定步长 上目标函数的极小点, 向 d ( K )上目标函数的极小点,即

算法的关键

插入点对称分布在搜索区间内插入的两个

试点在区间的位置相对于区间边界对称分布。 试点在区间的位置相对于区间边界对称分布。

αα 2 = α1b => aa1 = a2b

固定的区间收缩率区间收缩率是表示每次缩小所

得到的新区间长度与缩小前旧区间长度之比. 得到的新区间长度与缩小前旧区间长度之比.

min f ( X ( K ) + αd ( K ) ) = f ( X ( K ) + α ( K ) d ( K ) )

则称 α ( K ) 为方向

d (K )

上的最优步长因子。 上的最优步长因子。

二维函数f(x)沿方向 的一维搜索示例 沿方向s的一维搜索示例 二维函数 沿方向

最优步长因子 在搜索方向上, 在搜索方向上,使目标函数取得极小值的 步长因子,称为该方向上最优步长因子。 步长因子,称为该方向上最优步长因子。

f (a1) < f (b1 ) [a, b1 ]

f (a1 ) > f (b1 ) [a1 , b]

f (a1 ) = f (b1 ) [a1 , b1 ]

一维搜索方法分类

应用区间消去原理, 应用区间消去原理,需要在确定的搜索 内给出插入点。根据确定插入点的方法不同, 内给出插入点。根据确定插入点的方法不同, 一维搜索方法分为两大类: 一维搜索方法分为两大类: 试探法:黄金分割法、 试探法:黄金分割法、斐波那契法 插值法(函数逼近法):二次插值法、 ):二次插值法 插值法(函数逼近法):二次插值法、三次 插值法、格点法等。 插值法、格点法等。

2)比较两试点函数值,缩短搜索区间.由于 )比较两试点函数值,缩短搜索区间 由于

f1 < f 2

消去右区间

(α 2 , b]

3)确定新区间 ) b = α 2 = 5.708 [a,b]=[2,5.708] 4)判断迭代终止条件: )判断迭代终止条件:

b − a = 5.708 − 2 = 3.708 > ε

保留区间λL 消去区间( − λ)L 1 =λ = 保留区间λL 初始区间L

整理后得到一元二次方程 其解

λ + λ87 L 2

故黄金分割法又称为0.618法。 故黄金分割法又称为0.618法 0.618

插入的两个试点为: 插入的两个试点为

λ = 0 .6 1 8 α 1 = b − λ (b − a ) α 2 = a + λ (b − a )

f1 = f 2= 0

α 2 = α 3 = 4 f 2 = f 3 = −2 α 3 = α 2 + h = 8 f 3 = f (α 3 ) = 18

5. 比较函数值 比较函数值,

f1 > f 2 < f 3

所以a=2,b=8,即搜索区间为 即搜索区间为[a,b]=[2,8]. 所以 即搜索区间为

一维搜索 沿给定搜索方向, 沿给定搜索方向,求最优步长因子的 一元函数极值问题,称为一维搜索。 一元函数极值问题,称为一维搜索。

f (x

k +1

) = f ( x + α k d ) = φ (α )

k k

一维问题是多维问题的基础

求最佳步长因子方法 •解析解法 解析解法

先将f(x+ad)进行泰勒展开, 先将f(x+ad)进行泰勒展开,并取到二 f(x+ad)进行泰勒展开 阶项, 阶项,后对泰勒展开式利用微积分求极值方 法获得最佳步长因子。 法获得最佳步长因子。

X (0) = [0 0] , S ( 0) = [1 1]

T

T

2 F = x12 + x2 − 8 x1 − 12 x2 + 52

= 2α 2 − 20α + 52

α 的确定方法

dF 令 = 4α − 20 = 0 , 得 α ∗ = 5是最优步长 . dα

F* = 2

第二节 搜索区间的确定与区间消去法原理

f 1 = f (α 1 ) = 3.4165 2 − 7 ´ 3.4165 + 10 = − 2.2430

黄 金 分 割 法 的 程 序 框 图

第四节 一维搜索的插值法

1、插值方法与试探方法的比较 、 2、函数逼近法 、 将搜索区间内的若干试验点的函数值构造的 低次多项式(二次多项式) 低次多项式(二次多项式)作为函数的近似 表达式, 表达式,用这个多项式的极值作为原函数的 极值点的近似点。 极值点的近似点。 3、二次多项式逼近原函数的方法 、

牛顿法和抛物线法

一、牛顿法(切线法) 牛顿法(切线法)

•基本思想 基本思想

取原函数极小点的一个近似点, 取原函数极小点的一个近似点,在近似点附近用二次函数 泰勒展开并保留到二次项)逼近原函数, (泰勒展开并保留到二次项)逼近原函数,以逼近函数的极 小点作为原极小点的新近似点,依此类推,直到近似点满足控 小点作为原极小点的新近似点,依此类推 直到近似点满足控 制误差为止,取最后的近似点作为原函数的极小点。 制误差为止,取最后的近似点作为原函数的极小点。

外 推 法 程 序 框 图

-

例:应用外推法求函数 f ( x ) = x 2 − 6 x + 9的搜索区间,初始点 α 0 = 0, 初始步长 h0 = 1。

二、区间消去法原理 由外推法确定搜索区间[a,b]后,在区间 后 由外推法确定搜索区间 内插入两点a1和 ( ),计算 内插入两点 和b1(a<a1<b1<b),计算 ), 插入点的函数值,并比较其大小, 插入点的函数值,并比较其大小,确定消去 的区间,从而得到缩短的搜索区间, 的区间,从而得到缩短的搜索区间,依次类 最后即可得到理论最小点的近似解。 推,最后即可得到理论最小点的近似解。

1 f ( x + α d ) ≈ f ( x) + α d ∇f ( x) + (α d )T G (α d ) 2

T

d ∇f ( x ) α =− T d Gd

T *

x

k +1

=x + α d

k *

k

(k = 1, 2,...)

•数值解法 数值解法

利用计算机通过反复迭代计算求得最佳 步长因子的近似值。 基本思路是: 步长因子的近似值。 基本思路是: 先确定步长因子(最优点)所在的区间, 先确定步长因子(最优点)所在的区间, 然后根据区间消去法远离不断缩小此区间, 然后根据区间消去法远离不断缩小此区间, 从而获得最优点的数值的近似解。 从而获得最优点的数值的近似解。 0.618法,抛物线法 三次插值法 法 抛物线法 三次插值法..... 抛物线法,三次插值法