概率论与数理统计(随机变量的相互独立性)

随机变量独立性判断随机变量的独立性和相关性

随机变量独立性判断随机变量的独立性和相关性随机变量的独立性和相关性是概率论和数理统计中的重要概念。

在实际问题中,我们经常需要判断随机变量之间是否相互独立或者相关。

本文将介绍如何判断随机变量的独立性和相关性。

一、什么是随机变量的独立性和相关性随机变量的独立性和相关性描述了随机变量之间的关系。

独立性:若两个随机变量X和Y的联合分布等于各自的边缘分布之积,即P(X=x, Y=y) = P(X=x)P(Y=y),则称X和Y独立。

相关性:若两个随机变量X和Y之间存在某种依赖关系,即它们的联合分布和边缘分布不相等,称X和Y相关。

二、判断随机变量的独立性和相关性的方法1. 统计方法利用样本数据进行统计分析,可以判断随机变量的独立性和相关性。

对于两个随机变量X和Y,如果它们的样本相关系数接近于0,可以认为X和Y近似独立;如果样本相关系数接近于1或-1,可以认为X和Y相关。

2. 图形方法通过绘制散点图可以直观地观察随机变量的相关性。

对于两个随机变量X和Y,如果它们的散点图呈现出线性关系,则可以认为X和Y相关;如果散点图呈现出无规律的分布,则可以认为X和Y近似独立。

3. 利用协方差和相关系数判断协方差和相关系数是判断随机变量相关性的重要指标。

协方差衡量了两个随机变量之间的线性相关性,若协方差为0,则可以认为两个随机变量不相关。

相关系数除了衡量两个随机变量的线性相关性,还可以衡量非线性相关性,相关系数的范围在-1至1之间,绝对值越接近1表示相关性越强,绝对值越接近0表示独立性越强。

三、应用举例1. 抛硬币问题假设一次抛硬币,X表示正面次数,Y表示反面次数。

在这个例子中,X和Y的取值只能是0或1,它们的联合分布如下:P(X=0, Y=0) = 1/2P(X=1, Y=0) = 1/2P(X=0, Y=1) = 1/2P(X=1, Y=1) = 1/2可以看出,X和Y的联合分布等于各自的边缘分布之积,即P(X=x, Y=y) = P(X=x)P(Y=y),因此X和Y是独立的。

概率论与数理统计(随机变量的相互独立性)

即X与Y独立.

3.4 随机变量的相互独立性

反之,若X与Y独立,由于f(x,y),fX(x),fY(y)都是 连续函数,故对所有的x,y,有

f ( x, y) fX ( x) fY ( y)

特别,令 x 1, y 2,可以得到

1

1

2 1 2 1 2 2 1 2

从而 0.

☺课堂练习

已知 ( X ,Y ) 的分布律为

( X ,Y ) (1,1) (1,2) (1,3) (2,1) (2,2) (2,3)

111 1

pij

6

9 18

3

(1) 求 与 应满足的条件; (2) 若 X 与 Y 相互独立,求 与 的值.

解:将 ( X ,Y ) 的分布律改写为

(2) P{ X1 X2 1} D f ( x1, x2 )dx1d x2

x2

1

x1 x2 1 D

O

1

1 0

1 x2 0

1 9

e ( x1 x2 )/ 3

d

x1

d

x2

1 9

1 ex2 / 3 (

0

1 0

x2

e

x1

/

3

d

x1

)dx2

x1

9

18

3.4 随机变量的相互独立性

【例3.17】已知随机变量X与Y相互独立且都服从参 数为1/2的0-1分布,定义随机变量

1 当X Y为偶数 Z 0 当X Y为奇数

求Z的分布律,(X,Z)的分布律, 并问X与Z是否独立?

解:由X与Y的分布律

X

0

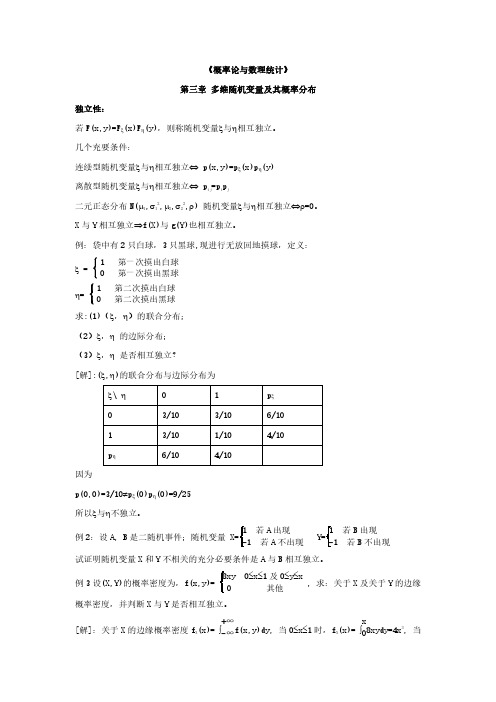

随机变量的独立性和相关性

随机变量的独立性和相关性随机变量是概率论和数理统计中的重要概念,用于描述随机事件和随机现象的数值特征。

研究随机变量之间的关系对于深入理解概率和统计学的基本原理至关重要。

在这篇文章中,我们将探讨随机变量的独立性和相关性。

一、独立性独立性是指两个或多个随机变量之间的关系,即一个随机变量的取值对另一个随机变量的取值没有任何影响。

如果两个随机变量X和Y 是独立的,那么它们满足以下条件:P(X=x, Y=y) = P(X=x) * P(Y=y)其中P(X=x, Y=y)表示X等于x,Y等于y的概率,P(X=x)和P(Y=y)分别表示X等于x的概率和Y等于y的概率。

换句话说,当两个随机变量独立时,它们的联合概率等于各自的边缘概率的乘积。

独立性的意义在于可以简化概率计算。

如果X和Y是独立的,那么我们可以通过独立事件的性质计算它们的联合概率。

此外,独立性还可以应用于贝叶斯定理、条件概率和协方差等相关概念的推导与计算。

二、相关性相关性是指两个随机变量之间存在某种程度的关联或依赖关系。

如果两个随机变量X和Y相关,那么它们的取值是彼此依赖的,即当X的取值发生变化时,Y的取值也会随之变化。

在统计学中,相关性通过协方差和相关系数来度量。

协方差描述了两个随机变量之间的总体关系,定义为:cov(X,Y) = E[(X - E(X))(Y - E(Y))]其中cov(X,Y)表示X和Y的协方差,E(X)和E(Y)分别表示X和Y的期望(均值)。

协方差的数值可以为负、零或正,分别表示负相关、无相关或正相关。

相关系数是协方差的标准化形式,用于度量两个随机变量之间的线性相关程度。

相关系数的取值范围在-1和1之间,越接近-1或1表示相关性越强,越接近0表示相关性越弱或不存在。

三、独立性与相关性的区别独立性和相关性是两个不同的概念。

独立性是指两个或多个随机变量之间的独立关系,即一个变量的取值对另一个变量的取值没有影响。

相关性是指两个随机变量之间存在某种关联或依赖关系,即一个变量的取值会随着另一个变量的取值而变化。

数理统计--独立性

x<0 或 x>1 时 , fX(x)=0; 所 以 fX(x)=

4x 0

3

0x1 。 同 理 当 0 y 1 时 , fY(y)= 其他

1 2 y 8xydx=4y(1-y ), 其 它 情 况 fY(y)=0, 所 以 关 于 Y 的 边 缘 概 率 密 度 fY(y)=

2 4y(1-y ) 0x1 . 因为当 0x1, 0y1 时,f(x,y) fX(x)fY(y),所以 X 与 Y 不独立。 0 其他

( y x ) ,并判断 X 与 Y 是否独立?(6 分)

(4 分)

f ( x, y )dy 2dy 2 x ,从而

0

x

2 x, f x ( x) 0,

0 x 1 其它

1

当 0 y 1 时,则 fY ( y )

f ( x, y )dx 2dx 2(1 y ), 从而

试证明随机变量 X 和 Y 不相关的充分必要条件是 A 与 B 相互独立。 例 3 设(X,Y)的概率密度为,f(x,y)= 8xy 0 0x1 及 0yx , 求:关于 X 及关于 Y 的边缘 其他

概率密度,并判断 X 与 Y 是否相互独立。 +∞ x 3 [解]:关于 X 的边缘概率密度 fX(x)= -∞f(x,y)dy, 当 0x1 时,fX(x)= 08xydy=4x , 当

1

y

0 0

xy f ( x, y )dxdy E ( XY )

1 1

0

2 xydydx ( x x )dx 4

3 x x

1

1

两个随机变量的函数的分布: 几条结论: 1. X~P(1), Y~P(2), 若 X 与 Y 相互独立,则 X+Y~P(1+2);

二维随机变量的相互独立性

f(x, y)=fX(x) fY(y) 几乎处处成立(即: 在平面上除去“面积”为零的集合以外, 处处成立).

➢ 因为随机变量是随机事件的量化指标,因此在判断随机 变量X与Y是否相互独立时,仍可以像判断随机事件的独 立性一样,根据问题的实际意义去判定.

概率论与数理统计

9

❖ 3.连续型随机变量的独立性 1.概念

判断随机变量X与Y是否相互独立.

➢ 解 (2) 不放回摸球, 分布律如表:

P( X 0,Y 0) P( X 0)P(Y 0)

故采用无放回抽取时,可判定

X与Y不是相互独立的,这也

与实际意义一致.

概率论与数理统计

8

❖ 3.连续型随机变量的独立性 1.概念

➢ 定理3.6.2 设二维连续型随机变量(X, Y) 的概率密度为 f(x, y), fX(x), fY(y) 分别为(X, Y) 的边缘概率密度, 则X和Y 相互独立等价于

1, 第一次摸出白球, 1, 第二次摸出白球, X 0, 第一次摸出黑球, Y 0, 第二次摸出黑球.

判断随机变量X与Y是否相互独立.

➢ 解 利用古典概型的方法求其

联合分布律及边缘分布律,

根据分布律的结果判断独立性.

(1) 有放回摸球,分布律如下:

概率论与数理统计

6

❖ 2.离散型随机变量的独立性 1.概念

即X 和Y 相互独立.

概率论与数理统计

4

❖ 2.离散型随机变量的独立性 1.概念

➢ 设离散型随机变量(X, Y)的联合分布律、边缘分布律分别为

P( X xi ,Y y j ) pij , P( X xi ) pi , P(Y y j ) p• j

关于离散型随机变量X, Y的相互独立性,有如下的判别法. ➢ 定理3.6.1 离散型随机变量X与Y相互独立的充要条件是:

概率论与数理统计-第3章-第4讲-随机变量的独立性

1, (x, y) G

f (x, y) 0,

其它.

1

2x

02 随机变量的独立性

例题 设二维离散型随机变量 X, Y 的联合分布律为

应用

Y X

1

1

1 6

2

3

1

1

9

18

2

1 3

试确定常数 , 使得随机变量 X 与Y 相互独立.

02

随机变量的独立性 由表,可得随机变量 X 与Y 的边缘分布律为

P{XY Y 0} P{( X 1)Y 0}

P{X 1 0,Y 0} P{X 1 0,Y 0}

P(X ) P(X ) 1

2

P{X 1}P{Y 0} P{X 1}P{Y 0} 1111 1

22 22 2

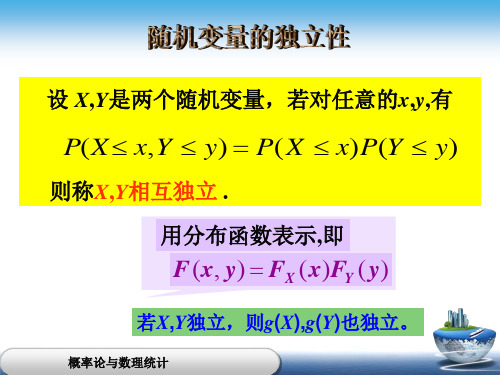

第4讲 随机变量的独立性

本节我们学习了二维随机变量的独立性, 后续会推广到更多维. 随机变量的独立性在概率论和数理统计中会发挥重要的作用.

用分布函数表示, 即 设 X,Y 是两个随机变量, 若对任意的x, y, 有 F ( x, y) FX (x)FY ( y)

则称 X, Y 相互独立 .

它表明, 两个随机变量相互独立时, 联合分布函数等于两个 边缘分布函数的乘积 .

01 两个随机变量独立的定义

离散型

X与Y 独立

对一切 i , j 有

01 两个随机变量独立的定义 两个随机变量独立的定义

设 X,Y是两个随机变量, 若对任意的x,y ,有 P ( X x,Y y) P( X x)P(Y y)

则称X,Y相互独立 .

如何判断

两事件A, B独立的定义是: 若 P(AB)=P(A)P(B)则称事件A, B独立 .

01 两个随机变量独立的定义

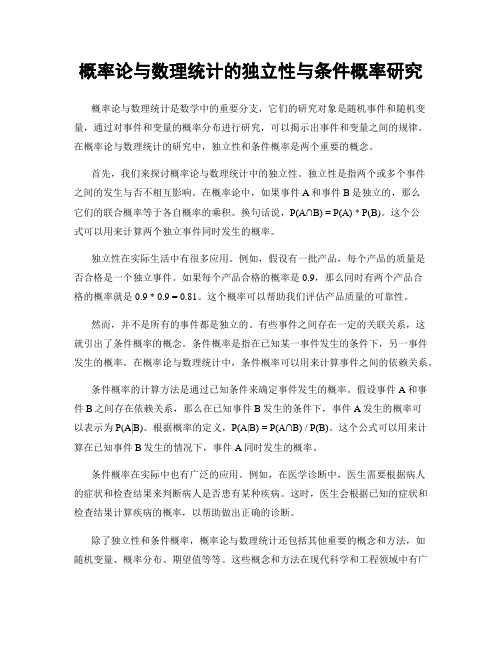

概率论与数理统计的独立性与条件概率研究

概率论与数理统计的独立性与条件概率研究概率论与数理统计是数学中的重要分支,它们的研究对象是随机事件和随机变量,通过对事件和变量的概率分布进行研究,可以揭示出事件和变量之间的规律。

在概率论与数理统计的研究中,独立性和条件概率是两个重要的概念。

首先,我们来探讨概率论与数理统计中的独立性。

独立性是指两个或多个事件之间的发生与否不相互影响。

在概率论中,如果事件A和事件B是独立的,那么它们的联合概率等于各自概率的乘积。

换句话说,P(A∩B) = P(A) * P(B)。

这个公式可以用来计算两个独立事件同时发生的概率。

独立性在实际生活中有很多应用。

例如,假设有一批产品,每个产品的质量是否合格是一个独立事件。

如果每个产品合格的概率是0.9,那么同时有两个产品合格的概率就是0.9 * 0.9 = 0.81。

这个概率可以帮助我们评估产品质量的可靠性。

然而,并不是所有的事件都是独立的。

有些事件之间存在一定的关联关系,这就引出了条件概率的概念。

条件概率是指在已知某一事件发生的条件下,另一事件发生的概率。

在概率论与数理统计中,条件概率可以用来计算事件之间的依赖关系。

条件概率的计算方法是通过已知条件来确定事件发生的概率。

假设事件A和事件B之间存在依赖关系,那么在已知事件B发生的条件下,事件A发生的概率可以表示为P(A|B)。

根据概率的定义,P(A|B) = P(A∩B) / P(B)。

这个公式可以用来计算在已知事件B发生的情况下,事件A同时发生的概率。

条件概率在实际中也有广泛的应用。

例如,在医学诊断中,医生需要根据病人的症状和检查结果来判断病人是否患有某种疾病。

这时,医生会根据已知的症状和检查结果计算疾病的概率,以帮助做出正确的诊断。

除了独立性和条件概率,概率论与数理统计还包括其他重要的概念和方法,如随机变量、概率分布、期望值等等。

这些概念和方法在现代科学和工程领域中有广泛的应用。

例如,在金融领域中,概率论与数理统计可以用来对股票价格的波动进行建模和预测,以帮助投资者做出决策。

概率论与数理统计 随机变量的独立性

g ( xi , y j ) f ( x, y)dxdy

概率论与数理统计

例9

求E(X),E(Y),E(XY).

E ( XY ) xi y j pij

j 1 i 1

解 X,Y的边缘分布为

1 3 (1 0) 0 (3 0) 3 (1 1) 3 (3 1) 0 1 E ( X ) xi pi 18 3 8 , 4 4 2 i 1 3 1 9 (1 2) (3 2) 0 3 (1 3) 0 (3 3) . 1 8 0 1 2 3 3 1 3 , 8 4 E (Y ) y j p j 8 8 8 8 2 j 1

E X i E( X i )

n i 1 n i 1

概率论与数理统计

例10

解

设随机变量Xi为

则X=X1+ X2+ …+ X10 故 E(X)=E(X1)+ E(X2)+ …+ E(X10) 而E(Xi)=1-(9/10)20 i=1,2,…,10

9 20 E( X ) E ( X i ) E ( X i ) 10 ] 8.784 [1 10 i 1 i 1

概率论与数理统计

若(X,Y)是二维离散型随机变量,Z=g(X,Y), 且E(Z)存在,则

E (Z ) E[ g ( X , Y )] g ( xi , y j ) pij

j 1 i 1

若(X,Y)是二维连续型随机变量,Z=g(X,Y), 且E(Z)存在,则

E (Z ) E[ g ( X , Y )]

概率论与数理统计

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

积为零的集合,在其上等式 f ( x, y) fX ( x) fY ( y) 不成立.

3.4 随机变量的相互独立性

【例3-16】设随机变量X和Y的联合分布律为

Y X

y1

y2

y3

x1

a

1/9

c

x2

1/9

b

1/3

若X与Y相互独立,求参数a,b,c的值. 解: 首先写出两个边缘边缘分布律

Y X

y1

y2

总寿命为 X1 X2 ,求 P{ X1 X 2 1}.

3.4 随机变量的相互独立性

解(1)X1概率密度为

f

X1

(

x1

)

1 3

e

x1

3

,

0,

x1 0 其 它.

X2概率密度为

fX2

(

x2

)

1 3

x2

e

3

,

0,

x2 0 其 它.

因两只保险丝的寿命 X1, X2 , 相互独立,故 X1, X 2

解:将 ( X ,Y ) 的分布律改写为

Y X

1

2

3

1

1

1

1

6

9

18

1

2

3

P{Y y j }

1 2

1 1

9

18

P{X xi}

1 3

1

3

2

3

(1)由分布律的性质知 故与应满足的条件是

0, 0, 2

3

: 0, 0 且

1,

1

.

3

(2) 因为 X 与 Y 相互独立, 所以有

1

1

2 1 2 1 2 2 1 2

从而 0.

☺课堂练习

已知 ( X ,Y ) 的分布律为

( X ,Y ) (1,1) (1,2) (1,3) (2,1) (2,2) (2,3)

111 1

pij

6

9 18

3

(1) 求 与 应满足的条件; (2) 若 X 与 Y 相互独立,求 与 的值.

3.4 随机变量的相互独立性

【补充例】种保险丝的寿命(以一百小时计) X 服从指数

分布,其概率密度为

f

(

x

)

1 3

e

x

3

,

x0

0, 其它.

(1) 有两只这种保险丝,其寿命分别为 X1, X2, 设 X1, X2 相互独立,求 X1 , X 2 的联合概率密度.

(2) 在(1)中,一只是原装的,另一只是备用的,备用的 只在原装的熔断时自动投入工作,于是两只保险丝的

因此,若ρ=0,则对所有x,y有 f ( x, y) fX ( x) fY ( y)

即X与Y独立.

3.4 随机变量的相互独立性

反之,若X与Y独立,由于f(x,y),fX(x),fY(y)都是 连续函数,故对所有的x,y,有

f ( x, y) fX ( x) fY ( y)

特别,令 x 1, y 2,可以得到

则称X1,X2,…,Xn相互独立.

3.4 随机变量的相互独立性

易知,在离散型随机变量的情形,如果对于任意n

个取值x1,x2,…,xn,有 n P{ X1 x1 , X 2 x2 , , X n xn } P{ X i xi } i 1

则X1,X2,…,Xn相互独立.

在连续型随机变量的情形,如果下式几乎处处成

x2

1

x1 x2 1 DO1源自1 01 x2 0

1 9

e ( x1 x2 )/ 3

d

x1

d

x2

1 9

1 ex2 / 3 (

0

1 0

x2

e

x1

/

3

d

x1

)dx2

x1

1 9

e ( 1 x2 / 3

0

1

4

e

1 3

3

3e

x2 1 3

)dx2

3

3.4 随机变量的相互独立性

【例3.19】设服从二维正态分布,则X与Y相互独立 的充要条件是ρ=0.

解法二:

1 e0.5 x e0.5 y e , 0.5( x y) x 0, y 0;

F(x, y)

0,

其它

由分布函数与概率密度的关系知

2F ( x, y) 0.25e0.5( x y) , x 0, y 0

f (x, y)

xy

0, 其它

f X ( x)

f (x,

y)dy

Pij Pi.P. j

3.4 随机变量的相互独立性

3) 设连续型随机变量( X ,Y )的联合概率密度为

f ( x, y),边缘概率密度分别为fX ( x), fY ( y),则有

X 和 Y 相互独立

f ( x, y) f X ( x) fY ( y).

在平面上几乎处处成立。

在平面上几乎处处成立:允许在平面上存在面

(i,j= 0,1),

所以X与Z独立.

3.4 随机变量的相互独立性

【例3.18】某电子仪器由两部件构成,以X和Y分别表示两部

件的寿命(单位:千小时),已知X和Y的联合分布函数为

F(x, y) 问X与Y是否独立?

1

e0.5 x 0,

e 0.5 y

e0.5( x y) , x 0,, y 其它

的联合概率密度为 f ( x1 , x2 ) f X1 ( x1 ) f X2 ( x2 )

(

1 3

e

x1

3

)(

1 3

e

x2

3

),

x1 0, x2 0,

0,

其 它.

3.4 随机变量的相互独立性

即

f

( x1,

x2 )

1 9

(x1 x2)

e

3

0,

x1 0, x2 0, 其 它.

(2) P{ X1 X2 1} D f ( x1, x2 )dx1d x2

pij

0.25 0.25 0.25 0.25

(X,Y) (0,0) (0,1) (1,0) (1,1)

Z

1

0

0

1

(X,Z) (0,1) (0,0) (1,0) (1,1)

(X,Z)的分布律及边缘分布律为:

X

Z

0

1

pi.

0

0.25 0.25 0.5

1

0.25 0.25 0.5

p.j

0.5

0.5 1

由于P{X = i,Z = j} = 0.25 = 0.50.5 = P{X = i}P{Z = j}

pij P{ X xi } P{Y y j }, (i 1,2; j 1,2,3)

特别有

p12

1 9

1 3

1 9

2,

9

又 1, 得 1.

3

9

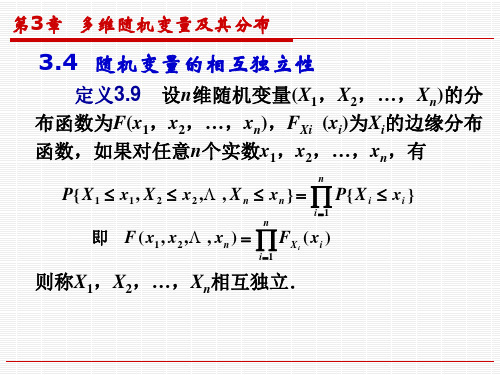

第3章 多维随机变量及其分布

3.4 随机变量的相互独立性

定义3.9 设n维随机变量(X1,X2,…,Xn)的分 布函数为F(x1,x2,…,xn),FXi (xi)为Xi的边缘分布 函数,如果对任意n个实数x1,x2,…,xn,有

n

P{ X1 x1 , X 2 x2 , , X n xn } P{ X i xi } i 1 n 即 F ( x1, x2, , xn ) FXi ( xi ) i 1

y3

pi.

x1

a

1/9

c

a+c+1/9

x2

1/9

b

1/3 b+4/9

p.j

a+1/9 b+1/9 c+1/3 a+b+c+5/9=1

3.4 随机变量的相互独立性

Y X

y1

y2

y3

pi.

x1

a

1/9

c

a+c+1/9

x2

1/9

b

1/3 b+4/9

p.j

a+1/9 b+1/9 c+1/3 a+b+c+5/9=1

0;

解法一:由边缘分布函数的定义知

1 e0.5x , x 0

FX

(x)

lim F( x,

y

y)

0,

x0

1 e0.5 y , y 0

FY

(

y)

lim

x

F ( x,

y)

0,

y0

显然,对任意实数,均有F( x, y) FX ( x)FY ( y) ,

故X与Y独立.

3.4 随机变量的相互独立性

利用X与Y相互独立的条件,

由 p22 p2 p2, 即 b (b 4 )(b 1 ), 解之得 b 2 / 9. 99

再由 p23 p2 p3 ,

即 1 (b 4)(c 1 ),

3

93

将 b 2 代入解得c 1 ,

9

6

最后利用a b c 5 1得a 1 .

9

18

3.4 随机变量的相互独立性

立

n

f ( x1, x2 , , xn ) fXi ( xi )

i 1

则X1,X2,…,Xn相互独立. 这里“几乎处处成立”是指除去测度为零的点集

外处处成立.

3.4 随机变量的相互独立性

特别地,二维的情形

1) 设随机变量( X ,Y )的联合分布函数为F( x, y), 边缘分布函数分别为FX ( x),FY ( y),则有

X 和 Y 相互独立 F(x, y) FX (x)FY ( y).

2) 若离散型随机变量 ( X,Y )的联合分布律为