空间聚类分析概念与算法

第四讲 聚类分析

4. 聚类分析数据格式5. 判别分析数据格式西安交大管理学院2008秋胡平17 1.基本概念和思想西安交大管理学院2008秋胡平主要的聚类分析方法图示法聚类分析hierarchical clustering method quick cluster method k-means2. 主要的聚类分析方法2. 轮廓图(Profile diagram)西安交大管理学院2008秋胡平西安交大管理学院2008秋胡平38主要的聚类分析方法2.2 距离与相似系数西安交大管理学院2008秋胡平主要的聚类分析方法2.2.1.3 欧式距离的平方 2.2.2. 明氏(Minkowski)距离西安交大管理学院2008秋胡平45西安交大管理学院2008秋胡平46主要的聚类分析方法主要的聚类分析方法西安交大管理学院2008秋胡平49西安交大管理学院2008秋胡平主要的聚类分析方法主要的聚类分析方法2.2.3.1Mahalanobis距离西安交大管理学院2008秋胡平53主要的聚类分析方法西安交大管理学院2008秋胡平57西安交大管理学院2008秋胡平58第四讲聚类分析2. 主要的聚类分析方法西安交大管理学院2008秋胡平西安交大管理学院2008秋胡平66 2.4系统聚类法 2.4系统聚类法西安交大管理学院2008秋胡平69西安交大管理学院2008秋胡平70系统聚类法西安交大管理学院2008秋胡平73西安交大管理学院2008秋胡平77西安交大管理学院2008秋胡平78八种系统聚类法公式的参数西安交大管理学院2008秋胡平892.5快速聚类法西安交大管理学院2008秋胡平97在Spss 软件中选择Analyze ->Classify —>K-Means Cluster 。

进入K —均值聚类对话框,选择Country 为标识变量,Urban ,Lifeexpf ,Lifeexpm ,Literacy ,Gdp -cap 为变量。

聚类算法和分类算法总结

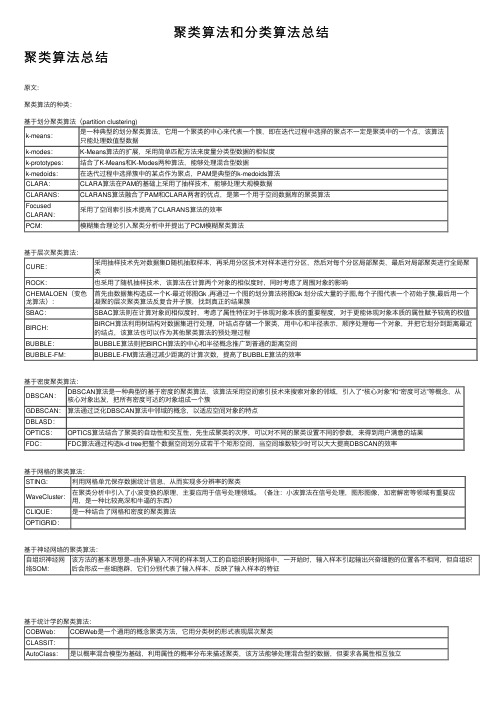

聚类算法和分类算法总结聚类算法总结原⽂:聚类算法的种类:基于划分聚类算法(partition clustering)k-means:是⼀种典型的划分聚类算法,它⽤⼀个聚类的中⼼来代表⼀个簇,即在迭代过程中选择的聚点不⼀定是聚类中的⼀个点,该算法只能处理数值型数据k-modes:K-Means算法的扩展,采⽤简单匹配⽅法来度量分类型数据的相似度k-prototypes:结合了K-Means和K-Modes两种算法,能够处理混合型数据k-medoids:在迭代过程中选择簇中的某点作为聚点,PAM是典型的k-medoids算法CLARA:CLARA算法在PAM的基础上采⽤了抽样技术,能够处理⼤规模数据CLARANS:CLARANS算法融合了PAM和CLARA两者的优点,是第⼀个⽤于空间数据库的聚类算法FocusedCLARAN:采⽤了空间索引技术提⾼了CLARANS算法的效率PCM:模糊集合理论引⼊聚类分析中并提出了PCM模糊聚类算法基于层次聚类算法:CURE:采⽤抽样技术先对数据集D随机抽取样本,再采⽤分区技术对样本进⾏分区,然后对每个分区局部聚类,最后对局部聚类进⾏全局聚类ROCK:也采⽤了随机抽样技术,该算法在计算两个对象的相似度时,同时考虑了周围对象的影响CHEMALOEN(变⾊龙算法):⾸先由数据集构造成⼀个K-最近邻图Gk ,再通过⼀个图的划分算法将图Gk 划分成⼤量的⼦图,每个⼦图代表⼀个初始⼦簇,最后⽤⼀个凝聚的层次聚类算法反复合并⼦簇,找到真正的结果簇SBAC:SBAC算法则在计算对象间相似度时,考虑了属性特征对于体现对象本质的重要程度,对于更能体现对象本质的属性赋予较⾼的权值BIRCH:BIRCH算法利⽤树结构对数据集进⾏处理,叶结点存储⼀个聚类,⽤中⼼和半径表⽰,顺序处理每⼀个对象,并把它划分到距离最近的结点,该算法也可以作为其他聚类算法的预处理过程BUBBLE:BUBBLE算法则把BIRCH算法的中⼼和半径概念推⼴到普通的距离空间BUBBLE-FM:BUBBLE-FM算法通过减少距离的计算次数,提⾼了BUBBLE算法的效率基于密度聚类算法:DBSCAN:DBSCAN算法是⼀种典型的基于密度的聚类算法,该算法采⽤空间索引技术来搜索对象的邻域,引⼊了“核⼼对象”和“密度可达”等概念,从核⼼对象出发,把所有密度可达的对象组成⼀个簇GDBSCAN:算法通过泛化DBSCAN算法中邻域的概念,以适应空间对象的特点DBLASD:OPTICS:OPTICS算法结合了聚类的⾃动性和交互性,先⽣成聚类的次序,可以对不同的聚类设置不同的参数,来得到⽤户满意的结果FDC:FDC算法通过构造k-d tree把整个数据空间划分成若⼲个矩形空间,当空间维数较少时可以⼤⼤提⾼DBSCAN的效率基于⽹格的聚类算法:STING:利⽤⽹格单元保存数据统计信息,从⽽实现多分辨率的聚类WaveCluster:在聚类分析中引⼊了⼩波变换的原理,主要应⽤于信号处理领域。

四类传统聚类算法简介

- leaf balance L •Parameter: T

BIRCH algorithm

•

An example of the CF Тree Initially, the data points in one cluster.

root A

A

BIRCH algorithm

root •

An example of the CF Тree The data arrives, and a check is made whether the size of the cluster does not exceed T.

传统聚类算法

• 基于划分的方法

• K-means算法

• 基于密度的方法

• DBSCAN算法

• FCM算法

• 基于网格的方法

• CLIQUE算法

• 基于层次的方法

• 层次凝聚的代表算法AGNES。层 次分裂的代表算法DIANA。 • 改进的层次聚类方法BIRTH

一、基于划分的方法

• 思想:给定包含n个样本的一个有限数据集,将数据集用划分方 法构建成k个聚类(k<n)

A

A

T

BIRCH algorithm

root •

An example of the CF Тree

If the cluster size grows too big, the cluster is split into two clusters, and the points are redistributed.

• 再使用循环定位技术将样本在各聚类间移动,来提高划分质量。

• 经典的基于划分的聚类方法k-means算法和FCM算法

K-means聚类算法

聚类分析

基于核的方法,该类思想的基础是在非线性支持向量机中,采用“核方法”的方式实现原始空间X的映射,吧X转化为高维空间,并且探讨该工具的非线性能力。

谷点搜索聚类算法:这种方法吧特征向量当做一个任意变量x的实例,这些算法都基于一个普遍接受的假设,即很多向量驻留的x区域对应着的概率密度函数值增加的区域。所以,对概率密度函数的估计可能使得聚类形成的区域更加显著。

竞争型学习算法:这是迭代算法,不适用代价函数。根据某种距离度量,它们产生一些聚类,而且收敛于最可判断的一个。其典型代表是基本的竞争学习方法和漏洞学习算法。

figure(2);

for p=1:n

if(bel(p)==1)

plot(y(1,p),y(2,p),'bo');hold on;

end

if(bel(p)==2)

plot(y(1,p),y(2,p),'g*');hold on;

end

if(bel(p)==3)

plot(y(1,p),y(2,p),'r+');hold on;

其他算法:特殊的聚类技术

分支和约束聚类算法。对于给定的聚类数m,这些算法使用预订的准则,不需要考虑到所有可能的聚类就可以提供全局最优聚类,然而,它们的计算量大。

遗传聚类算法:这些算法用一个可能的聚类作为初始种群,迭代生成新的种群,按照相关的准则,新种群一般比原来的种群具有更优的聚类。

随机松弛算法:在制定准则情况下,这种方法保证在一定的条件下概率收敛于全局最优聚类,但是计算量大。

第10章 聚类分析:基本概念和方法

10.4.1:DBSCAN:一种基于高密度连通区域的基于密度的聚类 为了把核心对象与它的近邻连接成一个稠密区域, DBSCAN使用密度相连概念。两个对象p1,p2 D是关于 和 MinPts密度相连的(density-connected),如果存在一个对 象q D,使得对象p1和p2都是从q关于 和MinPts密度可达 。不像密度可达,密度相连是等价关系。容易证明,对于 对象o1、o2和o3,如果o1和o2是密度相连的,并且o2和o3是 密度相连的,则o1和o2也是密度相连的。例10.7。

10.3.5:概率层次聚类

概率层次聚类(probabilistic hierarchical clustering)旨在通过使用概率模型度量簇之间的距离,克 服以上某些缺点。 一种看待聚类问题的方法是,把待聚类的数据对象集 看做要分析的基础数据生成机制的一个样本,或生成模型 (generative model)。 实践中,我们可以假定该数据的生成模型采用常见的 分布函数,如高斯分布或伯努利分布,它们由参数确定。 于是,学习生成模型的任务就归结为找出使得模型最佳拟 合观测数据集的参数值。

10.4.1:DBSCAN:一种基于高密度连通区域的基于密度的聚类 “如何在基于密度的聚类中发现稠密区域?”对象O密度 可以用靠近O的对象数度量。DBSCAN(Density-Based Spatial Clustering of Applications with Noise,具有 噪声应用的基于密度的空间聚类)找出核心对象,即其邻域 稠密的对象。它连接核心对象和它们的邻域,形成稠密区域 作为簇。 “DBSCAN如何确定对象邻域?”一个用户指定的参数 用来指定每个对象的邻域半径。对象O的 邻域是以O为 中心、以 为半径的空间。

基于密度的噪声应用空间聚类算法

基于密度的噪声应用空间聚类算法随着数据量的不断增长,数据挖掘和机器学习领域也不断发展。

其中,聚类算法是一种重要的数据挖掘技术,通过聚类可以将数据分为不同的组别,为后续分析和决策提供支持。

在聚类算法中,基于密度的噪声应用空间聚类算法是一种比较有代表性的算法。

一、算法基本原理基于密度的噪声应用空间聚类算法是一种基于密度的聚类算法,它通过对数据点间的密度关系进行分析,将密度较大的数据点聚集到一起形成簇。

该算法的基本原理如下:1. 根据给定的密度阈值,将所有数据点分为核心点、边缘点和噪声点三种类型;2. 通过一个密度连通性判定来确定核心点的邻域范围;3. 依据核心点之间的连通性将这些核心点合并进同一簇;4. 将与边缘点相邻的核心点和边缘点合并进同一簇;5. 剩余的点被归类为噪声点。

二、算法流程基于密度的噪声应用空间聚类算法的具体流程如下:1. 初始化:设定密度阈值、距离阈值,以及核心点邻域中的最小点数等参数;2. 确定核心点:计算每个数据点的密度,将密度大于等于密度阈值的点标记为核心点,密度小于密度阈值的点标记为噪声点;3. 标记边缘点:将密度小于密度阈值但是邻域中存在核心点的点标记为边缘点;4. 合并簇:从一个核心点开始,将其邻域内的所有核心点找出来并合并为一簇,重复进行该过程直至所有核心点都被分配至某一簇中;5. 处理边缘点:将邻域内存在核心点的边缘点归为核心点所在的簇;6. 输出:输出聚类结果。

三、算法优缺点基于密度的噪声应用空间聚类算法有一些优点:1. 适用于非凸形状的聚类,能够识别任意形状的簇;2. 无需指定簇的数量,能够自适应地进行聚类;3. 能够处理噪声数据,并将噪声数据排除在聚类结果之外。

然而,该算法也存在一些不足之处:1. 对于密度相差很大的簇,可能会将密度较小的簇归为噪声点;2. 效率较低,对于大规模数据集进行聚类时,计算量相对较大;3. 对参数的设置较为敏感,参数设置不当可能会影响聚类结果的准确性。

第七讲多距离空间聚类分析

不是用的平均密度来进行比较么?这个预期K值和随机分布又是什么鬼?

• 平均值的问题,前面我们已经一而再再而三的说过了,虽然他简 单好用,但是他的优点和缺点一样的明显,在描述算法的时候, 可以用平均值来进行描述,但是实际使用中,平均值暴露出来的 各种问题,会让分析人员为之抓狂。特别是在空间分布研究的时 候。如果仅仅用平均密度来研究具有空间分析的数据,会出现如 下图的问题。

此方法检查每个点与研究区域的边的 距离以及这个点到其各相邻点的距离。 如果有的相邻点与所涉及点的距离比 与研究区域的边的距离更远,则所有 这类相邻点都将被指定额外权重。此 边校正方法仅适用于形状为正方形或 矩形的研究区域,或者当为研究区域 方法参数选择 MINIMUM_ENCLOSING_RECTANG LE 时才适用。

应用

• 城市里面有若干巡逻热点,如果警方要部署巡逻区域,怎么才能 找到即省油,又能尽量的覆盖到所有的巡逻热点这样的分析中, 就可以采用距离分析,探索每个设定的巡逻区域的最佳距离。

• 另外,我有一批点,我现在要用这些点生成一个缓冲区,这个缓 冲区需要覆盖所有的区域,但是又要求缓冲区的距离是最小的, 那么就可以通过这个工具,来找到聚类程度最高的一个距离,如 下:

返回的值以及含义如下:

一般根据你设定的距离,会返回一堆的数据,如:

把这些数据整体画出来,就会变成这个样子

• 无论是从表信息里面,还是从图上,我们都可以看见,当第五次 计算的时候,也就是预期K值(预期K值一般等于距离)等于 33517的时候,观测K与预期K值的差距最大,聚类程度最高。

聚类分析简单例子

聚类结果优化策略

特征选择

选择与聚类任务相关的特征,去除冗余和无 关特征,提高聚类效果。

选择合适的聚类算法和参数

针对数据集的特点选择合适的聚类算法,并 调整算法参数以达到最佳聚类效果。

特征变换

通过降维或升维技术,将原始特征转换为更 有利于聚类的特征空间。

集成聚类

将多个聚类结果集成起来,得到更稳定和可 靠的聚类结果。

聚类结果的解释性

当前聚类算法往往缺乏对聚类结果的解释性,使 得用户难以理解聚类结果的含义。未来可以研究 如何提高聚类结果的解释性,使得聚类分析更加 易于理解和应用。

高维数据聚类

随着数据维度的增加,传统聚类算法可能会面临 “维数灾难”的问题。未来可以研究专门针对高 维数据的聚类算法,以提高聚类的准确性和效率 。

初始化

选择K个点作为初始聚类中心。

分配数据点

计算每个数据点与K个聚类中心 的距离,将其分配给最近的聚 类中心。

更新聚类中心

重新计算每个聚类的中心点, 即该类中所有数据点的均值。

迭代

重复分配数据点和更新聚类中 心的步骤,直到聚类中心不再 发生变化或达到最大迭代次数

。

层次聚类算法原理

01

02

03

04

初始化

将每个数据点视为一个独立的 簇。

合并簇

计算每对簇之间的距离,将距 离最近的两个簇合并为一个新

的簇。

更新距离

重新计算新簇与其余簇之间的 距离。

迭代

重复合并簇和更新距离的步骤 ,直到达到预设的簇数量或簇 之间的距离超过某个阈值。

DBSCAN算法原理

初始化

选择任意一个未访问过的数据点作为种子 点。

标记噪声点

数据准备

聚类分析获奖课件

二、常见旳相同性测度

(一)距离

设 xi xi1 , xi2 , , xip 和 xj (x ,j1 xj2 ,, xjp )

是第 i 和 j 个样品旳观察值,则两者之间旳距离

1

为:

明距离

dij ( p | xik x jk |q )q

k 1

欧氏距离

dij

(x x ) p

k 1

由此,我们旳问题是怎样来选择样品间相 同旳测度指标,怎样将有相同性旳类连接起来?

聚类分析根据一批样品旳许多观察指标,按照 一定旳规则详细地计算某些样品或某些参数(指标) 旳相同程度,把相同旳样品或指标归为一类,把 不相同旳归为一类。

例如对上市企业旳经营业绩进行分类;据经 济信息和市场行情,客观地对不同商品、不同顾 客及时地进行分类。又例如当我们对企业旳经济 效益进行评价时,建立了一种由多种指标构成旳 指标体系,因为信息旳重叠,某些指标之间存在 很强旳有关性,所以需要将相同旳指标聚为一类, 从而到达简化指标体系旳目旳。

2、 R2 统计量

总离差平方和旳分解

x11 x12 x1p

x21

x22

x2

p

xn1

xn 2

xnp

x1 x2

xp

总离差平方和 (x11 x1)2 (xn1 x1)2 (x1p xp )2 (xnp xp )2

假如着些样品被提成两类

x11 x12 x1p

x21

x22

x2

p

xn1

1

xn1 2

xn1

p

x x (1) (1)

1

2

x (1) p

x11

x21

xn2

1

x (2) 1

数据库中的空间数据聚类与分类

数据库中的空间数据聚类与分类随着科技的飞速发展,数据的产生速度不断增加。

其中,空间数据是指具有地理位置信息的数据,例如地图数据、卫星影像数据、人口分布数据等。

针对这些庞大的空间数据,数据库的存储和管理变得愈发重要。

数据库中的空间数据聚类与分类技术旨在将相似的空间数据归为一类,并将不同类别的数据区分开来。

通过对空间数据的聚类与分类,可以更好地理解和分析大规模的空间数据集。

首先,空间数据聚类是将具有相似特征的空间数据划分为不同的类别。

这些特征可以是距离、形状、颜色、密度等。

聚类算法是对空间数据进行分组的工具,采用基于距离的测量方法来评估数据点之间的相似度。

常见的聚类算法包括K-Means聚类、DBSCAN聚类和层次聚类等。

其中,K-Means聚类是最常用的算法之一,能够基于数据之间的距离进行快速有效的聚类。

在数据库中进行空间数据分类的目的是将聚类后的数据加以标签,便于后续的空间分析和查询。

分类过程中可以利用机器学习的方法,将空间数据分为不同的类别。

常见的分类算法有决策树、支持向量机和神经网络等。

这些算法能够从训练集中学习并预测未知空间数据的类别。

数据库中的空间数据聚类与分类技术可以应用于许多领域。

举例来说,地理信息系统(GIS)中的空间数据聚类与分类可以用于城市规划,通过对城市人口分布、交通流量等数据的聚类与分类,优化城市规划和交通策略。

在环境保护领域,利用卫星影像数据的聚类和分类技术,可以帮助划定生态保护区和监测森林覆盖率等。

此外,由于数据库中的空间数据聚类与分类技术具有高效、准确和可扩展等特点,它也成为大数据管理与分析的重要工具。

数据挖掘、商业智能和市场调研等领域都离不开对数据的聚类与分类。

通过对大规模空间数据进行聚类与分类,可以发现隐藏在数据背后的知识和关联,并帮助企业做出更明智的决策。

尽管空间数据聚类与分类技术在实际应用中具有广泛的潜力,但也存在一些挑战。

首先,空间数据的特点决定了传统聚类与分类算法的不适用性。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

空间聚类概念 空间聚类作为聚类分析的一个研究方向,是指将空间数据集中的对象分成由相似对象组成的类。同类中的对象间具有较高的相似度,而不同类中的对象间差异较大。作为一种无监督的学习方法,空间聚类不需要任何先验知识,比如预先定义的类或带类的标号等。由于空间聚类方法能根据空间对象的属性对空间对象进行分类划分,其已经被广泛应用在城市规划、环境监测、地震预报等领域,发挥着较大的作用。同时,空间聚类也一直都是空间数据挖掘研究领域中的一个重要研究分支。目前,己有许多文献资料提出了针对不同数据类型的多种空间聚类算法,一些著名的软件,如WEAK、SPSS、SAS等软件中已经集成了各种聚类分析软件包。 1 空间数据的复杂性 空间聚类分析的对象是空间数据。由于空间数据具有空间实体的位置、大小、形状、方位及几何拓扑关系等信息,使得空间数据的存储结构和表现形式比传统事务型数据更为复杂,空间数据的复杂特性表现: (1)空间属性间的非线性关系。由于空问数据中蕴含着复杂的拓扑关系,因此,空间属性间呈现出一种非线性关系。这种非线性关系不仅是空间数据挖掘中需要进一步研究的问题,也是空问聚类所面临的难点之一。 (2)空间数据的尺度特征。空间数据的尺度特征足指在不同的层次上,空间数据所表现出来的特征和规律都不尽相同。虽然在空间信息的概化和细化过程中可以利用此特征发现整体和局部的不同特点,但对空间聚类任务来说,实际上是增加了空间聚类的难度。 (3) 间信息的模糊性。空间信息的模糊性足指各种类型的窄问信息中,包含大量的模糊信息,如空问位置、 间关系的模糊性,这种特性最终会导致空间聚类结果的不确定性。 (4)空间数据的高维度。空问数据的高维度性是指空间数据的属性(包括空间属性和非空间属性)个数迅速增加,比如在遥感领域,获取的空间数据的维度已经快速增加到几十甚至上百个,这会给空间聚类的研究增加很大的困难。 2 空间聚类算法 目前,研究人员已经对空间聚类问题进行了较为深入的研究,提出了多种算法。根据空间聚类采用的不同思想,空间聚类算法主要可归纳为以下几种:基于划分的聚类算法、基于层次的聚类算法、基于密度的聚类算法、基于网格的聚类算法、基于模型的聚类算法以及其它形式的聚类算法,如图l所示。 (1)基于划分的聚类 基于划分的聚类方法是最早出现并被经常使用的经典聚类算法。其基本思想是:在给定的数据集随机抽取n个元组作为n个聚类的初始中心点,然后通过不断计算其它数据与这几个中心点的距离(比如欧几里得距离),将每个元组划分到其距离最近的分组中,从而完成聚类的划分。由于基于划分的聚类方法比较容易理解,且易实现,目前其已被广泛的弓l入到空间聚类中,用于空间数据的分类。其中最为常用的几种算法是:k一平均(k-means)算法、kl中心点(k—medoids)算法和EM(expectation maximization)算法。k一平均算法 ’使用每个聚类中所有对象的平均值作为该聚类的中心;k一中心点算法 I贝0选用簇中位置最中心的对象作为聚类中心;而EM算法“’则采用一个平均概率分布和一个d×d协方差矩阵来表示一个聚类。除上述3种算法外,也出现了众多的基于上述算法的变异算法,如基于选择的方法(CLARA)、基于随机搜索的方法(cLARANs)等。 (2)基于层次的聚类 基于层次的聚类方法就是将数据对象组成一棵聚类的树。根据层次的分解方向,分为凝聚法和分裂法。凝聚法最初假定数据集中的每个对象都为一个单独的类,然后通过不 断合并相近的对象,直到满足条件为止;分裂法同凝聚法的分解方向相反,其开始假设所有的对象都在一个类中,之后不断进行分裂,直到满足条件为止。由于一个类一旦分裂或凝聚就不能撤消,因此基于层次的算法的灵活性较差,故很少有纯粹的层次算法,层次方法往往和其它方法相结合进行聚类。代表性算法有:CURE算法、CHAMELEON算法。CURE(clustering using representatives)算法 是一种新颖的层次算法,它采取随机取样和划分相结合的方法:一个随机样本首先被划分,每个划分被局部聚类,最后把每个划分中产生的聚类结果用层次聚类的方法进行聚类。较好的解决了偏好球形和相似大小的问题,在处理孤立点时也更加健壮。CHAMELEON(hierarchical clustering using dynamic modeling)算法 的主要思想是首先使用图划分算法将数据对象聚类为大量相对较小的子类,其次使用凝聚的层次聚类算法反复地合并子类来找到真正的结果类。CHAMELEON算法是在CURE等算法的基础上改进而来,能够有效的解决CURE等算法的问题。 (3)基于密度的聚类 基于密度的聚类算法主要特点在于其使用区域密度作为划分聚类的依据,其认为只要数据空间区域的密度超过了预先定义的阀值,就将其添加到相近的聚类中。这种方法不同于各种各样基于距离的聚类算法,其优点在于能够发现任意形状的聚类,从而克服基于距离的方法只能发现类圆形聚类的缺点。代表性算法有:DBSCAN算法、OPTICS算法、DE—NCLUE算法等。DBSCAN(density based spatial clustering ofapplications withnoise)算法” 将聚类定义为基于密度可达性最大的密度相连对象的集合。聚类分析时,它必须输入参数£、MinPts,其中,£是给定对象的半径,MinPts是一个对象的£邻域内包含的最少对象数目。检查一个对象的£邻域的密度是否较大,即一定距离£内数据点的个数是否超过MinPts来确定是否建立一个以该对象为核心对象的新类,再合并密度可达类。尽管DBSCAN算法能对任意形状的数据集进行聚类。但它仍需要用户输入参数£和MinPts,而聚类结果对这两个参数的值又非常敏感。这事实上是将选择参数的任务留给了用户,而在实际中,用户很难准确确定合适的参数值,这往往导致聚类结果的偏差。因此,为了克服上述问题,人们提出了一种基于DBSCAN的改进算法OPTICS(ordering points to identify theclustering structure) 。OPTICS算法为自动和交互的聚类分析计算一个聚类次序,这个次序反映了数据基于密度的聚类结构,并且能够使用图形或其它可视化的方法表示。DENCLUE(density—basedclustering)算法 也是一种基于密度分布的聚类方法,概括了包括划分法、层次法等多种聚类方法,能够处理包含大量噪音的聚类,并且其执行效率要远远高于DBSCAN算法。 (4)基于网格的聚类基于网格的聚类主要思想是将空间区域划分若干个具有层次结构的矩形单元,不同层次的单元对应于不同的分辨率网格,把数据集中的所有数据都映射到不同的单元网格中,算法所有的处理都是以单个单元网格为对象,其处理速度要远比以元组为处理对象的效率要高的多。代表性算法有:STING算法、CLIQUE算法、WAVE.CLUSTER算法等。STING(statistical information gnd)算法“ 首先将空间区域划分为若干矩形单元,这些单元形成一个层次结构,每个高层单元被划分为多个低一层的单元。单元中预先计算并存储属性的统计信息,高层单元的统计信息可以通过底层单元计算获得。这种算法的优点是效率很高,而且层次结构有利于并行处理和增量更新;其缺点是聚类的边界全部是垂直或是水平的,与实际情况可能有比较大的差别,影响聚类的质量。WaveCluster(clustering using wavelet transformation)算法 “是一种采用小波变换的聚类方法。其首先使用多维数据网格结构汇总区域空间数据,用多维向量空间表示多维空间中的数据对象,然后使用小波变换方法对特征空间进行处理,发现特征空间中的稠密区域。最终通过多次小波变换,获得多分辨率的聚类。CLIQuE(clustefinginquest)算法“ 综合了基于密度和基于网格的聚类方法。其主要思想是将多维数据空间划分为多个矩形单元,通过计算每一个单元中数据点中全部数据点的比例的方法确定聚类。其优点是能够有效处理高维度的数据集,缺点是聚类的精度有可能会降低。 (5)基于模型的聚类 基于模型的聚类主要思想是假设数据集中的数据分布符合特定的数学模型,通过数学模型来发现聚类。主要有两种基于模型的方法:一种是统计学的方法,代表性算法是COB—WEB算法:另一种是神经网络的方法,代表性的算法是竞争学习算法。COBWEB算法m 是一种增量概念聚类算法。这种算法不同于传统的聚类方法,它的聚类过程分为两步:首先进行聚类,然后给出特征描述。因此,分类质量不再是单个对象的函数,而且也加入了对聚类结果的特征性描述。竞争学习算法” 属于神经网络聚类。它采用若干个单元的层次结构,以一种“胜者全取”的方式对系统当前所处理的对象进行竞争。 (6)其它方法的聚类 除了上述5种空间聚类算法外,研究人员根据空间聚类的要求,提出了多种结合其它思想的空间聚类方法。影响较大的有遗传空间聚类和带约束的空间聚类算法。其中,遗传空间聚类是模仿生物进化过程中的自然选择和进化机制,通过基因编码、遗传、变异和交叉等操作,来实现空间聚类的一种算法,是一种基于群体的全局随机优化算法:而带约束的空间聚类算法则是为了解决空间聚类中所面临的空间障碍问题而产生的,如城市中的河流、湖泊等障碍,各居民点并非沿直线,而是沿着一定的道路或网络到达簇中心等情况,如果在实际分析中不考虑这些障碍,获得的聚类结果必然与实际情况有较大的误差,而带约束的空间聚类正是解决上述问题的有效算法。 3 空间聚类质量评价方法 空间聚类作为聚类的一个研究分支,其过程是一个寻找最优划分的过程,即根据聚类终止条件不断对划分进行优化,最终得到最优解。由于空间聚类是一种无监督的学习方法,