医学统计学多元线性回归研

统计学中的线性回归模型与假设检验

统计学中的线性回归模型与假设检验统计学作为一门研究数据收集、分析和解释的学科,扮演着重要的角色。

其中,线性回归模型和假设检验是统计学中常用的方法。

本文将介绍线性回归模型的基本概念和应用,以及假设检验的原理和实际意义。

一、线性回归模型线性回归模型是一种用于描述两个或多个变量之间关系的统计模型。

它假设自变量和因变量之间存在线性关系,并通过最小化因变量与预测值之间的差异来估计回归系数。

在线性回归模型中,自变量通常表示为X,因变量表示为Y。

模型的基本形式可以表示为Y = β0 + β1X + ε,其中β0和β1是回归系数,ε是误差项。

回归系数表示自变量对因变量的影响程度,误差项表示模型无法解释的随机变动。

线性回归模型的应用非常广泛。

例如,在经济学中,可以使用线性回归模型来研究收入与消费之间的关系;在医学研究中,可以使用线性回归模型来分析药物剂量与治疗效果之间的关系。

通过对数据进行拟合和分析,线性回归模型可以帮助我们理解变量之间的关系,并进行预测和决策。

二、假设检验假设检验是一种统计推断方法,用于判断样本数据与某个假设之间是否存在显著差异。

在假设检验中,我们首先提出一个原假设(H0)和一个备择假设(H1),然后根据样本数据进行统计推断,判断是否拒绝原假设。

在假设检验中,我们通常使用一个统计量来衡量样本数据与原假设之间的差异。

常见的统计量包括t值、F值和卡方值等。

通过计算统计量的概率值(p值),我们可以判断样本数据是否支持原假设。

假设检验在科学研究和实际应用中具有重要意义。

例如,在药物研发中,可以使用假设检验来判断新药物是否比现有药物更有效;在市场营销中,可以使用假设检验来评估不同广告策略的效果。

通过假设检验,我们可以基于数据进行科学决策,提高研究和实践的可靠性。

三、线性回归模型与假设检验的关系线性回归模型和假设检验是统计学中紧密相关的方法。

在线性回归分析中,我们可以使用假设检验来评估回归系数的显著性。

在线性回归模型中,我们通常对回归系数进行假设检验,以确定自变量对因变量的影响是否显著。

线性回归计算方法及公式36页PPT

• 向前引入法(forward selection)

自变量由少到多一个一个引入回归方程。 将 corr(y , xj)最大而又能拒绝H0者,最 先引入方程,余此类推。至不能再拒绝 H0为止。

• 向后剔除法(backward selection)

自变量先全部选入方程,每次剔除一个使 上述检验最不能拒绝H0者,直到不能剔 除为止。

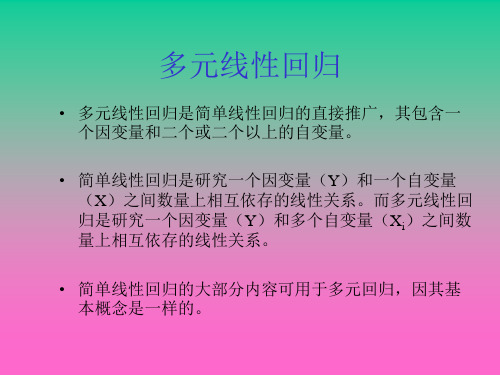

多元线性回归

• 多元线性回归是简单线性回归的直接推广,其包含一 个因变量和二个或二个以上的自变量。

• 简单线性回归是研究一个因变量(Y)和一个自变量 (X)之间数量上相互依存的线性关系。而多元线性回 归是研究一个因变量(Y)和多个自变量(Xi)之间数 量上相互依存的线性关系。

• 简单线性回归的大部分内容可用于多元回归,因其基 本概念是一样的。

y =B0+B1x1+B2x2+…+Bp xp+ (模型)

B0、B1、B2和Bp为待估参数, 为残差。 • 由一组样本数据,可求出等估参数的估计值b0、b1、b2

和bp,,得到如下回归方程:

ŷi =b0+b1x1+b2x2+…+bp xp

• 由此可见,建立回归方程的过程就是对回归模型中的 参数(常数项和偏回归系数)进行估计的过程。

回归方程中自变量的选择

• 多元线性回归方程中并非自变量越多越 好,原因是自变量越多剩余标准差可能 变大;同时也增加收集资料的难度。故 需寻求“最佳”回归方程,逐步回归分 析是寻求“较佳”回归方程的一种方法。

选择变量的统计学标准

• R2最大

R2 = SS回归/ SS总

• adjR2最大: adjR2=1-MS误差/ MS总

线性相关与回归(简单线性相关与回归、多重线性回归、Spearman等级相关)

4.剔除强影响点(Influential cases;或称为突出点, outliers)

通过标准化残差(Standardized Residuals)、学生氏残 差(Studentlized Residuals)来判断强影响点 。当指标 的绝对值大于3时,可以认为样本存在强影响点。

删除强影响点应该慎重,需要结合专业知识。以下两种情 况可以考虑删除强影响点:1.强影响点是由于数据记录错 误造成的;2.强影响点来自不同的总体。

r r t sr 1 r2 n2

只有当0时,才能根据|r|的大小判断相关 的密切程度。

4.相关与回归的区别和联系 (1)相关与回归的意义不同 相关表达两个变量 之间相互关系的密切程度和方向。回归表达两个变 量之间的数量关系,已知X值可以预测Y值。从散点 图上,散点围绕回归直线的分布越密集,则两变量 相关系数越大;回归直线的斜率越大,则回归系数 越大。 (2)r与b的符号一致 同正同负。

5.自变量之间不应存在共线性(Collinear)

当一个(或几个)自变量可以由其他自变量线性表示时,称 该自变量与其他自变量间存在共线性关系。常见于:1.一个 变量是由其他变量派生出来的,如:BMI由身高和体重计算 得出 ;2.一个变量与其他变量存在很强的相关性。 当自变量之间存在共线性时,会使回归系数的估计不确定、 预测值的精度降低以及对y有影响的重要自变量不能选入模 型。

P值

截距a 回归系数b sb 标准化回归系数 t值 P值

3.直线回归的预测及置信区间估计

给定X=X0, 预测Y

3.直线回归的预测及置信区间估计

因变量

自变量

保存(产生新变量,保 存在当前数据库) 统计

3.直线回归的预测及置信区间估计

医学统计学知识点汇总(精华)

医学统计学知识点汇总(精华)一.概论1,医学统计学:运用概率论和数理统计学的原理和方法,研究医学领域中随机现象有关数据的搜集、整理、分析和推断,进而阐明其客观规律性的一门应用科学。

2,医学统计学的主要内容:1)统计研究设计调查研究设计和实验研究设计2)医学统计学的基本原理和方法研究设计和数据处理中的基本统计理论和方法。

A:资料的搜集与整理 B:常用统计描述,集中趋势和离散趋势,相对数,相关系数,回归系数,统计表,统计图 C:统计推断,如参数估计和假设检验。

3)医学多元统计方法多元线性回归和逐步回归分析、判别分析、聚类分析、主成分分析、因子分析、logistic回归与Cox回归分析。

3,统计工作步骤:1)设计明确研究目的和研究假说,确定观察对象与观察单位,样本含量和抽样方法,拟定研究方案,预期分析指标,误差控制措施,进度与费用。

2)搜集材料A,搜集材料的原则及时、准确、完整B,统计资料的来源医学领域的统计资料的来源主要有三个方面。

一是统计报表,二是经常性工作记录,三是专题调查或专题实验。

C,资料贮存3)整理资料 a检查核对b设计分组c拟定整理表d归表4)分析资料统计分析包括统计描述和统计推断4,同质(homogeneity):指被研究指标的影响因素相同。

变异(variation):同质基础上的各观察单位间的差异。

变量(variable):收集资料过程中,根据研究目的确定同质观察单位,再对每个观察单位的某项特征进行测量或观察,这种特征称为变量变量值:变量的观察结果或测量值。

变量类型变量值表现实例资料类型数值变量离散型定量测量值,有计量单位产前检查次数计量资料连续型身高分类变量无序二分类对立的两类属性性别(男女)计数资料多分类不相容的多类属性血型(A,B,O,AB)有序多分类类间有程度差异的属性受教育程度(小学,中学,高中,大学…)等级资料5,总体(population)根据研究目的所确定的同质研究对象中所有观察单位某变量值的集合。

回归分析法概念及原理

回归分析法概念及原理回归分析是一种统计学方法,用于研究两个或多个变量之间的关系。

它的主要目的是通过建立一个数学模型来预测一个或多个自变量对因变量的影响。

回归分析可以用来解答诸如“给定一组自变量的值,可以预测因变量的值吗?”或者“自变量之间是否存在一种关系,可以用来解释因变量的变化?”等问题。

回归分析的原理基于最小二乘法。

根据最小二乘法,我们希望建立一个模型,使得模型预测值与真实观测值之间的残差最小。

回归分析可以分为简单线性回归和多元线性回归两种类型。

简单线性回归是指只有一个自变量和一个因变量的回归分析。

在简单线性回归中,我们假设自变量和因变量之间存在一种线性关系。

简单线性回归可以用下面的方程表示:Y=β0+β1*X+ε,其中Y是因变量,X是自变量,β0和β1是回归系数,ε是误差项。

多元线性回归是指有两个或更多个自变量和一个因变量的回归分析。

与简单线性回归类似,多元线性回归的目的是建立一个数学模型来预测因变量。

多元线性回归可以用下面的方程表示:Y=β0+β1*X1+β2*X2+...+βn*Xn+ε,其中Y是因变量,X1到Xn是自变量,β0到βn是回归系数,ε是误差项。

回归分析的关键步骤包括模型建立、估计参数、模型检验和模型应用。

在模型建立阶段,我们选择适当的自变量和函数形式,并根据给定的数据集拟合回归模型。

在估计参数阶段,我们计算回归系数的估计值。

常用的估计方法有最小二乘法、最大似然估计法等。

在模型检验阶段,我们通过假设检验、方差分析等方法来评估模型的拟合程度和回归系数的显著性。

在模型应用阶段,我们根据模型来进行预测或推断。

除了简单线性回归和多元线性回归,还有其他类型的回归分析方法,如非线性回归、广义线性回归、岭回归等。

这些方法可以用来解决不同类型的问题,如非线性关系、离散因变量、多重共线性等。

回归分析在许多领域中被广泛应用。

例如,在经济学中,回归分析可以用来研究经济变量之间的关系,预测未来的经济趋势;在医学中,回归分析可以用来研究疾病发生的风险因素,预测患者的生存率;在市场营销中,回归分析可以用来研究产品销售量和广告投入之间的关系,制定市场营销策略。

线性回归计算方法及公式(共31张PPT)

Logistic回归的参数估计

• Logistic回归模型的参数估计常用最大似然法,最大似然法 的基本思想是先建立似然函数或对数似然函数,似然函数 或对数似然函数达到极大时参数的取值,即为参数的最大 似然估计值。其步骤为对对数似然函数中的待估参数分别 求一阶偏导数,令其为0得一方程组,然后求解。由于似然 函数的偏导数为非线性函数,参数估计需用非线性方程组 的数值法求解。常用的数值法为Newton-Raphson法。不同 研究的设计方案不同,其似然函数的构造略有差别,故 Logistic回归有非条件Logistic回归与条件Logistic回归两种。

记Logit(P)=ln[p/(1-p)],则上式可表示为:

Logit(P) = Bo+BX

这里X的取值仍是任意的, Logit(P)的值亦 在正负无穷大之间,概率P的数值则必然在 0-1之间。 p/(1-p)为事件的优势, Logit(P)为对数优势,故logistic回归又称对 数优势线性回归

一般地,设某事件D发生(D=1)的概 率P依赖于多个自变量(x1,x2, …,xp),且

y =B0+B1x1+B2x2+…+Bp xp+ (模型)

B0、B1、B2和Bp为待估参数, 为残差。 • 由一组样本数据,可求出等估参数的估计值b0、b1、b2和bp,

,得到如下回归方程:

ŷi =b0+b1x1+b2x2+…+bp xp

• 由此可见,建立回归方程的过程就是对回归模型中的参数 (常数项和偏回归系数)进行估计的过程。

• 逐步引入-剔除法(stepwise selection)

医学统计学简答题

1、正态分布的特点及其应用性质:①以均数为中心,两头低中间高,左右完全对称的钟型曲线;②只有一个高峰,在X=μ,总体中位数亦为μ;③μ为位置参数,当σ恒定时,μ越大,曲线沿横轴越向右移动;σ为形态参数,当μ恒定时,σ越大,表示数据越分散,曲线越矮胖,反之,曲线越瘦高;④对于任何服从正态分布N(μ,σ2)的随机变量X作的线性变换,都会变换成u服从于均数为0,方差为1的正态分布,即标准正态分布;⑤正态分布在μ±1σ处各有一个拐点;⑥正态曲线下的面积分布有一定的规律:X轴与正态曲线所夹面积恒为1;区间μ±σ的面积为68.27%,区间μ±1.96σ的面积为95.00%,区间μ±2.58σ的面积为99.00%。

应用:①概括估计变量值的频数分布;②制定参考值范围;③质量控制;④是许多统计方法的理论基础。

2、确定参考值范围的一般原则和步骤、方法一般原则和步骤:①抽取足够例数的正常人样本作为观察对象;②对选定的正常人进行准确而统一的测定,以控制系统误差;③判断是否需要分组测定;④决定取单侧范围值还是双侧范围值;⑤选定适当的百分范围;⑥选用适当的计算方法来确定或估计界值。

方法:①正态分布法:②百分位数法(偏态分布):3、标准差与标准误的区别与联系区别:含义:标准差反映观察值在个体中的变异大小,标准差越大,变量值越分散。

标准误是指样本统计量的标准差,反映来自同一总体的样本统计量的离散程度以及样本统计量与总体参数的差异程度,即抽样误差的大小。

计算方法:标准差:总体标准差:样本标准差:标准误:均数的标准误:率的标准误:用途:标准差①用于对称分布,特别是正态分布资料,表示观察值分布的离散程度②结合均数,描述正态分布的特征、估计参考值范围③结合样本统计量,计算均数标准误④计算变异系数⑤反映均数的代表性标准误①衡量样本均数的可靠性②估计总体均数的可信区间③用于均数的假设检验与n的关系:随着n增加,样本标准差稳定于总体标准差;随着n增加,样本标准误减少并趋于0。

回归分析方法

回归分析方法回归分析是一种统计学方法,用于研究自变量与因变量之间的关系。

它可以帮助我们理解变量之间的相互影响,并预测未来的趋势。

在实际应用中,回归分析方法被广泛运用于经济学、社会学、医学等领域,成为了一种重要的分析工具。

在进行回归分析时,首先需要确定自变量和因变量。

自变量是我们希望用来预测或解释因变量的变量,而因变量则是我们希望了解其变化情况的变量。

在确定了自变量和因变量之后,我们需要收集数据,并进行回归模型的建立和检验。

回归分析方法有多种形式,其中线性回归是最为常见的一种。

线性回归假设自变量与因变量之间存在线性关系,通过最小二乘法来拟合数据,得到最佳拟合直线或平面。

除了线性回归外,还有非线性回归、多元回归等不同形式的回归分析方法,可以根据实际情况选择合适的模型进行分析。

在进行回归分析时,我们需要关注一些重要的指标,如回归系数、残差、拟合优度等。

回归系数可以告诉我们自变量对因变量的影响程度,残差则可以帮助我们检验模型的拟合程度,而拟合优度则可以告诉我们模型对数据的解释能力如何。

这些指标可以帮助我们判断回归模型的有效性,从而做出合理的结论和预测。

除了以上提到的内容,回归分析方法还有一些需要注意的问题。

首先,我们需要注意自变量之间的多重共线性问题,避免自变量之间存在高度相关性,影响回归模型的稳定性和准确性。

其次,我们需要注意残差的独立性和正态性,以确保回归模型的有效性和可靠性。

最后,我们还需要注意回归模型的适用范围和局限性,避免在不适当的情况下进行过度解释和预测。

总的来说,回归分析方法是一种重要的统计学工具,可以帮助我们理解变量之间的关系,并进行有效的预测和决策。

在实际应用中,我们需要根据具体情况选择合适的回归模型,并注意回归分析中的一些关键问题,以确保分析结果的准确性和可靠性。

希望本文对回归分析方法有所帮助,谢谢阅读!。

多元线性回归与BP神经网络预测模型对比与运用研究

多元线性回归与BP神经网络预测模型对比与运用研究一、本文概述本文旨在探讨多元线性回归模型与BP(反向传播)神经网络预测模型在数据分析与预测任务中的对比与运用。

我们将首先概述这两种模型的基本原理和特性,然后分析它们在处理不同数据集时的性能表现。

通过实例研究,我们将详细比较这两种模型在预测准确性、稳健性、模型可解释性以及计算效率等方面的优缺点。

多元线性回归模型是一种基于最小二乘法的统计模型,通过构建自变量与因变量之间的线性关系进行预测。

它假设数据之间的关系是线性的,并且误差项独立同分布。

这种模型易于理解和解释,但其预测能力受限于线性假设的合理性。

BP神经网络预测模型则是一种基于神经网络的非线性预测模型,它通过模拟人脑神经元的连接方式构建复杂的网络结构,从而能够处理非线性关系。

BP神经网络在数据拟合和预测方面具有强大的能力,但模型的结构和参数设置通常需要更多的经验和调整。

本文将通过实际数据集的应用,展示这两种模型在不同场景下的表现,并探讨如何结合它们各自的优势来提高预测精度和模型的实用性。

我们还将讨论这两种模型在实际应用中可能遇到的挑战,包括数据预处理、模型选择、超参数调整以及模型评估等问题。

通过本文的研究,我们期望为数据分析和预测领域的实践者提供有关多元线性回归和BP神经网络预测模型选择和应用的有益参考。

二、多元线性回归模型多元线性回归模型是一种经典的统计预测方法,它通过构建自变量与因变量之间的线性关系,来预测因变量的取值。

在多元线性回归模型中,自变量通常表示为多个特征,每个特征都对因变量有一定的影响。

多元线性回归模型的基本原理是,通过最小化预测值与真实值之间的误差平方和,来求解模型中的参数。

这些参数代表了各自变量对因变量的影响程度。

在求解过程中,通常使用最小二乘法进行参数估计,这种方法可以确保预测误差的平方和最小。

多元线性回归模型的优点在于其简单易懂,参数估计方法成熟稳定,且易于实现。

多元线性回归还可以提供自变量对因变量的影响方向和大小,具有一定的解释性。

第15-17章 多因素分析(统计学)

Sig. .047 .701 .099 .036 .016

Y ˆ 5 .9 0 4 .1X 3 1 4 0 .3 2 X 2 5 0 .2 1 X 3 7 0 .6 1 X 4 38

.

12

2、回归方程的假设检验——F检验

结果无显著性 1)表明所观察的自变量与应变量不存在线性回归关系; 2)也可能由于样本例数过少;

总胆固醇 甘油三脂 胰岛素

糖化血

血糖

(mmol/L) X1 5.68 3.79 6.02 … 5.84 3.84

(mmol/L) X2 1.90 1.64 3.56 … 0.92 1.20

(μU/ml)

X3 4.53 7.32 6.95 … 8.61 6.45

红蛋白(%) X4 8.2 6.9 10.8 … 6.4 9.6

.

7

.

8

多元线性回归除具有直线回归的基本性质外,还具有

以下特点(用途):

(1)因素筛选:(因素分析)

例如影响高血压的诸多因素中:

1)哪些是主要因素?

2)各因素的作用大小?

(2)提高回归方程的估计精度

多元回归比只有一个自变量的简单直线回归更

能缩小应变量Y对其估计值的离差,在预测和统计 控制方面应用的效果更好。

多因素分析

温州医学院环境与公共卫生学院 叶晓蕾

.

1

概念 多因素分析是同时对观察对象的两个或两个以上

的变量进行分析。 常用的统计分析方法有:

多元线性回归、Logistic回归、COX比例风险回归 模型、因子分析、主成分分析,等。

.

2

多变量资料数据格式

例号 X1

X2

…

Xp

Y

1