matlab回归分析

用MATLAB求解回归分析

估

F值、与F对应的概率p

计

相关系数 r2 越接近 1,说明回归方程越显著;

.

(

缺

省显

时著

为性

0

水 平

05

)

F > F1-α(k,n-k-1)时拒绝 H0,F 越大,说明回归方程越显著;

与 F 对应的概率 p 时拒绝 H0,回归模型成立.

3、画出残差及其置信区间: rcoplot(r,rint)

例1 解:1、输入数据:

stats = 0.9702 40.6656

0.0005

1、回归:

非线性回 归

是事先用m-文件定 义的非线性函数

(1)确定回归系数的命令: [beta,r,J]=nlinfit(x,y,’model’, beta0)

估计出的 回归系数

残差 Jacobian矩阵

输入数据x、y分别为 n m矩阵和n维列向 量,对一元非线性回 归,x为n维列向量。

r2=0.9282, F=180.9531, p=0.0000

p<0.05, 可知回归模型 y=-16.073+0.7194x 成立.

3、残差分析,作残差图: rcoplot(r,rint)

从残差图可以看出,除第二个数据外,其余数据的残

差离零点均较近,且残差的置信区间均包含零点,这说明 回归模型 y=-16.073+0.7194x能较好的符合原始数据,而第 二个数据可视为异常点.

2、预测和预测误差估计:

(1)Y=polyval(p,x)求polyfit所得的回归多项式在 x处 的预测值Y; (2)[Y,DELTA]=polyconf(p,x,S,alpha)求 polyfit所得的回归多项式在x处的预测值Y及预测值的 显著性为 1-alpha的置信区间Y DELTA;alpha缺省时为0.5

第15讲 MATLAB 多元线性回归分析

变量 Y 线性依赖于某个变量 X i ;若检验的结果是 接受 H 0 ,则说明所有变量 X 1 , X 2 ,..., X p 对变量的线性 关系是不重要的。

本章目录

16

回 归 分析

2 线性回归

—多元线性回归

2.3 回归方程的假设检验—模型的检验

x i (1, xi1 ,...,xip )

例

本章目录

22

i 1,2,...,n

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

自变量的选择

本章目录

23

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

提

选择自变量的准则 选择自变量进入回归模型的方法

纲

(SAS实例)

本章目录

24

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

1. 引言

因变量

y 自变量为 x , x ,, x

1 2

p

满足线性关系

p

y x x e

0 1 1 p

(I)

对 x1 , x2 ,, x p y 进行 n 次观测, 所得的 n 组数据为

xi1 , xi 2 ,, xip, (i 1,2,, n)

它们均满足(I)式

25

本章目录

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

matlab多个因变量回归

matlab多个因变量回归Matlab是一种强大的科学计算软件,可以用于多个因变量回归分析。

多个因变量回归分析是一种统计方法,用于探究多个自变量对多个因变量的影响关系。

在本文中,将介绍如何使用Matlab进行多个因变量回归分析,并解释结果的含义。

我们需要准备一组数据,包括多个自变量和多个因变量。

假设我们想要研究一辆汽车的油耗情况,可能的自变量包括车速、引擎排量、重量等,而因变量则是油耗量和二氧化碳排放量。

在Matlab中,可以使用regress函数进行多个因变量回归分析。

该函数的语法如下:```[b,bint,r,rint,stats] = regress(y,X)```其中,y是因变量矩阵,每一列代表一个因变量;X是自变量矩阵,每一列代表一个自变量。

函数的输出包括回归系数b、回归系数的置信区间bint、残差r、残差的置信区间rint以及回归统计信息stats。

接下来,我们将使用一个具体的例子来说明多个因变量回归分析在Matlab中的应用。

假设我们有一组数据,包括100辆汽车的车速、引擎排量、重量以及油耗量和二氧化碳排放量。

我们的目标是探究车速、引擎排量和重量对油耗量和二氧化碳排放量的影响。

我们需要加载数据并将自变量和因变量分别存储在矩阵X和矩阵y 中。

假设数据存储在一个名为"car_data.csv"的文件中,我们可以使用readmatrix函数来读取数据:```data = readmatrix('car_data.csv');X = data(:, 1:3); % 车速、引擎排量、重量y = data(:, 4:5); % 油耗量和二氧化碳排放量```接下来,我们可以使用regress函数进行多个因变量回归分析,并获取回归系数、残差等信息:```[b,bint,r,rint,stats] = regress(y, X);```回归系数b代表了自变量对因变量的影响程度。

利用MATLAB进行回归分析

利用MATLAB进行回归分析一、实验目的:1.了解回归分析的基本原理,掌握MATLAB实现的方法;2. 练习用回归分析解决实际问题。

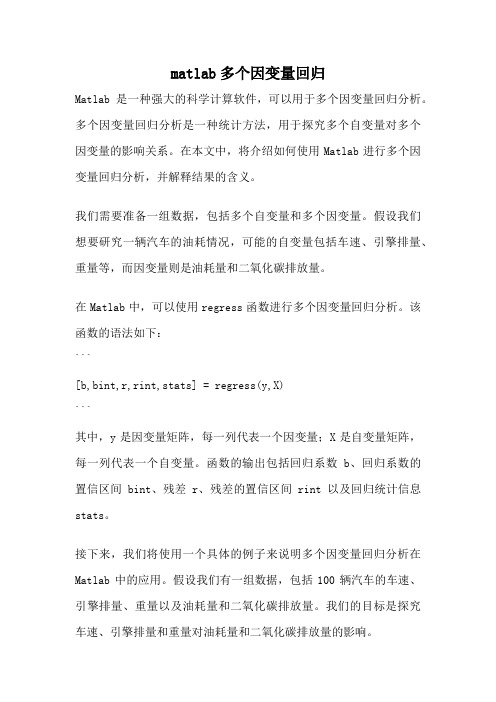

二、实验内容:题目1社会学家认为犯罪与收入低、失业及人口规模有关,对20个城市的犯罪率y(每10万人中犯罪的人数)与年收入低于5000美元家庭的百分比1x、失业率2x和人口总数3x(千人)进行了调查,结果如下表。

(1)若1x~3x中至多只许选择2个变量,最好的模型是什么?(2)包含3个自变量的模型比上面的模型好吗?确定最终模型。

(3)对最终模型观察残差,有无异常点,若有,剔除后如何。

理论分析与程序设计:为了能够有一个较直观的认识,我们可以先分别作出犯罪率y与年收入低于5000美元家庭的百分比1x、失业率2x和人口总数x(千人)之间关系的散点图,根据大致分布粗略估计各因素造3成的影响大小,再通过逐步回归法确定应该选择哪几个自变量作为模型。

编写程序如下:clc;clear all;y=[11.2 13.4 40.7 5.3 24.8 12.7 20.9 35.7 8.7 9.6 14.5 26.9 15.736.2 18.1 28.9 14.9 25.8 21.7 25.7];%犯罪率(人/十万人)x1=[16.5 20.5 26.3 16.5 19.2 16.5 20.2 21.3 17.2 14.3 18.1 23.1 19.124.7 18.6 24.9 17.9 22.4 20.2 16.9];%低收入家庭百分比x2=[6.2 6.4 9.3 5.3 7.3 5.9 6.4 7.6 4.9 6.4 6.0 7.4 5.8 8.6 6.5 8.36.7 8.6 8.4 6.7];%失业率x3=[587 643 635 692 1248 643 1964 1531 713 749 7895 762 2793 741 625 854 716 921 595 3353];%总人口数(千人)figure(1),plot(x1,y,'*');figure(2),plot(x2,y,'*');figure(3),plot(x3,y,'*');X1=[x1',x2',x3'];stepwise(X1,y)运行结果与结论:犯罪率与低收入散点图犯罪率与失业率散点图犯罪率与人口总数散点图低收入与失业率作为自变量低收入与人口总数作为自变量失业率与人口总数作为自变量在图中可以明显看出前两图的线性程度很好,而第三个图的线性程度较差,从这个角度来说我们应该以失业率和低收入为自变量建立模型。

MATLAB回归分析

MATLAB回归分析回归分析是统计学中常用的一种方法,用于建立一个依赖于自变量(独立变量)的因变量(依赖变量)的关系模型。

在MATLAB环境下,回归分析可以实现简单线性回归、多元线性回归以及非线性回归等。

简单线性回归是一种最简单的回归分析方法,它假设自变量和因变量之间存在线性关系。

在MATLAB中,可以通过`polyfit`函数进行简单线性回归分析。

该函数可以拟合一元数据点集和一维多项式,返回回归系数和截距。

例如:```matlabx=[1,2,3,4,5];y=[2,3,4,5,6];p = polyfit(x, y, 1);slope = p(1);intercept = p(2);```上述代码中,`x`是自变量的数据点,`y`是因变量的数据点。

函数`polyfit`的第三个参数指定了回归的阶数,这里是1,即一次线性回归。

返回的`p(1)`和`p(2)`分别是回归系数和截距。

返回的`p`可以通过`polyval`函数进行预测。

例如:```matlabx_new = 6;y_pred = polyval(p, x_new);```多元线性回归是在有多个自变量的情况下进行的回归分析。

在MATLAB中,可以使用`fitlm`函数进行多元线性回归分析。

例如:```matlabx1=[1,2,3,4,5];x2=[2,4,6,8,10];y=[2,5,7,8,10];X=[x1',x2'];model = fitlm(X, y);coefficients = model.Coefficients.Estimate;```上述代码中,`x1`和`x2`是两个自变量的数据点,`y`是因变量的数据点。

通过将两个自变量放在`X`矩阵中,可以利用`fitlm`函数进行多元线性回归分析。

返回值`model`是回归模型对象,可以通过`model.Coefficients.Estimate`获得回归系数。

Matlab统计回归详解

统计回归一、一元线性回归回归分析中最简单的形式是x y 10ββ+=,y x ,均为标量,10,ββ为回归系数,称一元线性回归。

这里不多做介绍,在线性回归中以介绍多元线性回归分析为主。

二、多元线性回归(regress )多元线性回归是由一元线性回归推广而来的,把x 自然推广为多元变量。

m m x x y βββ+++= 110 (1)2≥m ,或者更一般地)()(110x f x f y m m βββ+++= (2)其中),,(1m x x x =,),,1(m j f j =是已知函数。

这里y 对回归系数),,,(10m ββββ =是线性的,称为多元线性回归。

不难看出,对自变量x 作变量代换,就可将(2)化为(1)的形式,所以下面以(1)为多元线性回归的标准型。

1.1 模型在回归分析中自变量),,,(21m x x x x =是影响因变量y 的主要因素,是人们能控制或能观察的,而y 还受到随机因素的干扰,可以合理地假设这种干扰服从零均值的正态分布,于是模型记作⎩⎨⎧++++=),0(~2110σεεβββN x x y m m (3) 其中σ未知。

现得到n 个独立观测数据),,,(1im i i x x y ,m n n i >=,,,1 ,由(3)得⎩⎨⎧=++++=ni N x x y i i im m i i ,,1),,0(~2110 σεεβββ (4) 记⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=nm n m x x x x X 111111, ⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=n y y Y 1 (5) T n ][1εεε =,T m ][10ββββ =(4)表示为 ⎩⎨⎧+=),0(~2σεεβN X Y (6) 1.2 参数估计用最小二乘法估计模型(3)中的参数β。

由(4)式这组数据的误差平方和为∑=--==ni T i X Y X Y Q 12)()()(ββεβ (7)求β使)(βQ 最小,得到β的最小二乘估计,记作βˆ,可以推出 Y X X X T T 1)(ˆ-=β(8) 将βˆ代回原模型得到y 的估计值mm x x y βββˆˆˆˆ110+++= (9) 而这组数据的拟合值为βˆˆX Y =,拟合误差Y Y e ˆ-=称为残差,可作为随机误差ε的估计,而∑∑==-==n i ni i i iy y e Q 1122)ˆ( (10) 为残差平方和(或剩余平方和),即)ˆ(βQ 。

matlab回归分析

1、 regress命令用于一元及多元线性回归,本质上是最小二乘法。

在Matlab 2014a中,输入help regress ,会弹出和regress的相关信息,一一整理。

调用格式:B = regress(Y,X)[B,BINT] = regress(Y,X)[B,BINT,R] = regress(Y,X)[B,BINT,R,RINT] = regress(Y,X)B,BINT,R,RINT,STATS] = regress(Y,X)[...] = regress(Y,X,ALPHA)参数解释:B:回归系数,是个向量(“the vector B of regression coefficients in the linear model Y = X*B”)。

BINT:回归系数的区间估计(“a matrix BINT of 95% confidence intervals for B”)。

R:残差(“a vector R of residuals”)。

RINT:置信区间(“a matrix RINT of intervals that can be used to diagnose outliers”)。

STATS:用于检验回归模型的统计量。

有4个数值:●判定系数R^2: 指回归直线对观测值的拟合程度。

R^2的取值范围是[0,1]。

R^2的值越接近1,说明回归直线对观测值的拟合程度越好;反之,R^2的值越接近0,说明回归直线对观测值的拟合程度越差。

●F统计量观测值: F值越大通过检验的可能性就越大F值表示回归模型的方差与残差的比值(残差就是总方差减去回归模型的方差),可以想象F越大表示残差越小,模拟的精度越高(从方差方面考虑).不过只要F的值大于你所需要的显著性检验的临界值就可以了.●检验的p的值: 就是当原假设为真时所得到的样本观察结果或更极端结果出现的概率。

如果P值很小,说明原假设情况的发生的概率很小,而如果出现了,根据小概率原理,我们就有理由拒绝原假设,P值越小,我们拒绝原假设的理由越充分。

Matlab中的样本分类和回归分析技巧

Matlab中的样本分类和回归分析技巧引言:在现代科学和工程领域中,对于数据的分类和回归分析是非常重要的技能。

Matlab作为一种功能强大的数值计算和编程环境,提供了丰富的工具和函数来处理这些任务。

本文将介绍Matlab中常用的样本分类和回归分析技巧,帮助读者更好地应用这些方法。

一、数据预处理与可视化在进行样本分类和回归分析之前,首先需要对数据进行预处理和可视化。

Matlab中提供了一些实用的函数和工具箱来处理这些任务。

例如,可以使用importdata函数导入各种格式的数据文件,并使用preprocessing工具箱进行数据清洗,例如去除异常值或缺失数据。

此外,Matlab还提供了强大的绘图功能,可以使用plot和scatter函数绘制数据的散点图、箱线图和直方图,以便更好地理解数据的分布和特征。

二、特征选择与提取在样本分类和回归分析中,选择合适的特征对于模型的性能至关重要。

在Matlab中,可以使用特征选择算法来从原始数据中选择最相关的特征。

Matlab提供了一些功能强大的特征选择工具箱,例如ReliefF、Lasso和稀疏正则化算法等。

此外,Matlab还提供了一些特征提取算法,例如主成分分析(PCA)和独立成分分析(ICA),可以从原始数据中提取出最重要的特征。

三、样本分类算法Matlab中提供了许多常用的样本分类算法,包括支持向量机(SVM)、K最近邻(K-Nearest Neighbors,KNN)和决策树等。

这些算法在Matlab中都有相应的函数和工具箱,可以方便地进行模型训练和测试。

例如,使用fitcsvm函数可以训练支持向量机模型,并使用predict函数对新样本进行分类。

在选择分类算法时,需要根据数据的属性和目标来选择合适的算法,并使用交叉验证等方法评估模型的性能。

四、回归分析算法与样本分类类似,Matlab中也提供了多种用于回归分析的算法,例如线性回归、岭回归和支持向量回归等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

回归分析

一元线性回归 数 学 模 型 及 定 义

2010-11-19

多元线性回归 性 回 归 (曲 线 回 归 ) 可 线 性 化 的 一 元 非 线 数 学 模 型 及 定 义 检 验 与 预 测

模 型 参 数 估 计

模 型 参 数 估 计

多 元 线 性 回 归 中 的

逐 步 回 归 分 析

*

* * * *

ˆ

y = 11.6789e

1.1107 − x

16

一、数学模型及定义

一般称

Y = Xβ + ε 2 E (ε ) = 0, COV (ε , ε ) = σ I n

为高斯—马尔柯夫线性模型(k 元线性回归模型 k 元线性回归模型),并简记为 (Y , Xβ , σ 2 I n )

y1 1 x11 ... 1 x 21 Y = ,X = ... ... ... yn 1 x n1

以身高x为横坐标,以腿长y为纵坐标将这些数据点(xI,yi) 在平面直角坐标系上标出.

102 100 98 96 94 92 90 88 86 84 140 145 150 155 160 165

解答

y = β 0 + β1 x + ε

2010-11-19

散点图

4

一般地,称由 y = β 0 + β1 x + ε 确定的模型为一元线性回归模型 一元线性回归模型, 一元线性回归模型 记为

y 0 的置信水平为 1 − α 的预测区间 预测区间为 预测区间 ˆ ˆ [ y0 − δ ( x0 ), y 0 + δ ( x0 )]

1 (x0 − x ) ˆ 其中 δ ( x 0 ) = σ e t α ( n − 2) 1 + + 1− n L xx 2

2

特 别 , 当 n 很 大 且 x0 在 x 附 近 取 值 时 , y 的 置 信 水 平 为 1 − α 的预 测 区 间 近 似 为

β 0 和 β 1 置信水平为 1-α 的置信区间分别为

1 x2 ˆ 1 x2 ˆ ˆ ˆ , β 0 + t α (n − 2)σ e + + β 0 − t α (n − 2)σ e 1− 1− n Lxx n L xx 2 2

ˆ ˆ + t (n − 2)σ / L ˆ ˆe 和 β 1 − t α ( n − 2)σ e / L xx , β 1 α xx 1− 1− 2 2

y = β 0 + β1 x + ε Eε = 0, Dε = σ 2

固定的未知参数 β 0 、 β1 称为回归系数,自变量 x 也称为回归变量.

Y = β 0 + β 1 x ,称为 y 对 x 的回归直线方程.

一元线性回归分析的主要任务 主要任务是: 主要任务

1、用试验值(样本值)对 β 0 、 β 1 和 σ 作点估计; 2、对回归系数 β 0 、 β 1 作假设检验; 3、在 x= x 0 处对 y 作预测,对 y 作区间估计.

ˆ ˆ ˆ ˆ y − σ e u 1− α , y + σ e u 1− α 2 2

2010-11-19 12

(2)控制 )

要求: y =

β 0 + β 1 x + ε 的值以 1 − α 的概率落在指定区间 ( y ′, y ′′)

ˆ ˆ y − δ ( x) ≥ y ′, y + δ ( x) ≤ y ′′ ˆ ˆ 要求 y ′′ − y ′ ≥ 2δ ( x ) . 若 y − δ ( x ) = y ′, y − δ ( x ) = y ′′ 分别有解 x′ ˆ ˆ 和 x ′′ ,即 y − δ ( x ′) = y ′, y + δ ( x ′′) = y ′′ . 则 ( x ′, x ′′) 就是所求的 x 的控制区间.

返回

2010-11-19 13

只要控制 x 满足以下两个不等式

四、可线性化的一元非线性回归 曲线回归) (曲线回归)

例2 出钢时所用的盛钢水的钢包,由于钢水对耐火材料的侵蚀, 容积不断增大.我们希望知道使用次数与增大的容积之间的关 系.对一钢包作试验,测得的数据列于下表:

使用次数 2 3 4 5 6 7 8 9 增大容积 6.42 8.20 9.58 9.50 9.70 10.00 9.93 9.99 使用次数 10 11 12 13 14 15 16 增大容积 10.49 10.59 10.60 10.80 10.60 10.90 10.76

(2)在 x1 = x01 , x2 = x02 ,..., xk = x0 k , 处对 y 的值作预测与控制,即对 y 作区间估计.

2010-11-19 17

二、模型参数估计

1、对 β i 和σ 2 作估计

用最小二乘法求 β 0 ,..., β k 的估计量:作离差平方和

Q = ∑ ( y i − β 0 − β 1 xi1 − ... − β k xik )

i =1

n

2

选择 β 0 ,..., β k 使 Q 达到最小。

ˆ 注 意 : β 服 从 p+1 维 正 态 分

ˆ 得到的 β i 代入回归平面方程得:

布,且为 β 的无偏估 计 , 协 方 差 阵 为 σ 2C . C=L -1 =(c i j), L=X ’X

ˆ ˆ ˆ y = β 0 + β 1 x1 + ... + β k x k

(Ⅱ)t检验法 检验法

当 H 0 成立时, T = 故T >t

α

2

n

ˆ Lxx β 1 ~t(n-2) ˆ σe

1−

(n − 2) ,拒绝 H 0 ,否则就接受 H 0 .

n 2 i =1

其中L xx = ∑ ( xi − x ) = ∑ xi2 − nx 2

2010-11-19

i =1

9

(Ⅲ)r检验法 检验法

( 5)对数曲线 y=a+blogx,x>0 对数曲线

(6)S 型曲线 y =

1 a + be − x

解例 2.由散点图我们选配倒指数曲线 y=aeb / x

ˆ ˆ 根据线性化方法,算得 b = −1.1107, A = 2.4587

返回

2010-11-19

由此 最后得

ˆ a = e A = 11.6789

线性模型 (Y , Xβ , σ I n ) 考虑的主要问题是:

y = β 0 + β1 x1 + ... + β k xk 称为回归平面方程 回归平面方程. 回归平面方程

返回

(1)用试验值 (样 本值) 对未知 参数 β 和 σ 2 作点估计和 假设检 验, 从而建 立 y 与

x1 , x 2 ,..., x k 之间的数量关系;

β 0 , β1

2010-11-19 6

2、 σ 2 的无偏估计

ˆˆ 记 Qe = Q( β 0 , β1 ) = ˆ ∑ (y − β

n i =1 i 0

ˆ − β 1 xi

ˆ ) = ∑( y − y )

2 n i =1 i i

2

称 Qe 为残差平方和 剩余平方和. 残差平方和或剩余平方和 残差平方和

2010-11-19 15

通常选择的六类曲线如下:

1 b (1)双曲线 = a + 双曲线 y x

(2)幂函数曲线 y=a x b , 其中 x>0,a>0 幂函数曲线

(3)指数曲线 y=a e bx 其中参数 a>0. 指数曲线

(4)倒指数曲线 y=a e b / x 其中 a>0, 倒指数曲线

数学建模与数学实验

回归分析

2010-11-19 1

实验目的

1、直观了解回归分析基本内容。 、直观了解回归分析基本内容。 2、掌握用数学软件求解回归分析问题。 、掌握用数学软件求解回归分析问题。

实验内容

1、回归分析的基本理论。 回归分析的基本理论。 2、用数学软件求解回归分析问题。 、用数学软件求解回归分析问题。 实验作业。 3、实验作业。

记

Q = Q ( β 0 , β 1 ) = ∑ ε = ∑ ( y i − β 0 − β 1 xi )

i =1 2 i i =1

n

n

2

ˆ ˆ 最小二乘法就是选择 β 0 和 β 1 的估计 β 0 , β 1 使得 最小二乘法

ˆ ˆ Q ( β 0 , β 1 ) = min Q ( β 0 , β 1 )

称为经验回归平面方程. β i 称为经验回归系数. 经验回归平面方程 ˆ 经验回归系数

2010-11-19

18

2、 多项式回归

设变量 x、Y 的回归模型为

Y = β 0 + β1 x + β 2 x 2 + ... + β p x p + ε

ˆ2 σ 2 的无偏估计 的无偏估计为 σ e = Qe (n − 2)

ˆ ˆ ˆ 称 σ e 为剩余方差(残差的方差) σˆ e 分别与 β 0 、 β 1 独立 。 剩余方差(残差的方差) , 剩余方差

2 2

ˆ 剩余标准差 σ e 称为剩余标准差.

2010-11-19

返回

7

检验、 三、检验、预测与控制

σ 2 的置信水平为 1-α 的置信区间为

Qe Q , 2 e χ 2 ( n − 2) χ ( n − 2) α 1− α 2 2

2010-11-19 11

3、预测与控制 、 (1)预测 )

ˆ ˆ ˆ 用 y0 的回归值 y 0 = β 0 + β 1 x 0 作为 y0 的预测值.