向量空间模型文档相似度计算实现(c#)

向量的相似度计算常用方法9个

向量的相似度计算常用方法相似度的计算简介关于相似度的计算,现有的几种基本方法都是基于向量(Vector)的,其实也就是计算两个向量的距离,距离越近相似度越大。

在推荐的场景中,在用户—物品偏好的二维矩阵中,我们可以将一个用户对所有物品的偏好作为一个向量来计算用户之间的相似度,或者将所有用户对某个物品的偏好作为一个向量来计算物品之间的相似度.下面我们详细介绍几种常用的相似度计算方法。

共8种。

每人选择一个.第9题为选做。

编写程序实现(这是第一个小练习,希望大家自己动手,java实现).计算两个向量的相似性:向量1(0.15, 0。

45, 0。

l68, 0.563, 0。

2543, 0.3465, 0。

6598, 0。

5402, 0.002)向量2(0。

81, 0.34, 0.l66, 0。

356, 0。

283, 0.655, 0。

4398, 0.4302, 0.05402)1、皮尔逊相关系数(Pearson Correlation Coefficient)皮尔逊相关系数一般用于计算两个定距变量间联系的紧密程度,它的取值在[-1,+1] 之间。

s x , sy是 x 和 y 的样品标准偏差。

类名:PearsonCorrelationSimilarity原理:用来反映两个变量线性相关程度的统计量范围:[-1,1],绝对值越大,说明相关性越强,负相关对于推荐的意义小.说明:1、不考虑重叠的数量;2、如果只有一项重叠,无法计算相似性(计算过程被除数有n—1);3、如果重叠的值都相等,也无法计算相似性(标准差为0,做除数)。

该相似度并不是最好的选择,也不是最坏的选择,只是因为其容易理解,在早期研究中经常被提起。

使用Pearson线性相关系数必须假设数据是成对地从正态分布中取得的,并且数据至少在逻辑范畴内必须是等间距的数据。

Mahout中,为皮尔森相关计算提供了一个扩展,通过增加一个枚举类型(Weighting)的参数来使得重叠数也成为计算相似度的影响因子。

cosine相似度计算

cosine相似度计算

Cosine相似度计算是自然语言处理以及文本挖掘领域中最常见的工具之一,也是最有用的。

它是一种基于向量空间模型(VSM)的相关算法,把不同的词表示成向量,并且可以计算语句之间的相似度。

本文将深入探讨这种算法的原理,并且介绍它的应用和优点。

从数学的角度来看,cosine相似度是一种相似度计算方法,它在自然语言处理领域被广泛使用,也是机器学习领域中最常见的工具之一。

原理是两个向量表示的文本或者语句,把它们进行向量内积运算,结果就是它们之间的相似度。

Cosine相似度是根据向量空间模型(VSM)实现的,它是把文本中单词表示成一个向量,向量的维度是文本中所有单词的数量,每个单词在向量中对应的维度的值就是单词在文本中的重要性。

首先,将文本中的所有单词按照词簿转换成一个个以单词为维度的向量,然后计算它们之间的余弦相似度,最终得到的结果就是文本的相似度。

Cosine相似度的优点很明显:它是一种简单有效的算法,可以快速计算出文本之间的相似度;它不容易受到自然语言中的噪音或者错误影响;它可以用来计算任意长度的文本之间的相似度。

Cosine相似度的应用非常广泛,它在推荐系统、自然语言处理、文本挖掘等领域都有广泛的应用。

在推荐系统中,它可以用来计算用户之间的相似度,从而提供更加丰富的内容;在自然语言处理中,它可以用来进行文本的分类、聚类和检索;在文本挖掘中,它可以用来计算文本摘要的相似度,从而提取出文本的主要特征和内容。

总之,cosine相似度是一种有用而又实用的算法,它可以用来快速计算文本之间的相似度,应用非常广泛,在自然语言处理和文本挖掘领域发挥着重要的作用。

文本处理中的向量空间模型

向量空间模型在文本处理中的应用引言在信息检索和自然语言处理领域,向量空间模型是一种常用的文本表示方法。

它将文本转换为向量形式,通过计算向量之间的相似度来实现文本分类、聚类和检索等任务。

本文将详细介绍向量空间模型在文本处理中的原理、应用和优化方法。

1. 向量空间模型的原理向量空间模型基于词袋模型,将文本表示为一个高维向量。

每个维度代表一个词语,而向量中的值表示该词语在文本中出现的次数或权重。

通过这种方式,可以捕捉到不同词语在文本中的重要性和关联性。

具体而言,向量空间模型包括以下步骤:1.文本预处理:去除停用词、标点符号等无关信息,并进行词干化或词形还原等操作。

2.构建词典:将所有文档中出现过的词语构建成一个词典。

3.文档表示:对每个文档进行向量化表示,常见的方法有计算词频(TermFrequency)或使用TF-IDF(Term Frequency-Inverse DocumentFrequency)对词频进行加权。

4.向量相似度计算:通过计算向量之间的余弦相似度或欧氏距离等指标,来度量文本之间的相似性。

2. 向量空间模型的应用向量空间模型在文本处理中有广泛的应用,包括但不限于以下几个方面:2.1 文本分类文本分类是将文本分为不同类别的任务。

向量空间模型可以将每个文档表示为一个向量,并使用分类算法(如朴素贝叶斯、支持向量机等)进行分类。

通过对训练集进行学习,可以构建一个分类器,用于对新文档进行分类。

2.2 文本聚类文本聚类是将相似的文档分到同一类别的任务。

向量空间模型可以通过计算向量之间的相似度,将相似的文档聚在一起。

常见的聚类算法有K-means、层次聚类等。

2.3 文本检索文本检索是根据用户输入的查询词,在大规模文本库中找到相关文档的任务。

向量空间模型可以将用户查询和每个文档表示为向量,并计算它们之间的相似度。

通过排序相似度得分,可以返回与查询最相关的前几个结果。

2.4 信息抽取信息抽取是从文本中提取结构化信息的任务。

cosine similarity计算方法

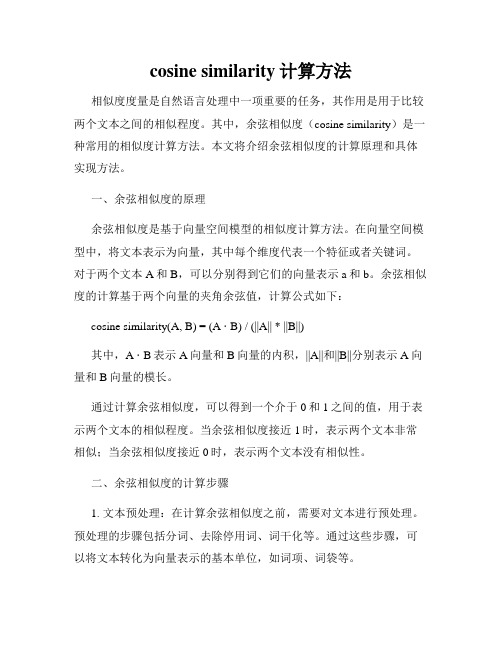

cosine similarity计算方法相似度度量是自然语言处理中一项重要的任务,其作用是用于比较两个文本之间的相似程度。

其中,余弦相似度(cosine similarity)是一种常用的相似度计算方法。

本文将介绍余弦相似度的计算原理和具体实现方法。

一、余弦相似度的原理余弦相似度是基于向量空间模型的相似度计算方法。

在向量空间模型中,将文本表示为向量,其中每个维度代表一个特征或者关键词。

对于两个文本A和B,可以分别得到它们的向量表示a和b。

余弦相似度的计算基于两个向量的夹角余弦值,计算公式如下:cosine similarity(A, B) = (A · B) / (||A|| * ||B||)其中,A · B表示A向量和B向量的内积,||A||和||B||分别表示A向量和B向量的模长。

通过计算余弦相似度,可以得到一个介于0和1之间的值,用于表示两个文本的相似程度。

当余弦相似度接近1时,表示两个文本非常相似;当余弦相似度接近0时,表示两个文本没有相似性。

二、余弦相似度的计算步骤1. 文本预处理:在计算余弦相似度之前,需要对文本进行预处理。

预处理的步骤包括分词、去除停用词、词干化等。

通过这些步骤,可以将文本转化为向量表示的基本单位,如词项、词袋等。

2. 构建向量表示:在进行余弦相似度计算之前,需要将文本转化为向量表示。

这可以通过统计文本中各个特征或关键词的频率来实现。

常用的向量表示方法有词频(Term Frequency,TF)和词频-逆文档频率(Term Frequency-Inverse Document Frequency,TF-IDF)。

3. 计算余弦相似度:通过上述的计算公式,可以计算出两个文本向量的余弦相似度。

具体计算步骤为:首先计算两个向量的内积,然后分别计算两个向量的模长,最后将内积除以模长的乘积即可得到余弦相似度。

三、余弦相似度的应用余弦相似度在自然语言处理中有广泛的应用,其中主要包括以下几个方面:1. 文本聚类和分类:通过计算不同文本之间的余弦相似度,可以将相似的文本聚为一类或者进行分类任务。

文本相似度算法基本原理

文本相似度算法基本原理文本相似度算法是指对两个文本进行比较,评估它们之间的相似程度的一种方法。

在文本处理的相关领域中,文本相似度算法被广泛应用于引擎、信息检索、文本聚类、文本分类、文本摘要等任务中。

本文将介绍几种常见的文本相似度算法的基本原理。

一、基于词频统计的文本相似度算法最简单的文本相似度算法之一是基于词频统计的算法。

该算法通过统计两个文本中共同出现的词语的个数,并计算它们的相似度。

算法的基本步骤如下:1.分词:将待比较的文本进行分词,将文本划分为一组词语。

2.统计词频:统计每个词在两个文本中出现的次数。

3.计算相似度:根据词频计算相似度。

常用的相似度度量方法包括余弦相似度、欧氏距离等。

这种方法的优点是简单直观,计算效率高。

但是它忽略了词语的顺序和上下文信息,无法有效处理一词多义、词序不同的情况。

二、基于向量空间模型的文本相似度算法向量空间模型是一种常见的文本表示方法,它将文本表示为一个高维向量,通过计算向量之间的距离或相似度来度量文本之间的相似程度。

基于向量空间模型的文本相似度算法的基本步骤如下:1.文本表示:将文本转化为向量表示。

常用的方法包括词袋模型和TF-IDF模型。

词袋模型将文本中的词语组成一个向量,向量的每个维度对应一个词语,维度值为该词在文本中的词频。

TF-IDF模型在词袋模型的基础上,通过加权计算,考虑了词语在文本集合中的重要性。

2.计算相似度:根据向量表示计算文本的相似度。

常用的相似度度量方法包括余弦相似度、欧氏距离、曼哈顿距离等。

基于向量空间模型的文本相似度算法可以更好地考虑词语的顺序和上下文信息,可以处理一词多义、词序不同的情况。

但是它对文本长度较敏感,对于长文本计算复杂度较高。

三、基于词嵌入的文本相似度算法词嵌入是一种将词语映射到连续向量空间的方法,它可以很好地保留了词语的语义信息。

基于词嵌入的文本相似度算法通过计算词嵌入向量之间的距离或相似度来度量文本之间的相似程度。

一种改进的基于向量空间文本相似度算法的研究与实现

进 的基 于向量 空间文本相似 度计算 方法 , 其正 确性 和有效 性得

到 了实 验 证 明 。

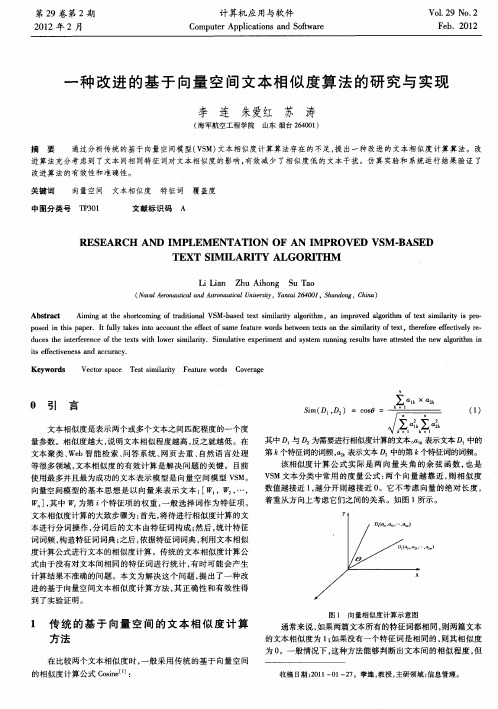

图 1 向量相似度计算示 意图

1 传 统 的 基 于 向量 空 间 的 文 本 相 似 度 计 算

p s d i h sp p r I f l a e n o a c u t h f c f a au e w r sb t e e t o e s lrt f e t t e eo e e e t ey r - o e n t i a e . t u l t k s it c o n e ef to me f t r o d ewe n tx s n t i ai o x , h r fr f ci l e y t e s e h mi y t v

第2 9卷 第 2期

21 0 2年 2月

计 算机 应 用与软 件

C mp trAp l ai n n ot a e o u e pi t s a d S f r c o w

V0. 9 No 2 12 . Fe b.2 2 01

一

种 改进 的基 于 向量 空 间文 本 相 似 度 算 法 的研 究 与 实现

其中 D。 D 为需要进行相似度计算的文本。,表示文本 D, 与 2 a 中的 第k 个特征词的词频 , 表示文本 D 2中的第 k 个特征词的词频。

该相 似度 计 算公 式 实 际是 两 向量夹 角 的余 弦 函数 , 是 也

V M文本分类 中常用 的度 量公 式 : S 两个 向量 越靠 近 , 相似 度 则 数值越接 近 1越 分开则越 接近 0 , 。它 不考虑 向量 的绝对 长度 , 着重从方 向上考虑它们之间 的关 系。如 图 1 所示 。

式 由于没 有对 文本间相 同的特征词 进行 统计 , 有时 可能会 产生 计算结果 不准确的问题 。本 文为解 决这 个 问题 , 出 了一 种改 提

新手学信息检索4:向量空间模型与相似度计算

新手学信息检索4:向量空间模型与相似度计算阿里巴巴首席工程师经验分享,物超所值。

相似度从字面上理解就是两个事物的相似程度。

在信息检索中,相似度表示的是两个文档之间的相似程度或者查询与文档的相似程度。

首先回想一下检索过程:1:首先用户输入查询词。

2:搜索引擎根据查询词查找相应的文档。

3:搜索引擎把查询结果以一定的方式显示给用户。

那么一篇文档是否满足用户的查询需求可以用文本与查询的相似程度来衡量。

而相似度到最后总能够计算成一个实数,所以可以根据文档与查询的相似度进行排序。

与查询相似度较高的文档排在前面,较低的排在后面。

相似度的计算方式五花八门。

比如上一篇文章中,可以简单的利用tf*idf的累加和代表文档与查询的相似程度。

当然这种方法看上去没什么理论深度,所以就不讨论了。

对于一件事,研究者常常尽量使用数学理论去解释它,使它模型化,使它变得有理有据。

数学包含的内容博大精深,所以解释的方法也不同。

有的研究者试图用这种数学理论去解释,有的研究者试图用那种数学理论解释。

有些人解释的很成功,当然有一些则失败了。

当一个一流研究者找到一个新的解释方法并建立一个模型后,其他的三流研究者就开始对这个模型修修补补。

现在就来说说一流研究者提出的一个检索模型:向量空间模型。

该模型被用于文档的分类,该模型最初被用于文档的分类,通过文档与类别的特征之间计算来实现文档正确分类,但是该模型也可以用在信息检索中。

向量空间模型就是把查询和文档想象成N维空间向量,N是词典大小。

每一维表示一个查询词。

向量在每一个维度上的坐标可以通过计算得到。

设查询向量表示成:Q=[q1,q2,……,qN];文档向量表示成:D=[d1,d2,……,dN];这样查询Q与文档D都能表示成两个向量。

那么我们如何计算其相似度呢?这里常用的就是余弦相似度:对于这种模型下的余弦相似度的计算有一个非常形象的解释:把每一篇文档想象成N维空间下的点。

一个查询可以想象成从原点打出的一束光刺穿了这个N维空间,离光束近的点与查询相似度高,离光束远的点与查询相似度低。

向量空间模型的基本原理

向量空间模型的基本原理

(含原创)

向量空间模型是一种衡量向量之间相关性的方法,最早源于信息检索,但后来

发展成为在全球范围内应用于互联网的一种有效的模型。

它的基本原理是通过将文本的特征定义为多维空间中的向量,相同或相似的特征定义为接近的向量,不同或不相关的特征定义为远离的向量,以检测数据之间的关联性。

以搜索引擎为例,如果用户输入一组搜索字词,该词语可以在多维空间中转换

为一组数字,在这个空间中,用户输入的词语将和其他网站上的文章相比较,以确定与用户输入的搜索字词最接近的文章,从而获得相关搜索结果。

在相似度计算中,向量空间模型可以更精细地匹配,以便找到与用户搜索最相

关的结果。

模型支持多种形式的数据转换,如分类或安全处理,并能够应用向量算法计算出两组输入之间的相似度扩大。

在互联网上,向量空间模型可以用来优化搜索结果,还可以进行文档分类和文本挖掘,从而有效地提升搜索性能。

向量空间模型可以通过应用相似度计算技术来实现自动化搜索,使用户更好地

与所需信息相关联。

它不仅可以用于互联网普及程度最高的部分,搜索和索引,还可以应用于处理更多复杂的信息检索任务。

由于其具有快速计算准确程度高的特点,向量空间模型已成为互联网中一种受欢迎的信息检索技术,值得了解与学习。

向量空间模型在信息检索中的应用

向量空间模型在信息检索中的应用一、前言信息检索是指用户通过检索系统,以关键词等方式请求得到相关的信息的过程。

在这个过程中,如何让计算机快速准确地找到用户需要的信息,成为了信息检索中最基本的问题。

而向量空间模型成为了信息检索中最常用的方法之一。

二、向量空间模型概述向量空间模型是一种用向量来表示文本,以向量之间的距离或角度作为相似度度量的信息检索模型。

在向量空间模型中,每篇文本表示为一个向量,该向量与文本中所有词汇的向量构成的向量空间的距离被用来度量文本之间的相似度。

在向量空间模型中,文本表示为向量,而每个词汇也被表示为向量。

可以使用不同的方法来构建向量空间模型。

其中,最常用的是词频-逆文档频率方法(TF-IDF)。

三、向量空间模型的构建(一)词汇的表示在构建向量空间模型之前,需要对文档中的每个词汇进行处理,将其转换为向量。

主要有以下两种方法:1. 二元词向量(Boolean Vector)每个词汇的向量只有两个取值:0 和 1。

0表示该词汇在文档中未出现,1表示该词汇在文档中出现。

2. 词频向量(Term Frequency Vector)每个词汇的向量取值为该词汇在文档中出现的次数。

(二)文档的表示在对文本进行处理之后,就可以将每篇文本表示为向量。

文本向量的构建可以采用以下方法:1. 词频-逆文档频率向量(TF-IDF Vector)在TF-IDF中,每个文档的向量由其包含的所有词汇的TF-IDF 值构成,其中TF值表示该词汇出现的次数,IDF值表示在语料库中包含该词汇的文档数目的倒数。

2. LSA(潜在语义分析)向量LSA是一种利用SVD技术对文档、词汇进行降维处理来求解文档相似度的方法。

四、向量空间模型的应用(一)文本分类向量空间模型可用于文本分类。

建立好文本与向量之间的对应关系后,可以用已知分类的文本数据训练分类器。

测试文本经过向量化之后,使用分类器进行分类,从而完成文本分类的任务。

(二)信息检索向量空间模型在信息检索中得到广泛应用。

向量空间检索模型

向量空间检索模型

向量空间检索模型是信息检索领域中常用的一种模型。

它将文档和查询表示为向量,并通过计算它们之间的相似度来进行检索。

在向量空间检索模型中,每个文档和查询都被表示为一个向量,通常使用词频或者词向量来表示。

每个维度代表一个特定的词项,向量的数值表示词项在文档中的出现频率或者其他权重信息。

当用户发起一个查询时,查询也会被表示为一个向量。

接下来,通过计算查询向量与文档向量之间的相似度,可以对文档进行排序,以便返回最相关的文档作为搜索结果。

计算向量间的相似度可以使用多种方法,最常见的是余弦相似度。

余弦相似度衡量了两个向量之间的夹角,数值越大表示相似度越高。

除了基本的向量表示和相似度计算,向量空间检索模型还可以通过引入权重、正则化和其他技术来提高检索的效果和精度。

总而言之,向量空间检索模型是一种基于向量表示和相似度计算的信息检索模型,通过计算查询向量与文档向量之间的相似度来实现文档的排序和检索。

它是信息检索领域中常用的一种模型,并在实践中取得了良好的效果。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Text.RegularExpressions;

namespace Felomeng.VSMSimilarity

{

class SVMModle

{

/// <summary>

/// 降维词表

/// </summary>

private List<string> reducingKeys = new List<string>();

/// <summary>

/// 构造函数:使用降维表

/// </summary>

/// <param name="reducingKeys">降维词表</param>

public SVMModle(List<string> reducingKeys)

{

this.reducingKeys = reducingKeys;

}

/// <summary>

/// 构造函数:不使用降维表

/// </summary>

public SVMModle()

{

}

/// <summary>

/// 相似度计算

/// </summary>

/// <param name="text1">文档1(分好词的,分词符为非汉字字符)</param>

/// <param name="text2">文档2(分好词的,分词符为非汉字字符)</param>

/// <returns>两篇文章的相似度</returns>

public double Similarity(string text1, string text2)

{

double similarity = 0.0, numerator = 0.0, denominator1 = 0.0, denominator2 = 0.0;

int temp1, temp2;

Dictionary<string, int> dictionary1 = GetDictionary(text1);

Dictionary<string, int> dictionary2 = GetDictionary(text2);

if ((dictionary1.Count < 1) || (dictionary2.Count < 1))//如果任一篇文章中不含有汉字

{

return 0.0;

}

Dictionary<string, int>.KeyCollection keys1 = dictionary1.Keys;

foreach (string key in keys1)

{

dictionary1.TryGetValue(key, out temp1);

if (!dictionary2.TryGetValue(key, out temp2))

{

temp2 = 0;

}

dictionary2.Remove(key);

numerator += temp1 * temp2;

denominator1 += temp1 * temp1;

denominator2 += temp2 * temp2;

}

Dictionary<string, int>.KeyCollection keys2 = dictionary2.Keys;

foreach (string key in keys2)

{

dictionary2.TryGetValue(key, out temp2);

denominator2 += temp2 * temp2;

}

similarity = numerator / (Math.Sqrt(denominator1 * denominator2));

return similarity;

}

/// <summary>

/// 相似度计算

/// </summary>

/// <param name="text1">第一篇文档的词频词典</param>

/// <param name="text2">第二篇文档的词频词典</param>

/// <returns>两篇文档的相似度</returns>

public double Similarity(Dictionary<string, int> text1, Dictionary<string, int> text2)

{

double similarity = 0.0, numerator = 0.0, denominator1 = 0.0, denominator2 = 0.0;

int temp1, temp2;

Dictionary<string, int> dictionary1 = new Dictionary<string,int>( text1);

Dictionary<string, int> dictionary2 = new Dictionary<string,int>( text2);

if ((dictionary1.Count < 1) || (dictionary2.Count < 1))//如果任一篇文章中不含有汉字

{

return 0.0;

}

Dictionary<string, int>.KeyCollection keys1 = dictionary1.Keys;

foreach (string key in keys1)

{

dictionary1.TryGetValue(key, out temp1);

if (!dictionary2.TryGetValue(key, out temp2))

{

temp2 = 0;

}

dictionary2.Remove(key);

numerator += temp1 * temp2;

denominator1 += temp1 * temp1;

denominator2 += temp2 * temp2;

}

Dictionary<string, int>.KeyCollection keys2 = dictionary2.Keys;

foreach (string key in keys2)

{

dictionary2.TryGetValue(key, out temp2);

denominator2 += temp2 * temp2;

}

similarity = numerator / (Math.Sqrt(denominator1 * denominator2));

return similarity;

}

/// <summary>

/// 统计文档词频词典

/// </summary>

/// <param name="text">已分词文档,分隔符为非汉语字符</param>

/// <returns>该文档词频词典</returns>

public Dictionary<string, int> GetDictionary(string text)

{

Dictionary<string, int> dictionary = new Dictionary<string, int>();

Regex regex = new Regex(@"[\u4e00-\u9fa5]+");

MatchCollection results = regex.Matches(text);

int temp;

foreach (Match word in results)

{

if (dictionary.TryGetValue(word.Value, out temp))

{

temp++;

dictionary.Remove(word.Value);

dictionary.Add(word.Value, temp);

}

else

{

dictionary.Add(word.Value, 1);

}

}

return dictionary;

}

}

}

本文来自CSDN博客,转载请标明出处:/Felomeng/archive/2009/03/25/4023990.aspx。