实验7 线性回归

多元线性回归模型的估计、回归系数和回归方程的检验、标准化回归方程、预测

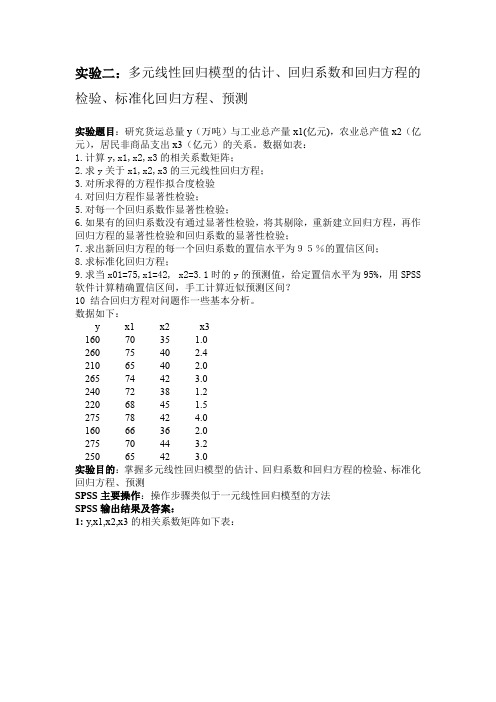

实验二:多元线性回归模型的估计、回归系数和回归方程的检验、标准化回归方程、预测实验题目:研究货运总量y(万吨)与工业总产量x1(亿元),农业总产值x2(亿元),居民非商品支出x3(亿元)的关系。

数据如表:1.计算y,x1,x2,x3的相关系数矩阵;2.求y关于x1,x2,x3的三元线性回归方程;3.对所求得的方程作拟合度检验4.对回归方程作显著性检验;5.对每一个回归系数作显著性检验;6.如果有的回归系数没有通过显著性检验,将其剔除,重新建立回归方程,再作回归方程的显著性检验和回归系数的显著性检验;7.求出新回归方程的每一个回归系数的置信水平为95%的置信区间;8.求标准化回归方程;9.求当x01=75,x1=42, x2=3.1时的y的预测值,给定置信水平为95%,用SPSS 软件计算精确置信区间,手工计算近似预测区间?10 结合回归方程对问题作一些基本分析。

数据如下:y x1 x2 x31607035 1.02607540 2.42106540 2.02657442 3.02407238 1.22206845 1.52757842 4.01606636 2.02757044 3.22506542 3.0实验目的:掌握多元线性回归模型的估计、回归系数和回归方程的检验、标准化回归方程、预测SPSS主要操作:操作步骤类似于一元线性回归模型的方法SPSS输出结果及答案:1:y,x1,x2,x3的相关系数矩阵如下表:由上述输出结果知:y=-348.280+3.754x1+7.101x2+12.447x3 3模型汇总b模型R R 方调整 R 方标准估计的误差1 .898a.806 .708 23.44188a. 预测变量: (常量), 居民非商品支出X3(亿元), 工业总产值X1(亿元), 农业总产值X2(亿元)。

b. 因变量: 货运总量Y(万吨)由上述输出结果知:调整R square=0.708,拟合的较好4Anova b模型平方和df 均方 F Sig.1 回归13655.370 3 4551.790 8.283 .015a残差3297.130 6 549.522总计16952.500 9a. 预测变量: (常量), 居民非商品支出X3(亿元), 工业总产值X1(亿元), 农业总产值X2(亿元)。

化学试验设计法中的回归分析

一元线性和非线性回归方法对单因素试验很管用,但是我们在试验中经常碰到的是多因素情况。

1

譬如分析化学中常见的多组分分析问题,如何做??

2

传统的方法是采用化学掩蔽或分离等方法,将其转化为单因素进行研究。

3

但这样经常费时费力,还得到的不一定是最好的条件。

4

还有如前面提到的均匀设计法的数据分析,要求出多个因素的最优水平,如何做??

上面介绍的是“逐步引入”的方法。 另外还有“逐步剔除”、“有进有出”等方法。

*

自变量x的显著性如何检验?

Fa,说明xj贡献较大,保留; F≤Fa,则剔除xj。 假定在n个自变量中已经建立了x1、x2、…、xL对y的回归方程,对各变量的贡献进行比较,找出最小贡献xj,要检验xj的显著性,则可由xj对y的方差贡献Qj来衡量。 通常用Qj与x1、x2、…、xL的整体方差Q之比Qj/Q来量度。 采用F检验:

*

6.6 逐步回归分析法介绍(stepwise regression) 在上一节中讨论了多元回归分析。当我们不知道指标(因变量)和多个因素(自变量)之间的关系模型时,如何进行回归分析? 还有, 在某些实际问题中可能有这样的情况:参加回归的n个变量x1、x2、 … xn 中,单独观察,有些因素与因变量y的相关程度很密切,但当综合观察n个因素与y的相关性时,这些因素可能显得不太重要。

5

在这时就必须采用多元回归。

6

*

多元回归有多种,除了多元线性、非线性回归外,其他如化学计量学中的主成分分析、偏最小二乘法、聚类分析等也是比较常用的回归分析方法。

多元线性回归是一种使用非常广泛的校正方法,在均匀设计中就要用到。

对于一个多因素(X1、X2、…Xn)的试验,试验响应指标为Y,如果Y与各因素之间为线性关系,则有:

(整理)线性回归与相关性分析

,,,本科学生实验报告学号:########## 姓名:¥¥¥¥¥¥学院:生命科学学院专业、班级:11级应用生物教育A班实验课程名称:生物统计学实验教师:孟丽华(教授)开课学期:2012 至2013 学年下学期填报时间:2013 年 5 月22 日云南师范大学教务处编印线回归方程进行预测或控制,一般只能内插,不要轻易外延;2、直线回归相关分析的注意事项:1)、相关分析只是以相关系数来描述两个变量间线性相关的程度和方向,并不阐明事物间存在联系的本质,也不是两事物间存在联系的证据。

要阐明两事物间的本质联系,必须凭专业知识从理论上加以论证。

因此,把两个毫无关系的事物放在一起作相关分析是毫无意义的。

同样,作回归分析也要有实际意义;2)、在进行直线回归前应绘制散点图,有直线趋势时,才适宜作直线回归分析。

散点图还能提示资料有无异常点;3)、直线回归方程的适用范围一般以自变量的取值范围为限;4)、对同一组资料作回归和相关分析,其相关系数和回归系数的显著性检验结果完全相同。

由于相关系数的显著性检验结果可直接查表,比较方便;而回归系数的显著性检验计算复杂,故在实际应用中常用相关系数的显著性检验结果代替回归系数的显著性检验。

5)、在资料要求:相关分析要求两个变量服从双变量正态分布。

回归分析要求因变量服从正态分布,自变量可以是精确测量和严格控制的变量。

如两个变量服从双变量正态分布,则可以作两个回归方程,用X推算Y,或用Y推算X;3、相关分析中,不区分自变量和因变量。

相关分析只研究两个变量之间线性相关的程度或一个变量与多个变量之间线性相关的程度,不能用一个或多个变量去预测另一个变量的值,这是回归分析与相关分析的主要区别;4、通过此次实验,更加熟悉了SPSS软件的应用,学习了线性回归与相关性分析,考察两变量之间线性关系,建立回归方程,并对回归系数作假设检验;计算。

直线回归的步骤

直线回归的步骤回归分析是一种用来研究变量之间关系的统计方法,其中最常用的方法是直线回归。

直线回归可以用来描述两个变量之间的线性关系,也可以用来预测一个变量的值。

本文将介绍直线回归的基本概念和步骤。

一、直线回归的基本概念直线回归的基本概念包括自变量、因变量、回归线和残差。

自变量是用来解释因变量的变量,又称为解释变量或独立变量。

因变量是需要解释的变量,又称为被解释变量或依赖变量。

回归线是自变量和因变量之间的最佳拟合直线,可以用来描述两个变量之间的线性关系。

残差是回归线与实际数据之间的差异,也就是预测值与实际值之间的误差。

二、直线回归的步骤直线回归的步骤包括数据收集、数据处理、回归分析和结果解释。

1. 数据收集直线回归的第一步是收集数据。

数据可以通过实验、调查或观察等方式获得。

收集数据时需要注意数据的准确性和可靠性,避免数据的误差和偏差。

2. 数据处理数据处理是指对收集到的数据进行清洗、整理和统计。

数据清洗是指对数据进行筛选和修正,去除异常值和缺失值等。

数据整理是指对数据进行排序和归纳,方便后续的分析和处理。

数据统计是指对数据进行描述性统计和推断性统计,包括均值、方差、标准差、相关系数等指标的计算。

3. 回归分析回归分析是直线回归的核心步骤。

回归分析可以分为简单线性回归和多元线性回归两种类型。

简单线性回归是指只有一个自变量和一个因变量的回归模型,多元线性回归是指有多个自变量和一个因变量的回归模型。

简单线性回归的回归模型可以表示为:Y = a + bX + e其中,Y是因变量,X是自变量,a是截距,b是斜率,e是误差项。

多元线性回归的回归模型可以表示为:Y = a + b1X1 + b2X2 + … + bnXn + e其中,Y是因变量,X1、X2、…、Xn是自变量,a是截距,b1、b2、…、bn是斜率,e是误差项。

回归分析的目的是找到最佳拟合直线,即使得残差最小的直线。

最小二乘法是用来求解最佳拟合直线的一种方法。

线性回归算法实验分析

线性回归算法实验分析⼀、线性回归实验⽬标 算法推导过程中已经给出了求解⽅法,基于最⼩乘法直接求解,但这并不是机器学习的思想,由此引⼊了梯度下降⽅法。

实验主要内容: (1)线性回归⽅程实现 (2)梯度下降效果 (3)对⽐不同梯度下降测量 (4)建模曲线分析 (5)过拟合与⽋拟合 (6)正则化的作⽤ (7)提前停⽌策略⼆、实验步骤 ⾸先准备环境,配置画图参数,过滤警告。

import numpy as npimport osimport warningsimport matplotlibimport matplotlib.pyplot as plt# 画图参数设置plt.rcParams['belsize'] = 14plt.rcParams['belsize'] = 12plt.rcParams['belsize'] = 12# 过滤警告warnings.filterwarnings('ignore') 构造数据点(样本):# 通过rand函数可以返回⼀个或⼀组服从“0~1”均匀分布的随机样本值。

随机样本取值范围是[0,1),不包括1X = 2 * np.random.rand(100, 1)# 构造线性⽅程,加⼊随机抖动# numpy.random.randn()是从标准正态分布中返回⼀个或多个样本值# 1.当函数括号内没有参数时,返回⼀个浮点数;# 2.当函数括号内有⼀个参数时,返回秩为1的数组,不能表⽰向量和矩阵# 3.当函数括号内有两个及以上参数时,返回对应维度的数组,能表⽰向量或矩阵。

np.random.randn(⾏,列)# 4.np.random.standard_normal()函数与np.random.randn类似,但是输⼊参数为元组(tuple)y = 3*X + 4 + np.random.randn(100, 1)plt.plot(X, y, 'b.') # b指定为蓝⾊,.指定线条格式plt.xlabel('X_1')plt.ylabel('y')# 设置x轴为0-2,y轴为0-15plt.axis([0, 2, 0, 15])plt.show() 执⾏显⽰数据点如下所⽰:1、线性回归⽅程实现"""线性回归⽅程实现"""# numpy.c_:按⾏连接两个矩阵,就是把两矩阵左右相加,要求⾏数相等。

数学建模——线性回归分析82页PPT

2019/11/15

zhaoswallow

2

表1 各机组出力方案 (单位:兆瓦,记作MW)

方案\机组 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17

1

2

3

4

5

6

7

8

120

73

180

80

125

125

81.1

90

133.02 73

180

80

125

125

81.1

90

3 -144.25 -145.14 -144.92 -146.91 -145.92 -143.84 -144.07 -143.16 -143.49 -152.26 -147.08 -149.33 -145.82 -144.18 -144.03 -144.32

4 119.09 118.63 118.7 117.72 118.13 118.43 118.82 117.24 117.96 129.58 122.85 125.75 121.16 119.12 119.31 118.84

5 135.44 135.37 135.33 135.41 135.41 136.72 136.02 139.66 137.98 132.04 134.21 133.28 134.75 135.57 135.97 135.06

6 157.69 160.76 159.98 166.81 163.64 157.22 157.5 156.59 156.96 153.6 156.23 155.09 156.77 157.2 156.31 158.26

ˆ0

ˆ1 xi )2

min

0 ,1

分享线性回归实验实践与领悟的心得体会详析

分享线性回归实验实践与领悟的心得体会详析英文回答:1. Linear regression is a fundamental statistical technique used to model the relationship between a dependent variable and one or more independent variables.2. Through my practical experience with linear regression experiments, I have come to realize the importance of data preprocessing. Cleaning and transforming the data prior to analysis is crucial for obtaining accurate and meaningful results.3. Another key insight I gained is the significance of feature selection. Identifying and including only the most relevant independent variables in the regression model helps to improve its predictive power and interpretability.4. I have also learned that understanding the assumptions of linear regression is essential. Assumptions such as linearity, independence, and homoscedasticity should be carefully assessed and, if violated, appropriate corrective measures should be taken.5. Experimenting with different types of linear regression models, such as simple linear regression, multiple linear regression, and polynomial regression, has allowed me to grasp the versatility of this technique in various scenarios.6. Furthermore, I have discovered the importance of evaluatingmodel performance. Metrics like R-squared, mean squared error, and adjusted R-squared help to assess the goodness of fit and determine the effectiveness of the regression model.7. In my experience, the interpretation of regression coefficients is a crucial aspect. Understanding the relationship between the independent variables and the dependent variable helps to draw meaningful conclusions and make informed decisions.8. I have also realized the value of cross-validation techniques in assessing model generalization. Splitting the data into training and testing sets, or employing techniques like k-foldcross-validation, helps to validate the model's performance on unseen data.9. Additionally, I have found that dealing with outliers and influential observations is important. Identifying and properly handling these data points can significantly impact the accuracy and reliability of the regression analysis.10. Collaborating with domain experts has been beneficial in my linear regression experiments. Their insights and knowledge have provided valuable context and helped to refine the analysis.11. I have also recognized the importance of visualizing the regression results. Graphical representations, such as scatter plots, residual plots, and regression lines, aid in understandingthe relationship between variables and identifying potential issues.12. Regularization techniques, such as ridge regression and lasso regression, have proven useful in preventing overfitting and improving model performance in situations with multicollinearity.13. I have learned that the choice of the appropriate evaluation metric depends on the specific problem and the desired outcome. For example, mean absolute error may be more suitable for certain applications compared to mean squared error.14. Understanding the limitations of linear regression is crucial. It is essential to recognize that this technique assumes a linear relationship between variables and may not be suitable for complex nonlinear relationships.15. Finally, through my practical experience, I have come to appreciate the iterative nature of linear regression analysis. Continuously refining the model, testing assumptions, and incorporating new insights helps to improve the accuracy and effectiveness of the analysis.中文回答:1. 线性回归是一种基本的统计技术,用于建模因变量与一个或多个自变量之间的关系。

线性回归分析实验报告

实验一:线性回归分析实验目的:通过本次试验掌握回归分析的基本思想和基本方法,理解最小二乘法的计算步骤,理解模型的设定T检验,并能够根据检验结果对模型的合理性进行判断,进而改进模型。

理解残差分析的意义和重要性,会对模型的回归残差进行正态型和独立性检验,从而能够判断模型是否符合回归分析的基本假设。

实验内容:用线性回归分析建立以高血压作为被解释变量,其他变量作为解释变量的线性回归模型。

分析高血压与其他变量之间的关系。

实验步骤:1、选择File | Open | Data 命令,打开gaoxueya.sav图1-1 数据集gaoxueya 的部分数据2、选择Analyze | Regression | Linear…命令,弹出Linear Regression (线性回归) 对话框,如图1-2所示。

将左侧的血压(y)选入右侧上方的Dependent(因变量) 框中,作为被解释变量。

再分别把年龄(x1)、体重(x2)、吸烟指数(x3)选入Independent (自变量)框中,作为解释变量。

在Method(方法)下拉菜单中,指定自变量进入分析的方法。

图1-2 线性回归分析对话框3、单击Statistics按钮,弹出Linear Regression : Statistics(线性回归分析:统计量)对话框,如图1-3所示。

1-3线性回归分析统计量对话框4、单击 Continue 回到线性回归分析对话框。

单击Plots ,打开Linear Regression:Plots (线性回归分析:图形)对话框,如图1-4所示。

完成如下操作。

图1-4 线性回归分析:图形对话框5、单击Continue ,回到线性回归分析对话框,单击Save按钮,打开Linear Regression;Save 对话框,如图1-5所示。

完成如图操作。

图1-5 线性回归分析:保存对话框6、单击Continue ,回到线性回归分析对话框,单击Options 按钮,打开Linear Regression ;Options 对话框,如图1-6所示。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

实验编号: 07 师大SPSS实验报告2017 年 4 月 24 日

计算机科学学院2015级5班实验名称:线性回归

:唐雪梅学号:2015110538 指导老师:__朱桂琼___ 实验成绩:___

实验七线性回归

一.实验目的及要求

1.了解SPSS 特点结构操作

2.利用SPSS进行简单数据统计

二.实验容

(1)消费者品牌偏好分析:通过品牌使用时间和价格敏感度了解消费者的品牌偏好。

某彩妆系列产品公司进行了一项关于消费者品牌偏好态度的分析,调研人员收集了有关的调研数据,用11点标尺度量态度(1=非常不喜欢该品牌,11=非常喜欢该品牌)对于价格敏感度的度量也用11点标尺(1=对价格完全不敏

思考题:

(1)消费者对品牌的使用时间以及对其价格的敏感度对消费者的品牌偏好有何种影响?它们之间是一种什么样的关系?

(2)如果有影响,品牌偏好与使用时间之间的关系能否用一个模型表示出来?

(2)销售额和员工数量的关系:

随着公司的持续发展,常常有滑入无效率困境的危险,假定某公司的销售开始滑坡,但公司还是不停地招聘新人,公司有某个10年的关于销售额和员

(1)以销售额为自变量,员工数为因变量画出散点图,并建立一个回归模型,通过员工的数量来预测销售额。

(2)解释回归系数的实际意义。

(3)根据分析的结果回答:如果这个趋势继续下去,你对公司的管理层有何建议?你认为管理层应该关注什么?

(3)制度变迁是经济增长的源头,根据研究衡量制度变迁有两个变量:非国有化率和国家财政收入占GDP的比重。

自1998年以来中国的经济增长率一直未突破9%的状态,因此以9%为分界点,将经济增长定义为1(经济增长大于等于9%)或0(经济增长小于9%),

三、实验主要流程、基本操作或核心代码、算法片段(该部分如不够填写,请另加附页)实验一:多元线性回归分析

1.建立数据库

2.分析步骤:分析——回归——线性

3.结果

结论:在对编号为1的模型进行线性回归分析时所采用的方法是全部引入法:输入,此处无被剔出的变量

结论:R Square=0.966,接近于1,说明模型的拟合优度很高,方程拟合很好。

结论:sig=0<0.01,该模型具有显著性意义

系数a

模型

非标准化系数标准系数

t Sig.

B 标准误差试用版

1 (常量) .376 .629 .598 .565

使用时间.516 .060 .819 8.550 .000

价格敏感.235 .085 .266 2.772 .022

a. 因变量: 品牌偏好

拟合结果:y=0.516x1+0.235x2+0.376

Sig.取值大于0.05,没有理由拒绝原假设,即回归系数与零无显著性差异,模型中不存在共线性问题。

结论:特征根均不等于0,则不存在共线性问题,条件指数均小于30,本例中模型不存在共线性的问题。

(1)研究品牌偏好与使用时间之间的关系模型

B)原假设:回归系数与零无显著性差异

C)线性回归分析:

单击分析→回归→线性→打开线性回归主对话框;在弹出的线性回归对话框中,选择变量“品牌偏好(Y)”,添加到因变量框中;选择变量“使用时间(X1)”添加到自变量框中,单机统计量,选中估计、模型拟合度和DW 三个选项。

结果分析:R Square=0.936,接近于1,说明模型的拟合优度很高,方程拟合很好。

DW=2.783,说明残差是负自相关的,表明所假设的模型合理的。

拟合结果:y=0.59x+1.079

残差Mean=0,表明这些数据中无离群值,且数据的标准差也比较小,可以认为模型是合理的

实验二:回归分析

原假设:回归系数与零无显著性差异

1.建立数据库

2.散点图建立:图形——旧对话框——散点\点状——散点图

从图中看出销售额与员工数为非线性关系

(4)回归分析:

A)操作流程:

单击分析→回归→曲线估计→打开曲线估计主对话框;在弹出的曲线估计对话框中,选择变量“员工数”,添加到因变量框中;选择

变量“销售额”添加到自变量框中。

结论:从表中数据可以看出,三次方程的R Square=0.935最接近1,所以员工数和销售呈三次方的关系。

实验三:二维Logistic回归分析

(1)录入实验数据:

(2)二维Logistic回归分析:

1)原假设:回归系数与0无显著性差异

2)操作流程:选择菜单分析→回归→二维Logistic;然后选择Y变量使之添加到因变量框中,选择x1和x2变量,使它们分别进入协变量框中

3)结果分析:

其中常数项包括在模型中,初始-2LL为15.278,迭代结束于第三步,因为此时参数估计与其在上一步的变化已经小于0.001

分类结果表说明Step0的拟合效果。

可以看出对于y=1,有100%的准确性,对于y=0,有0%准确性,总共有66.7%的准确性

似然比卡方检验的观测值等于0.039,概率p值等于0.981。

显著性水平均大于0.05,所以可以拒绝原假设,即认为所有回归系数不同时为0,解释变量的全体与Logit P之间的线性关系显著,采用该模型合理。

模型拟合优度,给出了-2对数似然值较大,说明拟合优度并不理想,Cox和Shell 值以及Nagelkerke值较小,也说明拟合程度较低。

与前一步相比较,预测的准确率不变,模型的总体预测精度也不变。

Sig的值大于0.05,没有理由拒绝原假设,即认为该回归系数与0无显著性差异,它与Logit P的线性关系不是显著的,所以该模型是不可用的,应该重新建模。

四、实验结果的分析与评价(该部分如不够填写,请另加附页)

1.线性回归分析步骤

(1)确定回归方程中的解释变量(自变量)和被解释变量(因变量)。

(2)确定回归模型:通过观察散点图确定应通过哪种数学模型来概括回归线。

(3)建立回归方程:在一定的统计拟合准则下估计出模型中的各个参数,得到一个确定的回归方程

(4)对回归方程进行各种检验:检验回归方程是否真实地反映了事物总体间的统计关系以及回归方程能否用于预测等

(5)利用回归方程进行预测:根据回归方程对事物的未来发展趋势进行预测

2.一元线性回归操作

1.单击Analyze→Regression→Linear→打开Linear Regression主对话框

2.在弹出的LinearRegression对话框中,选择变量“气压”,添加到Dependent框中,表

示因变量;选择变量“沸点”,添加到Independent框中,表示自变量。

3.多元线性回归操作

Analyze→Regression→Linear命令,打开Linear Regression 对话框

选择解释变量Y进入Dependent框

将X1,X2和X5直接纳入模型

X3和X4通过逐步法。

而X6直接不予考虑

选择被解释变量X1,X2和X5进入Independent(s)框

在Method框中选择Enter(默认)表示所选变量强行进入回归方程

单击Next

选择被解释变量X3、X4进入Independent(s)框

在Method框中选择Stepwise对所选变量进行逐步筛选策略

在Linear Regression对话框中单击Statistics按钮

选中Estimates 和Model fit 复选框

选中Collinearity diagnostics复选框

单击OK按钮

4. 二维Logistic回归的SPSS操作

选择菜单Analyze →Regression→Binary Logistic

选择y变量使之添加到Dependent框中,选择x1变量、x2、x3,使它们分别进入Covariates 框中,表示其为自变量

单击Logistic Regression对话框中的Options按钮,选择所有选项,但保留各选项中的缺省值单击Continue按钮,返回上一个对话框,单击OK按钮

注:实验成绩等级分为(90-100分)优,(80-89分)良,(70-79分)中,(60-69分)及格,(59分)不及格。