二分类预测准确度研究——基于判别分析和logistic回归的比较

分类分析--逻辑回归(二分类)

分类分析--逻辑回归(⼆分类)分类分析--逻辑回归逻辑回归(logistic regression)是⼴义线性模型的⼀种,可根据⼀组数值变量预测⼆元输出,即逻辑回归只适⽤于⼆分类,R中的基本函数glm()可⽤于拟合逻辑回归模型。

glm()函数⾃动将预测变量中的分类变量编码为相应的虚拟变量。

威斯康星乳腺癌数据中的全部预测变量都是数值变量,因此不必要对其编码。

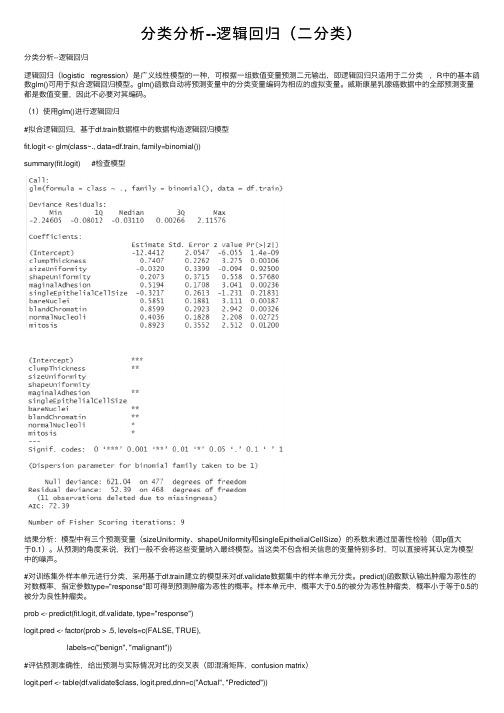

(1)使⽤glm()进⾏逻辑回归#拟合逻辑回归,基于df.train数据框中的数据构造逻辑回归模型fit.logit <- glm(class~., data=df.train, family=binomial())summary(fit.logit) #检查模型结果分析:模型中有三个预测变量(sizeUniformity、shapeUniformity和singleEpithelialCellSize)的系数未通过显著性检验(即p值⼤于0.1)。

从预测的⾓度来说,我们⼀般不会将这些变量纳⼊最终模型。

当这类不包含相关信息的变量特别多时,可以直接将其认定为模型中的噪声。

#对训练集外样本单元进⾏分类,采⽤基于df.train建⽴的模型来对df.validate数据集中的样本单元分类。

predict()函数默认输出肿瘤为恶性的对数概率,指定参数type="response"即可得到预测肿瘤为恶性的概率。

样本单元中,概率⼤于0.5的被分为恶性肿瘤类,概率⼩于等于0.5的被分为良性肿瘤类。

prob <- predict(fit.logit, df.validate, type="response")logit.pred <- factor(prob > .5, levels=c(FALSE, TRUE),labels=c("benign", "malignant"))#评估预测准确性,给出预测与实际情况对⽐的交叉表(即混淆矩阵,confusion matrix)logit.perf <- table(df.validate$class, logit.pred,dnn=c("Actual", "Predicted"))logit.perf结果分析:模型正确判别了129个类别为良性的患者和69个类别为恶性的患者。

logistic回归分析

0

1X1

2X2

mXm

10

若 Z 0 1X1 2 X 2 m X m 则 P 1 1 eZ

1P

00..55

0

Z

-4 -3 -2 -1 0 1 2 3 4

图16-1 logistic函数的图形

11

2.模型参数的意义

ln P 1 P

0

1X1

2X2

mXm

logitP

常数项β0表示暴露剂量为0时个体发病与

20

二、logistic回归模型的参数估计

数据格式: 同多元线性回归分析的数据格式 参数估计:

最大似然估计(maximum likelihood

estimate,MLE)法 可利用统计软件实现。

21

优势比估计: 某一因素两个不同水平优势比的估计值为

OR j exp bj C1 C0

Xj只有两个水平时ORj的1-α可信区间为:

研究二分类或多分类观察结果与一些影响

因素之间关系的一种多变量分析方法。

7

一、基本概念

二分类变量

连续变量

因变量Y=

1 0

阳性率P:(0,1)

ln

P 1-P

:

(,

)

Logit变换

8

ln P 1 P

0

1X1

2X2

mXm

P

1

1 exp[(0 1 X1 2 X 2 L m X m )]

32

33

34

Variables in the Equation

S1ta ep

x6 Constant

S2tb ep

x5 x6

Constant

B 2.826 -.523 1.828 3.059

Logistic回归分析报告结果解读分析

Logistic回归分析报告结果解读分析Logistic回归常用于分析二分类因变量(如存活和死亡、患病和未患病等)与多个自变量的关系。

比较常用的情形是分析危险因素与是否发生某疾病相关联。

例如,若探讨胃癌的危险因素,可以选择两组人群,一组是胃癌组,一组是非胃癌组,两组人群有不同的临床表现和生活方式等,因变量就为有或无胃癌,即“是”或“否”,为二分类变量,自变量包括年龄、性别、饮食习惯、是否幽门螺杆菌感染等。

自变量既可以是连续变量,也可以为分类变量。

通过Logistic回归分析,就可以大致了解胃癌的危险因素。

Logistic回归与多元线性回归有很多相同之处,但最大的区别就在于他们的因变量不同。

多元线性回归的因变量为连续变量;Logistic回归的因变量为二分类变量或多分类变量,但二分类变量更常用,也更加容易解释。

1.Logistic回归的用法一般而言,Logistic回归有两大用途,首先是寻找危险因素,如上文的例子,找出与胃癌相关的危险因素;其次是用于预测,我们可以根据建立的Logistic回归模型,预测在不同的自变量情况下,发生某病或某种情况的概率(包括风险评分的建立)。

2.用Logistic回归估计危险度所谓相对危险度(risk ratio,RR)是用来描述某一因素不同状态发生疾病(或其它结局)危险程度的比值。

Logistic回归给出的OR(odds ratio)值与相对危险度类似,常用来表示相对于某一人群,另一人群发生终点事件的风险超出或减少的程度。

如不同性别的胃癌发生危险不同,通过Logistic回归可以求出危险度的具体数值,例如1.7,这样就表示,男性发生胃癌的风险是女性的1.7倍。

这里要注意估计的方向问题,以女性作为参照,男性患胃癌的OR是1.7。

如果以男性作为参照,算出的OR将会是0.588(1/1.7),表示女性发生胃癌的风险是男性的0.588倍,或者说,是男性的58.8%。

撇开了参照组,相对危险度就没有意义了。

Logistic回归分析报告结果解读分析

Logistic回归分析报告结果解读分析Logistic回归常用于分析二分类因变量(如存活和死亡、患病和未患病等)与多个自变量的关系。

比较常用的情形是分析危险因素与是否发生某疾病相关联。

例如,若探讨胃癌的危险因素,可以选择两组人群,一组是胃癌组,一组是非胃癌组,两组人群有不同的临床表现和生活方式等,因变量就为有或无胃癌,即“是”或“否”,为二分类变量,自变量包括年龄、性别、饮食习惯、是否幽门螺杆菌感染等。

自变量既可以是连续变量,也可以为分类变量。

通过Logistic回归分析,就可以大致了解胃癌的危险因素。

Logistic回归与多元线性回归有很多相同之处,但最大的区别就在于他们的因变量不同。

多元线性回归的因变量为连续变量;Logistic回归的因变量为二分类变量或多分类变量,但二分类变量更常用,也更加容易解释。

1.Logistic回归的用法一般而言,Logistic回归有两大用途,首先是寻找危险因素,如上文的例子,找出与胃癌相关的危险因素;其次是用于预测,我们可以根据建立的Logistic回归模型,预测在不同的自变量情况下,发生某病或某种情况的概率(包括风险评分的建立)。

2.用Logistic回归估计危险度所谓相对危险度(risk ratio,RR)是用来描述某一因素不同状态发生疾病(或其它结局)危险程度的比值。

Logistic回归给出的OR(odds ratio)值与相对危险度类似,常用来表示相对于某一人群,另一人群发生终点事件的风险超出或减少的程度。

如不同性别的胃癌发生危险不同,通过Logistic回归可以求出危险度的具体数值,例如1.7,这样就表示,男性发生胃癌的风险是女性的1.7倍。

这里要注意估计的方向问题,以女性作为参照,男性患胃癌的OR是1.7。

如果以男性作为参照,算出的OR将会是0.588(1/1.7),表示女性发生胃癌的风险是男性的0.588倍,或者说,是男性的58.8%。

撇开了参照组,相对危险度就没有意义了。

Logistic回归分析简介

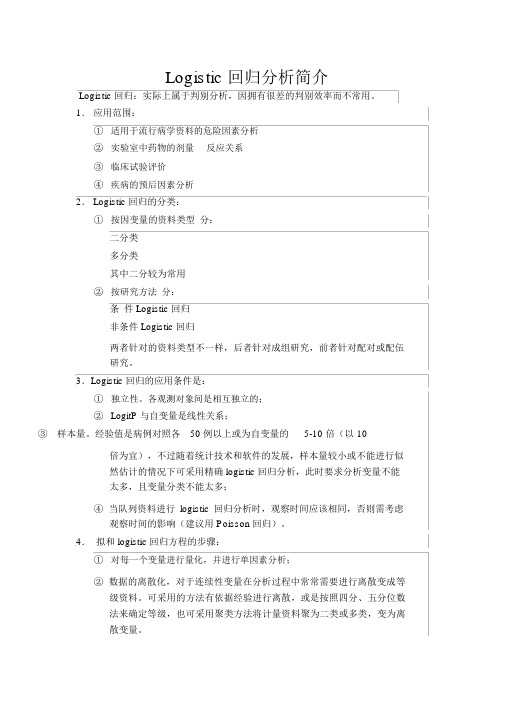

Logistic 回归分析简介Logistic 回归:实际上属于判别分析,因拥有很差的判别效率而不常用。

1.应用范围:①适用于流行病学资料的危险因素分析②实验室中药物的剂量-反应关系③临床试验评价④疾病的预后因素分析2. Logistic 回归的分类:①按因变量的资料类型分:二分类多分类其中二分较为常用②按研究方法分:条件 Logistic 回归非条件 Logistic 回归两者针对的资料类型不一样,后者针对成组研究,前者针对配对或配伍研究。

3.Logistic 回归的应用条件是:①独立性。

各观测对象间是相互独立的;②LogitP 与自变量是线性关系;③样本量。

经验值是病例对照各50 例以上或为自变量的5-10 倍(以 10倍为宜),不过随着统计技术和软件的发展,样本量较小或不能进行似然估计的情况下可采用精确 logistic 回归分析,此时要求分析变量不能太多,且变量分类不能太多;④当队列资料进行logistic回归分析时,观察时间应该相同,否则需考虑观察时间的影响(建议用 Poisson回归)。

4.拟和 logistic 回归方程的步骤:①对每一个变量进行量化,并进行单因素分析;②数据的离散化,对于连续性变量在分析过程中常常需要进行离散变成等级资料。

可采用的方法有依据经验进行离散,或是按照四分、五分位数法来确定等级,也可采用聚类方法将计量资料聚为二类或多类,变为离散变量。

③对性质相近的一些自变量进行部分多因素分析,并探讨各自变量(等级变量,数值变量)纳入模型时的适宜尺度,及对自变量进行必要的变量变换;④在单变量分析和相关自变量分析的基础上,对P≤α(常取0.2,0.15或0.3)的变量,以及专业上认为重要的变量进行多因素的逐步筛选;模型程序每拟合一个模型将给出多个指标值,供用户判断模型优劣和筛选变量。

可以采用双向筛选技术: a 进入变量的筛选用score统计量或 G统计量或 LRS(似然比统计量 ),用户确定 P 值临界值如: 0.05、 0.1 或0.2,选择统计量显著且最大的变量进入模型; b 剔除变量的选择用 Z 统计量(Wald 统计量 ),用户确定其 P 值显著性水平,当变量不显者,从模型中予以剔除。

Logistic回归

2 2 2 3

0 1 1 1

1 1 0 1

1 1 1 0

0 0 0 1

1 0 0 0

2 2 1 3

1 1 1 1

1 1 1 1

学会看结果!

表16-4 例16-2进入方程中的自变量及有关参数的估计值 选入 回归系 标准误 Wald 标准回归 ˆ 2 P值 OR Sb 变量 数b 系数 b’

常数项 X1 X5 X6 X8

单纯从数学上讲,与多元线性 回归分析中回归系数的解释并无不 同,亦即bi表示xi改变一个单位时, logit P的平均变化量。

变量筛选

方法:前进法、后退法和逐步法。 Wald 统计量和计分统计量之一。

检验统计量:不是 F 统计量,而是似然比统计量、

例16-2 为了探讨冠心病发生的有关危险因素,对26

第三节 Logistic回归分析的方法与步骤

一.准备资料:

(一)资料审核: 1.资料的性质: (1)因变量P必须是限于0-1之间的数据或二分类数据(0,1) (2)自变量的要求则随所用的Logistic回归分析方法不同而有所区别。 若采用Logistic判别法,则要求自变量X1,X2,…,XP服从下列①或②或 ③或④。若采用Logistic最大似然法,则要求自变量X1,X2,…,XP服从 下列②或③或④或⑤。 ①要服从多元正态分布且协方差距阵相同 ②自变量X1,X2,…,XP为多元独立的二分类变量 ③自变量X1,X2,…,XP都服从对数正态的离散变量 ④为①和③两项同时存在 ⑤自变量X1,X2,…,XP不一定符合正态分布

例冠心病病人和28例对照者进行病例对照研究,各

因素的说明及资料见表16-2和表16-3。试用logistic 逐

步回归分析方法筛选危险因素。

二分类Logistic回归模型

⼆分类Logistic回归模型 Logistic回归属于概率型的⾮线性回归,分为⼆分类和多分类的回归模型。

这⾥只讲⼆分类。

对于⼆分类的Logistic回归,因变量y只有“是、否”两个取值,记为1和0。

这种值为0/1的⼆值品质型变量,我们称其为⼆分类变量。

假设在⾃变量x1,x2,⋯,x p作⽤下,y取“是”的概率是p,则取“否”的概率是1-p,研究的是当y取“是”发⽣的模率p与⾃变量x1,x2,⋯,x p 的关系。

Logistic回归模型①Logit变换 Logit 变换以前⽤于⼈⼝学领域,1970年被Cox引⼊来解决曲线直线化问题。

通常把某种结果出现的概率与不出现的概率之⽐称为称为事件的优势⽐odds,即假设在p个独⽴⾃变量x1,x2,⋯,x p作⽤下,记y取1的概率是p=P(y=1|X),取0概率是1−p,取1和取0的概率之⽐为p1−p。

Logit变换即取对数:λ=ln(odds)=lnp 1−p②Logistic函数 Logistic中⽂意思为“逻辑”,但是这⾥,并不是逻辑的意思,⽽是通过logit变换来命名的。

⼆元logistic回归是指因变量为⼆分类变量的回归分析,⽬标概率的取值会在0~1之间,但是回归⽅程的因变量取值却落在实数集当中,这个是不能够接受的,所以,可以先将⽬标概率做Logit变换,这样它的取值区间变成了整个实数集,采⽤这种处理⽅法的回归分析,就是Logistic回归。

Logistic函数为:Logit(p)=lnp1−p=Z,p=11+e−2 Logistic回归模型中的因变量只有1和0(如是和否、发⽣和不发⽣)两种取值。

对odds取⾃然对数即得Logistic变换Logit(p)=lnp1−p A。

当p在(0,1)之间变化时,odds的取值范围是(0,+oo),则Logistic函数的取值范围是(-oo,+oo)。

③Logistic回归模型 Logistic 回归模型是建⽴lnp1−p与⾃然变量的线性回归模型。

LOGISTIC回归分类算法

LOGISTIC回归分类算法LOGISTIC回归分类算法是一种用于解决二分类问题的机器学习算法。

它基于逻辑斯特函数来建立分类模型,通过学习得到一个能够将样本映射到指定分类的函数。

接下来,我将详细介绍LOGISTIC回归分类算法的原理、模型建立过程以及算法的优缺点。

一、算法原理LOGISTIC回归分类算法的核心思想是通过逻辑斯特函数(logistic function)来建立分类模型。

逻辑斯特函数是一种S形曲线,可以将输入的连续变量映射到一个预测的概率值。

逻辑斯特函数的表达式如下:P(y=1,x)=1/(1+e^(-z))其中,P(y=1,x)表示样本x属于类别1的概率,e表示自然常数,z表示预测的线性函数,计算公式如下:z=w^T*x其中,w是模型的参数,x是输入的特征。

二、模型建立过程使用LOGISTIC回归分类算法建立分类模型,主要包括以下几个步骤:1.数据预处理:对数据进行清洗、标准化等预处理操作,确保数据的质量和一致性。

2.特征选择:根据问题的需求选择合适的特征。

可以通过统计方法、特征相关性分析等方式进行特征选择。

3.参数估计:使用最大似然估计方法,通过最大化似然函数来估计模型的参数(权重w)。

5.模型评估:对训练好的模型进行评估,常用的评估指标包括准确率、精确率、召回率、F1值等。

可以使用交叉验证等方法来评估模型的泛化能力。

6.模型优化:根据评估结果进行模型优化,可以调整参数、增加新特征、减少特征等操作,不断提升模型性能。

三、优缺点分析1.简单易理解:模型本身简单,使用数学函数来描述,易于理解和实现。

2.计算效率高:计算量较小,对大规模数据集也能够较好地处理。

3.适用性广泛:适用于二分类问题,并且可扩展到多分类问题。

4.可解释性强:模型的输出是概率值,可以用于解释变量对分类结果的影响。

然而,LOGISTIC回归分类算法也存在一些缺点:1.假设限制:该算法假设特征之间是线性相关的,当特征之间存在非线性关系时,模型的性能可能会下降。

LOGISTIC回归

一、回归分析的分类logistic回归(logistic regression)是研究因变量为二分类或多分类观察结果与影响因素(自变量)之间关系的一种多变量分析方法,属概率型非线性回归。

根据1个因变量与多个因变量之分,有以下区分:①一个因变量y:I连续形因变量(y)——线性回归分析II分类型因变量(y)——Logistic 回归分析III 生存时间因变量(y)——生存风险回归分析IV时间序列因变量(y)——时间序列分析②多个因变量(y1,y2,……yn):I 路径分析II 结构方程模型分析在流行病学研究中,常需要分析疾病与各种危险因素间的定量关系,同时为了能真实反映暴露因素与观察结果间的关系,需要控制混杂因素的影响。

(1)Mantel-Haenszel分层分析:适用于样本量大、分析因素较少的情况。

当分层较多时,由于要求各格子中例数不能太少,所需样本较大,往往难以做到;当混杂因素较多时,分层数也呈几何倍数增长,这将导致部分层中某个格子的频数为零,无法利用其信息。

(2)线性回归分析:由于因变量是分类变量,不能满足其正态性要求;有些自变量对因变量的影响并非线性。

(3)logistic回归:不仅适用于病因学分析,也可用于其他方面的研究,研究某个二分类(或无序及有序多分类)目标变量与有关因素的关系。

二、logistic回归分析(一)logistic回归的分类(1)二分类资料logistic回归:因变量为两分类变量的资料,可用非条件logistic回归和条件logistic回归进行分析。

非条件logistic回归多用于非配比病例-对照研究或队列研究资料,条件logistic回归多用于配对或配比资料。

(2)多分类资料logistic回归:因变量为多项分类的资料,可用多项分类logistic回归模型或有序分类logistic回归模型进行分析。

队列研究(cohort study):也称前瞻性研究、随访研究等。

是一种由因及果的研究,在研究开始时,根据以往有无暴露经历,将研究人群分为暴露人群和非暴露人群,在一定时期内,随访观察和比较两组人群的发病率或死亡率。

logistic回归分析

表13-7 例13-2的logistic回归模型自变量筛选结果

模型

因素 X

第1步 常数项

回归系数 标准误

b

Sb

-2.528 0.238

Wald χ2 P值 112.433 <0.001

OR值

OR值95%可信区间 下限 上限

0.080

治疗11周

2.149 0.289 55.267 <0.001 8.578 4.867 15.117

因素 X 常数项

回归系数 标准误

Waldχ2 P值 OR值

b

Sb

-0.910 0.136 44.870 0.000 0.403

OR值95%可信区间

下限

上限

吸烟

0.886 0.150 34.862 0.000 2.424 1.807

3.253

饮酒

0.526 0.157 11.207 0.001 1.692 1.244

logistic回归分析

Logistic regression analysis

• 医学研究中应变量有时是二分类结果,如发病与不 发病、死亡与生存、有效与无效、复发与未复发等, 当需要研究二分类应变量的影响因素时,适合采用 logistic回归分析。

logistic回归属于概率型非线性回归,它是研究二 分类(可以扩展到多分类)反应变量与多个影响 因素之间关系的一种多变量分析方法。logistic回 归模型参数具有明确的实际意义。

OR值的可信区间:

exp(bj - zα/2 Sbj ) ORj exp(bj zα/2 Sb j )

• 例13-1 研究吸烟(X1)、饮酒(X2)与食道癌 (Y)关系的病例-对照资料,试作logistic回归 分析。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

二分类预测准确度研究——基于判别分析和 logistic回归的比较摘要:本文采用CGSS2015数据使用重抽样方法研究判别分析和回归在二分类预测准确度差异。

从样本中抽取不同样本量进行回归分析,结果显示:相同样本量下回归对两类别数据分类的正确率高于判别分析;判别分析对两类别预测的正确率较为接近且稳定,但回归对占比偏少的类别的分类正确率较低;随着样本量的增大,回归对占比较少类别的正确率有明显增加,从而提升总体正确率;判别分析对两类别预测的正确率无明显差异。

关键词:判别分析;回归;预测准确度作者简介:龙潜(1997~),男,贵州省毕节市,贵州师范学院统计学专业在读本科生*通讯作者:令狐雨薇(1987~),女,贵州省遵义市,贵州师范学院讲师,研究方向:社会经济统计、人口统计基金号:贵州师范学院大学生创新训练计划项目(201914223035《二分类预测准确度研究——基于判别分析和回归的比较》);“贵州师范学院大学生互联网+创新创业训练中心”(项目编号:黔教高发[2015]337号、黔教高发〔2017〕158号)1.问题的提出中国知网数据表明,以为关键词的文章有4.86万篇,涵盖了40个学科,有宏观经济管理与发展(占比11.99%)、数学(占比6.74%)、农业经济(占比6.01%)、计算机软件及计算应用(占比5.26%)等;以判别分析为关键词的文章有4376篇,也涵盖了多个学科,其中有医学、生物学和经济管理等领域。

由此可知分类问题在各学科的研究中都会经常遇见,常采用的分类方法有回归、判别分析、聚类分析等,其中回归是最为常用的方法,在多元分析中也较为常用判别分析的方法。

鉴于二分类问题的广泛性与代表性,本文主要探讨二分类问题常采用的方法:回归和判别分析。

回归是采用极大似然估计方法估计模型参数,根据回归的拟合值对观测数据进行分类;而判别分析是根据观测值与两个不同类别间距离差异进行分类,距离包括马氏距离和欧氏距离等。

这两种分类方法简单实用,很多统计软件可以实现相关计算。

它们有着广泛的应用,Biometrics、Biometrical Journal等学术刊物每年都会刊登很多关于判别分析和回归的论文。

尹剑等[1]应用判别分析和回归研究组合分类。

何宇强[2]等借助回归模型研究高速客运专线客流分担率。

Zavg ren[3]利用判别分析和回归对保险公司破产原因进行分析,量化保险公司倒闭前5年的公司金融问题信号,作为金融风险概率显著性的评价方法。

李萌[4]应用模型和判别分析研究商业银行信用风险评估。

白玉峰[5]等在心血管功能进行定量的判别和预测中应用了判别分析。

Lee、Hyun和Urrutia 利用回归模型预测非寿险公司偿付能力,并检测显著影响非寿险公司偿付能力的因素[6]。

马鸿文[7]在花岗岩成因类型的研究中运用了判别分析。

判别分析和回归为解决实际分类问题提供了有价值的信息。

但通过对知网文章的学习发现,现有的关于回归和判别分析的文章大多都是这两种方法的单独应用,极少数的文章会把两种方法比较使用得到分析结果。

也就是说,大多数研究者都只是把研究的问题融入这两种方法进行解决,并没有过多的去关注这两种方法预测精准度的差异。

针对这个问题,本文使用重抽样方法研究判别分析和回归在二分类预测准确度差异,为研究者提供相应问题最优方案以及初学者提供二分类问题常用分析模型的理论基础和指导方向,根据是否符合数据的分析要求、模型的预测精度是否达到最优等问题,选择建立较为合理的二分类问题分析模型,将其使用范围达到最佳,避免误用或缪用的情况,以便使高效和准确并存。

1.二分类预测的原理2.1 判别分析原理用数学语言表述就是,有个维类别,记为 ,…。

对于一个未知样本 ,我们要判断它属于哪一个类别。

解决这个问题的判别方法有很多种,常用的方法有距离判别分析、费歇尔( )判别分析、贝叶斯( )判别分析等。

2.1.1距离判别分析距离判别法根据距离的大小来判别类别。

其基本思路是计算样本到各个类别之间的距离,样本离哪个类别近就属于哪一类。

个维类别 ,…的均值(该类别所有样本的平均值)代表该类的中心,用 ,…表示,协方差矩阵分别为 ,…。

则某未知样本到某类的距离就可以用与之间的距离表示,即。

距离判别采用马氏距离的计算公式为:如果要判断样本是属于类还是类,可以计算:即为距离判别函数。

当时,属于类;时,属于类。

这就是距离判别分析的判别准则。

距离判别分析具有简单、直观、易懂等优点,但是距离判别分析没有考虑到误判对判别结果的影响。

2.1.2费歇尔( )判别分析判别分析的基本思想是方差小的样本倾向于成为一类,而方差大的样本倾向于不同的类。

它的基本思想是投影,找到一个最大的投影方向,使得该方向上样本的组间方差和组内方差的比值达到最大。

用数学语言表述为:对维空间中的点,找到一组线性函数一般的,也就是采用线性变换的方法将多维变量降低到低维。

最佳投影方向即为最佳的判别方法。

因此判别就是求一个线性变化,使所有多维样本降低到一维空间,并使它们组间方差和组内方差的比值达到最大。

判别分析可以总结为如下步骤:(1)把样本分成两类,并计算各类的均值、和协方差矩阵分别为、。

(2)计算投影方向。

经数学推导,的计算公式如下:其中,即协方差矩阵之和。

(3)对于未知样本,计算其投影方向。

并分别计算其与两类的距离和。

(4)计算判别函数,如果,属于第二类,反之,属于第一类。

对于线性可分的样本,判别总能找到一个投影方向,使得降维后得到的样本仍然线性可分,且可分性要更好,即同一类别的样本之间的距离(组内协方差)尽可能的小,不同类别的样本之间的距离(组间协方差)尽可能的大。

但是对线性不可分的样本判别无法确定最佳的分类函数。

2.1.3贝叶斯( )判别分析假设 ,…是预先已知的个类别,为未知样本。

引入概率的概念,样本属于类的先验概率用表示;后验概率用表示;类条件概率用表示。

对于具有两个类别,的问题,在判断未知样本的归属时可能会出现两种误判情况:错判到贝叶斯判别公式充分考虑先验概率和后验概率,坚持最小错判率准则。

贝叶斯公式为:对未知样本观察得分为,则属于第类的概率为:把观察样本并入后验概率最大的类别中。

2.2 归分析原理回归分析采用极大似然估计方法估计模型。

设因变量为,当其取值为1时,代表事件发生:当其取值为0时,代表事件未发生。

影响取值的个自变量为 ,…,假设观察事件在自变量作用下发生的条件概率为,则观察事件在自变量作用下不发生的条件概率为,由上述公式可知,事件发生的条件概率与事件不发生的条件概率都是由自变量构成的非线性函数。

为了计算和应用方便我们引入一个定义:事件的发生比,即事件发生与不发生的概率之比,记为Odds,对Odds进行对数变换,便得到回归模型的线性模型:与判别分析等多元线性分析相比,回归分析具有许多独特的优点,例如对数据的正态性方差齐性不做要求、对自变量的类型不做要求、系数的可解释性等。

3研究方法及分析本文为了研究判别分析和回归在二分类预测准确度差异,采用CGSS2015数据使用重抽样方法分别构建模型并计算各模型的准确度。

原始的CGSS2015数据共有12368条,经过处理筛选后得到可用于分析的样本数据为8539条,为达到研究目的,本文将数据中的定性变量幸福感作为此次研究的因变量,将其划分为两类,幸福为一类,不幸福为另一类,其中幸福感为幸福的数据占有6694条,为不幸福的数据占有1845条。

本文将8539条有效数据分为两个部分,训练集和测试集。

训练集用于构建分类模型,测试集用于检验分类模型的正确率。

通常情况下,在全部样本中抽取一定比例的样本作为训练集构建分类模型,在实际应用中,有时也将全部样本作为训练集进行模型的构建,计算模型对测试集的预判正确率,预判正确率最低的模型是最优的。

本文在训练集样本的抽样时,采用重抽样方法,从全部样本量的5%开始随机抽样作为训练集进行模型的构建并计算各模型的预测正确率,然后逐渐增大随机抽样的比例,直至全部样本作为训练集。

抽样比例确定后,对全部样本进行随机抽样,利用判别分析和回归进行分类,得到分类模型,将测试集用模型进行预测与测试集的原始结果相比较,计算预测正确率。

每个抽样比例下抽样过程重复200次,研究同一抽样比例下模拟结果的波动以及两种分类方法的预测正确率。

判别分析和回归的预测正确率平均值比较见表一。

表一不同情况下预测测结果汇总表训练集占比(%)回归判别分析幸福预测不幸福预总正幸福预测不幸福预总正正确率测正确率确率正确率测正确率确率595.20%39.60%82%74.50%73%73.80%1 095.10%30.10%81.90%73.40%72.80%72.90%1 595.70%36.70%83.40%74.50%71.10%73%2 095.20%32.50%82.40%74.50%70%73.40%2 595.60%34.80%83.80%75.10%69.80%73.90%3 095.70%28.80%83.60%74.40%69.70%73.50%3 595.60%33.60%84.50%74.50%71%73.70%4 095.80%30.40%84.90%75.10%71.80%74.40%4 595.70%33.20%84.80%74.90%71.40%74.20%5 095%35.30%85.30%75.70%71.20%74.70%5 595.60%34.70%85.30%75.10%70.20%74.90%6 095.60%35%85.70%75.20%72.20%75.30%6 595.60%34.70%85.40%74.80%71.60%75.70%7 095.50%35.10%85.70%75%71.90%75.90%7 595.30%36.20%86.10%74.60%71.70%75.60%8 095.60%36.10%86.50%74.30%72.60%76.30%8 595.40%35.90%86.30%75.80%73%77%9 095.40%35.60%86.30%75.60%73.40%77.70%9 595.40%36.50%87.10%76.30%73%78.40%1 0095.40%36.90%87.20%76.60%73.10%78.60%结果表明,在不同的抽样比例下,回归的正确率都优于判别分析,但在同一比例抽样中,回归对占比大的类别的分类正确率远高于对占比小的类别的分类正确率,而判别分析对不同类别的分类正确率无明显差异。

在重复抽样过程中,抽样比例为5%时,回归的正确率最高为89%,最低为65%,200次实验的正确率平均值为82%,抽样比例为100%时,回归的正确率最高为90.3%,最低为83%,200次实验的正确率平均值为87.2%。