科大讯飞语种识别系统介绍

IVR简要介绍及应用

IVR,(Interactive Voice Response)即互动式语音应答,您只须用电话即可进入服务中心,可以根据操作提示收听手机娱乐产品,也可以根据用户输入的内容播放有关的信息。

业务意即无线语音业务增值服务,和大家熟知的固定电话声讯服务类似。

手机用户拨打指定号码,获得所需信息或者参与互动式的服务。

最常见的业务有:1 语音点歌2 语音聊天交友3 手机杂志4 电子贺卡5 客服中心6交互式语音IVR,即语音增值业务,是移动运营商由2002年开始启动的业务。

移动的IVR主要有12530彩铃业务,联通的IVR品牌为联通音。

市场市场运营IVR业务的SP包括雷霆无极、腾讯、鸿联九五、云通讯平台、新浪。

其中,TOM旗下的雷霆无极占有国内市场70%的份额。

据中移动预计,2014年国内IVR业务的市场规模将达到25亿人民币左右,当然,这一数据相对乐观。

但是不可否认,IVR也必将成为无线增值服务中的重量级业务之一。

现有的IVR业务包括彩铃(移动自己运营)、在线点歌、语音信息服务、语音游戏、多方会议、背景音乐通话以及聊天交友等等(部分由科大讯飞公司运营)。

实质上,IVR业务主要是复制以前声讯台的业务模式,同时也提供了虚拟身份的主题聊天和点对点聊天业务。

现阶段,IVR业务的进入门槛主要体现在IVR业务资质申请的难度上。

IVR业务的技术门槛其实相当低。

SP向运营商申请接入号码资源,购买相应的语音平台设备与运营商的语音网关进行信令/话务中继的连接,搭建自己的服务系统(硬软方案十分成熟),创建自己的语音业务流程后,即可开展IVR业务了。

应用IVR另一重要应用是在呼叫中心中,分为前置和后置,前置IVR是语音先进入IVR处理,在无法解决客户问题的情况下才转入人工座席。

后置IVR是指IVR与人工座席处在平衡的位置,人工无法满足客户入话时转IVR,主要是为了拖延时间或增值服务。

Vlan 之间的路由IVR:Vlan 之间的路由(Inter-Vlan Routing,这里简写为IVR)行业应用1 IVR可应用于许多行业。

科大讯飞说明书

字体:设置文档中字体格式。

边框颜色:设置工作区内绘制的矩形、椭圆形、直线、虚线、多边形的边框颜色以及文本颜色。

填充颜色:设置工作区内绘制的矩形、椭圆形、多边形的内部填充颜色。

透明色:消除选定的矩形、椭圆形或多边形的内部填充色。

锁定文本位置:文本位置固定不动,但是可以进行删除操作。

背景颜色:设置当前页的背景颜色。

三、软件卸载

如果您要升级iFlytekBoard软件,请先卸载原软件,再按前面介绍的步骤安装升级软件。卸载本软件的方法:

点击“开始”菜单,打开“设置”中的“控制面板”,双击“添加/删除程序”,选择“iFlytekBoard”下的“删除”选项,即可卸载,如。

图3.3.1

点击“开始”菜单,打开“程序”中的“iFlytekBoard”,选择“UninstalliFlytekBoard”卸载本程序。

北京瑞麟百嘉科技有限公司将始终以技术优势与人才优势为坚强后盾,以公司的规范化管理与模式化经营为保障,真诚对待每位用户!

iFlytekBoard数码互动白板是由北京瑞麟百嘉公司自主研发的高科技产品,这款产品的人性化设计,让您使用起来更加便捷。通过iFlytekBoard数码互动白板,您可以控制计算机,也可以在数码互动白板上书写、注释或图解。无论是Word文件,还是PowerPoint演示文档、图片等,都可以通过数码互动白板进行修改、标注、储存和打印。并且您在数码互动白板上的操作过程及声音都可以录制为AVI格式的视频文件保存下来,方便您以后重复播放和研究。借助Internet,还可以满足您异地沟通和交流的需要,使分布在世界各地的人员如同在同一房间内进行演讲、讨论,实现了多点之间的远程互动。

热爱事业善于分享教学心得教学经验希望在这个平台能相互共赢

科大讯飞语音识别讲义

端点检测开发接口(ISR end-pointer detection API),识别引擎中 与端点检测相关的开发接口。

ISR REC API

语音识别开发接口(ISR Recognize API),识别引擎中与识别器相 关的开发接口。

主要内容

• 语音识别系统简介 • 语音识别接口介绍 • 基于讯飞语音识别系统SDK的开发

POI检索

中国科学技术大学 安徽大学

北京科技大学 科大讯飞

通过投票机制,评价每个条目的得分,综合未出现音的影 响,可以提供检索结果的候选,并可忽略顺序的影响

POI检索-编辑距离

Ke1 ji4 da4 xue2

中国科学技术大学 安徽大学

北京科技大学 科大讯飞

命令词识别系统的评估

• 假如在N句集内语音中

– 有M1句得到正确识别结果 – 有M2句得到错误识别结果 – 剩下的没有识别结果

• 评价参数

正确识别率 = (?M1/N)

命令词识别系统的评估

• 假如在N句集外语音中,

– 有M句没有识别结果 – 剩下的错误识别

• 评价参数

– 错误接受率 = 1?- (M/N)

– 解码算法只会寻找最大可能的路径,对集外词无拒 识能力

– 解码算法因模型及近似的原因,对集内词识别也不 一定正确

置信度的应用

• 优化用户交互界面

– 高置信度

• 直接默认识别准确

– 中置信度

• 有必要让用户再次确认

– 低置信度

• 默认识别错误,需要再次识别或者转人工坐席

• 置信度门限的确认

– false accept、false reject – EER: equal error rate

科大讯飞直播字幕原理

科大讯飞直播字幕原理全文共四篇示例,供读者参考第一篇示例:科大讯飞(iFlytek)是一家领先的智能语音和语言技术提供商,其直播字幕技术在直播行业得到广泛应用。

直播字幕是指在直播过程中实时生成的文字,并显示在屏幕上,帮助观众更好地理解主播的讲话内容。

下面我们来详细了解一下科大讯飞直播字幕的原理。

一、语音识别技术科大讯飞直播字幕的核心技术之一是语音识别技术。

通过语音识别技术,系统可以将主播的讲话内容实时转换为文字信息。

这一过程包括语音信号的采集、预处理、特征提取和模式匹配等多个步骤。

科大讯飞的语音识别技术在准确性和速度上都具有很高的水平,能够满足直播行业对实时性和准确性的需求。

二、语义理解技术除了语音识别技术,科大讯飞直播字幕还应用了语义理解技术。

通过语义理解技术,系统可以更好地理解主播的讲话内容,并将其转换为更加准确和生动的文字。

语义理解技术可以识别出主播所说的内容的关键信息,并根据语境进行处理,使得文字更加通顺和易懂。

三、机器学习算法科大讯飞直播字幕的实现还离不开机器学习算法的支持。

机器学习算法可以通过分析大量数据,不断调整和优化模型,提高系统的准确性和稳定性。

科大讯飞的机器学习算法能够在短时间内适应各种场景和语音特点,并不断提升系统的性能。

四、实时性和稳定性科大讯飞直播字幕技术具有很高的实时性和稳定性。

系统可以在毫秒级的时间内实现语音到文字的转换,并且保持良好的稳定性,不受环境噪音和说话速度的影响。

这使得科大讯飞的直播字幕技术能够在各种在线直播场景下稳定运行,并且满足观众对实时性的需求。

五、应用场景科大讯飞直播字幕技术已经在各种直播平台上得到广泛应用。

无论是体育赛事直播、新闻报道直播还是线上教育直播,都可以看到科大讯飞直播字幕的身影。

直播字幕不仅可以帮助听障人士理解直播内容,还能为一些不擅长听力理解的观众提供帮助,提升直播的用户体验。

科大讯飞直播字幕技术是通过语音识别、语义理解和机器学习算法等多种技术的综合应用,实现了语音到文字的实时转换,为在线直播提供了更加智能和便利的服务。

国家普通话水平智能测试系统

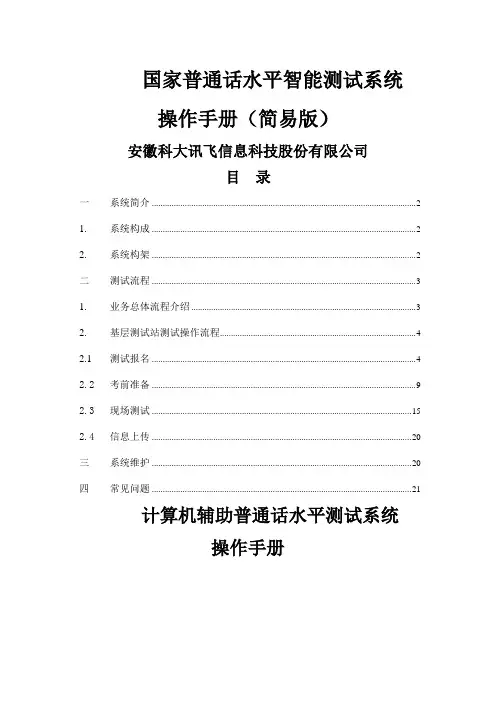

国家普通话水平智能测试系统操作手册(简易版)安徽科大讯飞信息科技股份有限公司目录一系统简介 (2)1.系统构成 (2)2.系统构架 (2)二测试流程 (3)1.业务总体流程介绍 (3)2.基层测试站测试操作流程 (4)2.1测试报名 (4)2.2考前准备 (9)2.3现场测试 (15)2.4信息上传 (19)三系统维护 (20)四常见问题 (20)计算机辅助普通话水平测试系统操作手册一系统简介1.系统构成科大讯飞提供的普通话测试系统不仅能够对考生的普通话进行智能评测,还能够对考试现场和测试流程以信息化的方式管理,实现了国家普通话水平测试的测试、组织和管理的信息化,该系统主要包括两个部分:●国家普通话水平智能测试系统国家普通话水平智能测试系统(PSCP)是安徽科大讯飞信息科技股份有限公司在国家语委“十五”重点科研项目支持下研发完成。

系统基于国家普通话水平测试大纲,可准确地对命题说话之外的所有测试题型实现自动评测,同时自动检测发音者存在的语音错误和缺陷;而且系统提供的测试管理功能,也能够帮助基层测试站组织测试,提高测试的效率。

该系统部署在基层测试站,主要使用者为考生和基层测试站的管理人员。

●国家普通话水平测试信息管理系统国家普通话水平测试信息管理系统(PSCW)实现的是普通话水平测试全过程的计算机管理,为计算机辅助测试全面解决方案提供支撑平台。

在该系统中,可以进行考生报名、测试员打分、成绩管理、数据管理等一系列操作。

该系统部署在远程WEB服务器上,相关人员通过登录网页完成相应的操作,主要使用者为省级测试管理人员、基层测试站的管理人员和测试员。

2.系统构架普通话测试系统解决方案的构架图如下:二测试流程1.业务总体流程介绍科大讯飞提供的普通话测试系统通过国家普通话水平智能测试系统和国家普通话水平测试信息管理系统的结合,实现了普通话测试全流程的信息化和网络化,总体业务流程如下图:从该流程中可以看到,测试站在测试过程中主要进行了四项操作,分别为测试报名、考前准备、现场测试、信息上传,下面我们就以上四项操作进行详细介绍。

科大讯飞 MSC 集成指南说明书

科大讯飞股份有限公司IFLYTEK CO.,LTD. 科大讯飞MSC集成指南目录1. 概述 (1)2. 预备工作 (2)Step 1 导入SDK (2)Step 2 添加用户权限 (2)Step 3 初始化 (3)3. 语音输入UI (5)4. 语音听写 (6)4.1. 上传联系人 (7)4.2. 上传用户词表 (7)5. 命令词识别(语法识别) (9)5.1. 在线命令词识别 (9)5.1.1. 应用级命令词识别 (9)5.1.2. 终端级命令词识别 (11)5.2. 离线命令词识别 (12)6. 语音合成 (13)7. 语义理解 (14)7.1. 语音语义理解 (14)7.2. 文本语义理解 (14)8. 本地功能集成(语记) (15)8.1. 本地识别 (15)8.2. 本地合成 (16)8.3. 获取语记参数 (16)9. 语音评测 (17)10. 唤醒 (19)11. 声纹密码 (19)11.1. 声纹注册 (19)11.2. 声纹验证 (21)11.3. 模型操作 (21)12. 人脸识别 (22)12.1. 人脸注册 (22)12.2. 人脸验证 (23)12.3. 人脸检测 (23)12.4. 人脸聚焦 (23)13. 附录 (24)13.1. 识别结果说明 (24)13.2. 合成发音人列表 (25)13.3. 错误码列表 (26)13.4. 声纹业务 (27)13.5. 人脸识别结果说明 (28)常见问题 (29)1. 概述本文档是集成科大讯飞MSC (Mobile Speech Client ,移动语音终端)Android 版SDK 的用户指南,介绍了语音听写、语音识别、语音合成、语义理解、语音评测等接口的使用。

MSC SDK 的主要功能接口如下图所示:图1 MSC 主要功能接口为了更好地理解后续内容,这里先对文档中出现的若干专有名词进行解释说明:表1 名词解释2.预备工作Step 1 导入SDK将开发工具包中libs目录下的Msc.jar和armeabi复制到Android工程的libs目录(如果工程无libs目录,请自行创建)中,如下图所示:图 2 导入SDK如果您的项目有libs/armeabi-v7a这个目录,请务必把libmsc.so复制一份到这个目录。

普通话模拟测试与学习系统平台操作指南

“普通话模拟测试与学习系统”平台操作指南第一部分平台介绍“普通话模拟测试与学习系统”平台需在学校局域网内运行,提供和国家正式普通话水平测试完全一致的全真模拟测试功能。

考生完成模拟测试之后,系统会自动对考生普通话水平进行评测,给出全面诊断报告。

通过该诊断报告,用户可以轻松了解自己的普通话水平,包括普通话水平等级、分数以及发音存在的主要问题。

系统还提供标准的学习训练语料,学习者可以参照标准发音进行学习。

在学习的过程中,系统通过科大讯飞国际领先的口语评测技术,针对学习者的发音从声母、韵母、声调三方面进行精准评测。

如果学习者在正式学习之前进行了模拟测试,系统会根据模拟测试结果自动提供针对性的学习语料,以便学习者针对性地进行训练,快速提高普通话口语水平。

第二部分登录信息1.平台登录网址:http://172.18.45.2/2.教职工登录账号:教职员工号3.学生登录账号:学生学号4.所有账户密码:1111(切忌:进入平台后不可更改密码)第三部分:普通话学习平台操作演示一.客户端打开“普通话智能评测及学习系统”网页,首页界面如下图所示:普通话模拟测试在学习平台首页上,点击“进入测试”按钮,即可开始普通话全真模拟测试,让你及时发现自己在普通话发音时的优势与不足之处,以便后续能进行有针对性的学习:试卷预览工具用户在开始测试之前有预览试卷的机会,总共四题,界面如下:测试过程1 考生登录:智能测试软件启动之后,系统弹出佩戴耳机的提示,请点击“下一步”按钮继续。

进入用户登录页面,确认准考证号之后点击“进入”。

如下图:注意:正式测试的登录界面中考生需要手动填写本人真实准考证号的后四位,再点击“确认”继续。

2 信息确认:考生登录后,系统进入信息确认界面。

点击“确认”,开始测试。

考生在测试过程中应注意如下事项:1)每一题测试前系统都会有一段提示音,请在提示音结束并听到“嘟”的一声后,再开始朗读。

2)考试过程中,请以适中的音量答题。

讯飞英语通Y1产品使用说明书

喇叭MIC 2 耳机孔电源键音量+语音键TYPE-C 接口MIC 2音量-外观介绍产品使用说明手册产品型号:YYT-Y1包装内容1、主机2、USB 数据线3、防蓝光钢化保护膜4、适配器5、专用硅胶保护壳产品概述卡槽位置电源键:长按—3秒开/关机,长按—10秒以上强制关机,短按—进入休眠/结束休眠。

语音键:长按右侧语音键,快速进入查词翻译,即使锁屏状态也可一键拼读查词和翻译;在课文跟读、AI 对话实战,跟读评测等众多功能中,都可按住语音键进行语音交互。

音量:音量加/音量减。

充电接口:USB 2.0, Type-C 。

电源适配器:5V/1A ,Type-C 。

电池:最高电压4.35V ,最大容量2200mAh ,最长待机7天。

数据说明:以上数据来源于自讯飞实验室,根据实际使用情况不同数据会略有差异,请以实物为准。

运行内存:3G机身存储:32G存储扩展: 64G TF 卡。

WiFi 联网网:2.4GHz 802.11 b / g / n 。

4G 联网:国内4G 全网通,双卡双待,TD-LTE 、 FDD-LTE 。

蓝牙通信:BLE4.2。

耳机接口:3.5mm 接口。

扬声器:瑞声AAC BOX 。

麦克风:双麦克降噪拾音系统。

产品尺寸:139.4*74*9.7 mm 。

产品重量:136g 。

电磁辐射指标:电磁辐射比吸收率(SAR )最大值为2.0W/Kg 。

拆开后盖便可插卡,下图为SIM 卡、TF 卡插槽位置。

功能描述1、课堂同步学习教材同步辅导练习,全面掌握!全国主流英语教材同步,复读、背诵、听写、视频讲解、课后练、单元测。

人工智能老师自动批改、全面掌握课内知识。

课文、单词、视频均支持离线使用,有网时下载到机器,无网时照常使用,真正做到随身学随时学。

a 、课文背诵朗读覆盖小学-高中20版主流教材的课文,支持课文听音频、跟读朗读。

搭载了讯飞语音评测技术,精确测评用户跟读朗读时的发音情况,让学生口语发音越来越标准。

语音云开放平台_开放语音合成、语音识别、语音搜索、声纹识别等语音技术_免费快速开发移动互联网语音应用6

您好,欢迎来到语音云开放平台! 请登录 免费注册首页平台介绍在线演示开发者专区下载专区应用推荐语音通行证论坛语音平台· 什么是MSP· 为何选择MSP· MSP 主要功能语音技术· 语音合成· 语音识别语音转写首页 > 平台介绍注册 | 申请appid | SDK 下载 | 开发文档 | 新手教程 | 常见问题 | 语音云社区 | 诚聘英才 | 邮件反馈科大讯飞 | 语音云官方网站 | 讯飞输入法 | 讯飞语点 | 讯飞口讯 | 开心熊宝 | 悠听 | 语音电子书安徽科大讯飞信息科技股份有限公司Copyright©2012 皖ICP 备05001217号目录[隐藏]1. 语音转写1.1 什么是语音转写1.2 讯飞的语音转写技术怎么样1.3 MSP 语音转写云服务特点1. 语音转写1.1 什么是语音转写语音转写是基于自然语言处理技术,将自然语言转换为文本输出。

自然语言处理技术所涵盖的研究内容非常广泛,从研究成果的表现形式来说,基本可以分为基础研究和应用研究两大类:基础研究:主要指对自然语言内在规律的研究,从研究深度和难度上大致可以划分为词典编撰、分词断句、词性分析、语言模型、语法分析、语义分析、语用分析等等。

应用研究:主要指基于基础研究的成果,面向不同的应用,研发相关的自然语言处理技术,大的方向至少包括:拼音输入法、信息检索、信息抽取、自动摘要、机器翻译、语音合成、语音识别、文本匹配、文本分类、对话系统等。

自然语言处理技术中最核心的自然语言理解技术,从进展和目前所取得的成果来说,都与人们的普遍预期有较大差距。

但是随着自然语言处理技术的研究积累,以及计算机技术水平的快速发展,越来越多的自然语言处理技术正逐步走向实用,并且创造了巨大的经济价值和社会价值。

互联网、电子文本、短消息、语音通讯等等自然语言媒介的快速增长,也为自然语言处理技术的研究和应用提供了非常好的机遇。

语音云开放平台_开放语音合成、语音识别、语音搜索、声纹识别等语音技术_免费快速开发移动互联网语音应用3

您好,欢迎来到语音云开放平台! 请登录 免费注册首页平台介绍在线演示开发者专区下载专区应用推荐语音通行证论坛语音平台· 什么是MSP· 为何选择MSPmsp 主要功能语音技术· 语音合成· 语音识别· 语音转写首页 > 平台介绍目录[隐藏]1. MSP 主要功能1.1 概述1.2 语音合成1.3 语音识别1.4 语法功能1.5 语音听写1.6 开发功能1. MSP 主要功能1.1 概述MSP 语音云平台目前集成了语音识别引擎InterReco 、语音合成引擎InterPhonic 、语音听写引擎IAT ,能够提供语音合成、语音识别、语音听写等语音服务,产品的功能也能够体现这些语音引擎的特点。

1.2 语音合成InterPhonic 语音合成系统是科大讯飞公司推出的新一代文语转化引擎,采用最先进的中文文本、韵律分析算法和大语料库的合成方法,合成语音已经接近真人的自然效果。

主要功能有:1) 高质量语音,将输入文本实时转换为流畅、清晰、自然和具有表现力的语音数据;2) 多语种服务,整合了多语种语音合成引擎,可提供中文、中英文混读、纯正英文、粤语、粤英文混读的语音合成服务;3) 多音色服务,提供丰富、风格多样化的音色选择,如浑厚淳正的男声,温柔甜美的女声,标准地道的英语男女声等等,所有音色库均继承科大讯飞语音合成技术一贯的优良品质。

用户可供根据不同应用业务需要,选择最适合应用场景的语音风格,并支持实时动态的音色切换;4) 高精度文本分析技术,保证了对文本中未登录词(如地名)、多音字、特殊符号(如标点、数字)、韵律短语等智能分析和处理;5) 多字符集支持,支持输入GB2312、GBK 、Big5、Unicode 和UTF-8等多种字符集,普通文本和带有CSSML 标注等多种格式的文本信息;6) 多种数据输出格式,支持输出多种采用率的线性Wav ,A/U 率Wav 和Vox 等格式的语音数据;7) 提供预录音合成模板,对合成文本中符合语音模板固定成分的文本使用发音人预录语音,非固定成分使用合成语音。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

. . .

德语模型得分

得 分 归 一 化

. . .

德语模型得分

Pick

识别结果

Max

粤语模型得分 汉语模型得分 吴语模型得分 汉语模型得分

图7 GMM-MMI测试流程

Acoustic系统—GMM-SVM系统

图8 GSV系统框图

GMM-SVM系统

模型训练部分 三个关键部分 1. GMM Super Vector:每条语音,采用最大后验概率(Maximum a posteriori,MAP)准则 ,从UBM 中自适应得到这条语音的GMM 模型,然后将所有高斯的每一维均值向量按照 顺序排列起来,构成一个超矢量作为SVM的输入,就称为GMM Super Vector 2. SVM模型的均值核函数和均值方差核函数 GMM只更新均值时

GMM同时更新均值方差 3. Model-Pushing技术

谢 谢

SDC

VAD

CMS

特征 高斯化

特征端 FA

最终特征

1) MFCC: 语种识别系统中,仅使用MFCC(Mel-Frequency Cepstral Coefficient)的C0~C6前7阶参数, 后面在此基础上,进行SDC扩展。 2)VTLN 声道长度规整(Vocal Tract Length Normalization,VTLN),将每个人的声道规整到统一的长 度上,用来减弱不同发音人带来的影响。

图4 特征提取顺序

3)RASTA RelAtive SpecTrAl这个词组的简称,是Hynek Hermansky等人根据人类语音听觉感知对于 激励源缓变不敏感的这种特性,提出的一种对于语音参数的时间轨迹进行滤波,以便从 语音的参数表示中减小非语音部分的频谱部分的方法,是一种经验性的滤波器:

特征提取模块(2)

MFCC (C0~C6)

训练语料

基于MLE的语种模型 MMI迭代 基于MMI的语种模型

RASTA

SDC

VTLN 特征 选择

VAD

CMS 测试语料 特征高斯化 识别 高斯后端

特征端FA

识别结果

图3 GMM-MMI系统流程图

特征提取模块(1)

VTLN 特征选择

语 音 信 号

MFCC (C0~C6)

RASTA

GMM-MMI系统测试流程

高斯后端分类器

美国英语模型得分 英语模型得分 印度英语模型得分 法语模型得分 法语模型得分 法语模型得分 英语模型得分

各 语 种 测试语句 MMI 模 型

日语模型得分

L D A

. . .

普通话模型得分

测试语句 得分向量

各 语 种 单 高 斯 模 型

日语模型得分

日语模型得分

Acoustic 测试语音 前端语音处理模块 Fusing 识别结果

PR

图1:语种识别系统框架

Acoustic系统介绍

Acoustic系统 基于Acoustic的语种识别由于其稳定性和鲁棒性,在语种识别中获得的广泛的应用, 是历届NIST LRE比赛中不可缺少的基本系统之一。Acoustic系统又包括GMM-MMI 系统和GMM-SVM两种建模方式:

GMM-MMI 测试语音

高斯后端分类器 Acoutic得分 Fusing

架

Acoustic系统--GMM-MMI系统框架

GMM-MMI系统可以分成三大块:特征提取模块、模型训练模块以及测试模块,下面分别介绍三个部分

语音信号

UBM模型 MLE迭代

4) SDC: Shifted Delta Cepstra 也称为移位差分倒谱特征

特征提取模块(3)

(5)Voice Activity Detection--VAD对识别性能影响很大,在语种识别系统中主要采用基于能 量四门限的VAD技术 (6)倒谱均值相减(Cepstral Mean Subtraction,CMS) 基于不变信道的假设一种外部信道估计。信道的噪声可以看成是信道固定的系统畸变和 随机信道传输噪声(认为是白噪声)的和。倒谱参数上减去均值,相应的也就去除了调 制噪声。 (7)特征高斯化 语种识别所用参数,本身都是随机矢量,因而具有相应的概率分布,训练和识别信道的 不匹配也就体现在概率分布的差别上。受实际环境的影响,特征参数的概率分布往往发 生改变。对特征参数进行规整,使得训练和识别时候的特征参数的概率分布比较接近, 这样两者之间不匹配的问题就应该能得到改善。 (8)特征端FA 特征域方法的因子分析可以当成一种鲁棒性前端的算法,就是对特征直接去掉噪声的部 分,得到相对“干净”的数据,主要在于去噪 。

图6 高斯后端训练步骤

•

高斯后端分类器 包括LDA变换矩阵和各语种模型的单高斯的GMM模型。

•

• •

开发集的选择:一般要包括和测试集一样的语种类别,并且数据类型要和测试集尽量的相似 ,并且不能和训练集有任何的重合,否则会造成开发集得分和测试集得分mismatch LDA训练:各语种的测试得分向量通过LDA降维,提取更有区分性的分量,将原始的N维得 分向量减为维数为N-1(N为语种总种类)。 各语种单高斯模型的训练:在开发集上利用LDA得到的各语种的得分向量,训练各语种的单 高斯模型(每个语种一个模型)。

GMM-MMI系统模型训练

UBM训练: 1. K-Means聚类得到UBM模型的初始化模型 2. EM算法迭代训练得到UBM模型

各语种GMM训练 1. 各语种数据在UBM模型基础上MLE估计出各 语种模型 2. MMI区分性准则下训练增加各语种之间的区分度

图5 UBM-GMM训练步骤

GMM-MMI高斯后端训练

语种识别系统介绍

安徽科大讯飞信息科技股份有限公司 Anhui USTC iFlyTEK Co., LTD

提纲

• 语种识别系统框架 • Acoustic-GMM系统介绍 • Acoustic-GSV系统介绍

语种识别系统框架

• 现有语种识别系统的主流方法包括基于Acoustic的方案和基于Phone Recognize的 方案,这两种系统由于建模方法等的差异,具有较好的互补性