实验四、RBF神经网络实验报告

基于RBF神经网络的燃煤火电机组脱硝自动控制

基于RBF神经网络的燃煤火电机组脱硝自动控制近年来,环境污染问题日益突出,燃煤火电机组脱硝技术被广泛应用于减少氮氧化物排放。

为了提高脱硝效率和降低运行成本,科学家和工程师们研究并发展了各种控制方法。

本文将介绍一种基于RBF神经网络的燃煤火电机组脱硝自动控制方法。

1. 燃煤火电机组脱硝技术概述燃煤火电机组脱硝是通过将氨水喷入锅炉烟道尾部,与氮氧化物发生催化反应,将其转化为氮气和水蒸气。

常见的脱硝技术包括选择性催化还原法(SCR)和选择性非催化还原法(SNCR)。

而为了提高脱硝效率以及降低氨气的消耗量,自动控制方法成为了研究的重点。

2. RBF神经网络在自动控制中的应用RBF神经网络是一种广泛应用于自动控制领域的人工神经网络。

其具有良好的非线性逼近能力和自适应学习能力,可以帮助提高系统的控制性能。

在燃煤火电机组脱硝自动控制中,RBF神经网络可以用于建模、预测和优化控制。

3. RBF神经网络建模要建立有效的自动控制系统,首先需要准确建立燃煤火电机组脱硝过程的数学模型。

RBF神经网络可以通过学习数据集中的样本,自动拟合出一个高度精确的数学模型。

然后,该模型可以用于预测脱硝过程中的关键参数和变量。

4. RBF神经网络预测与优化控制通过建立有效的RBF神经网络模型,可以进行系统状态的预测。

预测结果可以用于调整氨气的喷入量,以实现脱硝效率的最大化。

此外,RBF神经网络还可以通过在线学习的方式,对系统参数进行优化调整,进一步提高脱硝效率和降低氨气消耗量。

5. 实验设计与结果分析为了验证基于RBF神经网络的燃煤火电机组脱硝自动控制方法的有效性,进行了一系列实验。

通过收集实验数据并进行分析,证明了该方法在提高脱硝效率和降低氨气消耗量方面的优势。

6. 结论本文介绍了一种基于RBF神经网络的燃煤火电机组脱硝自动控制方法,并通过实验验证了其有效性。

该方法可以帮助实现燃煤火电机组脱硝过程的智能化和优化控制,减少氮氧化物的排放,保护环境。

神经网络控制(RBF)

神经网络控制(RBF)神经网络控制(RBF)是一种基于径向基函数(RBF)的神经网络,用于控制系统,其主要功能是通过对输入信号进行处理来实现对系统输出的控制。

通过神经网络控制,控制器可以学习系统的动态行为和非线性模型,从而使得控制器能够自适应地进行调整和优化,实现对系统的精确控制。

RBF 网络通常由三层组成:输入层、隐藏层和输出层。

输入层接受系统的输入信号,并将其传递到隐藏层,隐藏层对输入数据进行处理并输出中间层的值,其中每个中间层神经元都使用一个基函数来转换输入数据。

最后,输出层根据隐藏层输出以及学习过程中的权重调整,计算并输出最终的控制信号。

RBF 网络的核心是数据集,该数据集由训练数据和测试数据组成。

在训练过程中,通过输入训练数据来调整网络参数和权重。

训练过程分为两个阶段,第一阶段是特征选择,该阶段通过数据挖掘技术来确定最优的基函数数量和位置,并为每个基函数分配一个合适的权重。

第二阶段是更新参数,该阶段通过反向传播算法来更新网络参数和权重,以优化网络的性能和控制精度。

RBF 网络控制的优点在于其对非线性控制问题具有优秀的适应性和泛化性能。

另外,RBF 网络还具有强大的学习和自适应调整能力,能够学习并预测系统的动态行为,同时还可以自动调整参数以提高控制性能。

此外,RBF 网络控制器的结构简单、易于实现,并且具有快速的响应速度,可以满足实时控制应用的要求。

然而,RBF 网络控制也存在一些局限性。

首先,RBF 网络需要大量的训练数据来确定最佳的基函数数量和位置。

此外,由于网络参数和权重的计算量较大,实时性较低,可能存在延迟等问题。

同时,选择合适的基函数以及与其相应的权重也是一项挑战,这需要在控制问题中进行深入的技术和经验探索。

总体而言,RBF 网络控制是一种非常有效的控制方法,可以在广泛的控制问题中使用。

其结构简单,性能稳定,具有很强的适应性和泛化性能,可以实现实时控制,为复杂工业控制问题的解决提供了一个重要的解决方案。

神经网络 实验报告

神经网络实验报告神经网络实验报告引言:神经网络是一种模仿人脑神经元网络结构和功能的计算模型,它通过学习和训练来实现模式识别、分类和预测等任务。

本次实验旨在探索神经网络的基本原理和应用,并通过实践验证其效果。

一、神经网络的基本原理1.1 神经元模型神经元是神经网络的基本单元,它接收来自其他神经元的输入信号,并通过激活函数进行处理后输出。

我们采用的是Sigmoid函数作为激活函数,它能够将输入信号映射到0到1之间的值。

1.2 神经网络结构神经网络由输入层、隐藏层和输出层组成。

输入层接收外部输入的数据,隐藏层用于处理和提取特征,输出层给出最终的预测结果。

隐藏层的数量和每层神经元的数量是根据具体问题而定的。

1.3 反向传播算法反向传播算法是神经网络中最常用的训练算法,它通过计算误差和调整权重来不断优化网络的预测能力。

具体而言,它首先进行前向传播计算得到预测结果,然后计算误差,并通过链式法则将误差反向传播到每个神经元,最后根据误差调整权重。

二、实验设计2.1 数据集选择本次实验选择了一个手写数字识别的数据集,其中包含了大量的手写数字图片和对应的标签。

这个数据集是一个经典的机器学习数据集,可以用来评估神经网络的分类能力。

2.2 神经网络参数设置为了探究神经网络的性能和泛化能力,我们设置了不同的参数组合进行实验。

主要包括隐藏层数量、每层神经元数量、学习率和训练轮数等。

2.3 实验步骤首先,我们将数据集进行预处理,包括数据归一化和标签编码等。

然后,将数据集划分为训练集和测试集,用于训练和评估网络的性能。

接下来,根据不同的参数组合构建神经网络,并使用反向传播算法进行训练。

最后,通过测试集评估网络的分类准确率和损失函数值。

三、实验结果与分析3.1 参数优化我们通过对不同参数组合的实验进行比较,找到了在手写数字识别任务上表现最好的参数组合。

具体而言,我们发现增加隐藏层数量和神经元数量可以提高网络的分类准确率,但同时也会增加训练时间。

实训神经网络实验报告

一、实验背景随着人工智能技术的飞速发展,神经网络作为一种强大的机器学习模型,在各个领域得到了广泛应用。

为了更好地理解神经网络的原理和应用,我们进行了一系列的实训实验。

本报告将详细记录实验过程、结果和分析。

二、实验目的1. 理解神经网络的原理和结构。

2. 掌握神经网络的训练和测试方法。

3. 分析不同神经网络模型在特定任务上的性能差异。

三、实验内容1. 实验一:BP神经网络(1)实验目的:掌握BP神经网络的原理和实现方法,并在手写数字识别任务上应用。

(2)实验内容:- 使用Python编程实现BP神经网络。

- 使用MNIST数据集进行手写数字识别。

- 分析不同学习率、隐层神经元个数对网络性能的影响。

(3)实验结果:- 在MNIST数据集上,网络在训练集上的准确率达到98%以上。

- 通过调整学习率和隐层神经元个数,可以进一步提高网络性能。

2. 实验二:卷积神经网络(CNN)(1)实验目的:掌握CNN的原理和实现方法,并在图像分类任务上应用。

(2)实验内容:- 使用Python编程实现CNN。

- 使用CIFAR-10数据集进行图像分类。

- 分析不同卷积核大小、池化层大小对网络性能的影响。

(3)实验结果:- 在CIFAR-10数据集上,网络在训练集上的准确率达到80%以上。

- 通过调整卷积核大小和池化层大小,可以进一步提高网络性能。

3. 实验三:循环神经网络(RNN)(1)实验目的:掌握RNN的原理和实现方法,并在时间序列预测任务上应用。

(2)实验内容:- 使用Python编程实现RNN。

- 使用Stock数据集进行时间序列预测。

- 分析不同隐层神经元个数、学习率对网络性能的影响。

(3)实验结果:- 在Stock数据集上,网络在训练集上的预测准确率达到80%以上。

- 通过调整隐层神经元个数和学习率,可以进一步提高网络性能。

四、实验分析1. BP神经网络:BP神经网络是一种前向传播和反向传播相结合的神经网络,适用于回归和分类问题。

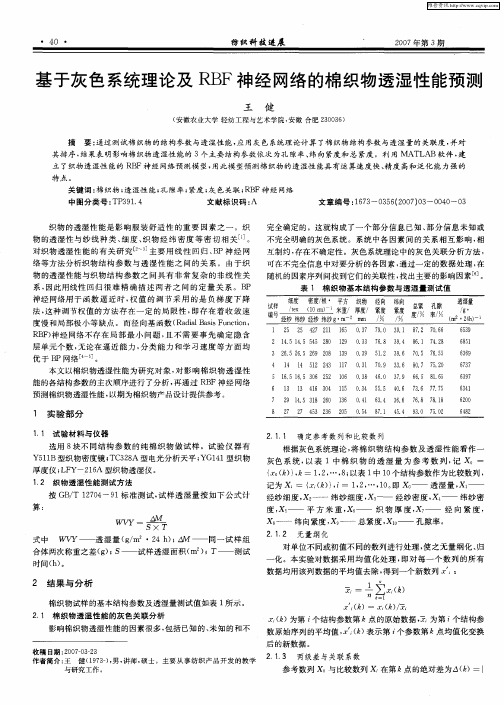

基于灰色系统理论及RBF神经网络的棉织物透湿性能预测

・4 ・ 0

纺织科 技 进展

20 年第 3 07 期

基 于灰 色 系统理论及 R F神 经 网络 的棉 织物透湿性能预测 B

王 健

( 安徽农业大学 轻 纺工程 与艺 术学 院, 安徽 合肥 2 0 3 ) 3 0 6

摘

要: 通过测试棉 织物 的结构参数 与透湿性能 , 用灰 色 系统理 论计算 了棉织物结构参数与透湿量 的关联度 , 应 并对

记 为 X { ( ) , 一 12 … ,O 即 X — — 透 湿 量 , —— = ∞ 五 }i ,, 1 。 c X1

按 G / 20— 9 B T 17 4 1标准 测试 , 样透 湿量按 如下 公式计 试

算:

W VY -

经纱细度 , —— 纬纱细 度 , —— 经纱密 度 , —— 纬 纱密 X。 Xs 蜀

完全确定 的。这就构成 了一个 部分 信息 已知 、 部分 信息未 知或

不完全 明确 的灰色 系统 。系统 中各 因素间 的关 系相互 影响 , 相 互制约 , 存在不确定性 。灰色系统理论 中的灰色 关联分析方 法 , 可在不完全信息 中对要分 析的各因素 , 通过一定 的数据处理 , 在

度 , —— 平 方 米 重 , —— 织 物 厚 度 , —— 经 向 紧 度 , Xs Xs X

Xs —— 纬 向紧度 , 。 X —— 总紧度 , o X —— 孔隙率 。

2 12 无 量 纲 化 . .

式 中 WV Y——透 湿量 (/ g m2・2 ) △ —— 同一试 样组 4h ; M 合体两次称重之差 ( ) S—— 试样透湿 面积( ) 丁—— 测试 g; m2 ; 时间( ) h。

收稿 日期 :0 70 —3 2 0 —32 2 13 两级差与关联 系数 . . 作者简介 : 健 (9 3)男 , 师, 士。主要从 事纺织产 品开发的教学 王 17 一 , 讲 硕 与研究工作 。 参考数列 X。 比较数列 X 与 在第 k点 的绝对差 为A()一 1 五

基于神经网络的风电功率预测技术

基于神经网络的风电功率预测技术随着清洁能源和环保意识的不断加强,风电作为一种新型的能源形式,得到了越来越广泛的应用和发展。

但是,风电系统的不稳定性和不可控性,给其使用和维护带来了很大的挑战。

很多研究者尝试使用神经网络技术来预测风电功率,以提高风电系统的可靠性和实用性。

一、神经网络的基本原理神经网络是一种模拟人脑神经元的计算模型。

它由一个由多个简单的处理节点(神经元)组成的网络构成。

神经元之间的连接具有可调权重,并对输入数据进行加工处理,以产生输出。

神经网络通过反向传播算法进行训练,不断优化节点之间的权重值,从而提高网络的准确性和泛化能力。

二、神经网络在风电功率预测中的应用神经网络的优势在于可以处理大量的输入和输出数据,具有较强的适应性和学习能力。

因此,越来越多的风电功率预测系统采用神经网络技术。

基于神经网络的风电功率预测技术可以更精准地预测出下一时刻的功率输出,提高风电系统的可靠性和实用性。

以下是一些常用的神经网络技术:1. BP神经网络BP神经网络是一种最常见的前向反馈神经网络,具有广泛的应用。

在风电功率预测中,BP神经网络可以利用历史的功率输出数据,建立一个具有多层神经元的模型,然后根据输入的气象数据进行训练,预测下一时刻的功率输出。

2. RBF神经网络RBF神经网络是一种基于径向基函数的神经网络,常用于非线性的数据建模和预测。

在风电功率预测中,RBF神经网络可以通过建立一个具有一层隐藏层的模型,利用输入的气象数据进行训练,预测下一时刻的功率输出。

3. Elman神经网络Elman神经网络是一种递归神经网络,它将输出反馈到神经元的输入端,实现时间序列数据的处理和预测。

在风电功率预测中,Elman神经网络可以利用历史的功率输出数据和气象数据,建立一个具有隐藏层和反馈层的模型,预测下一时刻的功率输出。

三、神经网络在风电功率预测中的应用案例1. 基于BP神经网络的风电功率预测系统某研究机构开发了一个基于BP神经网络的风电功率预测系统。

数学建模实验四:Matlab神经网络以及应用于汽油辛烷值预测

实验四:Matlab 神经网络以及应用于汽油辛烷值预测专业年级: 2014级信息与计算科学1班姓名: 黄志锐 学号:201430120110一、实验目的1. 掌握MATLAB 创建BP 神经网络并应用于拟合非线性函数2. 掌握MATLAB 创建REF 神经网络并应用于拟合非线性函数3. 掌握MATLAB 创建BP 神经网络和REF 神经网络解决实际问题4. 了解MATLAB 神经网络并行运算二、实验内容1. 建立BP 神经网络拟合非线性函数2212y x x =+第一步 数据选择和归一化根据非线性函数方程随机得到该函数的2000组数据,将数据存贮在data.mat 文件中(下载后拷贝到Matlab 当前目录),其中input 是函数输入数据,output 是函数输出数据。

从输入输出数据中随机选取1900中数据作为网络训练数据,100组作为网络测试数据,并对数据进行归一化处理。

第二步 建立和训练BP 神经网络构建BP 神经网络,用训练数据训练,使网络对非线性函数输出具有预测能力。

第三步 BP 神经网络预测用训练好的BP 神经网络预测非线性函数输出。

第四步 结果分析通过BP 神经网络预测输出和期望输出分析BP 神经网络的拟合能力。

详细MATLAB代码如下:27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54disp(['神经网络的训练时间为', num2str(t1), '秒']);%% BP网络预测% 预测数据归一化inputn_test = mapminmax('apply', input_test, inputps); % 网络预测输出an = sim(net, inputn_test);% 网络输出反归一化BPoutput = mapminmax('reverse', an, outputps);%% 结果分析figure(1);plot(BPoutput, ':og');hold on;plot(output_test, '-*');legend('预测输出', '期望输出');title('BP网络预测输出', 'fontsize', 12);ylabel('函数输出', 'fontsize', 12);xlabel('样本', 'fontsize', 12);% 预测误差error = BPoutput-output_test;figure(2);plot(error, '-*');title('BP神经网络预测误差', 'fontsize', 12);ylabel('误差', 'fontsize', 12);xlabel('样本', 'fontsize', 12);figure(3);plot((output_test-BPoutput)./BPoutput, '-*');title('BP神经网络预测误差百分比');errorsum = sum(abs(error));MATLAB代码运行结果截图如下所示:MATLAB代码运行结果如下所示:图1 BP神经网络预测输出图示图2 BP神经网络预测误差图示图3 BP 神经网络预测误差百分比图示2. 建立RBF 神经网络拟合非线性函数22112220+10cos(2)10cos(2)y x x x x ππ=-+-第一步 建立exact RBF 神经网络拟合, 观察拟合效果详细MATLAB 代码如下:MATLAB代码运行结果如下所示:图4 RBF神经网络拟合效果图第二步建立approximate RBF神经网络拟合详细MATLAB代码如下:13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41F = 20+x1.^2-10*cos(2*pi*x1)+x2.^2-10*cos(2*pi*x2); %% 建立RBF神经网络% 采用approximate RBF神经网络。

实验四、RBF神经网络实验报告

如果对于输入空间的某个局部区域只有少数几个连接权值影响输出,则该网络称为局部逼近网络。常见的局部逼近网络有RBF网络、小脑模型(CMAC)网络、B样条网络等。

广义RBF网络

Cover定理指出:将复杂的模式分类问题非线性地映射到高维空间将比投影到低维空间更可能线性可分。

广义RBF网络:从输入层到隐藏层相当于是把低维空间的数据映射到高维空间,输入层细胞个数为样本的维度,所以隐藏层细胞个数一定要比输入层细胞个数多。从隐藏层到输出层是对高维空间的数据进行线性分类的过程,可以采用单层感知器常用的那些学习规则,参见神经网络基础和感知器。

寻找逼近函数F(x)通过最小化下面的目标函数来实现:

加式的第一项好理解,这是均方误差,寻找最优的逼近函数,自然要使均方误差最小。第二项是用来控制逼近函数光滑程度的,称为正则化项,λ是正则化参数,D是一个线性微分算子,代表了对F(x)的先验知识。曲率过大(光滑度过低)的F(x)通常具有较大的||DF||值,因此将受到较大的惩罚。

3)Inverse multiquadrics(拟多二次)函数

σ称为径向基函数的扩展常数,它反应了函数图像的宽度,σ越小,宽度越窄,函数越具有选择性。

完全内插存在一些问题:

1)插值曲面必须经过所有样本点,当样本中包含噪声时,神经网络将拟合出一个错误的曲面,从而使泛化能力下降。K,K<P,从样本中选取K个(假设不包含噪声)作为Φ函数的中心。

隐藏层的作用是把向量从低维m映射到高维P,低维线性不可分的情况到高维就线性可分了。

神经网络_实验报告

一、实验目的与要求1. 掌握神经网络的原理和基本结构;2. 学会使用Python实现神经网络模型;3. 利用神经网络对手写字符进行识别。

二、实验内容与方法1. 实验背景随着深度学习技术的不断发展,神经网络在各个领域得到了广泛应用。

在手写字符识别领域,神经网络具有较好的识别效果。

本实验旨在通过实现神经网络模型,对手写字符进行识别。

2. 神经网络原理神经网络是一种模拟人脑神经元结构的计算模型,由多个神经元组成。

每个神经元接收来自前一个神经元的输入,通过激活函数处理后,输出给下一个神经元。

神经网络通过学习大量样本,能够自动提取特征并进行分类。

3. 实验方法本实验采用Python编程语言,使用TensorFlow框架实现神经网络模型。

具体步骤如下:(1)数据预处理:从公开数据集中获取手写字符数据,对数据进行归一化处理,并将其分为训练集和测试集。

(2)构建神经网络模型:设计网络结构,包括输入层、隐藏层和输出层。

输入层用于接收输入数据,隐藏层用于提取特征,输出层用于输出分类结果。

(3)训练神经网络:使用训练集对神经网络进行训练,调整网络参数,使模型能够准确识别手写字符。

(4)测试神经网络:使用测试集对训练好的神经网络进行测试,评估模型的识别效果。

三、实验步骤与过程1. 数据预处理(1)从公开数据集中获取手写字符数据,如MNIST数据集;(2)对数据进行归一化处理,将像素值缩放到[0, 1]区间;(3)将数据分为训练集和测试集,比例约为8:2。

2. 构建神经网络模型(1)输入层:输入层节点数与数据维度相同,本实验中为28×28=784;(2)隐藏层:设计一个隐藏层,节点数为128;(3)输出层:输出层节点数为10,对应10个类别。

3. 训练神经网络(1)定义损失函数:均方误差(MSE);(2)选择优化算法:随机梯度下降(SGD);(3)设置学习率:0.001;(4)训练次数:10000;(5)在训练过程中,每100次迭代输出一次训练损失和准确率。

RBF神经网络的一种快速鲁棒学习算法

第1 期

() 2 置隐结点数 L = 1选择势最大的训练数据为第一个 隐结点 的中心 , 为相应的势。 , P () 3 使用公式( ) 2 调整每个输入数据的势 P 。

.

P =P 一P x ( l — i ep 一 l

ma P ≤ £ x P

l) l

择隐结点的中心。C i — hn 等提 出了一种可 以用于拟合常数值函数 的 R F神经 网络 , h nC eg e B 它对离群点具有 鲁棒性[ 。基于以上工作 , 6 ] 本文提出了一种 R F神经网络快速鲁棒学习算 法, B 先使用相减聚类 ( ut c v S br t e ai Cut i , C 法_ 选择 R F隐结点的中心 , l en S ) 7 s rg ] B 然后把定标鲁棒损失函数作为 目标函数使用梯度下降法调整 隐结点的宽度和网络 的连接权值。由于近似底层 的映射而不是仅对训练数据集进行插值 , 因此这一算法对

() 4 如果不等式

.

成立 , 终止算法 ; 否则置 L : L+1并且找到具有最大势的训练数据点 X P , L, 为其相应的势值。 () 5 选择 x 作为第L个隐结点的中心 , 使用公式 ( ) 4 调整每个训练数据的势 , 回( ) 返 4。 P = P —P x f L l ) epl —X l l 其中 £ 和 为设计参数 , 。 a> 12 定标鲁棒损失函数( R F) . SL 鲁棒损失函数 』 ( [ D ) 一] o

R F网络的学习过程不受离群点的影响, B 并且能够快速收敛。实验结果表明了 R F神经网络 的这 B

学 习算 法的优 越性 。 关键词 :B R F神经网络 ; 相减聚类 ; 定标鲁棒损失函数 ; 离群点

一

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

实验四、RBF神经网络

一、实验目的

通过计算机编程实现并验证RBF神经网络的曲线拟合及模式分类能力。

二、实验内容

1)用Matlab实现RBF神经网络,并对给定的曲线样本集实现拟合;

2)通过改变实验参数,观察和分析影响RBF神经网络的结果与收敛速度的因素;

三、实验原理、方法和手段

RBF网络能够逼近任意的非线性函数,可以处理系统内的难以解析的规律性,具有良好的泛化能力,并有很快的学习收敛速度,已成功应用于非线性函数逼近、时间序列分析、数据分类、模式识别、信息处理、图像处理、系统建模、控制和故障诊断等。

简单说明一下为什么RBF网络学习收敛得比较快。

当网络的一个或多个可调参数(权值或阈值)对任何一个输出都有影响时,这样的网络称为全局逼近网络。

由于对于每次输入,网络上的每一个权值都要调整,从而导致全局逼近网络的学习速度很慢。

BP网络就是一个典型的例子。

如果对于输入空间的某个局部区域只有少数几个连接权值影响输出,则该网络称为局部逼近网络。

常见的局部逼近网络有RBF网络、小脑模型(CMAC)网络、B样条网络等。

径向基函数解决插值问题

完全内插法要求插值函数经过每个样本点,即。

样本点总共有P个。

RBF的方法是要选择P个基函数,每个基函数对应一个训练数据,各基函数形式为,由于距离是径向同性的,因此称为径向基函数。

||X-Xp||表示差向量的模,或者叫2范数。

基于为径向基函数的插值函数为:

输入X是个m维的向量,样本容量为P,P>m。

可以看到输入数据点Xp是径向基函数φp的中心。

隐藏层的作用是把向量从低维m映射到高维P,低维线性不可分的情况到高维就线性可分了。

将插值条件代入:

写成向量的形式为,显然Φ是个规模这P对称矩阵,且与X的维度无关,当Φ可逆时,有。

对于一大类函数,当输入的X各不相同时,Φ就是可逆的。

下面的几个函数就属于这“一大类”函数:

1)Gauss(高斯)函数

2)Reflected Sigmoidal(反常S型)函数

3)Inverse multiquadrics(拟多二次)函数

σ称为径向基函数的扩展常数,它反应了函数图像的宽度,σ越小,宽度越窄,函数越具有选择性。

完全内插存在一些问题:

1)插值曲面必须经过所有样本点,当样本中包含噪声时,神经网络将拟合出一个错误的曲面,从而使泛化能力下降。

由于输入样本中包含噪声,所以我们可以设计隐藏层大小为K,K<P,从样本中选取K个(假设不包含噪声)作为Φ函数的中心。

2)基函数个数等于训练样本数目,当训练样本数远远大于物理过程中固有的自由度时,问题就称为超定的,插值矩阵求逆时可能导致不稳定。

拟合函数F的重建问题满足以下3个条件时,称问题为适定的:

解的存在性

解的唯一性

解的连续性

不适定问题大量存在,为解决这个问题,就引入了正则化理论。

正则化理论

正则化的基本思想是通过加入一个含有解的先验知识的约束来控制映射函数的光滑性,这样相似的输入就对应着相似的输出。

寻找逼近函数F(x)通过最小化下面的目标函数来实现:

加式的第一项好理解,这是均方误差,寻找最优的逼近函数,自然要使均方误差最小。

第二项是用来控制逼近函数光滑程度的,称为正则化项,λ是正则化参数,D是一个线性微分算子,代表了对F(x)的先验知识。

曲率过大(光滑度过低)的F(x)通常具有较大的||DF||值,因此将受到较大的惩罚。

直接给出(1)式的解:

权向量 (2)

G(X,Xp)称为Green函数,G称为Green矩阵。

Green函数与算子D的形式有关,当D具有旋转不变性和平移不变性时,。

这类Green函数的一个重要例子是多元Gauss函数:

正则化RBF网络

输入样本有P个时,隐藏层神经元数目为P,且第p个神经元采用的变换函数为G(X,Xp),它们相同的扩展常数σ。

输出层神经元直接把净输入作为输出。

输入层到隐藏层的权值全设为1,隐藏层到输出层的权值是需要训练得到的:逐一输入所有的样本,计算隐藏层上所有的Green函数,根据(2)式计算权值。

广义RBF网络

Cover定理指出:将复杂的模式分类问题非线性地映射到高维空间将比投影到低维空间更可能线性可分。

广义RBF网络:从输入层到隐藏层相当于是把低维空间的数据映射到高维空间,输入层细胞个数为样本的维度,所以隐藏层细胞个数一定要比输入层细胞个数多。

从隐藏层到输出层是对高维空间的数据进行线性分类的过程,可以采用单层感知器常用的那些学习规则,参见神经网络基础和感知器。

注意广义RBF网络只要求隐藏层神经元个数大于输入层神经元个数,并没有要求等于输入样本个数,实际上它比样本数目要少得多。

因为在标准RBF网络中,当样本数目很大时,就需要很多基函数,权值矩阵就会很大,计算复杂且容易产生病态问题。

另外广RBF网与传统RBF网相比,还有以下不同:径向基函数的中心不再限制在输入数据点上,而由训练算法确定。

各径向基函数的扩展常数不再统一,而由训练算法确定。

输出函数的线性变换中包含阈值参数,用于补偿基函数在样本集上的平均值与目标值之间的差别。

因此广义RBF网络的设计包括:

结构设计--隐藏层含有几个节点合适

参数设计--各基函数的数据中心及扩展常数、输出节点的权值。

下面给出计算数据中心的两种方法:

数据中心从样本中选取。

样本密集的地方多采集一些。

各基函数采用统一的偏扩展常数:

dmax是所选数据中心之间的最大距离,M是数据中心的个数。

扩展常数这么计算是为了避免径向基函数太尖或太平。

自组织选择法,比如对样本进行聚类、梯度训练法、资源分配网络等。

各聚类中心确定以后,根据各中心之间的距离确定对应径向基函数的扩展常数。

λ是重叠系数。

接下来求权值W时就不能再用了,因为对于广义RBF网络,其行数大于列数,此时可以求Φ伪逆。

数据中心的监督学习算法

最一般的情况,RBF函数中心、扩展常数、输出权值都应该采用监督学习算法进行训练,经历一个误差修正学习的过程,与BP网络的学习原理一样。

同样采用梯度下降法,定义目标函数为

ei为输入第i个样本时的误差信号。

上式的输出函数中忽略了阈值。

为使目标函数最小化,各参数的修正量应与其负梯度成正比,即

具体计算式为

上述目标函数是所有训练样本引起的误差总和,导出的参数修正公式是一种批处理式调整,即所有样本输入一轮后调整一次。

目标函数也可以为瞬时值形式,即当前输入引起的误差

此时参数的修正值为:

四、实验结果

RBF神经网络函数用于线性回归,用exp(PI*0.1)作为训练数据,然后输入的测试数是exp(PI*0.1),其实际的输出结果与预测的输出结果完全一致,预测效果很好,其图如下图所示。

RBF神经网络函数用于分类,其实际的输出结果与预测的输出结果如下图所示。