光线跟踪讲解及源代码

写出光线跟踪递归函数的伪代码。

写出光线跟踪递归函数的伪代码。

光线跟踪是一种计算机图形学中常用的方法,用于模拟物体表面反射光线的行为,从而生成逼真的图像。

下面是光线跟踪递归函数的伪代码:```pythonRay Trace(Point3D origin, Vector3D direction, int depth):if depth == MAX_DEPTH: # 达到递归深度,结束递归return BACKGROUND_COLOR# 找到离射线最近的交点hit_distance, hit_point, hit_norm, hit_obj = findIntersection(origin, direction)if not hit_obj: # 未与任何物体相交,返回背景颜色return BACKGROUND_COLOR# 计算环境光照color = hit_obj.material.ambient_color * AMBIENT_LIGHT_COLOR# 计算入射光照for light in scene.lights:light_direction = normalize(light.position - hit_point)# 检查是否有阴影if not isShadowed(hit_point, light.position, hit_obj):color += computeDiffuseColor(hit_obj.material.diffuse_color, light.color, light_direction, hit_norm)color += computeSpecularColor(hit_obj.material.specular_color, light.color, light_direction, hit_norm, direction)前两个参数是光线的起点和方向向量,第三个参数是当前递归深度。

Ray Tracing程序

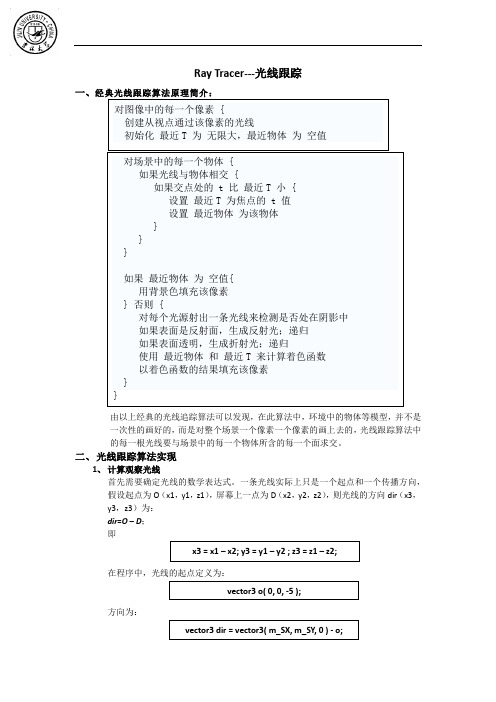

Ray Tracer---光线跟踪一、经典光线跟踪算法原理简介:对图像中的每一个像素 {创建从视点通过该像素的光线初始化最近T 为无限大,最近物体为空值对场景中的每一个物体 {如果光线与物体相交 {如果交点处的 t 比最近T 小 {设置最近T 为焦点的 t 值设置最近物体为该物体}}}如果最近物体为空值{用背景色填充该像素} 否则 {对每个光源射出一条光线来检测是否处在阴影中如果表面是反射面,生成反射光;递归如果表面透明,生成折射光;递归使用最近物体和最近T 来计算着色函数以着色函数的结果填充该像素}}由以上经典的光线追踪算法可以发现,在此算法中,环境中的物体等模型,并不是一次性的画好的,而是对整个场景一个像素一个像素的画上去的,光线跟踪算法中的每一根光线要与场景中的每一个物体所含的每一个面求交。

二、光线跟踪算法实现1、计算观察光线首先需要确定光线的数学表达式。

一条光线实际上只是一个起点和一个传播方向,假设起点为O(x1,y1,z1),屏幕上一点为D(x2,y2,z2),则光线的方向dir(x3,y3,z3)为:dir=O–D;即x3 = x1 – x2; y3 = y1 – y2 ; z3 = z1 – z2;在程序中,光线的起点定义为:vector3 o( 0, 0, -5 );方向为:vector3 dir = vector3( m_SX, m_SY, 0 ) - o;由此可以确定一条光线然后就需要求出与该光线相交的物体中的最近的交点2、光线与球体相交球体由方程(x-a)2+(y-b)2+(z-c)2=r2确定,求光线是否与方程相交,只需计算方程组(x-x1)2+(y-y1)2+(z-z1)2=R2e+ d t = 0有无实数解即可。

若令c(x1,y1,z1)为圆心,将二式带入一式整理可得,(d﹒d)t2 + 2d﹒(e - c)t + (e - c)﹒(e - c) - R2=0 这里,除了参数t外所有的都是已知的,所以也就是标准的一元二次方程,即At2 + Bt + C=0二次解下中根号下的项B2-4AC为判别式,它可以说明有多少实数解。

光线跟踪算法定义

光线跟踪算法定义

一、光线跟踪算法定义

光线跟踪算法(Ray Tracing)是一种计算机图形学的算法,用于生成图像的一种技术。

它是从视点向外发射若干光线,从物体表面反射到视点,然后以此确定视点看到的场景。

通过光线跟踪算法,我们可以计算出光线如何与物体交互,从而得到场景的3D渲染信息。

二、光线跟踪算法的基本步骤

1)光线初始化:根据画面上所描述的场景,从视点出发,将光线引导出去,以确定一条光线路径。

2)光线交点:然后,通过一系列计算查找场景中可能发生交叉的点,并计算出每个交点的位置。

3)漫反射:计算每个交点处发生的反射现象,确定物体表面材质和着色。

4)相交测试:使用插值来确定物体表面的属性,并计算出反射光线的状态,以确定新的交点位置。

5)更新交点:根据反射光线的状态,更新交点位置,并对变更后的光线进行漫反射。

6)最小交点:如果有多个交点,则对比各个交点的距离,选择最近的交点。

7)结束条件:当所有的反射光线都已经计算出新的交点,或者当反射光线不再反射时,结束计算,得到最后的场景图像。

三、光线跟踪算法的优势

1)高质量:通过对物体表面属性及采样参数的设置,可以提供高质量的图像效果。

2)自然照明:光线跟踪算法可以模拟照明、反射和折射等现实世界中的光线特性,使得图像效果更加自然。

3)提高性能:相比于传统算法,光线跟踪算法提供不同层次的多视角等,能够提高处理效率和性能。

4)节省资源:由于计算量较少,使用光线跟踪算法时可以节省部分资源,比如计算机内存。

光线跟踪算法

光线跟踪的算法1,原理由于从光源发出的光线有无穷多条,使得直接从光源出发对光线进行跟踪变得非常困难。

实际上,从光源发出的光线只有少数经由场景的反射和透射(折射)后到达观察者的眼中。

为此标准光线跟踪算法采用逆向跟踪技术完成整个场景的绘制。

光线跟踪思路:从视点出发,通过图像平面上每个像素中心向场景发出一条光线,光线的起点为视点,方向为像素中心和视点连线单位向量。

光线与离视点最近的场景物体表面交点有三种可能:1.当前交点所在的物体表面为理想漫射面,跟踪结束。

2.当前交点所在的物体表面为理想镜面,光线沿其镜面发射方向继续跟踪。

3.当前交点所在的物体表面为规则透射面,光线沿其规则透射方向继续跟踪。

如图-1中,场景中有三个半透明玻璃球,视点发出光线与场景最近交点为P1,使用任意局部光照模型(opengl使用的是phong模型)可以计算出P1点处的局部光亮度Ilocal,为了计算周围环境在P1点处产生的镜面发射光和规则折射光,光线1在P1点处衍生出两支光线:反射光2和折射光3。

P1处的光照由三部分组成:Ilocal + ks * I2 + kt * I3I3 为折射光线3的颜色,Kt为折射率I2 为反射光线2的颜色,Ks为反射率I3 和I2 的计算需要递归。

2,伪代码[cpp] view plain copy print?01.voidTraceRay(const Vec3& start, const Vec3& direction, int depth, Color& color)02.{03. Vec3 intersectionPoint, reflectedDirection, transmittedDirection;04. Color localColor, reflectedColor, transmittedColor;05. if (depth >= MAX_DEPTH) {06. color = Black; //#00007. }08. else {09. Ray ray(start, direction); //取start起点,方向direction为跟踪射线;10. if ( !scene->HasIntersection(ray) )11. color = BackgroundColor;12. else {13. 计算理起始点start最近的交点intersectionPoint,14. 记录相交物体intersectionObject,15.16. // #117. Shade(intersectionObject, intersectionPoint, localColor);18.19. // #220. if ( intersectionPoint所在面为镜面) {21. 计算跟踪光想S在intersectionPoint处的反射光线方向reflectedDirection,22. TraceRay(intersectionPoint, reflectedDirection, depth+1, reflectedColor);23. }24. // #325. if ( intersectionPoint所在的表面为透明面) {26. 计算跟踪光线S在intersectionPoint处的规则透射光线方向transmittedDirection,27. TraceRay(intersectionPoint, transmittedDirection, depth+1, transmittedColor);28. }29. // #summarize30. color = localColor + Ks * reflectedColor + Kt * transmittedColor;31. }// else32. } //else33.}34.// 局部光照模型计算交点intersectionPoint处的局部光亮度localColor35.void Shade(const Object&intersectionObj, const Vec3&intersectionPoint, Color&localColor)36.{37. 确定intersectionObj在intersectionPoint处的单位法向量N,38. 漫反射系数Kd,39. 镜面反射系数Ks,40. 环境反射系数Ka;41. localColor = Ka * Ia; //Ia为环境光亮度42. for ( 每一个点光源PointLight ) {43. 计算入射光线单位向量L和虚拟镜面法向单位向量H,44. // 由Phong模型计算光源PointLight在intersectionPoint处的漫反射和镜面反射光亮度45. localColor += ( Ipointlight * ( Kd * (N.dot(L)) + Ks * (N.dot(H))^n ) );46. }47.}。

光线跟踪技术的原理与实现

…

G A HC N MA EP O E SN … 一 … … … … …… … 一 …一P …… R P ISA D l G R C S IG … 一¨ ¨ … ……… ¨……… …一

光线跟踪技术的原理与实现

糍 戮

白 改 朝● 杨 H… l 1 ,

v c o3 O《 O 一5) e t r O , :

vco { vc r(r S 。 L Y O)一0 etr d et 3 F × 盯 S , 3 r o l _

¨ l

命 中 照 相 机 。 图 1中 没 有 画 出 的 是 那 些 无 法 到 达 观 察 者 的 光

线 .这 些光 线 也 是 不 从 光 源 往 照 相 机 进 行 跟 踪 的 原 因 ,而 是 采 用 相 反 的路 径 。 图 l 识 的 是 一 种 理 想 情 形 , 因为 光 线 的方 向 标

RROd ) ar r o ,j : v{

_

、

一

i

该光线起 始点在 ‘ 0’。 向朝 向 屏 幕 平 面 上 的 一 个 位 置 , 方

没 有 影 响 。 从 上 面 得 到 一 个 启 示 :与 其 等 待 光 源 发 射 一 条 光 线 穿 过 一个 目前 颜 色 或 是 黑 色 的 像 素 ,不 如 自己从 照 相 机 发 射

i

图 1 光线 跟 踪 原 理 示 意 图

注 意 下 面 的 代 码 .它 在 ryrcr p a t e. p中 的 R n e 方 法 中 构 a c e dr

造 了一 条 光 线 。 如图 1 所示 ,黄 色 的光 直 接 从 太 阳射 人 照相 机 中 ;红 色 的

光 线 被 场 景 反 射后 到达 照 相 机 ,而 蓝 色 的光 线 被 玻 璃 球 折 射后

纯路径追踪算法 c代码

纯路径追踪算法是一种高级的光线追踪算法,它能够模拟出更加真实的光线传播效果。

本文将介绍纯路径追踪算法的基本原理,并给出一份使用C语言实现的代码。

一、算法原理纯路径追踪算法是一种基于蒙特卡罗方法的光线追踪算法,它的基本思路是通过随机采样来模拟光线的传播过程。

具体来说,纯路径追踪算法的主要步骤如下:1. 从相机位置发射一条光线,记录其与场景中物体的相交点;2. 对于每个相交点,根据材质的反射和折射特性,随机生成一定数量的新光线;3. 对于每条新光线,递归执行步骤1和2,直到达到最大递归深度或者光线没有与任何物体相交为止;4. 对于每个相交点,根据采样的光线计算出其对应的颜色值,最终将所有颜色值相加得到最终像素颜色。

通过上述步骤,纯路径追踪算法能够模拟出真实的光线传播效果,包括反射、折射、漫反射、镜面反射等。

二、C语言代码实现下面是一份使用C语言实现的纯路径追踪算法代码:```c#include#include#include#define MAX_DEPTH 5 // 最大递归深度#define EPSILON 0.0001 // 微小值typedef struct {double x, y, z;} Vector3;typedef struct {Vector3 position;Vector3 normal;double distance;} Intersection;typedef struct {double r, g, b;} Color;typedef struct {Vector3 position;double radius;Color color;} Sphere;typedef struct {int width, height;double fov;Vector3 position;Vector3 forward;Vector3 right;Vector3 up;} Camera;typedef struct {int num_spheres;Sphere *spheres;} Scene;double dot(Vector3 a, Vector3 b) { return a.x * b.x + a.y * b.y + a.z * b.z; }Vector3 add(Vector3 a, Vector3 b) { Vector3 c;c.x = a.x + b.x;c.y = a.y + b.y;c.z = a.z + b.z;return c;}Vector3 subtract(Vector3 a, Vector3 b) {Vector3 c;c.x = a.x - b.x;c.y = a.y - b.y;c.z = a.z - b.z;return c;}Vector3 multiply(Vector3 a, double b) {Vector3 c;c.x = a.x * b;c.y = a.y * b;c.z = a.z * b;return c;}Vector3 normalize(Vector3 a) {double length = sqrt(a.x * a.x + a.y * a.y + a.z * a.z);Vector3 b;b.x = a.x / length;b.y = a.y / length;b.z = a.z / length;return b;}Intersection intersect_sphere(Vector3 ray_origin, Vector3 ray_direction, Sphere sphere) { Intersection intersection;intersection.distance = INFINITY;Vector3 oc = subtract(ray_origin, sphere.position);double a = dot(ray_direction, ray_direction);double b = 2 * dot(oc, ray_direction);double c = dot(oc, oc) - sphere.radius * sphere.radius;double discriminant = b * b - 4 * a * c;if (discriminant > 0) {double t1 = (-b + sqrt(discriminant)) / (2 * a);double t2 = (-b - sqrt(discriminant)) / (2 * a);double t = fmin(t1, t2);if (t > EPSILON) {intersection.distance = t;intersection.position = add(ray_origin, multiply(ray_direction, t)); intersection.normal = normalize(subtract(intersection.position, sphere.position));}}return intersection;}Intersection intersect_scene(Vector3 ray_origin, Vector3 ray_direction, Scene scene) { Intersection closest_intersection;closest_intersection.distance = INFINITY;for (int i = 0; i < scene.num_spheres; i++) {Sphere sphere = scene.spheres[i];Intersection intersection = intersect_sphere(ray_origin, ray_direction, sphere);if (intersection.distance < closest_intersection.distance) {closest_intersection = intersection;}}return closest_intersection;}Color trace_ray(Vector3 ray_origin, Vector3 ray_direction, Scene scene, int depth) {Color color = {0, 0, 0};if (depth > MAX_DEPTH) {return color;}Intersection intersection = intersect_scene(ray_origin, ray_direction, scene);if (intersection.distance == INFINITY) {return color;}Vector3 reflection_direction = subtract(ray_direction, multiply(intersection.normal, 2 *dot(ray_direction, intersection.normal)));Color reflection_color = trace_ray(intersection.position, reflection_direction, scene, depth + 1);color.r += reflection_color.r * 0.5;color.g += reflection_color.g * 0.5;color.b += reflection_color.b * 0.5;return color;}void render_scene(Camera camera, Scene scene, Color *image) {for (int y = 0; y < camera.height; y++) {for (int x = 0; x < camera.width; x++) {double u = (2 * (x + 0.5) / (double)camera.width - 1) * tan(camera.fov / 2);double v = (1 - 2 * (y + 0.5) / (double)camera.height) * tan(camera.fov / 2) * camera.height / (double)camera.width;Vector3 ray_direction = normalize(add(add(multiply(camera.forward, 1), multiply(camera.right, u)), multiply(camera.up, v)));Color color = trace_ray(camera.position, ray_direction, scene, 0);image[y * camera.width + x] = color;}}}int main() {Camera camera = {.width = 640,.height = 480,.fov = M_PI / 3,.position = {0, 0, 0},.forward = {0, 0, 1},.right = {1, 0, 0},.up = {0, 1, 0}};Sphere sphere1 = {.position = {0, 0, 5},.radius = 1,.color = {1, 1, 1}};Sphere sphere2 = {.position = {2, 0, 5},.radius = 1,.color = {1, 0, 0}};Sphere sphere3 = {.position = {-2, 0, 5},.radius = 1,.color = {0, 1, 0}};Scene scene = {.num_spheres = 3,.spheres = (Sphere[]){sphere1, sphere2, sphere3} };Color *image = malloc(camera.width * camera.height * sizeof(Color));render_scene(camera, scene, image);FILE *fp = fopen("output.ppm", "wb");fprintf(fp, "P6\n%d %d\n255\n", camera.width, camera.height);for (int i = 0; i < camera.width * camera.height; i++) {fputc((int)(255 * fmin(image[i].r, 1)), fp);fputc((int)(255 * fmin(image[i].g, 1)), fp);fputc((int)(255 * fmin(image[i].b, 1)), fp);}fclose(fp);free(image);return 0;}```三、代码解释上述代码中,我们定义了一些基本数据类型,包括三维向量(Vector3)、相交点(Interse ction)、颜色(Color)、球体(Sphere)和相机(Camera)。

试验报告光线跟踪的实现

实验报告:光线跟踪的实现学号:2111112041 姓名:李伟明实验思想从眼睛出发计算通过每个像素的光线方程,光线方程与场景中最近物体相交,计算各光源在该交点处的漫反射分量,镜面反射分量,并且叠加这些分量,递归计算光线在交点处的反射和折射光线,并且也将计算得到的各分量叠加到像素中,将该像素最后得到的总光强存储到一个二维数组里。

计算完所有像素后,使用opengl将这些像素点绘制出来。

一.创建场景场景中创建了三个平面,七个球(其中两个大球,五个小球),两个光源。

定义一个800*800的二维数组:rgbColor PixelColor[PixelH][PixelW],用于存储像素值。

PixelH和PixelW 的预定义值为800。

二.计算光线方程屏幕的大小为8*8,分辨率为800*800,屏幕在xoy平面上,屏幕中心位置是坐标原点。

眼睛的位置O(0,0,4),屏幕上一点D(image_x,image_y,0),光线的方向为V=D – O。

由此可以确定一条光线Ray(O,dir)。

然后求出该光线与场景中最近物体的交点。

三.光线与物体相交1.光线与球体相交球体方程:(x-x1)^2 + (y-y1)^2 + (z-z1)^2 = R^2光线方程:O + Vt = 0;V为单位向量,球心c(x1,y1,z1)。

由两方程可得t^2 + 2V * (O - c)*t + [(O - c)*(O - c) - R^2] = 0根据方程计算出t的实数解。

2.光线平面相交首先平面的法向量N与光线方向向量V点乘,如果结果不为0,则光线与平面有交点,计算出对应交点的t值四.慢反射光的计算漫反射的计算公式为,为了实现方便,我将Kd设置成了浮点型,表示对RGB三个分量的反射强度相同,同时为了反映出物体本身的颜色属性,在计算时乘上了物体本身的颜色。

1.具体实现代码为表示点成两个向量,prim->_pMat.GetDiffuse()为物体的慢反射系数,prim->_pMat.GetColor()为物体的颜色值,含RGB三个分量,lig->_pMat.GetColor()是光源的颜色值,含RGB三个分量。

光线追踪代码matlab

光线追踪代码matlab光线追踪代码(Matlab)是一种用于模拟光线在三维空间中传播和相互交互的计算机渲染技术。

它模拟了真实世界中光线追踪的物理过程,通过跟踪光线的路径,计算其与物体之间的相互作用,并最终生成逼真的图像。

在本文中,我们将以光线追踪代码(Matlab)为主题,逐步解释该过程的不同阶段。

我们将从建立场景开始,然后介绍光线追踪的基本原理,最后讨论如何通过修改代码来改善图像的质量。

第一步:建立场景在光线追踪中,我们需要定义一个场景,包括摄像机位置、光源、物体等。

在Matlab中,我们可以使用三维向量来表示场景中的点和向量,并使用结构体来表示不同物体的属性。

例如,我们可以定义一个矩形平面作为地面,摄像机位于(0,0,-1)的位置,光源位于(1,1,-1)的位置:matlabscene.camera.position = [0; 0; -1];scene.light.position = [1; 1; -1];scene.objects{1}.type = 'plane';scene.objects{1}.position = [0; 0; 0];scene.objects{1}.normal = [0; 0; 1];scene.objects{1}.material.diffuseColor = [0.5; 0.5; 0.5];第二步:光线追踪的基本原理光线追踪的基本原理是以摄像机位置为起点,沿着每个像素的方向发射光线,然后跟踪光线与场景中物体的交点和反射路径。

通过对光线和物体的相互作用进行计算,最终确定每个像素的颜色值。

为了实现这个过程,我们需要实现一个光线与物体相交的函数。

该函数接受一个光线和一个物体作为输入,并返回光线与物体相交的距离以及交点的位置和法向量。

该函数可以根据物体的类型来判断相交的方式,例如球体、平面等。

matlabfunction [distance, position, normal] = intersectRayObject(ray, object)% implement intersection calculation for different object types if strcmp(object.type, 'sphere')% calculation for sphereelseif strcmp(object.type, 'plane')% calculation for planeendend第三步:实现光线追踪的代码在Matlab中,我们可以使用迭代的方式来实现光线追踪的代码。

蒙 特 卡 罗 光 线 追 踪 法实现代码

蒙特卡罗光线追踪法(Monte Carlo Ray Tracing)是一种基于随机抽样的光线追踪算法,用于模拟光线在三维场景中的传播和交互。

它是计算机图形学中常用的一种渲染技术,能够高效地产生真实感强的图像。

蒙特卡罗光线追踪法实现代码主要包括以下几个步骤:1. 场景建模:首先需要定义一个三维场景,包括物体的几何形状、材质、光源等信息。

通常使用三维建模软件创建场景,并将场景信息导出为相应的数据格式,如OBJ、FBX等。

2. 光线发射:在光线追踪算法中,光线是从相机发出的,沿着像素的方向传播。

在代码实现中,需要确定相机的位置和方向,并计算每个像素对应的光线方向。

3. 光线与物体的交点计算:对于每条光线,需要与场景中的所有物体进行求交。

这一步需要判断光线与物体的交点,以及交点处的材质信息等。

4. 光线的反射和折射:根据物体的材质信息,对光线进行反射和折射的计算。

不同材质的物体对光线的反射和折射方式不同,需要根据具体的材质属性进行计算。

5. 光源的采样:对于光源上的点,需要进行随机采样,计算其对光线产生的影响。

光源的采样是蒙特卡罗算法中的重要步骤,它决定了最终图像的真实感。

6. 蒙特卡罗积分:蒙特卡罗光线追踪算法通过随机采样来逼近渲染方程中的积分,从而计算像素的颜色值。

这一步需要大量的随机采样,因此效率较低。

7. 图像生成:将计算得到的像素颜色值整合起来,生成最终的图像。

这一步需要对图像进行处理和压缩,以适应不同的显示设备和分辨率。

在实现蒙特卡罗光线追踪法的代码过程中,需要考虑光线追踪算法的复杂性和计算量。

通常需要结合并行计算、加速数据结构等技术手段,以提高算法的效率和实用性。

蒙特卡罗光线追踪法实现代码是一项复杂而有趣的工程,它能够帮助我们更好地理解光线在三维空间中的传播和交互规律,以及模拟出逼真的图像效果。

希望通过本文的介绍,读者能够对蒙特卡罗光线追踪法有一个基本的认识,并有兴趣深入学习和研究这一领域的相关知识。

光线追踪算法实验报告(3篇)

第1篇一、实验目的本实验旨在通过实际操作,了解光线追踪算法的基本原理和实现方法,掌握光线追踪算法在不同场景下的应用,并分析其实际效果。

二、实验环境1. 操作系统:Windows 102. 编程语言:C++3. 开发工具:Visual Studio 20194. 图形库:OpenGL三、实验内容1. 光线追踪算法原理光线追踪算法是一种基于光线传播原理的渲染技术。

通过模拟光线从摄像机出发,与场景中的物体发生碰撞、反射、折射等过程,最终计算出每个像素的颜色值,从而生成具有真实感的图像。

2. 光线追踪算法实现(1)光线与场景的交点检测首先,我们需要实现光线与场景中物体的交点检测。

在实验中,我们采用三角形作为场景中的基本几何形状,并使用Mller-Trumbore算法进行光线与三角形的交点检测。

(2)光线追踪过程在光线与场景交点检测的基础上,我们需要对光线进行追踪。

具体步骤如下:a. 计算光线在交点处的材质属性,包括反射率、折射率等;b. 根据材质属性,判断光线是否发生反射、折射或透射;c. 如果光线发生反射或折射,则根据反射、折射定律计算新光线的方向;d. 重复步骤a、b、c,直到光线满足终止条件(如光线与场景交点处的材质为透明,或光线追踪深度达到预设值)。

(3)光线追踪结果处理在光线追踪过程中,我们需要对每个像素的颜色值进行计算。

具体步骤如下:a. 对每个像素发射光线,进行光线追踪;b. 根据光线追踪结果,计算每个像素的颜色值;c. 对每个像素的颜色值进行合成,生成最终的渲染图像。

3. 实验场景为了验证光线追踪算法的效果,我们在实验中设计了以下场景:(1)场景一:室内场景,包含家具、墙面、窗户等物体;(2)场景二:室外场景,包含天空、地面、建筑物等物体。

四、实验结果与分析1. 实验结果通过实验,我们得到了以下结果:(1)场景一:室内场景的渲染效果较为真实,物体之间的光照、阴影、反射等现象得到了较好的模拟;(2)场景二:室外场景的渲染效果也较为真实,天空、地面、建筑物等物体的光照、阴影、反射等现象得到了较好的模拟。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

计算机图形学期末作业作业题目:Ray Tracing算法的实现******学号:S*****************摘要Ray Tracing算法又叫光线跟踪算法,它能通过递归方法逐个计算每个像素点的光强,然后就可以绘制出高度真实感的图像,因此该方法在图形学领域得到了广泛的应用。

Ray Tracing算法的思想还能应用到移动通信终端定位领域,该领域里的射线跟踪法与此算法思想类似。

MFC是微软公司提供的一个类库,以C++类的形式封装了Windows的API,并且包含一个应用程序框架,以减少应用程序开发人员的工作量。

其中包含的类包含大量Windows句柄封装类和很多Windows的内建控件和组件的封装类。

MFC在处理Windows窗口应用程序方面具有很大的优势,因此,本文使用MFC在VC6.0里实现Ray Tracing算法,并给出了该算法的详细讲解。

【关键词】Ray tracing 光线跟踪递归像素光强 MFC C++目录1.Ray Tracing算法概述 (1)1.1Ray Tracing算法简介 (1)1.2Ray Tracing算法的实现原理 (1)2.Ray Tracing算法的具体实现 (2)2.1算法的实现环境 (2)2.2实现算法的C++程序简介 (2)2.3算法的具体实现过程 (3)2.4 程序运行结果 (11)3.总结 (11)3.1 通过该算法学到的东西 (11)3.2本程序未完成的任务 (12)4.参考文献 (12)1.Ray Tracing算法概述1.1Ray Tracing算法简介光线跟踪(Ray tracing),又称为光迹追踪或光线追迹,它是来自于几何光学的一项通用技术,它通过跟踪与光学表面发生交互作用的光线从而得到光线经过路径的模型。

它用于光学系统设计,如照相机镜头、显微镜、望远镜以及双目镜等。

这个术语也用于表示三维计算机图形学中的特殊渲染算法,跟踪从眼睛发出的光线而不是光源发出的光线,通过这样一项技术将具有一定数学模型的场景显现出来。

这样得到的结果类似于光线投射与扫描线渲染方法的结果,但是这种方法有更好的光学效果,例如对于反射与折射有更准确的模拟效果,并且效率非常高,所以在追求高质量结果时我们经常使用这种方法。

在光线跟踪的过程中,我们要考虑许多因素。

要跟踪的光线包括反射光线、散射光线和镜面反射光线,利用递归方法并且设定一定的阀值来跟踪;在计算光强度时,我们要考虑场景中物体的反射系数、漫反射系数和镜面反射系数,还有交点处的法向量,出射光线的方向向量;在求视线以及反射光线和场景中物体的交点时,要计算出离眼睛以及出射点最近的交点作为击中点,得到击中点之后,我们就可以计算出击中点的坐标。

最终,通过三个公式计算出每一个像素点处三种光线的光强值,再将三个光强值相加,就得到了该像素点出的总光强值,最后将颜色缓冲器中的三种颜色值输出到屏幕上,就得到了我们需要的光线跟踪图像。

1.2Ray Tracing算法的实现原理(1)对图像中的每一个像素,创建从视点射向该像素的光线;(2)初始化最近时间T为一个很大的值,离视点最近的物体指针设为空值;(3)对场景中的每一个物体,如果从视点出发的光线和物体相交,且交点处的时间t比最近时间T小,则将t的值赋给最近时间T,并设置该物体为最近物体,将物体指针指向该物体;(4)经过第三步的计算后,如果最近物体指针指向空值NULL,则用背景色填充该像素。

如果该指针指向光源,则用光源的颜色填充该像素;(5)如果最近物体指针指向的既不是NULL也不是光源,则从交点向光源发出一条光线,并判断该光线在射向光源的过程中是否被遮挡,如果被遮挡,则该交点对光源不可见;(6)若第五步中的光线在射向光源的过程中没有被遮挡,则该交点对光源可见。

那么从交点到光源做出一条入射光线,并将入射光线单位化。

求出物体表面该交点处的法向量之后,我们就可以利用公式计算出该点的散射光强值、镜面反射光强值,并将它们加到总光强值上;(7)对于反射光线,我们先利用视线和交点处的法向向量求出视线的反射光线,并将其单位化。

然后以交点为视点,以交点处的反射光线为视线递归地进行跟踪,直至达到最大递归深度,我们就得到了加上递归反射光强的总光强值;(8)最后,我们逐行逐个像素的将三种颜色值输出到屏幕上。

至此,通过光线跟踪就得到了一幅质量很高的图像。

2.Ray Tracing算法的具体实现2.1算法的实现环境(1)编程环境:Microsoft Visual C++6.0;(2)图形类类库:MFC;(3)编程语言:C++;(4)显示设备:电脑显示器。

2.2实现算法的C++程序简介该程序由C++编写而成,主要分为以下几个部分:(1)点和向量的定义及运算;(2)光线类的定义及操作;(3)场景中各种物体的材质特征定义和求交计算;(4)光线跟踪过程及图像绘制;2.3算法的具体实现过程(1)点和向量的定义及运算CVector类用来存储向量的坐标值,设置向量的三个坐标值,对向量进行求和、求差、点积、叉积运算,这些运算通过运算符重载来完成。

使用typedef将CVector类重定义为CColor类和CPoint类,从而实现对像素点颜色和点的设置和运算。

CVector类公用成员函数的声明不再详述。

(2)光线类的定义及操作光线包含两个特征参数,即光线的起点和方向。

以上程序段能实现对光线的起点和方向的设置和获取,由起点和方向能唯一地确定出一条光线,并能结合“时间”t写出该光线的方程,以用来进行求交计算。

(3)场景中各种物体的材质特征定义和求交计算通过上面的程序段我们能设置和获取场景中各物体的散射系数、镜面反射系数和反射系数,以用来计算各像素点处的光强值。

通过上面的程序可以具体设置场景中每个物体的位置参数、散射系数、镜面反射系数和反射系数。

对球体和光源来说,我们设置它的球心坐标和半径;对地面和多边形来说,我们设置它的单位法向量和距坐标原点的距离,这样以来,它们的位置就能够确定出来。

上面的程序用来获得球体的球心和半径坐标,以及球面上position位置处的单位法向量。

得到这三个值之后,我们就可以对球体进行求交计算。

上面程序的功能是针对某条射线对球体进行求交计算,返回的结果是“击中”或者“丢失”或者“光线起点在内部”。

当delta大于0时,该光线和球体表面必有两个交点,击中时间分别为t1和t2,且t1<t2,当t1和t2均大于0时,光线起点必在球体外部,此时的击中时间为t1,返回值为“1”。

当t1<0且t2>0时,光线起点在球体内部,此时的返回值为“-1”。

当delta小于或者等于0时,我们认为光线与球体无交点,此时返回值为“0”。

上面的程序实现了光线对地平面(无限大平面)的求交计算,当单位法向量和视线垂直时,dot=0,此时视线与平面平行,函数返回值为MISS=0。

当单位法向量和视线不垂直时,视线和平面必有交点,可以通过公式计算出击中时间t0,当t0大于0且t0不是无穷大时,则把最近击中时间设置为t0,函数返回值为HIT=1。

上面的程序通过视线与无限大平面求交的方法来实现四边形的绘制,当求出击中时间t后,将t代入光线方程即可求出击中点的三维坐标值。

以上面程序中多面体的后面为例,其单位法向量与z轴平行,所以我们只需要将击中点的x坐标值和y坐标值分别与四边形的范围进行比较,x值和y值中任何一个超出范围,就将该点抛弃;只有x值和y值均在四边形范围内时,我们才将该点的返回值设为HIT=0。

通过这种方法我们能绘制出一个四边形。

左面和底面的绘制原理与后面类似,在此不再赘述。

(4)光线跟踪过程及图像绘制Raytrace函数共有5个参数,分别为视线、交点处的总光强、递归深度、反射索引和最近击中时间t。

当递归深度大于最大递归深度时函数停止运行。

初始化物体指针使其指向NULL,然后通过一个循环遍历场景中的所有物体,依次对物体求交,则t的值会不断的变化,最终变成一个所有物体击中时间中的最小值。

最后得到的物体指针指向最小t对应的物体,result为最小t对应的返回结果。

如果物体指针指向空NULL,则该光线和场景中的任何物体都没有交点;如果物体指针指向光源,则将光源的颜色值赋给总光强。

先利用上面求出的最近击中时间t求出交点坐标。

然后从交点向光源中心发出一条光线,求出该光线的时间方程,然后判断该光线是否与场景中的除光源外的物体相交,若相交,则该光线在射向光源的途中被遮挡,则该交点对光源不可见。

若该交点对光源可见,则从交点向光源发出一条光线当作入射线,然后求出交点处的单位法向量,然后通过函数调用分别得到该物体的散射系数和镜面反射系数,再通过两个公式分别计算出该交点处的散射光光强和镜面反射光光强,并把这两个光强值加到总光强上。

反射光的光强通过递归的方法实现,先求出物体的反射系数,计算出交点处的单位法向量。

然后计算出从视点射向交点的光线的反射光线。

然后以该反射光线为视线,以反射光强为总光强继续进行光线跟踪,且达到递归深度后停止递归,将得到的总光强(即反射光光强)加到原来的总光强上。

至此,该像素点处的总光强已求出,接下来就可以进行该像素点的绘制。

上面的程序的功能是逐行逐像素的绘制图像。

direction为从视点出发射向场景的光线的向量,然后将其单位化,求出方向向量之后,就得到了定义好的视线r。

针对每一条视线调用光线跟踪程序得到交点处的总光强,通过总光强可求出交点处红、绿、蓝三种颜色的强度值,然后利用颜色缓冲器将这三种颜色值输出到屏幕上显示出来。

至此,利用光线跟踪算法绘制图像已完成。

2.4 程序运行结果3.总结3.1 通过该算法学到的东西通过Ray Tracing算法的实现,我学会了在C++程序中如何对向量进行运算,因为本程序所有的运算都是基于向量的;对递归思想有了更深入的理解;使我的面向对象编程技术有了很大的提升,懂得了如何用C++做出一个大项目,这其中涉及到头文件的编写、源文件的编写、头文件的组织以及整个程序文件的组织,使大量的C++文件有条不紊的运行;还学习到了MFC绘图的相关知识。

总之,这次作业的完成使我获益匪浅。

3.2本程序未完成的任务本程序只实现了球体和立方体的三个面,没有完整的做出立方体,因为在画立方体别的面时,该面将其他的物体遮挡,改变该面的法向量之后还不能解决,原因有可能是光线跟踪程序中的跟踪过程只适用于球体,即有限空间的物体。

而立方体的面是由无限大的平面限制范围而求得,所以跟踪过程中出现遮挡问题。

若定义立方体的面时定义为有限空间,而不是通过限制无限平面空间来求得,可能会得出正确结果,限于时间原因,还没有对其进行验证。

4.参考文献[1]Francis S Hill, Jr. Stephen M Kelley.计算机图形学.北京:清华大学出版社,2009.[2]Stanley B.Lippman Barbara E .Moo等.C++Primer中文版.北京:人民邮电出版社,2006.[3]谭浩强.C++程序设计.北京:清华大学出版社,2004.[4].。