概率与概率分布 Probability and probability distributions

概率空间和概率分布的关系

概率空间和概率分布的关系Probability space and probability distribution are closely related concepts in the field of probability theory. A probability space consists of three components: a sample space, a set of events, and a probability measure. The sample space is the set of all possible outcomes of an experiment, the set of events is a collection of subsets of the sample space, and the probability measure assigns probabilities to each event in the set of events. The probability distribution, on the other hand, describes the likelihood of each possible outcome of a random variable. It provides a mathematical model for the randomness inherent in a system or process.概率空间和概率分布在概率论领域密切相关。

概率空间包括三个组成部分:样本空间、事件集和概率度量。

样本空间是实验的所有可能结果的集合,事件集是样本空间的子集的集合,概率度量给事件集中的每个事件分配概率。

另一方面,概率分布描述了随机变量每个可能结果的可能性。

它为系统或过程中固有的随机性提供了数学模型。

In a probability space, the sample space represents all the possible outcomes of an experiment, which is the foundation of the entireprobability theory. It provides a framework for analyzing uncertainty and making predictions based on statistical data. The set of events in a probability space is crucial for determining the probability of various outcomes and understanding the likelihood of different scenarios. The probability measure assigns a numerical value to each event in the set of events, representing the likelihood of that event occurring. It is a fundamental concept that enables us to quantify uncertainty and make informed decisions.在概率空间中,样本空间代表实验的所有可能结果,这是整个概率论的基础。

概率分布函数与概率密度函数

概率分布函数与概率密度函数概率分布函数(Probability Distribution Function, PDF)和概率密度函数(Probability Density Function, PMF)是概率论与数理统计中常用的两种描述随机变量分布特征的函数。

在实际应用中,它们被广泛用于描述各种不同类型的概率分布。

一、概率分布函数(PDF)概率分布函数,简称PDF,在统计学中用于描述离散型随机变量的分布概率。

设X是一个离散型随机变量,则PDF f(x)定义为:对于任意实数x, f(x) P(X=x),表示X=x的概率。

通过概率分布函数,我们可以得到随机变量X取不同值的概率。

当然,对于离散型随机变量,概率分布函数是一条递增的阶梯函数,因为它可以描述每一个取值点的概率。

二、概率密度函数(PMF)概率密度函数,简称PMF,在统计学中用于描述连续型随机变量的分布概率。

设X是一个连续型随机变量,则PMF f(x)定义为:对于任意实数x1 x2, P(x1 X x2) x1 x2 f(t)dt,表示X的取值在区间(x1,x2)上的概率。

与离散型随机变量的概率分布函数不同,连续型随机变量的概率密度函数不代表某一个具体取值点上的概率,而是代表在某一个区间上的概率密度。

因此,概率密度函数是一个连续的函数。

总结起来,概率分布函数和概率密度函数的差别可以从两个方面来看:一是离散型和连续型随机变量的差异,二是描述的对象不同。

在实际应用中,我们常常使用这两种函数来计算随机变量的各种性质,如均值、方差等。

另外,通过概率分布函数和概率密度函数,我们可以进行随机变量之间的运算、变换和组合等。

需要注意的是,概率分布函数和概率密度函数的定义域是不同的。

对于离散型随机变量,概率分布函数的定义域是变量的所有可能取值点;对于连续型随机变量,概率密度函数的定义域是整个实数轴。

总结:概率分布函数用于描述离散型随机变量的分布概率,是一条递增的阶梯函数;概率密度函数用于描述连续型随机变量的分布概率密度,是一个连续的函数;它们在描述分布特征、计算性质等方面起着重要的作用。

如何理解概率分布函数和概率密度函数

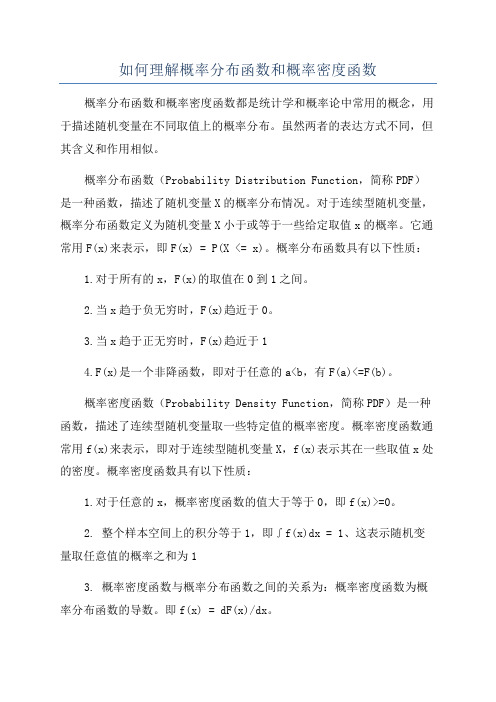

如何理解概率分布函数和概率密度函数概率分布函数和概率密度函数都是统计学和概率论中常用的概念,用于描述随机变量在不同取值上的概率分布。

虽然两者的表达方式不同,但其含义和作用相似。

概率分布函数(Probability Distribution Function,简称PDF)是一种函数,描述了随机变量X的概率分布情况。

对于连续型随机变量,概率分布函数定义为随机变量X小于或等于一些给定取值x的概率。

它通常用F(x)来表示,即F(x) = P(X <= x)。

概率分布函数具有以下性质:1.对于所有的x,F(x)的取值在0到1之间。

2.当x趋于负无穷时,F(x)趋近于0。

3.当x趋于正无穷时,F(x)趋近于14.F(x)是一个非降函数,即对于任意的a<b,有F(a)<=F(b)。

概率密度函数(Probability Density Function,简称PDF)是一种函数,描述了连续型随机变量取一些特定值的概率密度。

概率密度函数通常用f(x)来表示,即对于连续型随机变量X,f(x)表示其在一些取值x处的密度。

概率密度函数具有以下性质:1.对于任意的x,概率密度函数的值大于等于0,即f(x)>=0。

2. 整个样本空间上的积分等于1,即∫f(x)dx = 1、这表示随机变量取任意值的概率之和为13. 概率密度函数与概率分布函数之间的关系为:概率密度函数为概率分布函数的导数。

即f(x) = dF(x)/dx。

概率分布函数和概率密度函数的关系可以通过求导和积分互相转化。

对于连续型随机变量X,其概率分布函数可以通过概率密度函数进行计算,即F(x) = ∫f(t)dt,其中t的取值范围为(-∞, x)。

反过来,概率密度函数可以通过概率分布函数求导得到,即f(x) = dF(x)/dx。

理解概率分布函数和概率密度函数的重要性在于可以通过它们来描述和分析随机变量的概率分布特征。

概率分布函数可以用于计算随机变量取不同取值的概率,以及计算概率的分布情况,例如均值、方差和偏度等。

Probability Distribution-概率及概率分布

---条件概率

---随机变量 ---常用随机变量的分布:二项、泊松、均匀、指数、正态 ---数学期望、方差

概率分布-2

1、 随机实验,样本空间,随机事件

在一定条件下,并不总是出现相同结果的现象称为随机现象。

对随机现象进行观察和试验称为随机试验。

在随机试验中可能发生也可能不发生的事件称为随机事件(A、B)。 在随机试验中所有可能出现的结果组成的集合称为样本空间(S)。 集合表示: 例:抛一枚均匀骰子。事件A表示“大”即“4、5、6点”,如果

概率分布-15

例4:设N件产品中有K件是次品,N-K件是正品, K<N.现从N件中每次任意抽取1

件产品,在检查过它是正品或是次品后再放回,这样共抽取了n次.

求:事件A={所取的n件产品中恰有k件次品}的概率,k=0,1,2,…,n.

解:假定N件产品是有编号的,从中任意取出一件,每次 都有N种取法.由乘法原理,n次共有Nn种取法,所以基本 事件总数为Nn。 当所取的n件产品中恰有k件次品时,由于取到这k件次品 的次序的不同,因此从次序考虑共有Cnk种情况 。

概率分布-23

概率的的性质与运算法则

一)概率的公理定义 设E是随机试验,Ω 是它的样本空间,对于Ω中的每一 个事件A,赋予一个实数,记为P(A) ,称为事件A的概率, 如果集合函数 P(A) 满足下述三条公理: 公理1 0≤P(A)≤1 公理2 P(Ω )=1 (1) (2)

公理3 若事件A1, A2 ,… 两两互不相容,则有 (3) 这里事件个数可以是有限或无限的(必须是可列的) .

P( AB) P( A) P( B)

事件A出现 m2次

事件A在各轮试验中频率形成一个数列

ms m1 m2 n1 n2 ns

概率分布函数与概率密度函数

概率分布函数与概率密度函数概率分布函数与概率密度函数是概率论中两个重要的概念,用于描述和分析随机变量的概率分布特征。

本文将介绍概率分布函数(Probability Distribution Function,简称PDF)和概率密度函数(Probability Density Function,简称CDF)的定义与性质,并通过实例说明它们的应用。

一、概率分布函数(Probability Distribution Function)概率分布函数是描述随机变量取某个特定值的概率的函数。

其定义为随机变量X的分布函数,记作F(x),即F(x) = P(X ≤ x)。

其中,P(X ≤ x)表示随机变量X小于等于x的概率。

概率分布函数具有以下性质:1. 对于任意的实数x,0 ≤ F(x) ≤ 1,即概率分布函数的取值范围在[0,1]之间。

2. F(x)是非降函数,即当x1 < x2时,有F(x1) ≤ F(x2)。

3. F(x)是右连续函数,即当x→x0+时,有F(x)→F(x0)。

概率分布函数的图像是一个递增且不断向上逼近1的曲线。

通过概率分布函数,可以计算出随机变量X在某个区间内的概率。

例如,对于连续型随机变量X,可以使用积分来求得区间概率,即P(a ≤ X ≤ b) = F(b) - F(a)。

二、概率密度函数(Probability Density Function)概率密度函数是描述连续型随机变量概率分布的函数。

其定义为随机变量X在一点x附近单位长度上的概率,记作f(x)。

即在微小的区间(dx)内,随机变量X取值在x附近的概率为f(x)dx。

概率密度函数具有以下性质:1. f(x) ≥ 0,即概率密度函数的取值非负。

2. 随机变量X在整个样本空间的概率等于1,即∫f(x)dx = 1。

概率密度函数描述了连续型随机变量的概率分布情况,其图像是一个连续的曲线。

通过概率密度函数,可以计算出随机变量X在某个特定取值处的概率密度。

统计学_概率和概率分布

试验(trial):同一组综合条件的实现。

随机试验(random

trial) 试验的每一最基本的结果称为基本事件 (elementary event)。基本事件用小写 拉丁字母a,b,x等表示。 基本事件的集合称为事件(event),通 常用大写的拉丁字母A,B,…表示。

事件的几种基本运算

不同于离散型随机变量任何值都可以求出它

的概率。 连续型随机变量在试验中可以取某一区间内 的任何值,这些数值构成不可数的无穷集合。

特点1:任一确定的x概率都是0,但

并非该事件不发生。不能给随机变 量X的每一个值得出一个概率,只能 给X中的任意区间给出概率。

概率函数

概率

连续型概率的特点2:

1.先用符号/等式列出题目中的所给的信息;

2.再用符号/等式写出要求什么;

3.找公式计算。

§2.2 概率分布 变量可是定量的,也可以是定性的。 1、变量——可以测量的任何特征或属

定量变量(quantitative variable):亦称为数 性Any characteristic or attribute that can 随机变量 值变量,变量值是定量的,表现为数值大小, be measured。 (不同个体结果可能不同) 一般有度量衡单位。e.g. 身高、体重。 • 2、随机变量——在概率论中称变量为随机 随机变量(random variable) 定性变量(qualitative variable):亦称为分类 变量 变量,其变量值是定性的,表现某个体属于 观测值(observation) • 几种互不相容的类型中的一种。e.g. 血型,值 3 、 观 测 值 ( observed value ) 、 变 量 豌豆花的颜色。 (value of variable)、资料(data) —— 离散型随机变量(discrete random variable) 变量的测得值。 连续型随机变量(continuous random variable) 常数(constant):是不能给予不同数值的变 量,代表事物特征和性质的数值。e.g.样本平 均数,标准差。

概率与概率分布(课件三)

率。

第六章、概率与概率分布:基础知识

概率 主观概率是基于个人的经验、智慧和对事物的愿望

而估计出的概率。例如,我问同学们中学生考取

一本的概率是多大,一位来自农村普通中学的学

生可能会报告出一个相当低的概率,而另一位来 自城市重点中学的同学可能会报告出相当大的概 率。在不知道具体情况和所有可能的情况下,我 们报告的概率只能依赖于个人的经验、智慧和愿

第六章、概率与概率分布:基础知识 经验概率的基础知识

2.随机性与立独性(random and independent) 随机性意味着一事件出现是不被知晓的,我们最多可以估计 它出现的概率,随机事件的出现没有特定模式和稳定特

征。例如,在抛硬币过程中,正面朝上事件是不知的,

我们可以估计它的概率是50%,这样的事件就具有随机 性。

同时发生,它们就是两个相互包含事件。

第六章、概率与概率分布:概率计算规则 概率的公理

概率的公理系统包括以下内容:概率不能为

负数,取值在0—1之间;必然事件出现的

概率为1;不可能事件出现的概率为0。

第六章、概率与概率分布:概率计算规则

概率的加法定理 当A和B是相互排除事件时,他们同时出现的概率是0,即p (A and B)=0,这时A或B出现的概率为:p(A+B)=p(A) +p(B)。当有n个相互排除事件时,

第六章、概率与概率分布:概率分布 概率分布的类型

3.随机变量分布与样本分布

P(A1+A2+…+An)=P(A1)+P(A2)+ …+P(An)。当P(A and

B) ≠0时,即A和B 相互包含时,P(A+B)=P(A)+P(B) - P(A and B)。

应用统计学(第四章 概率与概率分布)

服从正态分布N(μ,σ2)的随机变量,x的取值落在区间 [x1,x2) 的概率P(x1≤x<x2),等于服从标准正态分布的随机变 量u在[(x1-μ)/σ, (x2-μ)/σ)内取值的概率。

u x

P(a u b) Φ(b) Φ(a) P( u a) 2Φ(a) P( u <a) 1 2Φ(a) P(0 u<a) Φ(a) 0.50 P(u a) 1 Φ(a) Φ(a)

1)正态分布的特征

a. x=μ 时 f(x) 值最大,密度曲线以μ为中心分布

b. x-μ绝对值相等时f(x) 相等,密度曲线以μ为中心两侧 对称

c. f(x)是非负函数,以x轴为渐近线

d.正态分布曲线由参数μ,σ 决定, μ 确定正态分 布曲线在x轴上的中心位置,σ 确定正态分布的变异度

e.正态分布曲线在x =μ±σ 处各有一个拐点,曲线通

是根据随机事件本身的特性直接计算其概率 随机事件若满足

试验的所有可能结果只有有限个,即样本空间中的基本 事件只有有限个

各个试验的可能结果出现的可能性相等,即所有基本事 件的发生是等可能的

试验的所有可能结果两两互不相容

则若样本空间由n个等可能的基本事件所构成,其中事件A 包含有m个基本事件,则事件A的概率为m/n,即 P(A)=m/n

x-

x+

b.连续型变量的概率分布

连续型随机变量的概

率分布因取值数不可数而 样本容量 n 足够大时,频率分

不能用分布律来表示

布趋于稳定,近似地看成总

体概率分布

n 无限大时

频率转化为概率 频率密度转化为概率密度 频率分布转化为概率分布 曲线为总体概率密度曲线 函数f(x)称为概率密度函数

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Ian Jolliffe University of Aberdeen

CLIPS module 3.4b

Probability and Statistics

Probability starts with a population, often described by a probability distribution, and predicts what will happen in a sample from that population. Statistics starts with a sample of data, and describes the data informatively, or makes inferences about the population from which the sample was drawn. This module concentrates on the inferential, rather than descriptive, side of Statistics.

Representative samples

In the previous two Slides we have used the phrase ‘sample of relevant data’ It is crucial that the sample of data you use to make inferences about a population is representative of that population; otherwise the inferences will be be biased Designing the best way of taking a sample is a third (as well as description and inference) aspect of Statistics. It is important, but it will not be discussed further in this module

Three types of statistical inference II

Hypothesis testing: given a sample of relevant data, test one or more specific hypotheses about the population from which the sample is drawn. For example, is the mean maximum temperature in June higher at Station A than at Station B? Is the daily probability of precipitation at Station A in October larger or smaller than 0.5?

Estimates and errors

The need for probability and statistics arises because nearly all measurements are subject to random variation One part of that random variation may be measurement error By taking repeated measurements of the same quantity we can quantify the measurement error –

Probability vs. Statistics: an example II

Statistics: for a new station we may wish to estimate the long-term (population) mean maximum temperature, and its standard deviation, based on the small amount of relevant data collected so far.

Probability vs. Statistics: an example

Probability: suppose we know that the maximum temperature at a particular station has a Gaussian distribution with mean 27o C and standard deviation 3o C. We can use this (population) probability distribution to make predictions about the maximum temperature on one or more days.

Three types of statistical inference

: given a sample of relevant data find an estimate of the (population) mean maximum temperature in June at a station? Or an estimate of the (population) probability of precipitation in October at a station? Interval estimation: given a sample of relevant data, find a range of values within which we have a high degree of confidence that the mean maximum temperature (or the probability of precipitation) lies